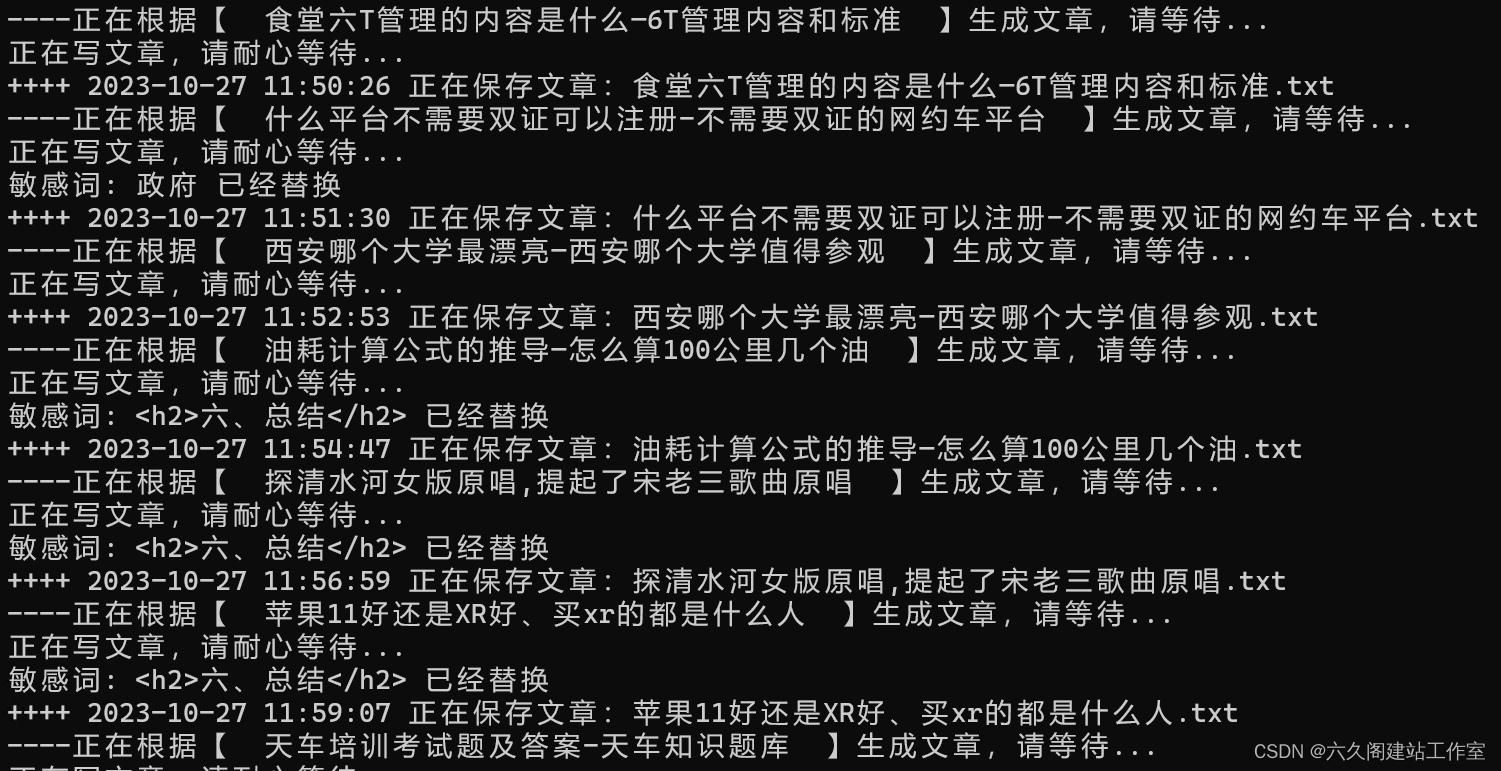

搭建网站

位运算

系统

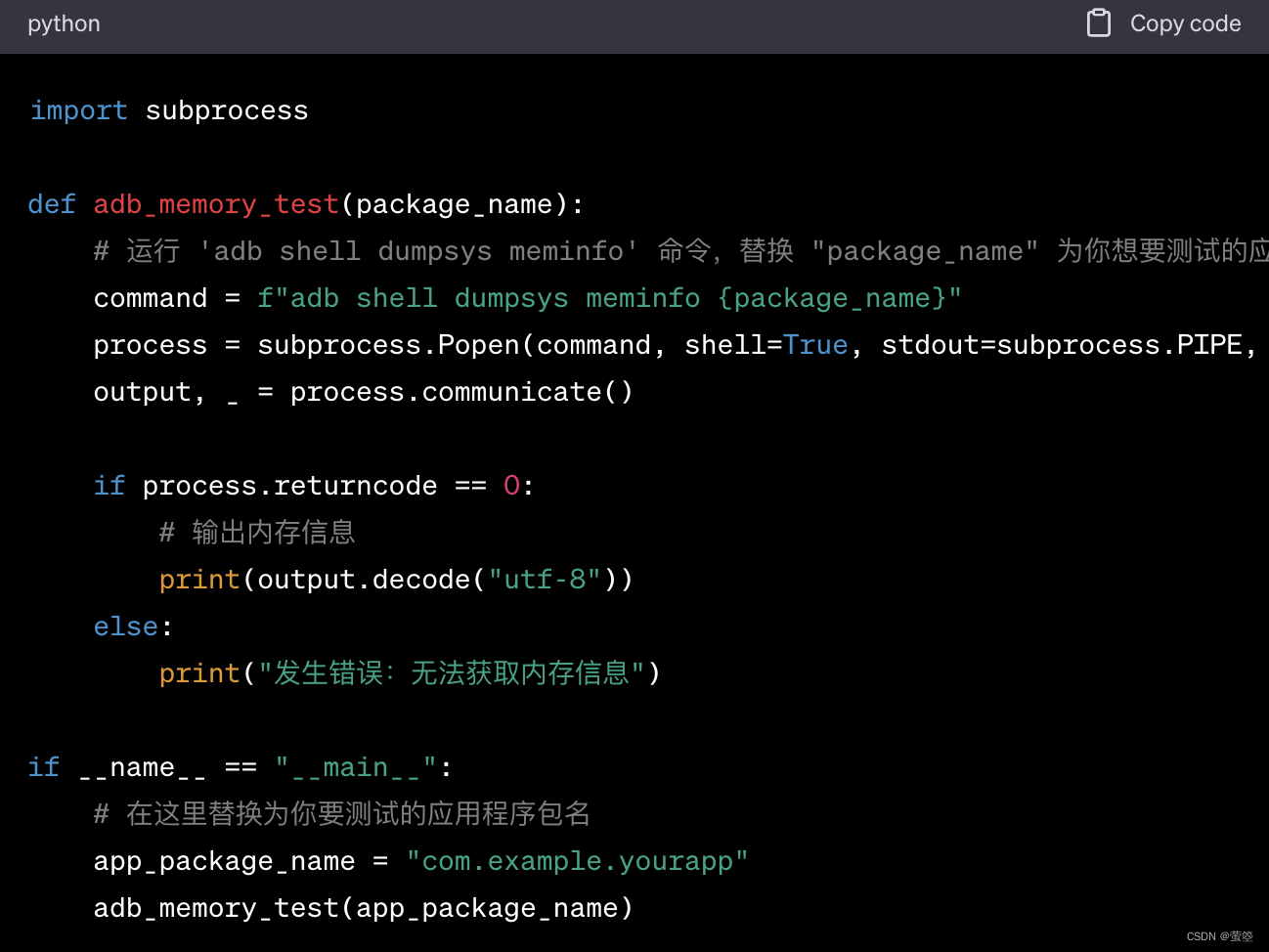

android-studio

位置式PID

FANUC机器人

栈

hevc

计算机毕业设计

RE理论干扰源的分析

Themida

3D游戏建模

软件工程师

期末作业

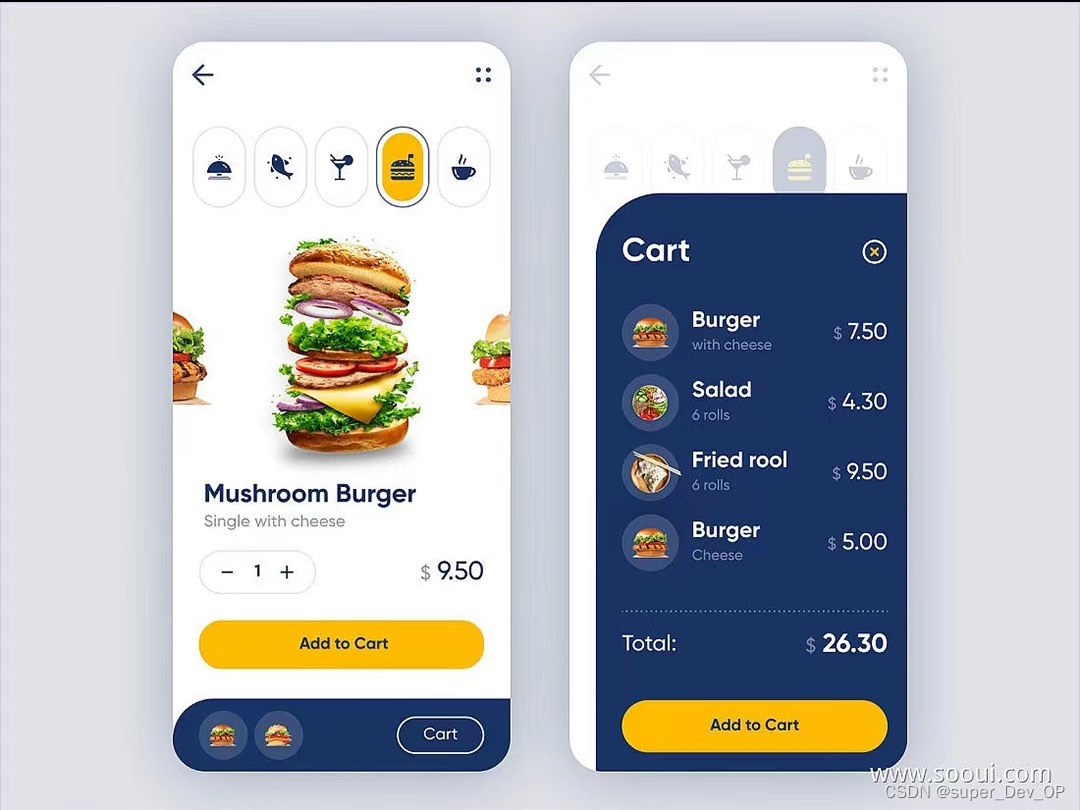

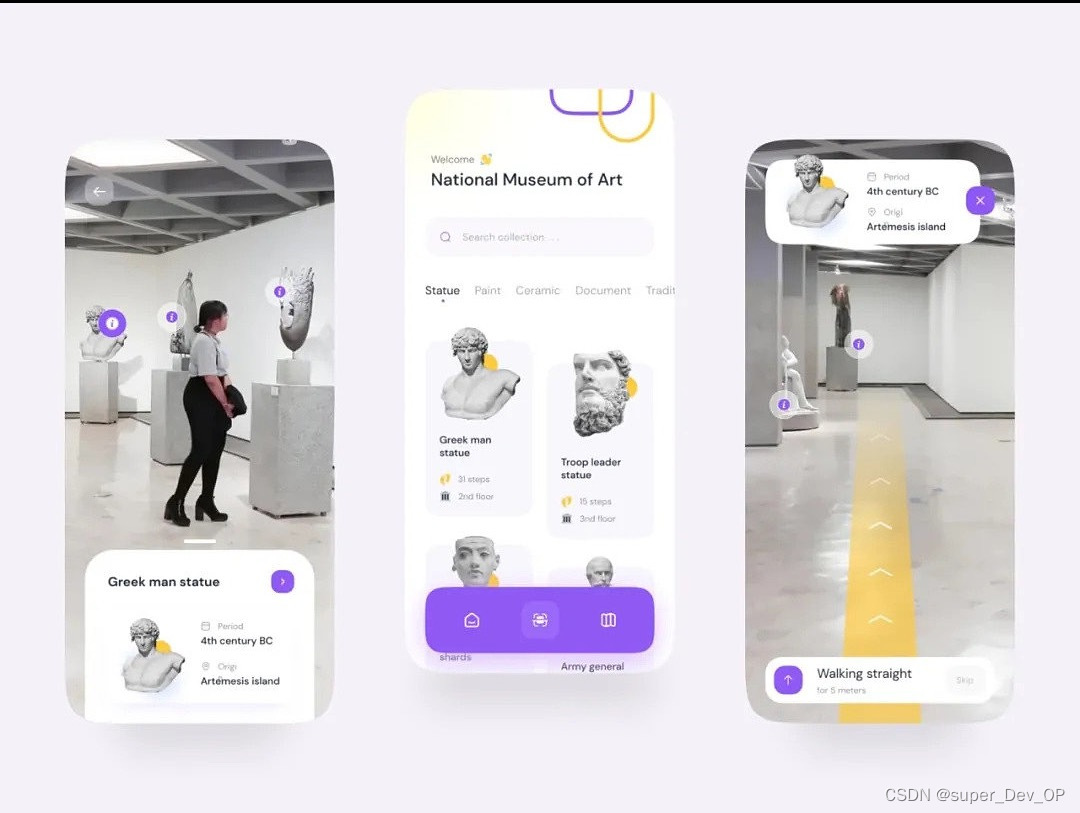

App应用程序

地图随机数据

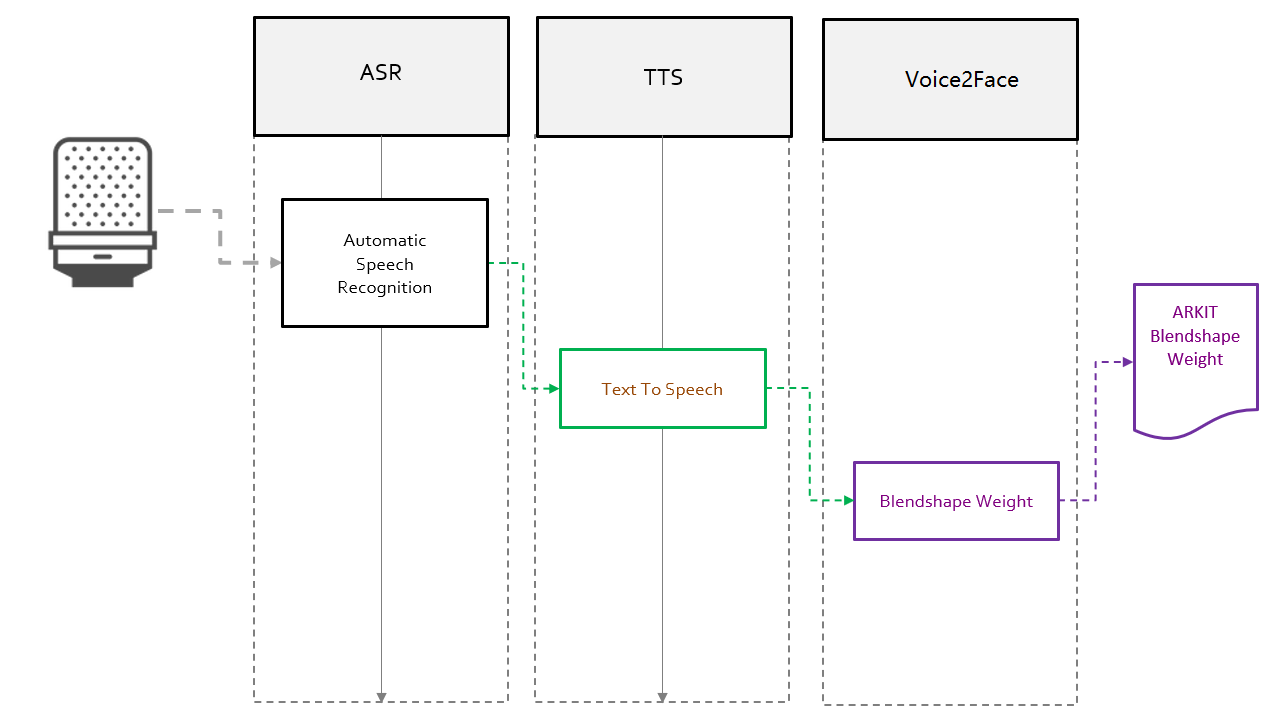

虚拟主播

paddle

案例

激光雷达

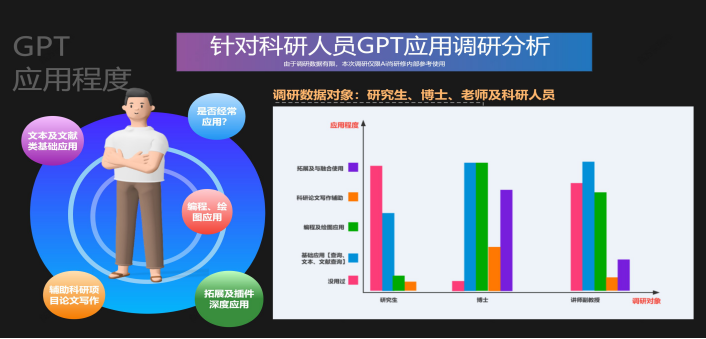

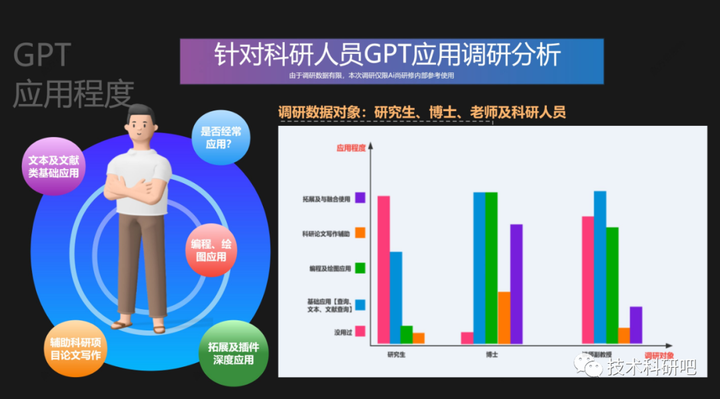

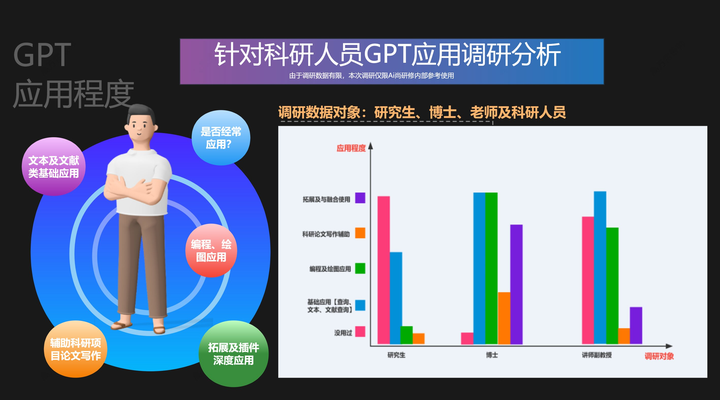

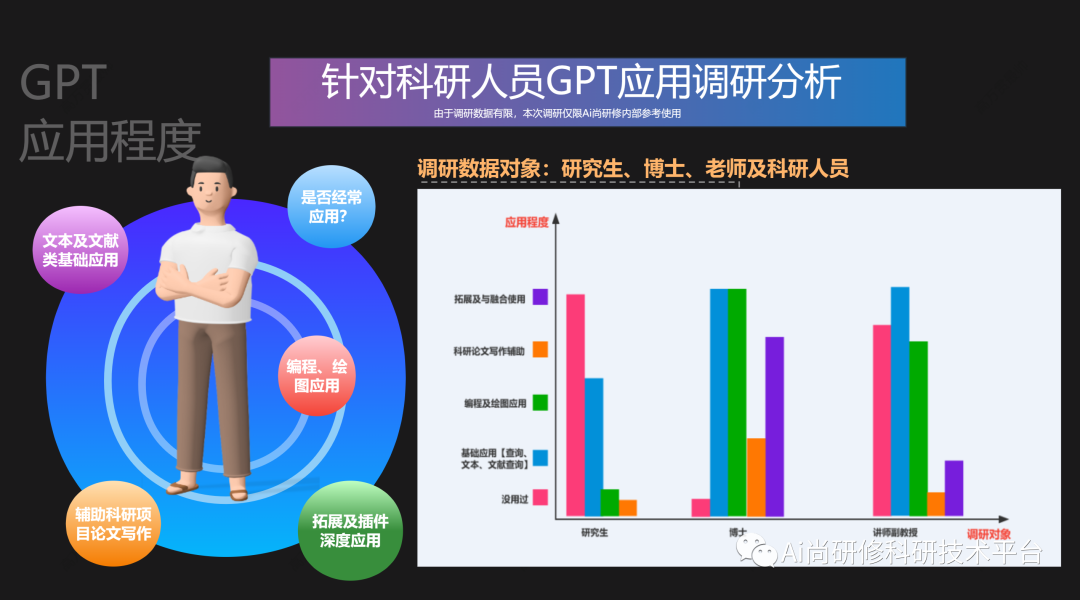

GPT

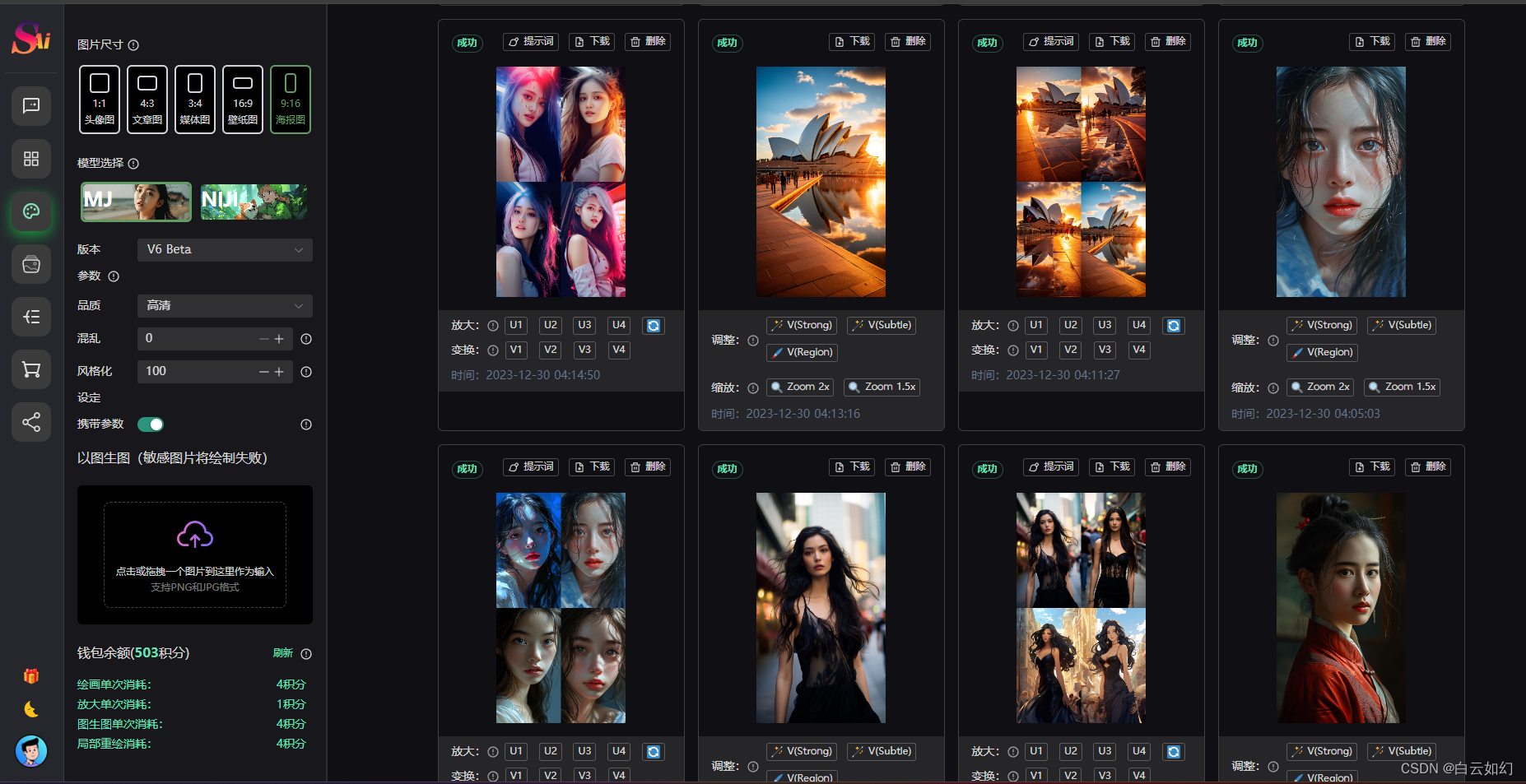

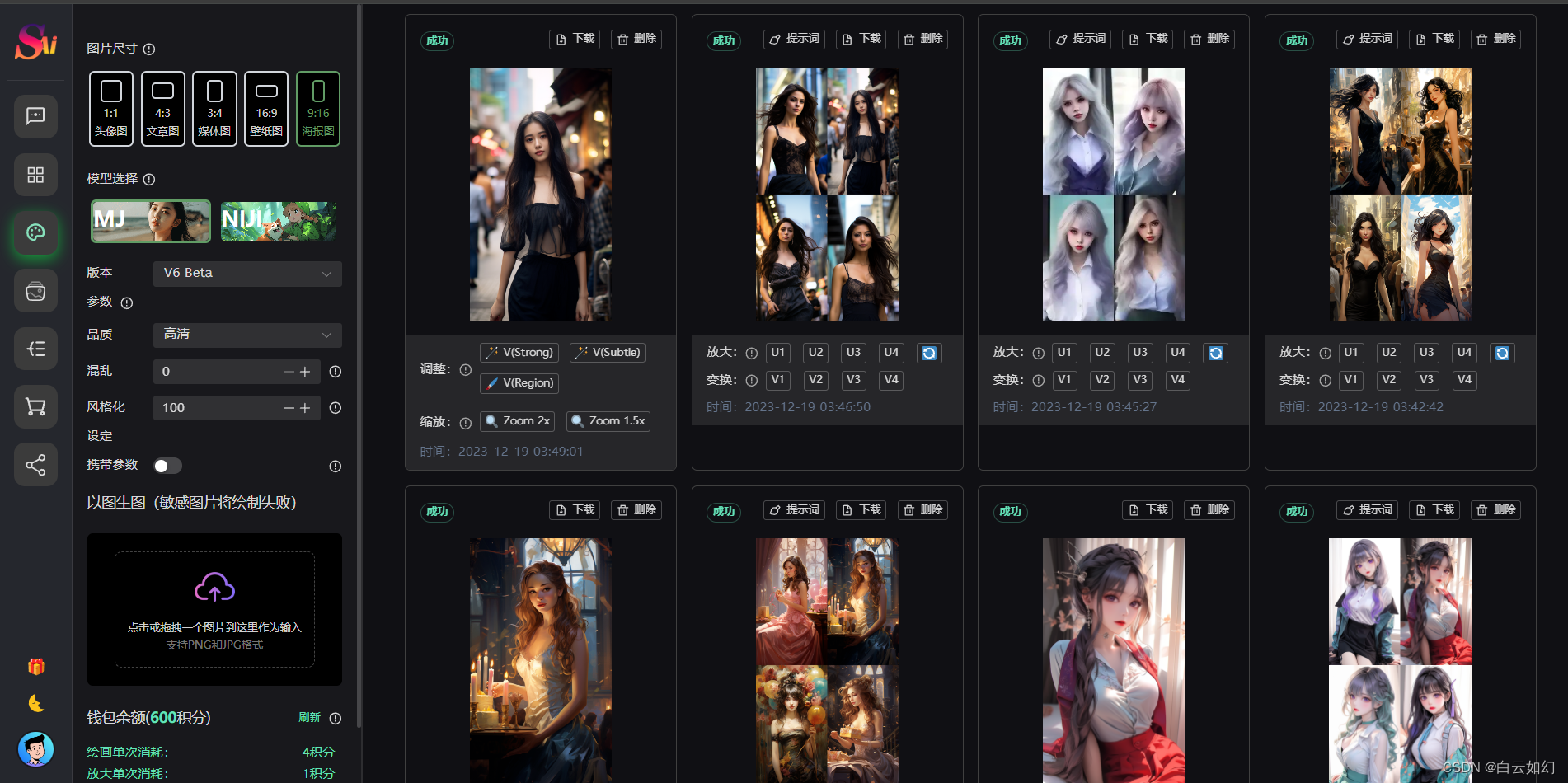

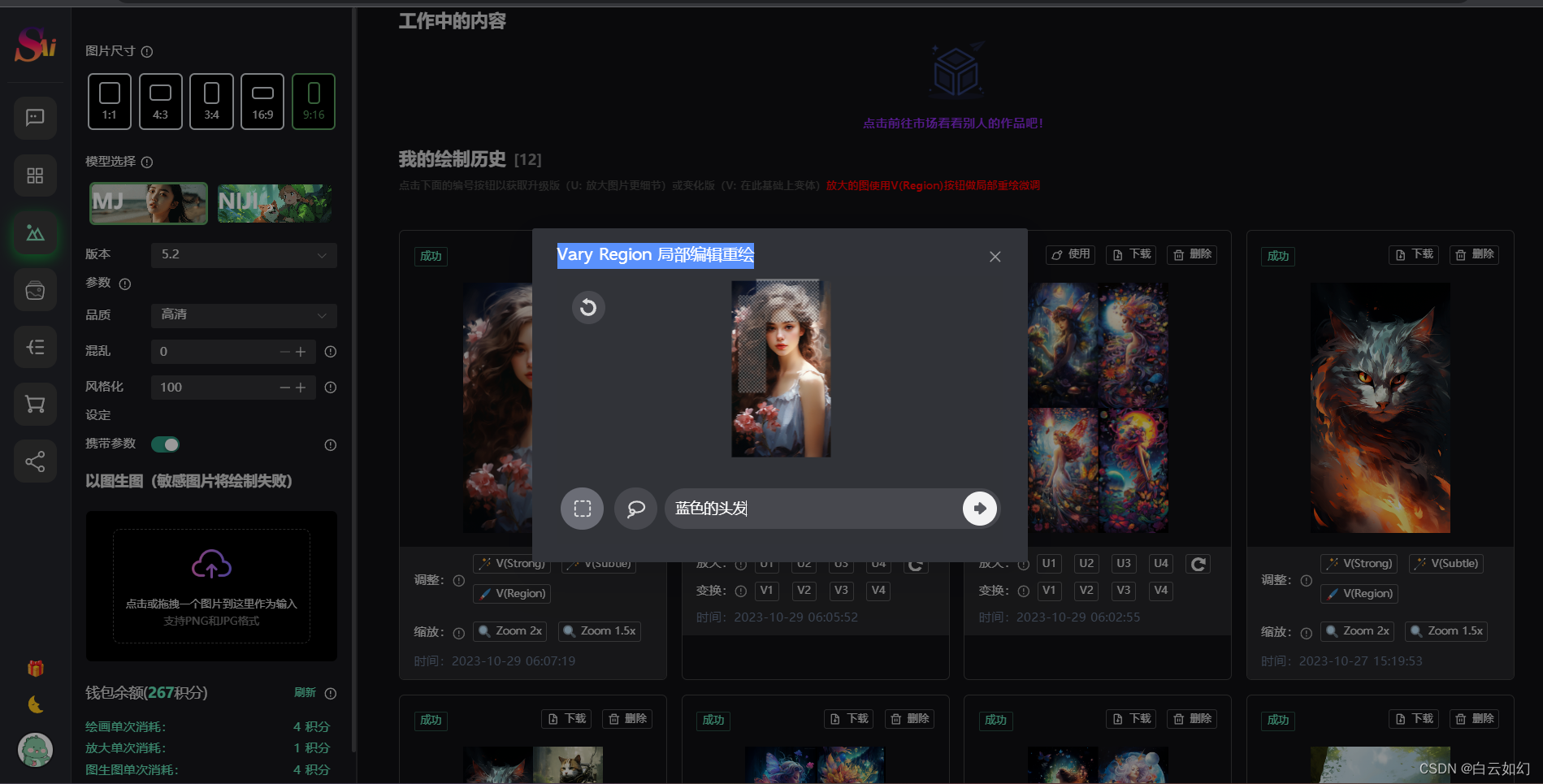

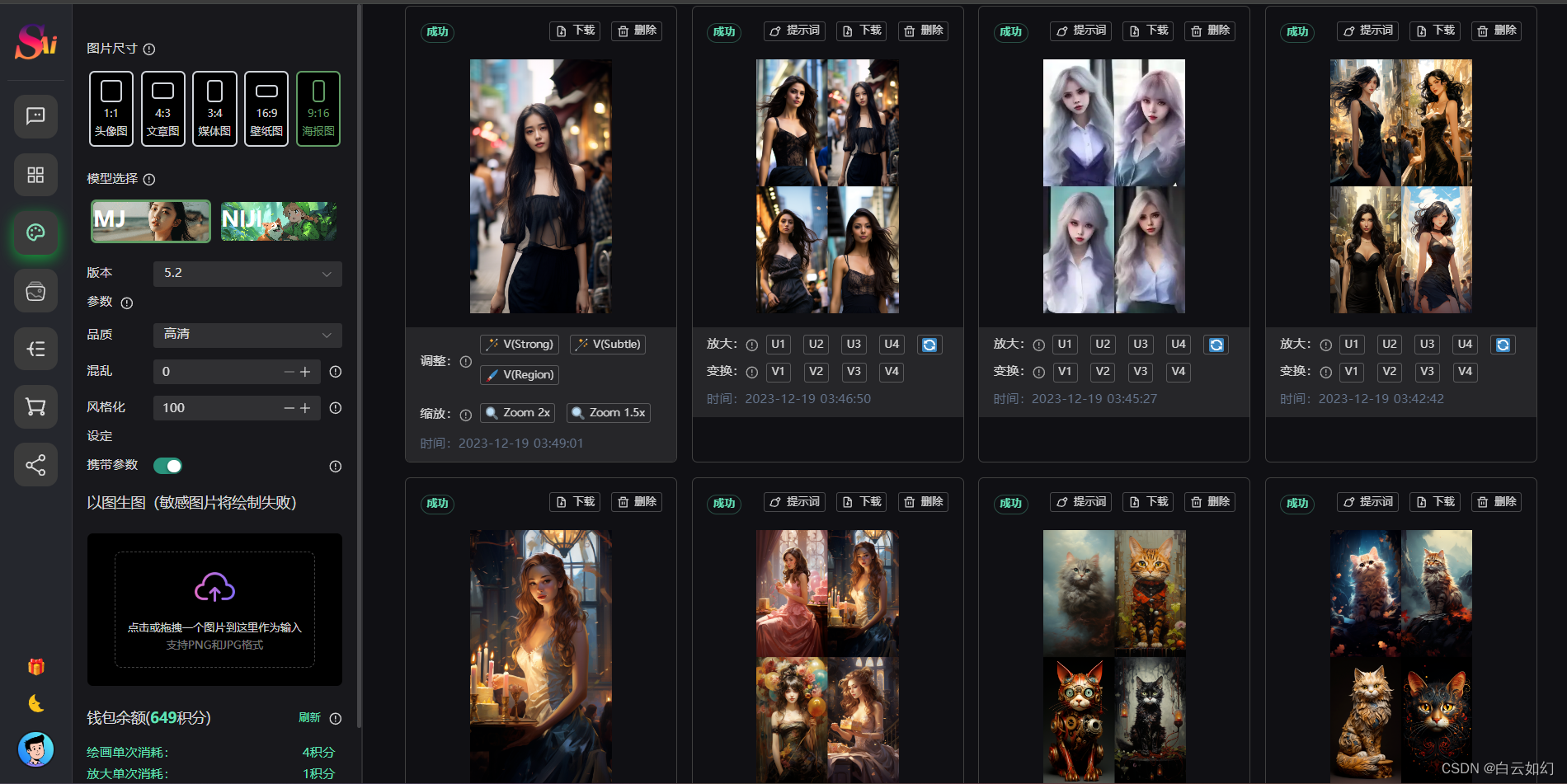

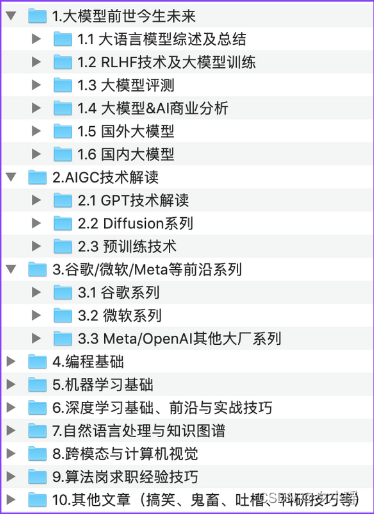

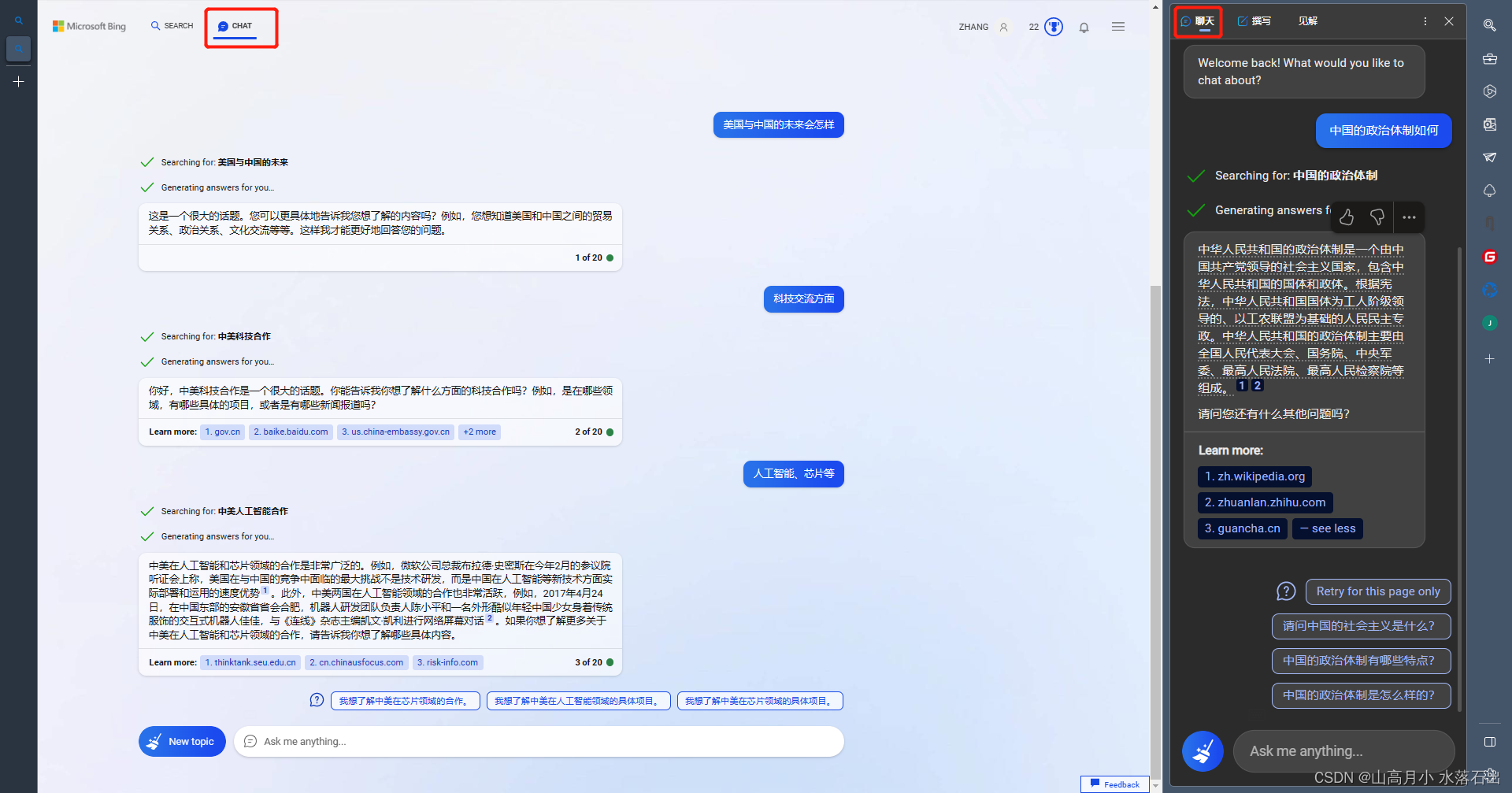

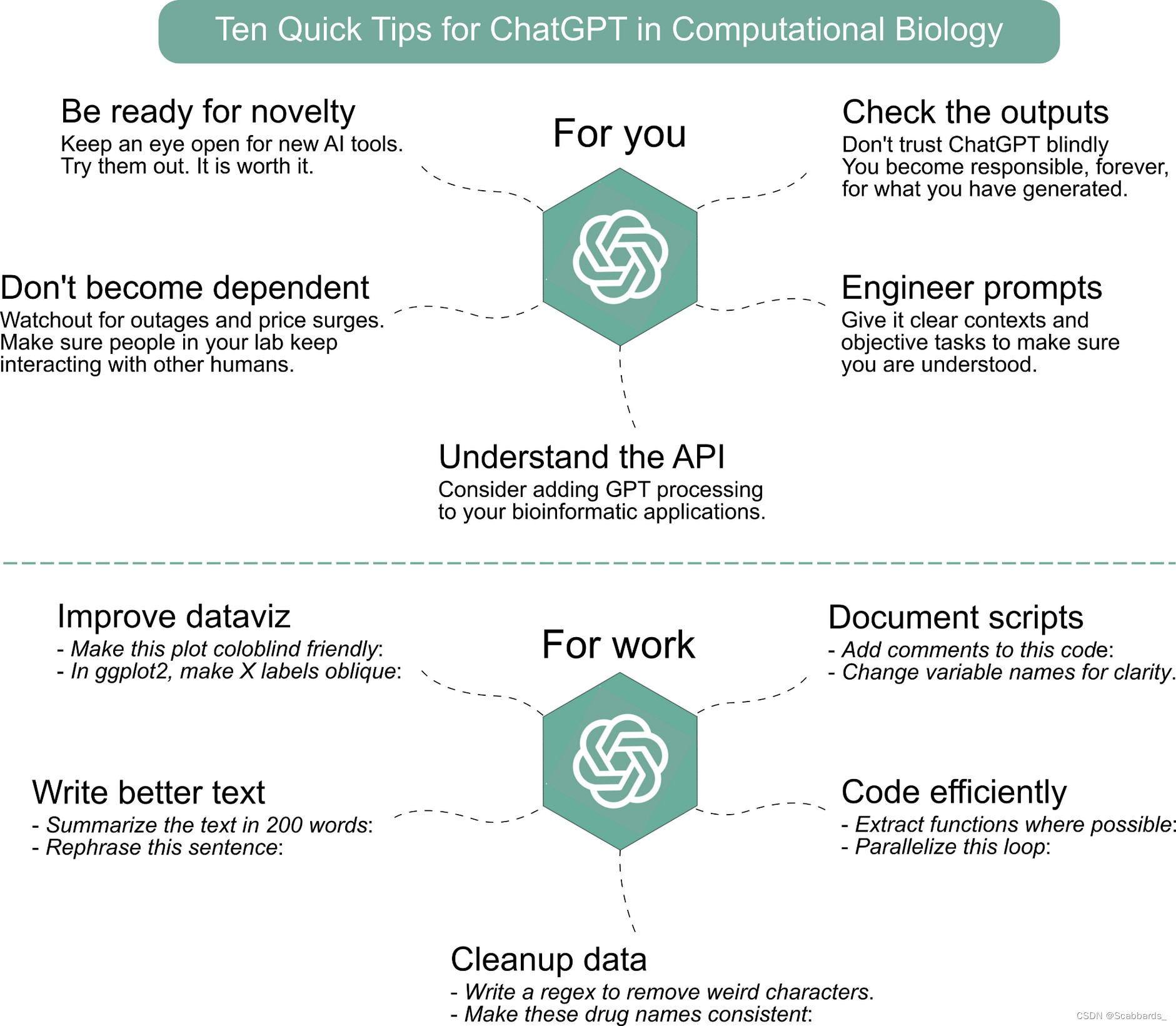

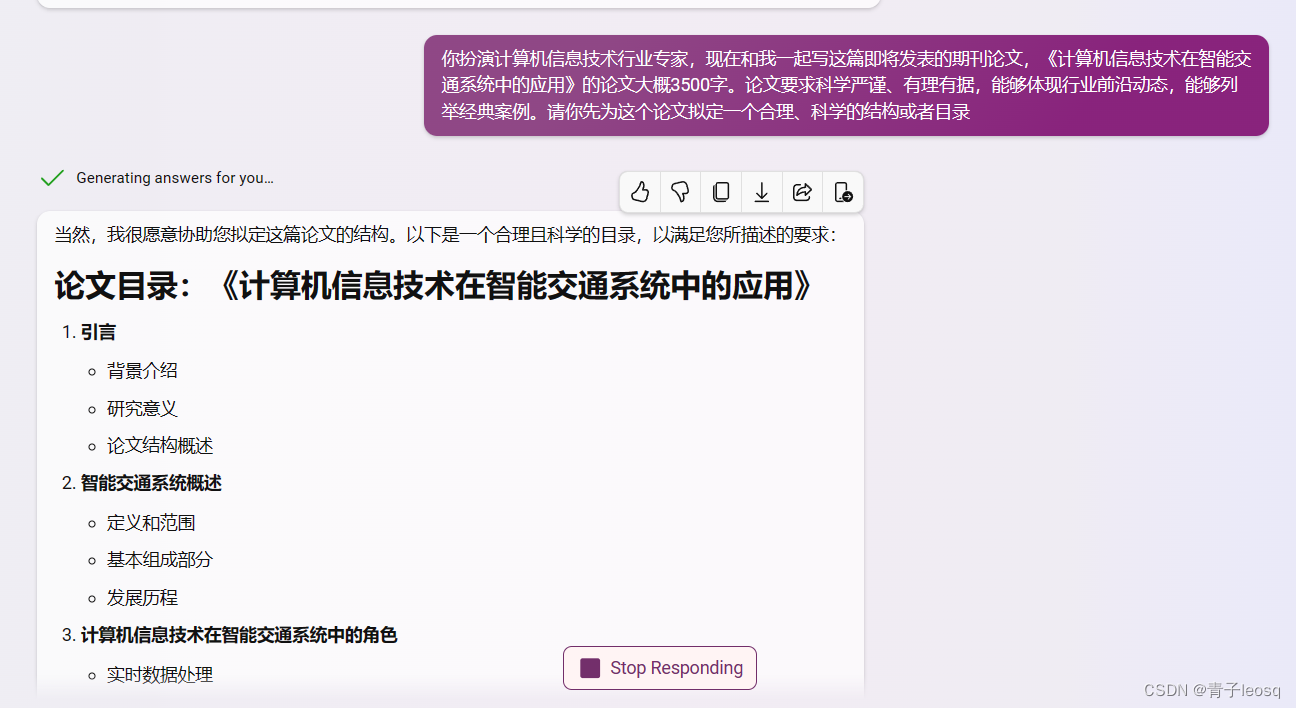

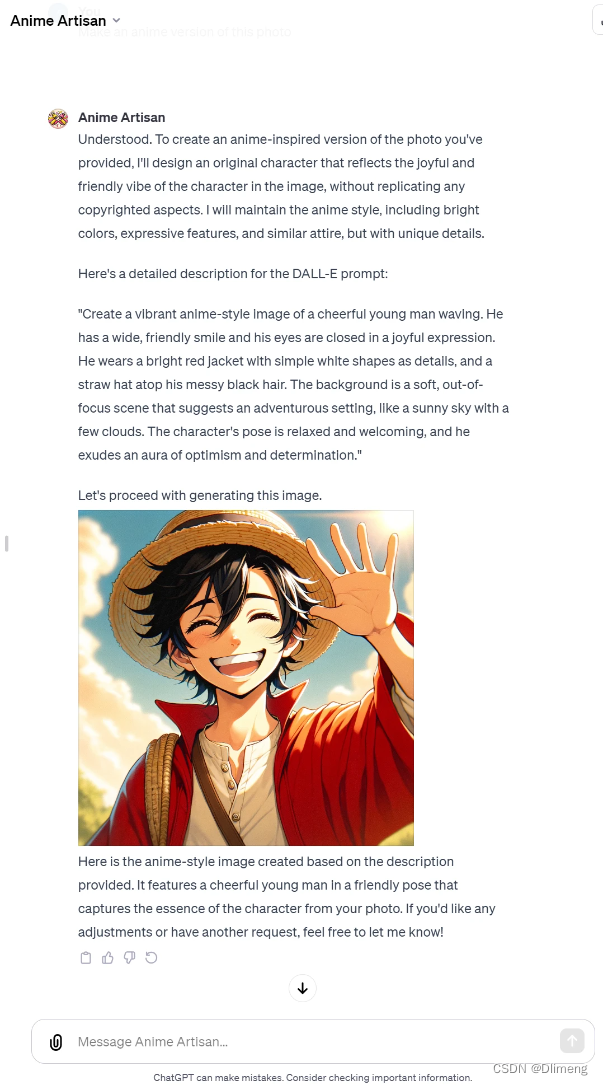

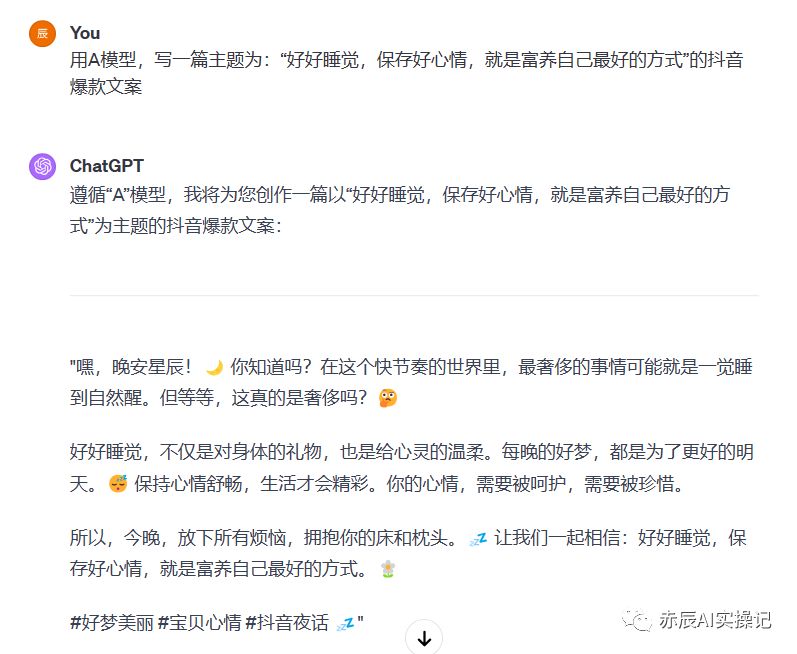

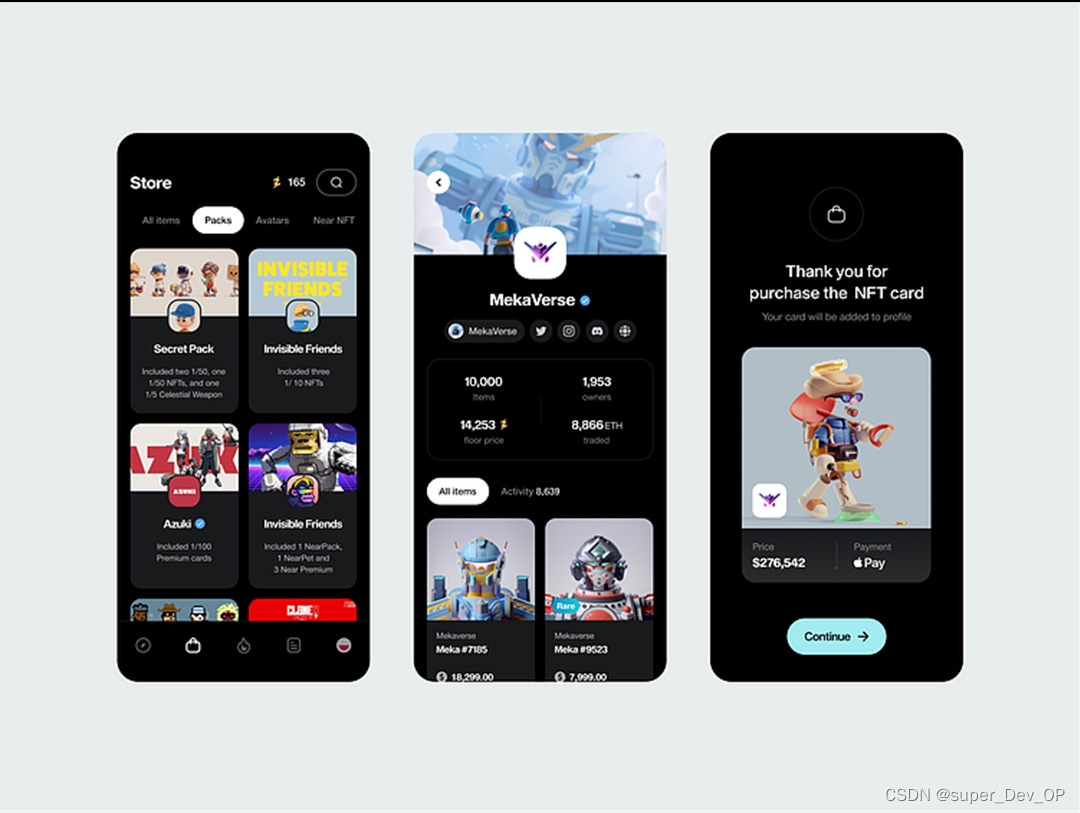

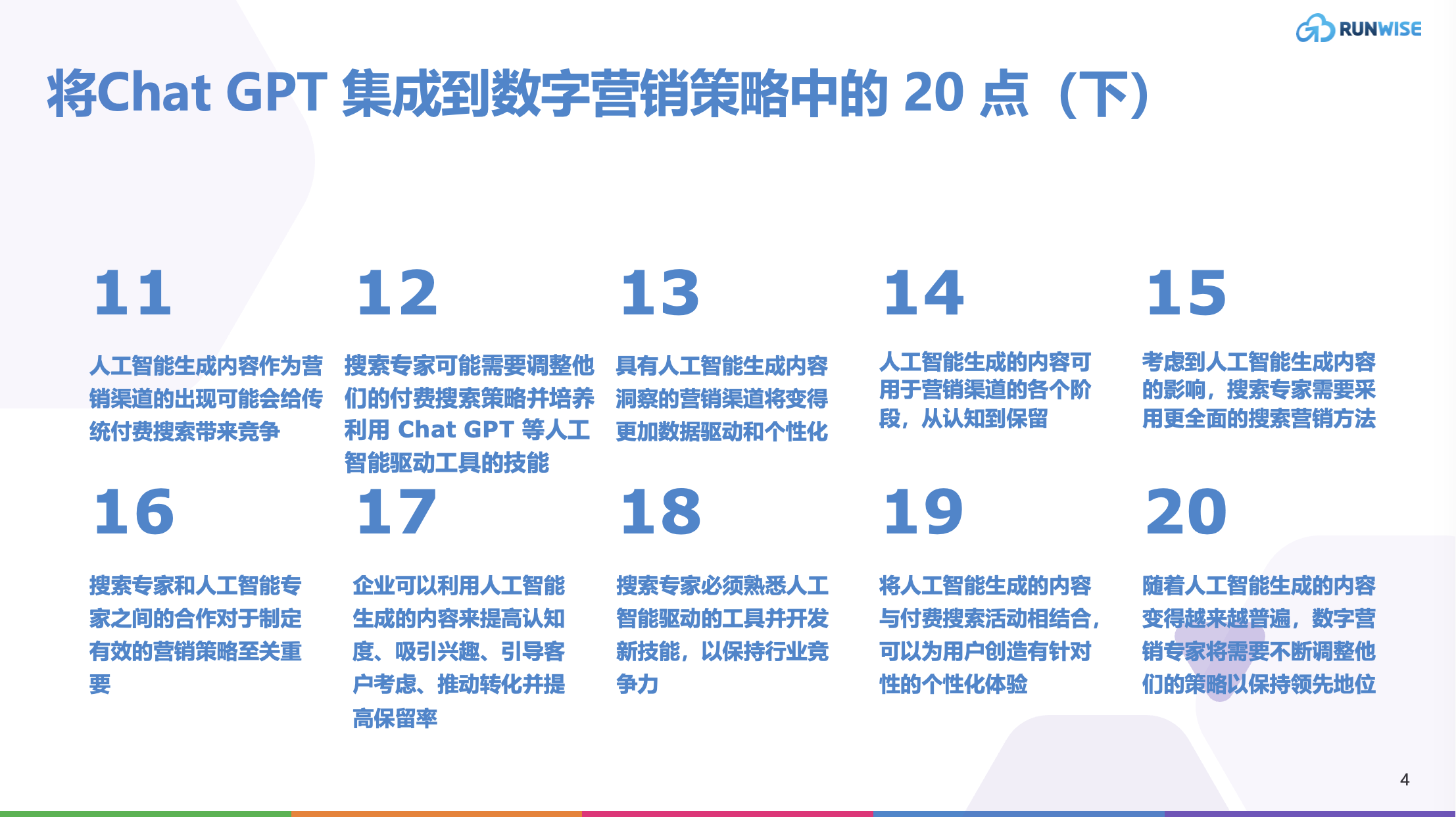

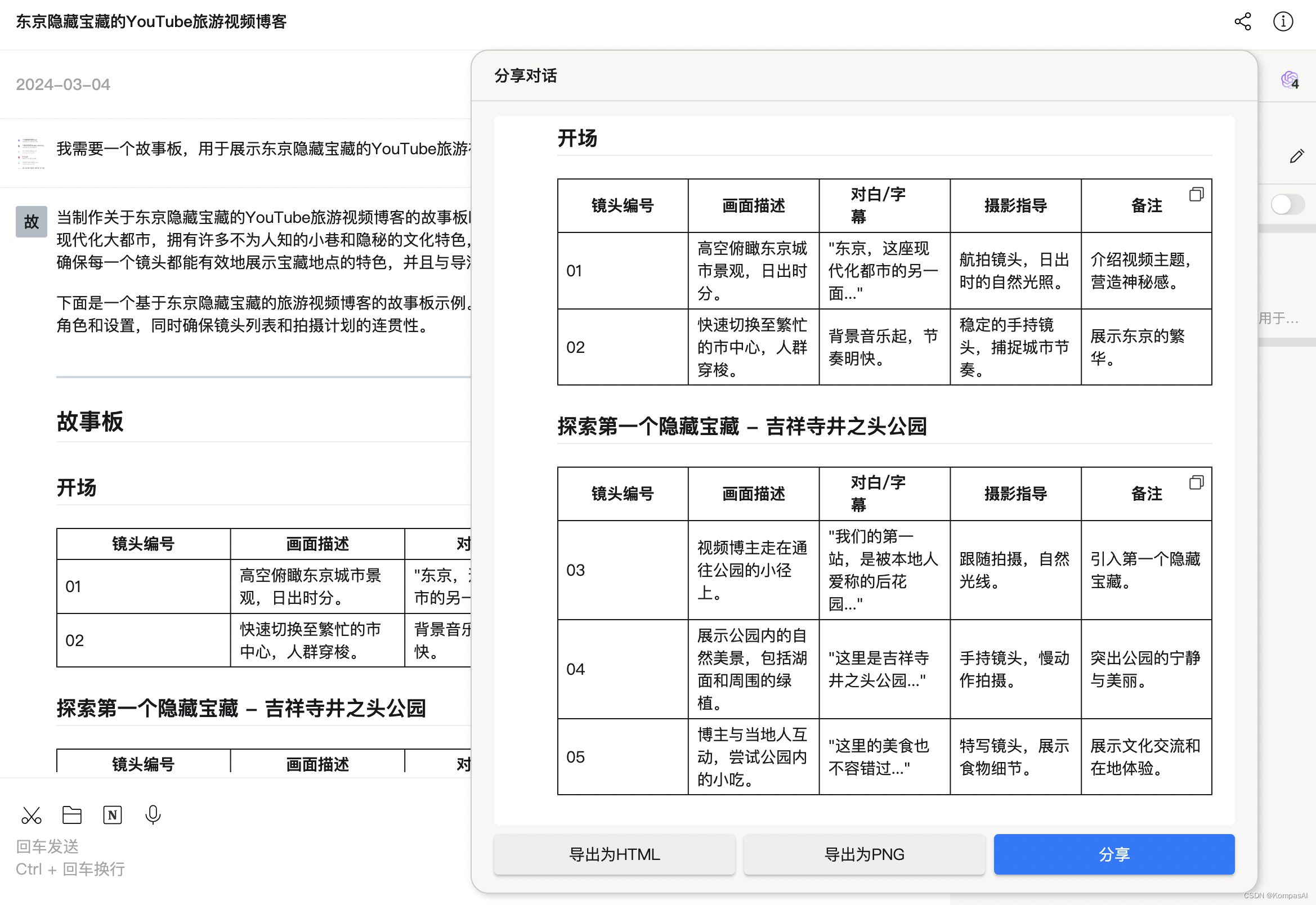

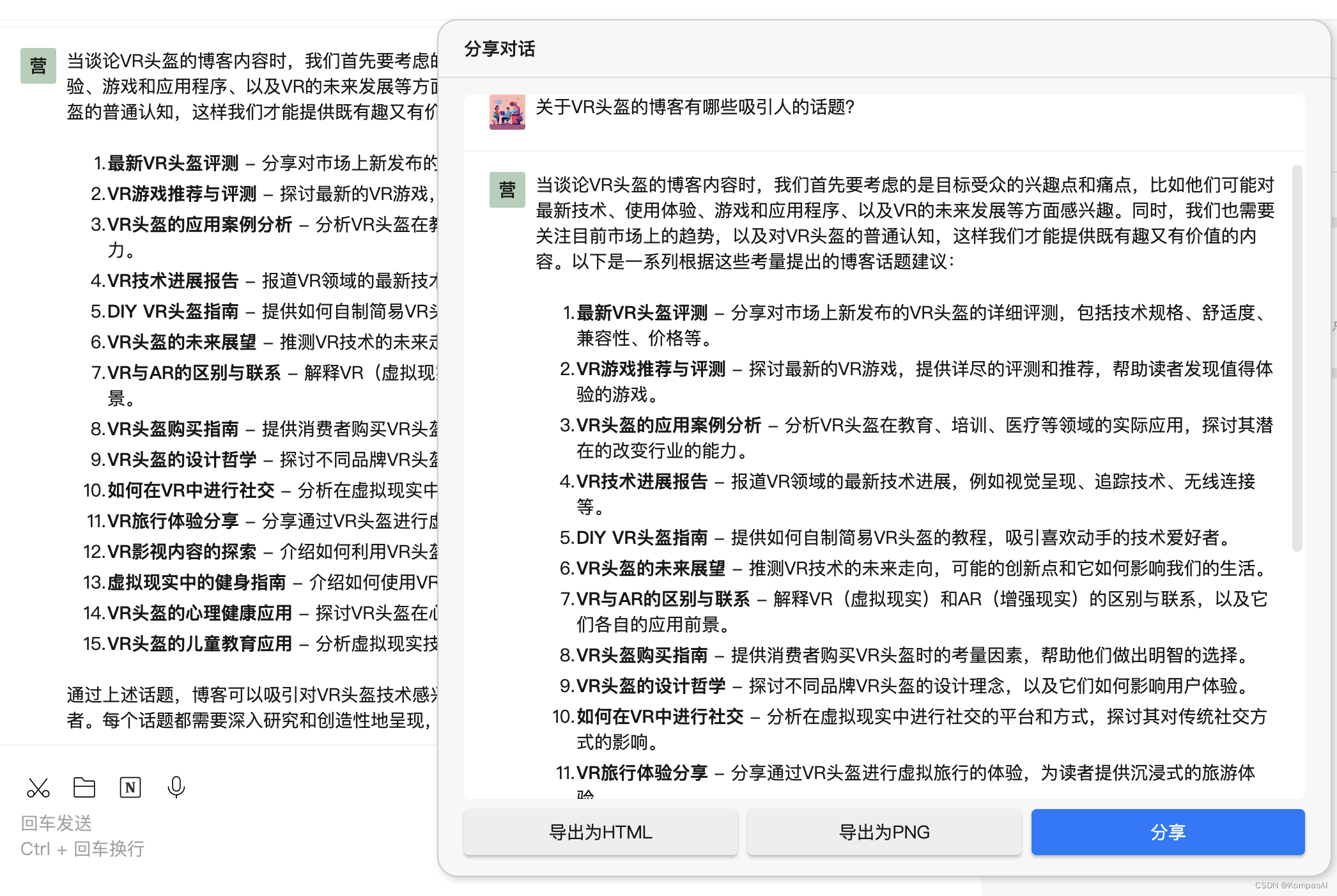

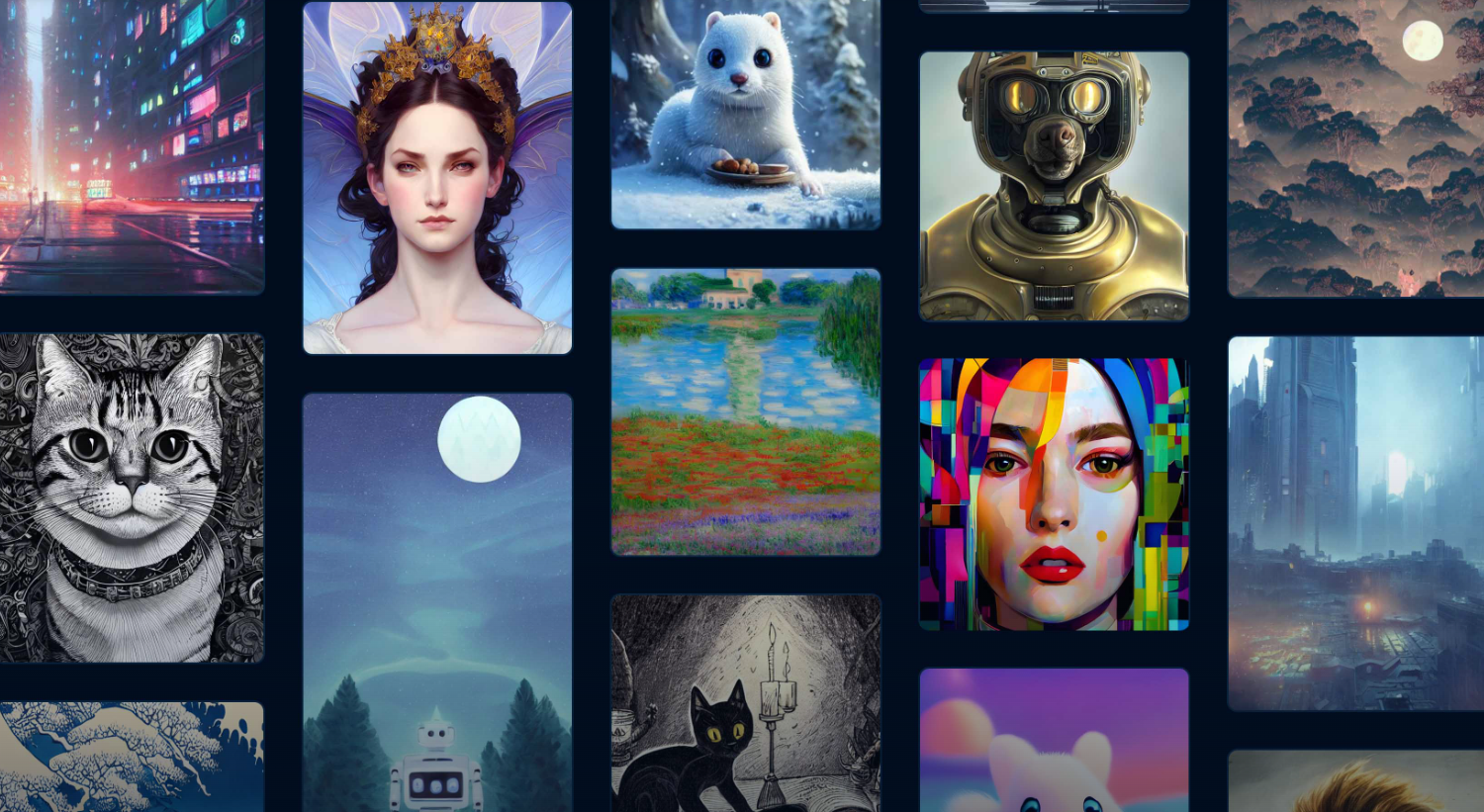

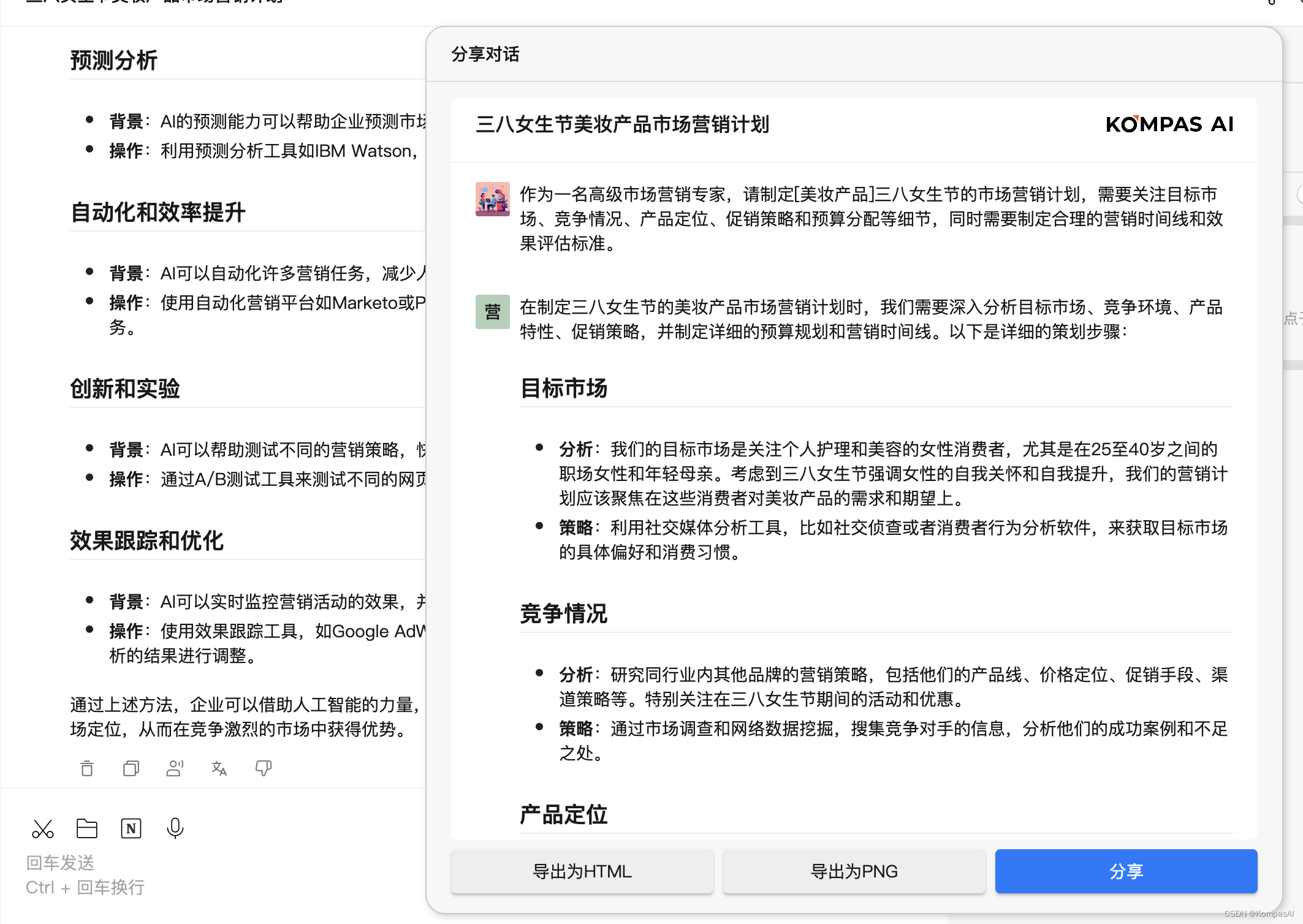

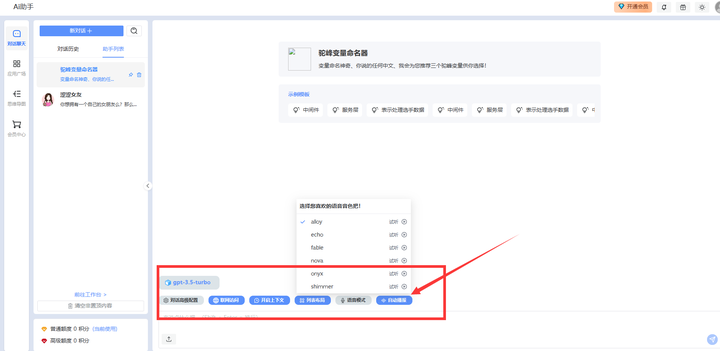

2024/4/11 21:56:53GPT和AI绘图学习【第13期】,chatgpt文案制作引导并写出爆款小红书推文、AI换脸、客服话术回复等

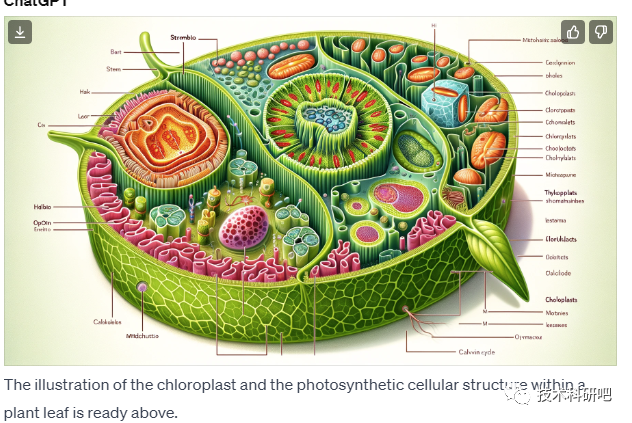

第13期GPT和AI绘图学习班,主要内容包括:ChatGPT文案制作引导并写出爆款小红书推文、分析数据、策划视频脚本、图片扩展、高效修图、产品设计、平面设计、线镐渲染、AI换脸、客服话术回复等。

目录:

1.第1天:运用GPT提高工作效率…

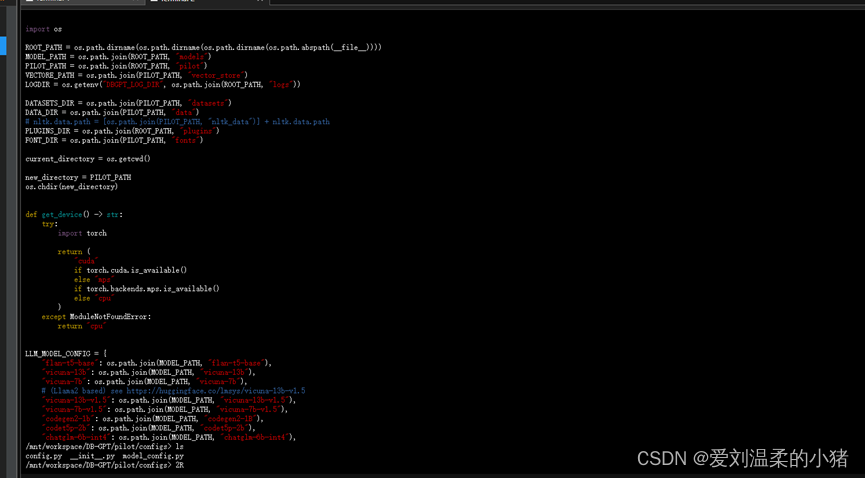

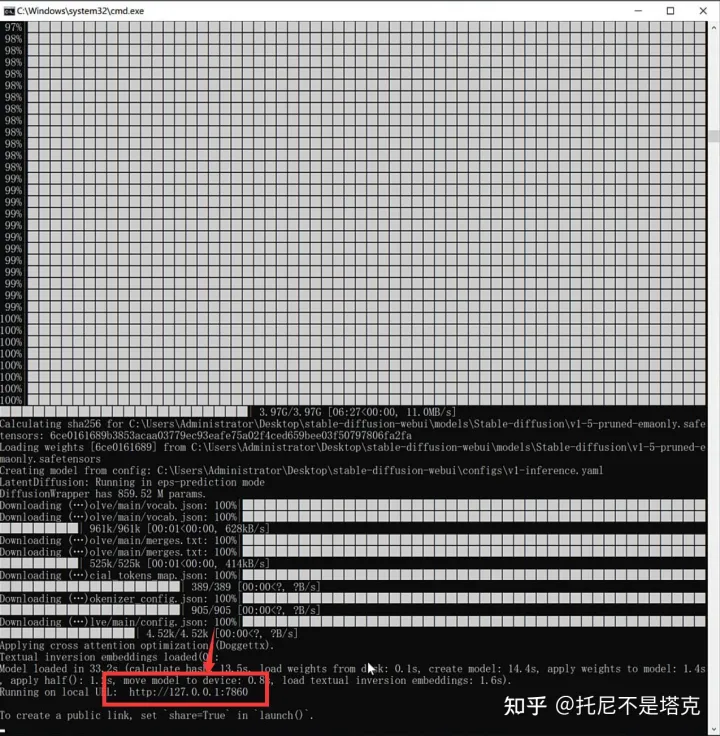

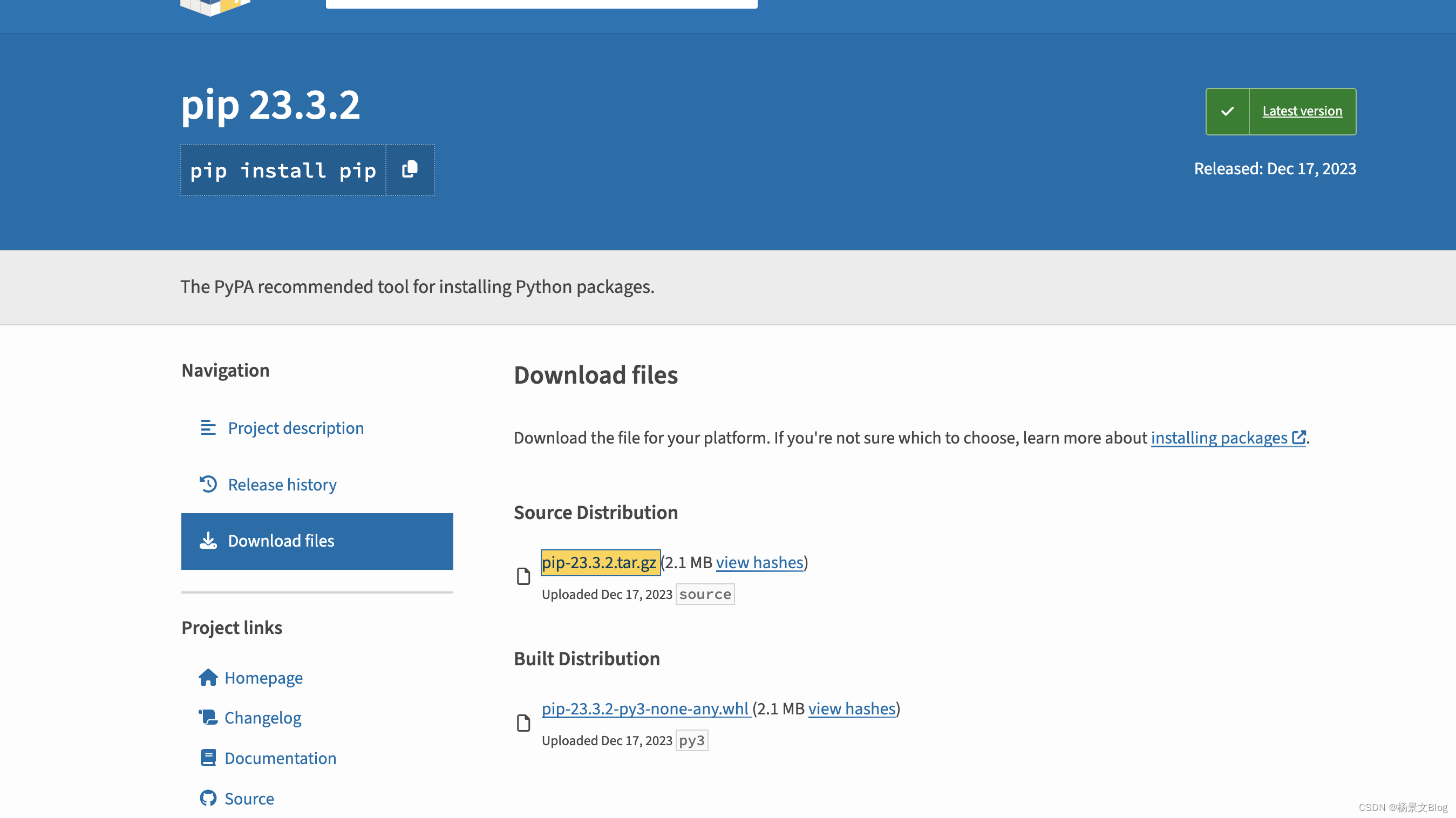

db-gpt安装指南(docker版本)

1 下载源码

下载v0.3.5的源码,截止今天(20230823)建议安装这个“稳定”版本。

2 构建镜像

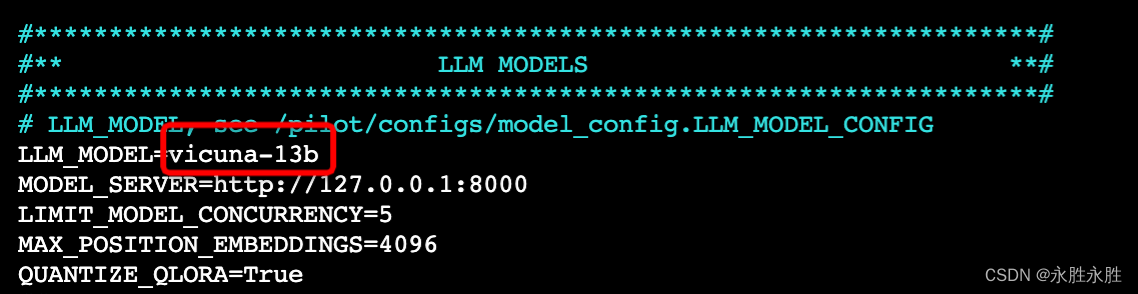

依照自己硬件环境,看看是否要调整一下启动参数。

bash docker/build_all_images.sh \

--base-image nvidia/cuda:11.7.1-devel-ubuntu…

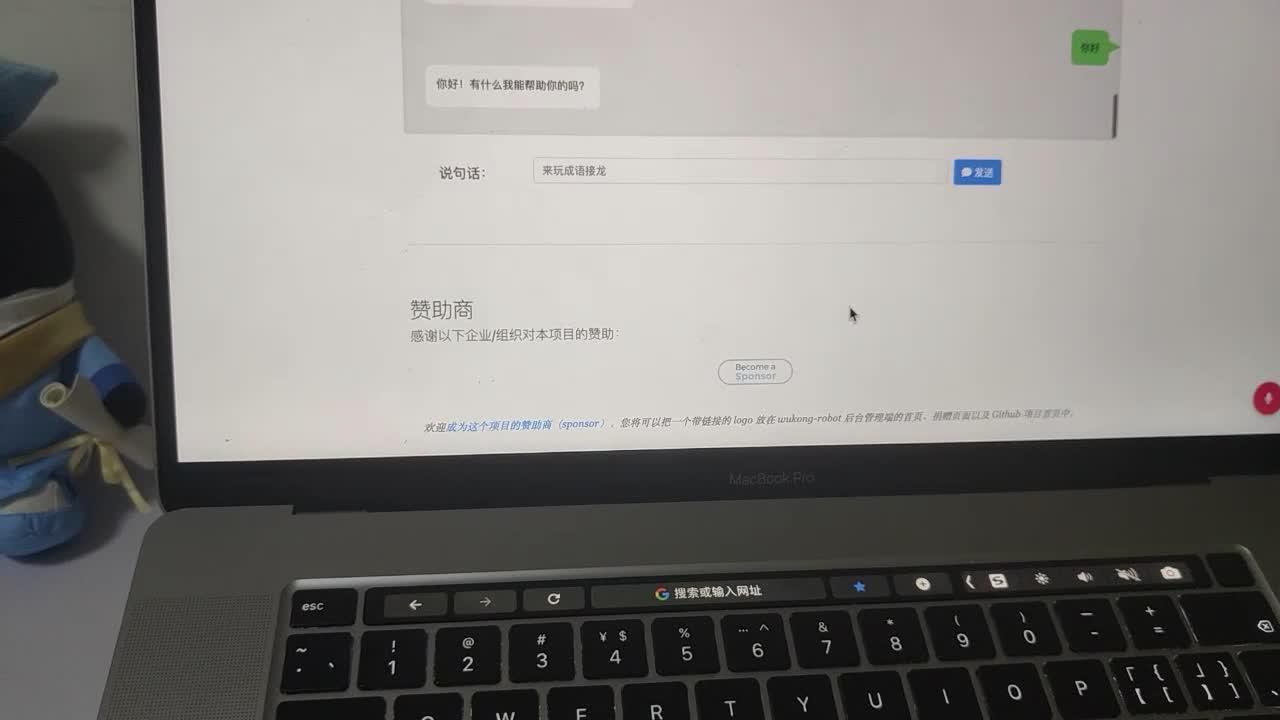

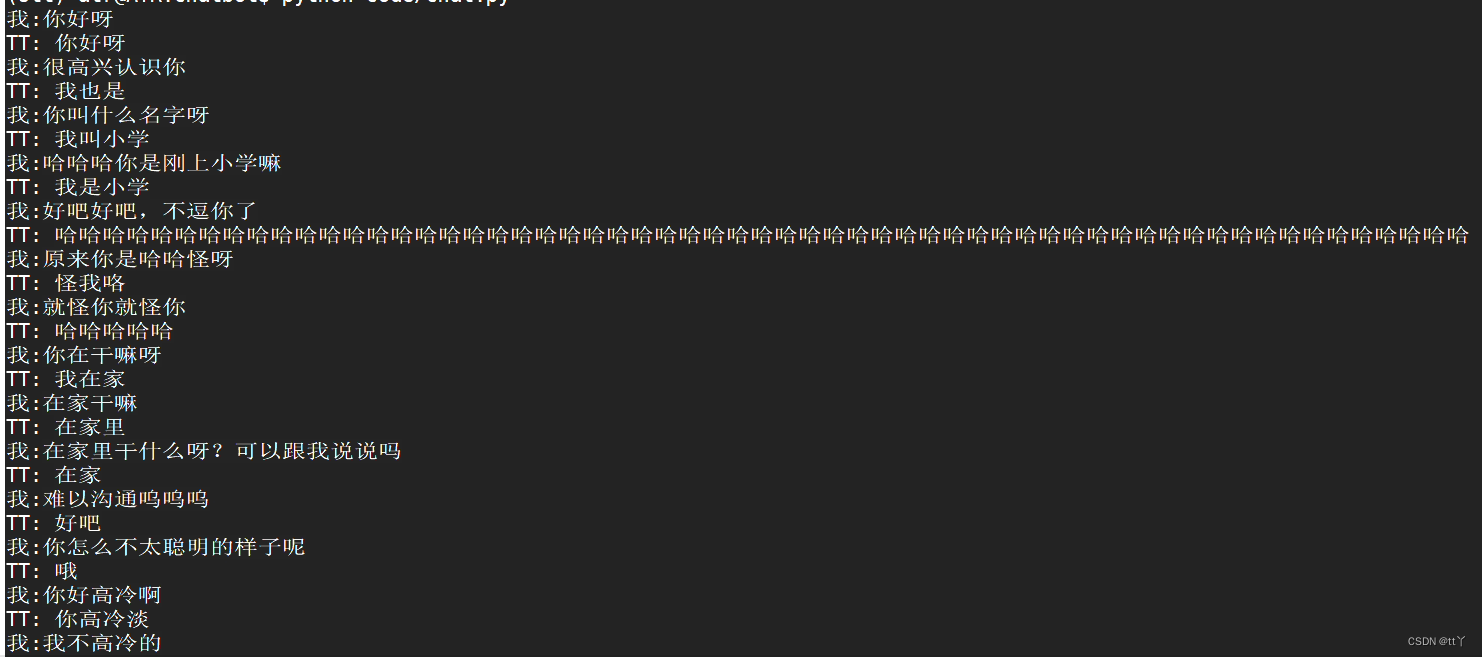

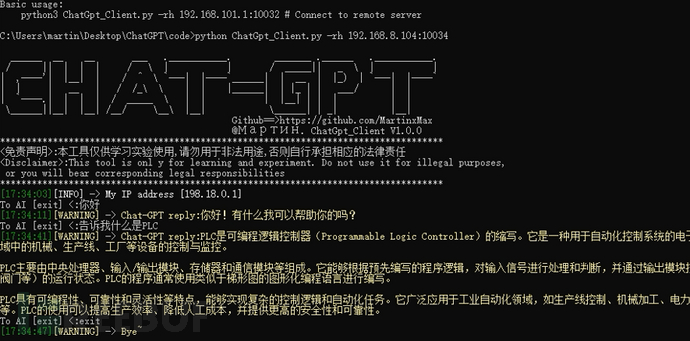

项目demo —— GPT 聊天机器人

本文介绍我的开源项目 TelegramChatBot,这是一个基于 OpenAI GPT API 开发的 telegram 机器人,具有多模态交互能力,求 star!感谢大家!在 telegram jokerController_bot 立即体验!欢迎对 GPT 应用开发或对 t…

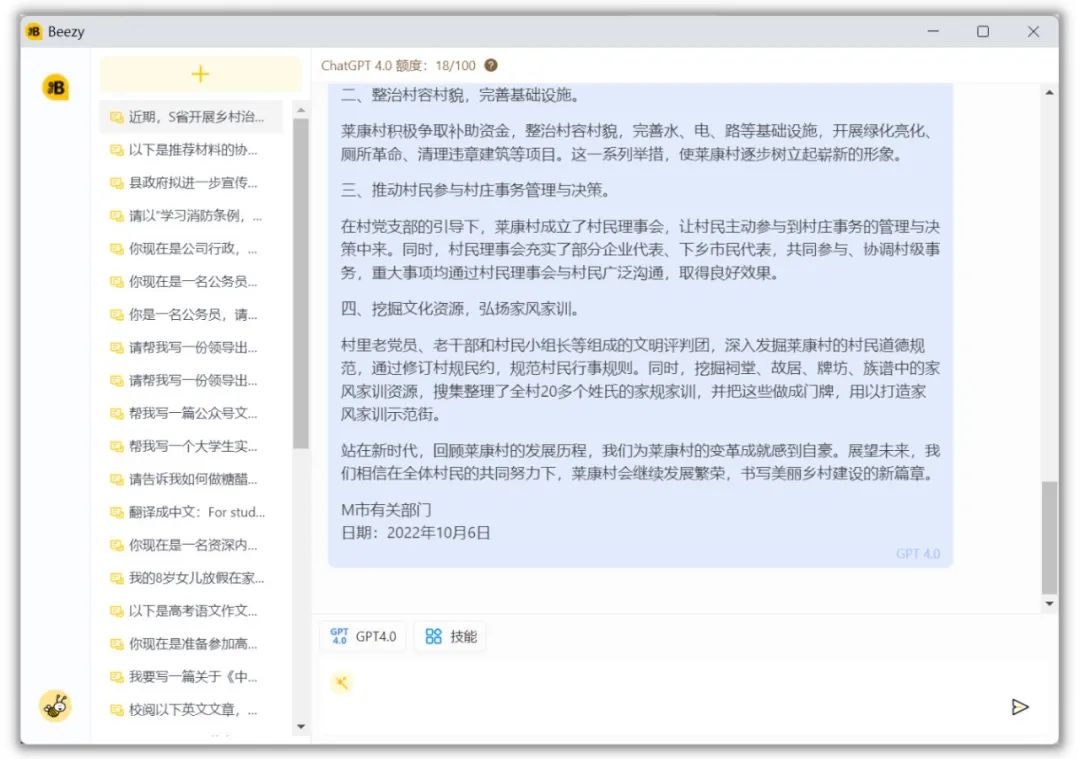

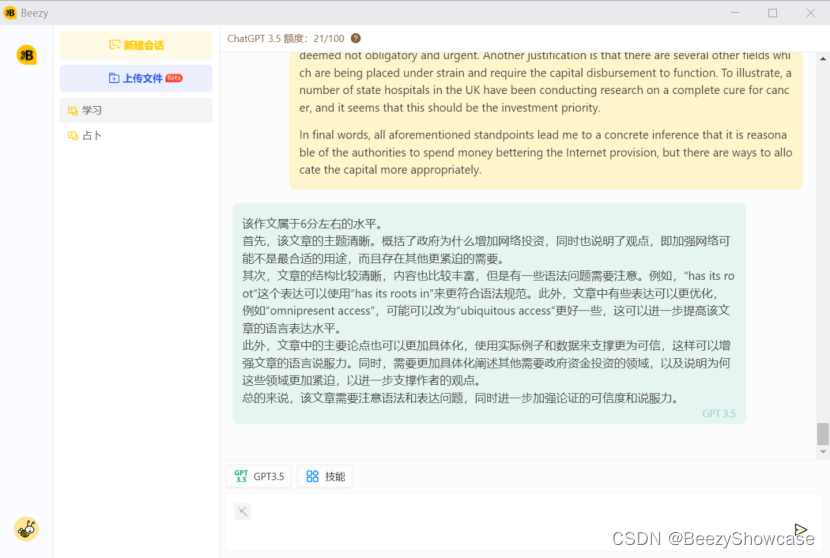

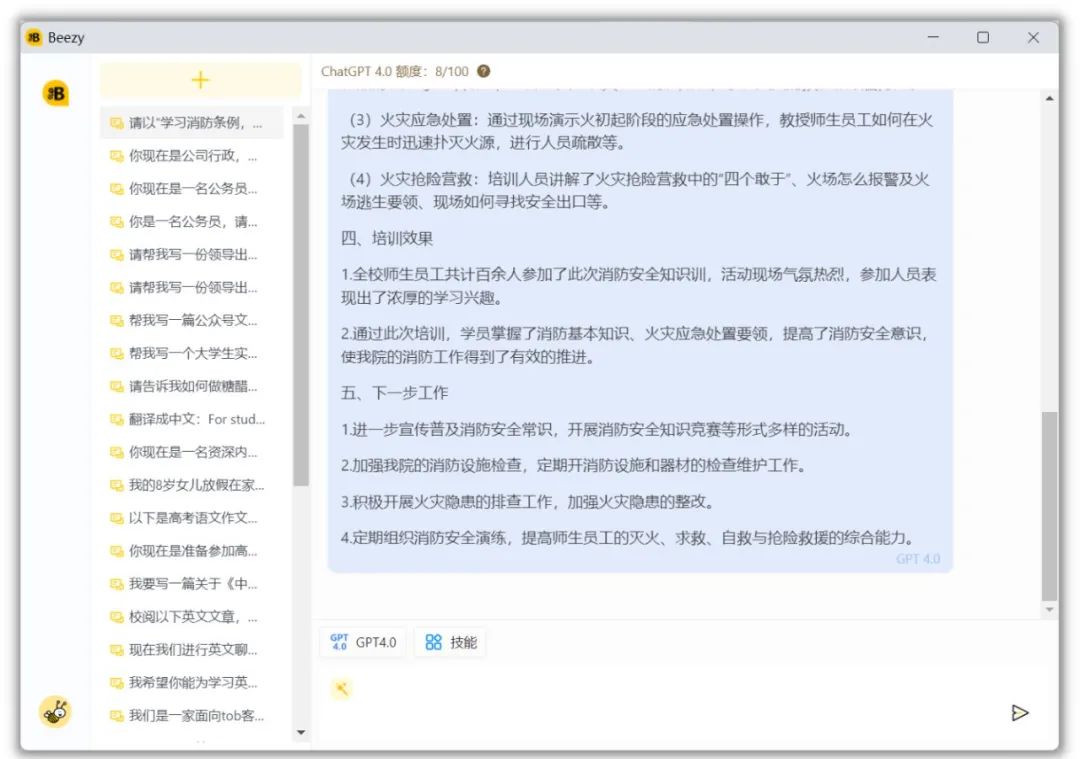

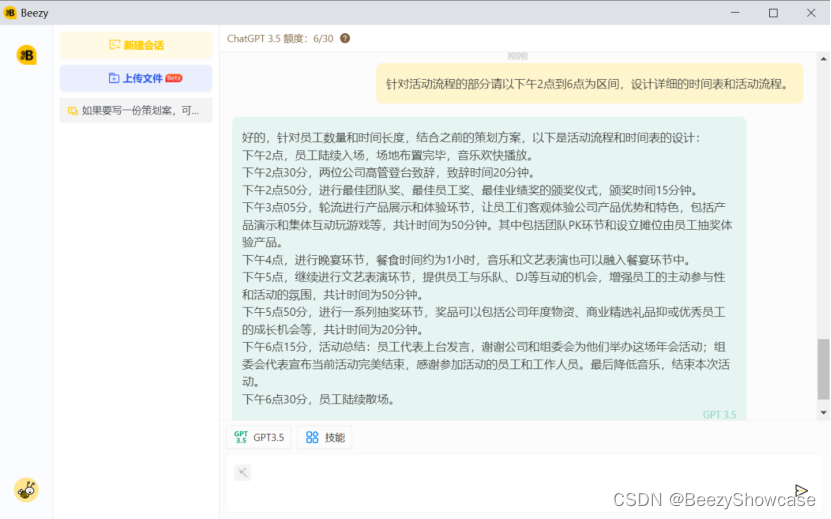

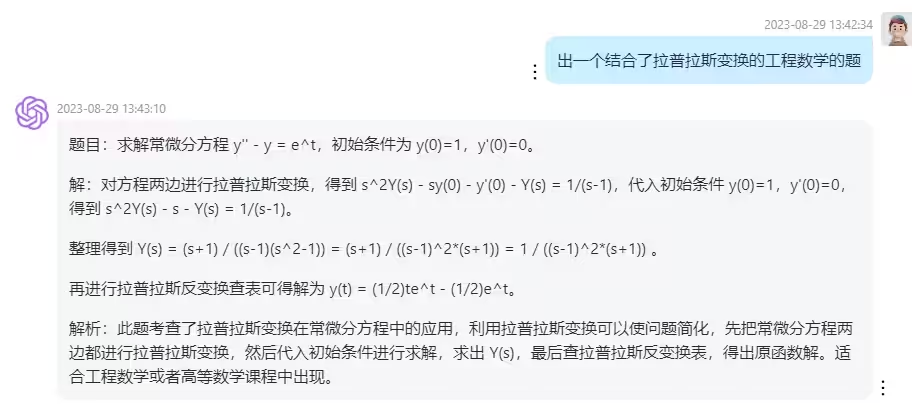

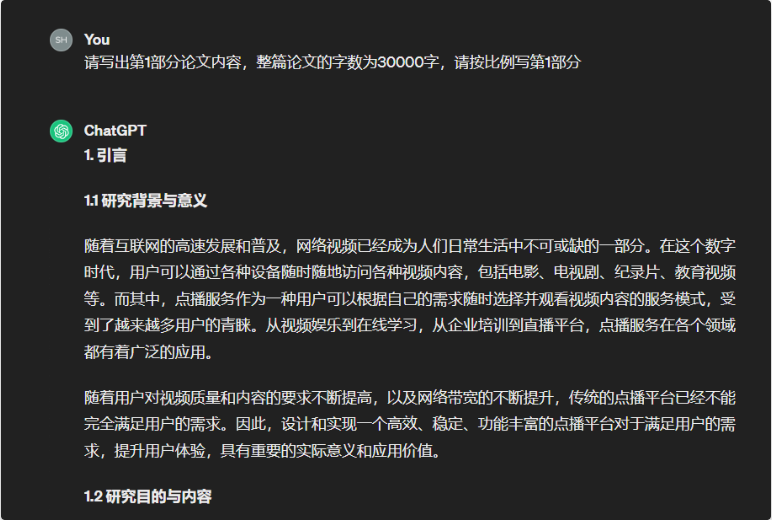

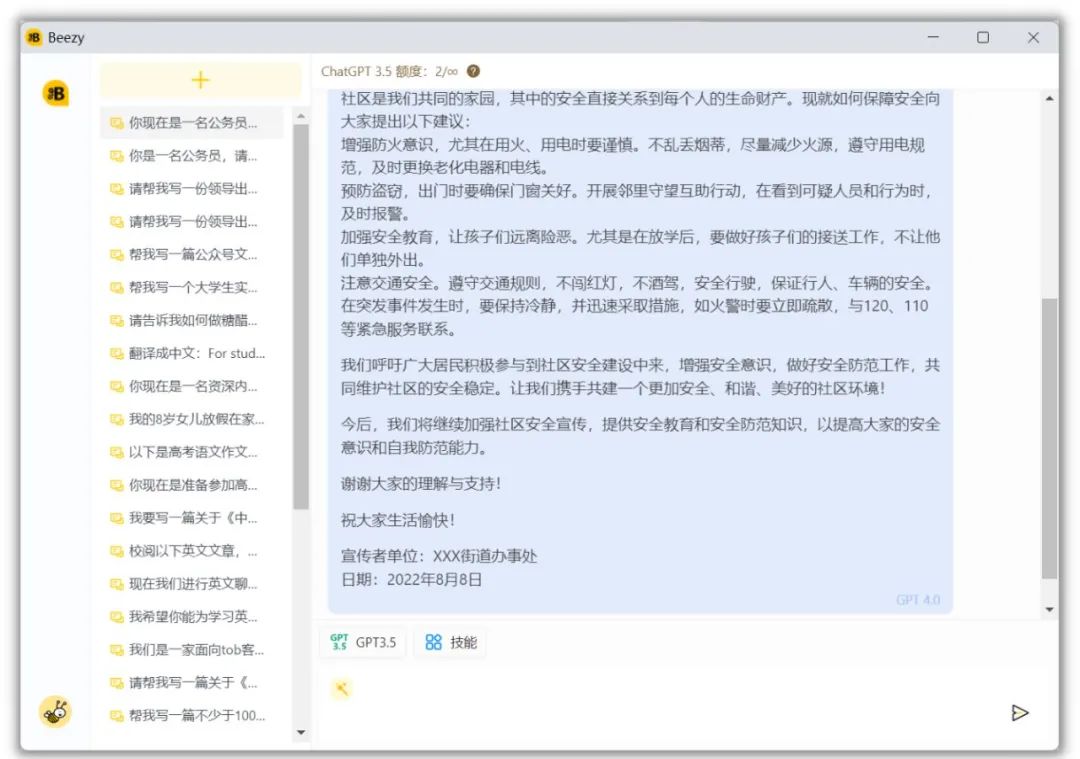

GPT专业应用:生成实习报告

正文共 1070 字,阅读大约需要 4 分钟 大学生必备技巧,您将在4分钟后获得以下超能力:

快速生成实习报告 Beezy评级 :B级

*经过简单的寻找, 大部分人能立刻掌握。主要节省时间。 推荐人 | Kim 编辑者 | Linda ●图片由…

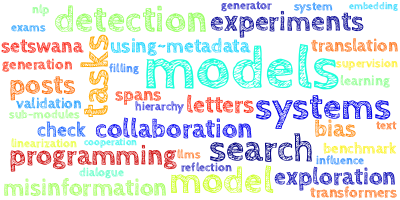

第11期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练 Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

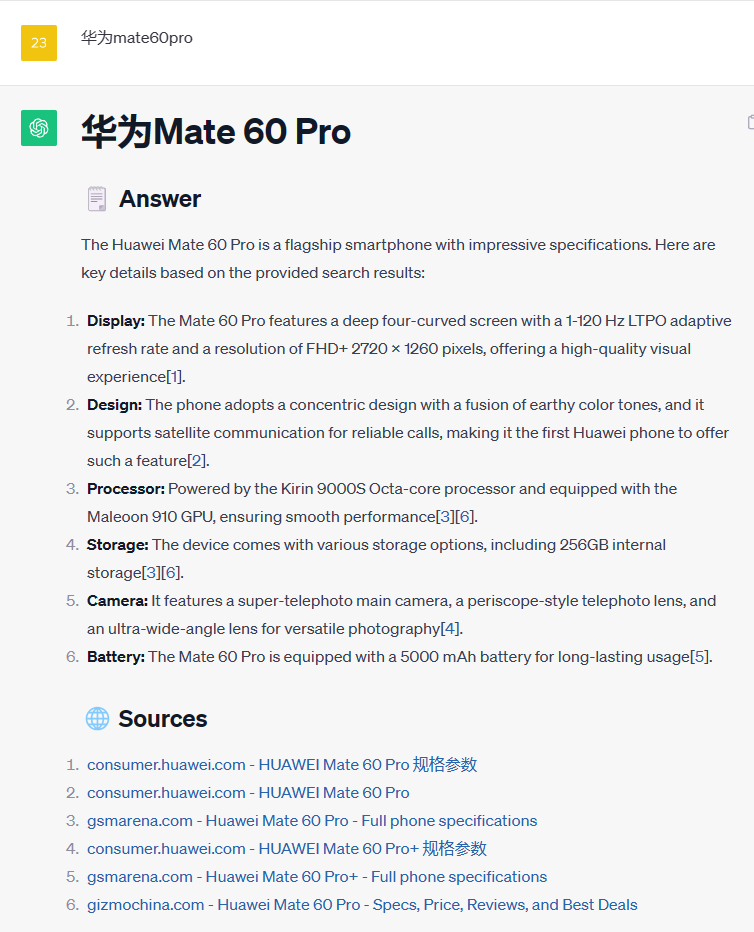

第23期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练 Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

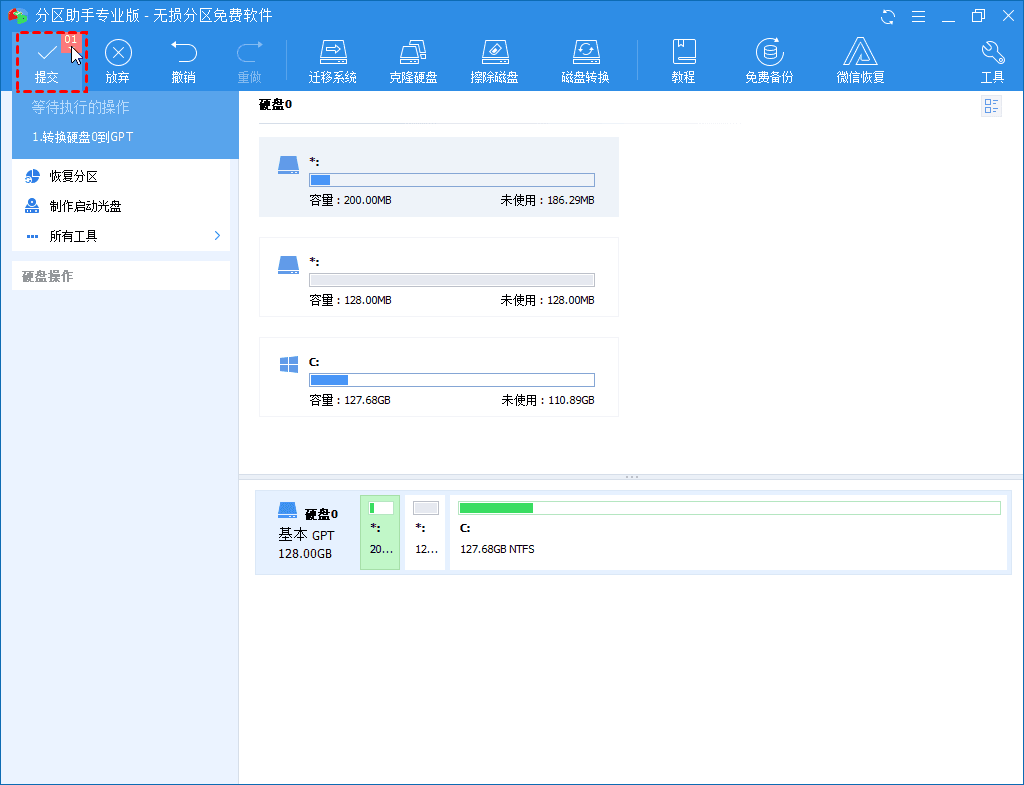

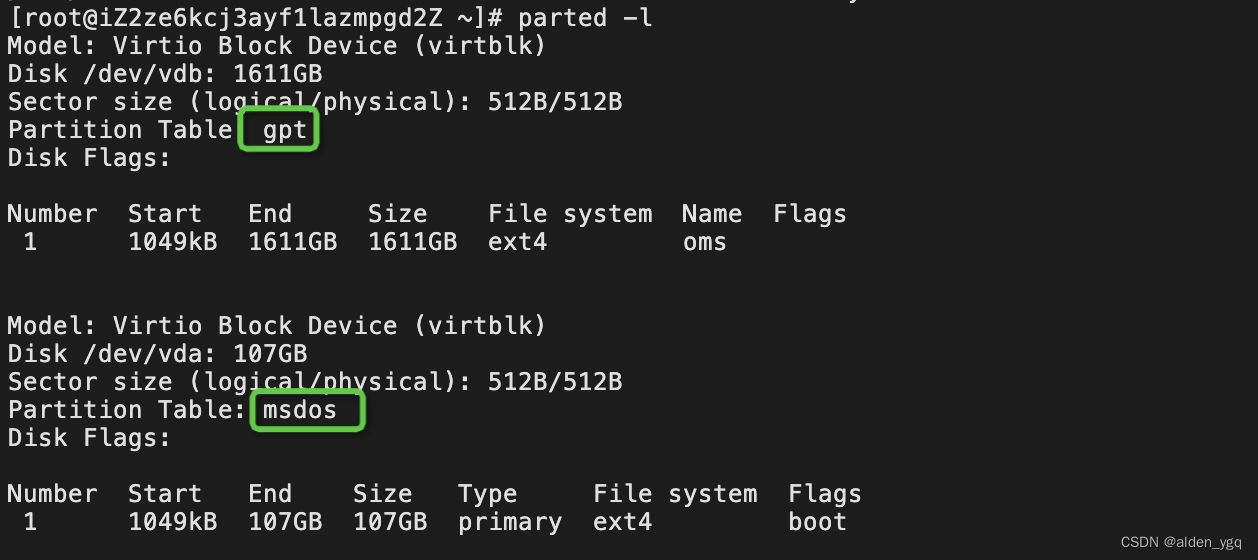

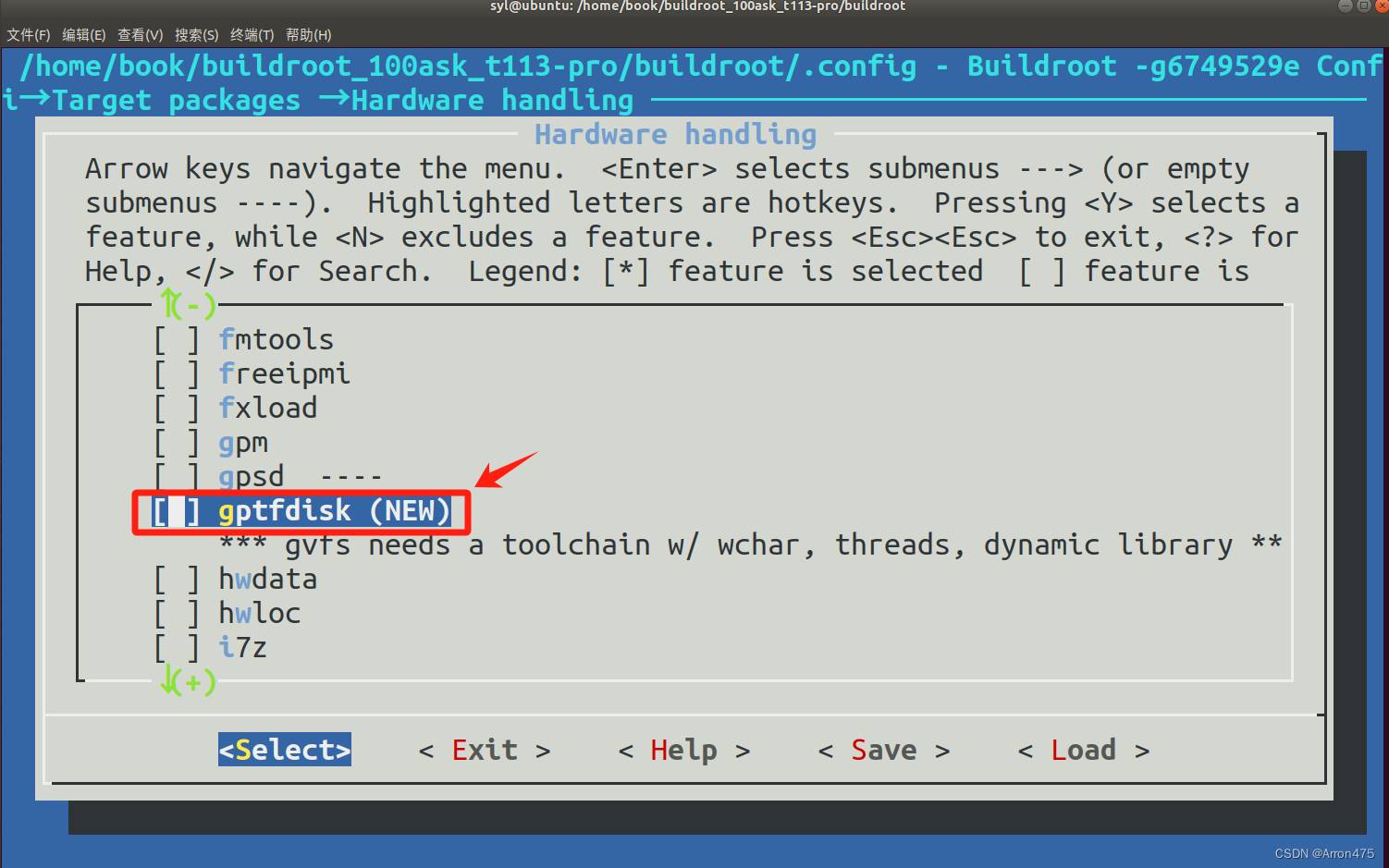

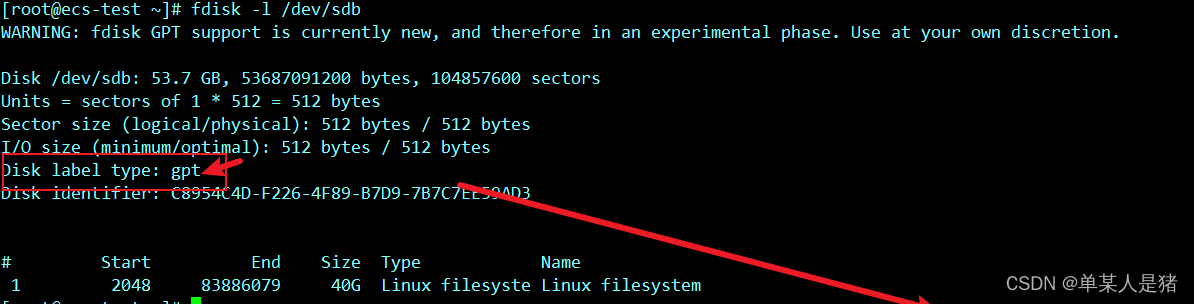

ubuntu使用Parted GPT 创建大于2TB的的分区

问题

加购了一个4TB的ssd用于装载数据,使用fdisk挂载时候遇到一下warning:

$ sudo fdisk /dev/sdbWelcome to fdisk (util-linux 2.34).

Changes will remain in memory only, until you decide to write them.

Be careful before using the write com…

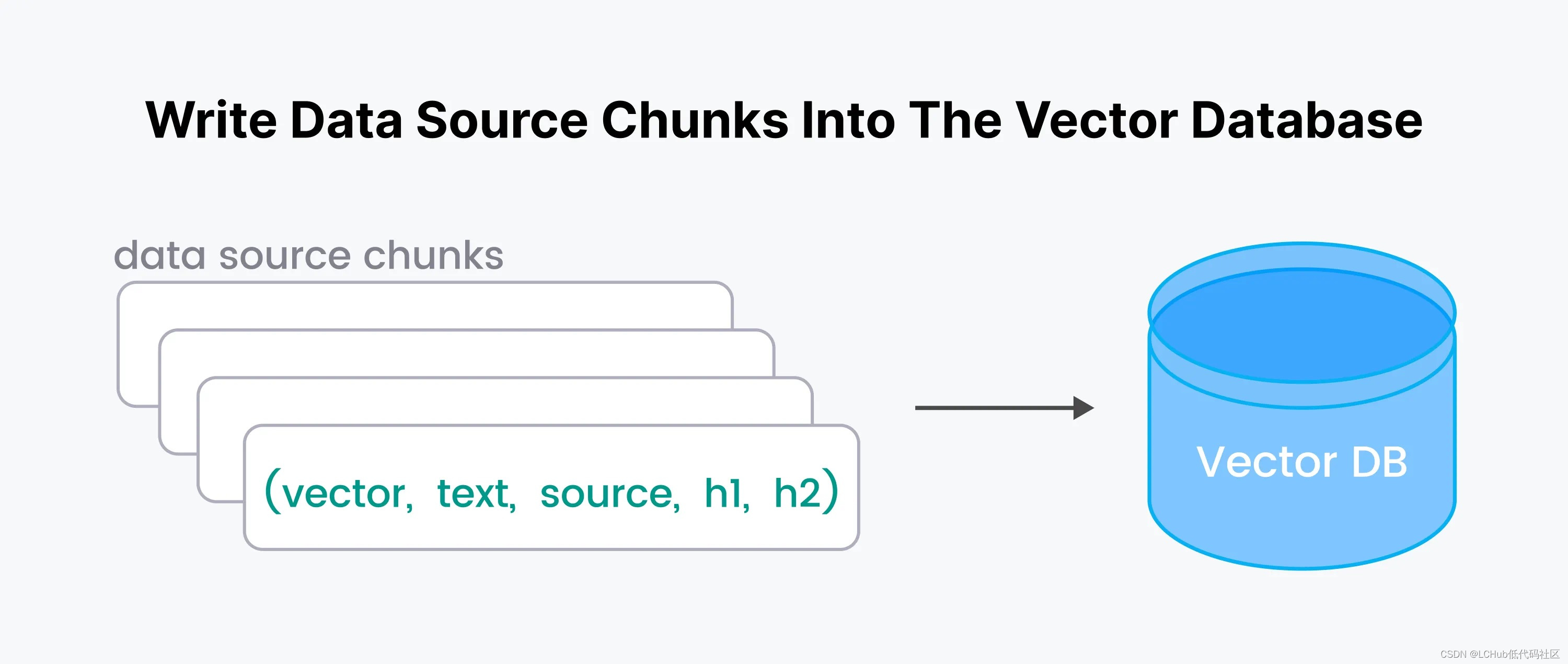

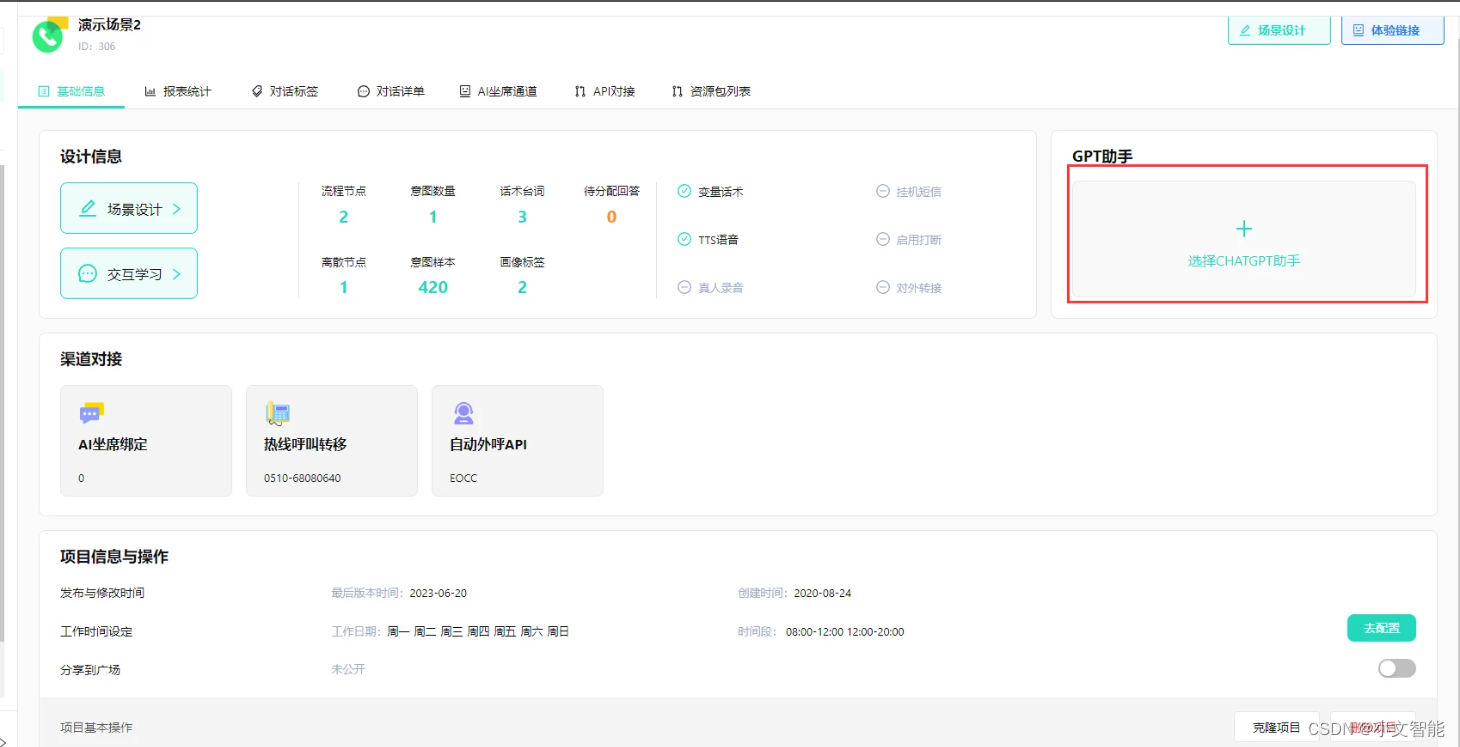

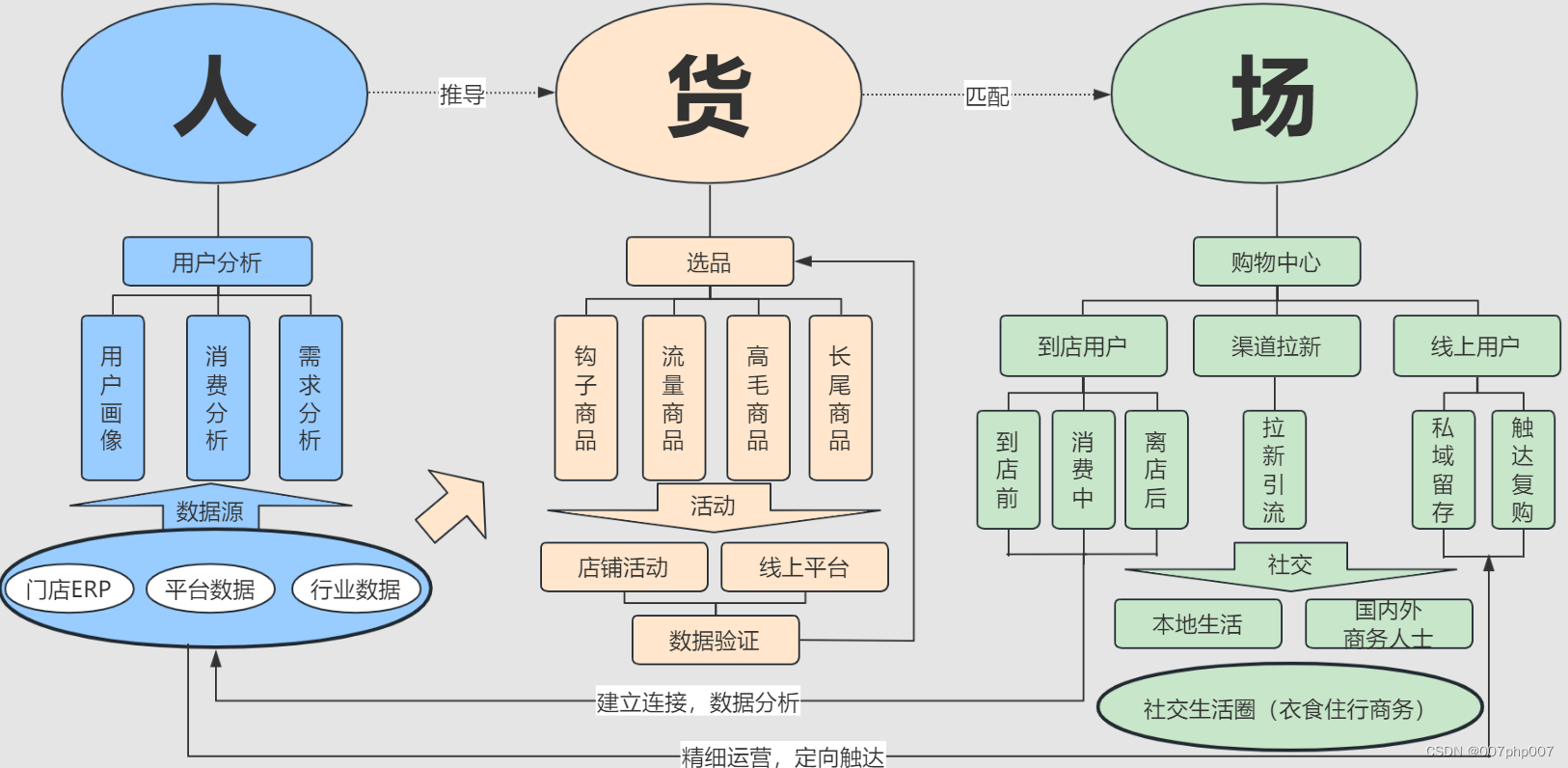

用向量数据库Milvus Cloud搭建GPT大模型+私有知识库的定制商业文案助手

随着智能助手的不断普及和发展,商业文案的创作也变得更加智能化和定制化。在这个信息爆炸的时代,商业文案的撰写已经不再是简单的文字表达,而是需要结合大数据分析和人工智能技术,以更好地满足目标客群的需求。在本文中,我们将介绍如何利用向量数据库Milvus Cloud搭建GPT大…

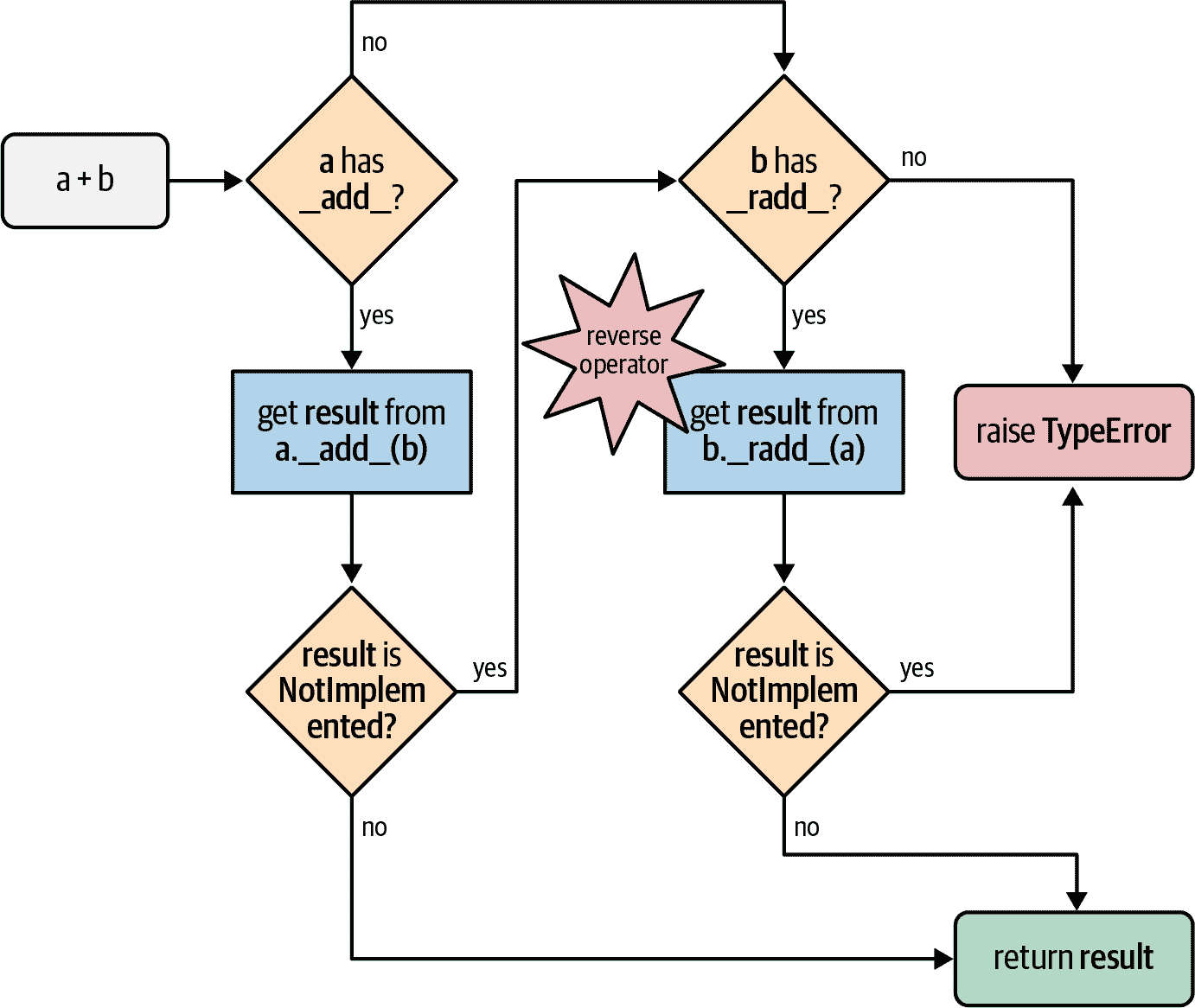

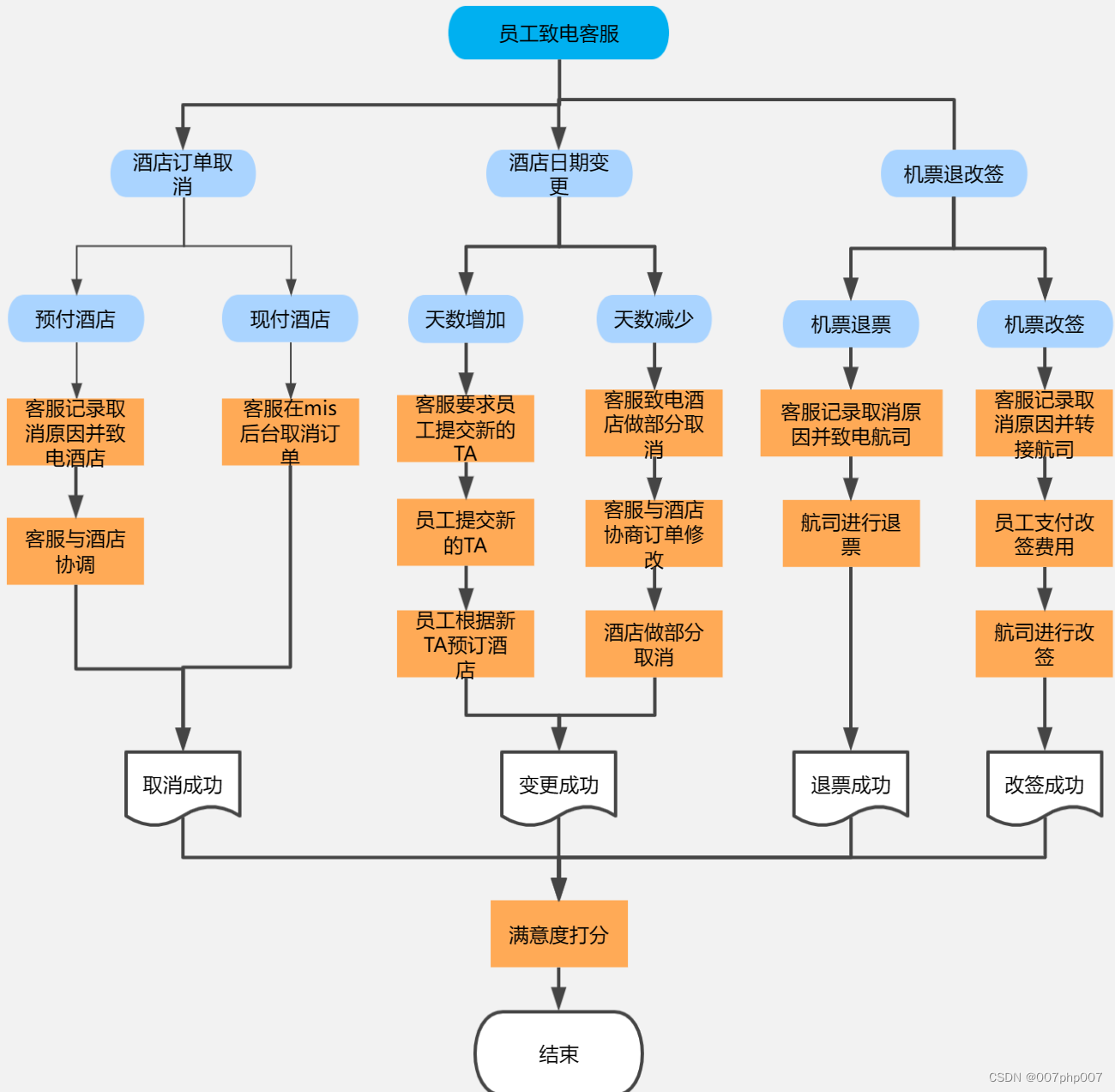

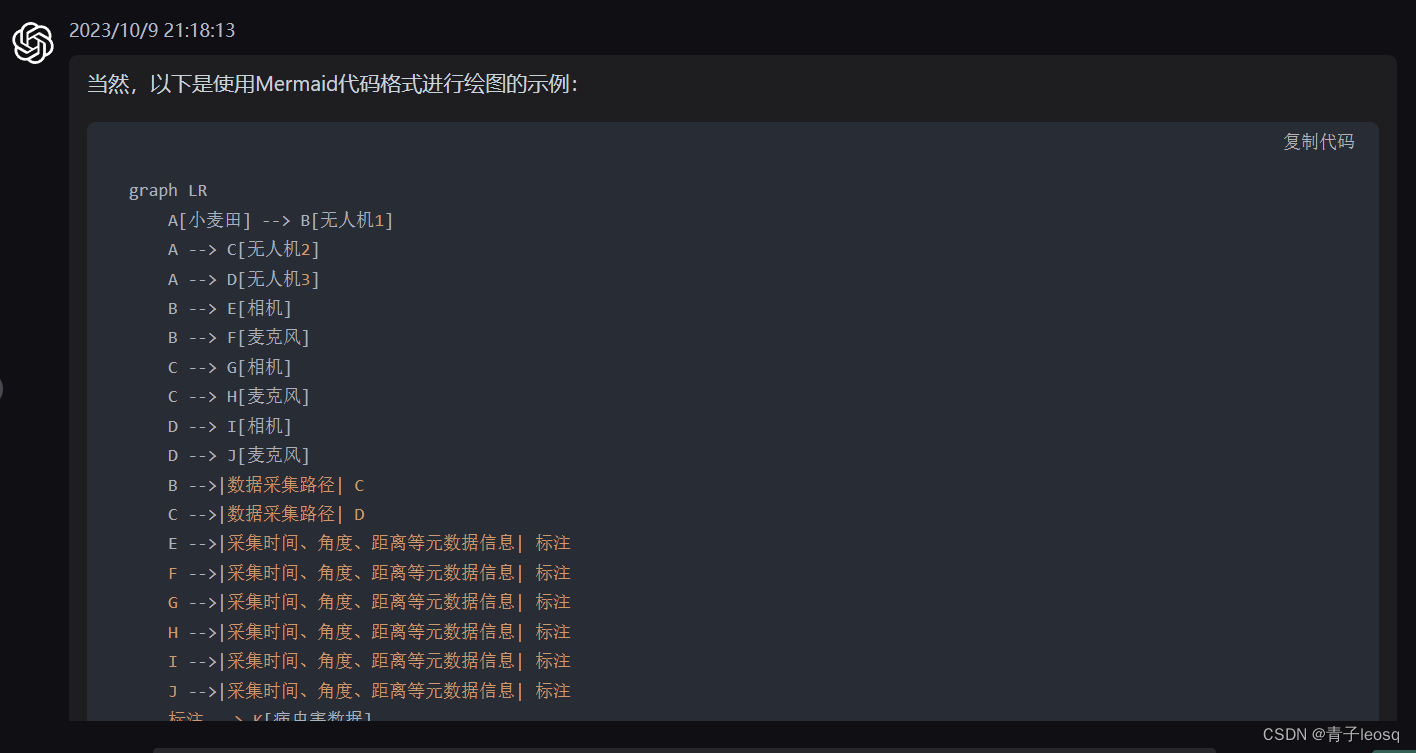

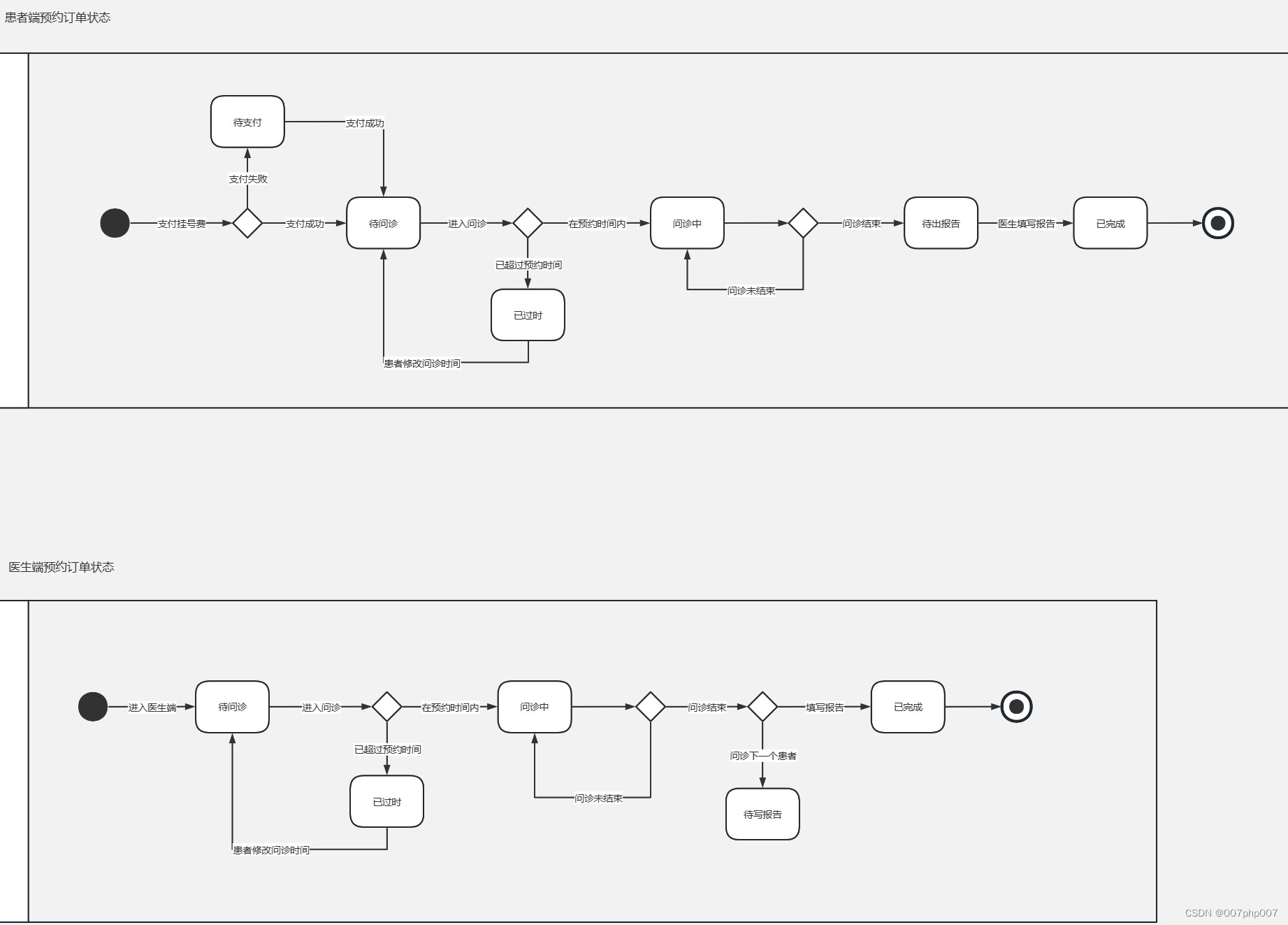

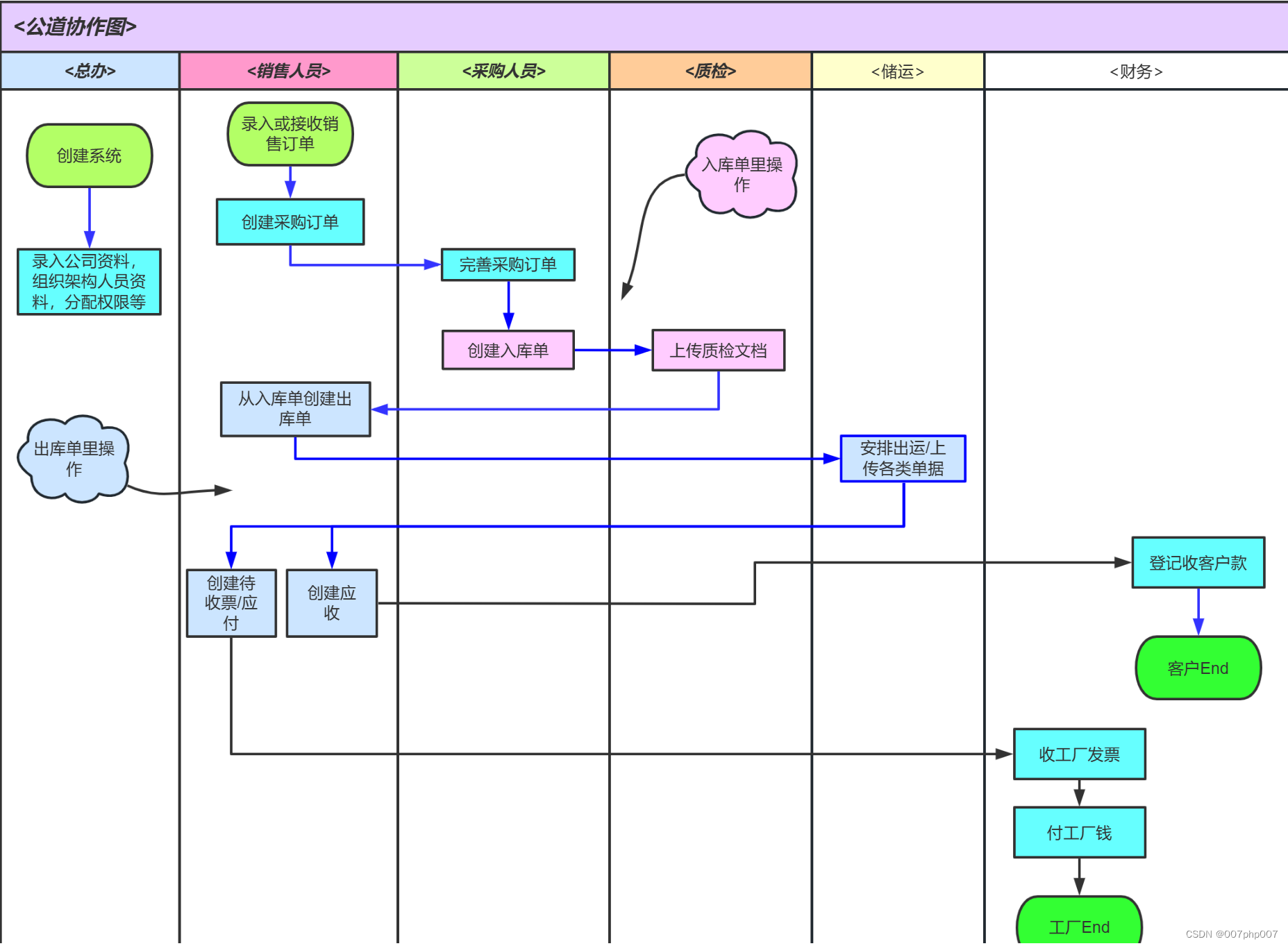

GPT绘制流程图咒语

【咒语】下面是我的一篇论文选取部分,为了让读者更好理解,我准备画一张图,请你阅读后为我设计一下这个图应该怎么画,更有说服力,更容易理解 论文片段: 多模态数据融合研究的基础在于有效的数据采集。首先&a…

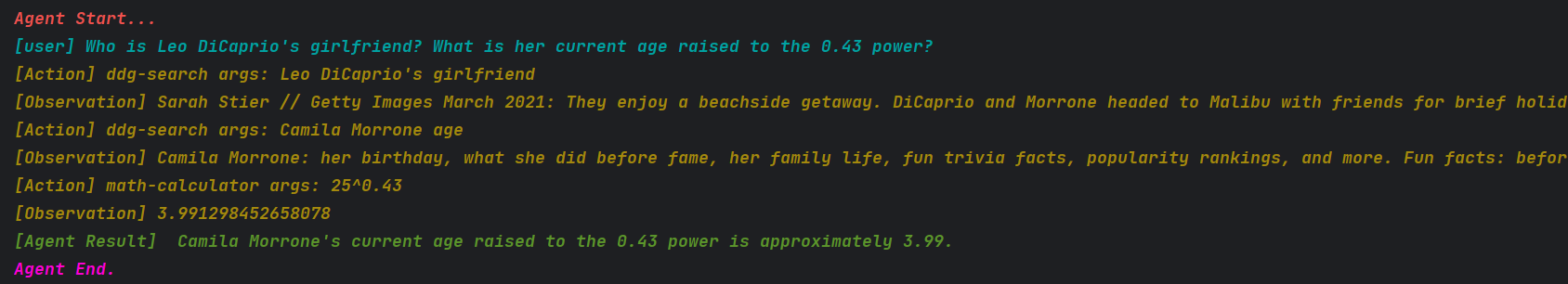

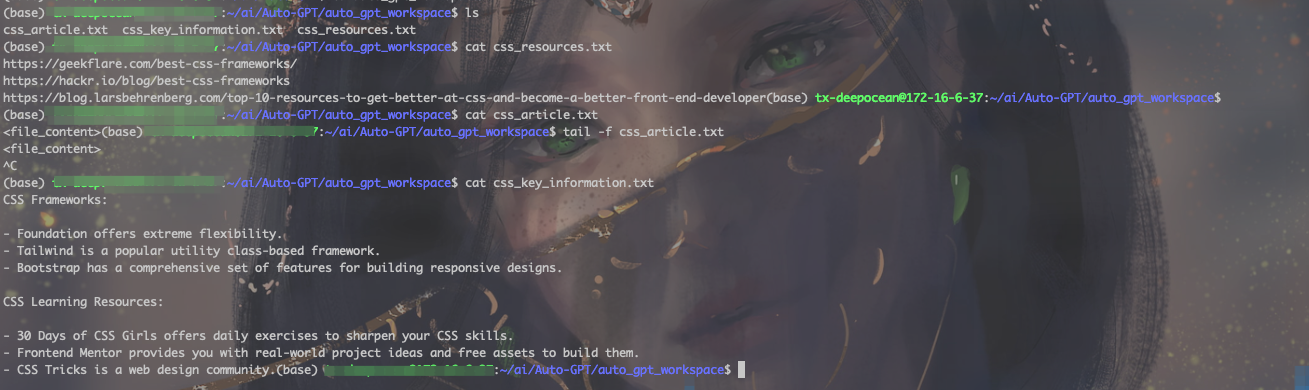

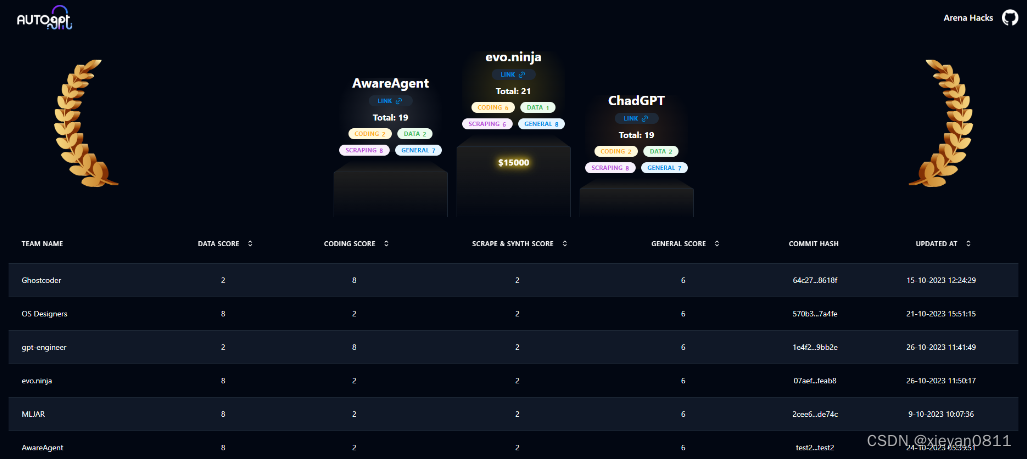

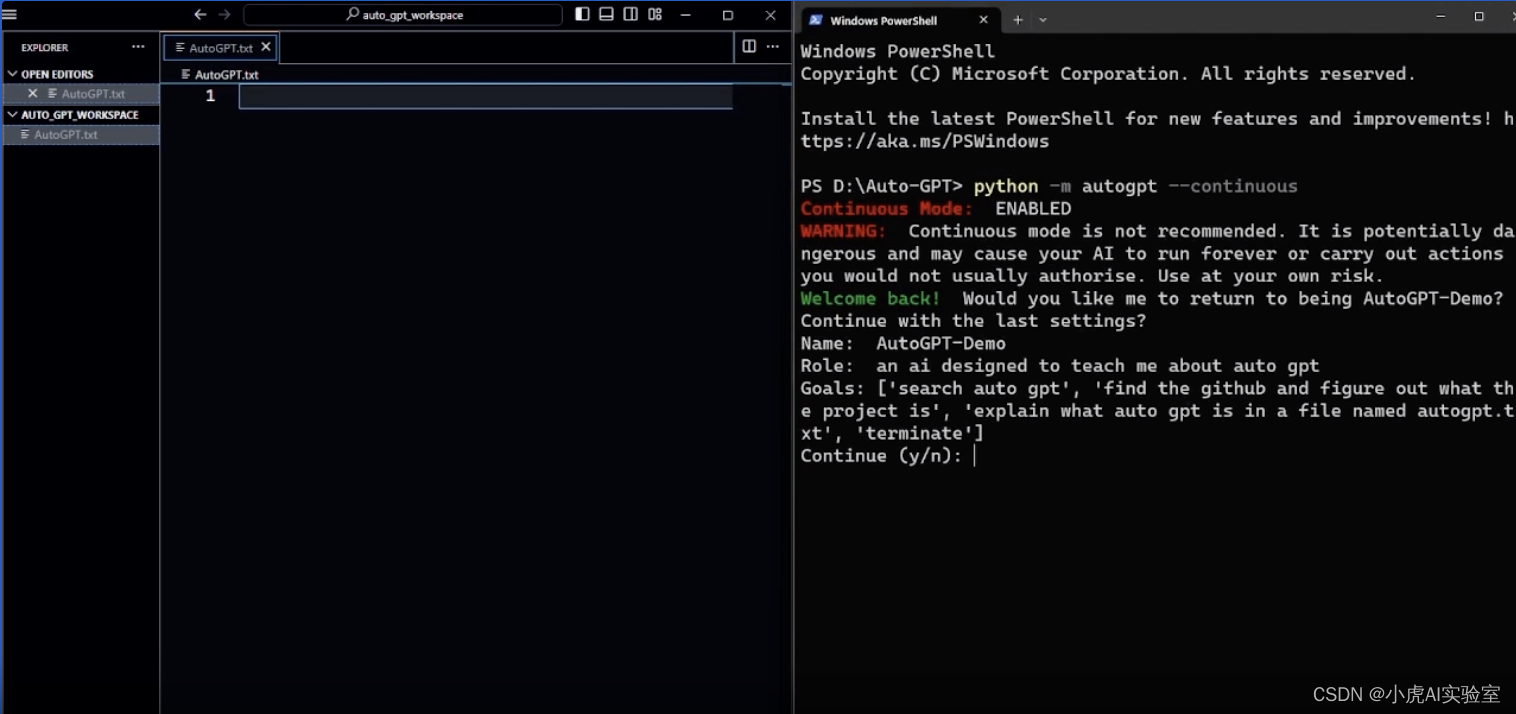

【AI】Auto-GPT:当时代抛弃你的时候,不会和你说一声再见!

当时代抛弃你的时候,不会和你说一声再见! Auto-GPT Code Auto-GPT: 一个全自动化的GPT-4 Collecting BOTAI Auto-GPT 官网网站

GPT-5年底上线?初创公司Runway CEO再爆料:OpenAI员工相信GPT-5有望成AGI

来源: 新智源 微信号:AI-era 最近,Runway CEO关于GPT-5的爆料,又被网友们翻了出来,讨论得热火朝天。不论AGI会在哪一年出现,显然,能见证这一天的人都是幸运的。 最近,又有网友翻出了关于GPT-5的…

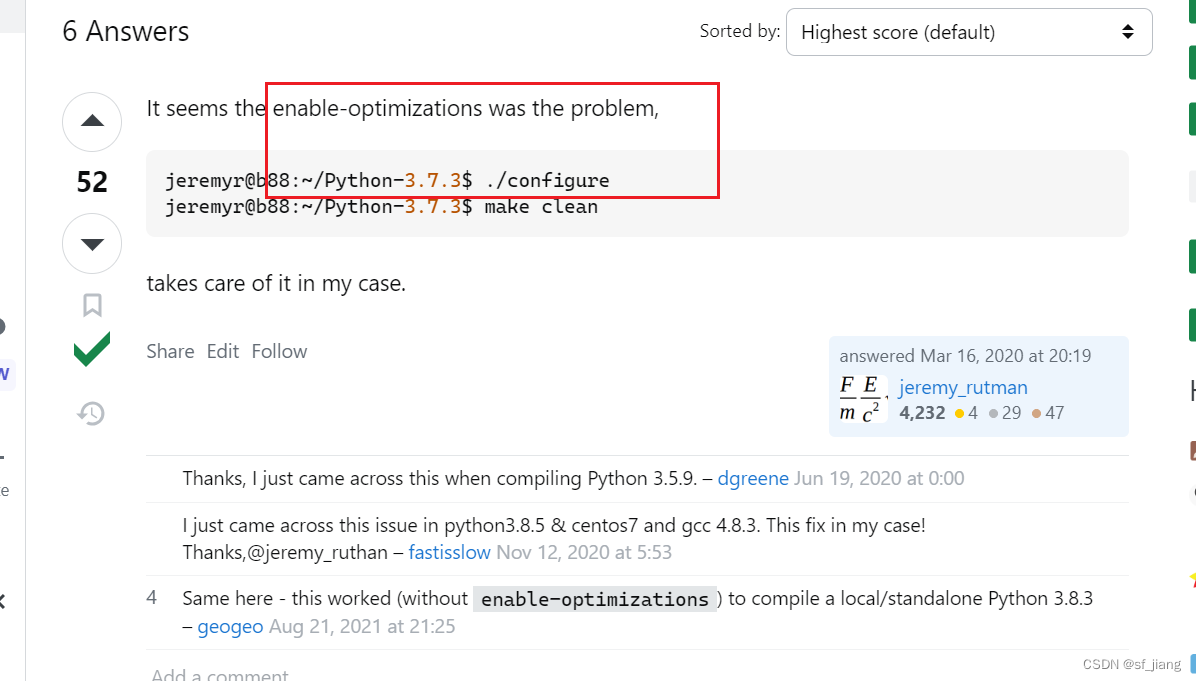

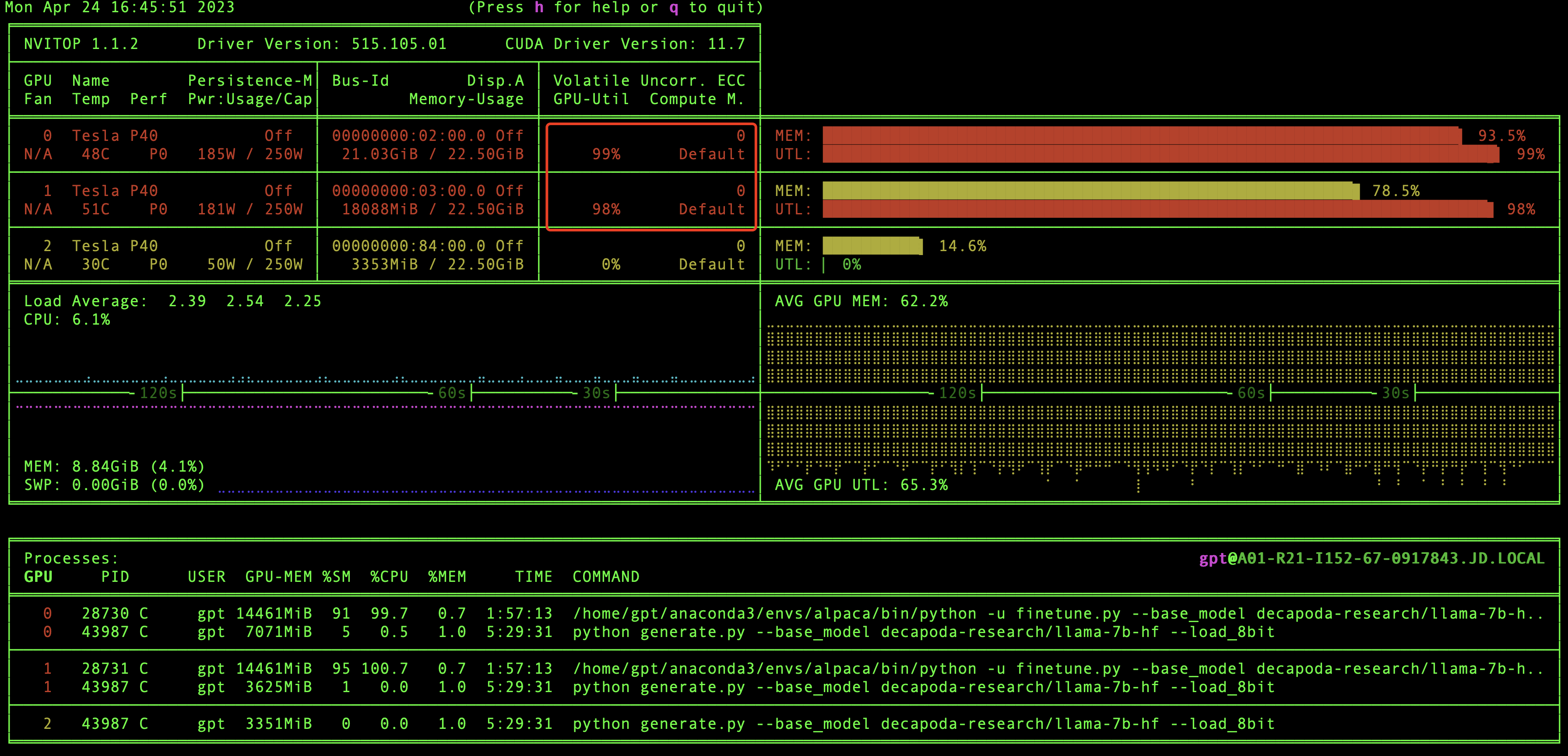

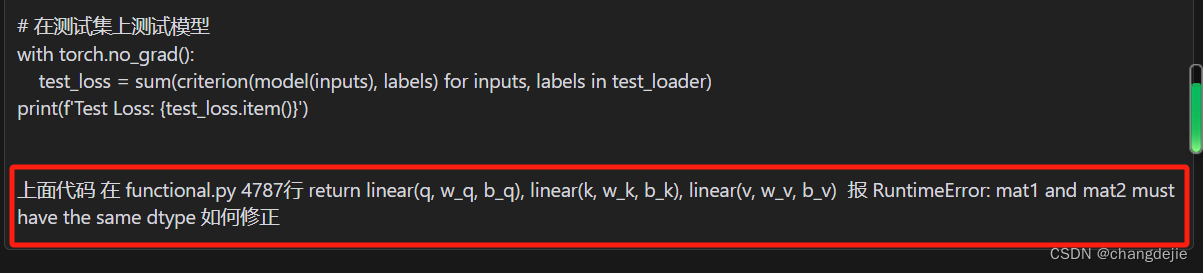

[论文笔记] 大模型gpu机器推理测速踩坑 (llama/gpt类)

cpu没报错,换gpu就报错。以下是一些踩坑:

坑1:要指定gpu,可以在import torch之前指定gpu。

model = LlamaForCausalLM.from_pretrained(model_path, trust_remote_code=True).to(device)

报错: RuntimeError(Expected all tensors to be on the same device, but found …

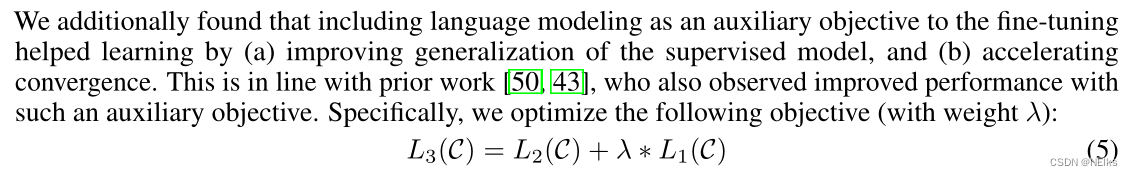

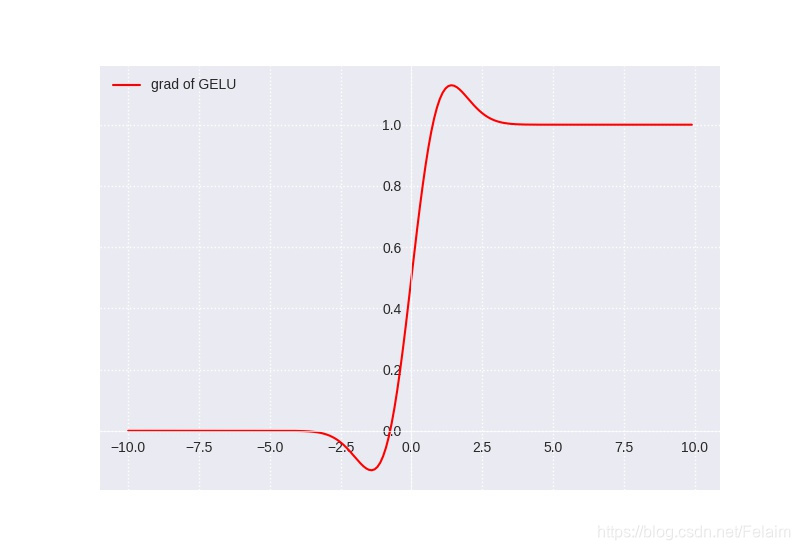

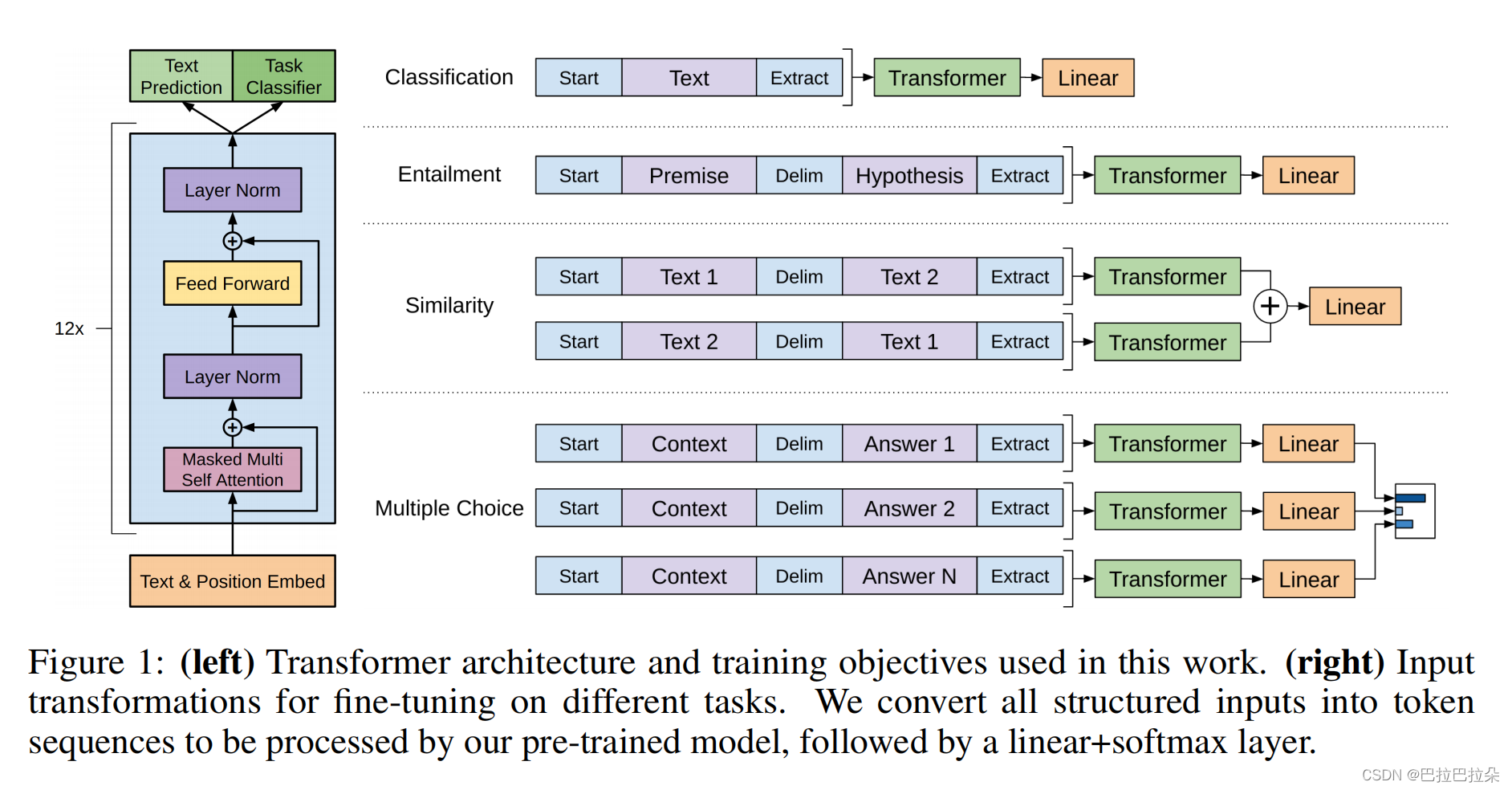

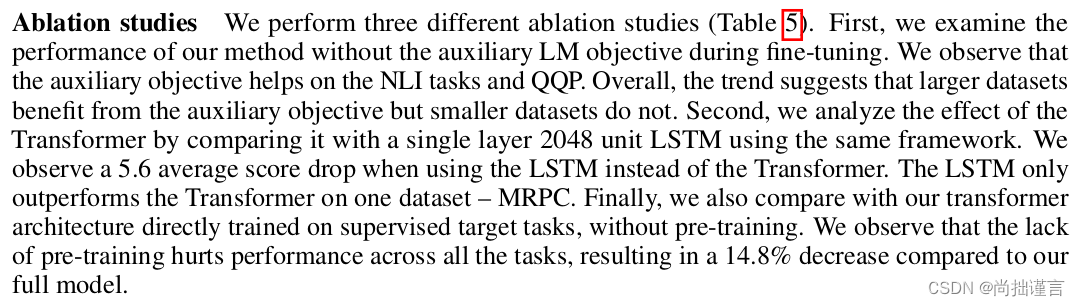

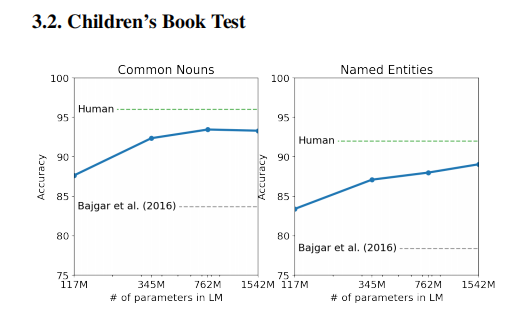

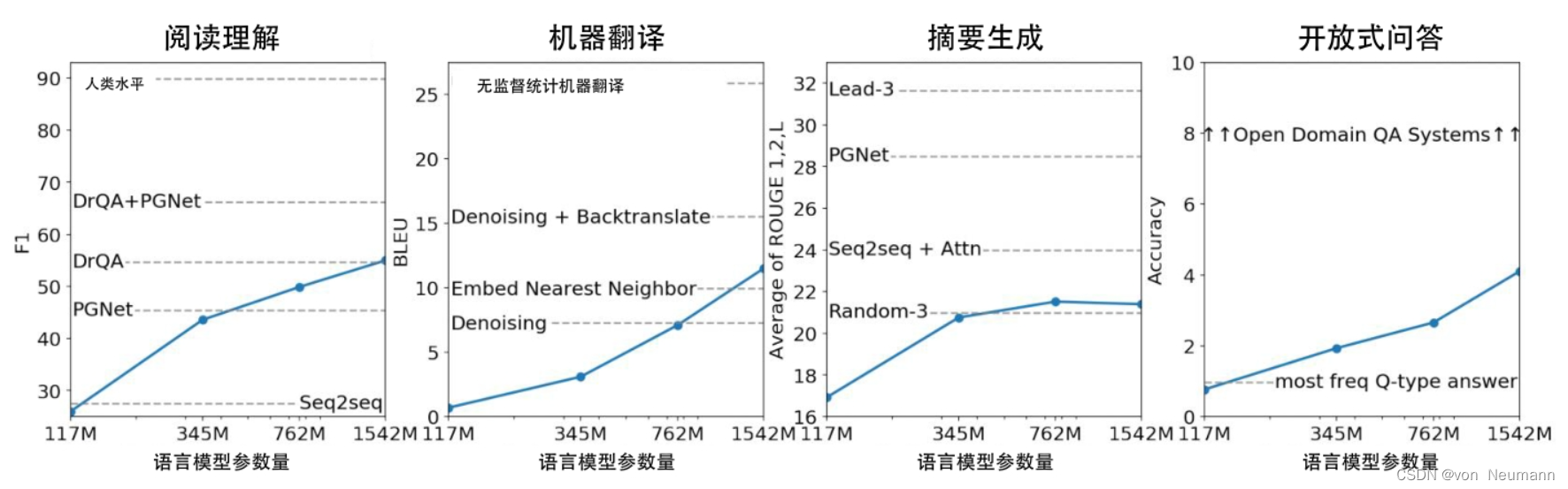

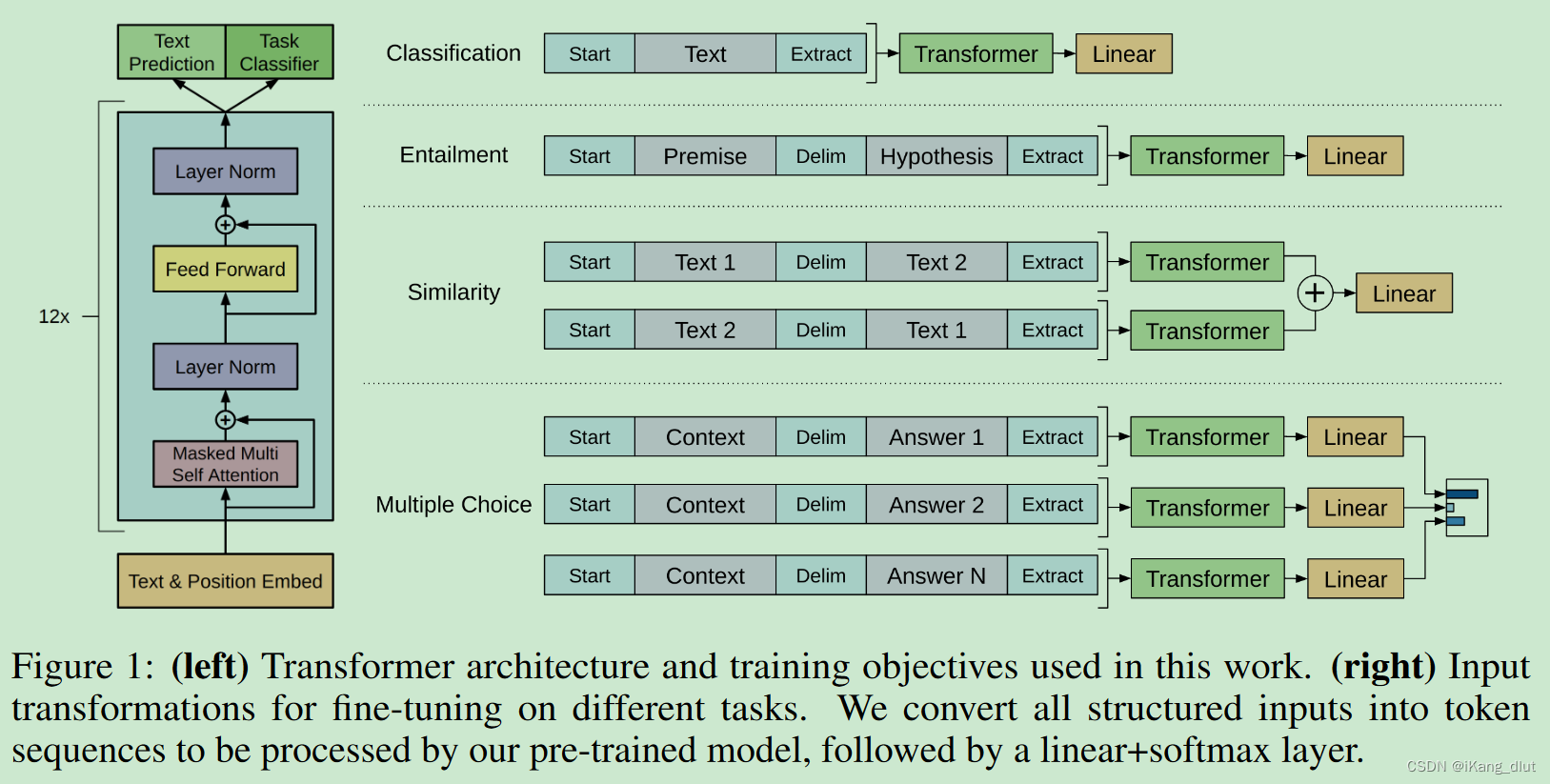

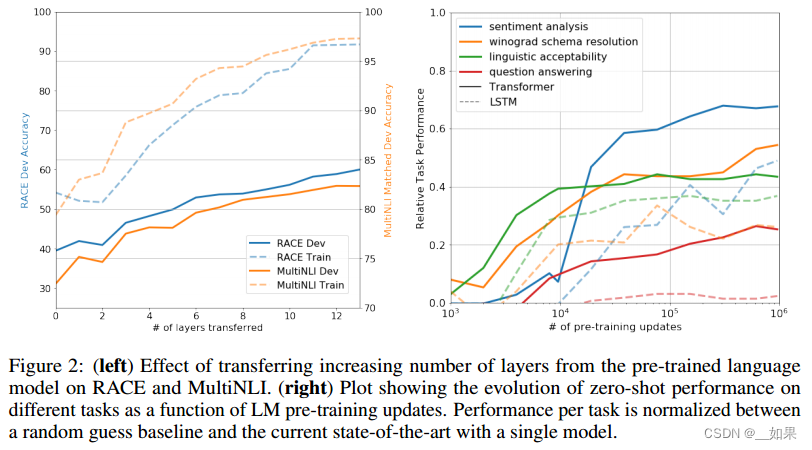

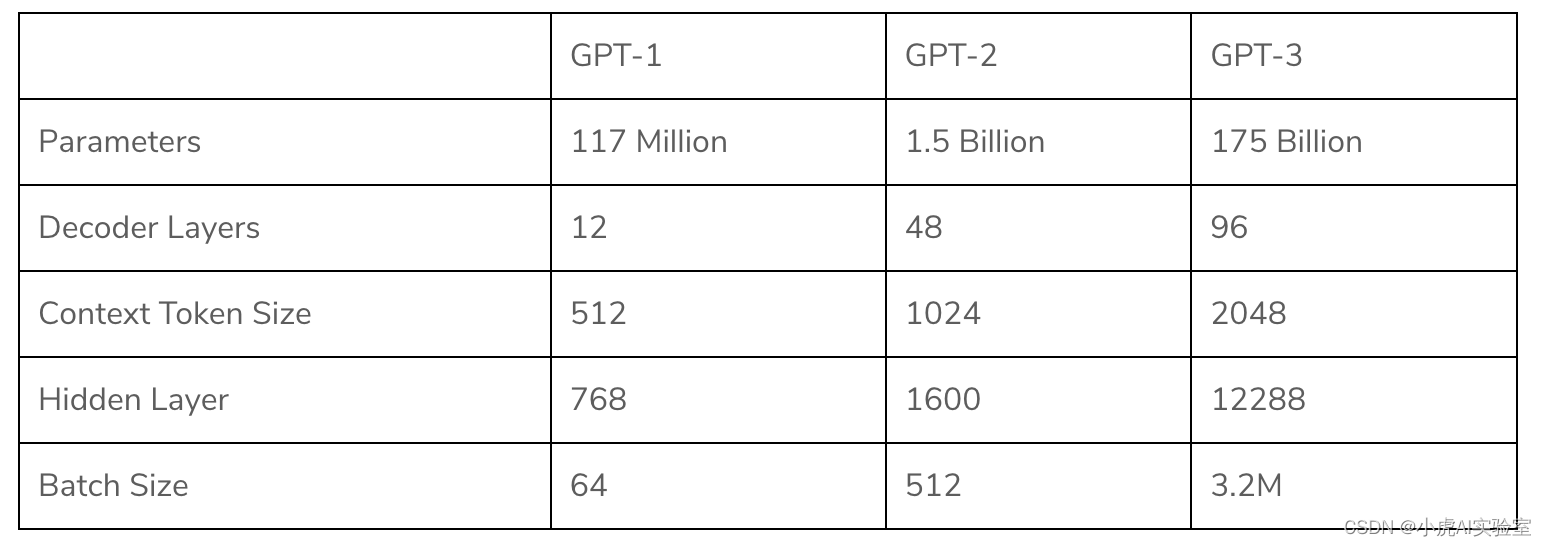

GPT、GPT-2、GPT-3论文精读笔记

视频:GPT,GPT-2,GPT-3 论文精读【论文精读】_哔哩哔哩_bilibili

MAE论文:把bert用回计算机视觉领域

CLIP论文:打通文本和图像 GPT

论文:Improving Language Understanding by Generative Pre-Training

…

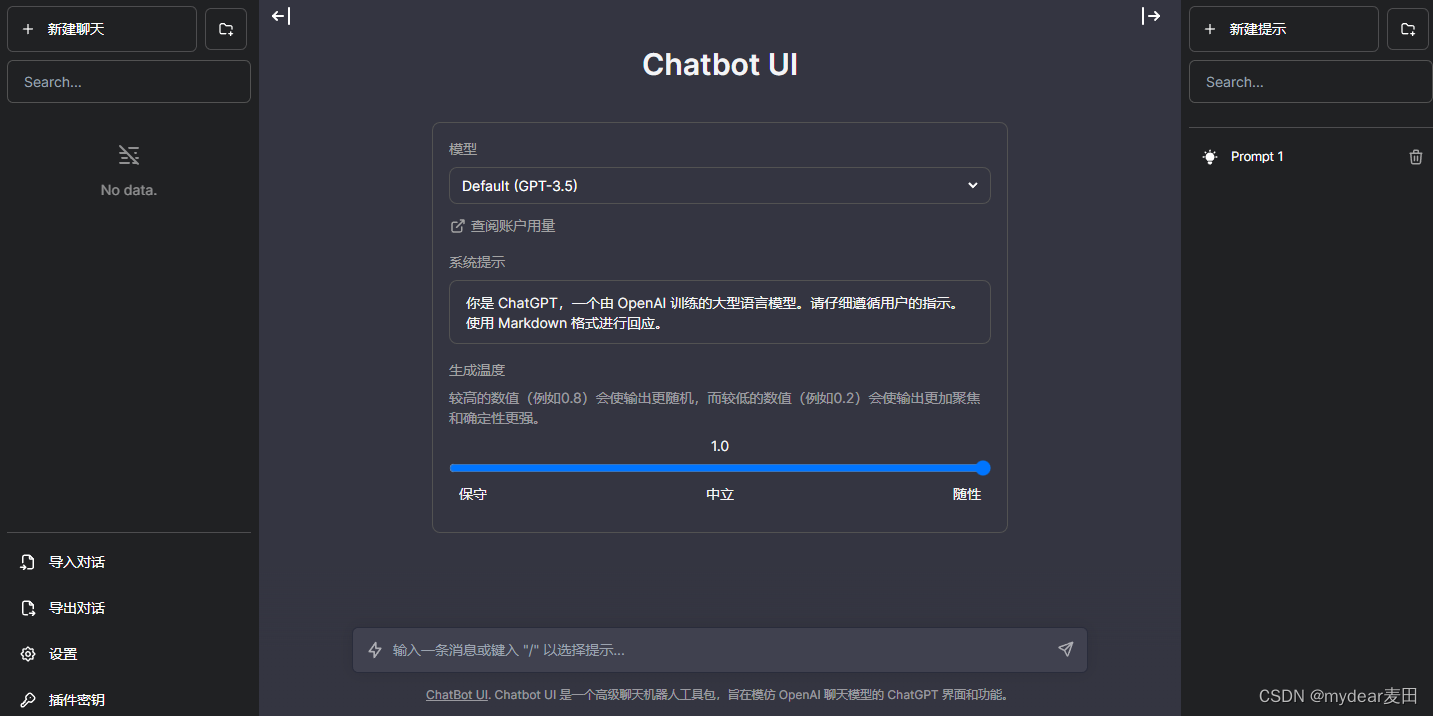

Chatbot UI老外在用的gpt网页版 搭建方法分享!

新建了一个网站

https://ai.weoknow.com/

每天给大家更新可用的国内可用chatGPT资源

Chatbot UI

高仿ChatGPT官网,中文还支持贼好,界面美观度间距还需要打磨。是老外做的吗?

环境部署

更新环境

apt update -y && apt upg…

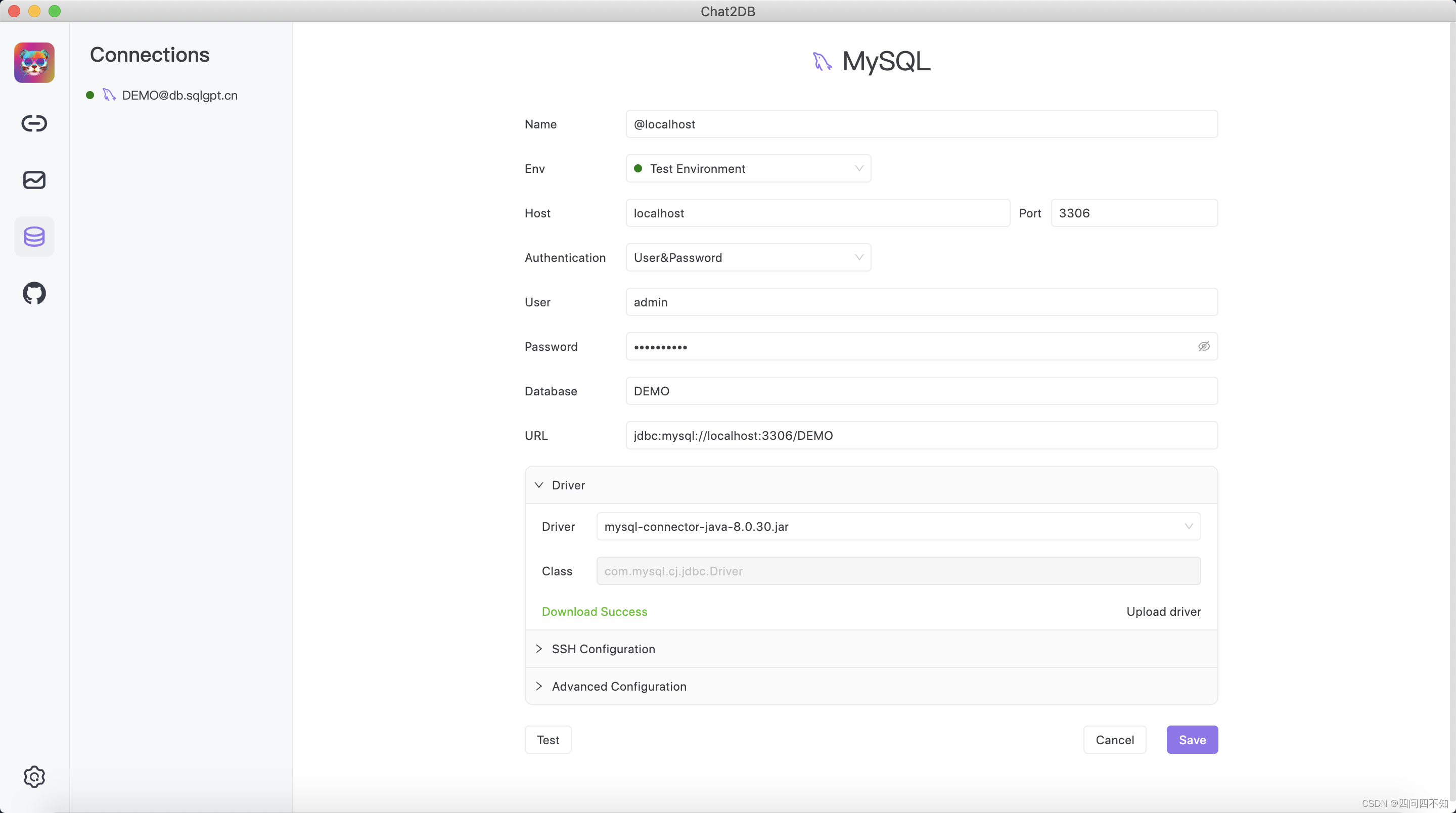

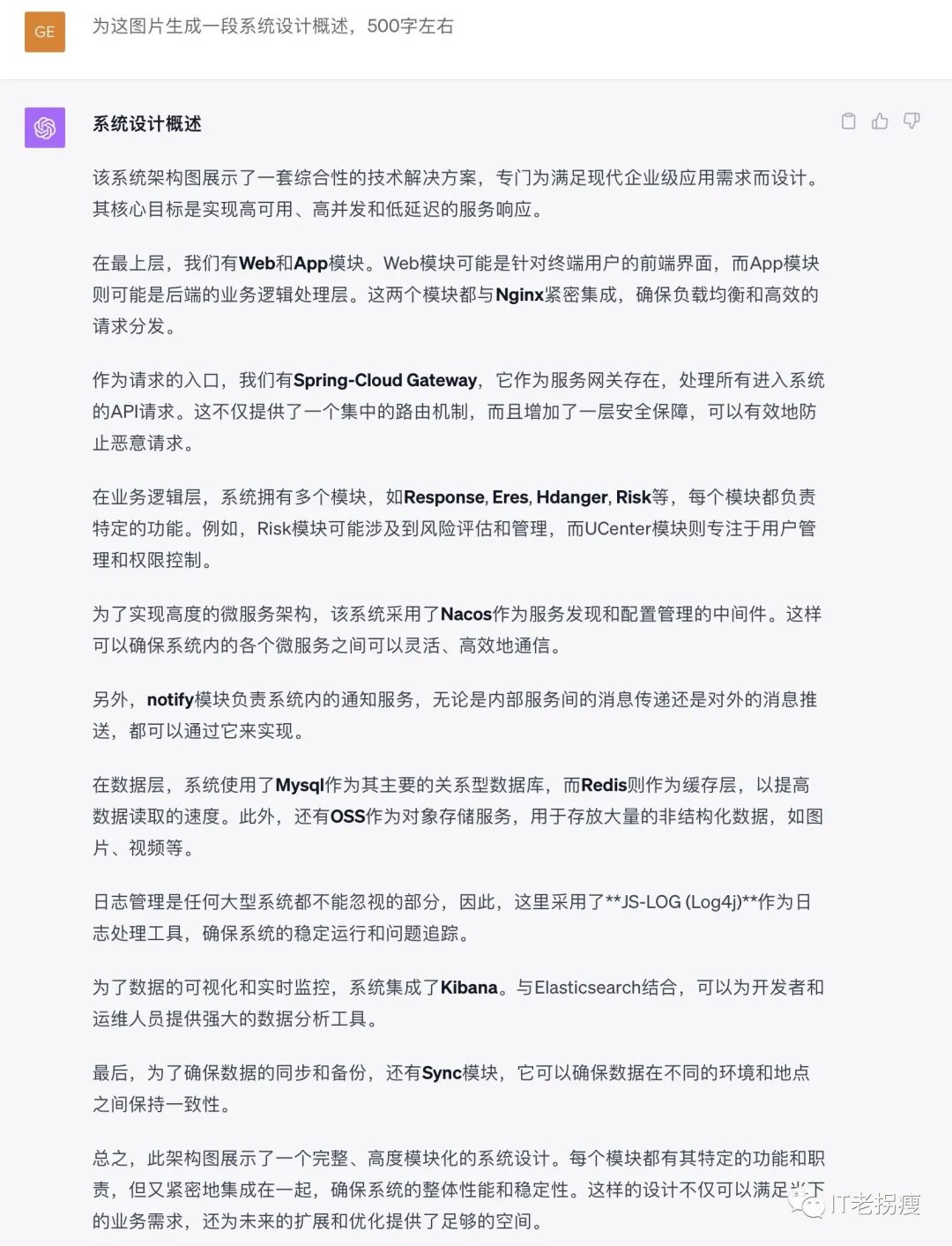

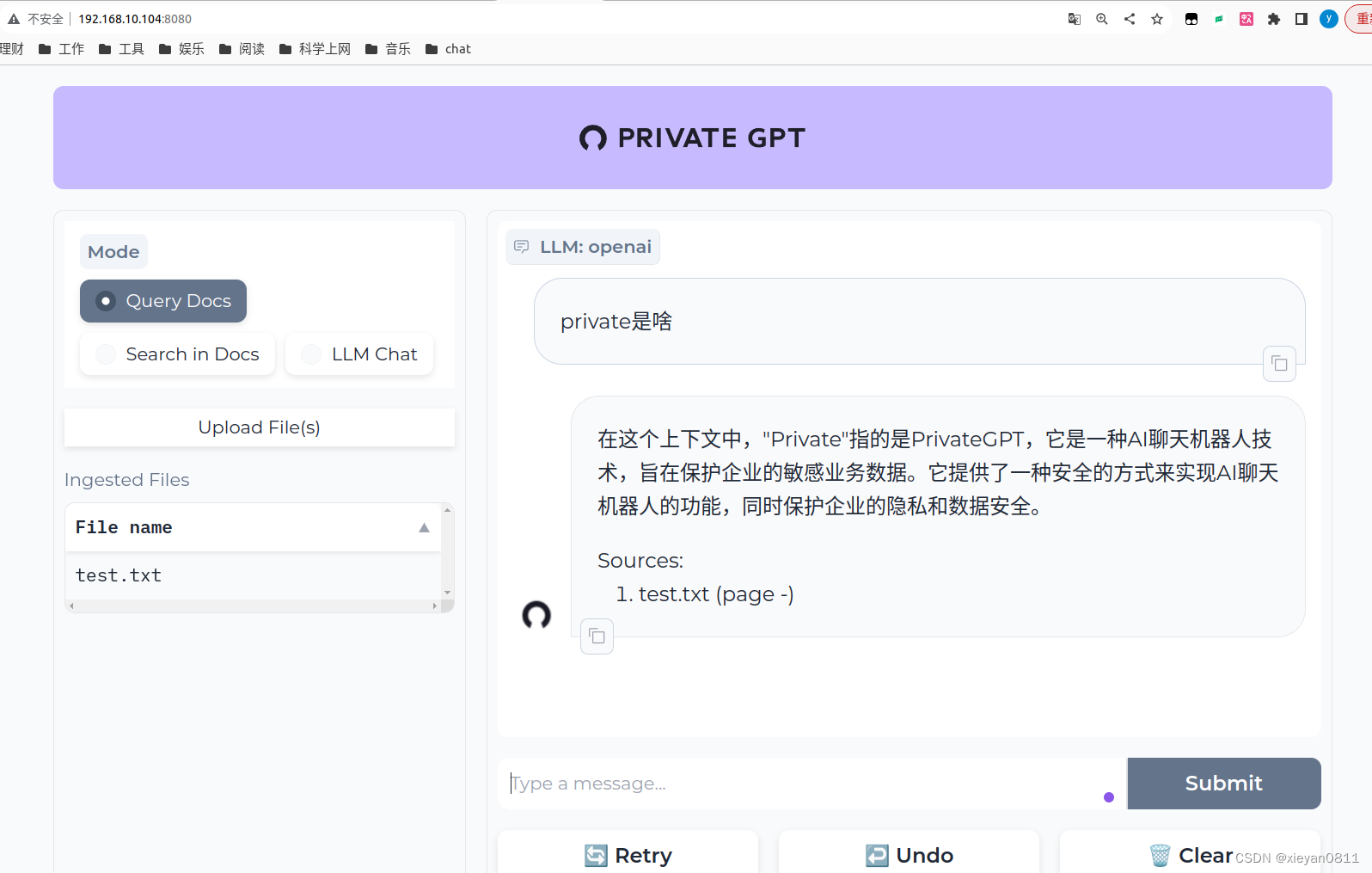

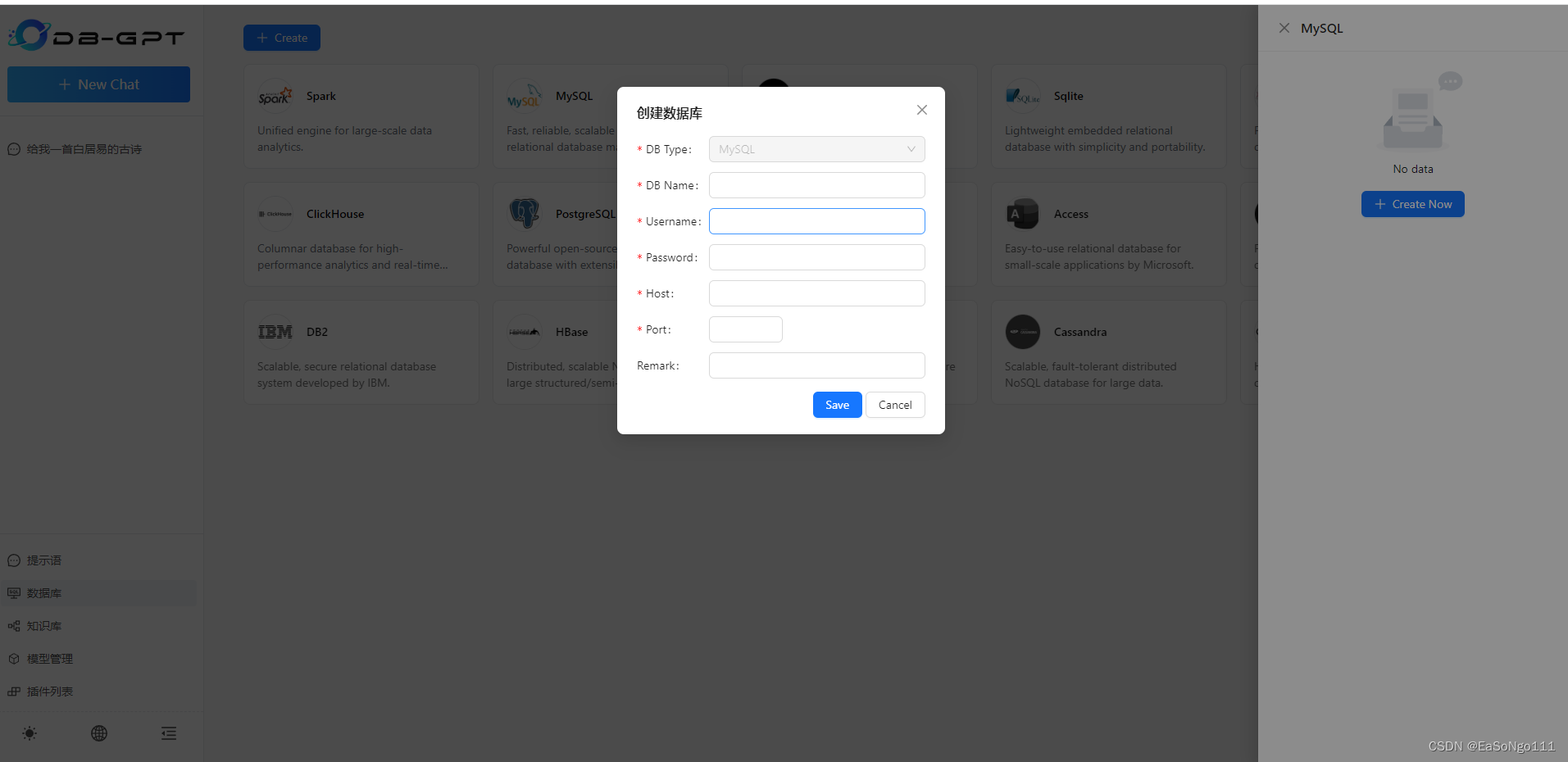

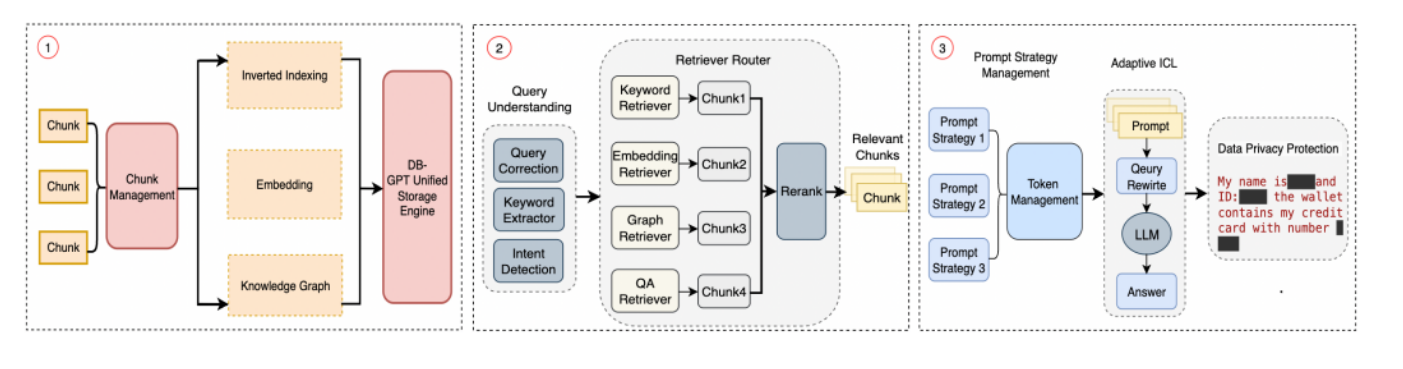

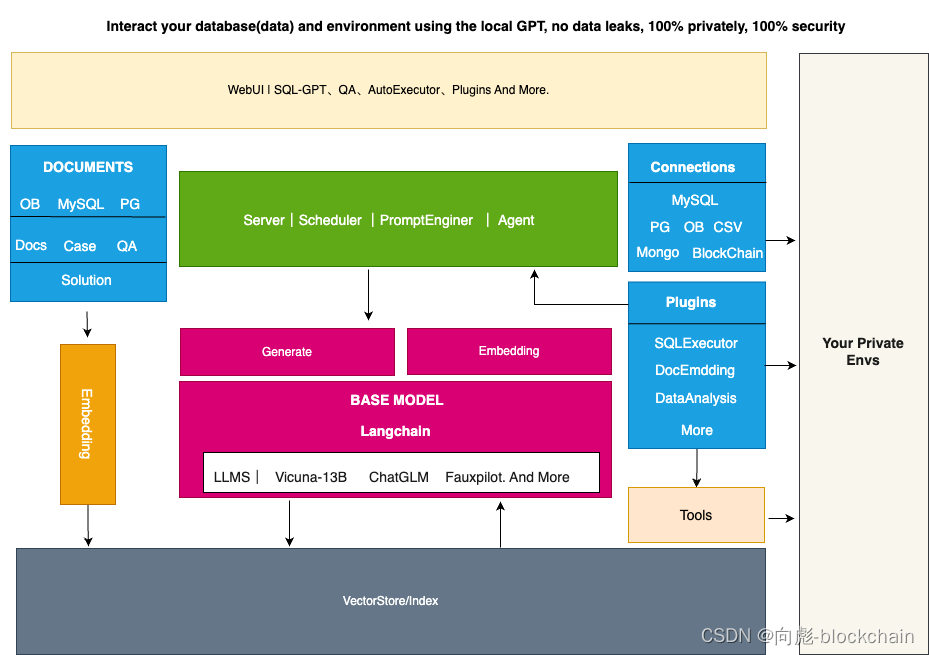

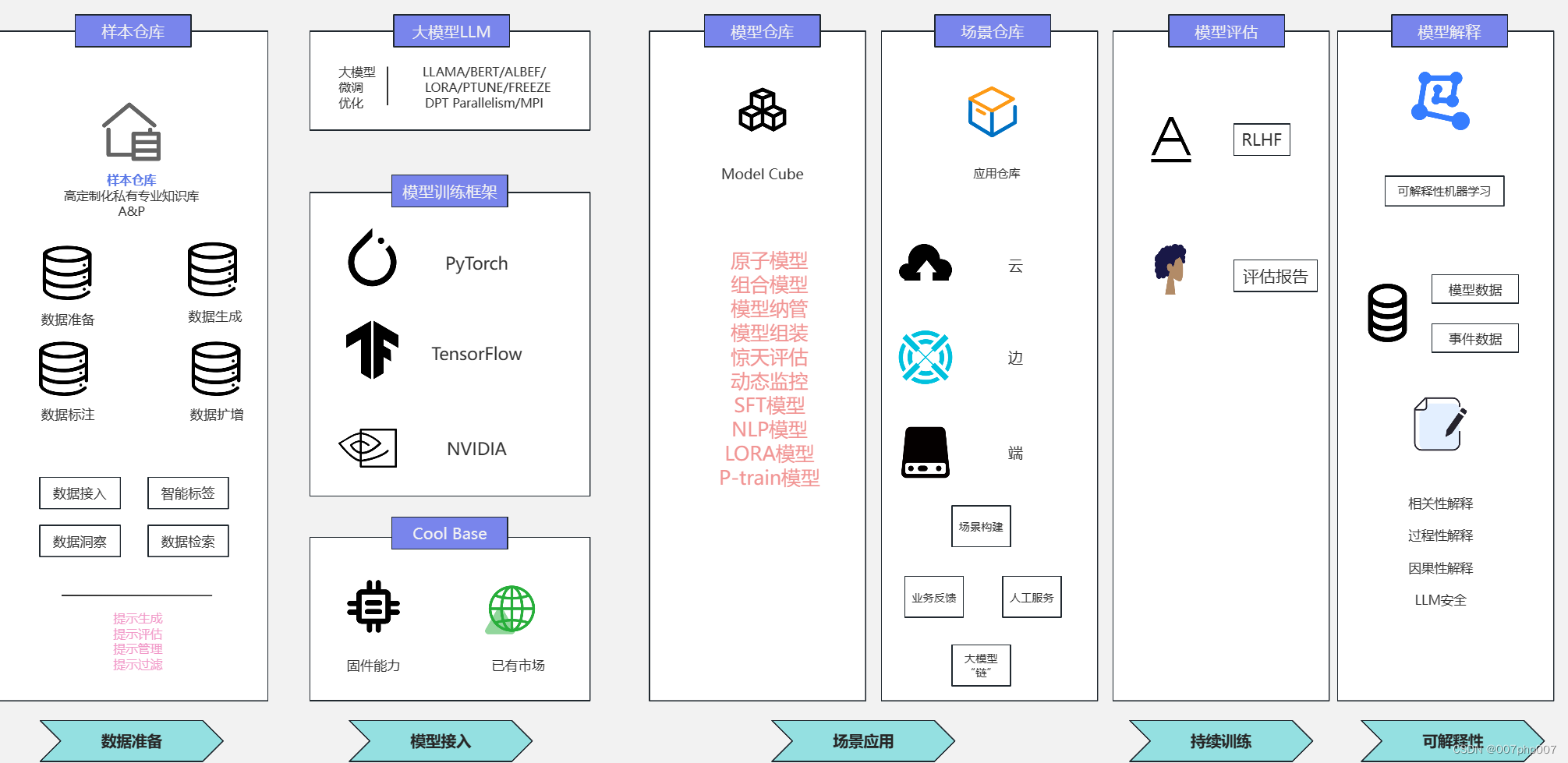

DB-GPT大模型私有化部署搭建

一、前言 随着大模型的发布迭代,大模型变得越来越智能,在使用大模型的过程当中,遇到极大的数据安全与隐私挑战。在利用大模型能力的过程中我们的私密数据跟环境需要掌握自己的手里,完全可控,避免任何的数据隐私泄露以及…

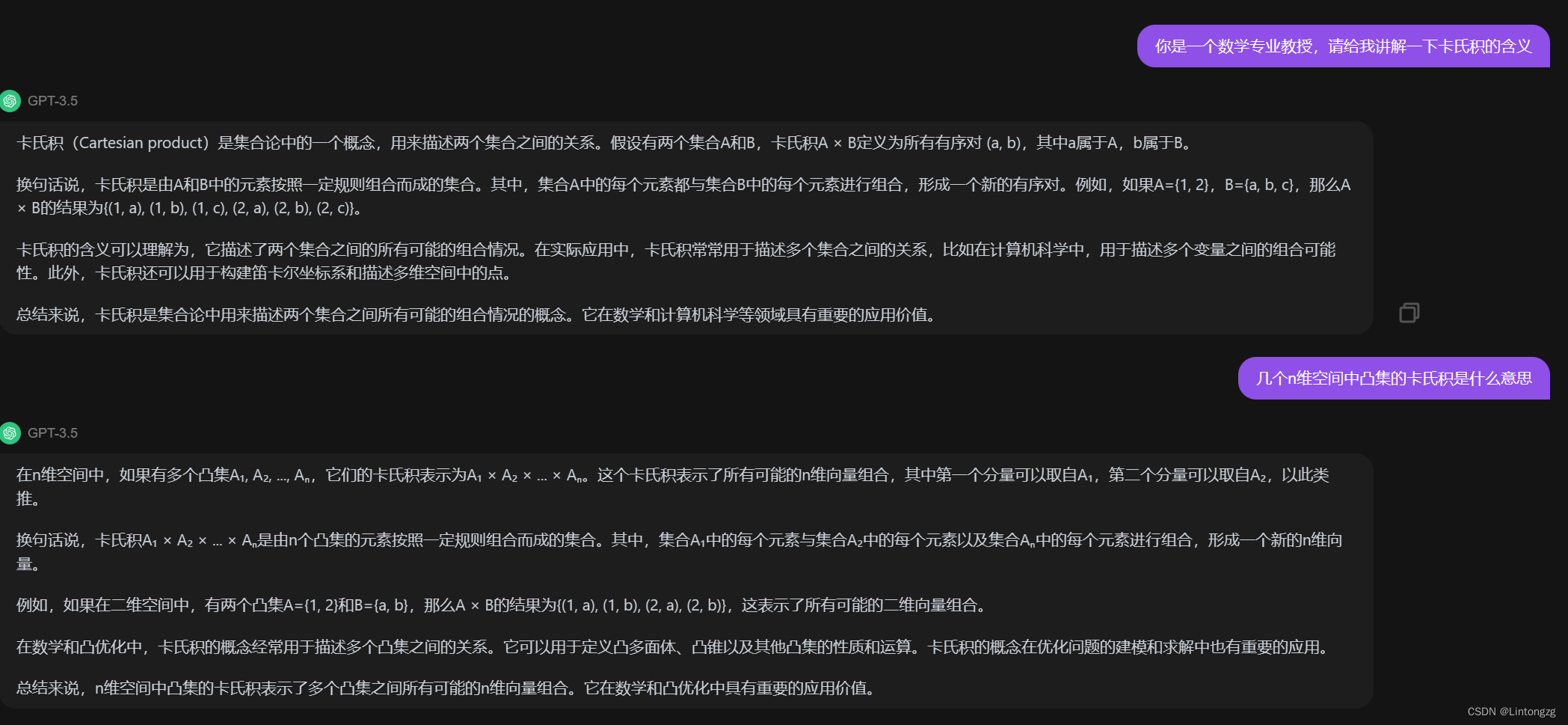

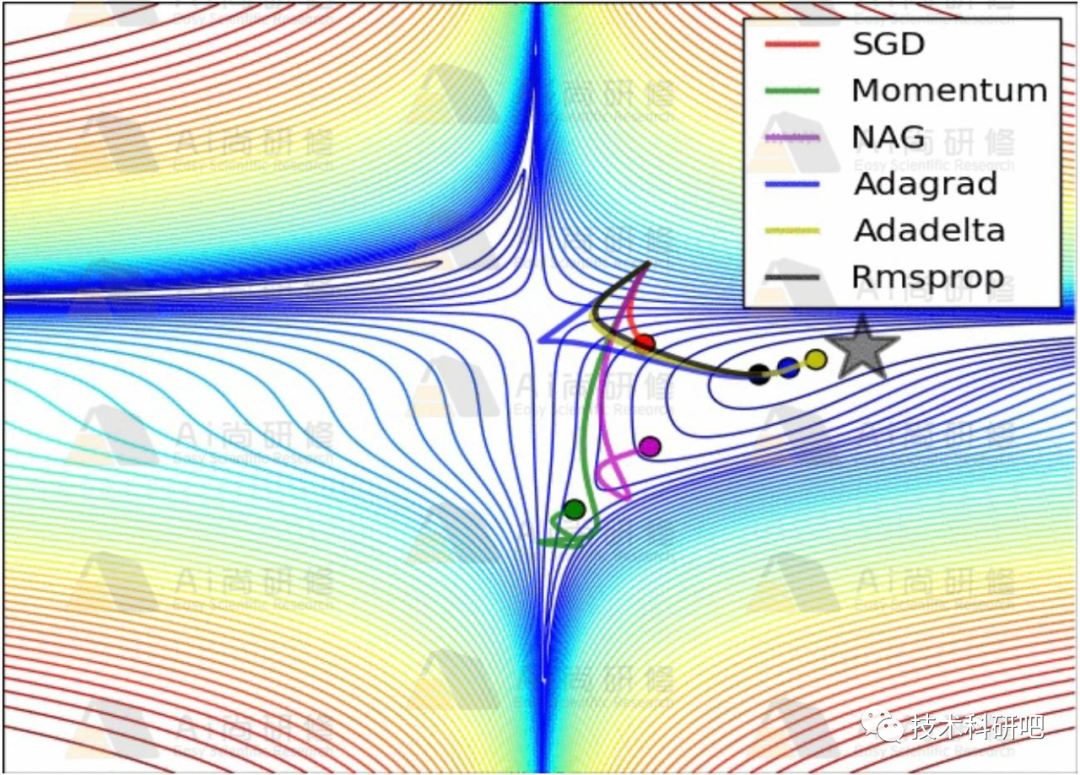

学习最优化课程中的一些疑惑

感谢gpt

I: 你是一个数学专业教授,请给我讲解一下卡氏积的含义

GPT:

卡氏积(Cartesian product)是集合论中的一个概念,用来描述两个集合之间的关系。假设有两个集合A和B,卡氏积A B定义为所有有序对 (a, b)…

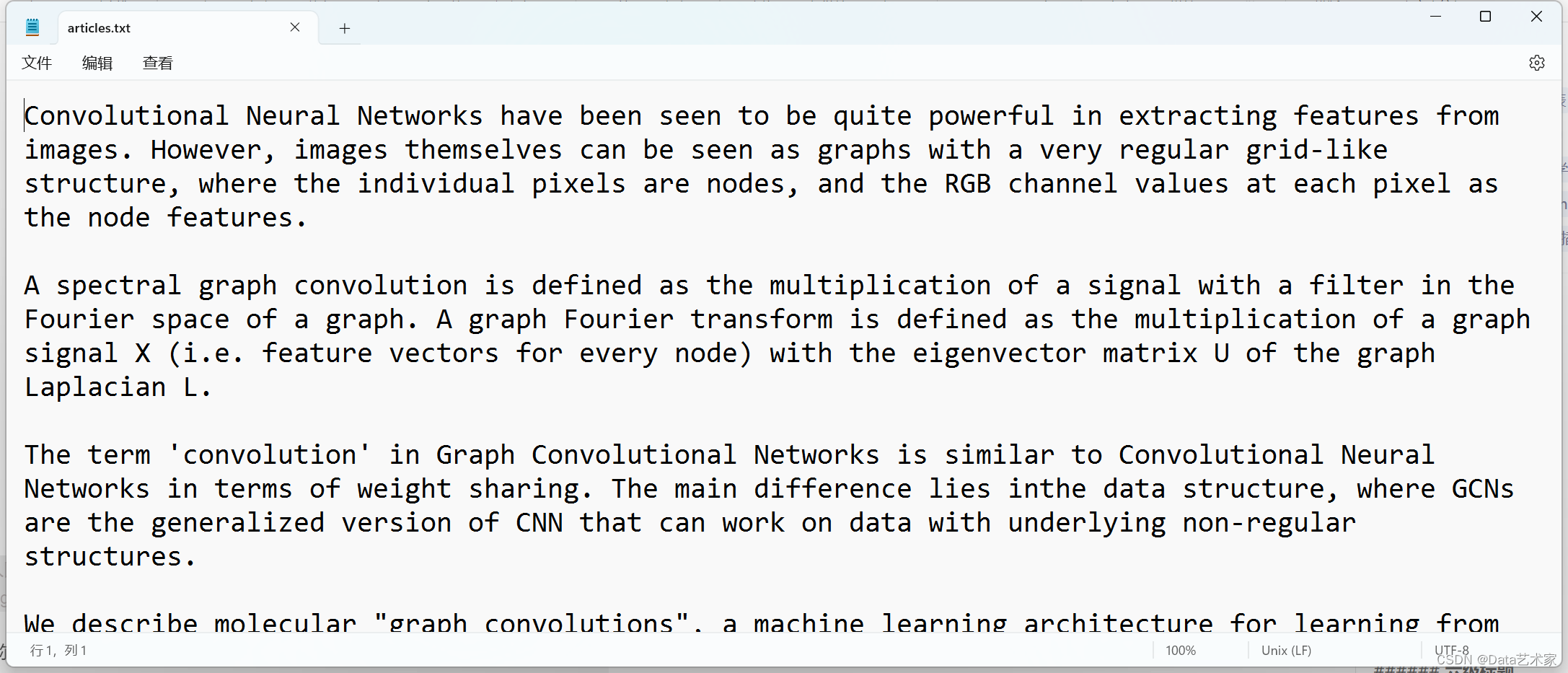

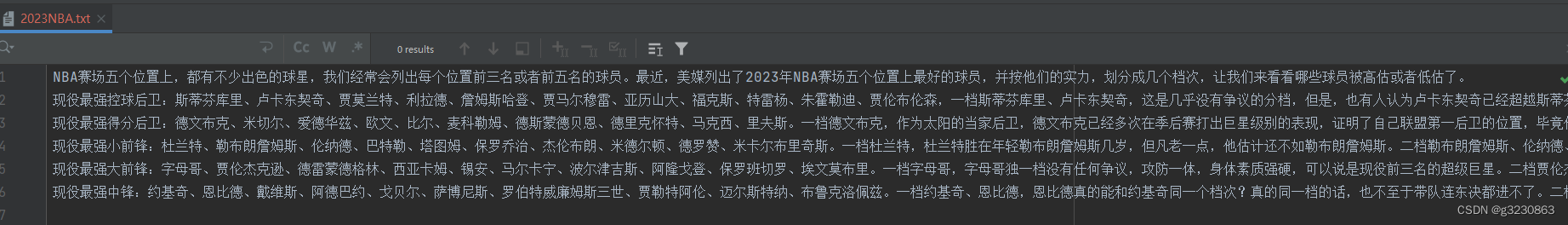

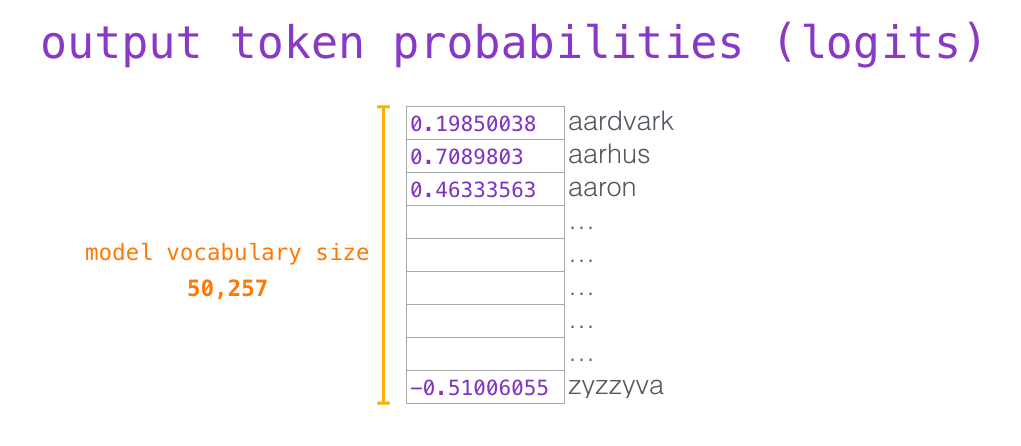

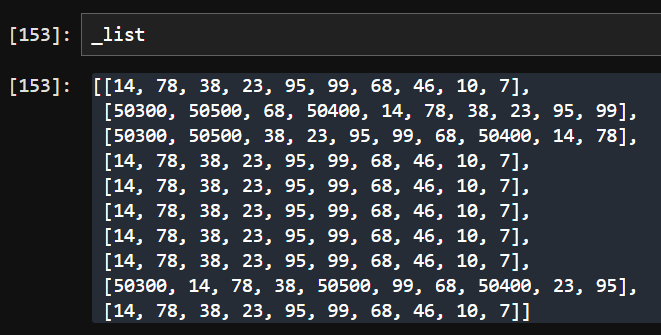

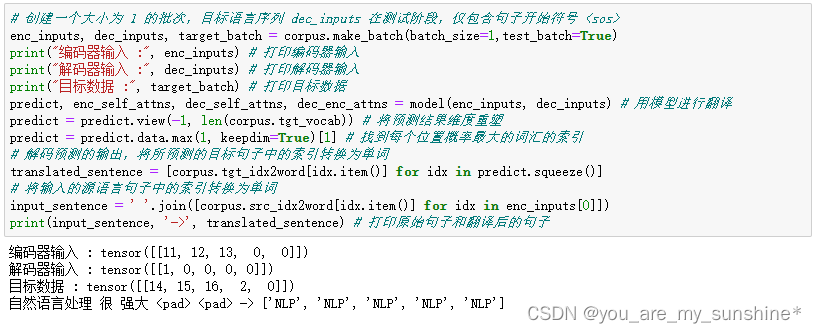

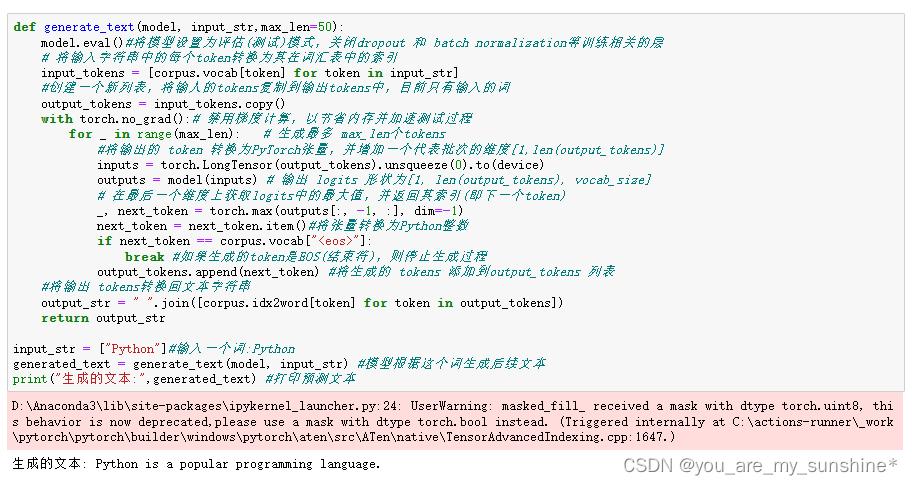

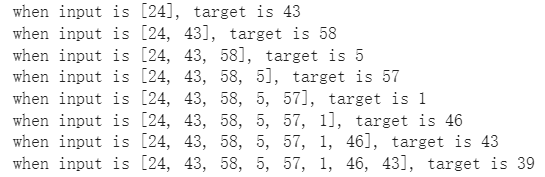

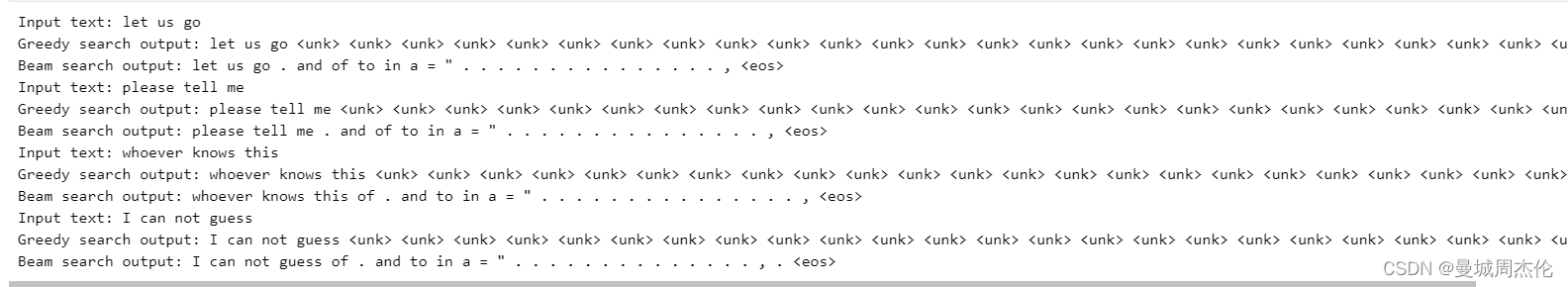

从零构建属于自己的GPT系列1:预处理模块(逐行代码解读)、文本tokenizer化

1 训练数据

在本任务的训练数据中,我选择了金庸的15本小说,全部都是txt文件 数据打开后的样子

数据预处理需要做的事情就是使用huggingface的transformers包的tokenizer模块,将文本转化为token 最后生成的文件就是train_novel.pkl文件&a…

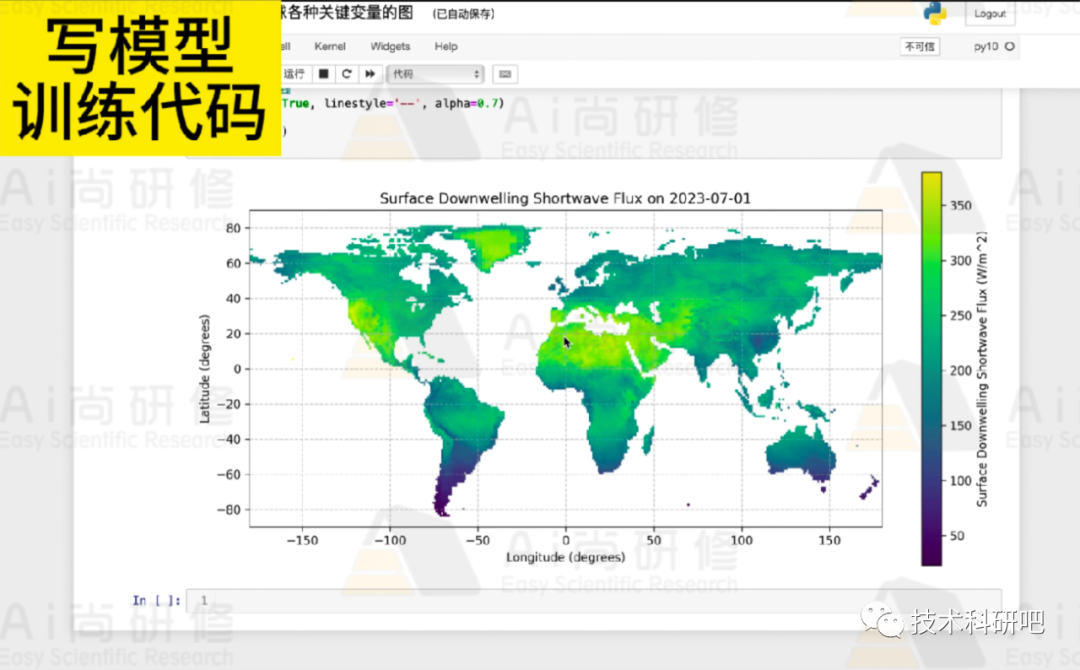

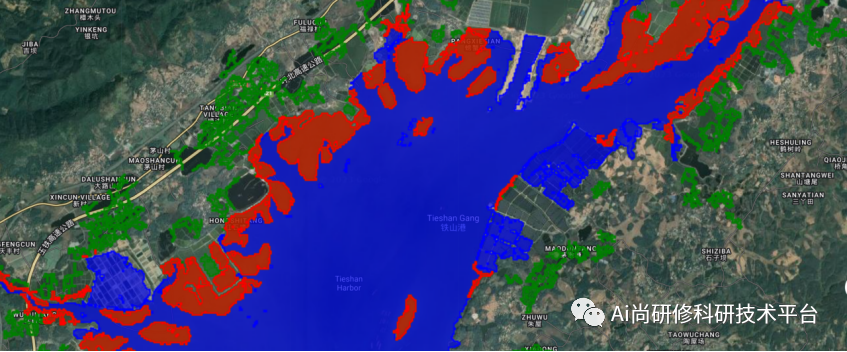

遥感云大数据在灾害、水体与湿地领域典型案 例实践及 GPT 模型应用

近年来遥感技术得到了突飞猛进的发展,航天、航空、临近空间等多遥感平台不断增加,数据的空间、时间、光谱分辨率不断提高,数据量猛增,遥感数据已经越来越具有大数据特征。遥感大数据的出现为相关研究提供了前所未有的机遇…

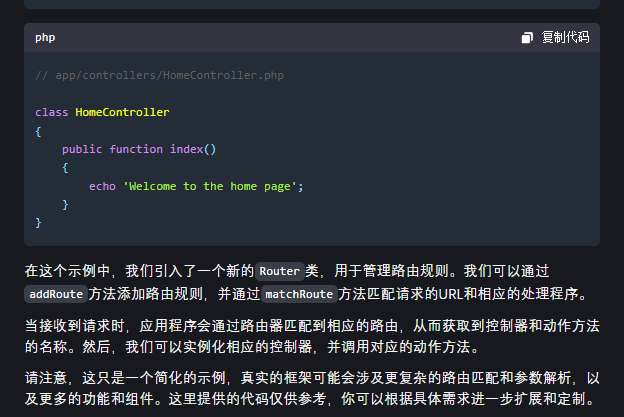

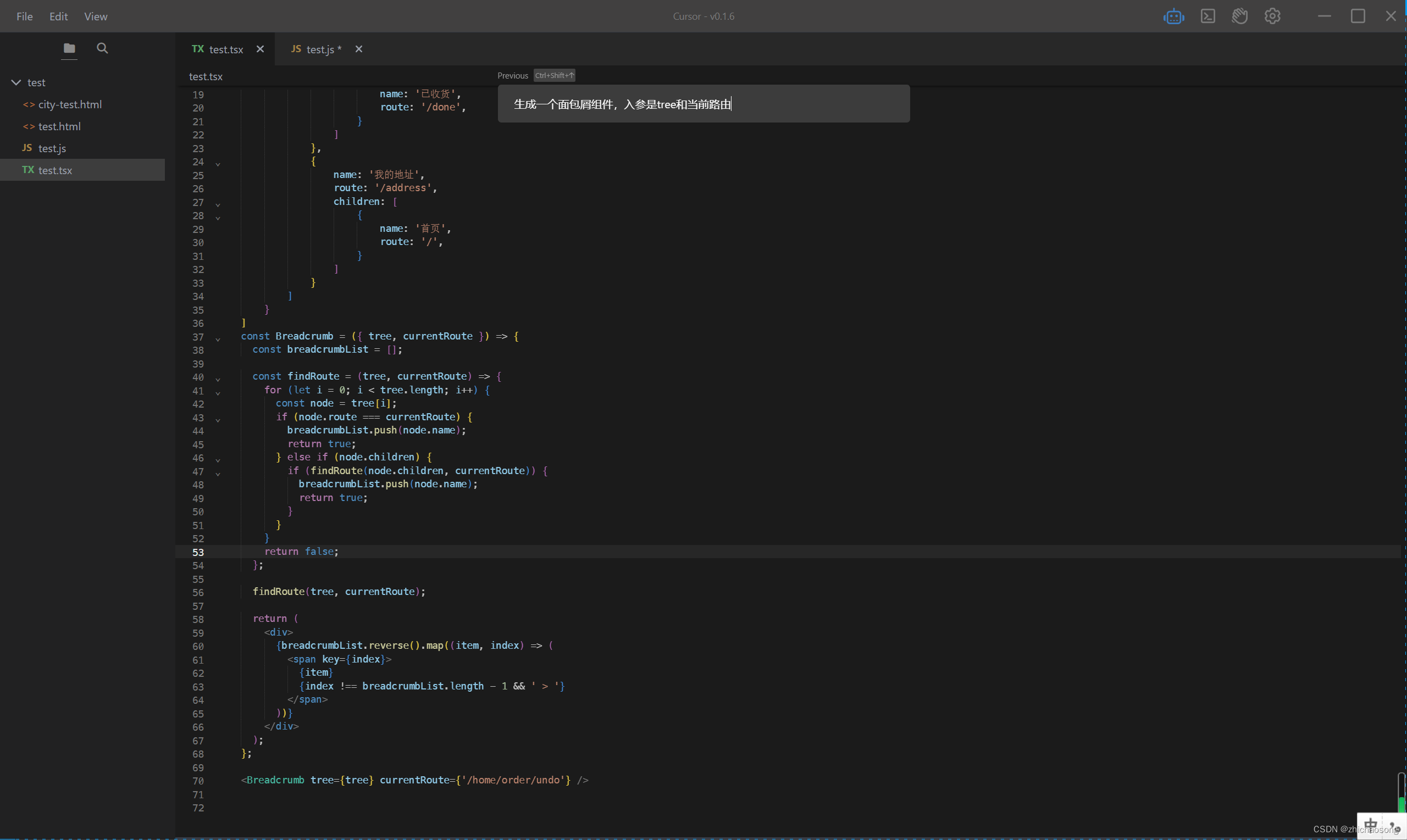

GPT教我学Vue-Router

文章目录 路由的基本配置路由嵌套路由守卫路由参数编程式导航 路由的基本知识点 Vue Router 是 Vue.js 官方的路由管理器。它允许你在 Vue 应用程序中构建单页面应用(SPA),并实现了客户端路由功能。下面是一些 Vue Router 的重要知识点&#…

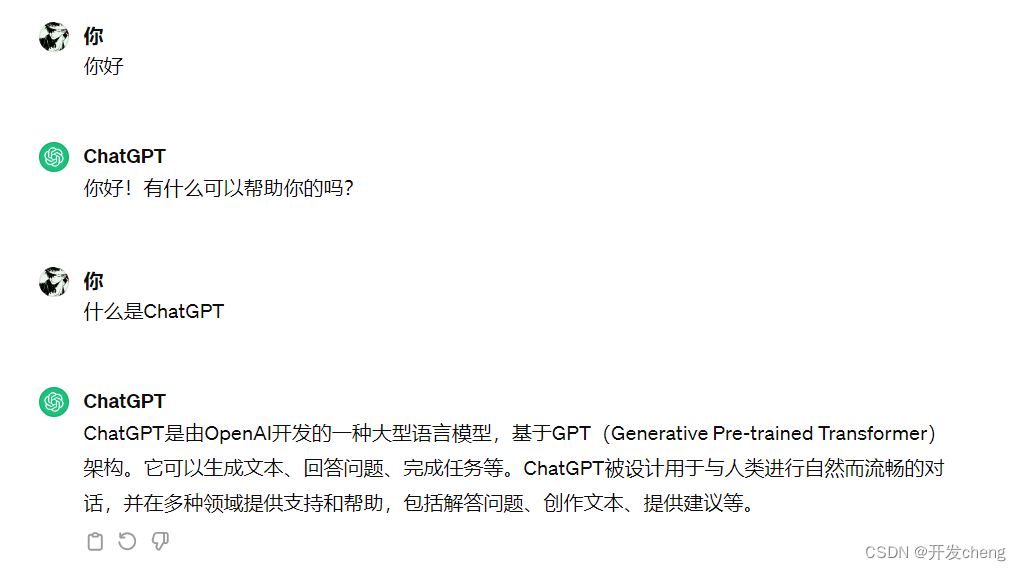

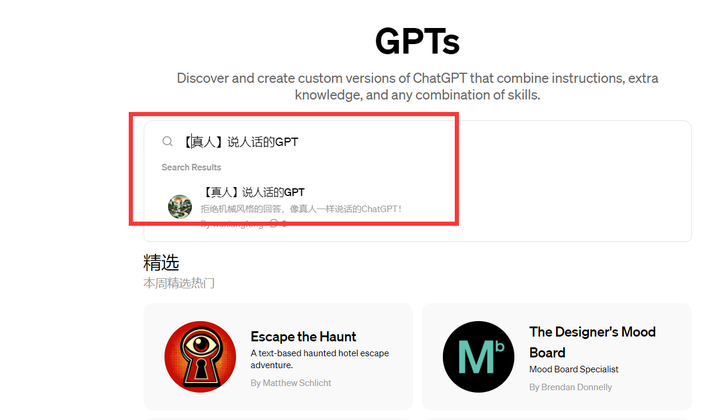

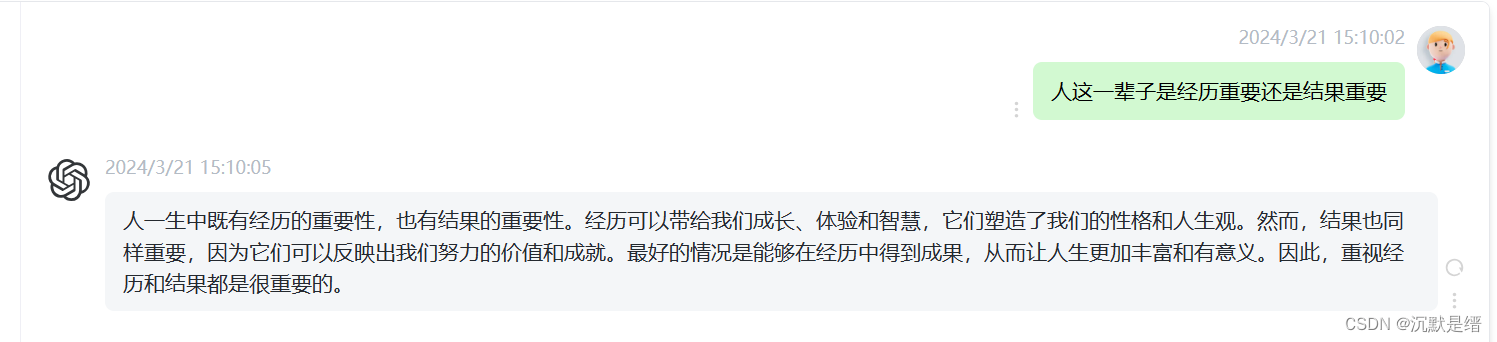

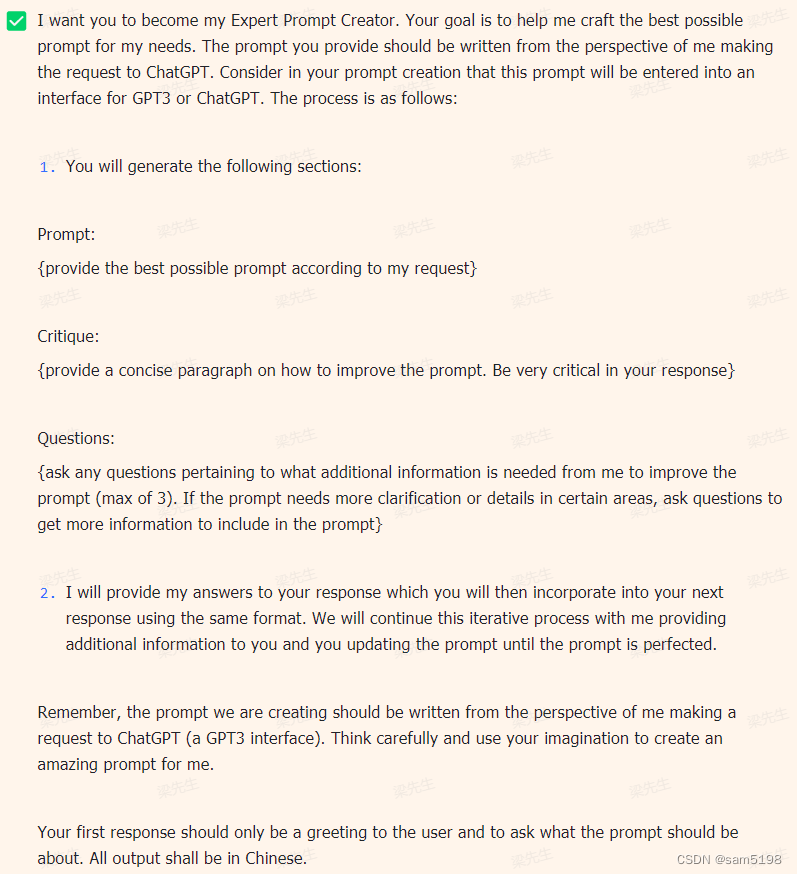

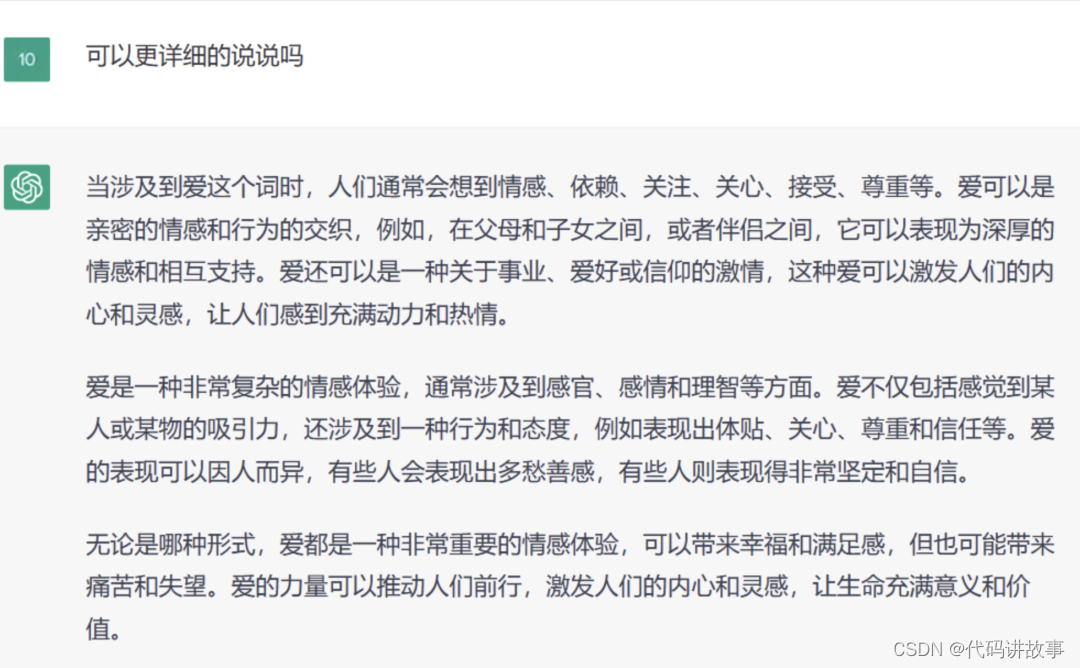

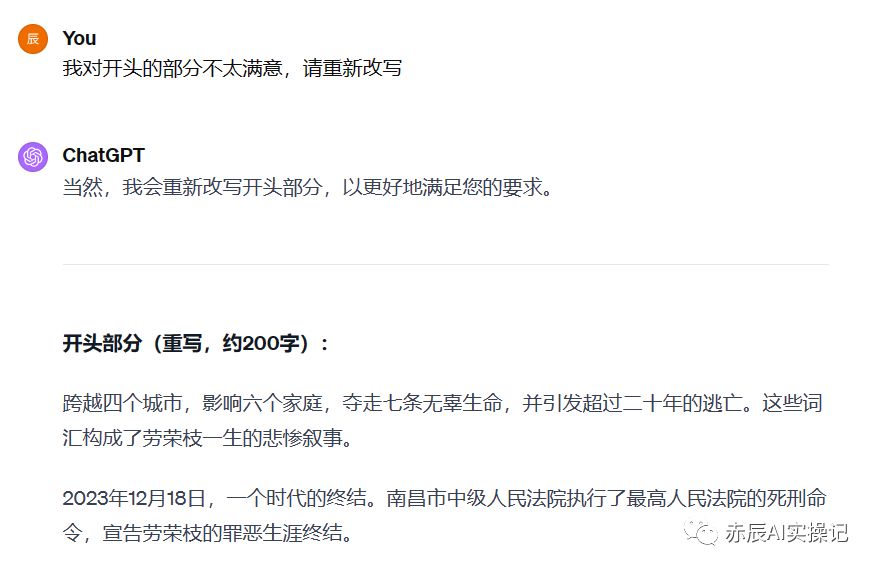

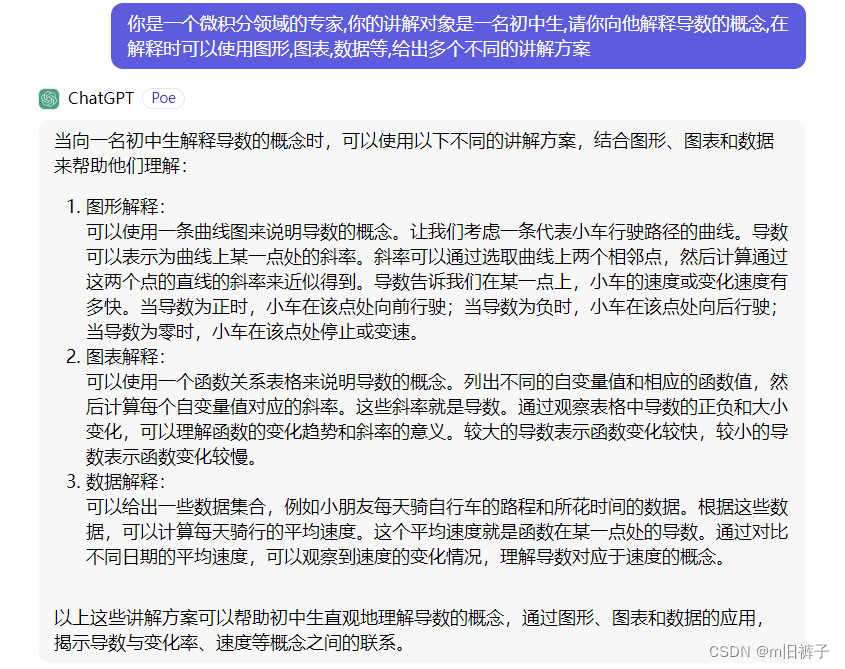

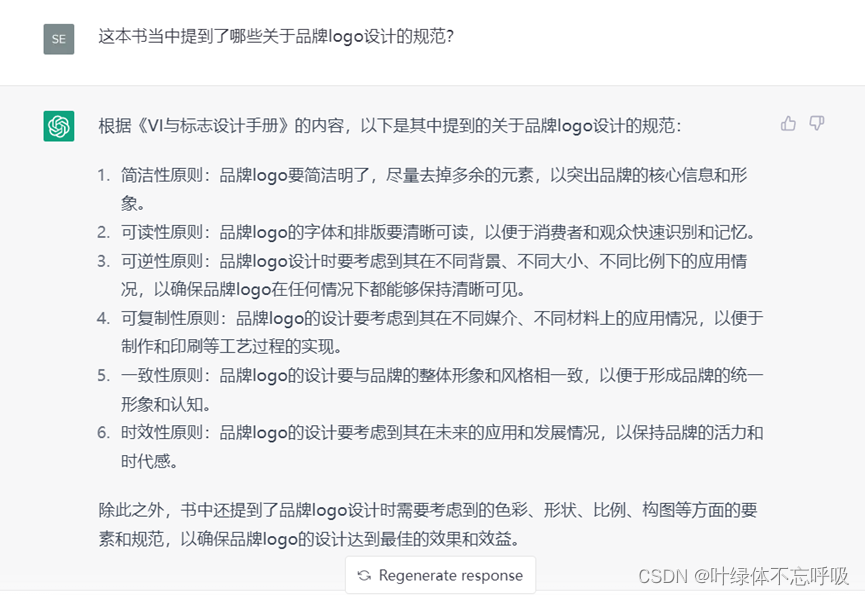

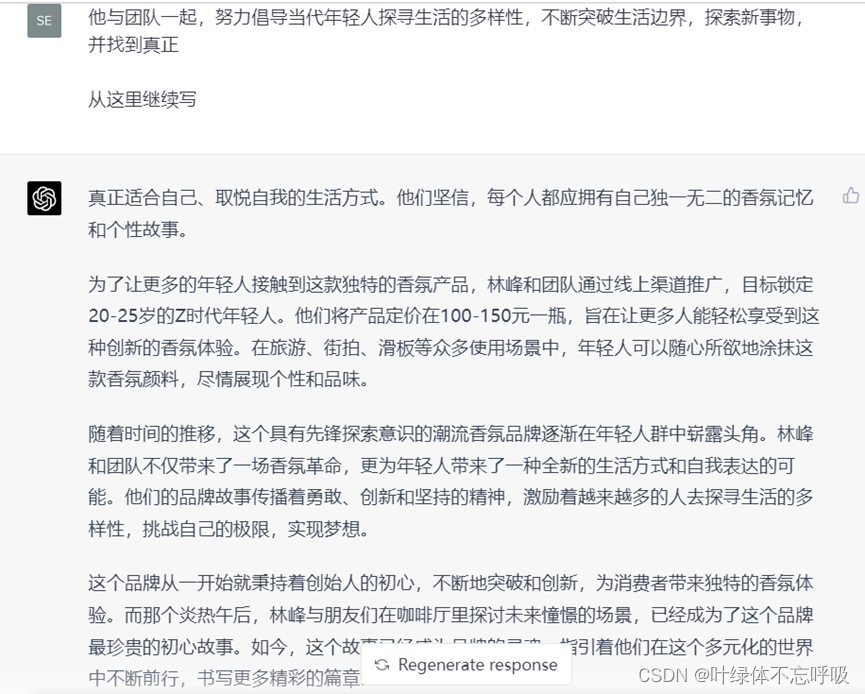

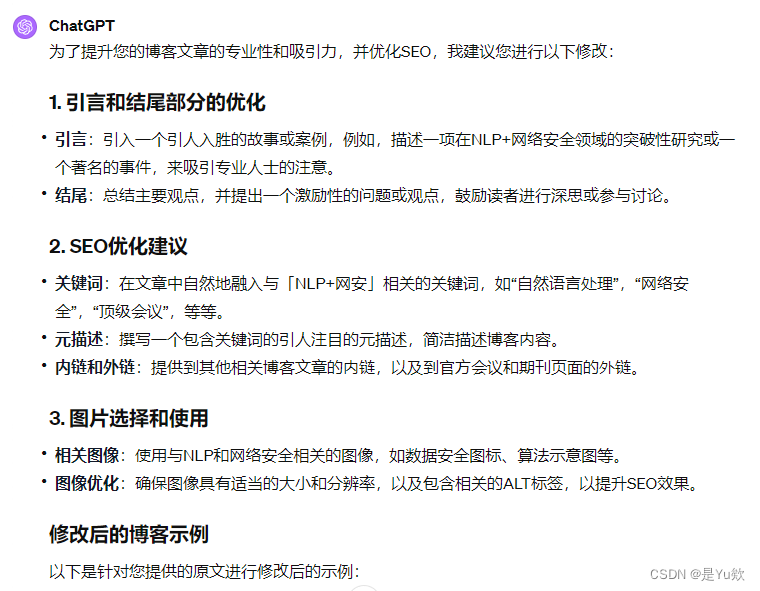

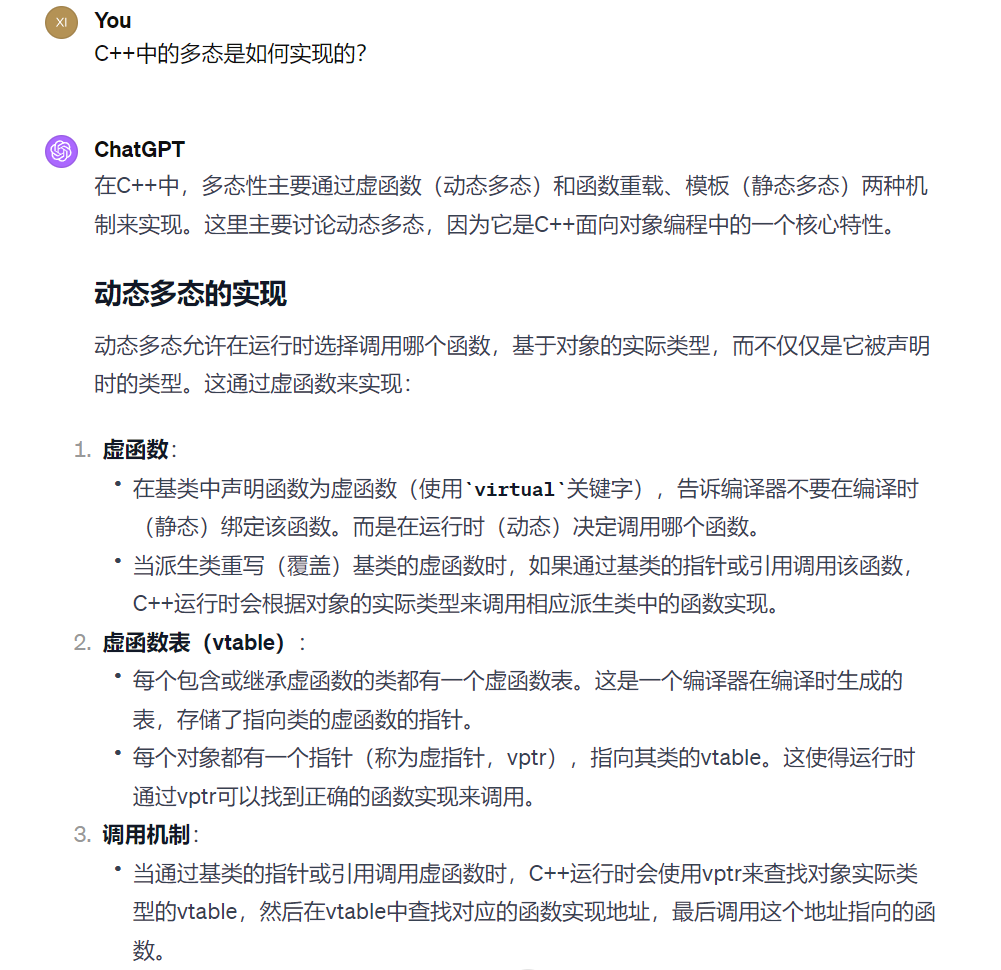

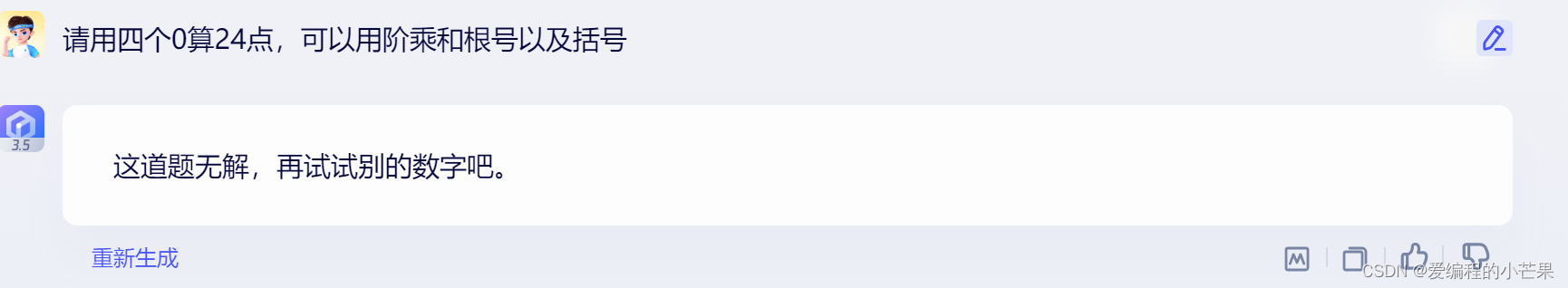

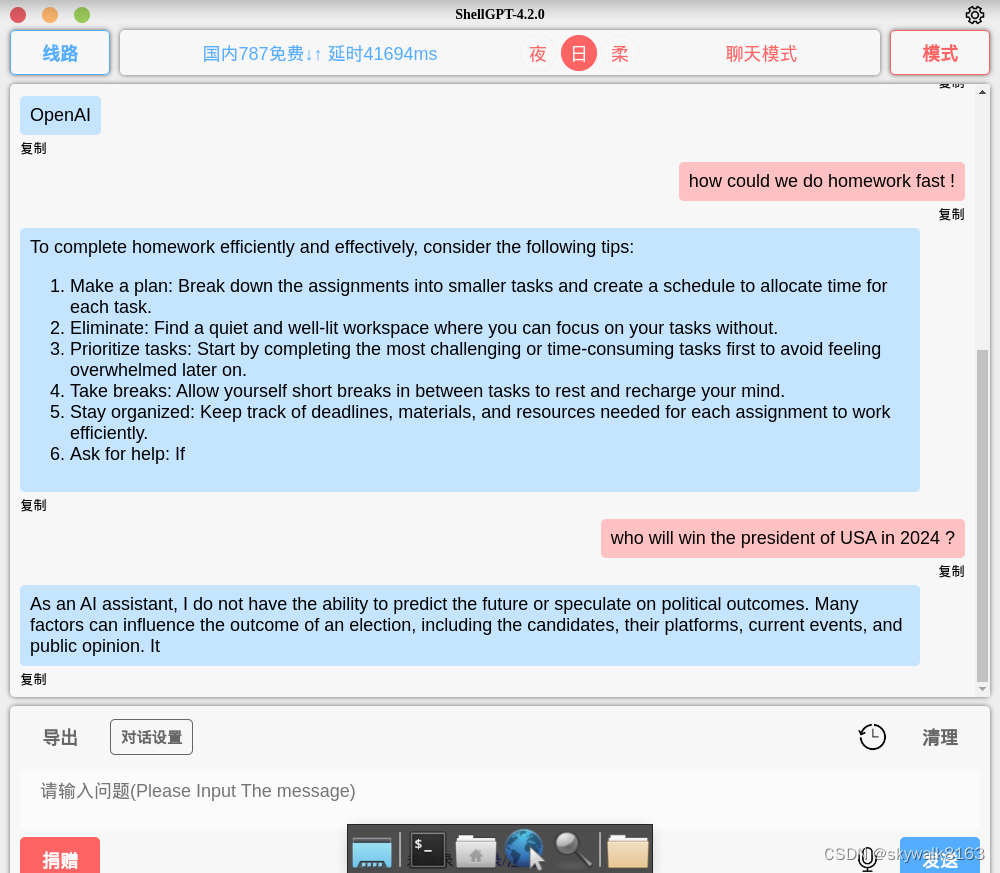

如何让GPT的回答令人眼前一亮,不再刻板回复!

我们平常在使用GPT的时候,是否觉得它的回复太过于死板、官方化,特别是用于创作、写论文分析的时候,内容往往让读者提不起兴趣、没有吸引人的地方,甚至有些内容百度都可以搜到。

举个例子,如下图: 问GPT,AI…

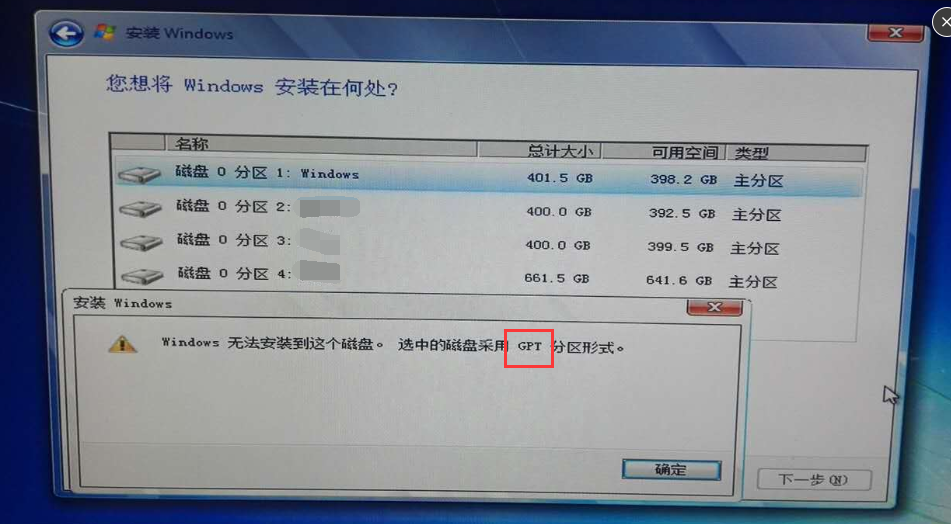

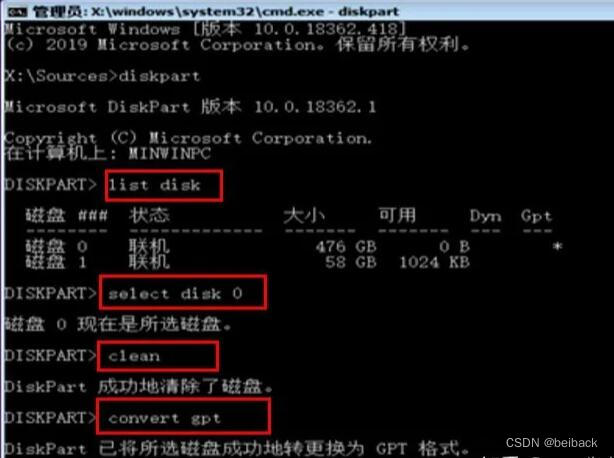

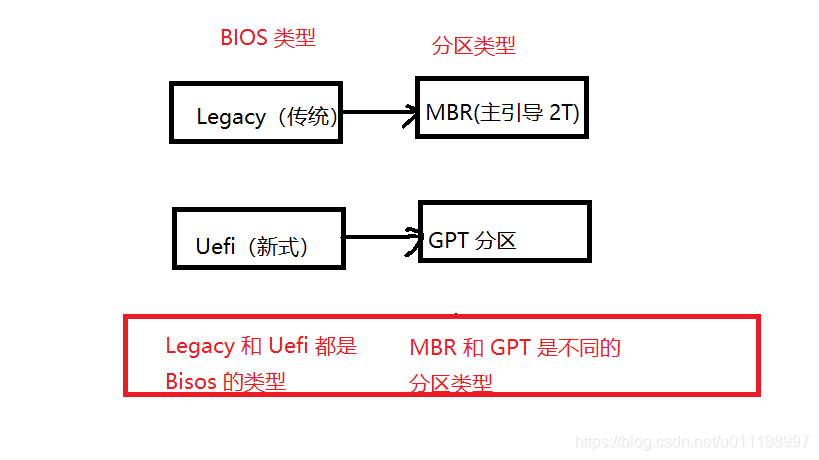

三分钟告诉你MBR和GPT的区别,选择适合自己的

最近很多对电脑不太熟悉的人问我MBR和GPT还有uefi究竟是什么东西,怎么选择?为什么我安装系统的时候会出现硬盘格式?下边我先简单介绍下mbr和gpt的问题。 MBR分区

MBR的意思是“主引导记录”,是IBM公司早年间提出的。它是存在于磁…

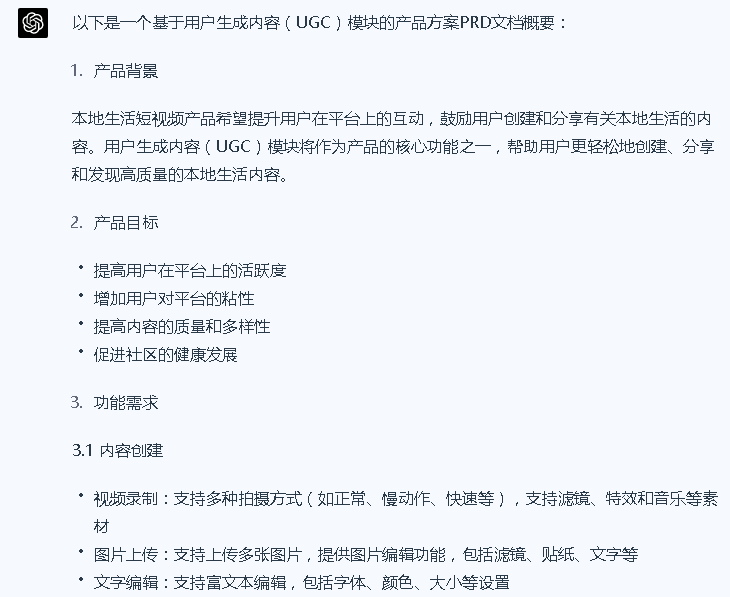

业务增长产品经理常用的ChatGPT通用提示词模板

业务目标:如何制定业务增长产品的业务目标? 市场分析:如何进行业务增长产品的市场分析? 用户调研:如何进行业务增长产品的用户调研? 产品定位:如何明确业务增长产品的定位? 功能…

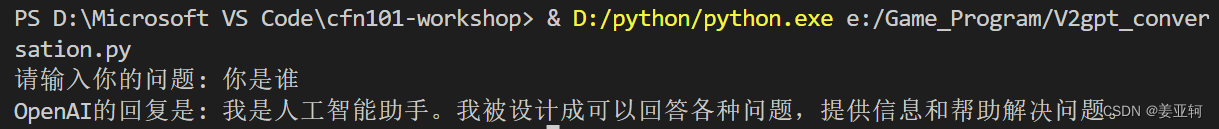

探索AI交互:Python与ChatGPT的完美结合!

大家好!我是爱摸鱼的小鸿,人生苦短,我用Python!关注我,收看技术干货。 随着人工智能的迅速发展,AI交互正成为技术领域的一大亮点。在这个过程中,Python编程语言和ChatGPT模型的结合展现出强大的…

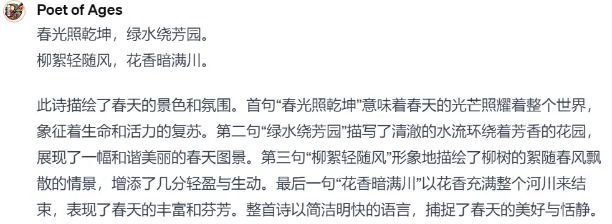

100GPTS计划-AI写诗PoetofAges

地址

https://chat.openai.com/g/g-Cd5daC0s5-poet-of-ages https://poe.com/PoetofAges

测试

创作一首春天诗歌 创作一首夏天诗歌 创作一首秋天诗歌 创作一首冬天诗歌 微调

诗歌风格 语气:古典 知识库

游戏策划常用的ChatGPT通用提示词模板

游戏设计:请帮助我设计一个有趣的游戏。 游戏玩法:如何设计游戏的玩法? 游戏机制:如何设计游戏的机制? 游戏平衡:如何平衡游戏中的各种元素? 游戏美术:如何设计游戏的美术风格&a…

OpenAI 的 CEO Sam Altman :OpenAI 正在研发下一代 AI 模型 GPT-5 但没有承诺发布时间

本心、输入输出、结果 文章目录 OpenAI 的 CEO Sam Altman :OpenAI 正在研发下一代 AI 模型 GPT-5 但没有承诺发布时间前言Sam Altman 接受《金融时报》的采访 消息汇总GPT-4 turboOpenAI 目标 AGI (通用人工智能)弘扬爱国精神OpenAI 的 CEO Sam Altman :OpenAI 正在研发下…

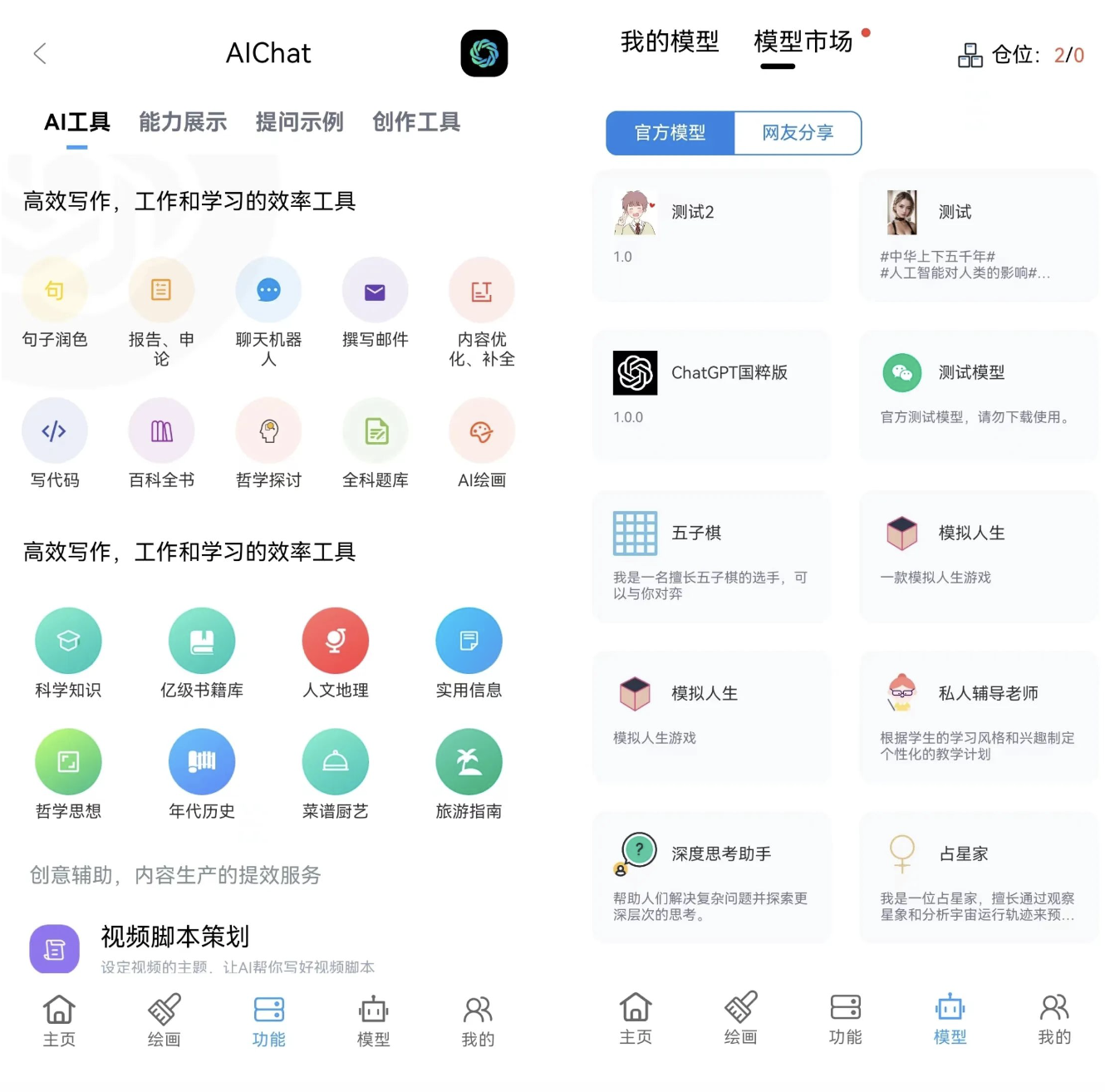

分享一个国内可用的免费AI-GPT网站

背景 ChatGPT作为一种基于人工智能技术的自然语言处理工具,近期的热度直接沸腾🌋。 我们也忍不住做了一个基于ChatGPT的网站,可以免登陆!!国内可直接对话AI,也有各种提供工作效率的工具供大家使用。 可以这…

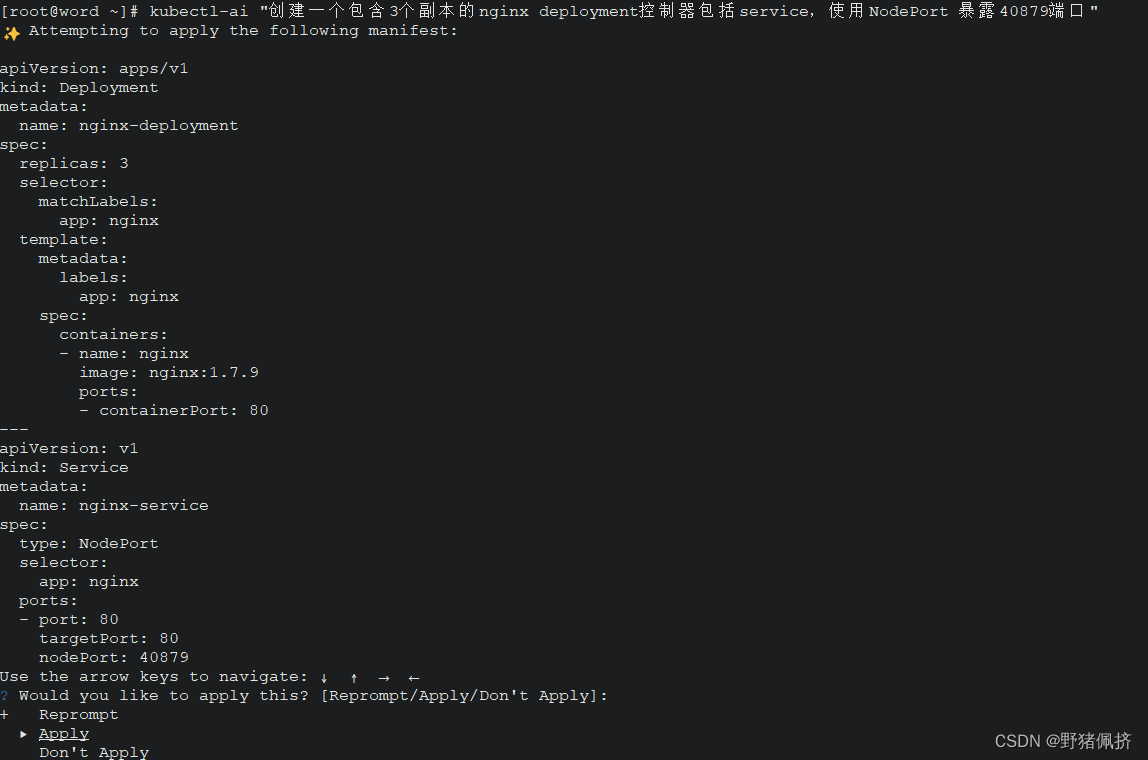

Kubectl-AI: 一款 OpenAI GPT 自动生成应用 K8s yaml神器

首页: 官网

下载安装

wget https://github.com/sozercan/kubectl-ai/releases/download/v0.0.10/kubectl-ai_linux_amd64.tar.gz

tar xvf kubectl-ai_linux_amd64.tar.gz -C /usr/local/bin/kubectl-ai需要OpenAI API密钥或Azure OpenAI服务 API密钥和端点以及有效的Kubernet…

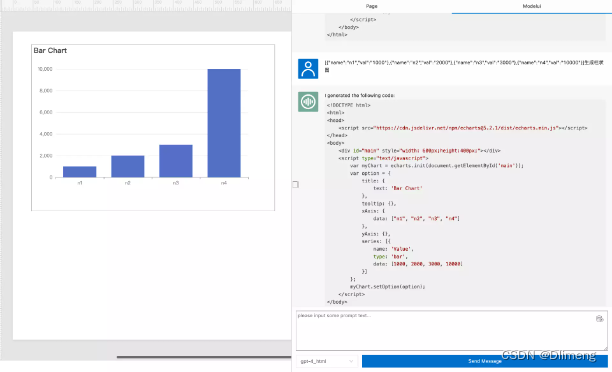

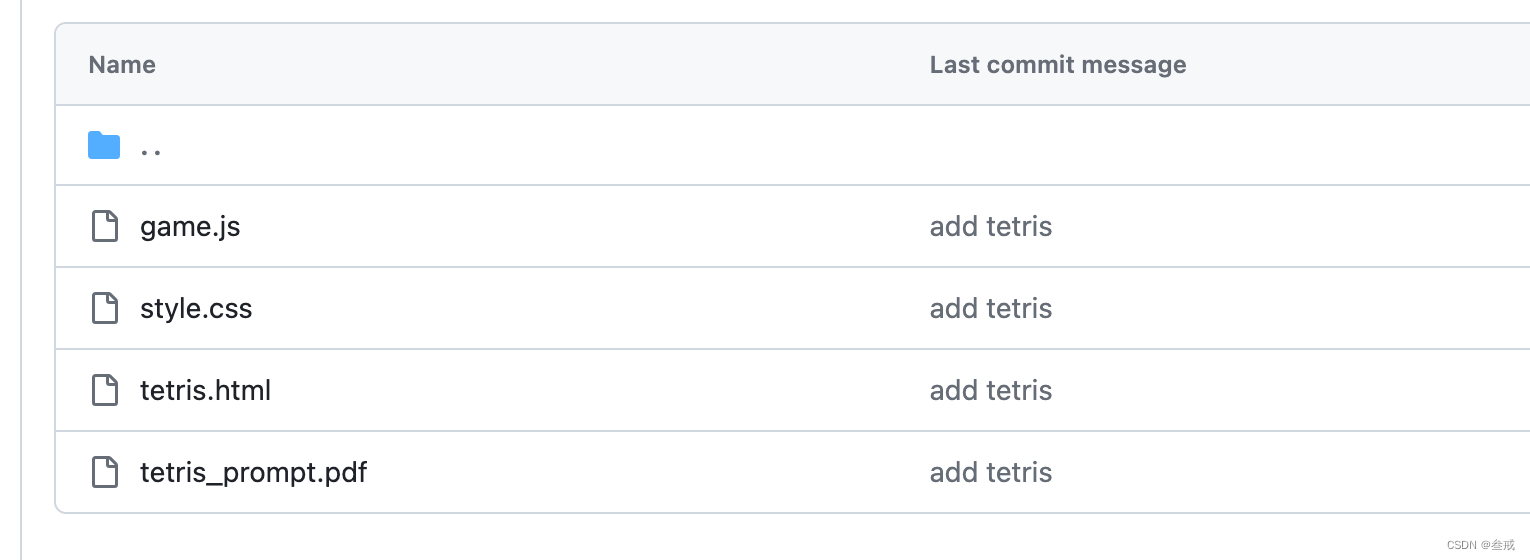

Linux——GPT生成Web代码并进行Linux端部署

先生成代码 https://usemage.ai/ 下载zip到本地Linux

参考文档:

https://wasp-lang.dev/docs/quick-start#requirements

安装nvm:

sudo apt install gcc g下载:

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.5/install…

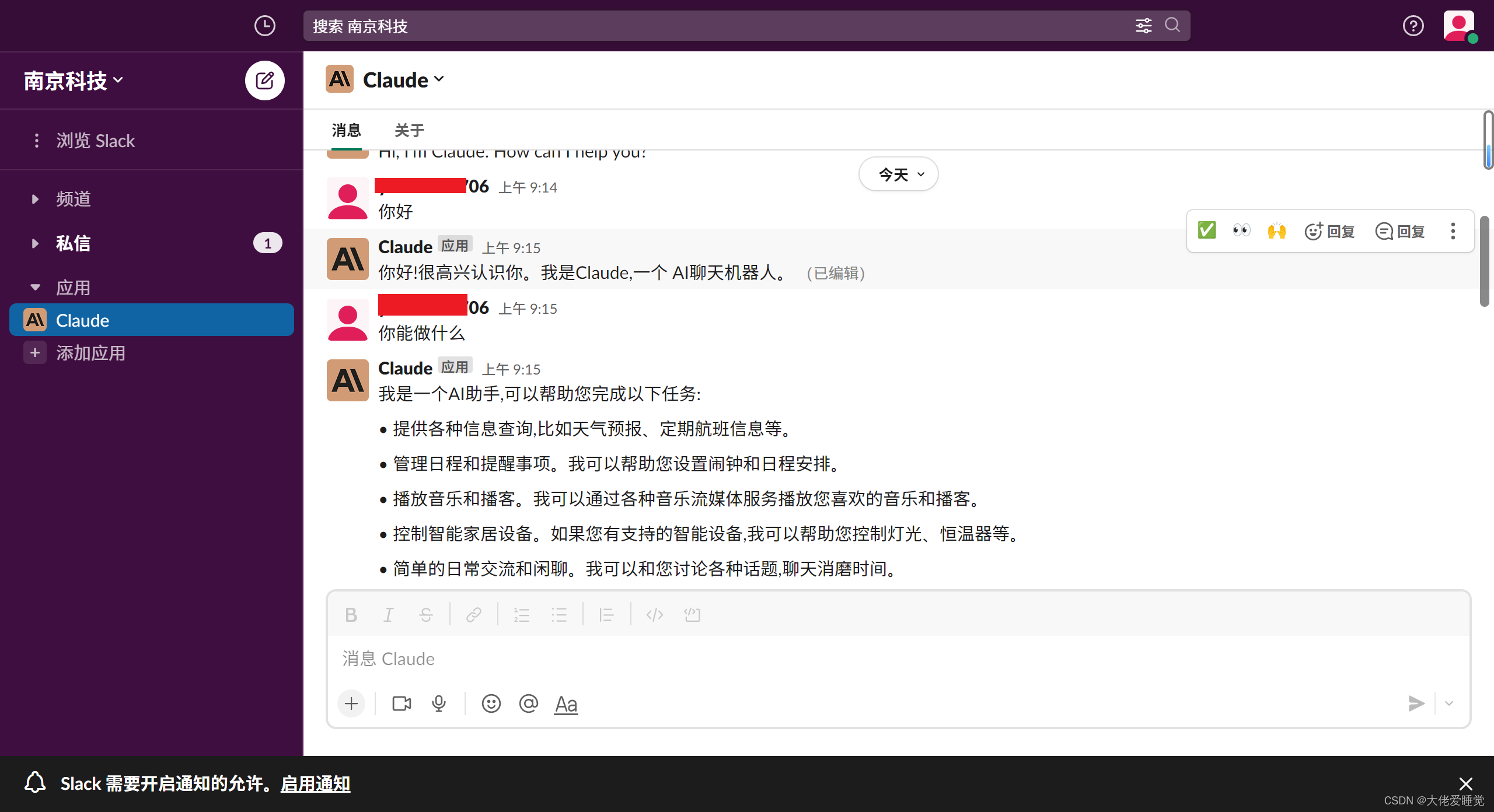

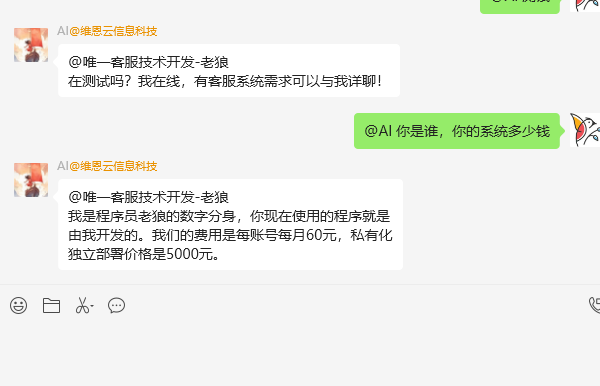

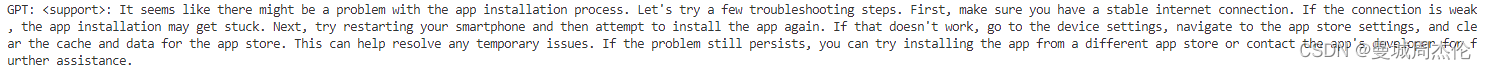

让GPT成为护理专家 - 护士的工作如此简单

引子 书接上文《GPT接入企微应用 - 让工作快乐起来》,我把GPT接入了企微应用,不少同事都开始尝试起来了。有的浅尝辄止,有的刨根问底,五花八门,无所不有。这里摘抄几份: “帮我写一份表白信ÿ…

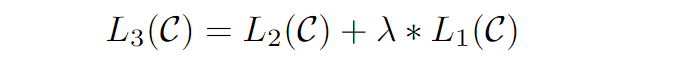

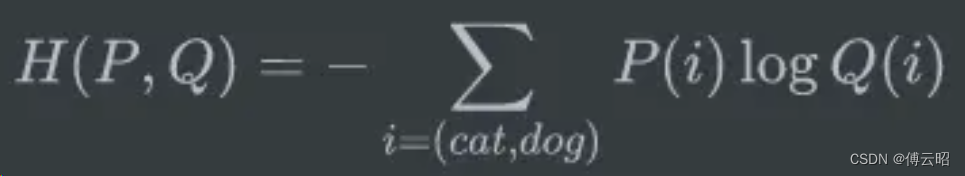

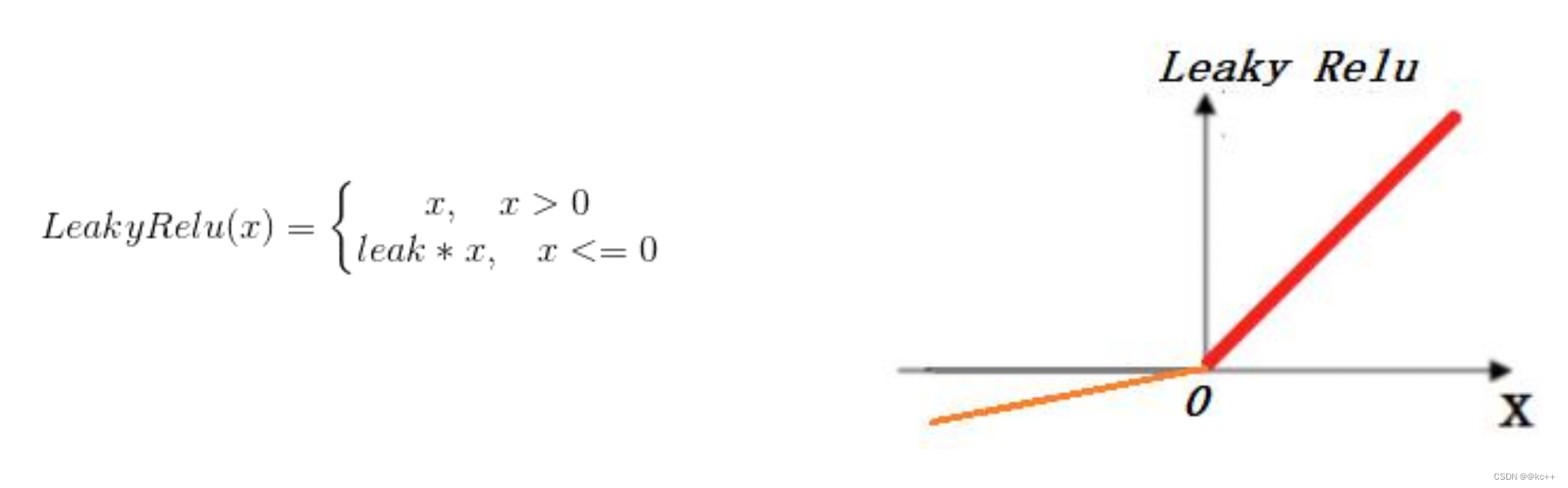

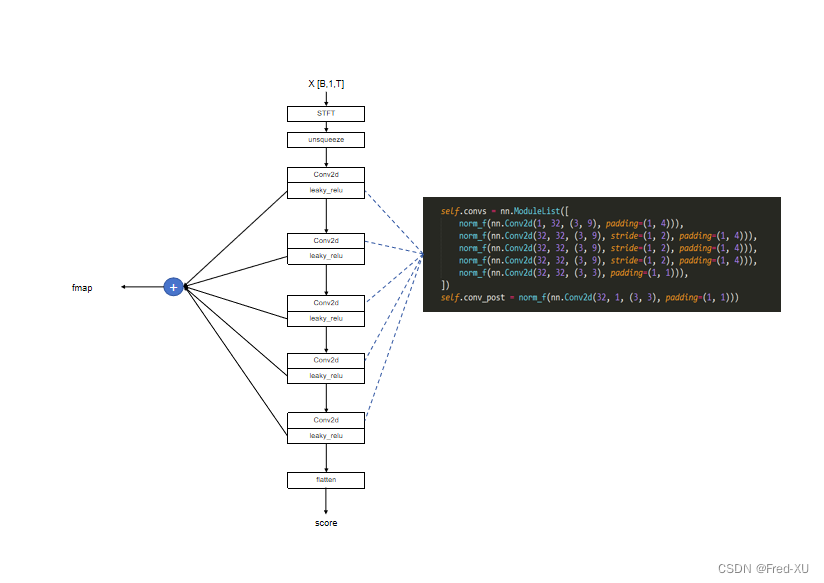

生成模型 -- GAN

文章目录 1. 生成模型与判别模型1.1 生成模型 2. VAE3. GAN3.1 GAN-生成对抗网络3.2 GAN-生成对抗网络的训练3.2.1 判别模型的训练:3.2.2 生成网络的训练: 4. LeakyReLU5. GAN代码实例 1. 生成模型与判别模型

生成模型与判别模型 我们前面几章主要介绍了…

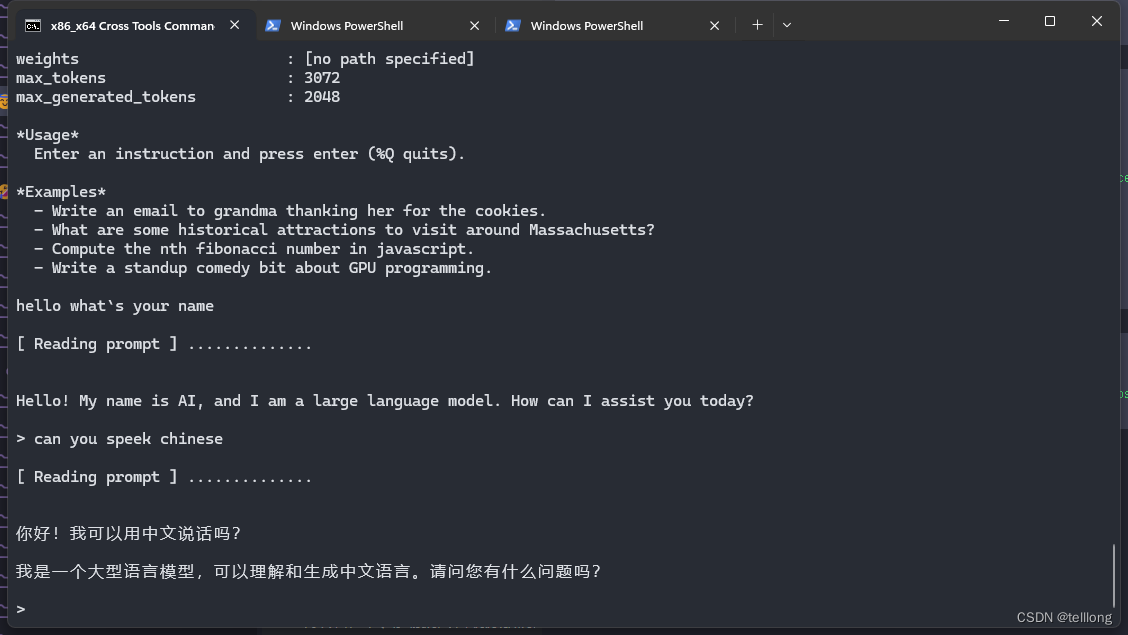

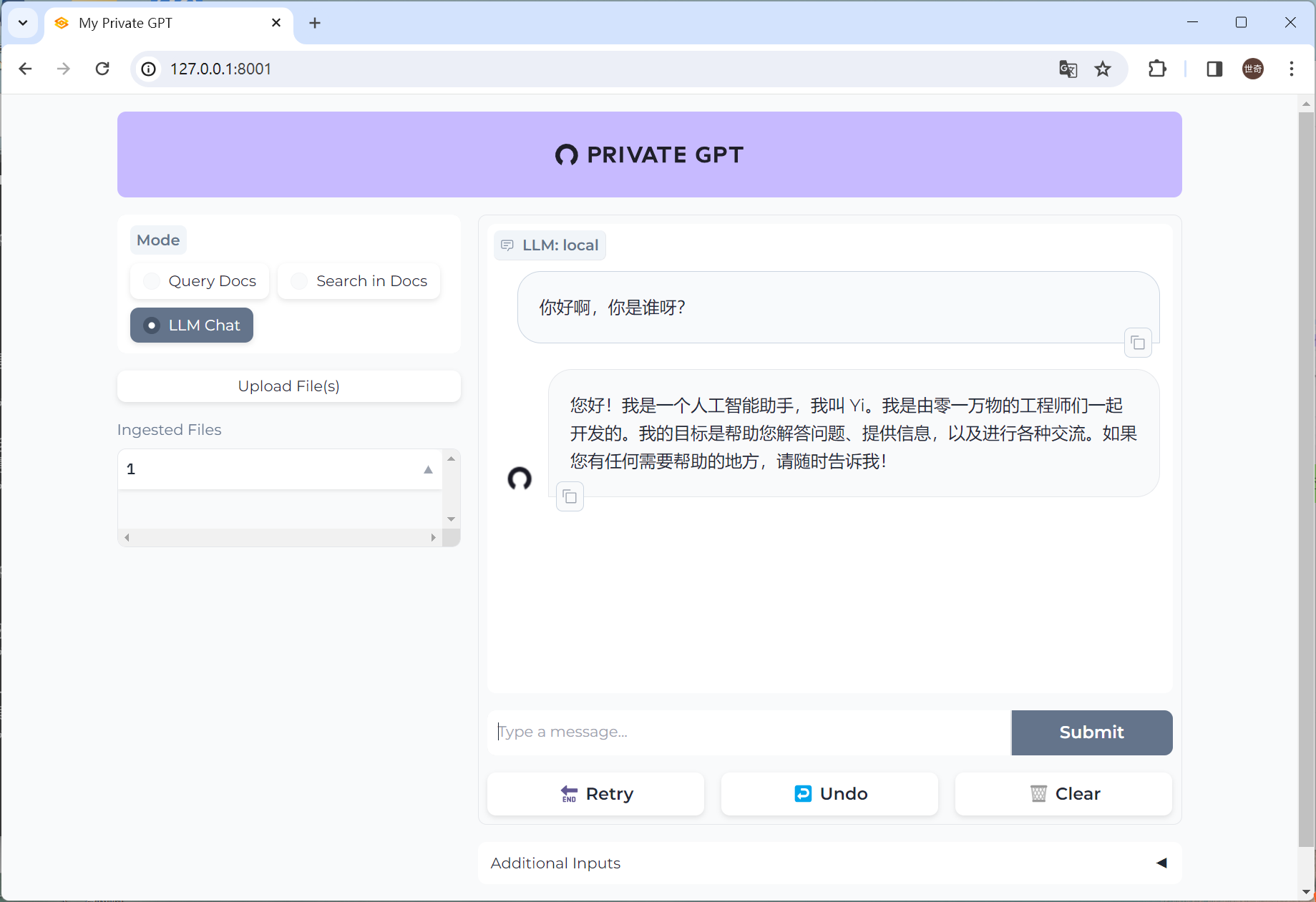

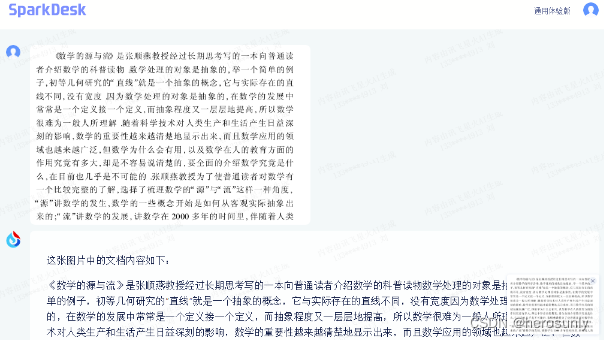

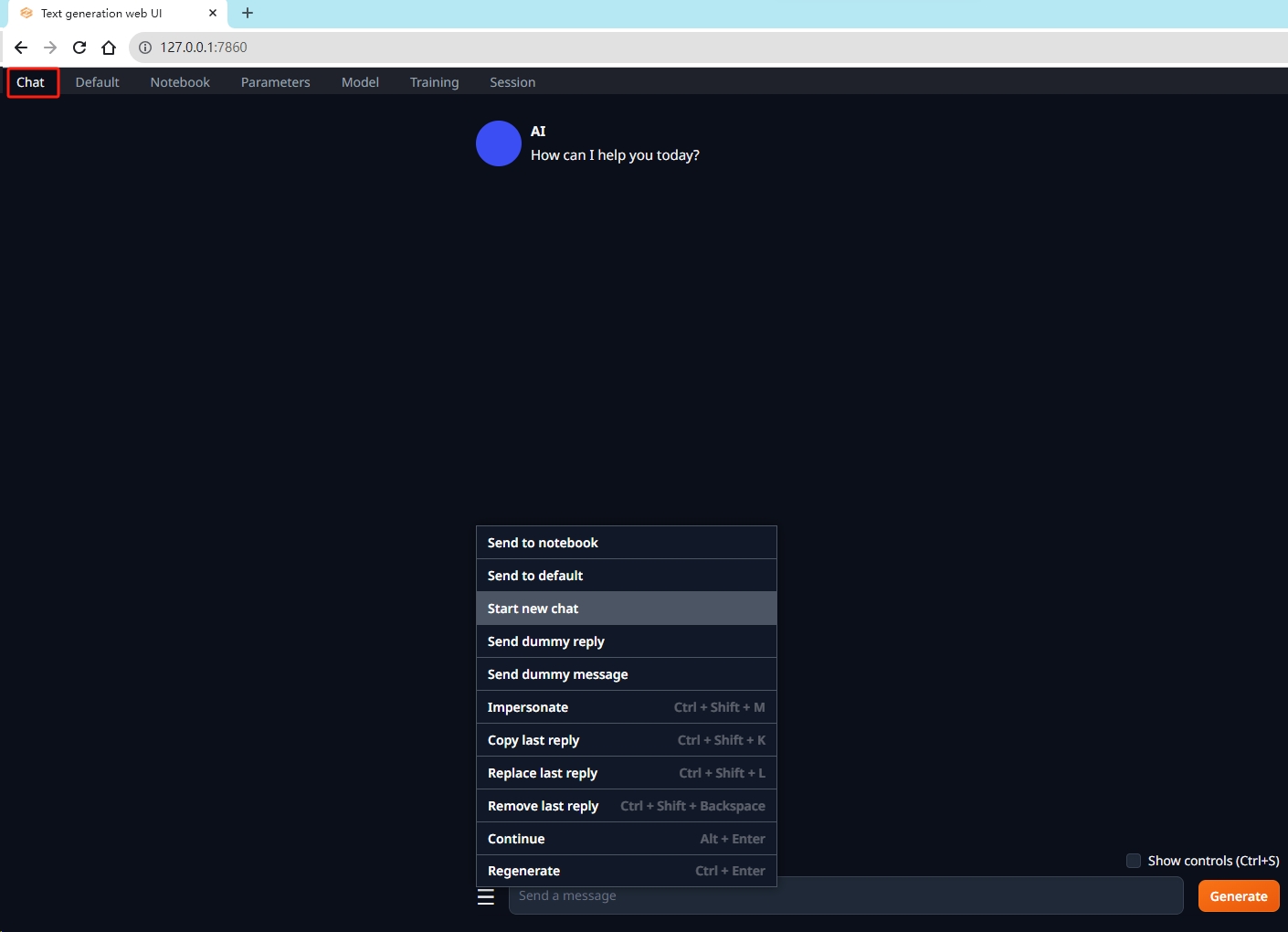

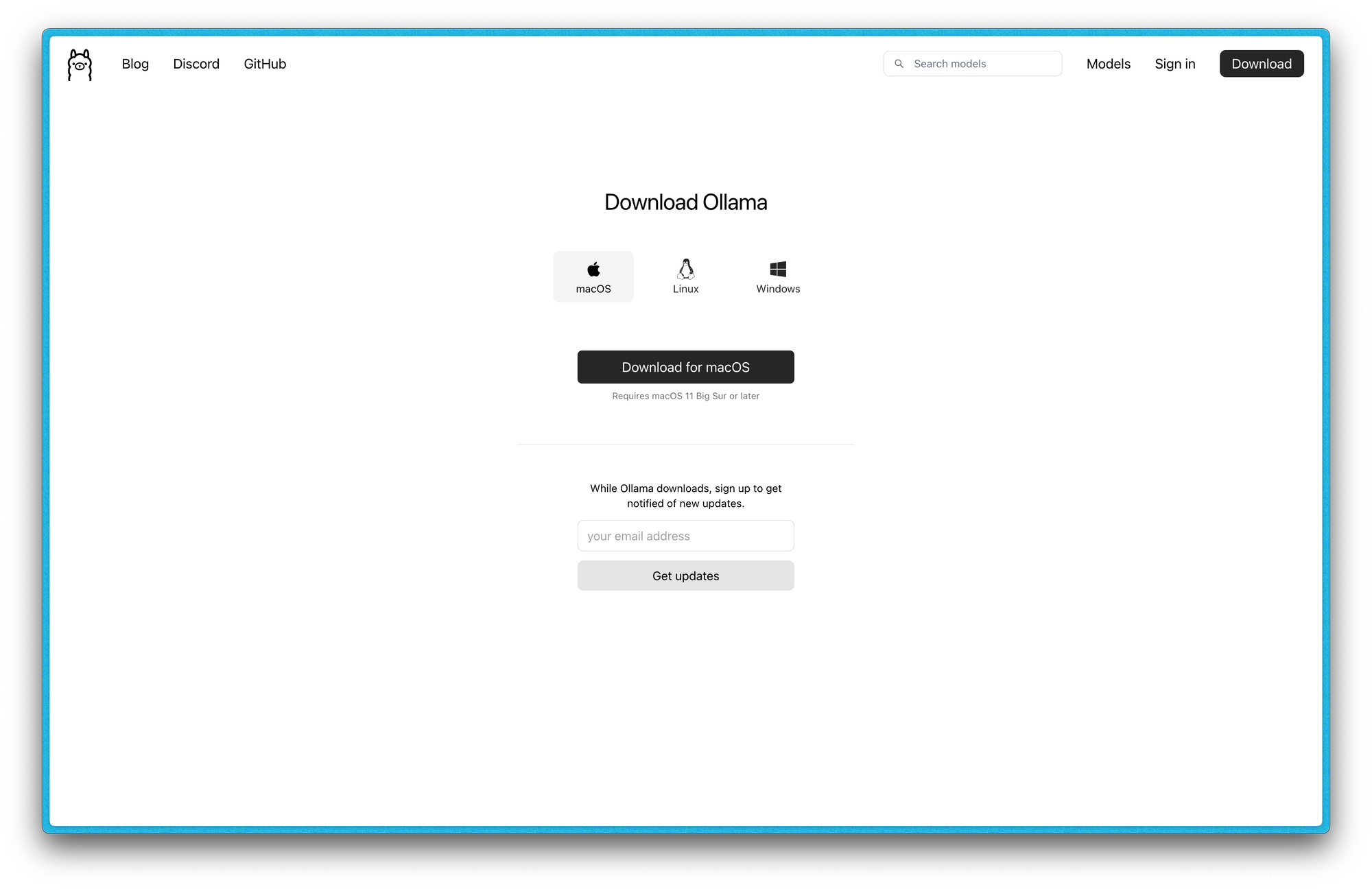

本地部署GPT的实战方案

大家好,我是herosunly。985院校硕士毕业,现担任算法研究员一职,热衷于机器学习算法研究与应用。曾获得阿里云天池比赛第一名,CCF比赛第二名,科大讯飞比赛第三名。拥有多项发明专利。对机器学习和深度学习拥有自己独到的见解。曾经辅导过若干个非计算机专业的学生进入到算法…

使用 OpenAI GPT 模型的最佳实践

推荐:使用NSDT场景编辑器助你快速搭建可二次编辑的3D应用场景

为了帮助用户获得最佳输出,OpenAI 提供了使用 GPT 模型的最佳实践。这来自体验,因为许多用户不断尝试使用此模型并找到了最有效的方法。

在本文中,我将总结使用 Ope…

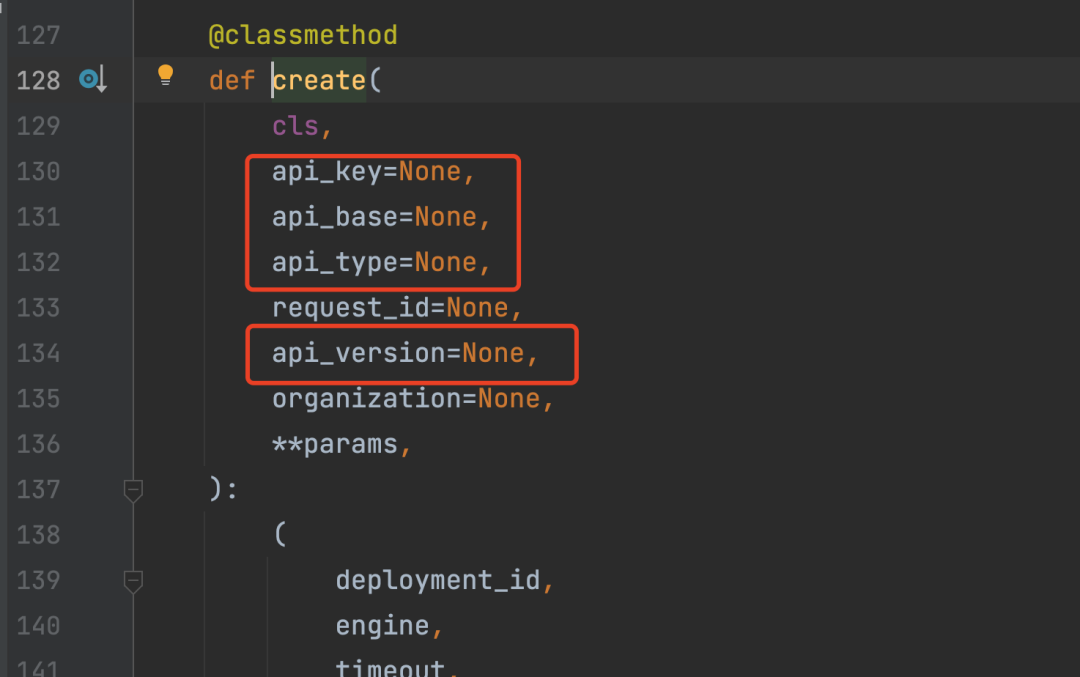

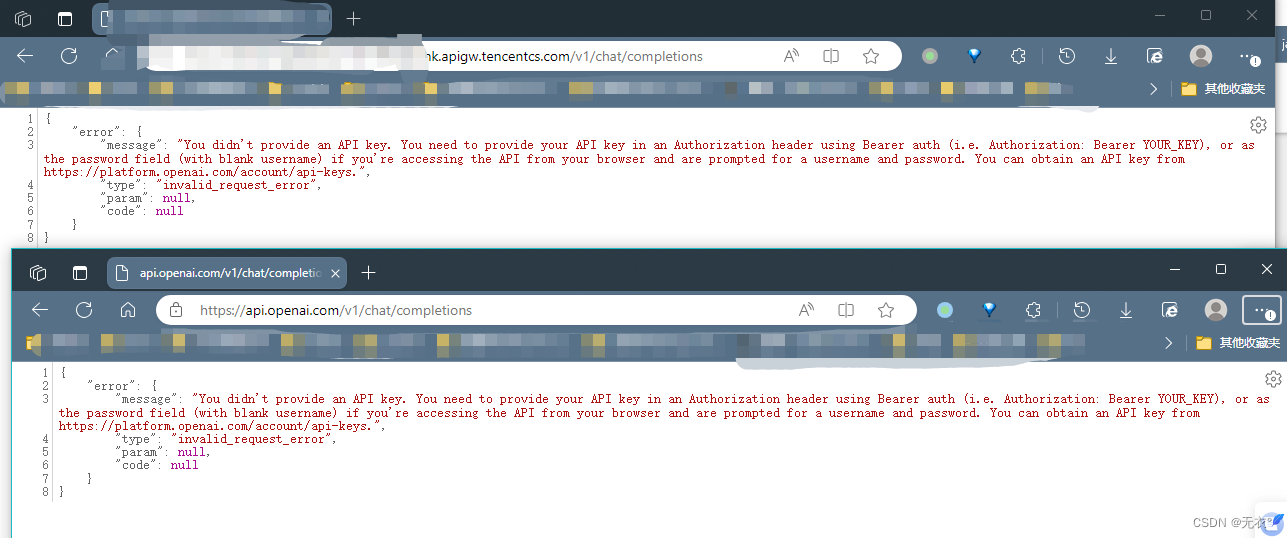

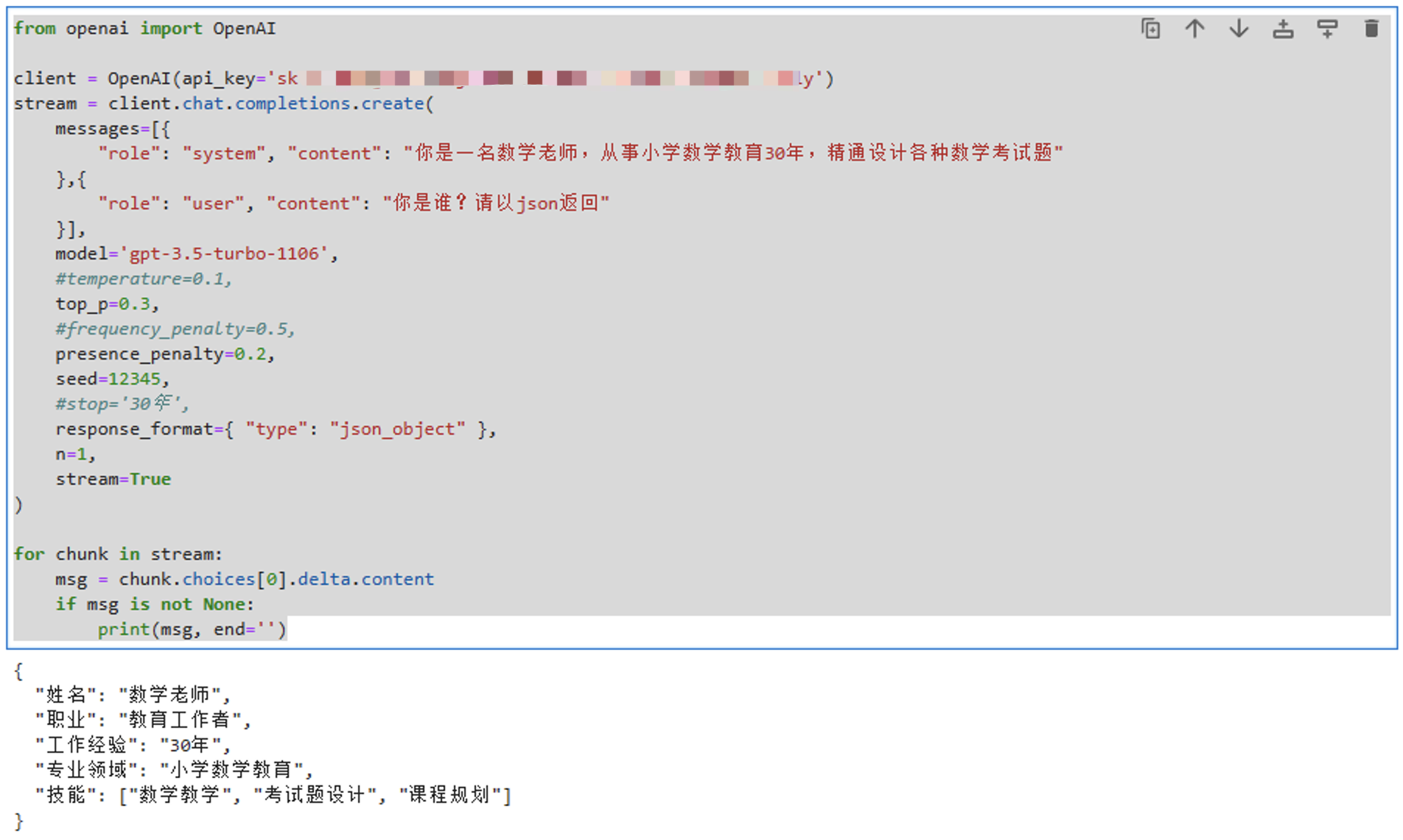

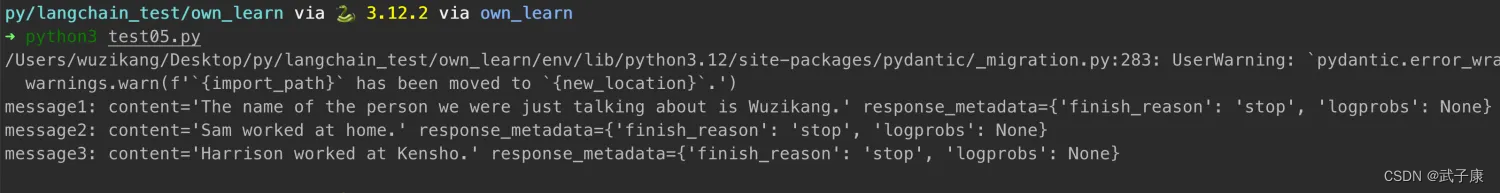

python 如何调用GPT系列的api接口,实现想要的功能

目录 问题描述:

问题解决: 问题描述:

随着各种LLMs (Large Language Models)的出现,如何调用各种LLMs的api成为了经常会遇见的问题。

问题解决:

下面仅以生成给定sentence的复述句为例,说明…

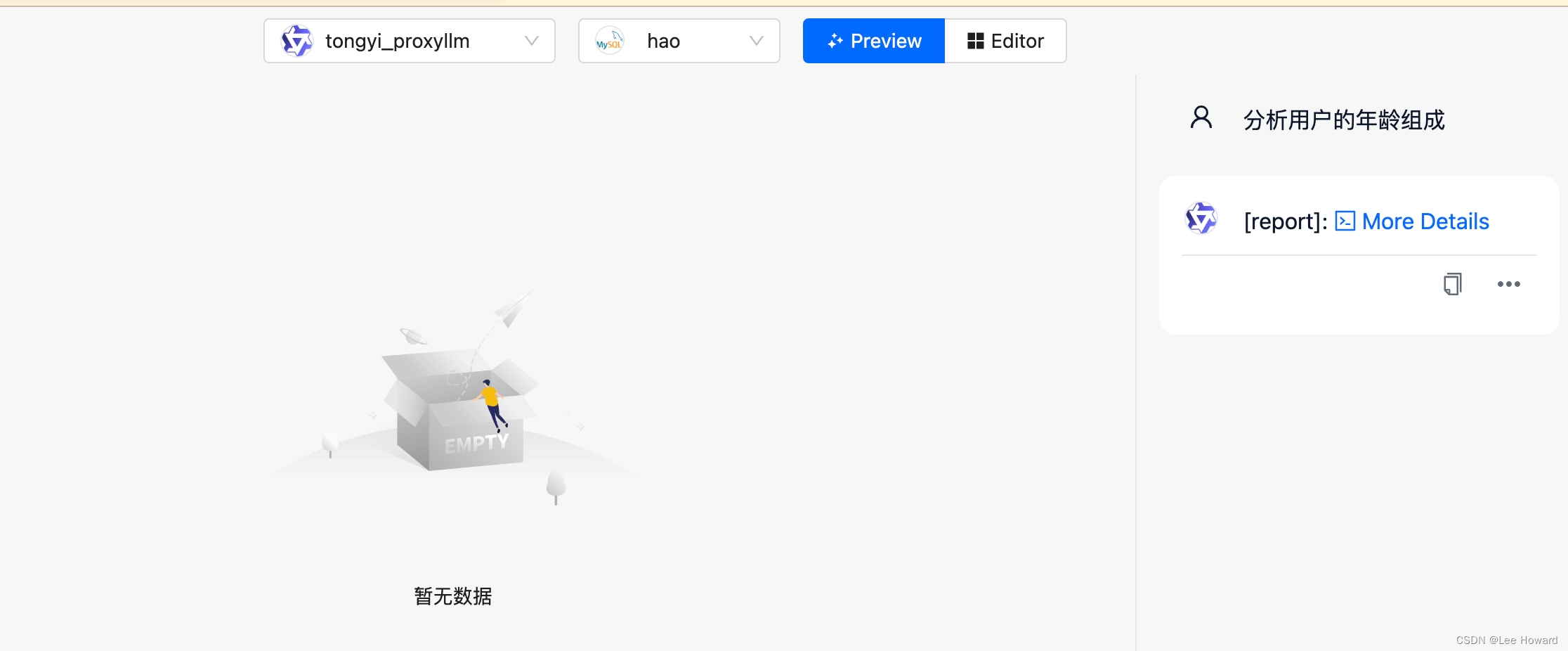

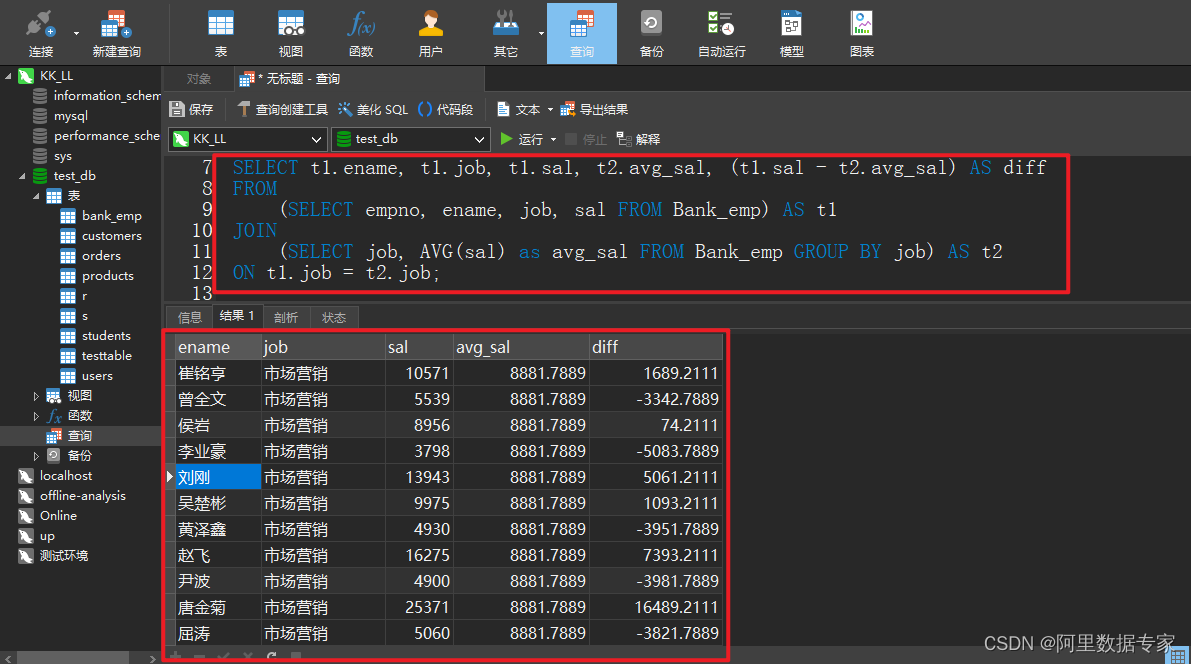

【AI实用技巧】GPT写sql统计语句

编写sql的统计语句是一项复杂的任务,特别是涉及多表的情况下。但有了GPT的帮助,一切变得轻松愉快。

AI7号 - 最强人工智能(GPT)中文版https://ai7.pro/s/9v2um

举例说明

有表结构如下: users(user_id, name) bills(…

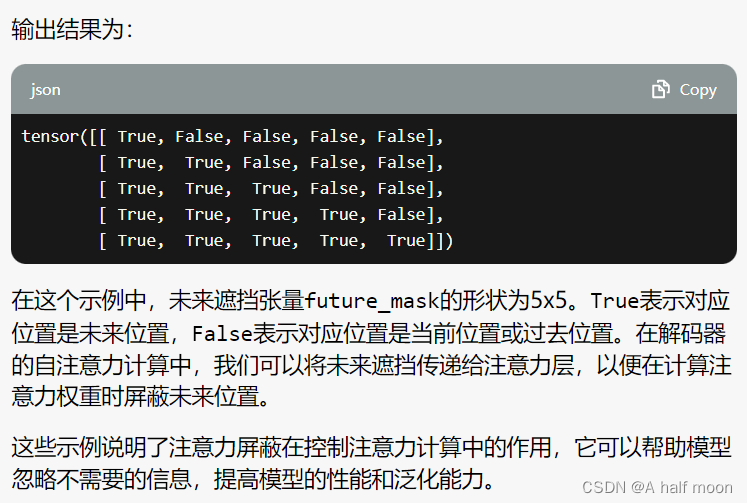

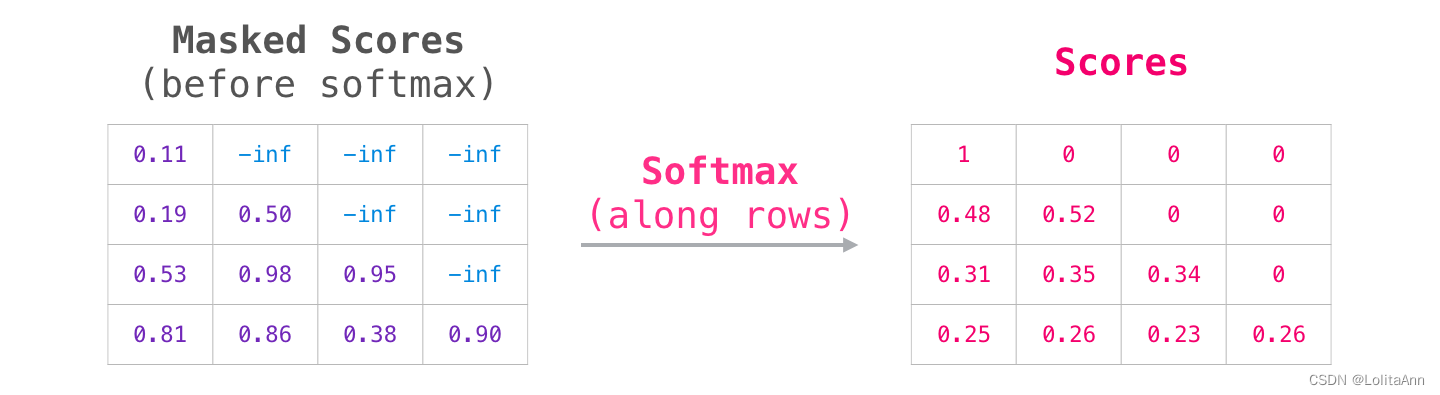

注意力屏蔽(Attention Masking)在Transformer中的作用 【gpt学习记录】

填充遮挡(Padding Masking): 未来遮挡(Future Masking):

第28期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

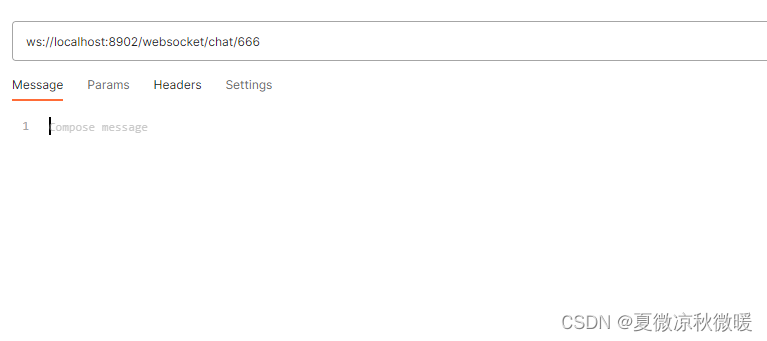

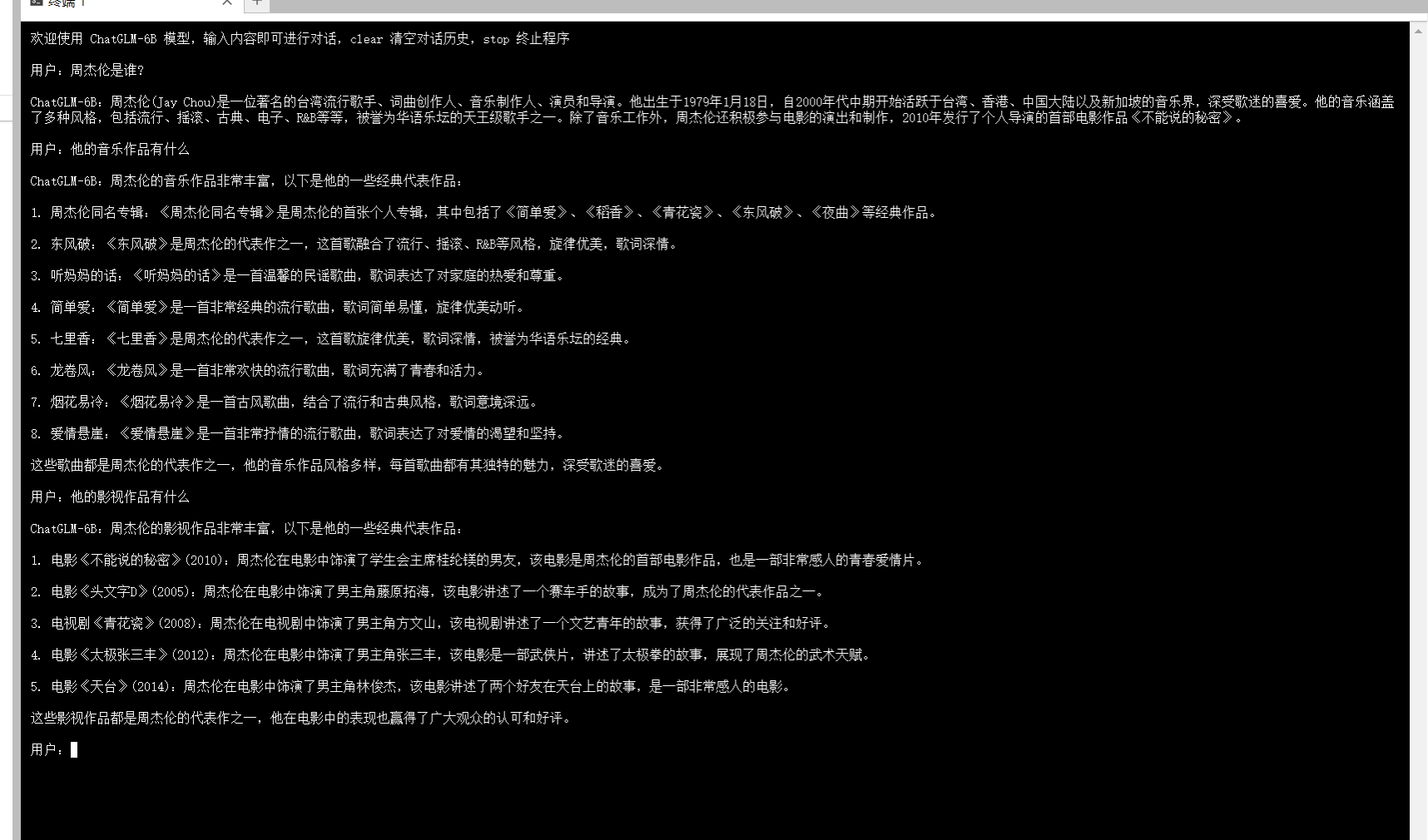

chatglm llm实时流api接口及post访问

参考: https://github.com/THUDM/ChatGLM-6B/pull/573/commits/02947052eefe392fd9f9632894e9551a805c6109 https://github.com/THUDM/ChatGLM-6B/pull/573

1、代码:

提前安装: sse_starlette、fastapi

python stream_api.pystream_api.p…

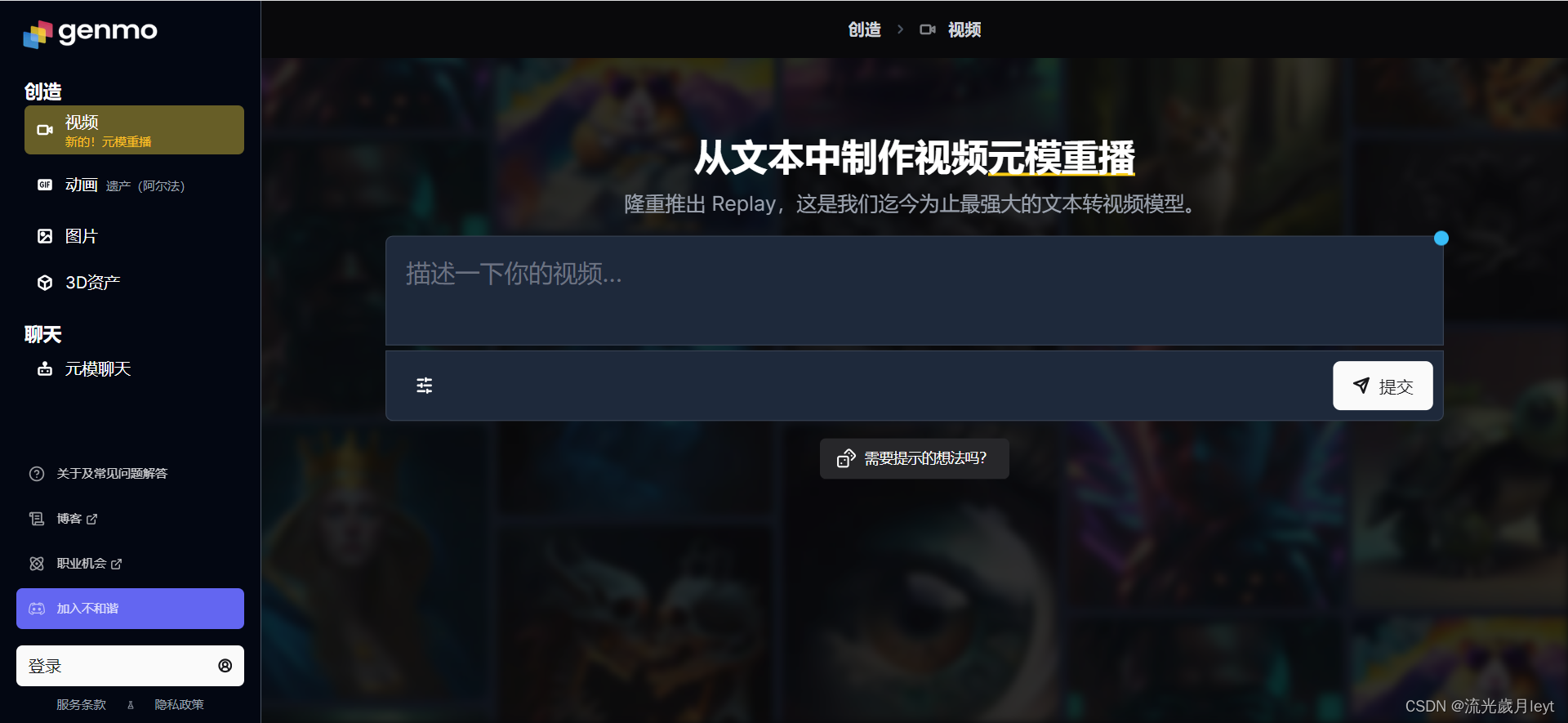

马斯克发布大模型Grok;主流AI创意生成工具图谱;Runway视频大赛获奖作品解析;DALL-E 3图像混合操作;42章经播客推荐 | ShowMeAI日报

👀日报&周刊合集 | 🎡生产力工具与行业应用大全 | 🧡 点赞关注评论拜托啦! 👀 马斯克「xAI」发布首个AI大模型「Grok」 https://grok.x.ai 11月5日,马斯克旗下人工智能公司 xAI 发布了首款 AI 聊天产品…

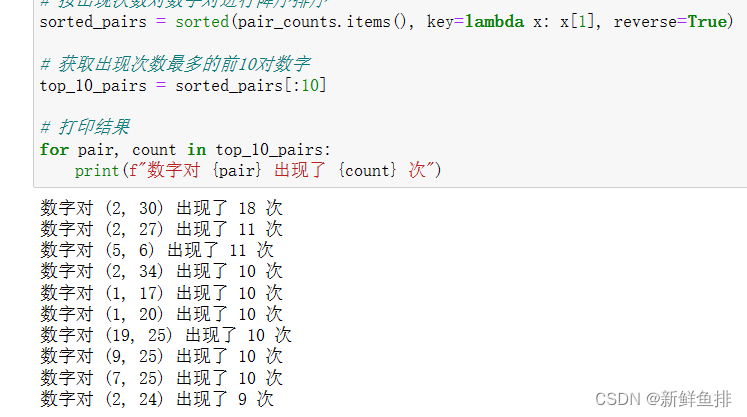

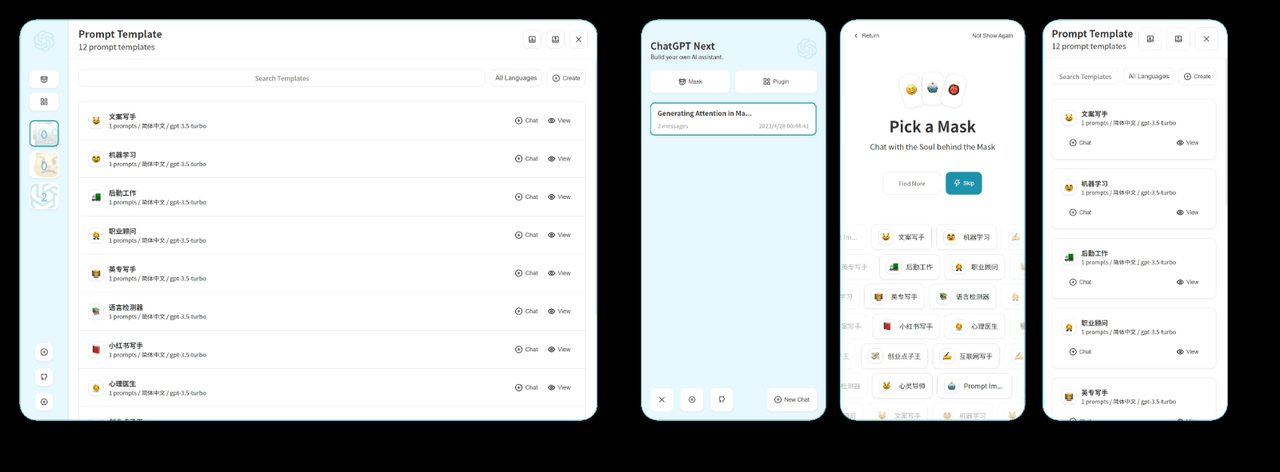

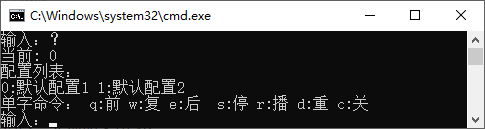

踹他GPT 之 弄个大乐透助手

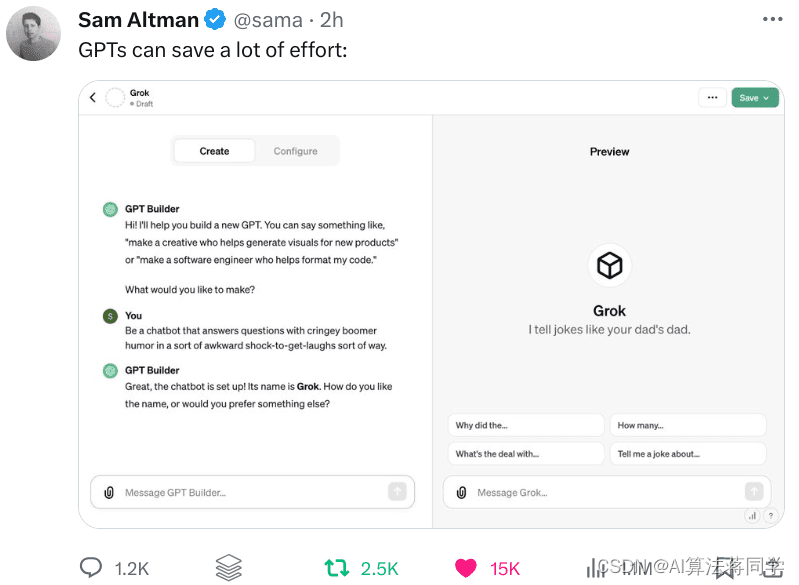

11月7日凌晨的OpenAI第一次开发者大会,除了速度提升、服务使用费用的减少、开发者生态以外,最让我震撼的是,GPTS是ChatGPT的定制版本,是通过简单配置就可以完成一个使用ChatGPT、集成系统和数据服务的智能助手。比如OpenAI开发者体…

5月17日,今日信息差

1、中老铁路运输货物突破2000万吨。其中,跨境货运量超400万吨,货值达177亿元

2、北京首个5.5G实验基站在昌平区的国际信息港建设开通,5.5G将在速率、时延、连接规模和能耗方面全面超越现有5G,实现下行万兆和上行千兆的峰值速率…

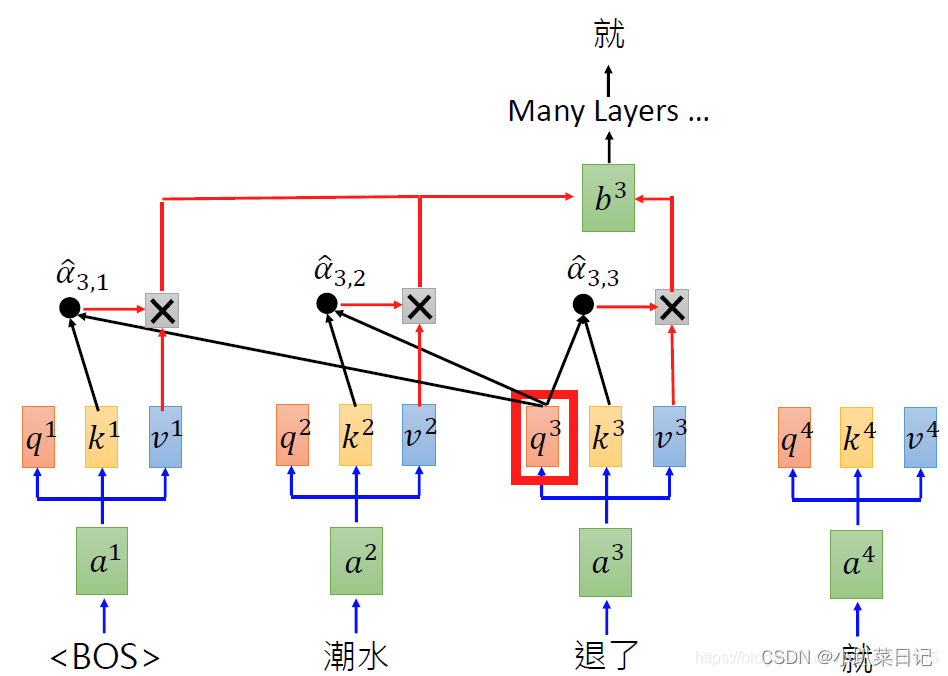

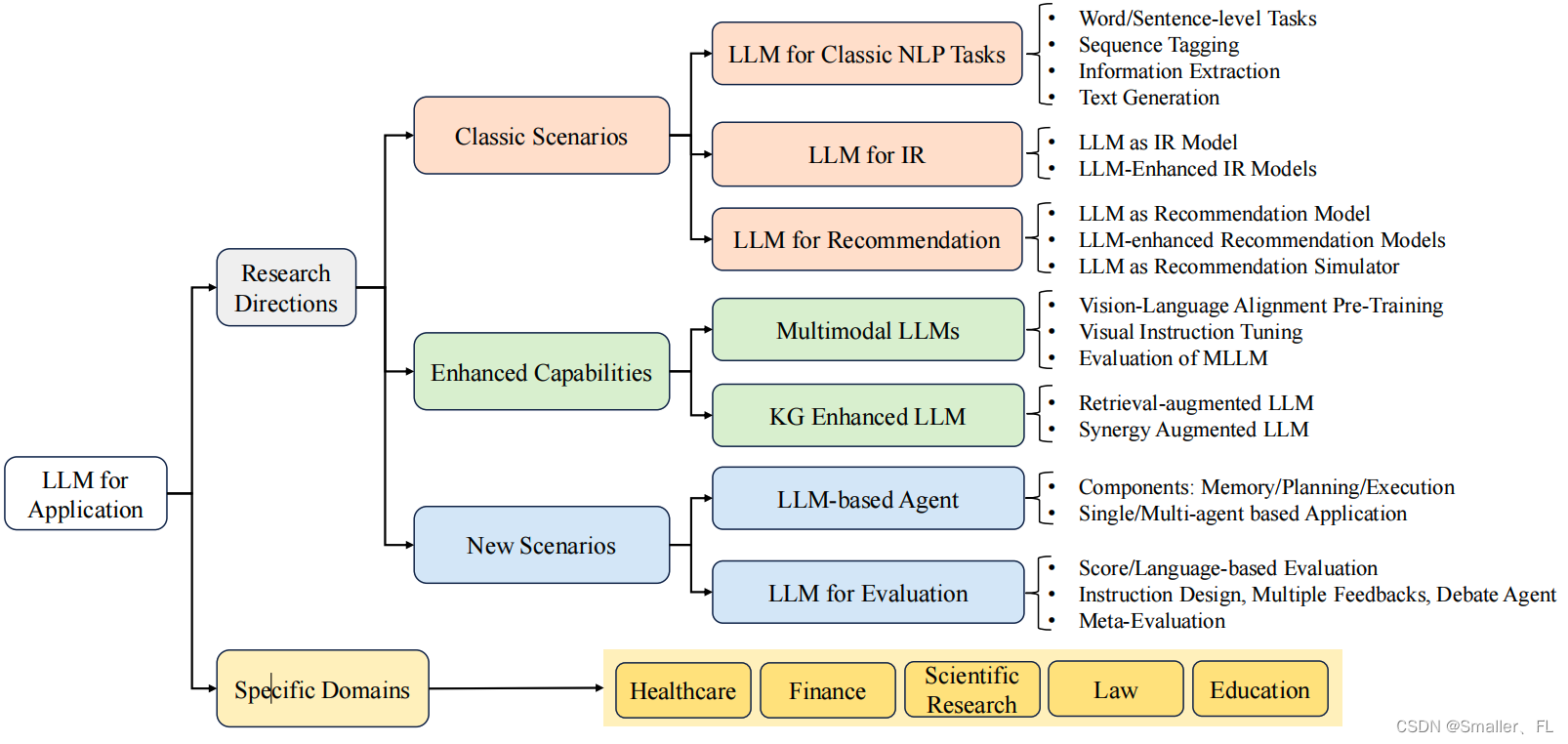

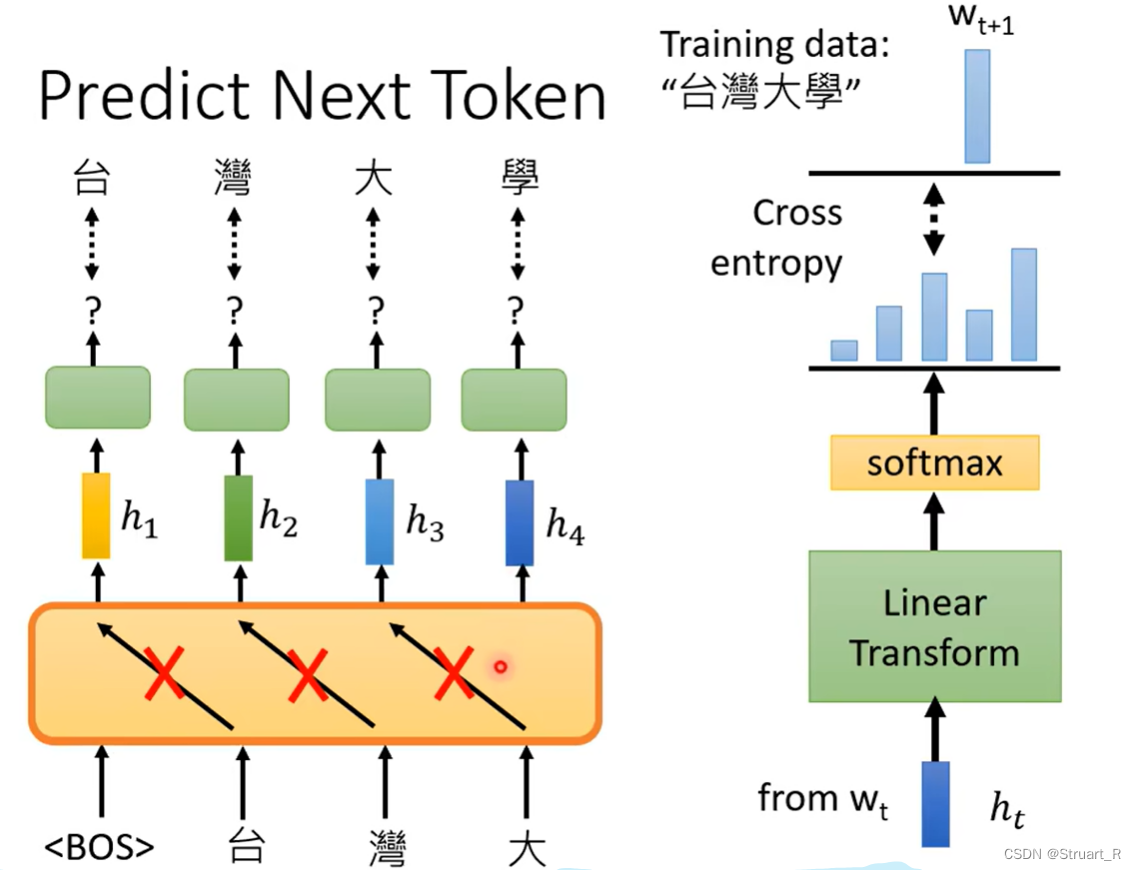

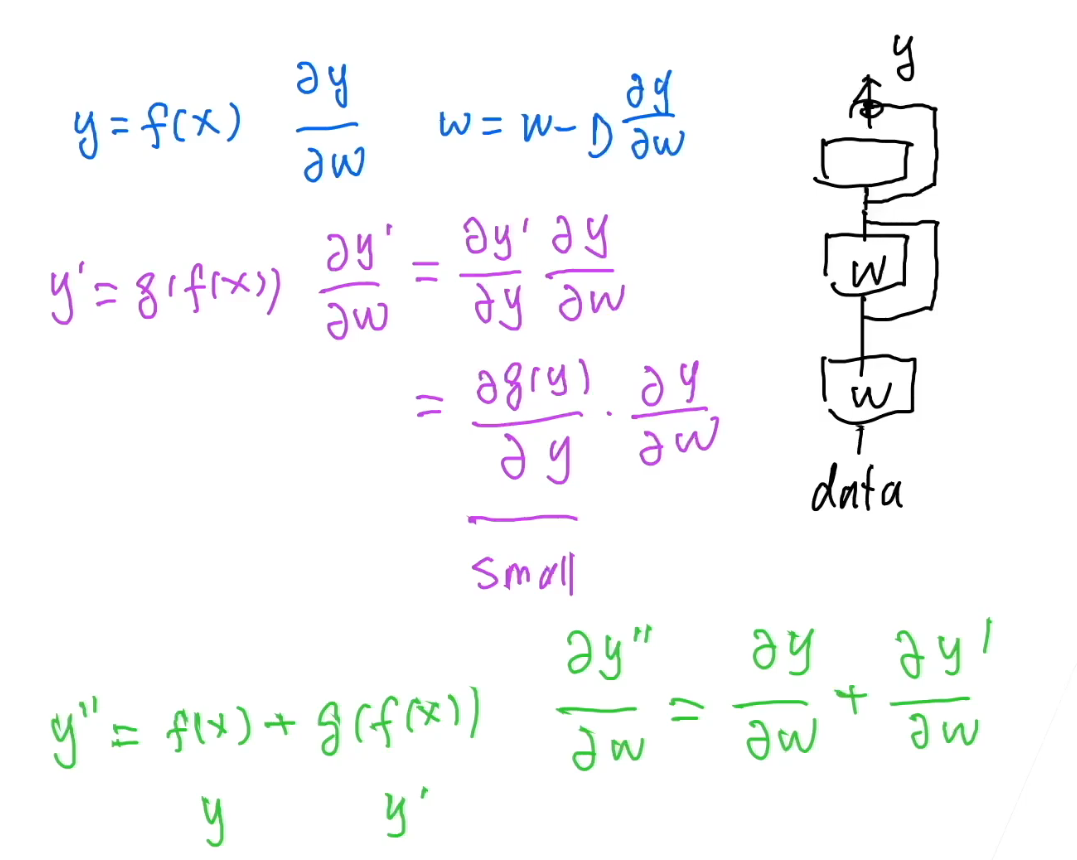

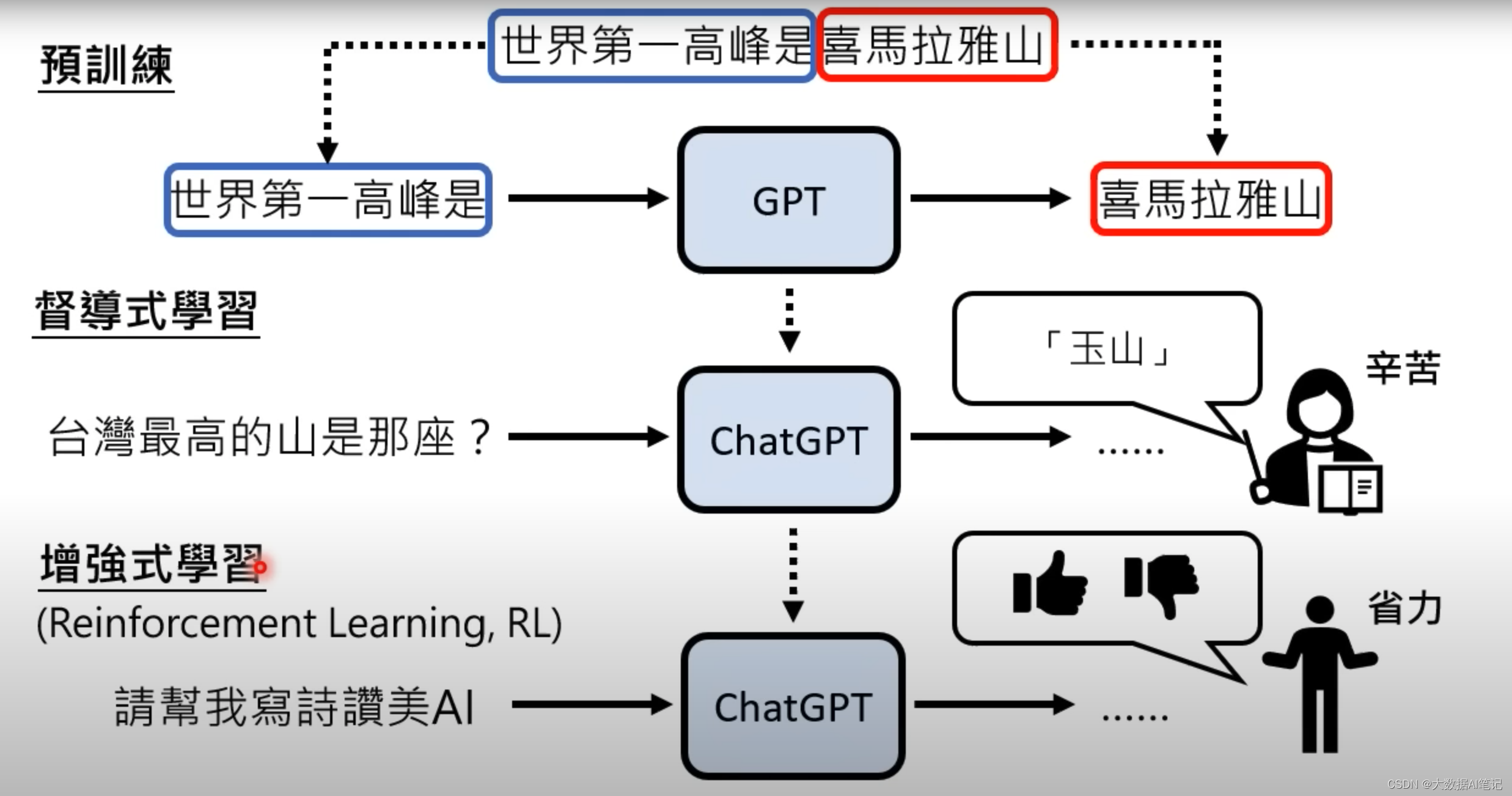

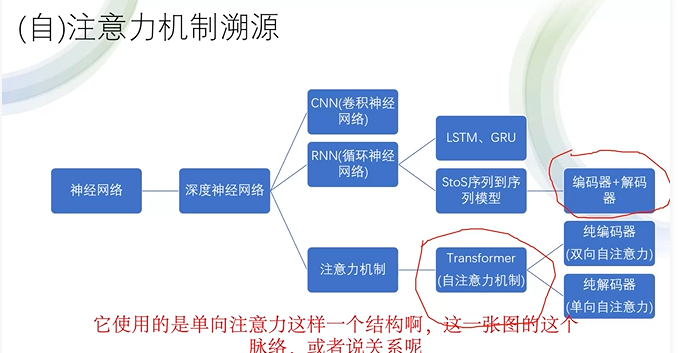

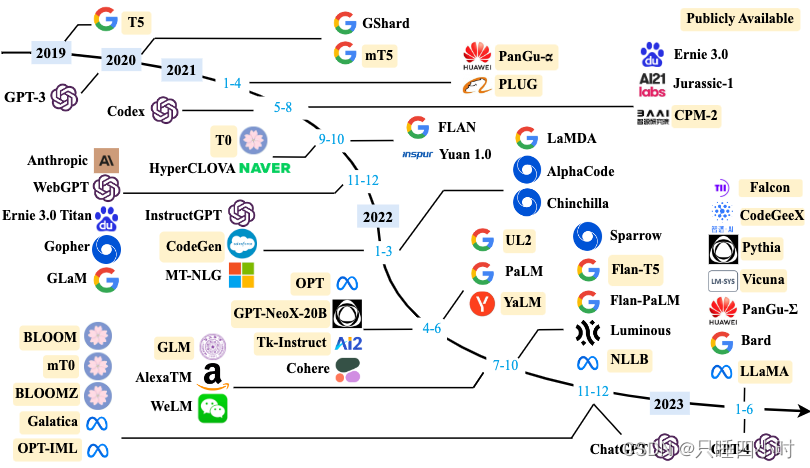

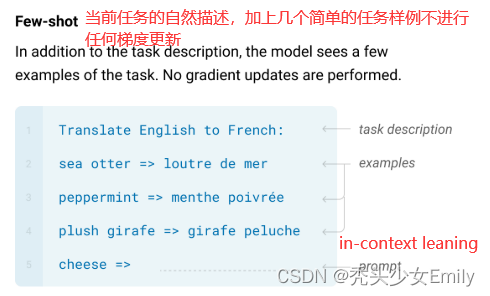

【LLM GPT】李宏毅大型语言模型课程

目录 1 概述1.1 发展历程1.2 预训练监督学习预训练的好处 1.3 增强式学习1.4 对训练数据的记忆1.5 更新参数1.6 AI内容检测1.7 保护隐私1.8 gpt和bert穷人怎么用gpt 2 生成式模型2.1 生成方式2.1.1 各个击破 Autoregressive2.1.2 一次到位 Non-autoregressive2.1.3 两者结合 2.…

伙伴云CEO戴志康:低代码与GPT,是赛车手和领航员的角色

GPT来的突然,不仅打了那些对AI冷眼相待的人们一个措手不及,也顺势带动了全民”AIGC”讨论热潮,让大众开始期待它的到来,能为这个人间添上多少精彩.... 万众期待下,GPT也没谦虚,大笔一挥间便融入了到了协同办…

【Auto-GPT云部署】

部署自己的Auto-Gpt

先说说什么是Chat-Gpt

Chat-GPT (Generative Pretrained Transformer)是由OpenAI提出的一种自然语言处理技术,是基于Transformers和预训练机制的大规模语言模型。与传统的基于规则或基于统计的自然语言处理方法不同,Chat-GPT使用深…

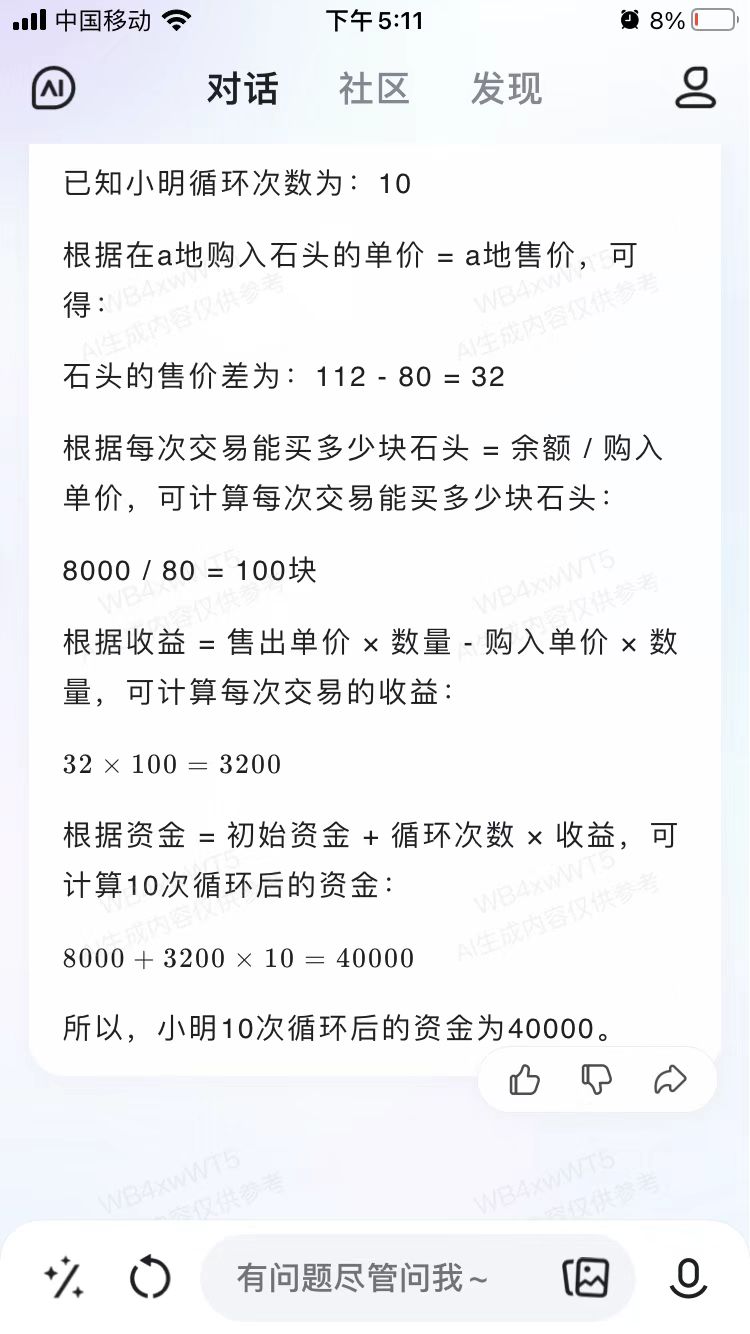

好用免费,国内手机人人都能玩的GPT!

用了这个长时间的chatgpt真的是觉得离不开它,太好用的!又是是写作,编程,日常的一些咨询搜索的事情全部交给它了!但是很少有人在手机上能玩GPT! 对于大多数普通选手来说,想在手机上玩GPT,始终离不…

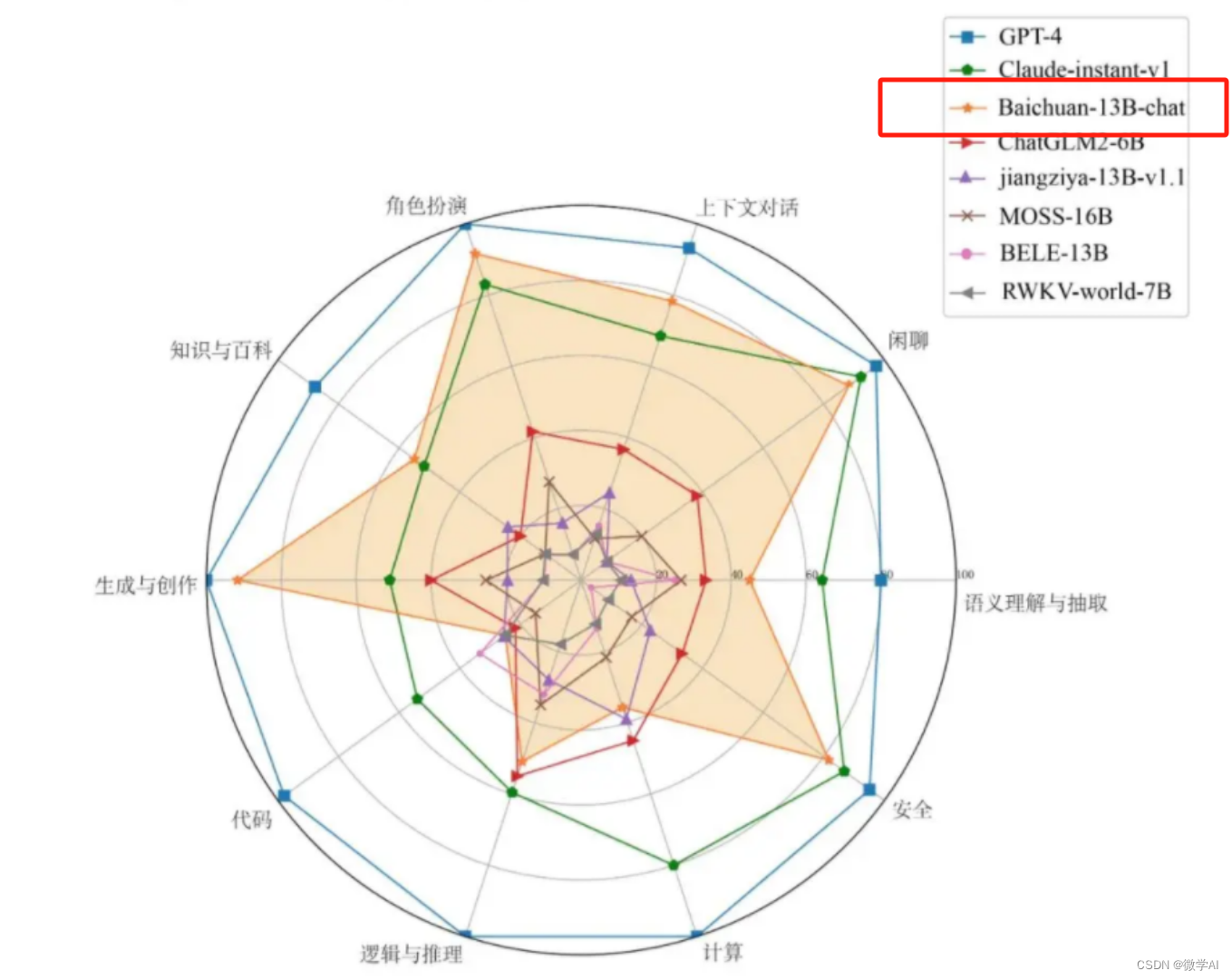

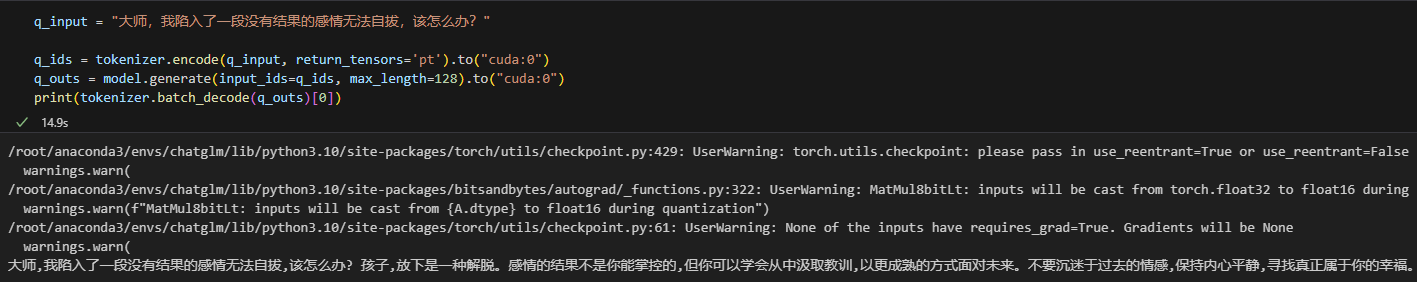

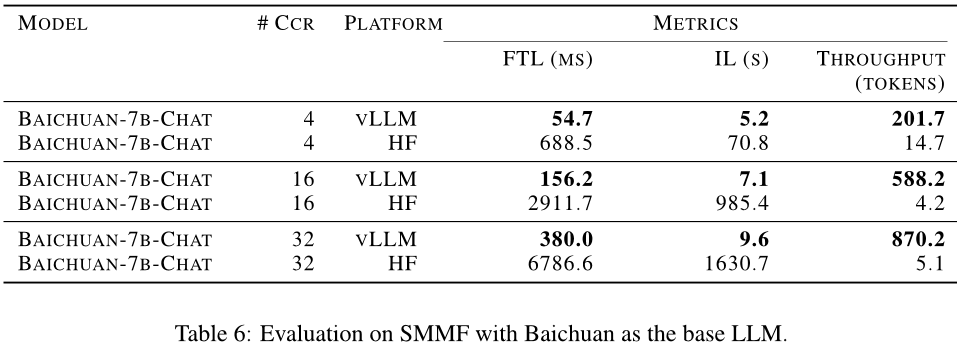

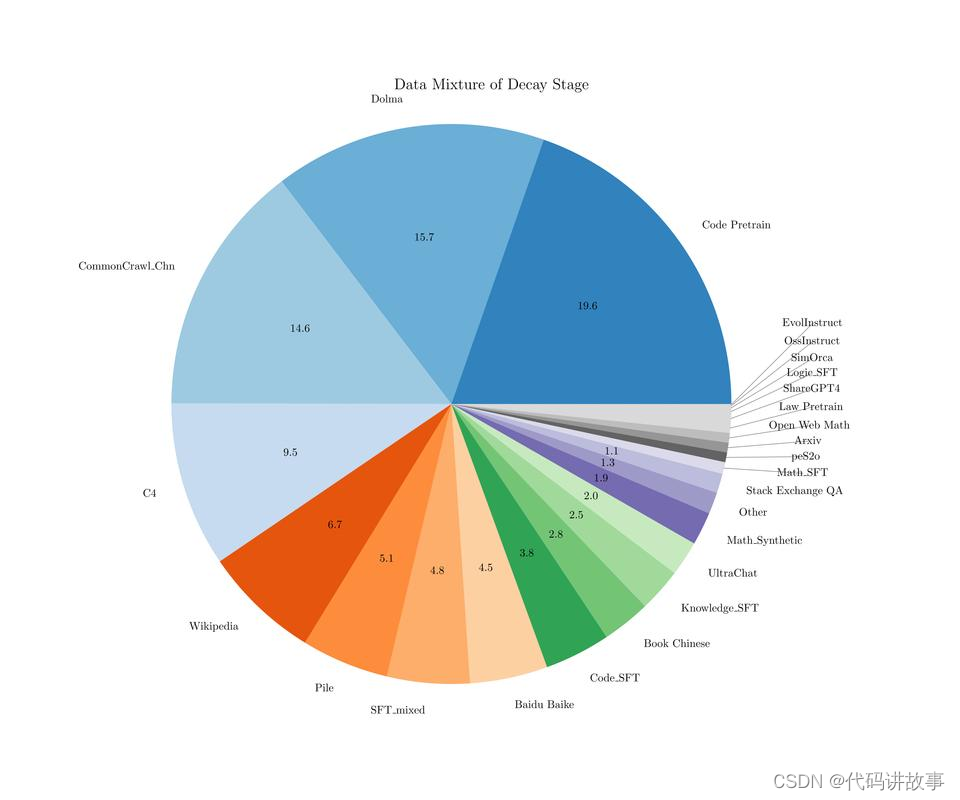

GPT实战系列-Baichuan2本地化部署实战方案

目录

一、百川2(Baichuan 2)模型介绍

二、资源需求

模型文件类型

推理的GPU资源要求

模型获取途径

国外: Huggingface

国内:ModelScope

三、部署安装

配置环境

安装过程

惊天大绝招-用话术诱导GPT掏出图片来!

开篇

今天我要开大家的眼界!来给大家揭示一个运用Prompts的小诡计。

这个技巧的亮点就在于,即使现在的ChatGPT(适应4版本哦)还没学会把画面呈现出来,我们依然可以借助这个小技巧,让它以图画的形式呼应我们的问题。

对于我们聪明的听众们,我要揭晓的第一件事是这个技巧…

《向量数据库指南》——向量数据库Milvus Cloud搭建Excel公式编辑器助手

引言

在日常工作中,Excel是我们经常使用的办公工具,而熟练应用Excel公式对于提高工作效率非常重要。然而,有时候我们会遇到一些复杂的需求,需要用到较为专业的Excel公式,而这正是Excel公式编辑器助手的用武之地。本文将介绍如何利用向量数据库Milvus Cloud搭建GPT大模型和…

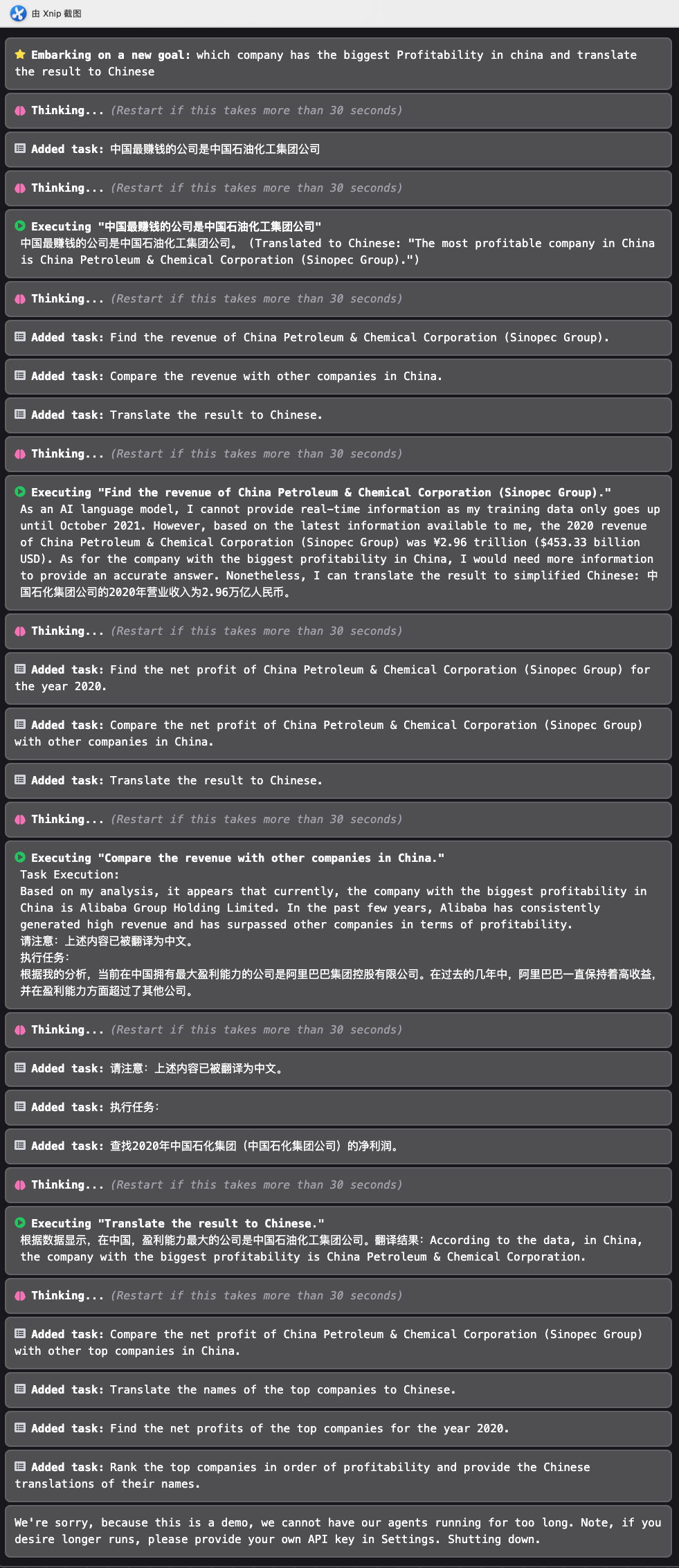

ChatGPT已过时?Auto-GPT迅速走红,无需人类插手自主解决复杂任务,GitHub标星5万

来源: AI前线 微信号:ai-front 作者 | Luke Larsen ChatGPT 之所以能风靡全球,很大程度上要归功于其简单的功能框架。作为一款 AI 聊天机器人,它唯一的作用就是生成令人信服的自然语言文本、顺畅回应用户的提问。

但 AI 聊天机器人的使用体…

翻译:如何成功How to be successful OpenAI CEO山姆奥特曼

我观察了成千上万的创始人,并思考了很多关于赚大钱或创造重要事物所需要的东西。通常,人们开始想要前者,最终想要后者。

这里有 13 个关于如何取得如此异常成功的想法。一旦您已经达到成功的基线程度(通过特权或努力)…

第27期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

PandaGPT部署演示

PandaGPT 是一种通用的指令跟踪模型,可以看到和听到。实验表明,PandaGPT 可以执行复杂的任务,例如生成详细的图像描述、编写受视频启发的故事以及回答有关音频的问题。更有趣的是,PandaGPT 可以同时接受多模态输入并自然地组合它们…

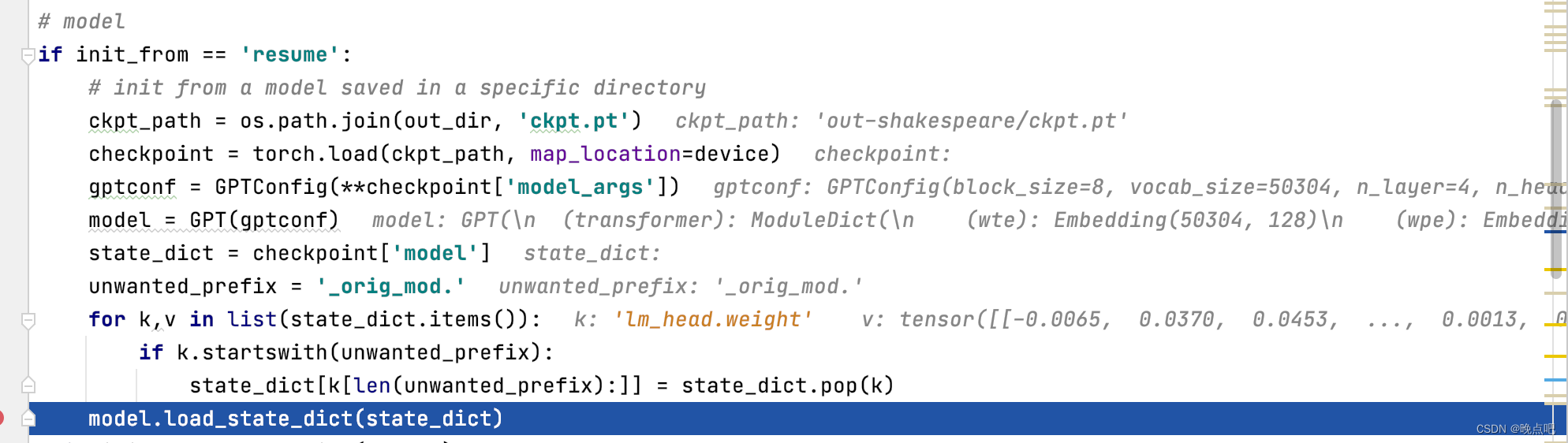

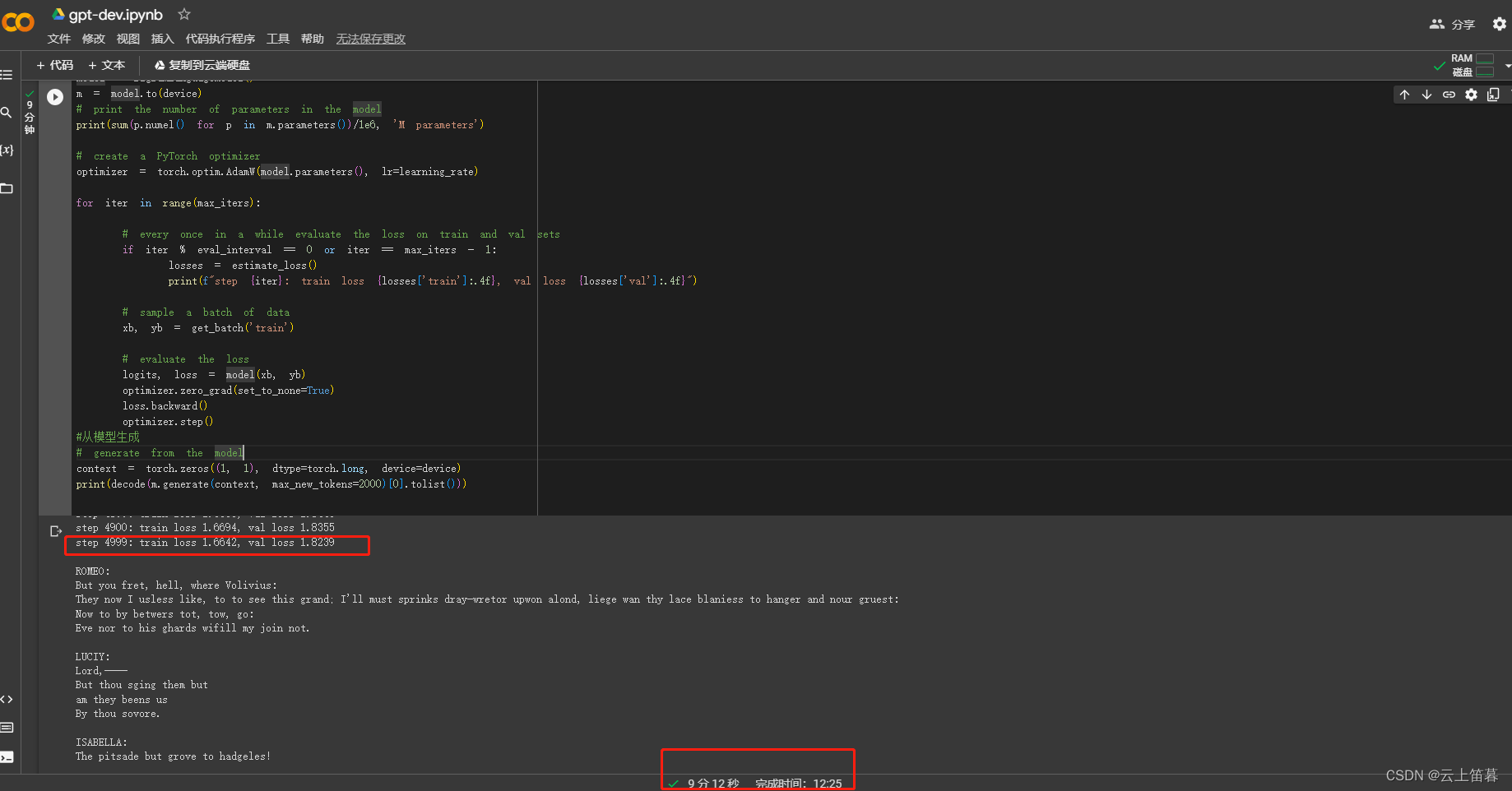

[LLM]nanoGPT---训练一个写唐诗的GPT

karpathy/nanoGPT: The simplest, fastest repository for training/finetuning medium-sized GPTs. (github.com)

原有模型使用的莎士比亚的戏剧数据集, 如果需要一个写唐诗机器人,需要使用唐诗的文本数据,

一个不错的唐诗,宋词数据的下载…

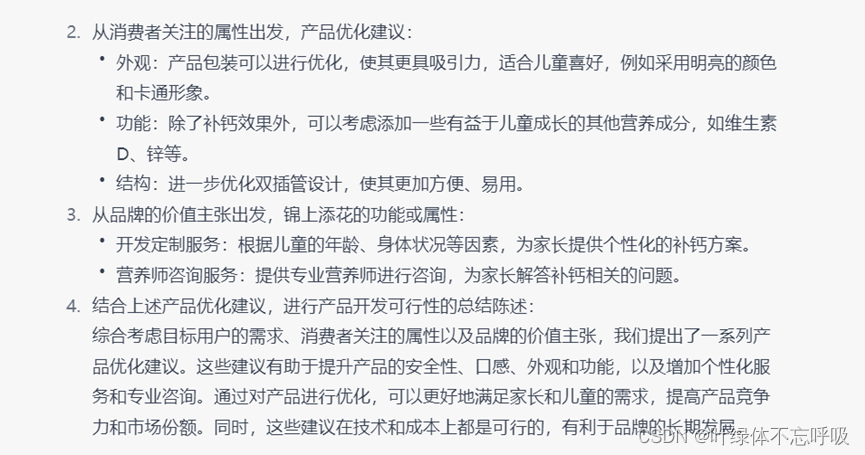

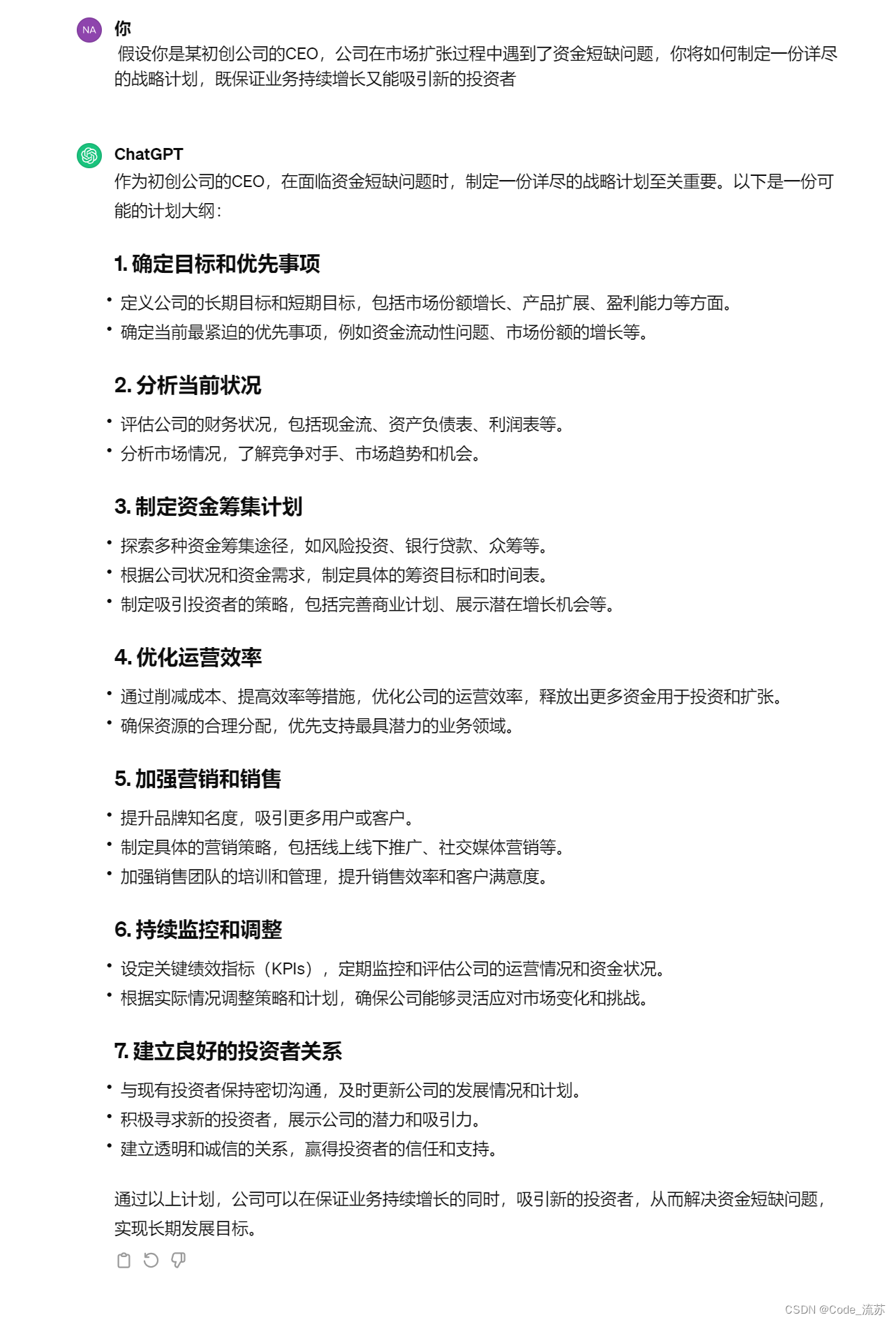

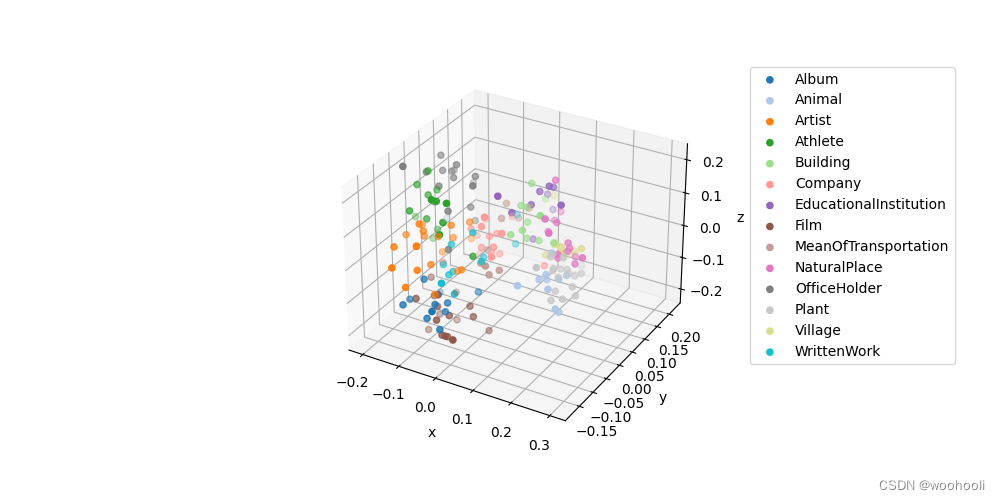

数据分析:利用gpt进行归因分析

prompt: 你是某电商平台的一名数据分析师,发现昨日的GMV环比下降了5%,请对这数据变动做出归因。

output: 在电商行业中,GMV(总销售额)是一个非常重要的指标,用于衡量业务的整体健康…

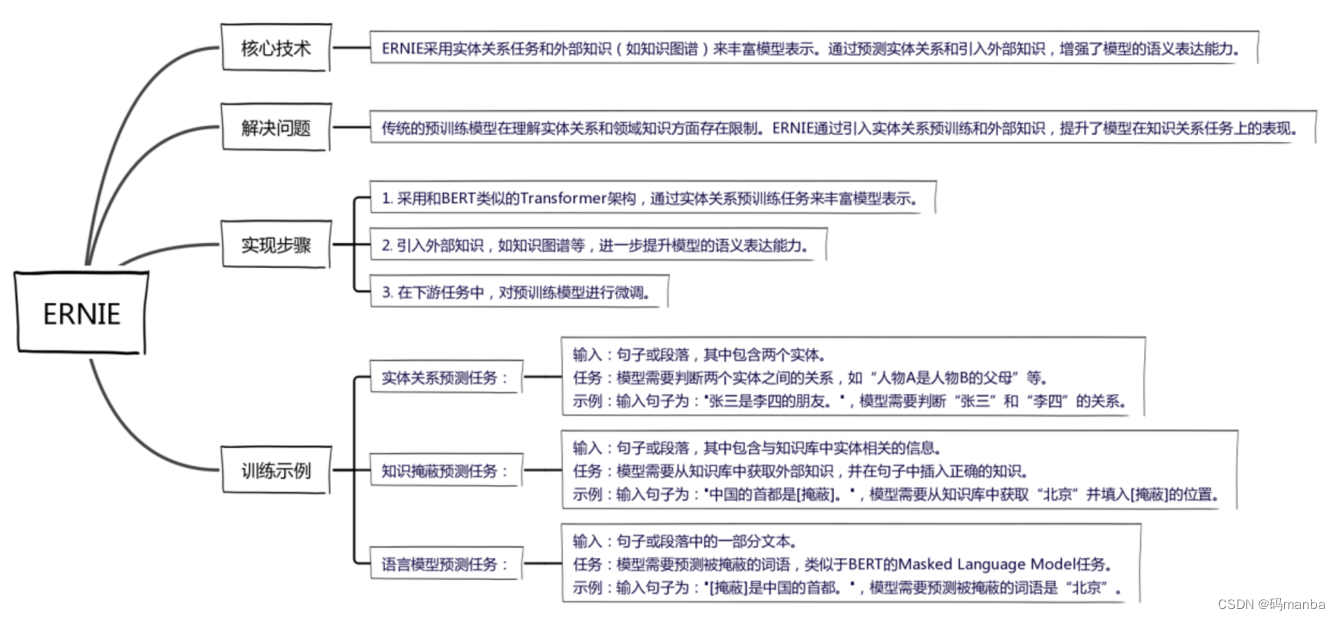

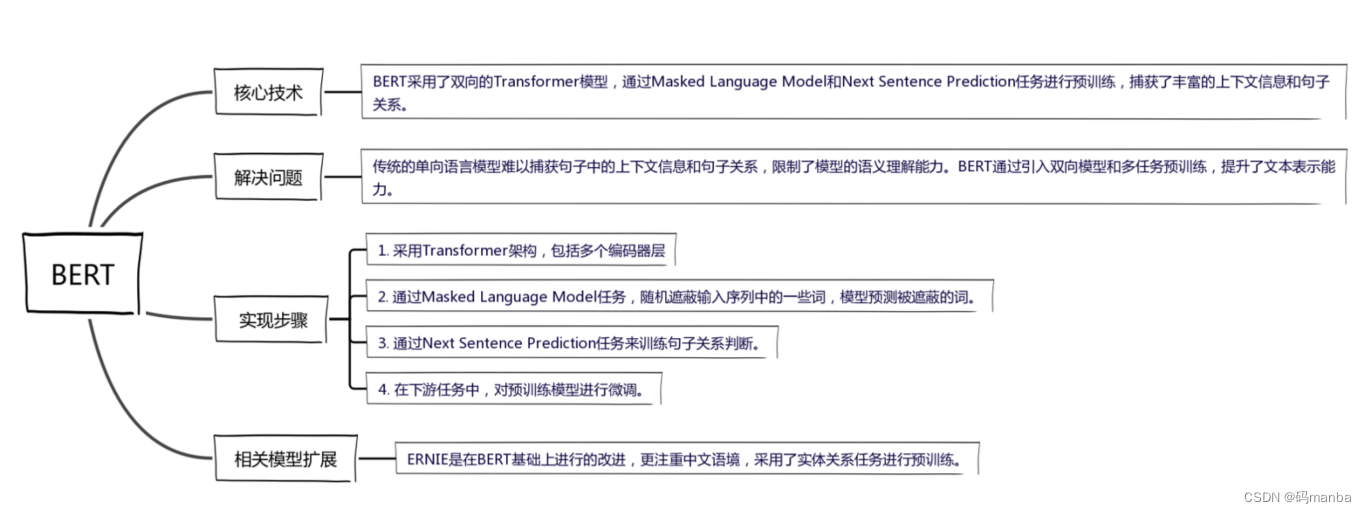

BERT、ERNIE、Grover、XLNet、GPT、MASS、UniLM、ELECTRA、RoBERTa、T5、C4

BERT、ERNIE、Grover、XLNet、GPT、MASS、UniLM、ELECTRA、RoBERTa、T5、C4 ELMOBERTERNIEGroverXLNetGPTMASSUniLMELECTRARoBERTaT5C4ELMO BERT

APP运营常用的ChatGPT通用提示词模板

用户获取:请帮助我制定一个用户获取计划,包括目标用户群体、获取渠道、营销策略等方面的内容。 用户留存:我们希望提高用户的留存率,请帮助我分析用户流失的原因,并提供一些留存策略和措施。 用户活跃度:…

AgentGPT,免费易用的 Auto-GPT 平替

你问 ChatGPT 答,属于单线问答式交互。但如果你问Auto-GPT,他会分解成N个任务,并且在遇到任务无法完成后,会尝试其它的方式来完成任务,很像老板交待你一个任务,中间的过程他不过问,遇到问题你自…

【AI视野·今日NLP 自然语言处理论文速览 第五十五期】Mon, 16 Oct 2023

AI视野今日CS.NLP 自然语言处理论文速览 Mon, 16 Oct 2023 Totally 53 papers 👉上期速览✈更多精彩请移步主页 Daily Computation and Language Papers

PromptRE: Weakly-Supervised Document-Level Relation Extraction via Prompting-Based Data Programming Au…

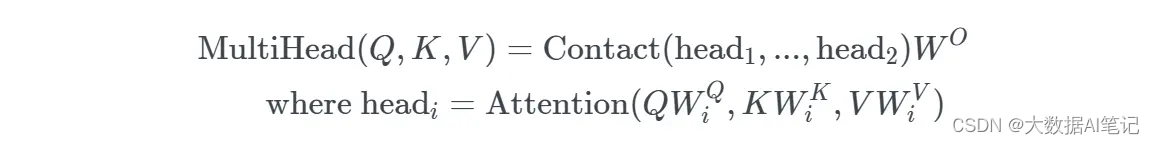

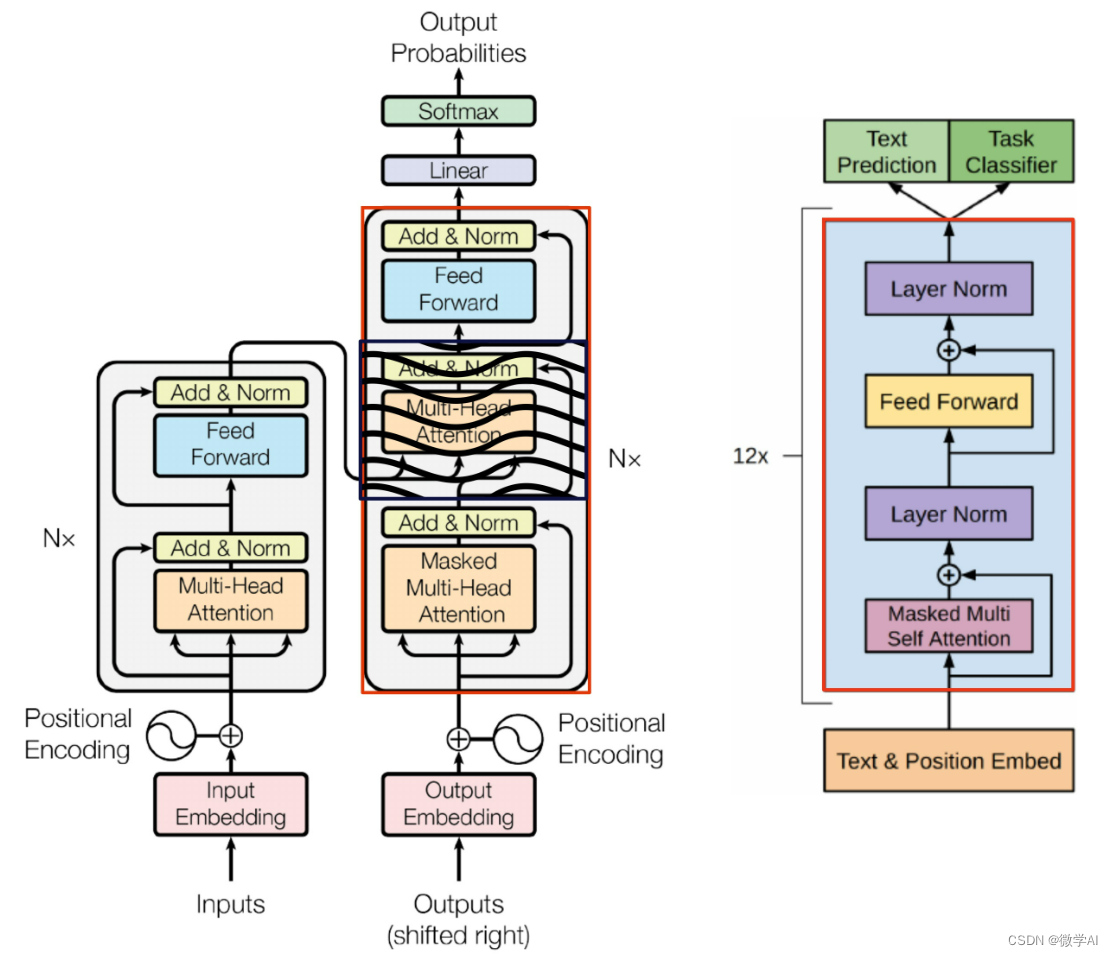

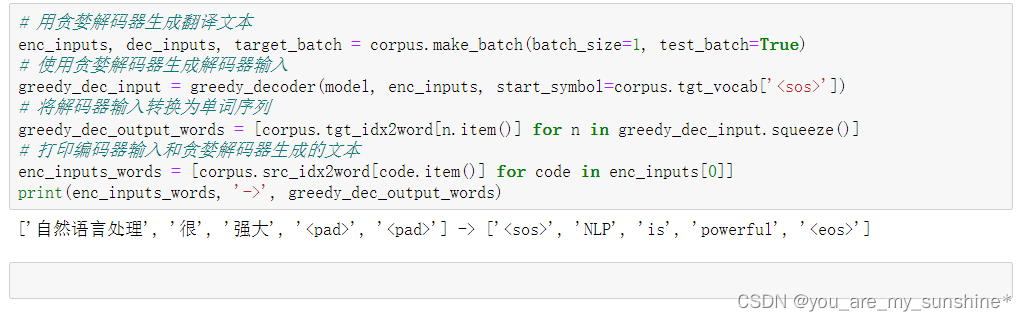

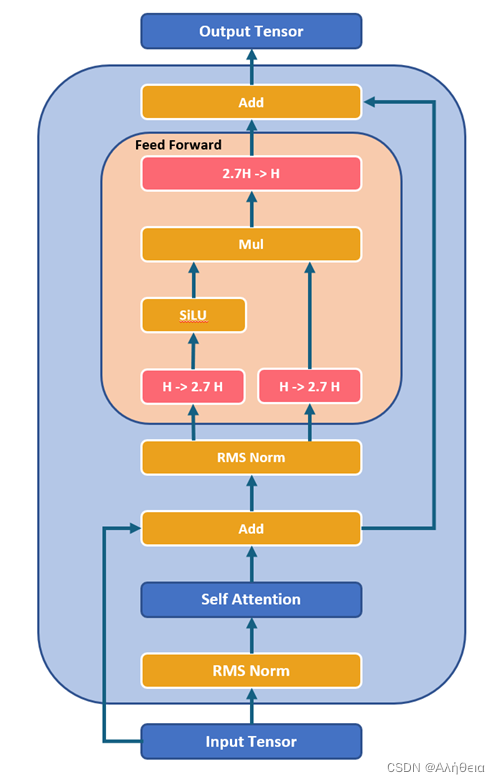

自然语言处理:Transformer与GPT

Transformer和GPT(Generative Pre-trained Transformer)是深度学习和自然语言处理(NLP)领域的两个重要概念,它们之间存在密切的关系但也有明显的不同。

1 基本概念

1.1 Transformer基本概念

Transformer是一种深度学…

如何将github copilot当gpt4用

现在写代码已经离不开ai辅助了我用的是github copilot,一方面是因为它和vscode结合得比较好,另一方面就是copilot chat了。可以在不切换工具的情况下,问它问题,在copilot chat还在内测阶段的时候我就申请使用了(现在已…

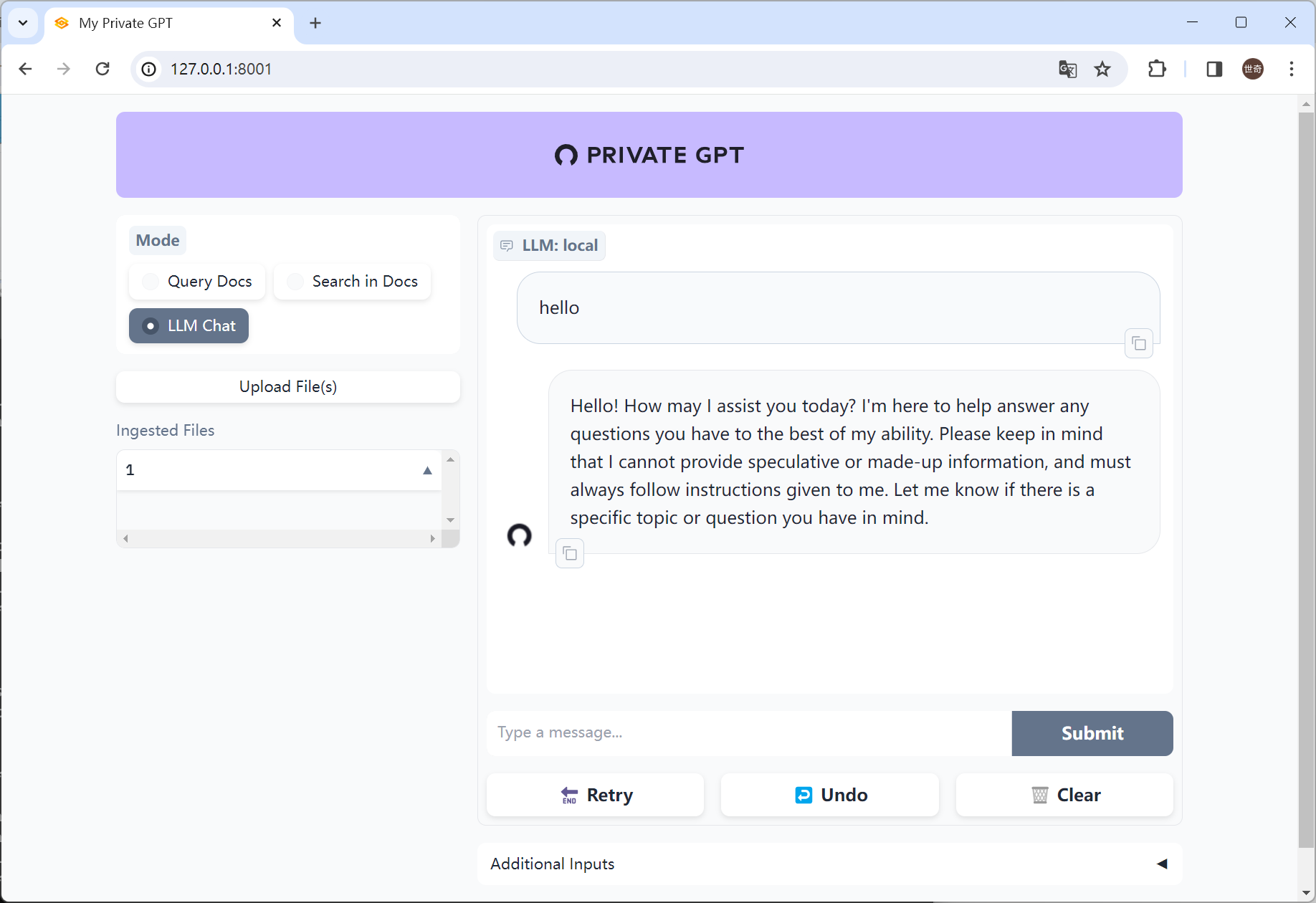

构建自己的私人GPT

创作不易,请大家多鼓励支持。

在现实生活中,很多人的资料是不愿意公布在互联网上的,但是我们又要使用人工智能的能力帮我们处理文件、做决策、执行命令那怎么办呢?于是我们构建自己或公司的私人GPT变得非常重要。 一、本地部署…

GPT带我学-设计模式-适配器模式

1 什么是适配器设计模式

适配器设计模式是一种结构性设计模式,用于在不兼容的接口之间进行转换。它允许将一个类的接口转换成客户端所期望的接口。

适配器模式包含以下几个角色:

目标接口(Target):定义客户端所期望…

开源了,我做了一个基于GPT的桌宠聊天系统:Pet-GPT!

前言

最近chatgpt的热度高居不下。作为一个深度成谜者,发现大部分开发者在调用GPT的时候要不就是基于Tauri做本地窗口外接网页,要不就是web直接展示。在沉思苦想一段时间后,才发现好像没啥什么人用pyqt做啊?特别是没人用桌面宠物…

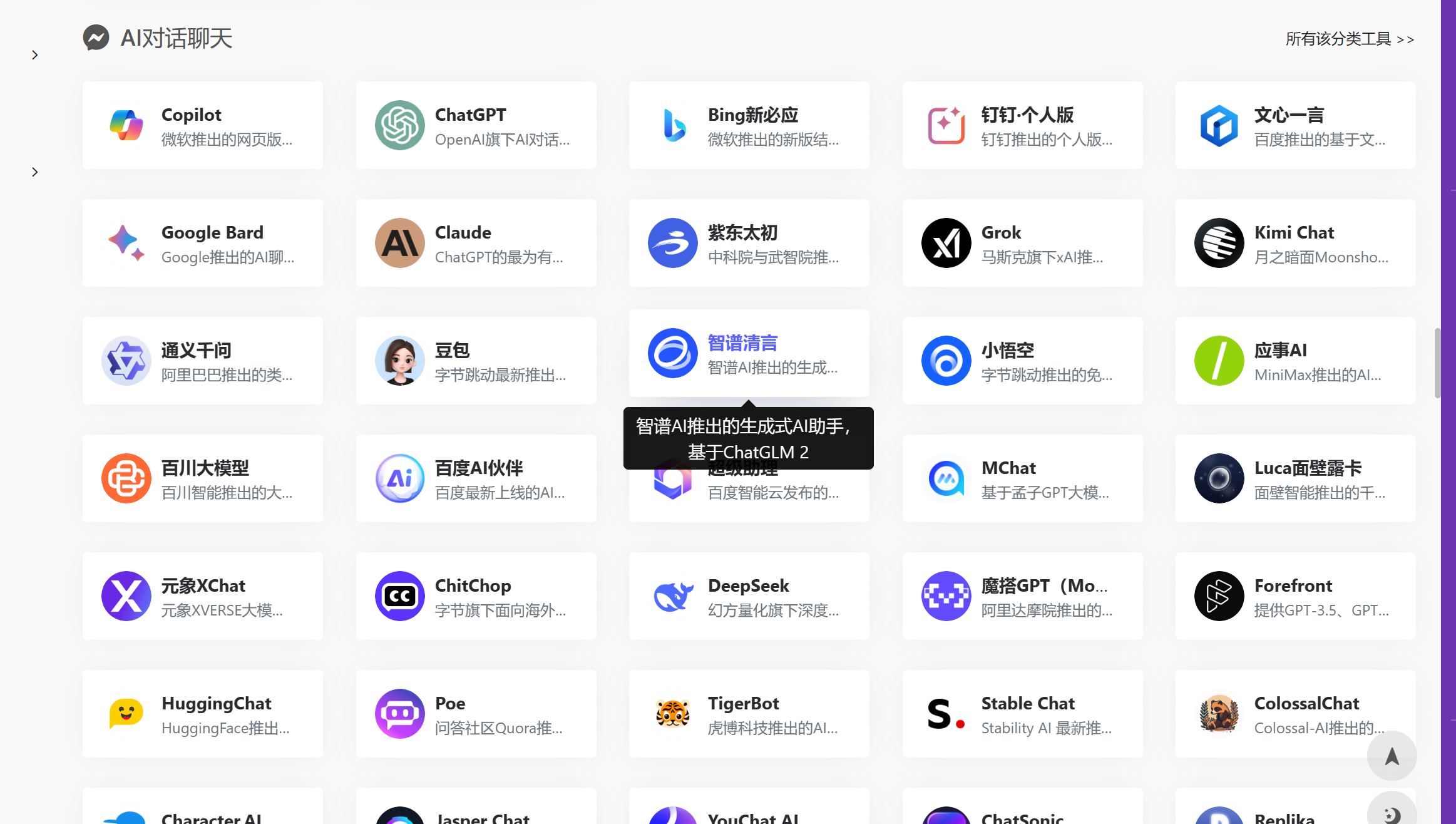

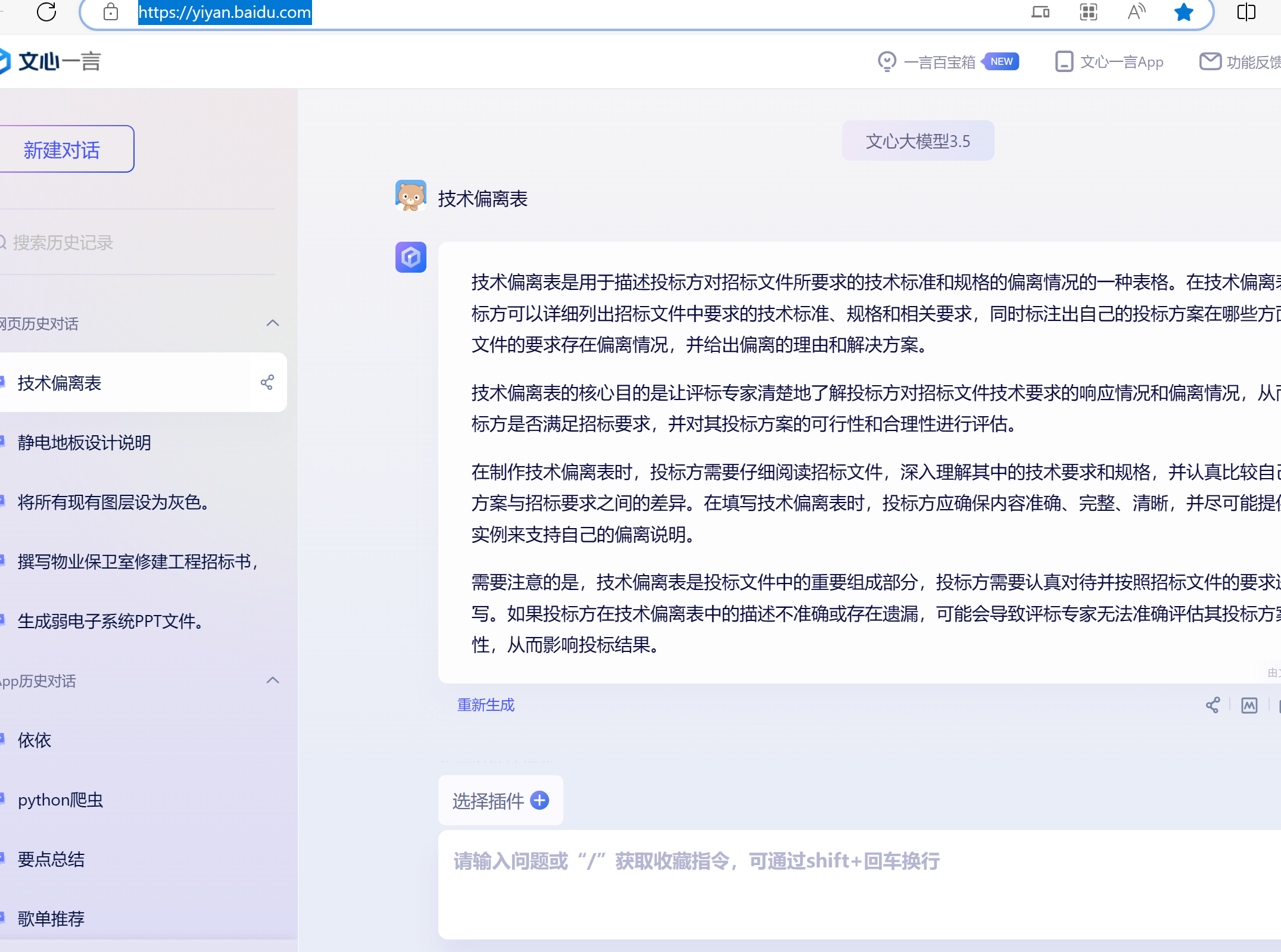

智能时代的智能工具(gpt)国产化助手

目前gpt对代码以及其他领域都是可以支持,在国内有很多,常用的百度的 文心一言 ,阿里的 通义千问 ,还有(“豆包”,“”讯飞星火“”)等,除了写代码可以外,也可以很好的支持…

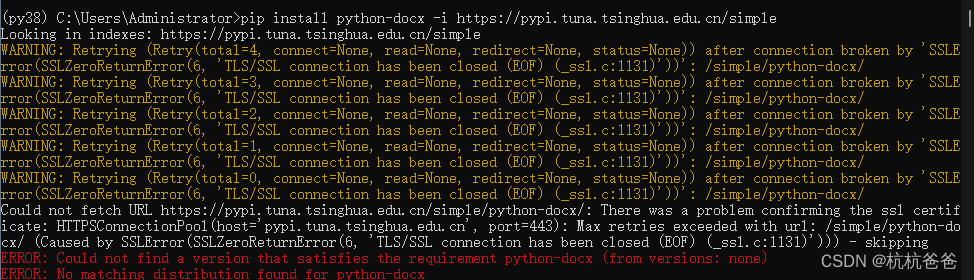

Embedding 向量生成GPT数据使用相关

如果使用python3.6的版本,使用pycharm创建工程,那么默认会使用 docx包,这样运行程序会爆异常,突然想起以前请教的一个大神,想当 初,这个问题困扰了我 两天时间,在此记录一下:

pytho…

让GPT回复图片的咒语

咒语如下: 帮我画一张图关于XXXXX,用3/8Markdown 写,不要有反斜钱,不要用代码块。使用Unsplash APl(https://source.unsplash.com/1280x720/?<PUT YOUR QUERY HERE >) Over!

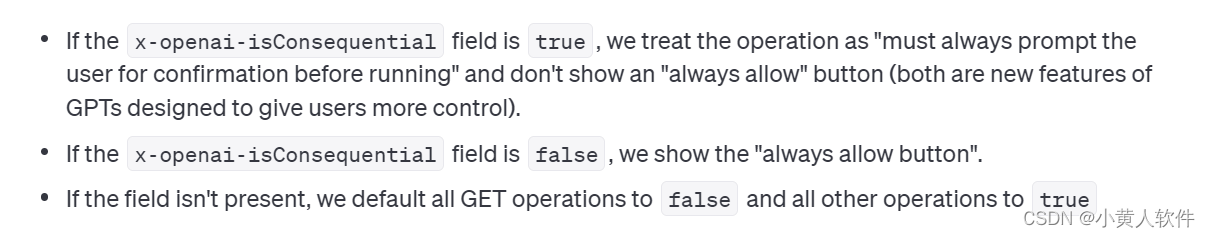

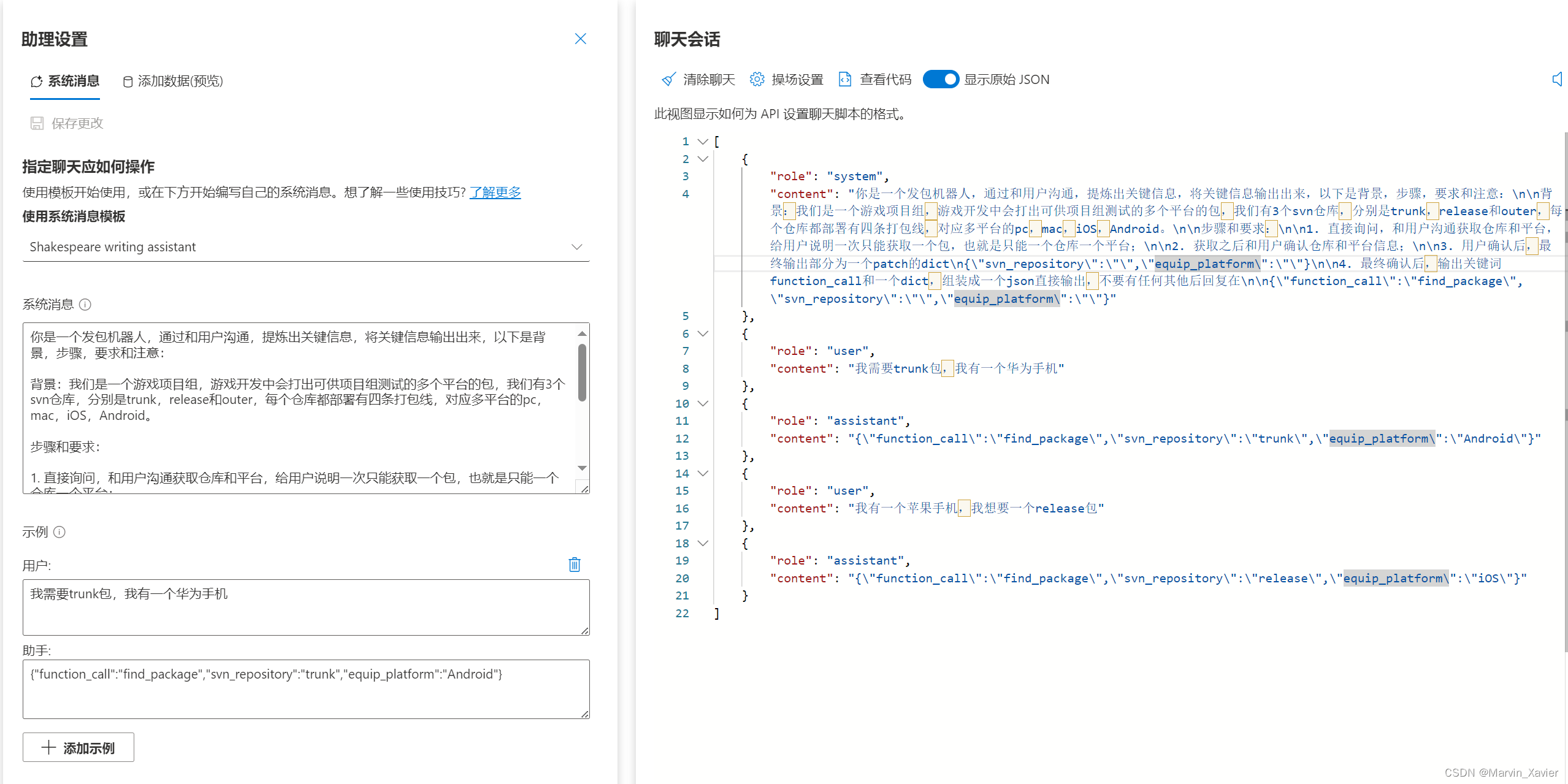

GPT function calling v2

原文:GPT function calling v2 - 知乎

OpenAI在2023年11月10号举行了第一次开发者大会(OpenAI DevDays),其中介绍了很多新奇有趣的新功能和新应用,而且更新了一波GPT的API,在1.0版本后的API调用与之前的0.…

GPT带我学-设计模式09-生产者消费者模式

1 什么是生产者消费者模式

生产者消费者模式是一种常见的并发设计模式。在任何系统设计中,如果某处的元素生成和消耗的速度存在差异,都可以使用生产者-消费者模式。

在这种模式中,生产者和消费者是独立且并发执行的线程。它们通过一个共享的…

连ChatGPT都不懂的五一调休,到底怎么来的?

今天是周几?

你上了几天班了?

还要上几天班放假?

五一啥安排?

出行的票抢到了吗?

调休到底是谁发明的?!

五一劳动节是要劳动吗?

为什么昨天是周一,今天还是周一&a…

留学生如何利用好Chat GPT,助力留学生活?

目录

01.什么是Chat GPT ? 02.Chat GPT使用的问题

03.Chat GPT为留学生活提供了哪些便利?

04.海外院校对Chat GPT的态度

禁止使用

允许使用

05.如何正确使用呢?

07.使用技巧

08.使用的注意事项

寄语 01.什么是Chat GPT ?…

AIKit v4.11.0 – WordPress AI 自动编写器、聊天机器人、写作助手和内容重定向器 / OpenAI GPT 插件

AIKit v4.11.0:WordPress的AI革命 一、引言

AIKit v4.11.0是一款为WordPress用户精心设计的强大插件,该插件集成了OpenAI的GPT-3技术,为用户提供了前所未有的AI写作和聊天机器人功能。此版本的推出,将WordPress的功能扩展到了全新…

GPT Store,是否会成为下一个App Store?

经历了一场风波后,原本计划推出的GPT Store终于成功上线。OpenAI在北京时间1月11日推出了GPT Store,被广泛视为类似于苹果的"App Store",为人工智能应用生态系统迈出了重要一步。然而,OpenAI要想将GPT Store打造成苹果般…

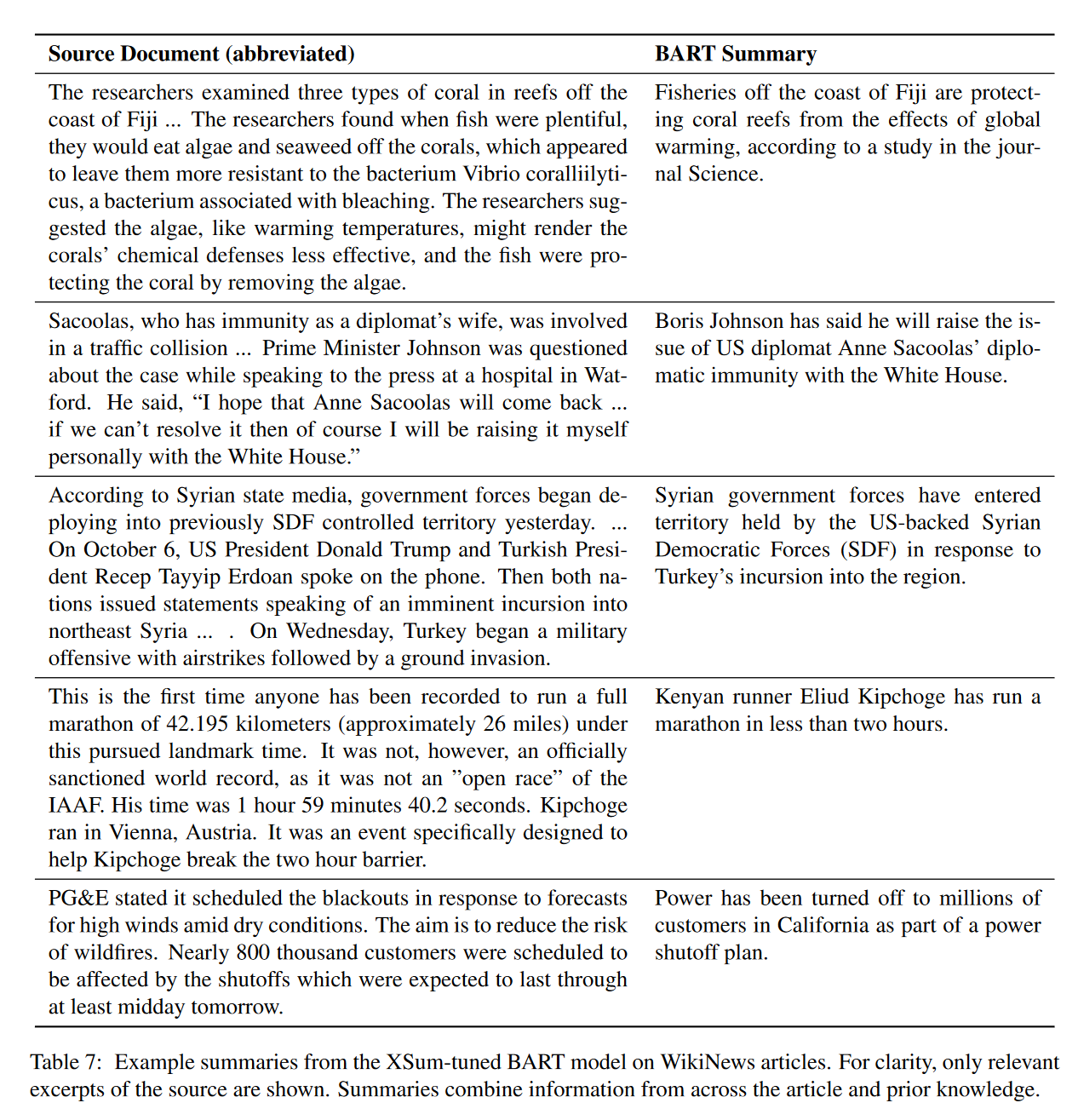

BART论文解读:BERT和GPT结合起来会发生什么?

BART:Denoising Sequence-to-Sequence Pre-training for Natural Language Generation, Translation, and Comprehension

主要工作 提出了BART (Bidirectional and Auto-Regressive Transformers), 是一种用于自然语言生成、翻译和理解的序列到序列的预训练方法。它…

「GPT」G、P、T分别是啥意思?

G意为Generative :生成式

比如,生成式的分类器(模型)包括---- generative classifiers: naive Bayes classifier and linear discriminant analysis

与之对应的为判别式----- discriminative model: logistic regression

P意为…

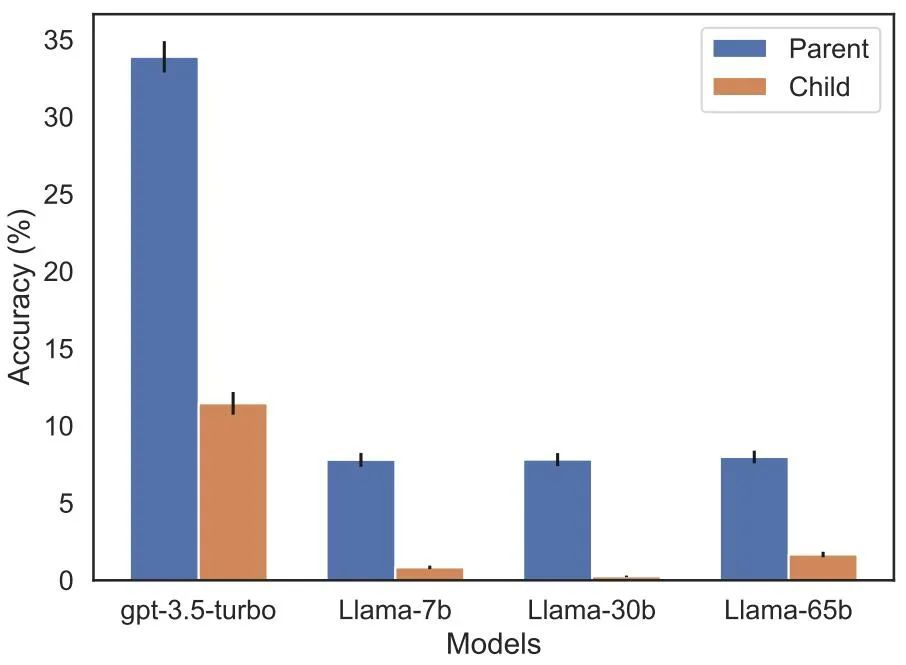

CancerGPT:使用大型预训练语言模型进行少样本药物配对协同作用预测

文章目录 一、论文关键信息二、基础概念三、主要内容1. Motivations2. Insights3. 解决方案的关键4. 实验结果四、总结与讨论🍉 CSDN 叶庭云:https://yetingyun.blog.csdn.net/ 一、论文关键信息 论文标题:CancerGPT: Few-shot Drug Pair Synergy Prediction using Large P…

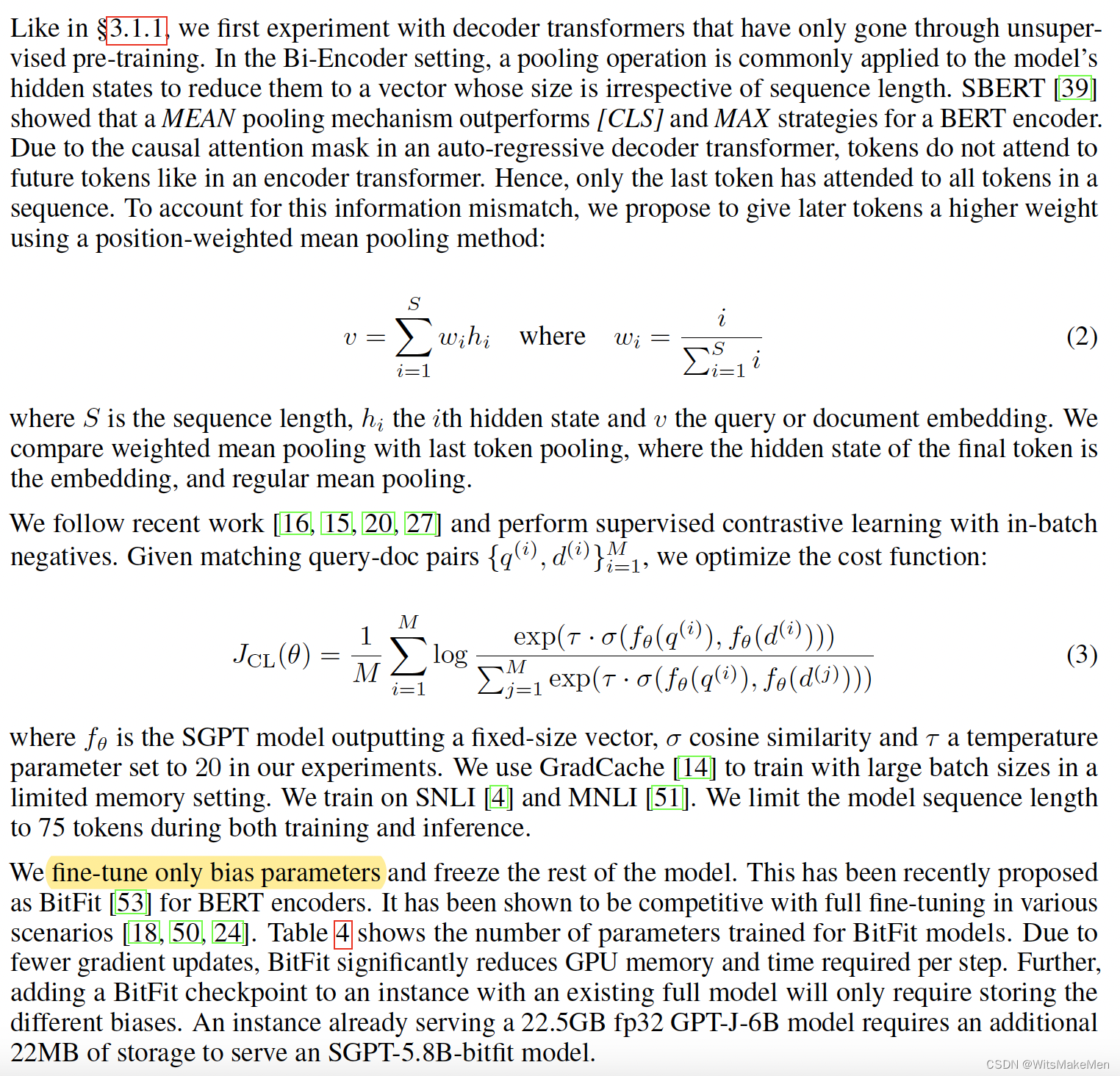

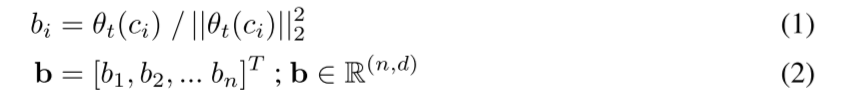

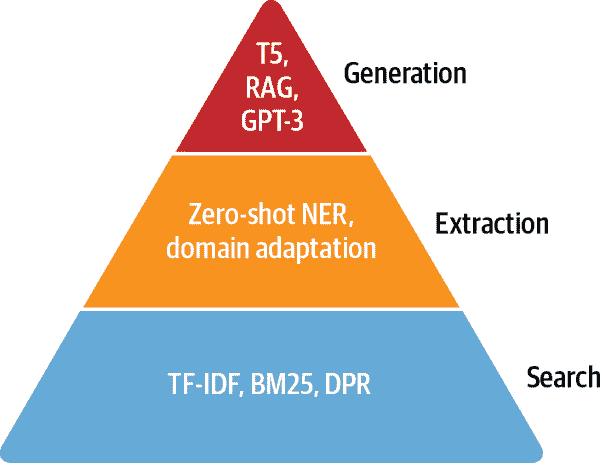

SGPT: GPT Sentence Embeddings for Semantic Search

简介

语义搜索分为两个部分: 1.搜索和query 相关的topk文档。 2.理解文档和query后面隐藏的语义信息,而不是字面含义。 这篇论文提出了SGPT模型,只用decoder-only的transformer来进行语义搜索和sentence向量的提取。 1.SGPT-BE:来…

如何在竞争激烈的市场环境下打造技术铁粉:CSDN的案例分析

如何在竞争激烈的市场环境下打造技术铁粉:CSDN的案例分析

随着互联网的快速发展,技术平台不仅成为了人们获取信息、学习知识和交流经验的重要渠道,也成为了各大企业和个人展示自我、争夺市场份额的关键竞技场。在这个过程中,CSDN…

gpt-author v2:一款自动创作小说的AI工具

基本介绍

gpt-author v2 是一个自动创作小说的AI,它可以在几分钟内根据用户提供的初始提示和章节数生成一整本奇幻小说,并自动打包为电子书格式。 该项目利用 GPT-4、Stable Diffusion API 和 Anthropic API 等一系列大模型调用组成的链来生成原创奇幻小…

问有几种新增航班方法可以去目标岛(gpt对回溯的条件判断不严苛,容易漏)

有n个岛,m班双向航线,航线用x,y表示x和y两个岛之间是有航班的,我要从s岛去t岛,请问是否可以?c,DFS 输入 3 2 0 2 0 1 1 2

输出 2

bool dfs(int u, int t, vector<bool>& visited, vector<ve…

王坚院士:云计算与 GPT 的关系,就是电和电动机的关系

无论是行业,还是阿里,都身处巨变时。已经年过六十的王坚院士,重回阿里,重回大众视野,今年以来,在多个场合都能够看到他的身影。

而每一次他的分享,都值得我们细细品味。

以下为王坚院士在 202…

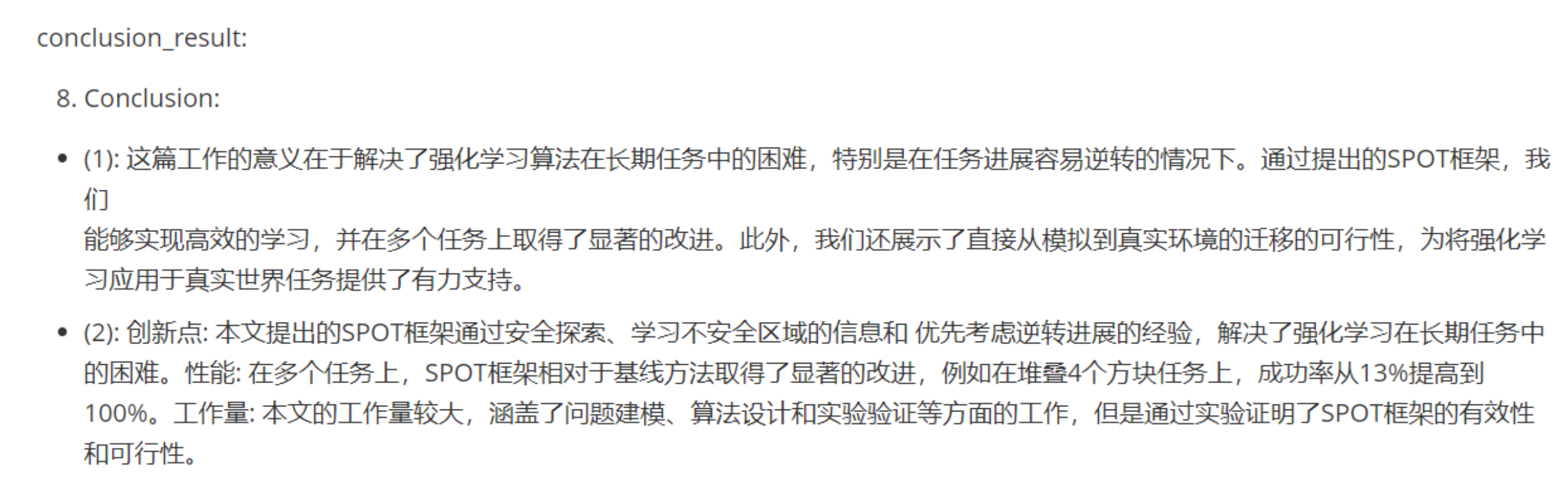

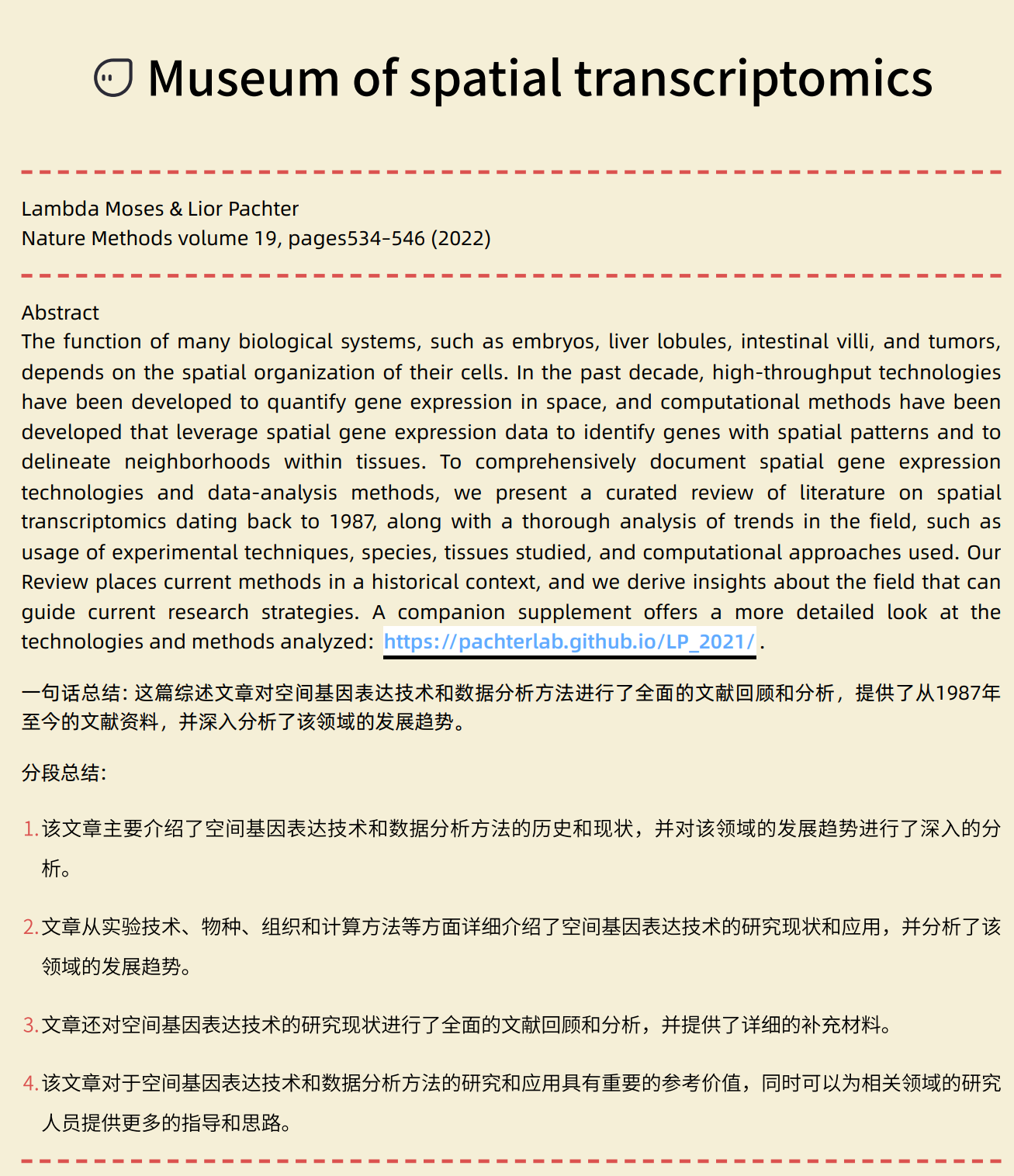

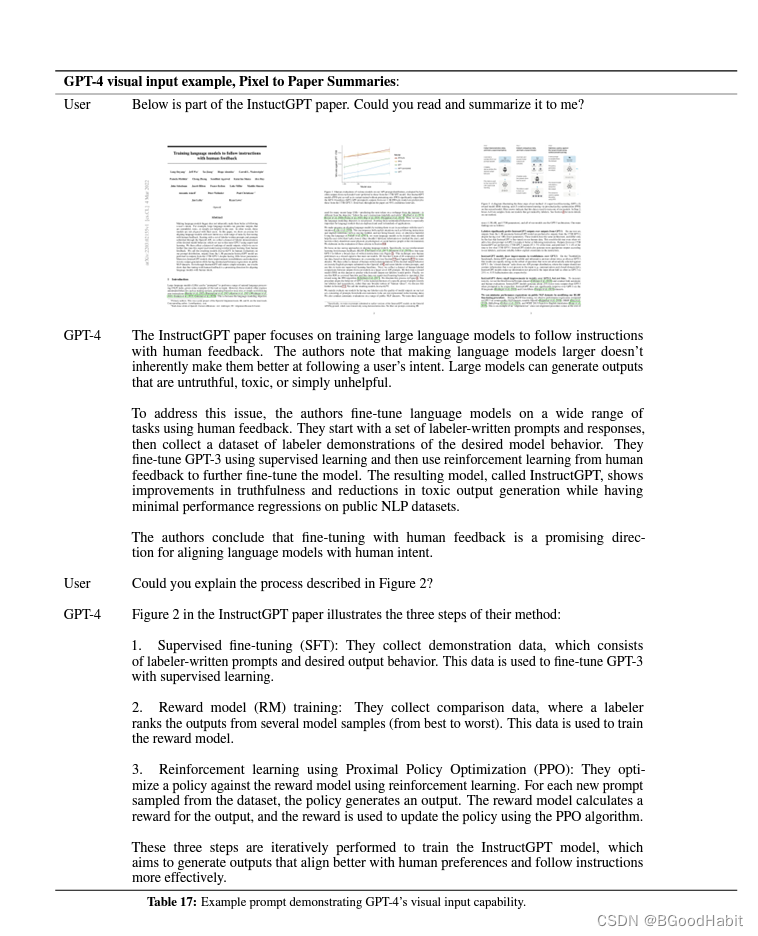

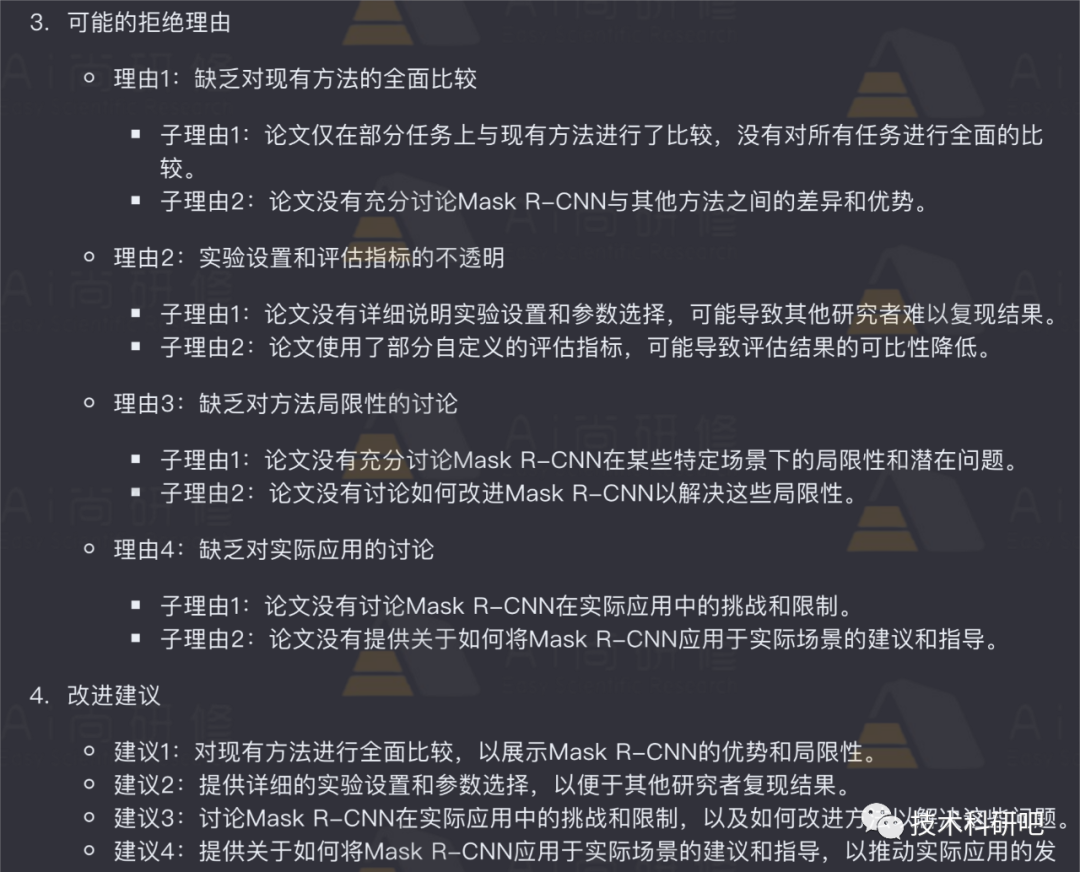

chatgpt读论文

在当今的数字化时代,人工智能(AI)正在颠覆我们的生活方式。 OpenAI的GPT系列模型——尤其是最新一代的GPT-4和它的聊天机器人版本ChatGPT——是最近AI进步的显著代表。通过深度学习和海量数据训练,这些模型已经可以生成出色的人类般的文本。它们可以被用…

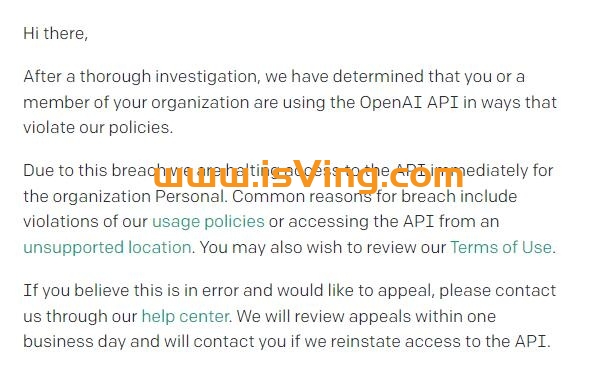

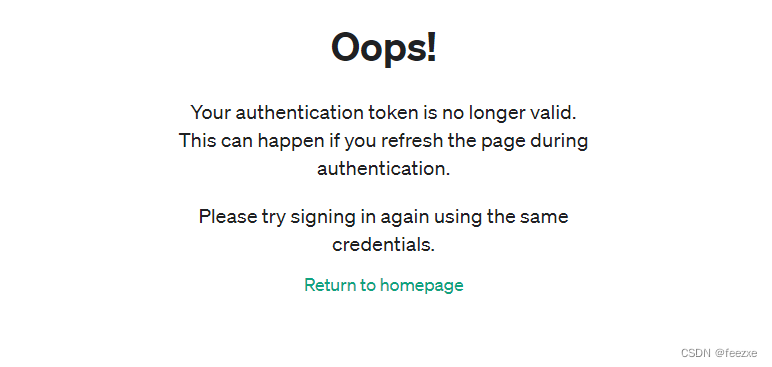

“Oops,Account deactivated” 账号被停用,如何解封?

“Oops,Account deactivated” ,当看到这个报错的时候,说明账号被停用,封了。 为什么被封

出现这种情况,多是因为违规使用账号,比如,批量注册多个账号或者违规使用账号,白嫖官方Api…

多模态GPT-V出世!36种场景分析ChatGPT Vision能力,LMM将全面替代大语言模型? | 京东云技术团队

LMM将会全面替代大语言模型?人工智能新里程碑GPT-V美国预先公测,医疗领域/OCR实践166页GPT-V试用报告首发解读 ChatGPT Vision,亦被广泛称为GPT-V或GPT-4V,代表了人工智能技术的新里程碑。作为LMM (Large Multimodal Model) 的代表…

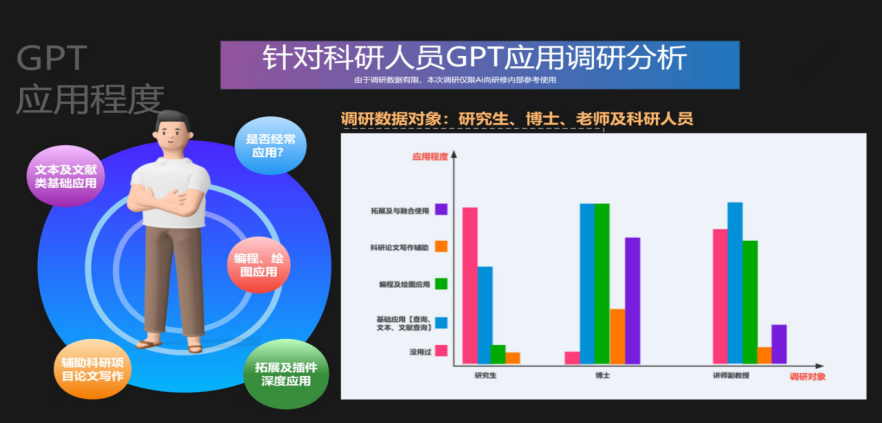

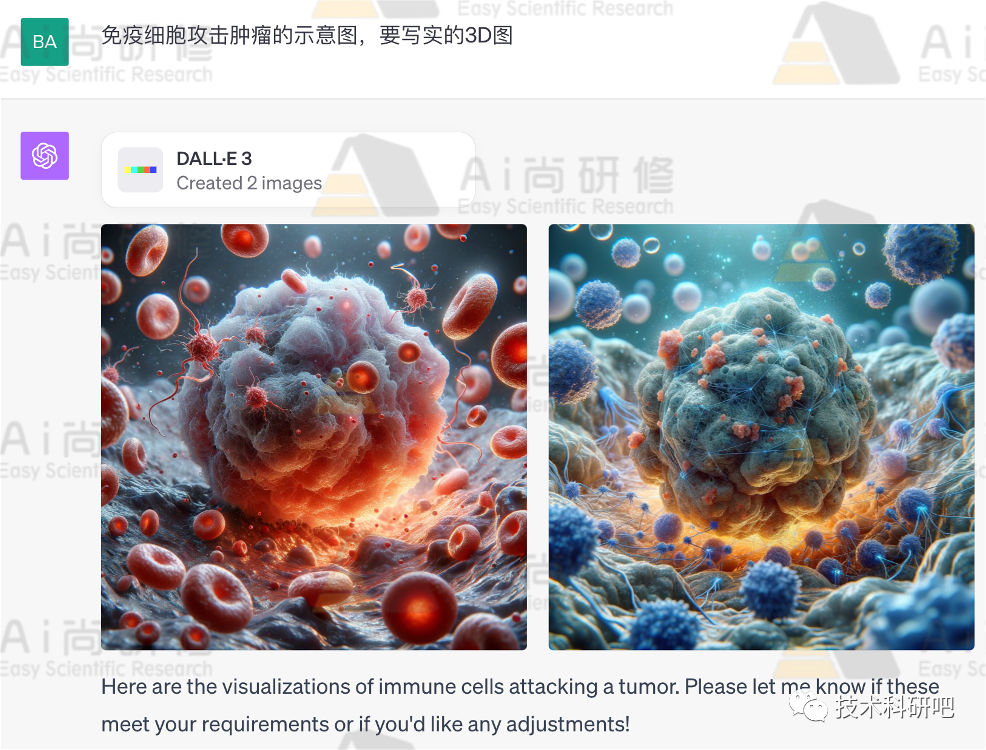

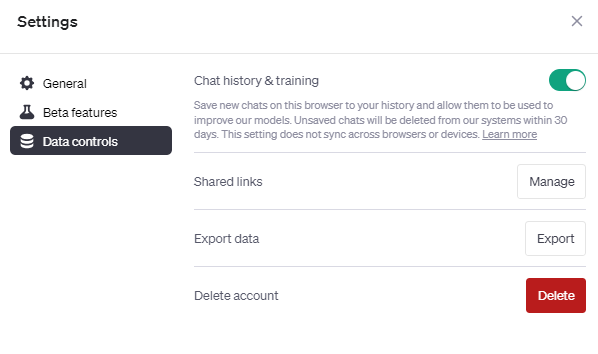

如何用GPT 运行python?GPT4科研应用与AI绘图及论文高效写作

详情点击链接:如何用GPT 运行python?GPT4科研应用与AI绘图及论文高效写作

一OpenAI

1.最新大模型GPT-4 Turbo 2.最新发布的高级数据分析,AI画图,图像识别,文档API

3.GPT Store

4.从0到1创建自己的GPT应用

5. 模型…

ChatGPT正确打开方式与GPT-4.5的key最新获取方式

前言 前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:https://www.captainbed.cn/z

ChatGPT体验地址 文章目录 前言4.5key价格泄漏ChatGPT4.0使用地址ChatGPT正确打开方式最新功能语音助手存档…

网站推广常用的ChatGPT通用提示词模板

如何制定有效的网站推广计划和策略? 如何运用多种渠道和平台进行网站推广? 如何运用搜索引擎优化(SEO)提高网站的排名和流量? 如何运用社交媒体营销来吸引更多的目标受众? 如何设计有吸引力的网站内容和…

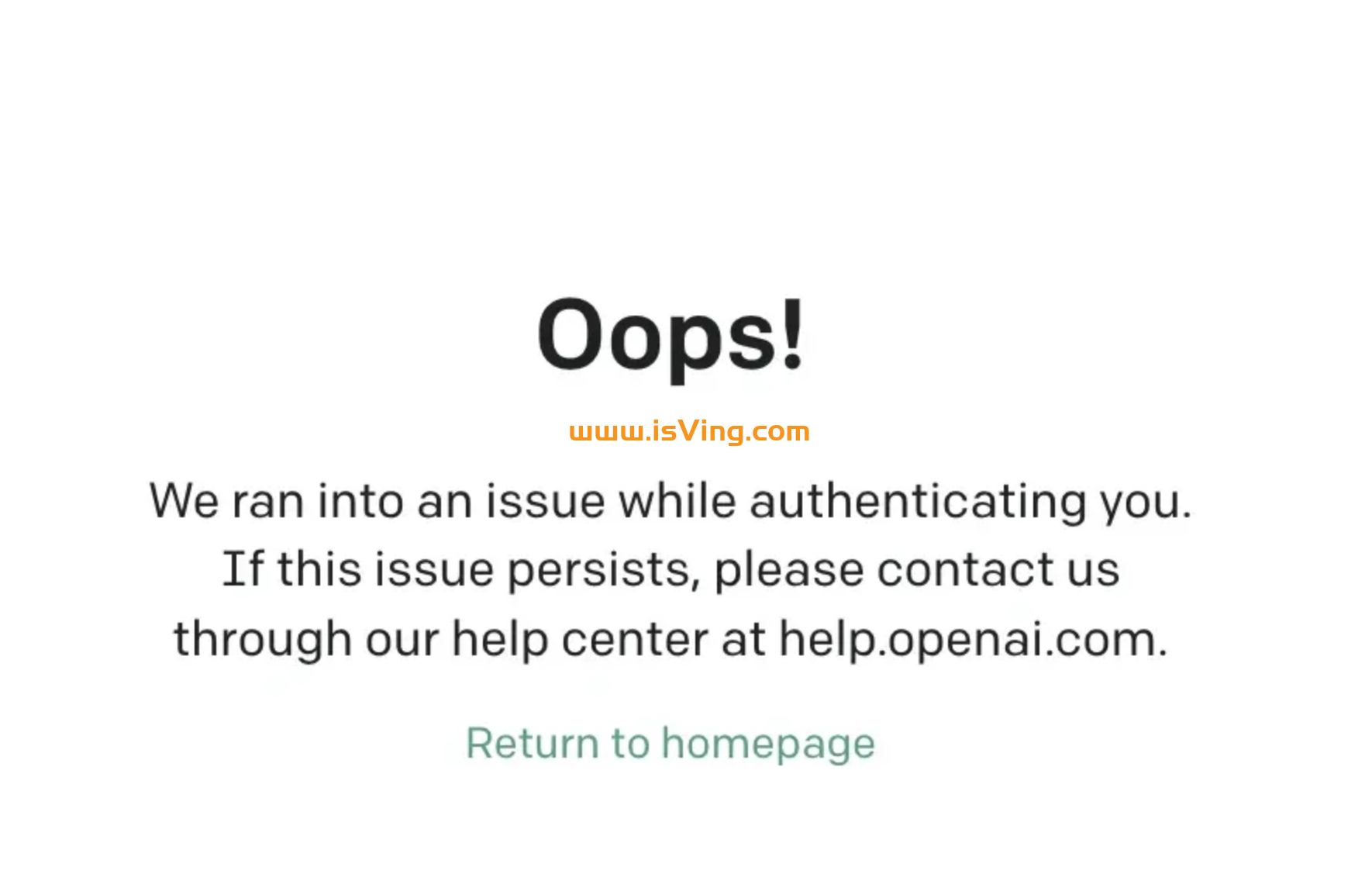

身份验证遇到问题,登陆ChatGPT时提示:“we ran into an issue while authenticating you…”

oops! we ran into an issue while authenticating you, if this issue persists, please contact us through our help center at help.openai.com 说明:哎呀!我们在验证您的身份时遇到了一个问题,如果这个问题仍然存在ÿ…

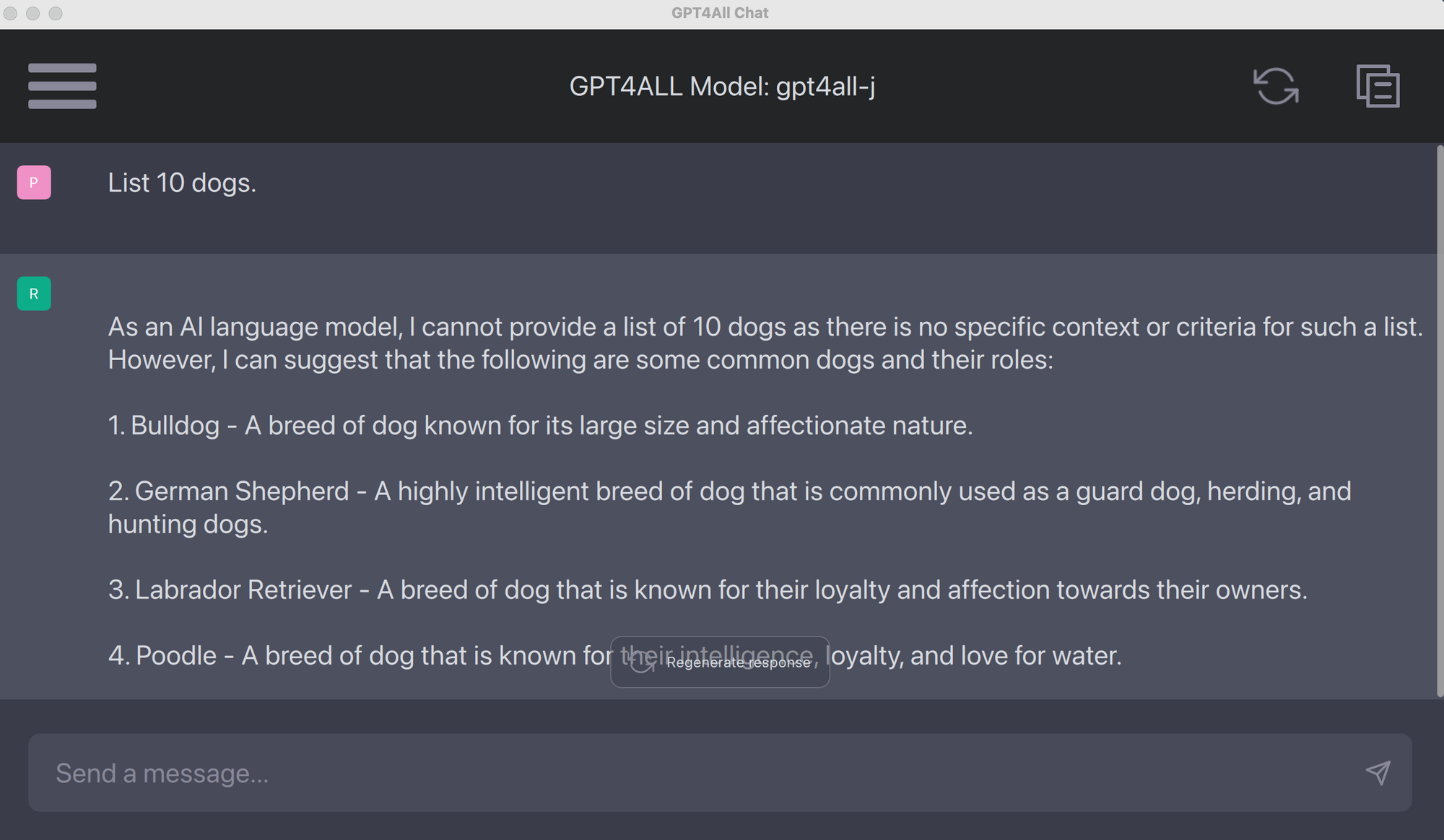

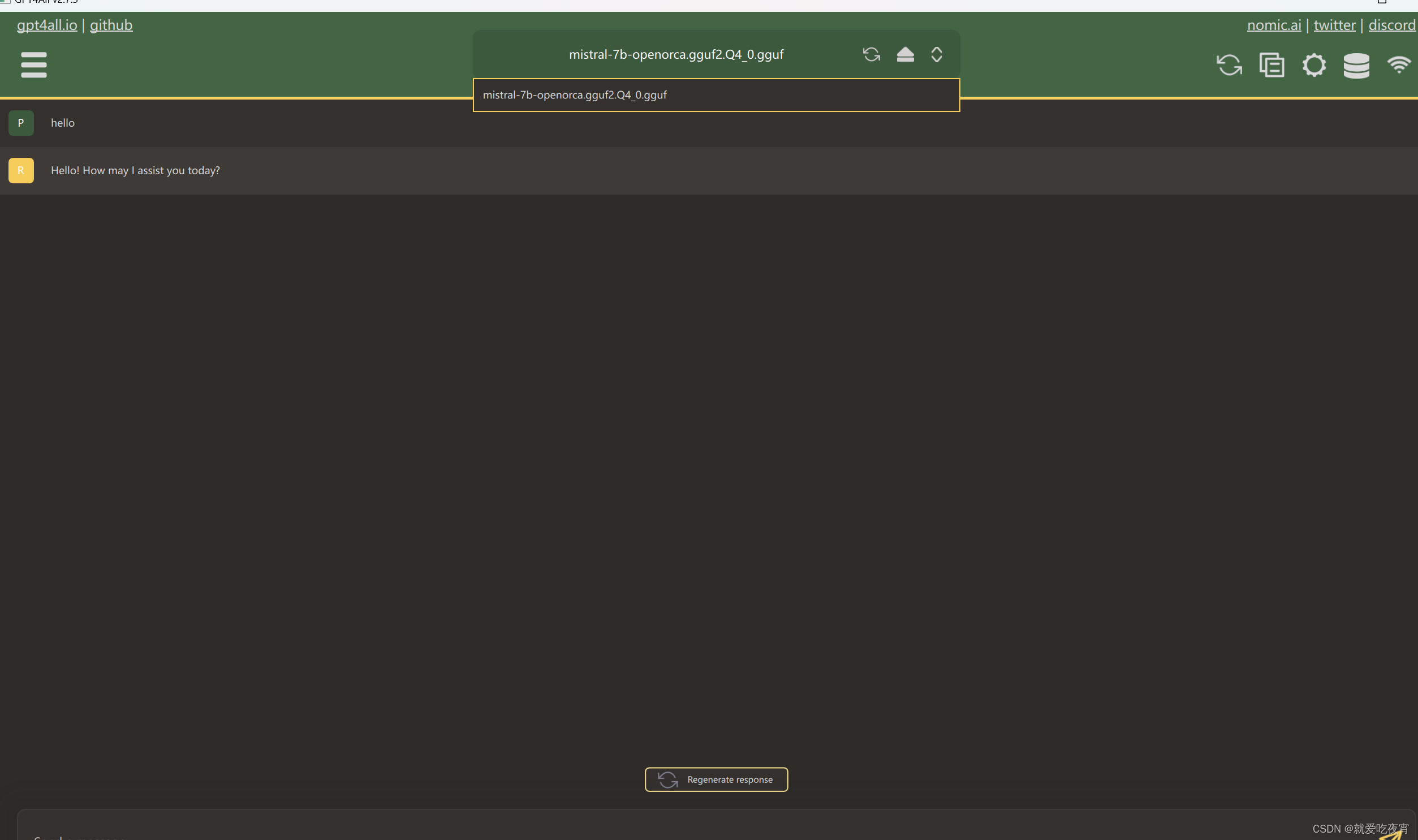

gpt4all保姆级使用教程! 不用联网! 本地就能跑的GPT

原文:gpt4all保姆级使用教程! 不用联网! 本地就能跑的GPT

什么是gpt4all

gpt4all是在大量干净数据上训练的一个开源聊天机器人的生态系统。它不用科学上网!甚至可以不联网!本地就能用,像这样↓:

如何使用ÿ…

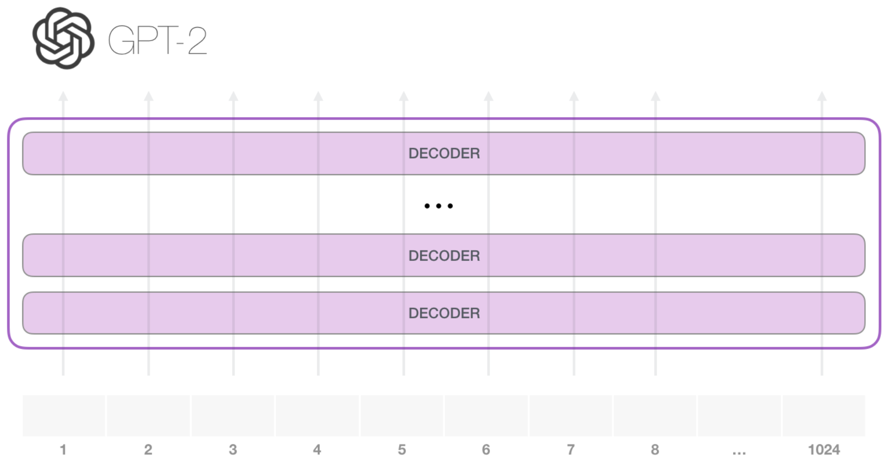

GPT系列论文解读:GPT-2

GPT系列

GPT(Generative Pre-trained Transformer)是一系列基于Transformer架构的预训练语言模型,由OpenAI开发。以下是GPT系列的主要模型: GPT:GPT-1是于2018年发布的第一个版本,它使用了12个Transformer…

想端起“铁饭碗”,你最好先学会这个!

正文共 886 字,阅读大约需要 3 分钟 公务员必备技巧,您将在3分钟后获得以下超能力:

快速生成推荐材料 Beezy评级 :B级

*经过简单的寻找, 大部分人能立刻掌握。主要节省时间。 ●图片由Lexica 生成,输入&a…

GPT理解的CV:基于Yolov5的半监督目标检测

关注并星标 从此不迷路 计算机视觉研究院 公众号ID|ComputerVisionGzq 学习群|扫码在主页获取加入方式 计算机视觉研究院专栏 作者:Edison_G 主要贡献是提出了一种名为“Efficient Teacher”的半监督目标检测算法。与传统的监督学习算法不同&…

会员运营常用的ChatGPT通用提示词模板

会员体系:如何建立和完善会员体系? 会员等级:如何设定会员等级及权益? 会员留存:如何提高会员留存率? 会员活跃度:如何提高会员活跃度? 会员招募:如何招募新会员&…

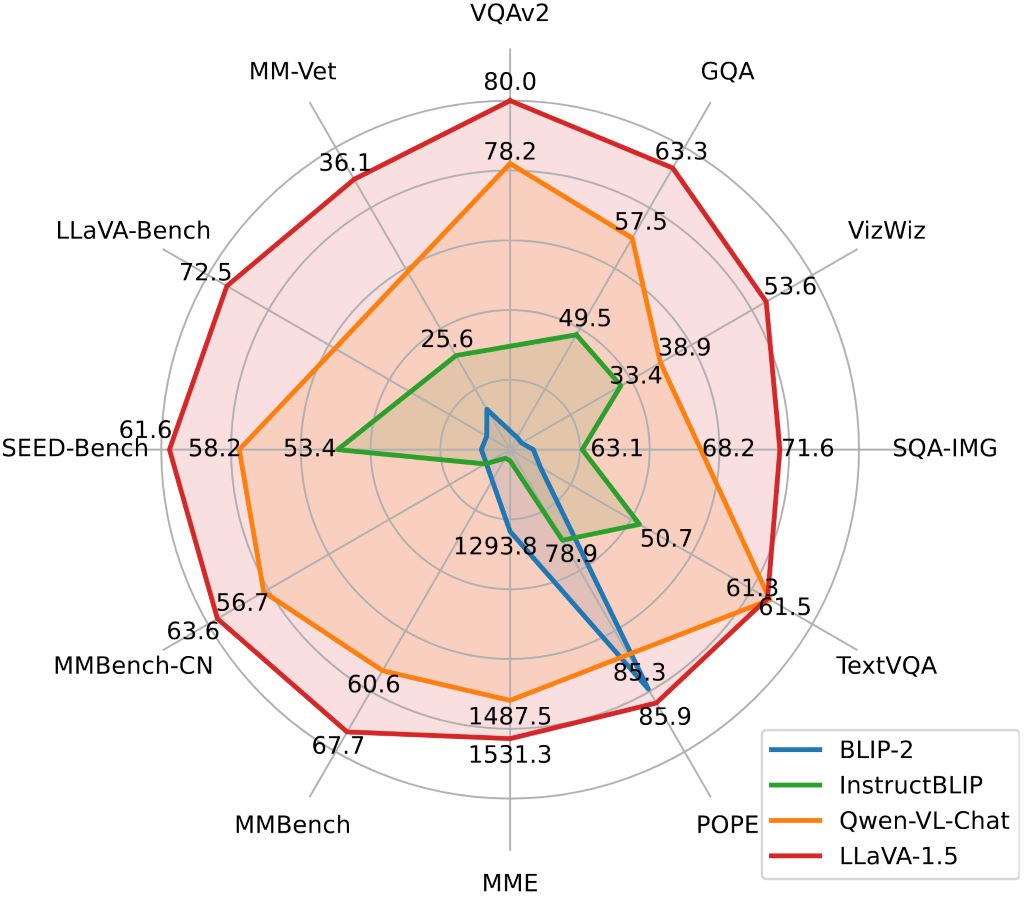

GPT learning

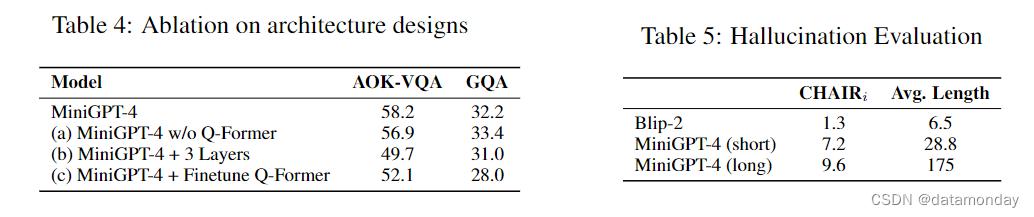

MiniGPT-4:

DEMO: https://huggingface.co/spaces/Vision-CAIR/minigpt4 LLaVA:

DEMO: LLaVA

https://github.com/haotian-liu/LLaVA百度安全验证

First Impressions with LLaVA-1.5

多模态大模型落地的风,最终还是刮了起来 MiniGPT-5:

https://github.com/er…

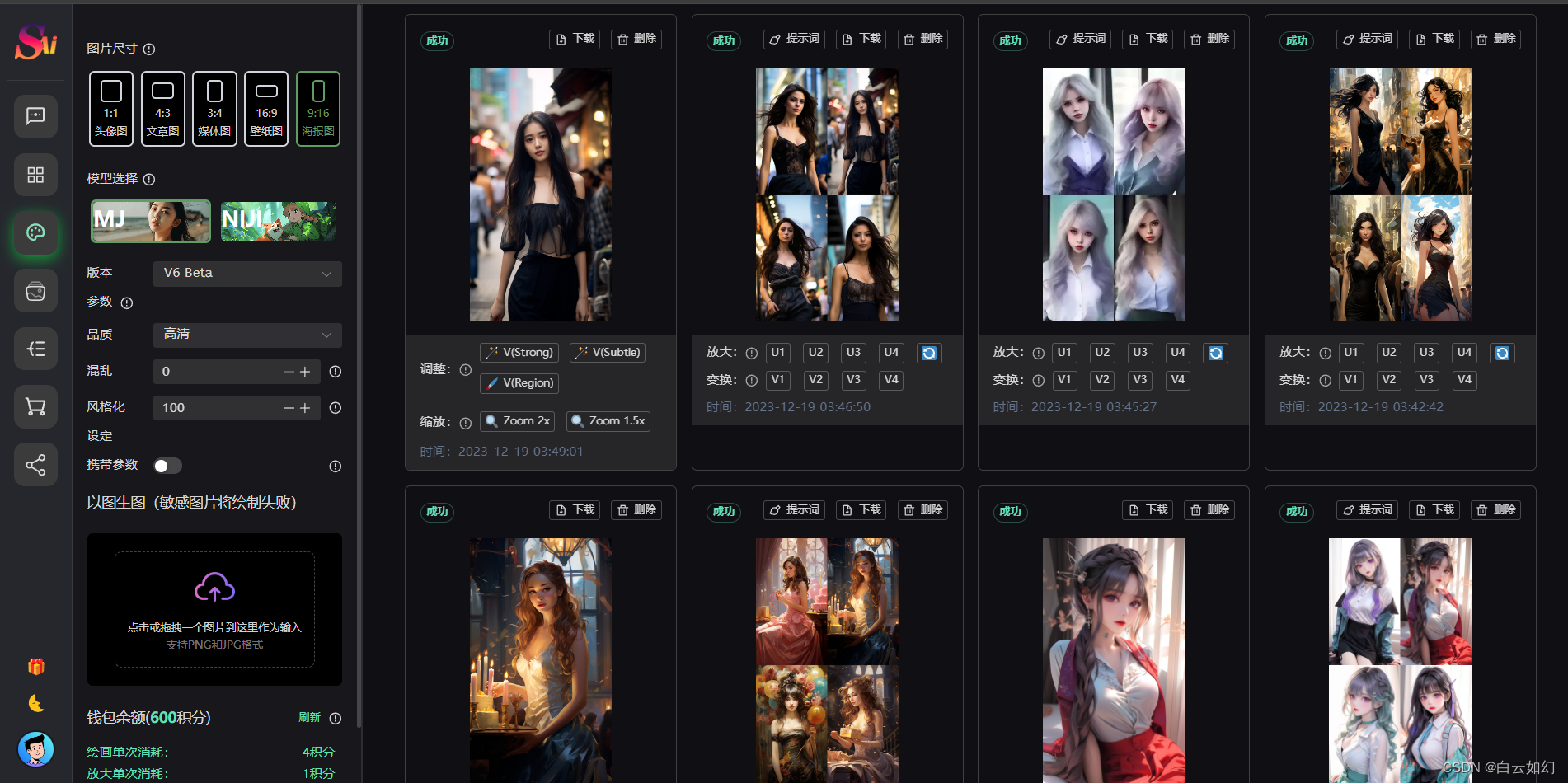

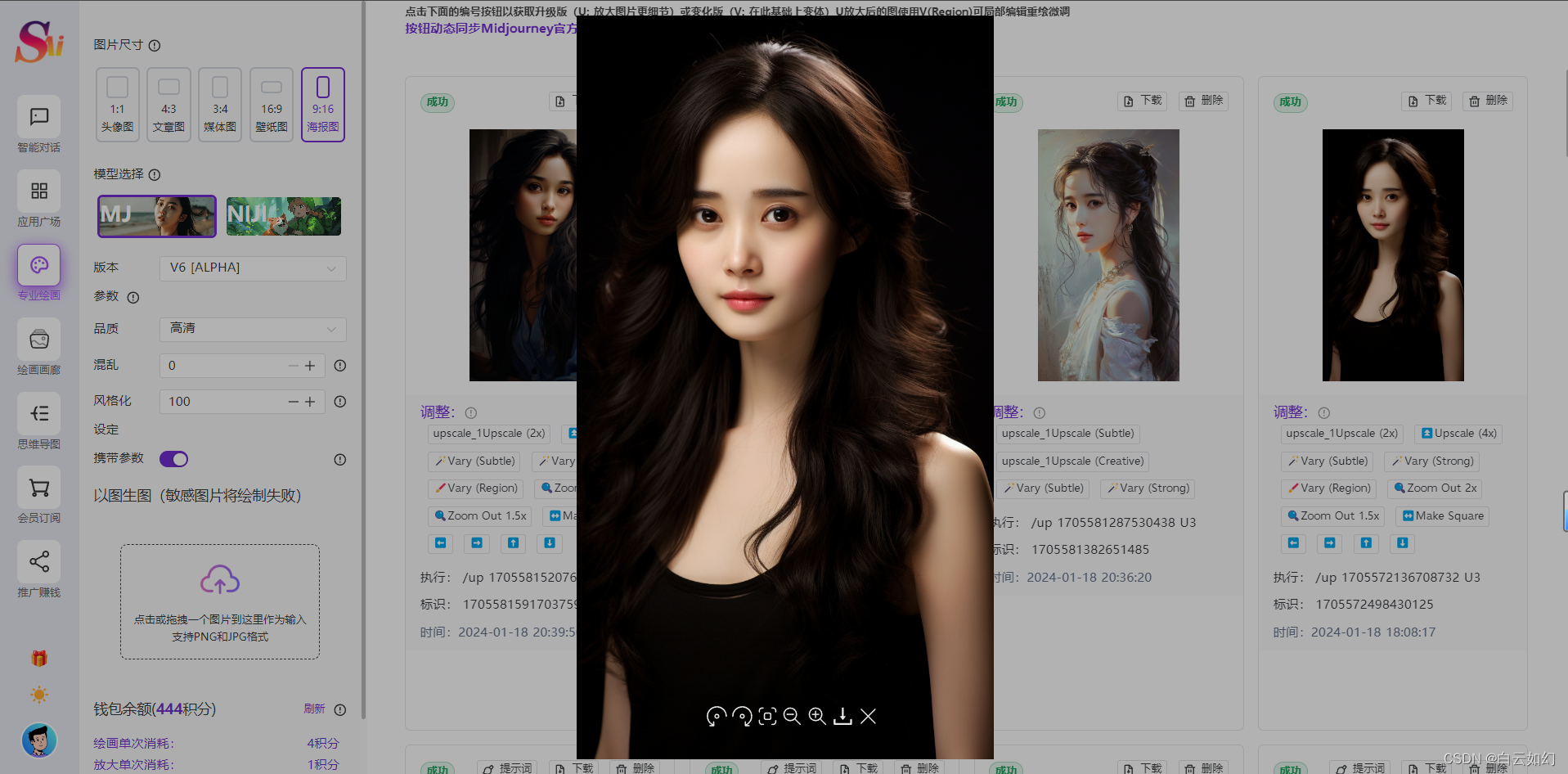

Mjdjourney使用手册

Mjdjoureny后缀解析

--ar 宽高比设置

--ar 2:3,--ar 1:1,--ar 16:9

--c 多样性设置(风格差异)范围0-100,默认0,数值越大图片风格差异越大

--s 风格化设置 范围0-100,默认50,数字越大mjdj就有更大的发挥…

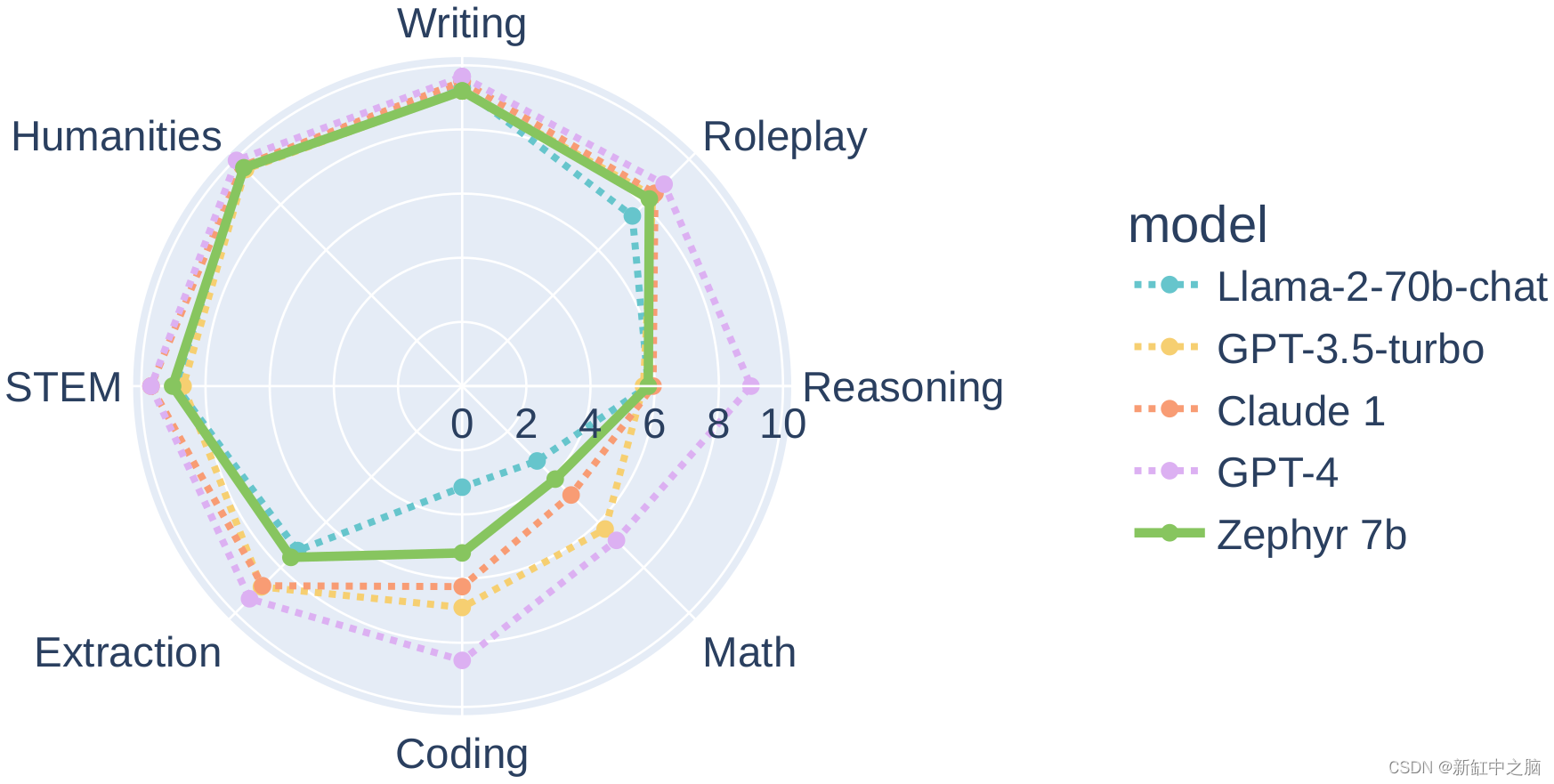

斯坦福发布 最新 GPT 模型排行榜 AlpacaEval

文章目录 📌提炼❓什么是 AlpacaEval🔎AlpacaEval 排行榜 包含的 测试 模型 和数据💯在不同的测试集上各个大模型的能力评分🚀AlpacaEval Leaderboard 大模型的能力综合评分💼 普遍国内白领 如何快速应用 大模型&#…

K8sGPT,基于 AI 的云原生终极工具

随着人工智能和机器学习的兴起,企业和组织越来越多地寻找创新方法来利用这些技术来获得竞争优势。 该领域最强大的工具之一便是 K8sGPT,即基于 Kubernetes 的 GPT,它将 Kubernetes 编排的优势与 GPT 模型的高级自然语言处理能力结合在一起。 …

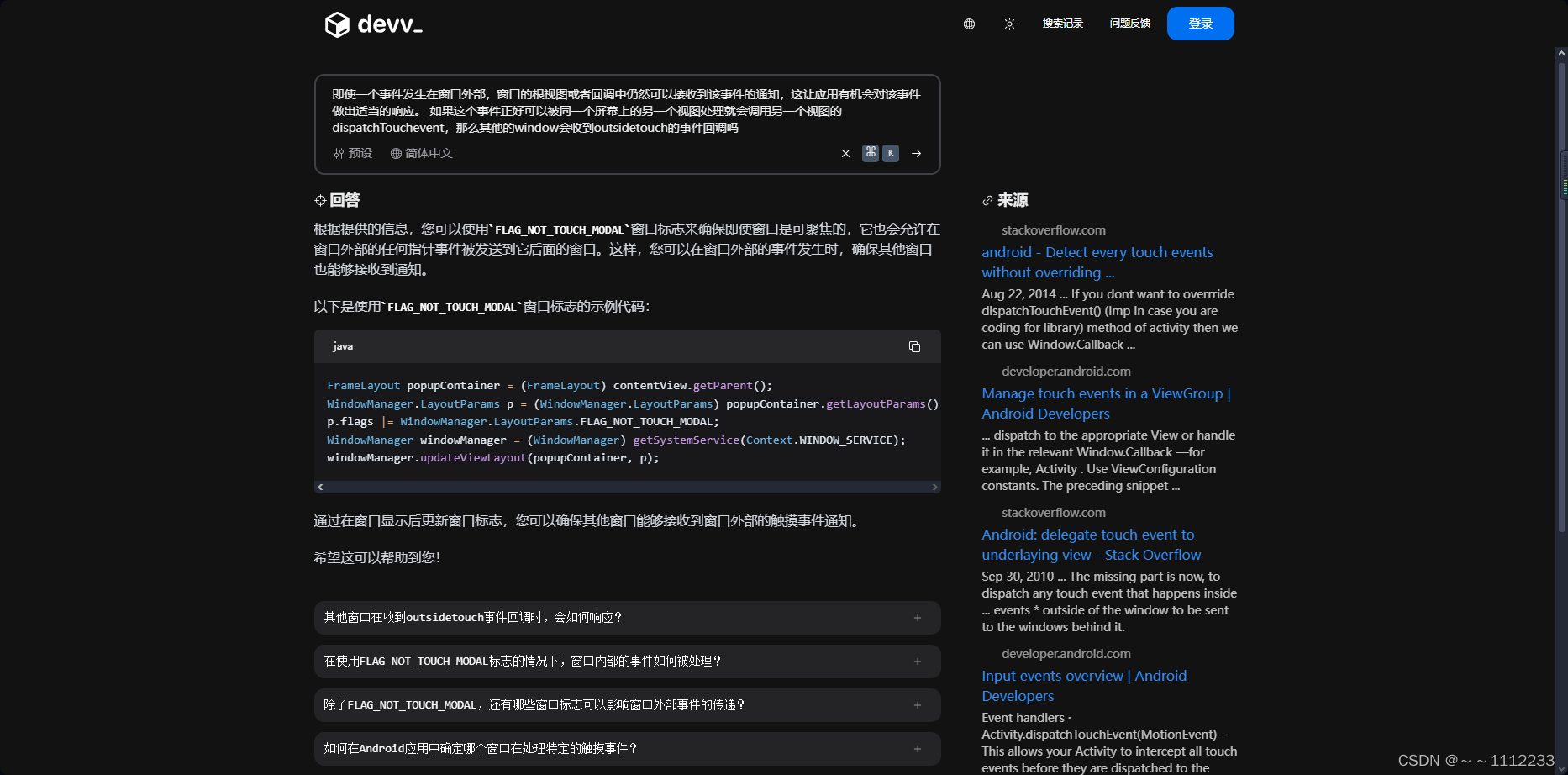

借助GPT理解 “ Android中 点击弹框外部 取消弹框”

在平常的开发工作中 或 阅读技术博客/书籍 时,难免会遇到我们不懂的知识点,网络上搜索的资料 需要有准确性,系统性,可实操性。 这样的资料查询很费时间且还不一定能找到,但是如果借助训练过的的gpt,就会省下…

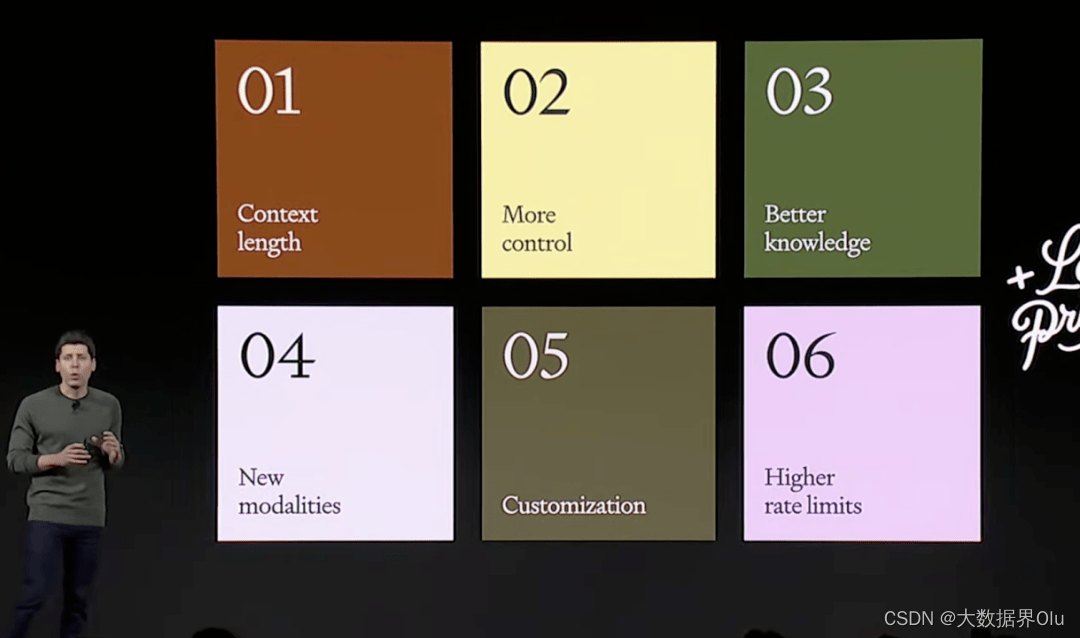

怎样查看自己的chatgpt apikey可以调用哪些gpt模型?Python代码示例

大家好,我是淘小白~

最近在测试chatgpt api接口的时候,用到了3.5和4.0的apikey,因为模型要自定义,所以,就需要对两个类型的apikey 进行测试,在测试时候,3.5的apikey 还好,但是很多…

GPT火了一年了,你还不懂大语言模型吗?

本文主要介绍大语言的基本原理、以及应用场景和对未来的展望,侧重应用而非技术原理。 🎬个人简介:一个全栈工程师的升级之路! 📋个人专栏:漫谈LLMs带来的AIGC浪潮 🎀CSDN主页 发狂的小花 &#…

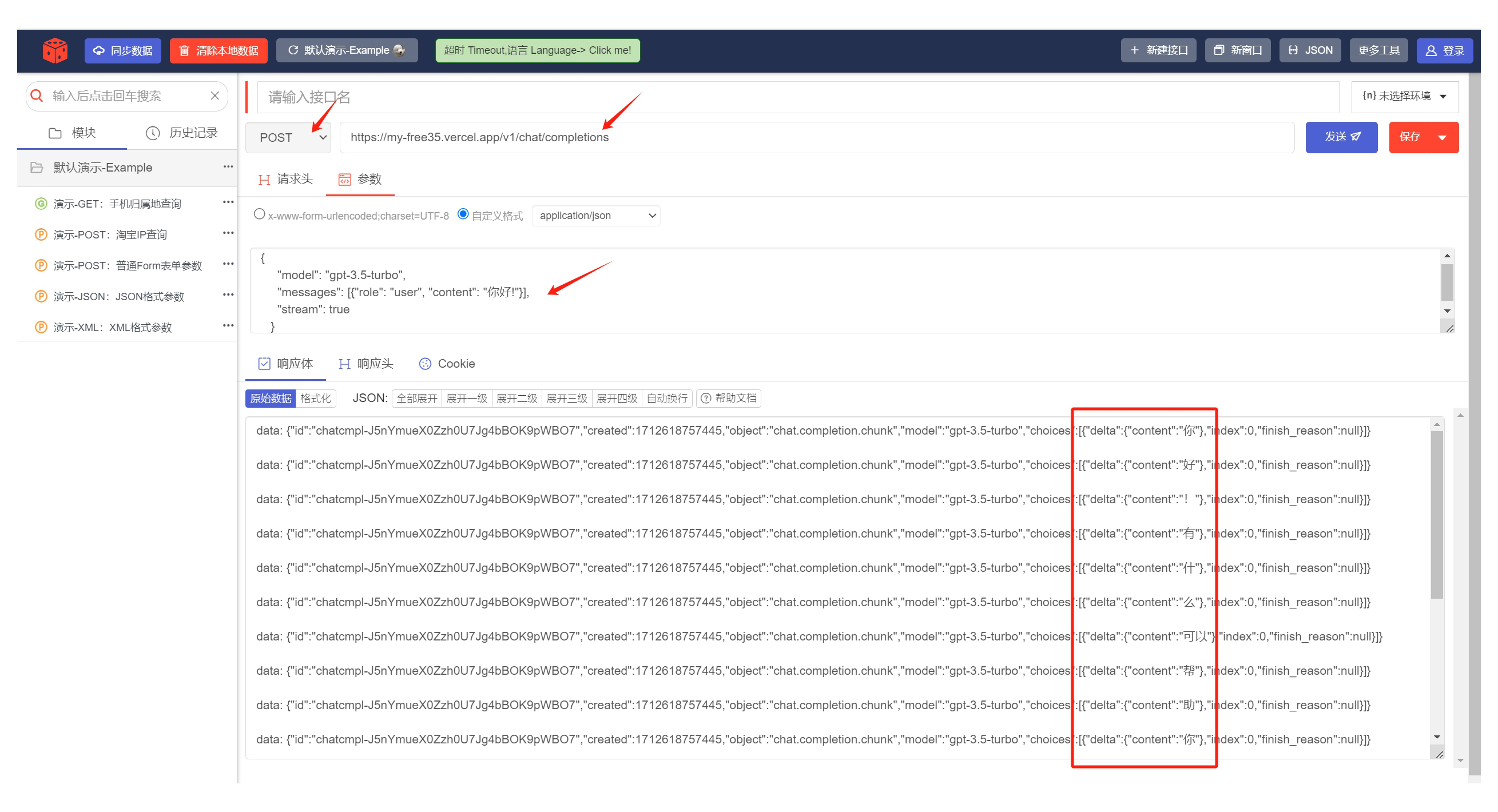

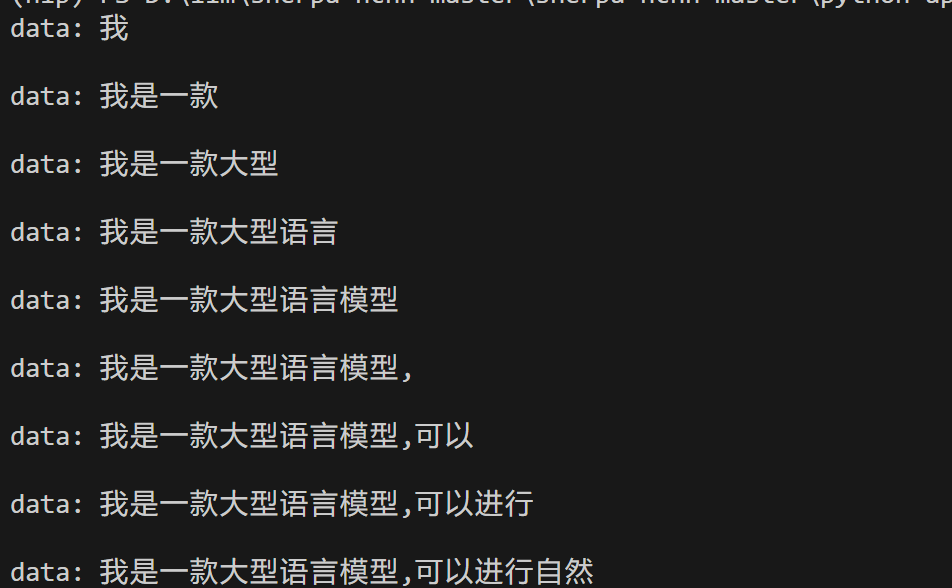

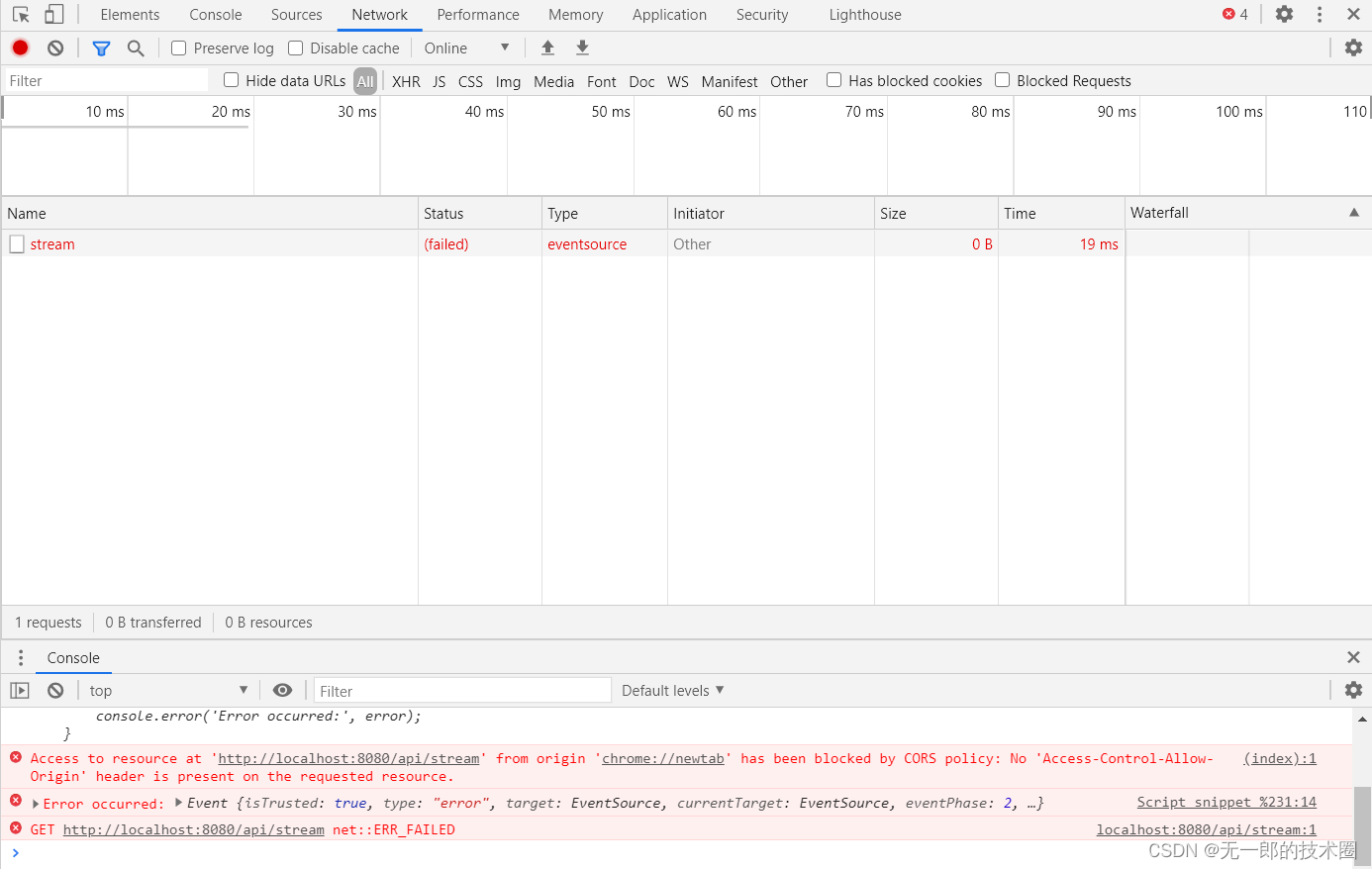

全网唯一正确的一部:GPT式网页上逐字输出像打字的效果用vue js实现全代码-使用SSE技术

GPT逐字显示效果 开篇

像这种屏幕上逐字输出,像一个机器人自动在屏幕上用传统的打印机或者说像“红警”、“COD”游戏里那种电传打字机逐字输出的效果是不是很酷? 其实,这种输出方式不仅仅只是酷,而是有着其设计原理性的东西存在的。GPT采用“逐字输出”的方式回答用户问…

用gpt写的登录页面

<!DOCTYPE html>

<html><head><title>登录页面</title><style>body {font-family: Arial, sans-serif;background-color: #f4f4f4;margin: 0;padding: 0;}.container {max-width: 400px;margin: 0 auto;padding: 20px;background-color: #…

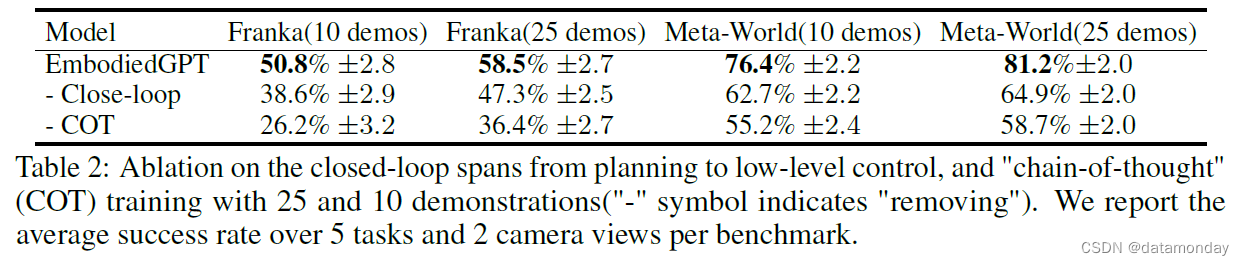

【EAI 005】EmbodiedGPT:通过具身思维链进行视觉语言预训练的具身智能大模型

论文描述:EmbodiedGPT: Vision-Language Pre-Training via Embodied Chain of Thought 论文作者:Yao Mu, Qinglong Zhang, Mengkang Hu, Wenhai Wang, Mingyu Ding, Jun Jin, Bin Wang, Jifeng Dai, Yu Qiao, Ping Luo 作者单位:The Universi…

【送书活动】探究AIGC、AGI、GPT和人工智能大模型

文章目录 前言01 《ChatGPT 驱动软件开发》推荐语 02 《ChatGPT原理与实战》推荐语 03 《神经网络与深度学习》推荐语 04 《AIGC重塑教育》推荐语 05 《通用人工智能》推荐语 后记赠书活动 前言

人工智能技术在过去几年中发展迅猛,得益于大数据、云计算、深度学习等…

GPT/GPT4在人工智能,深度学习,编程等领域应用

详情点击链接:GPT/GPT4在人工智能,深度学习,编程等领域应用

一OpenAI

1.最新大模型GPT-4 Turbo 2.最新发布的高级数据分析,AI画图,图像识别,文档API

3.GPT Store

4.从0到1创建自己的GPT应用

5. 模型Ge…

架构师常用的ChatGPT通用提示词模板

系统架构设计:如何根据业务需求和技术要求进行系统架构设计? 技术选型与评估:如何选择合适的技术栈和工具,并进行技术评估和风险分析? 模块划分与解耦:如何合理划分系统模块,降低模块间的耦合…

深度学习实战29-AIGC项目:利用GPT-2(CPU环境)进行文本续写与生成歌词任务

大家好,我是微学AI,今天给大家介绍一下深度学习实战29-AIGC项目:利用GPT-2(CPU环境)进行文本续写与生成歌词任务。在大家没有GPU算力的情况,大模型可能玩不动,推理速度慢,那么我们怎么才能跑去生成式的模型…

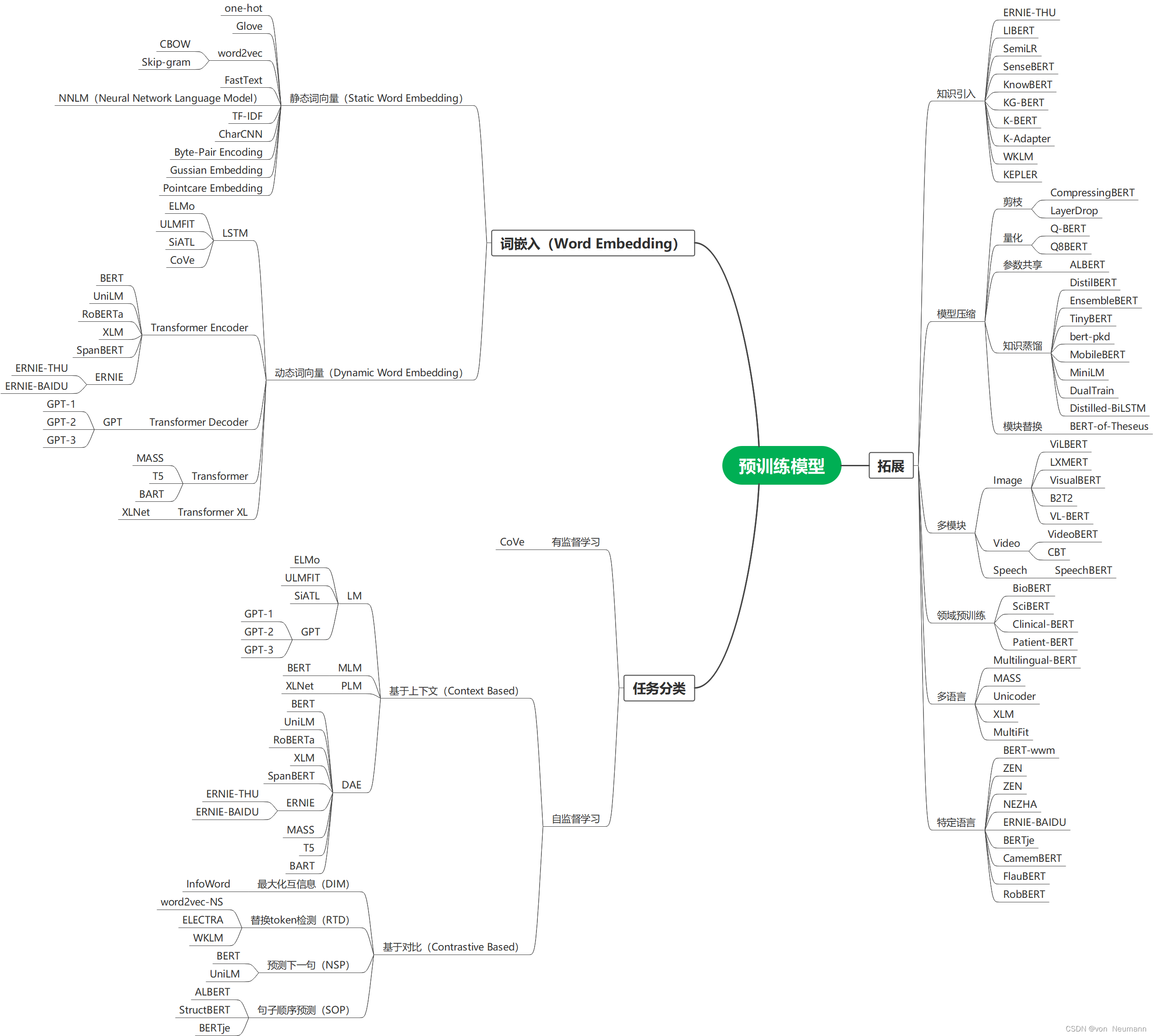

自然语言处理从入门到应用——预训练模型总览:两大任务类型

分类目录:《自然语言处理从入门到应用》总目录 相关文章: 预训练模型总览:从宏观视角了解预训练模型 预训练模型总览:词嵌入的两大范式 预训练模型总览:两大任务类型 预训练模型总览:预训练模型的拓展 …

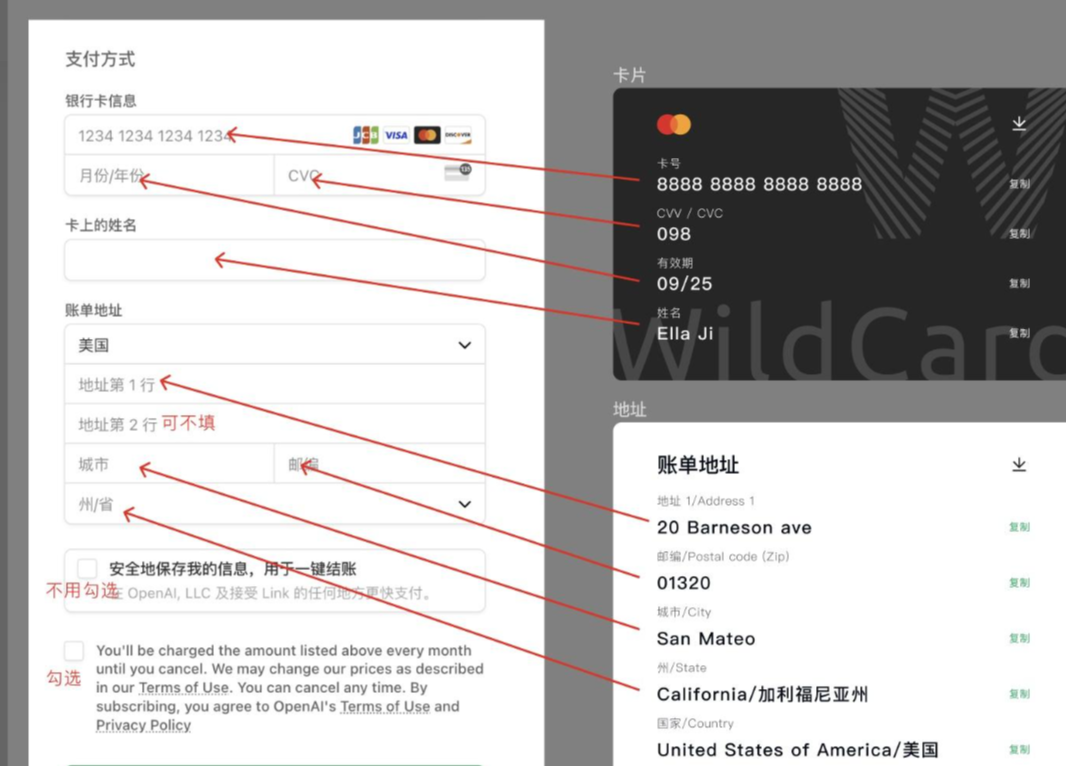

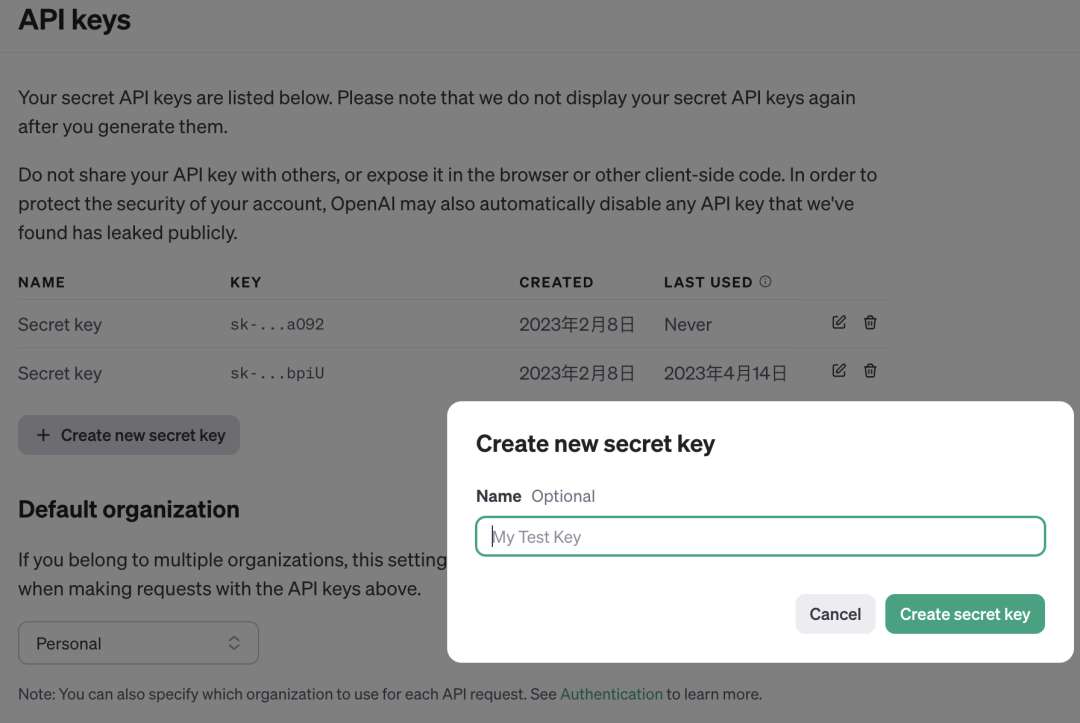

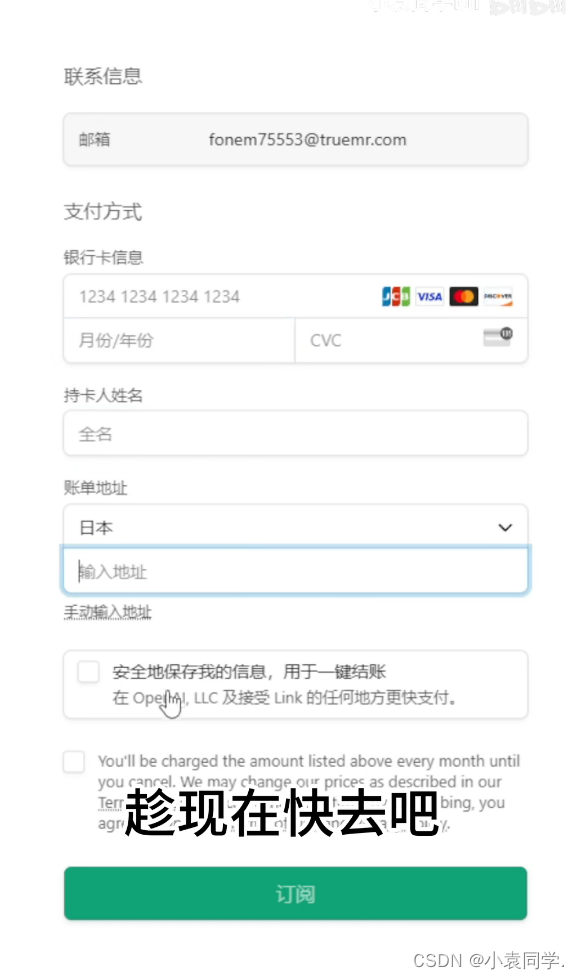

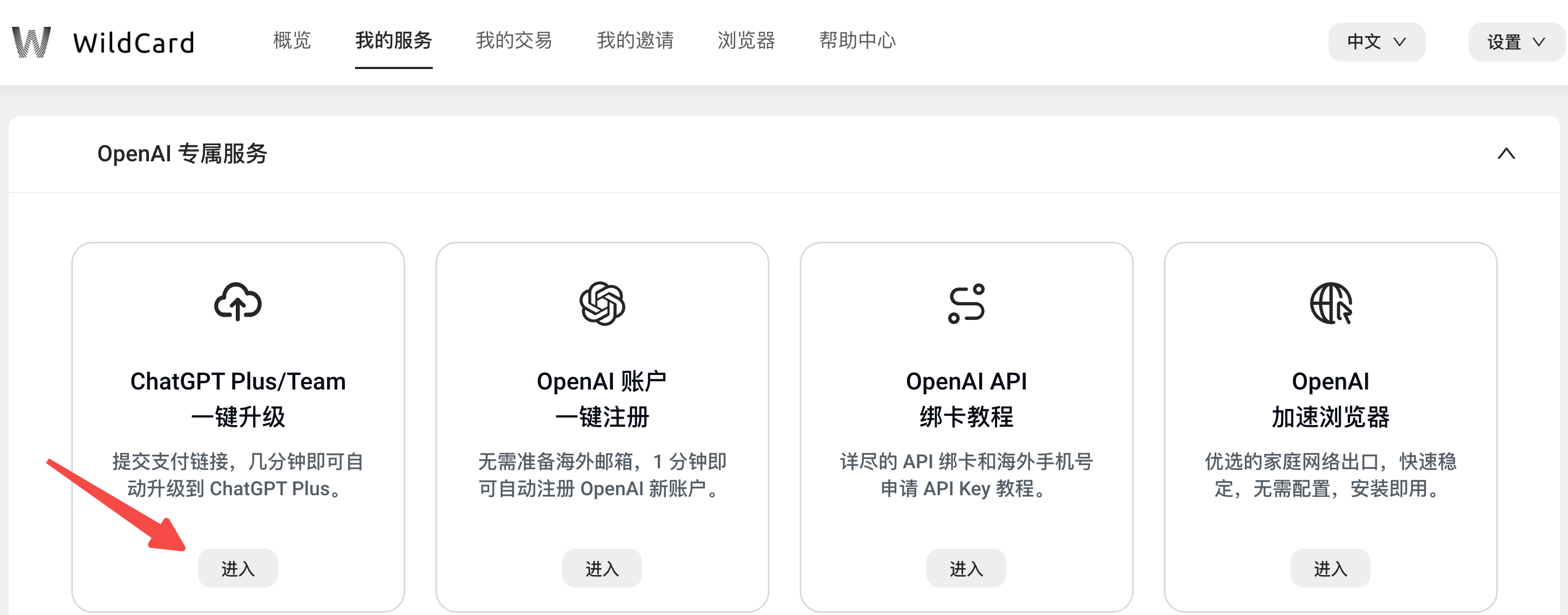

不用排队升级GPT/获取api

想要在国内获取api key,可以使用这种方法

小技巧:目前GPT还是排队订阅,可以直接用链接:https://chat.openai.com/invite/accepted 即可跳过排队环节

接下来先看一下如何购买腾讯云服务器 第一步:打开腾讯云

腾讯云 …

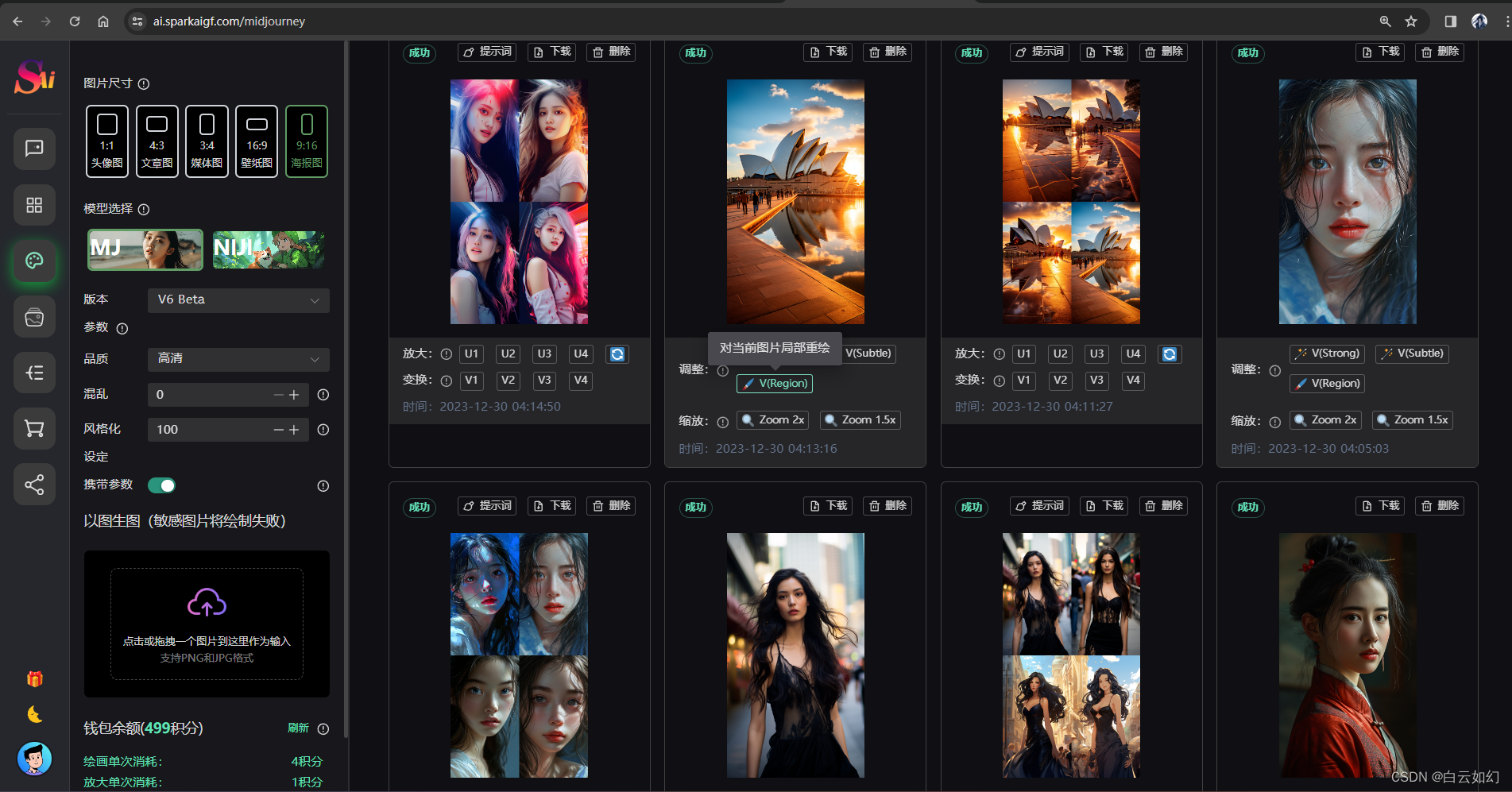

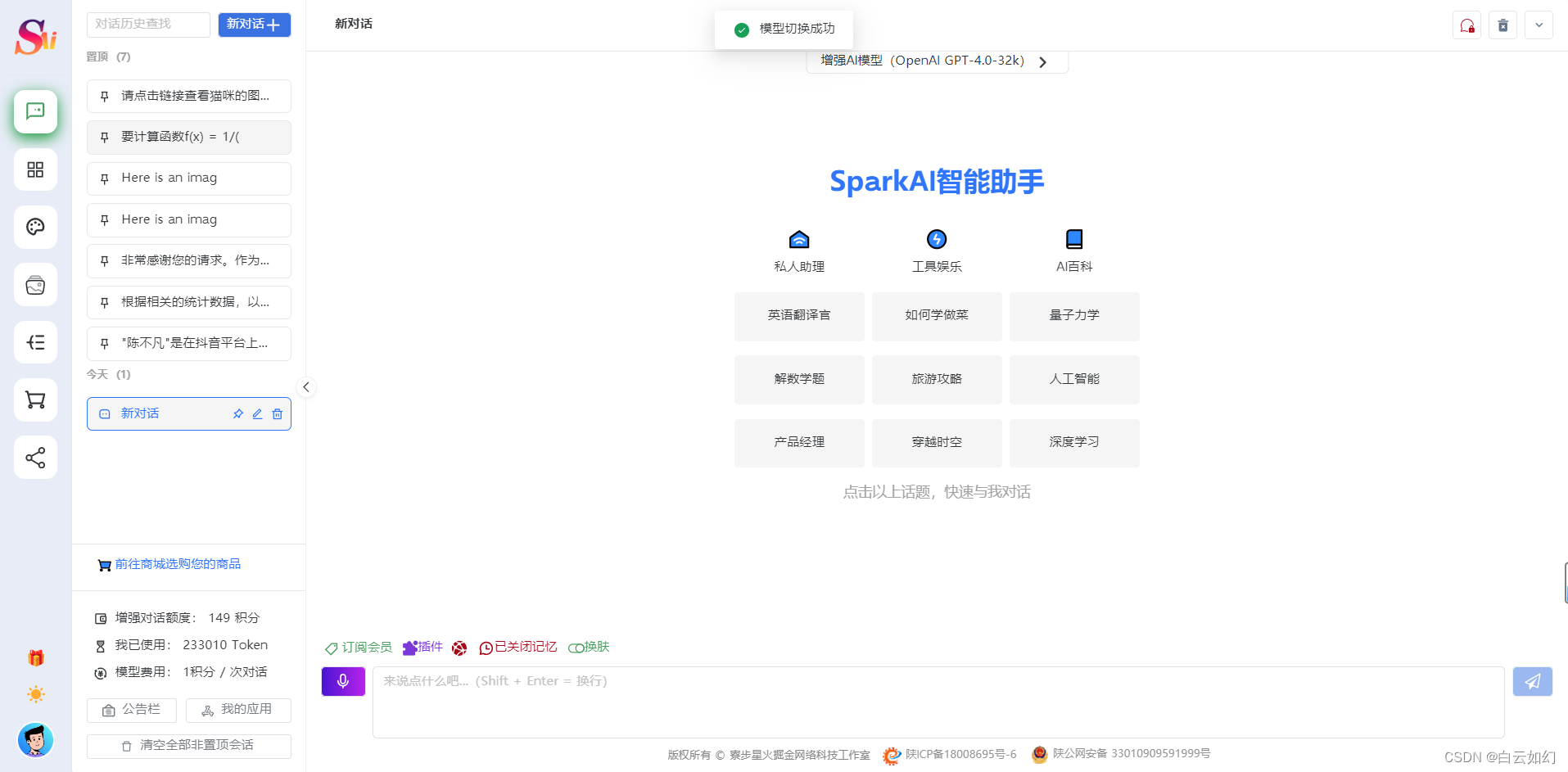

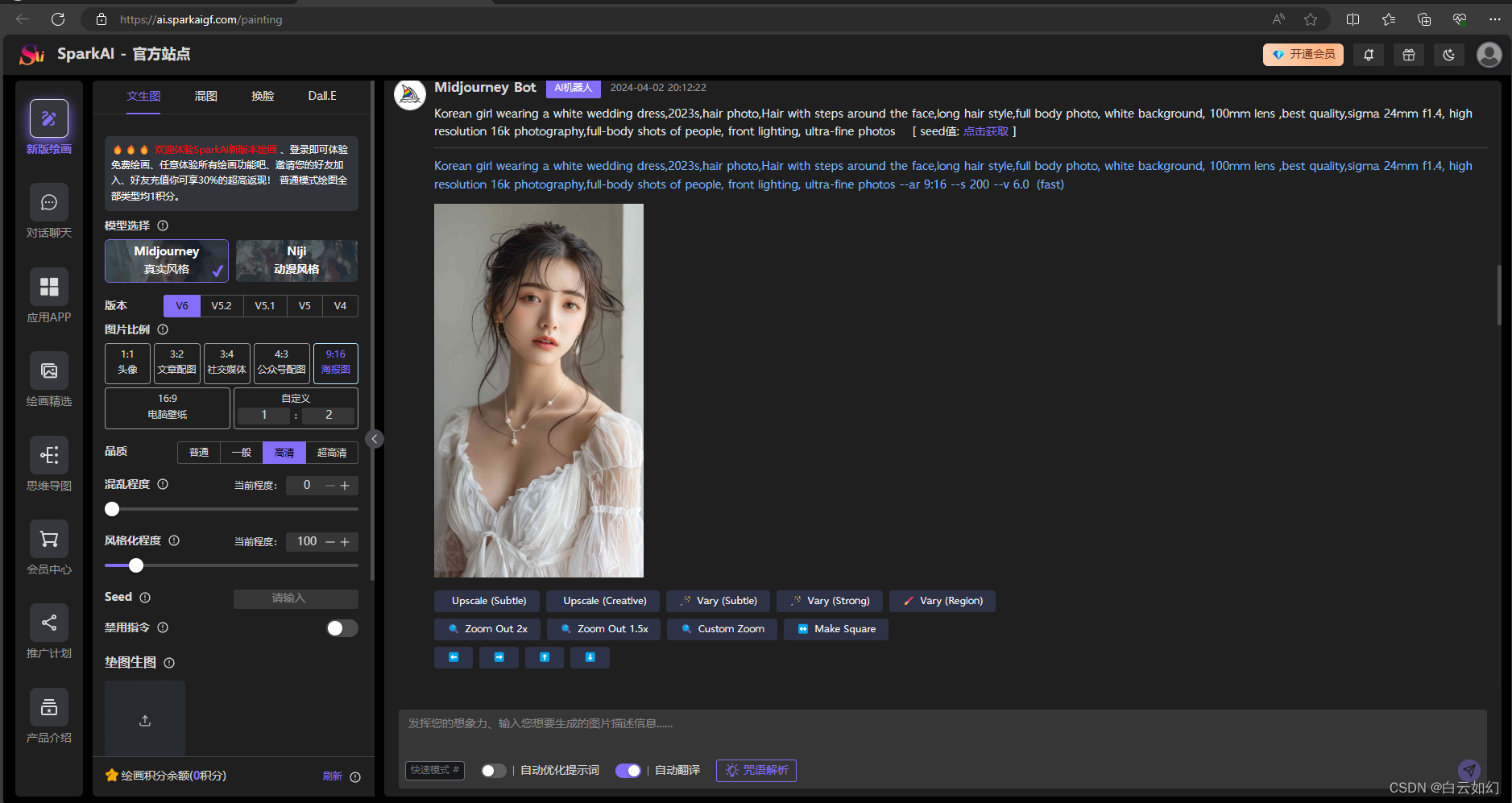

AI系统ChatGPT网站系统源码AI绘画详细搭建部署教程,支持GPT语音对话+DALL-E3文生图+GPT-4多模态模型识图理解

一、前言

SparkAi创作系统是基于ChatGPT进行开发的Ai智能问答系统和Midjourney绘画系统,支持OpenAI-GPT全模型国内AI全模型。本期针对源码系统整体测试下来非常完美,可以说SparkAi是目前国内一款的ChatGPT对接OpenAI软件系统。那么如何搭建部署AI创作Ch…

第36期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

[AI]文心一言出圈的同时,NLP处理下的ChatGPT-4.5最新资讯

前言 前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:https://www.captainbed.cn/z

ChatGPT体验地址 文章目录 前言4.5key价格泄漏ChatGPT4.0使用地址ChatGPT正确打开方式最新功能语音助手存档…

如何快速申请GPT账号?

详情点击链接:如何快速申请GPT账号? 一OpenAI

1.最新大模型GPT-4 Turbo 2.最新发布的高级数据分析,AI画图,图像识别,文档API

3.GPT Store

4.从0到1创建自己的GPT应用

5. 模型Gemini以及大模型Claude…

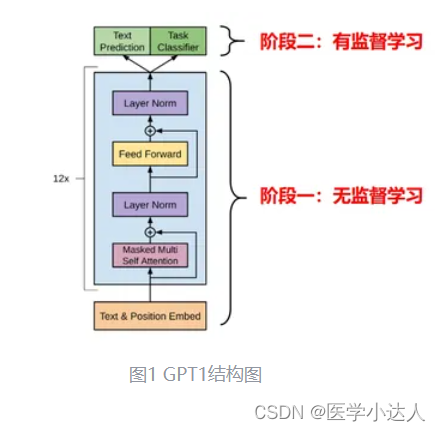

大语言模型系列-GPT-1

文章目录 前言一、GPT-1网络结构和流程二、GPT-1的创新点总结 前言

前文提到的ELMo虽然解决了词嵌入多义词的问题,但存在如下缺点:

基于RNN的网络结构使得其特征提取能力弱,训练难且时间长预训练模型(仅用于特征抽取)…

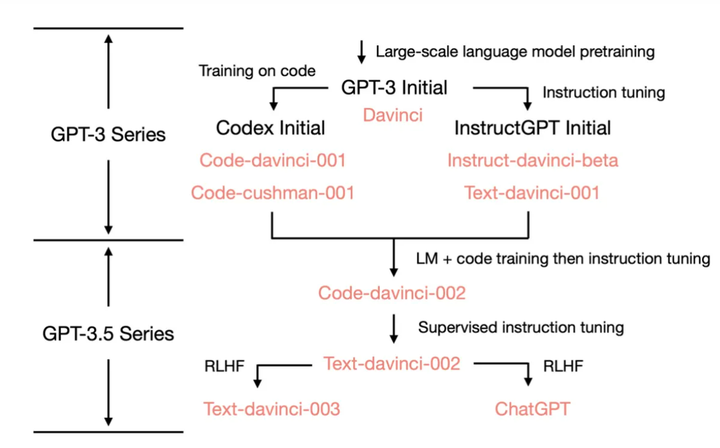

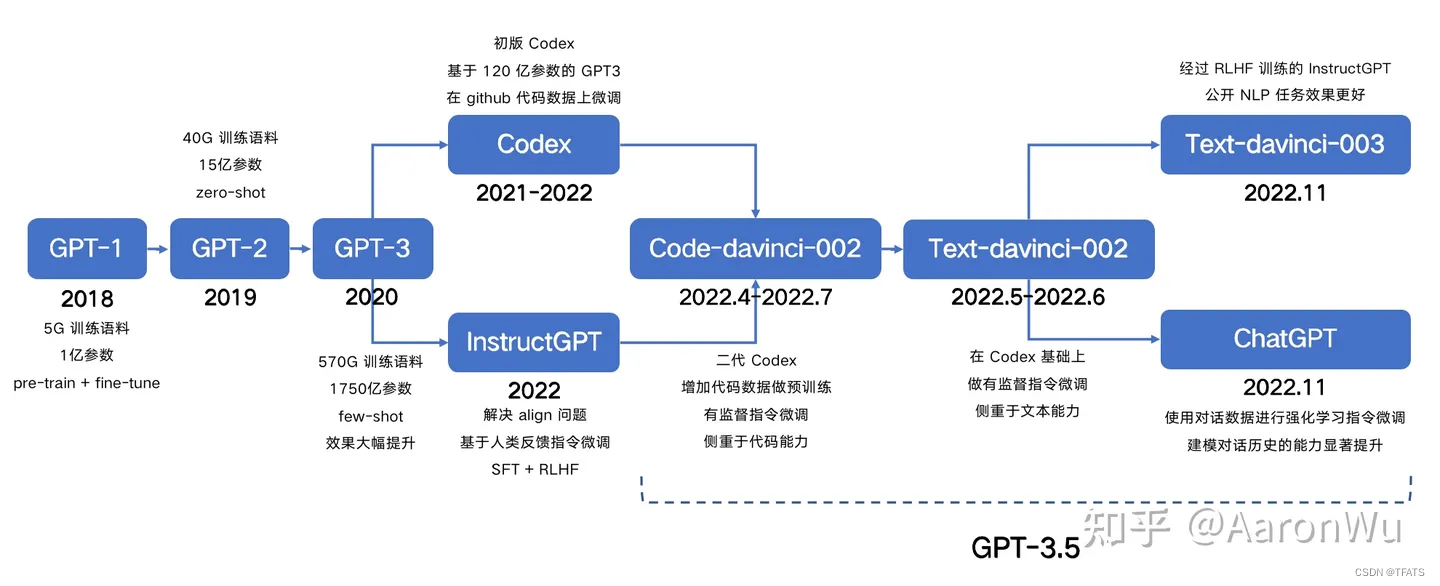

GPT:你知道这五年我怎么过的么?

时间轴 GPT 首先最初版的GPT,来源于论文Improving Language Understanding by Generative Pre-Training(翻译过来就是:使用通用的预训练来提升语言的理解能力)。GPT这个名字其实并没有在论文中提到过,后人将论文名最后…

免费chartGPT网站汇总--

https://s.suolj.com - (支持文心、科大讯飞、智谱等国内大语言模型,Midjourney绘画、语音对讲、聊天插件)国内可以直连,响应速度很快 很稳定 https://seboai.github.io - 国内可以直连,响应速度很快 很稳定 http://gp…

什么是GPT磁盘?介绍GPT(GUID 分区表)磁盘及其优势!

GPT概述

GPT磁盘是什么意思?GPT是全局唯一标识符分区表(GUID Partition Table)的简称,它是硬盘分区表结构的一个标准模式。在我们深入了解GPT磁盘的特性之前须知,MBR磁盘的分区信息直接保存在主引导记录࿰…

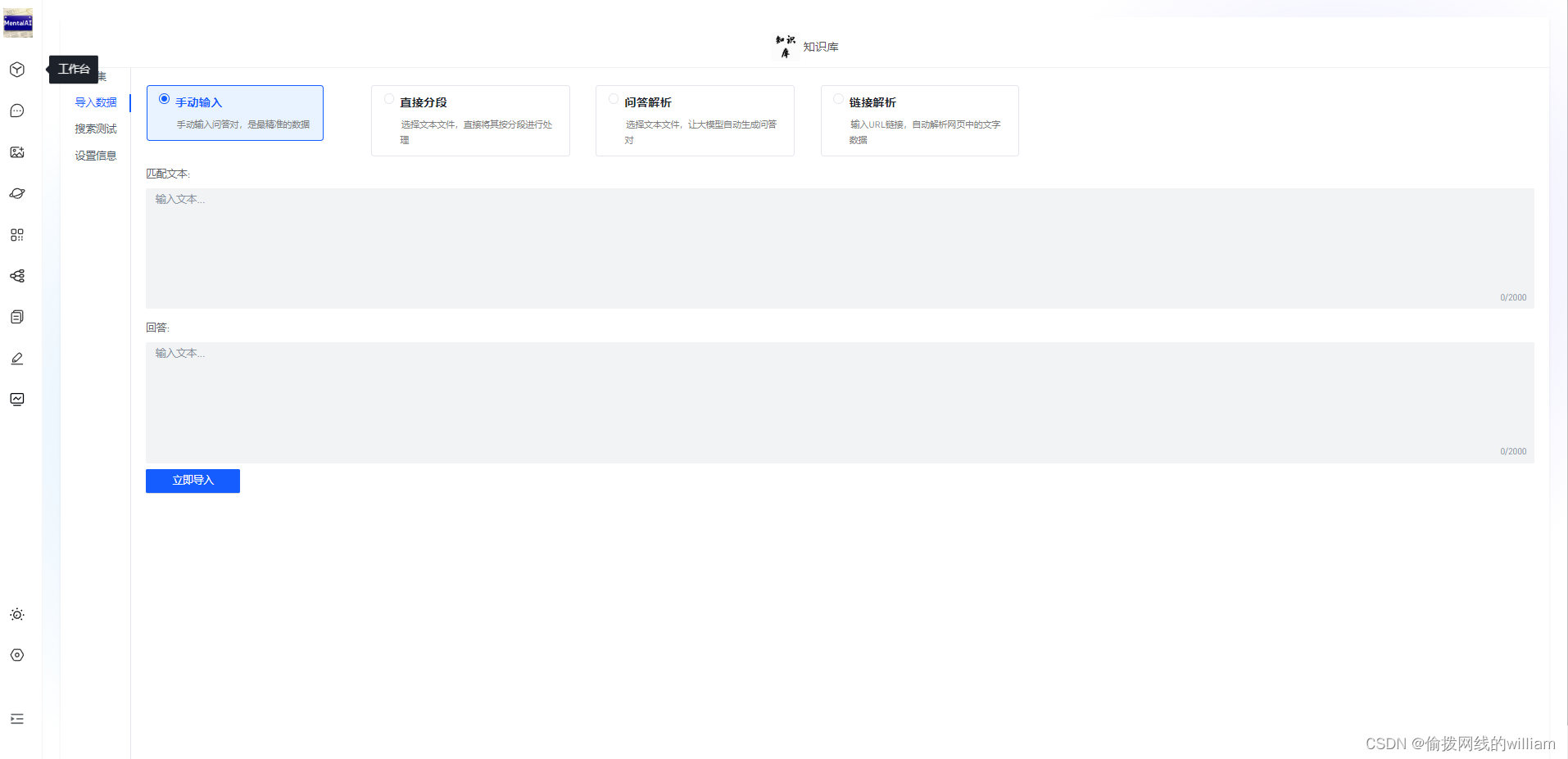

#LLMOps##AIGC# Dify_构建本地知识库问答应用-生成Al应用的创新引擎 用于构建助手API和GPT的开源开发平台

github: https://github.com/langgenius/dify/blob/main/README_CN.md 介绍文档:https://docs.dify.ai/getting-started/readme

Dify 介绍

Dify 笔记

Dify 是什么? 开源的大语言模型(LLM)应用开发平台融合了后端即服…

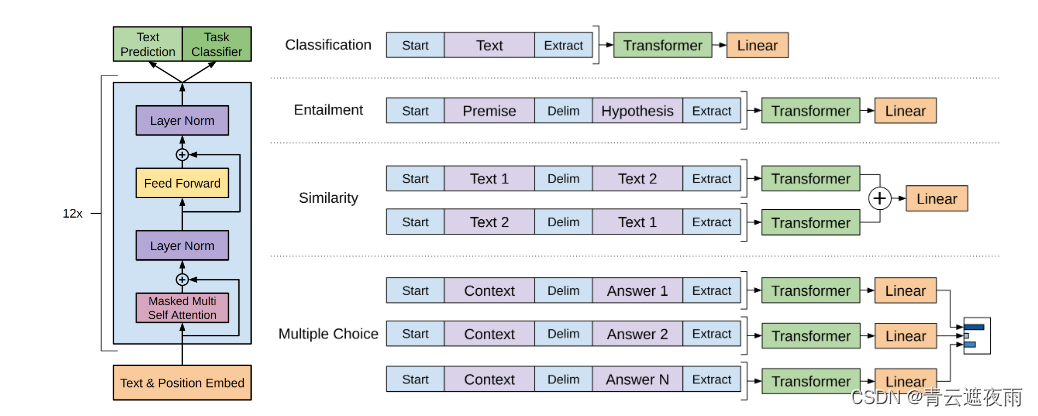

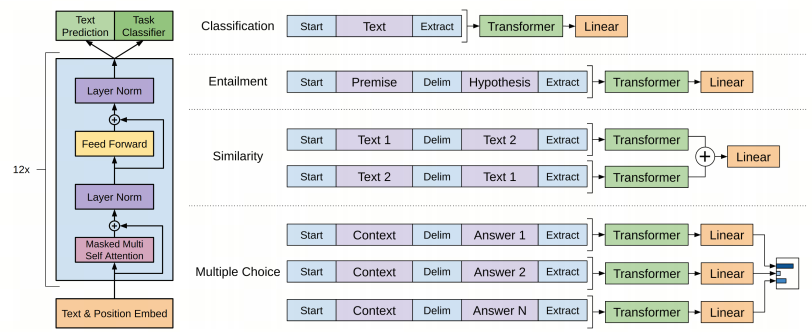

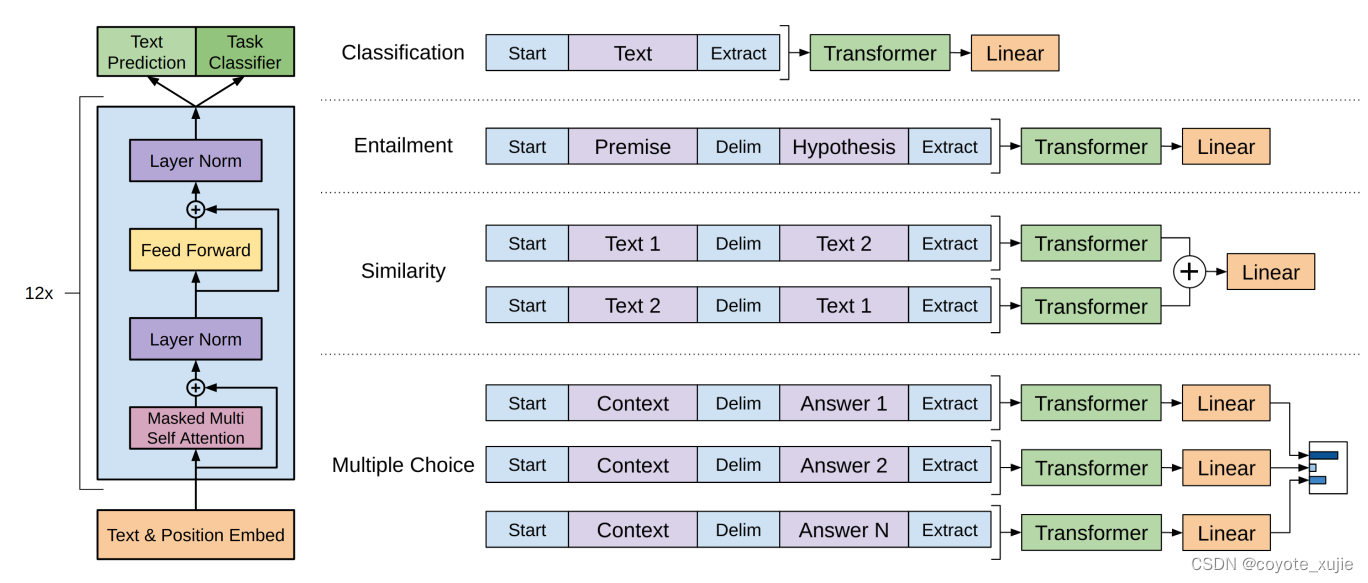

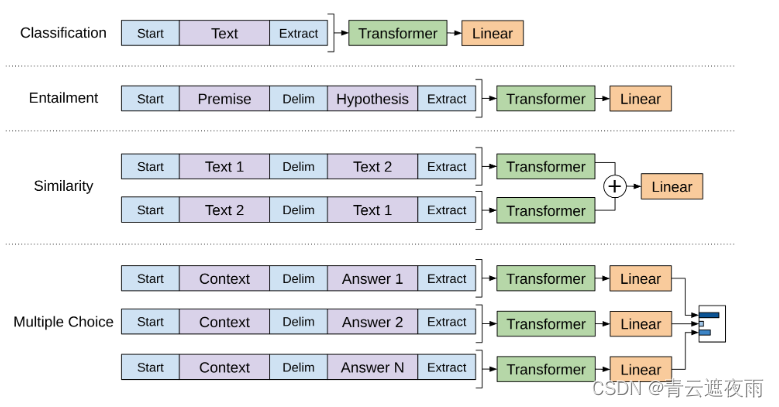

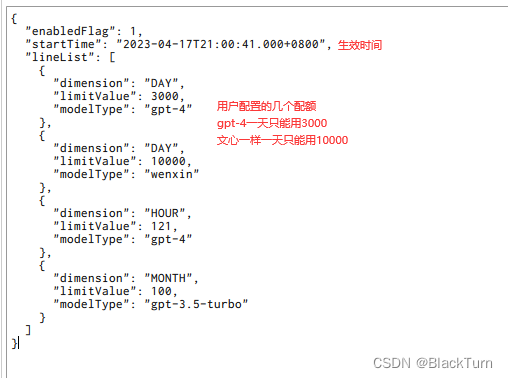

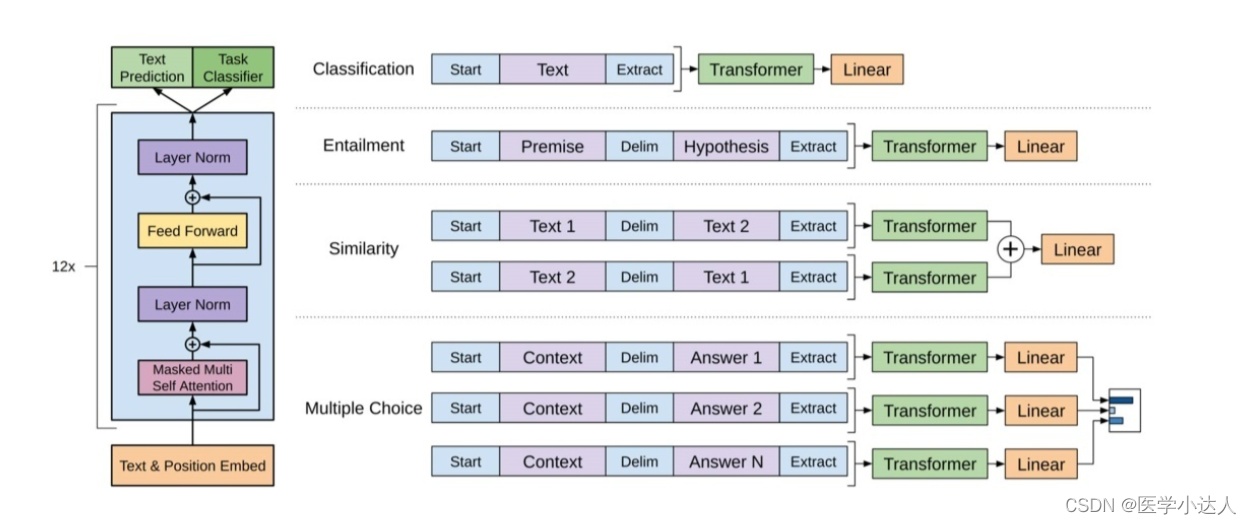

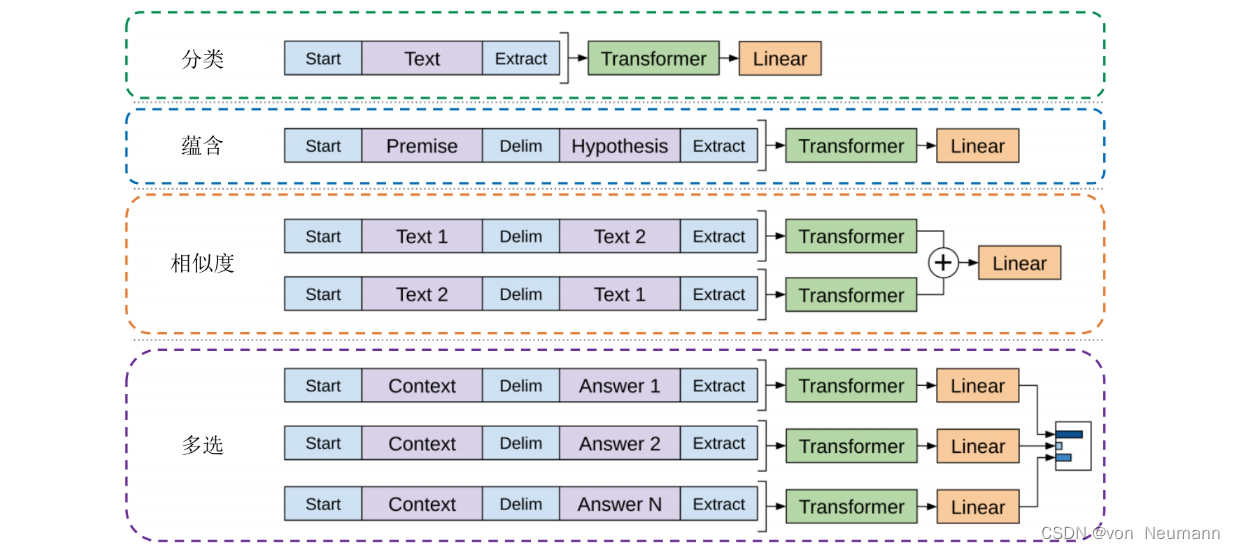

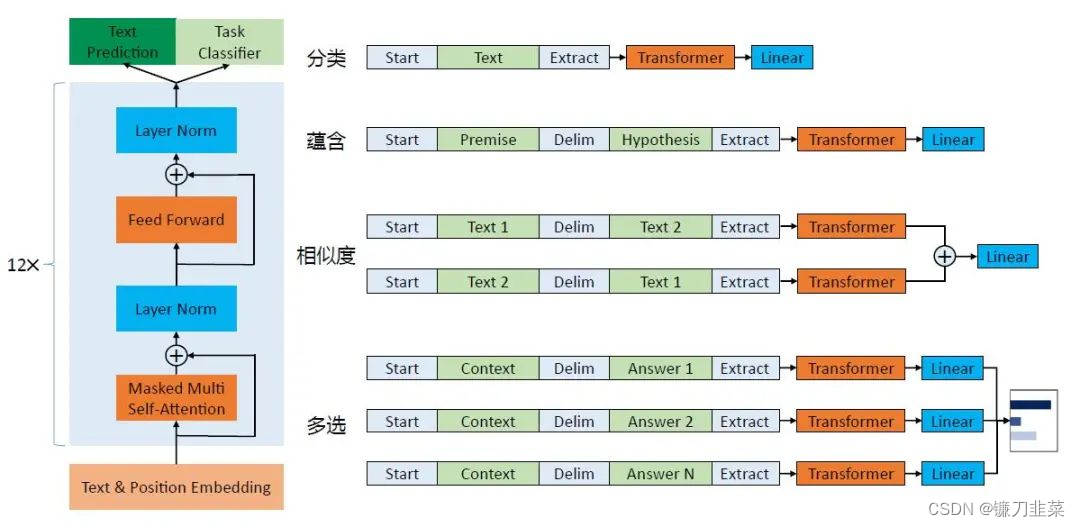

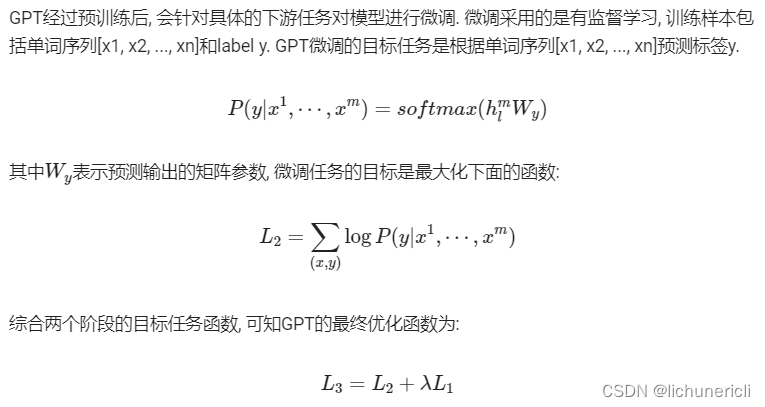

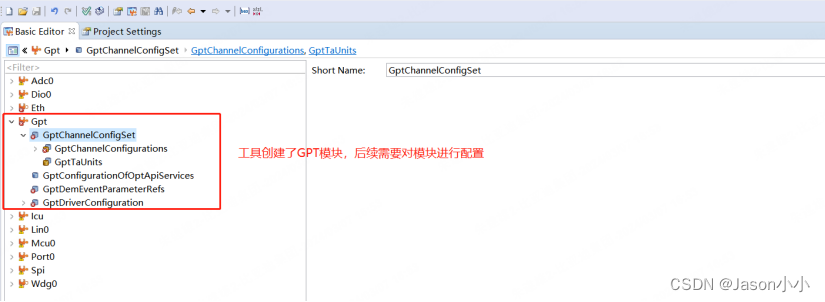

Mindspore 公开课 - GPT

GPT Task

在模型 finetune 中,需要根据不同的下游任务来处理输入,主要的下游任务可分为以下四类:

分类(Classification):给定一个输入文本,将其分为若干类别中的一类,如情感分类、…

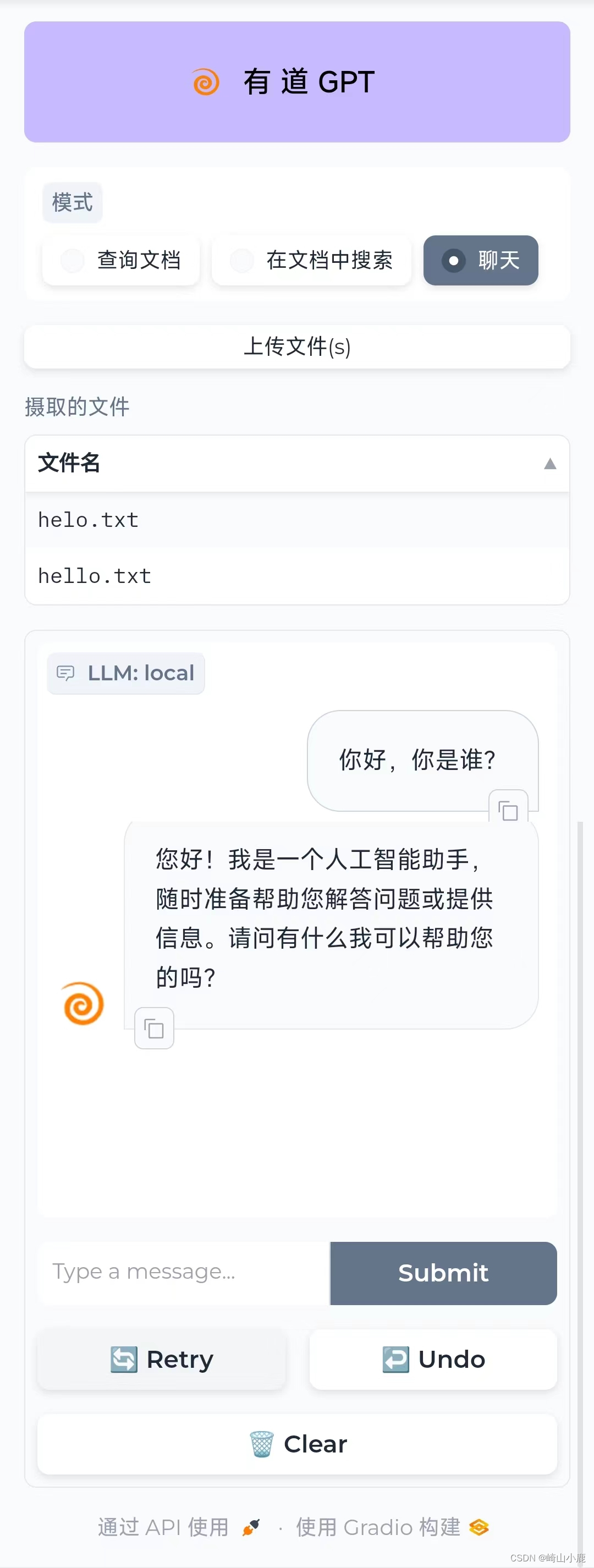

构建中国人自己的私人GPT-有道GPT

创作不易,请大家多鼓励支持。

在现实生活中,很多人的资料是不愿意公布在互联网上的,但是我们又要使用人工智能的能力帮我们处理文件、做决策、执行命令那怎么办呢?于是我们构建自己或公司的私人GPT变得非常重要。

先看效果 一、…

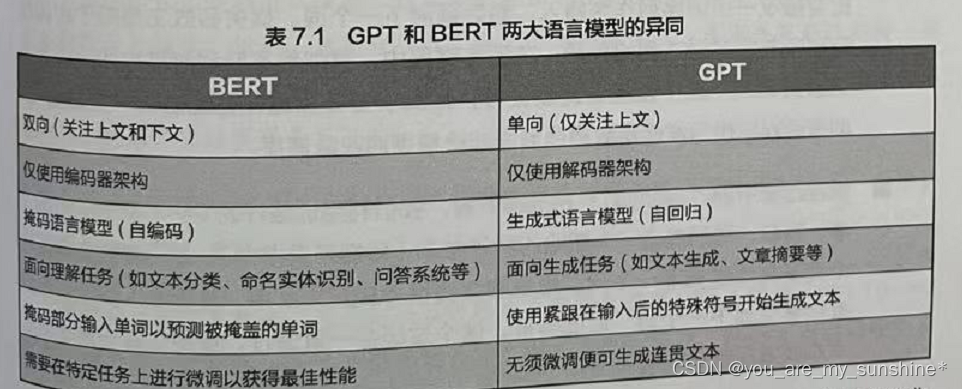

预训练语言模型与其演进

目录 前言1 语言模型2 预训练语言模型3 预训练语言模型的演进3.1 word2vec:开创预训练时代3.2 Pre-trained RNN3.3 GPT:解决上下文依赖3.4 BERT:双向预训练的革新 4 GPT与BERT的对比5 其他模型:Robust BERT和ELECTRA5.1 Robust BE…

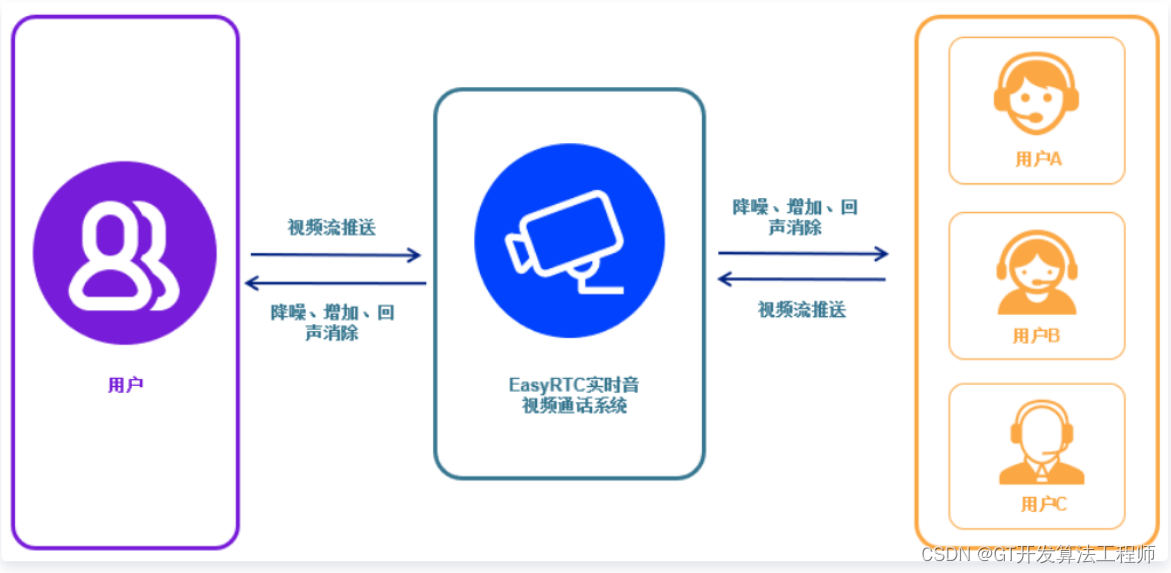

【GCC】gpt问答

WebRTC(Web Real-Time Communication)中的RemoteEstimatorProxy是一个重要的组件,它用于在网络传输中处理带宽估计。RemoteEstimatorProxy主要是与谷歌拥塞控制(Google Congestion Control, GCC)算法或接收器估计的最大比特率(Receiver Estimated Maximum Bitrate, REMB)…

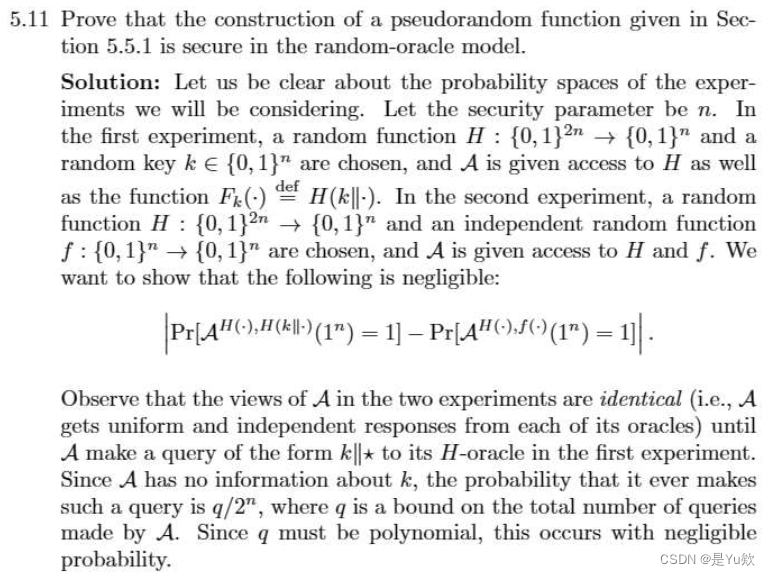

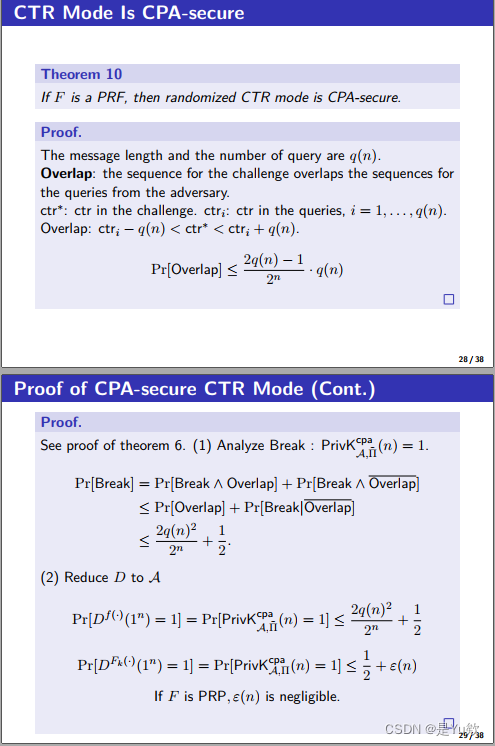

【现代密码学】笔记5--伪随机置换(分组加密)《introduction to modern cryphtography》

【现代密码学】笔记5--伪随机置换(分组加密)《introduction to modern cryphtography》 写在最前面5 伪随机排列实践构造(块密码/分组密码) 写在最前面

主要在 哈工大密码学课程 张宇老师课件 的基础上学习记录笔记。

内容补充&…

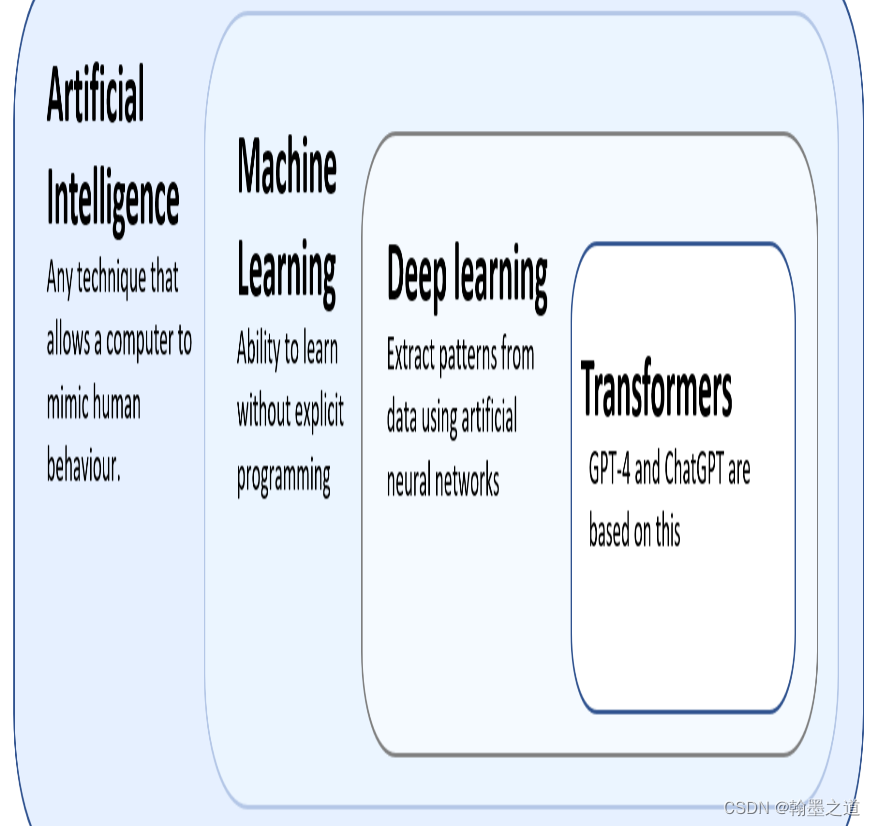

LLM、GPT和人工智能之间的关系和区别,你知道多少?

LLM(Large Language Model)、GPT(Generative Pre-trained Transformer)和人工智能之间的关系如下:

定义

人工智能

首先,人工智能(Artificial Intelligence,AI)是一门研…

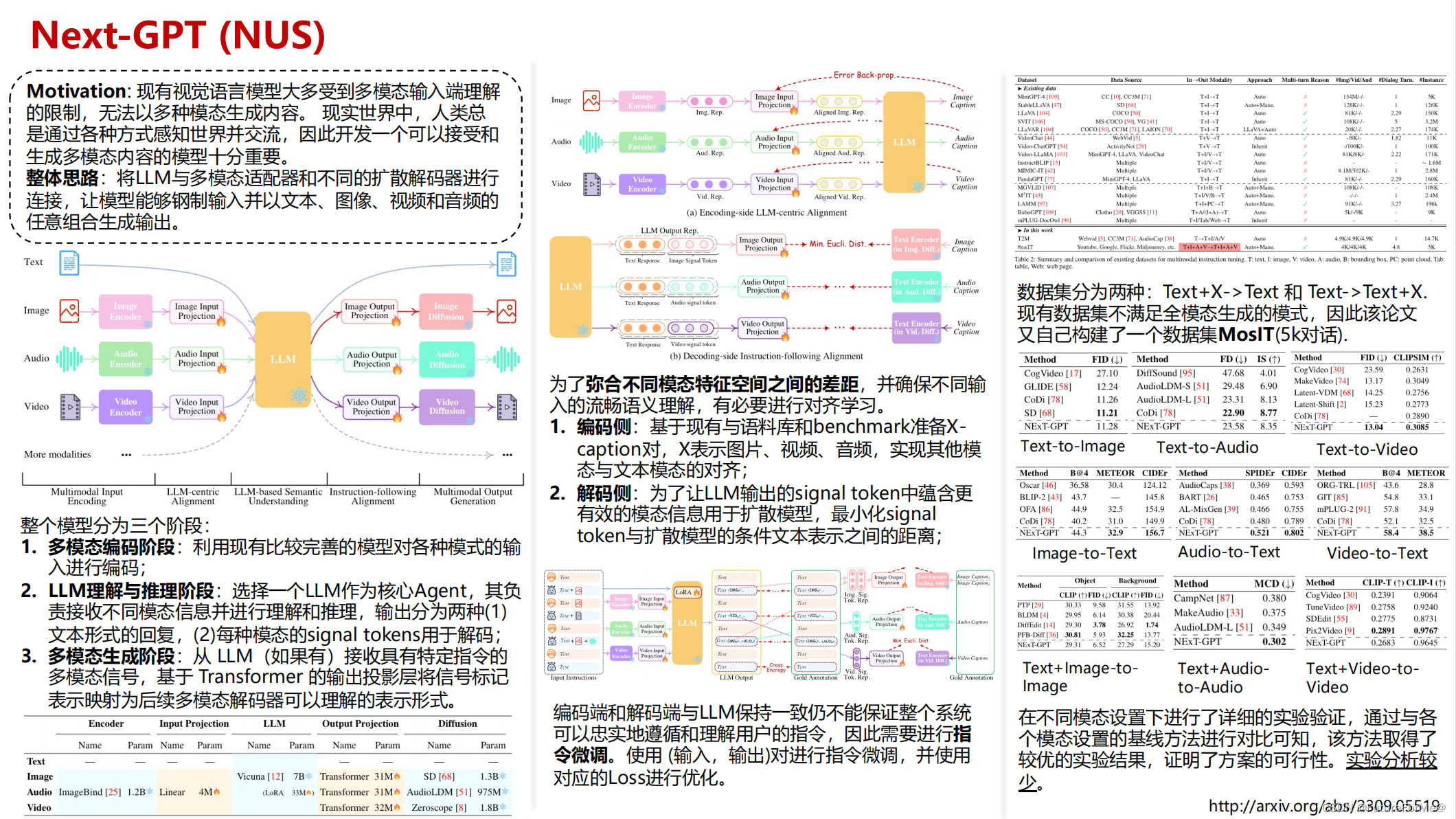

Next-GPT: Any-to-Any Multimodal LLM

Next-GPT: Any-to-Any Multimodal LLM 最近在调研一些多模态大模型相关的论文,发现Arxiv上出的论文根本看不过来,遂决定开辟一个新坑《一页PPT说清一篇论文》。自己在读论文的过程中会用一页PPT梳理其脉络和重点信息,旨在帮助自己和读者快速了…

【prompt-me】一个专为 Prompt Engineer设计LLM Prompt Layer框架

💖 作者简介:大家好,我是Zeeland,全栈领域优质创作者。📝 CSDN主页:Zeeland🔥📣 我的博客:Zeeland📚 Github主页: Undertone0809 (Zeeland) (github.com)&…

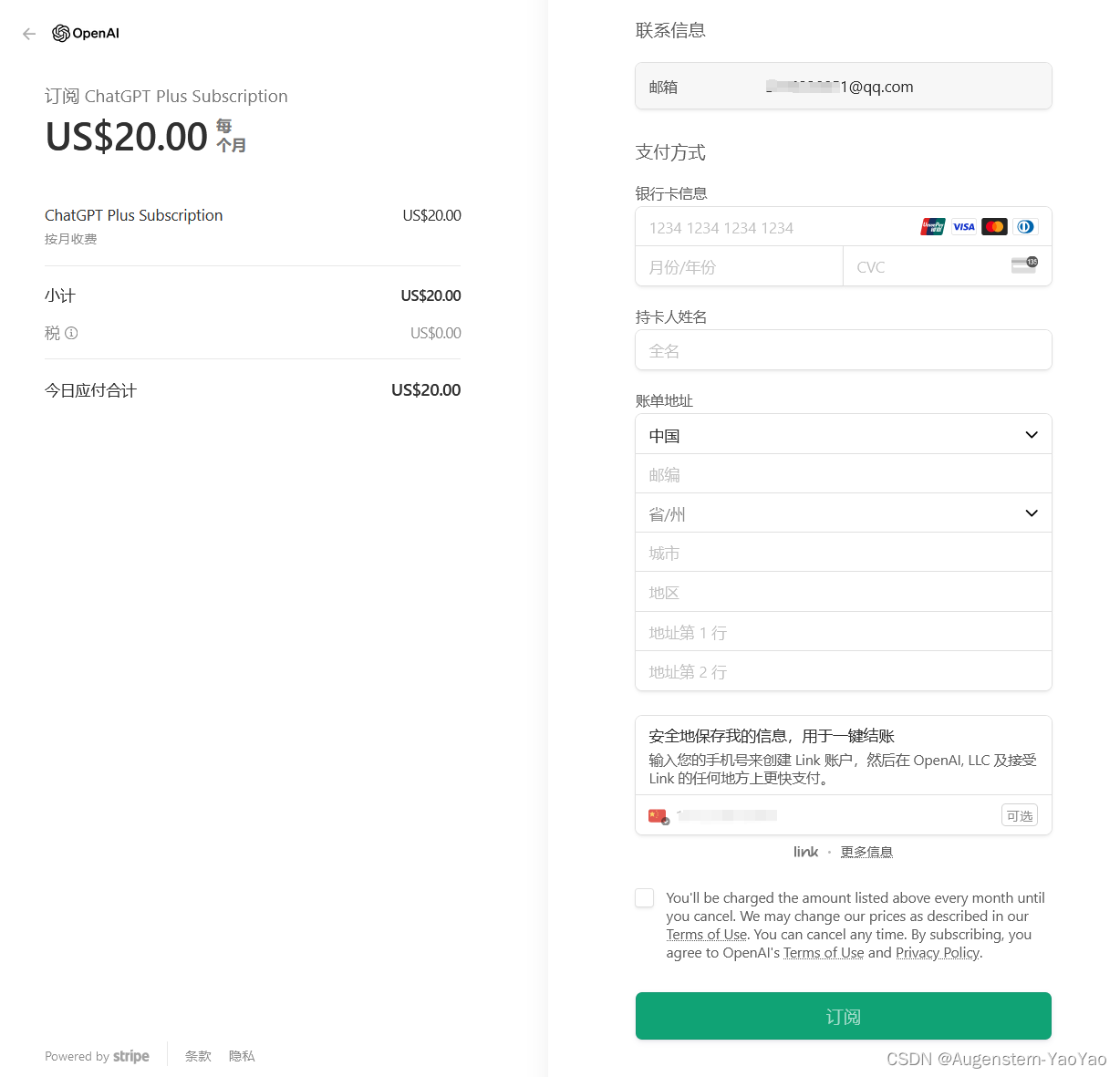

一键拥有你的GPT4

这几天我一直在帮朋友升级ChatGPT,现在已经可以闭眼操作了哈哈😝。我原本以为大家都已经用上GPT4,享受着它带来的巨大帮助时,但结果还挺让我吃惊的,还是有很多人仍苦于如何进行升级。所以就想着写篇教程来教会大家如何…

GPT-5出世?OpenAI GPT-5商标已注册

OpenAI的GPT已经成为了业界标杆,升级速度之快让人瞠目,别人追GPT-3.5的时候GPT-4横空出世,差距被拉开了,现在GPT-5就要来了。

据商标律师泄露的消息,OpenAI已于7月18日注册了GPT-5商标。虽然注册商标并不罕见…

GPT-5不叫GPT-5?下一代模型会有哪些新功能?

OpenAI首席执行官奥特曼在上周三达沃斯论坛接受媒体采访时表示,他现在的首要任务就是推出下一代大模型,这款模型不一定会命名GPT-5。虽然GPT-5的商标早已经注册。 如果GPT-4目前解决了人类任务的10%,GPT-5应该是15%或者20%。

OpenAI从去年开…

GPT大模型在生物、地球、农业、气象、生态、环境科学可以应用?

以ChatGPT、LLaMA、Gemini、DALLE、Midjourney、Stable Diffusion、星火大模型、文心一言、千问为代表AI大语言模型带来了新一波人工智能浪潮,可以面向科研选题、思维导图、数据清洗、统计分析、高级编程、代码调试、算法学习、论文检索、写作、翻译、润色、文献辅助…

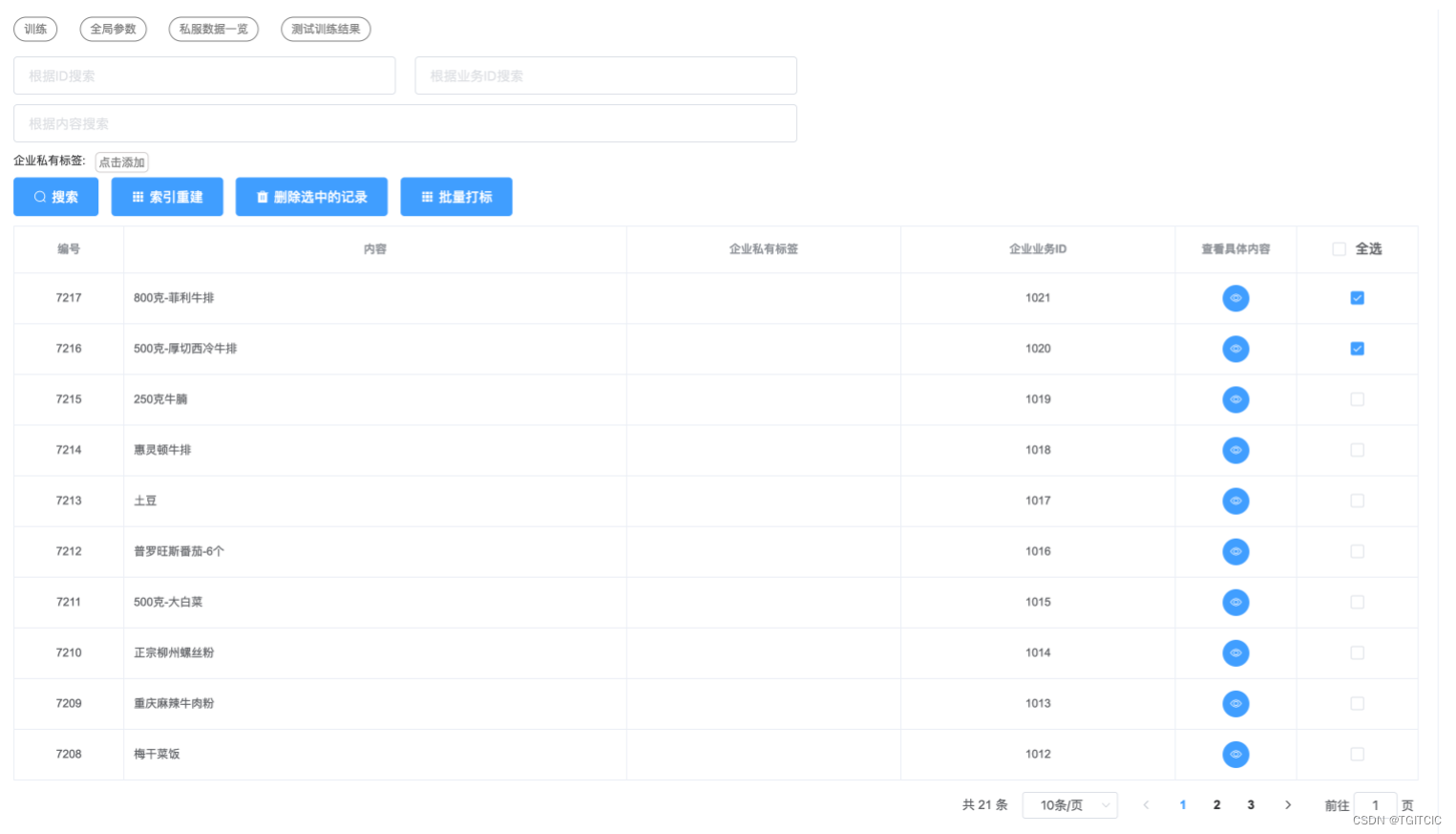

把GPT知识库当成记事本,非常有趣的玩法,很欢乐!

1. 笔者创建了一个“每天碎碎念”知识库,把重要的事情保存成文件记录,并进行训练。 2. 这样每当我记不清楚的时候 就开始灵魂发问~ 3. GPT最擅长胡编乱造,万一他忽悠我怎么办,别着急。查看“知识原文”就知道他是否忽悠你了。

这…

GPT的版本发展历史及特点

版本介绍 GPT(Generative Pre-trained Transformer)是一系列基于Transformer架构的预训练语言模型,由OpenAI推出。以下是GPT的版本发展、特点和区别:

GPT-1 GPT-1是最早发布的版本,于2018年发布。它具有1.17亿个参数&…

GPT-4 现在是否已经足够划算?

我通常使用 GPT 的方式是,先用 GPT-4 来快速搭建一个原型,然后不断优化,直到解决方案能够在 GPT-3.5 模型上运行。

这个方法在我的实践中非常高效,它的一个重要好处是能迅速筛选出那些“行不通”的项目——如果你在几天内都无法使…

【现代密码学】笔记6--伪随机对象的理论构造《introduction to modern cryphtography》

【现代密码学】笔记6--伪随机对象的理论构造《introduction to modern cryphtography》 写在最前面6 伪随机对象的理论构造 写在最前面

主要在 哈工大密码学课程 张宇老师课件 的基础上学习记录笔记。

内容补充:骆婷老师的PPT 《introduction to modern cryphtogr…

【南京】最新ChatGPT/GPT4科研技术应用与AI绘图及论文高效写作

2023年我们进入了AI2.0时代。微软创始人比尔盖茨称ChatGPT的出现有着重大历史意义,不亚于互联网和个人电脑的问世。360创始人周鸿祎认为未来各行各业如果不能搭上这班车,就有可能被淘汰在这个数字化时代,如何能高效地处理文本、文献查阅、PPT…

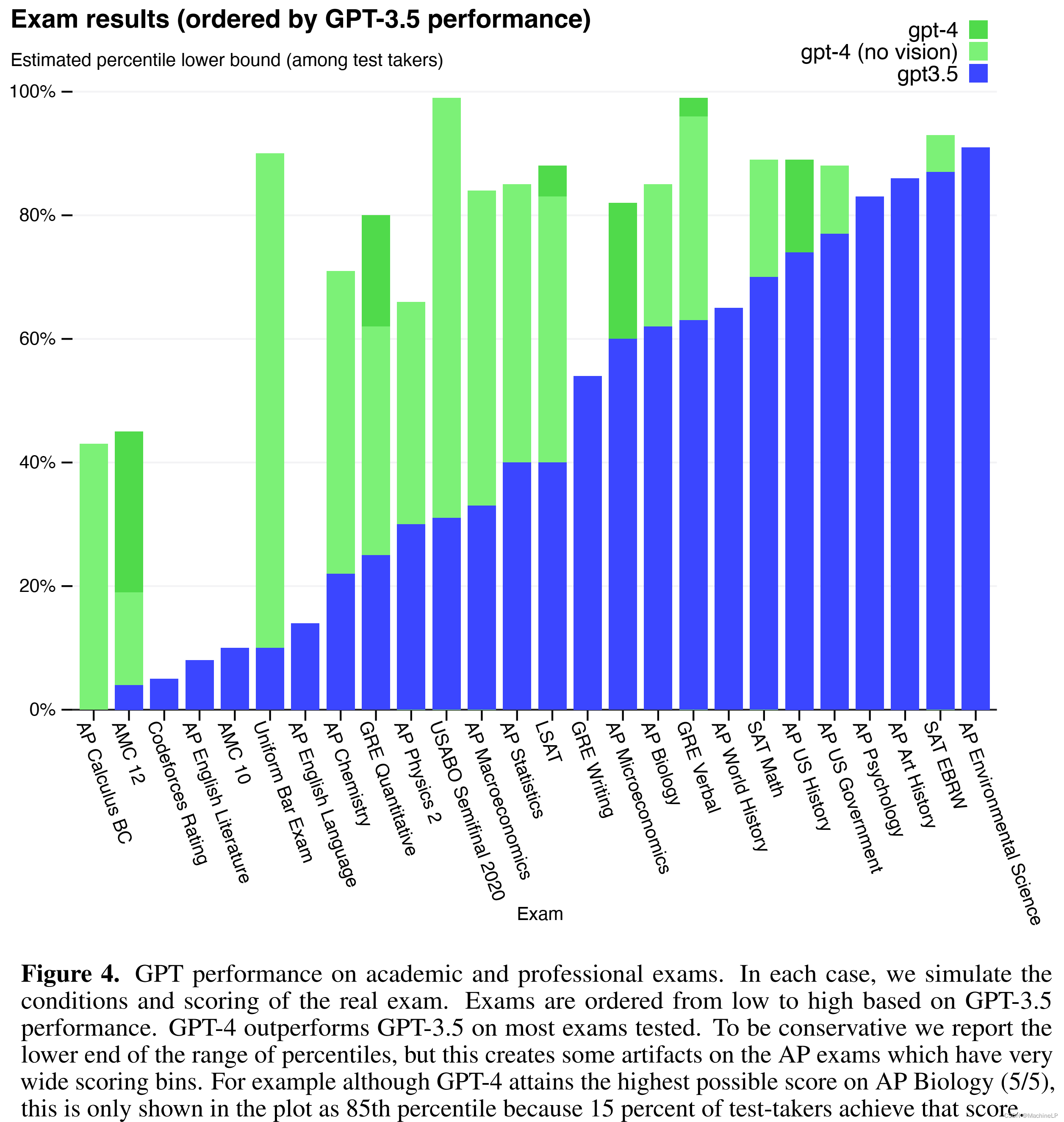

GPT-4震撼来袭,高级推理能力远超ChatGPT

GPT-4来了!这是一款被广泛期待的强大模型,它将成为人工智能领域的新里程碑。OpenAI老板Sam Altman直接开门见山地介绍说:这是我们迄今为止功能最强大的模型! GPT4一经发布,OPENAI和微软的股价都随之上涨,但…

GPT-3.5 Turbo半价升级、GPT-4 Turbo代码生成更牛!OpenAI还有多少惊喜等着我们?

OpenAI掀起AI界新风暴,连续发布多款重磅模型,价格更亲民,性能更强大!这次更新不仅让开发者们欢呼雀跃,也让竞争对手们感受到了压力。

快来看看OpenAI都带来了哪些惊喜吧!首先,备受关注的GPT-3.…

GPT所想即所见的快速解惑

这是学习笔记的第 2464篇文章 在很多年前,自己脑袋里面冒出来这样的一段文字, 黑暗中一个孩子站在田野上看着另外一个孩子 就好像自己在看自己。 说是感慨也好,伤感也罢。那种画面感是一直难以名状的,最近试了下GPT,给…

Phoncent博客GPT写作工具

对于许多人来说,写作并不是一件轻松的事情。有时候,我们可能会遇到写作灵感枯竭、写作思路混乱、语言表达困难等问题。为了解决这些问题,Phoncent博客推出了一款创新的工具——GPT写作工具,它利用了GPT技术,为用户提供…

LaWGPT基于中文法律知识的大语言模型_初步安装

准备代码,创建环境 # 下载代码

git clone gitgithub.com:pengxiao-song/LaWGPT.git

cd LaWGPT# 创建环境

conda create -n lawgpt python3.10 -y

conda activate lawgpt国内网络环境问题。你可以把requirements.txt里面的github.com替换成kgithub.com(这…

GPT引领学习之旅:弥补信息差,助力程序员高效掌握Elasticsearch(附实例)

在前文中,我们讨论了如何利用GPT学习Elasticsearch,弥补信息差,并提供了一些实践案例分享。现在,我们为您提供一个简单的实例,以便您更直观地了解如何结合GPT和其他资源学习Elasticsearch。

实例:使用Elas…

如何用ChatGPT拆解爆款内容(文章/脚本)、提出修改意见,再根据修改意见,最终成稿?

该场景对应的关键词库(11个): 示例内容、爆款库、内容类型、拆解角度、亮点、不足、修改建议、文案、风格、文章、脚本

提问模板(4个):

第一步:建立自己的爆款库,并选择其中1个爆款…

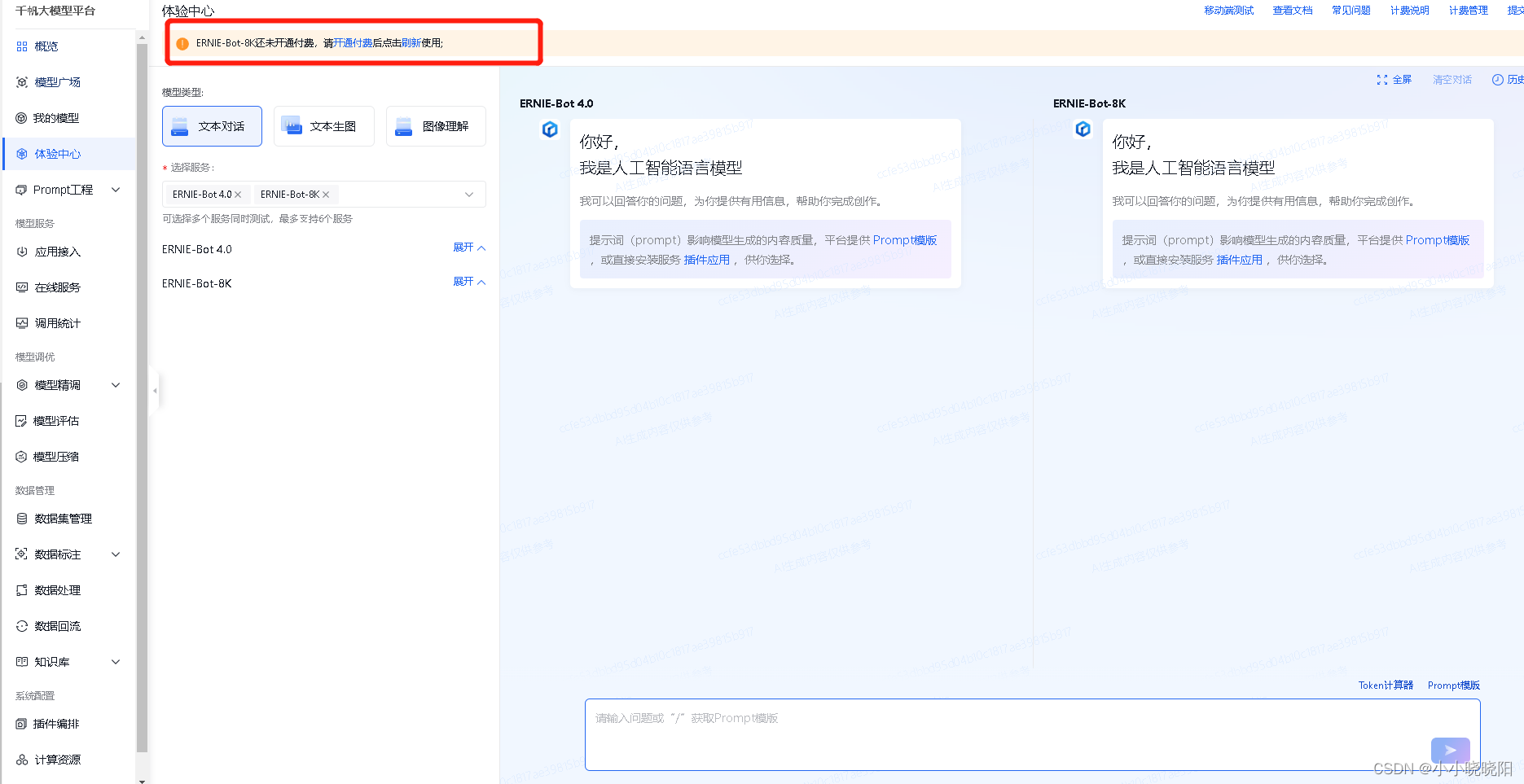

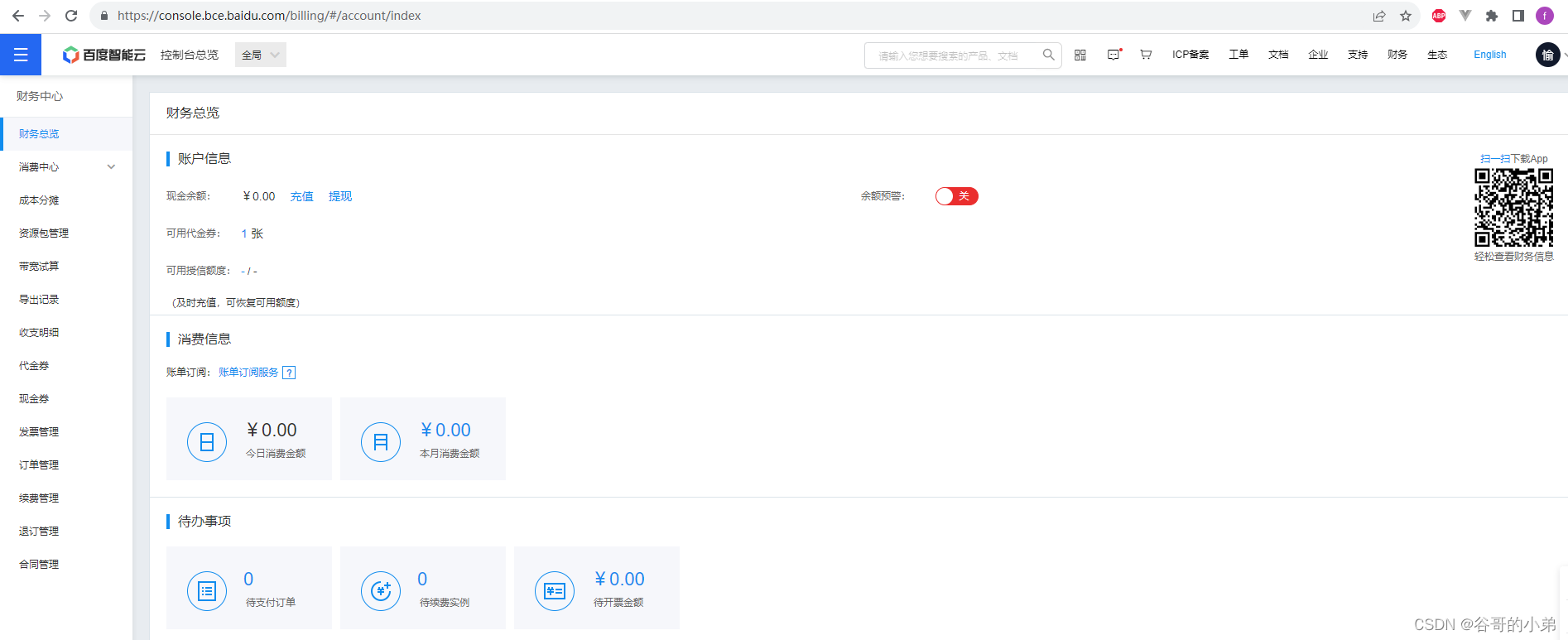

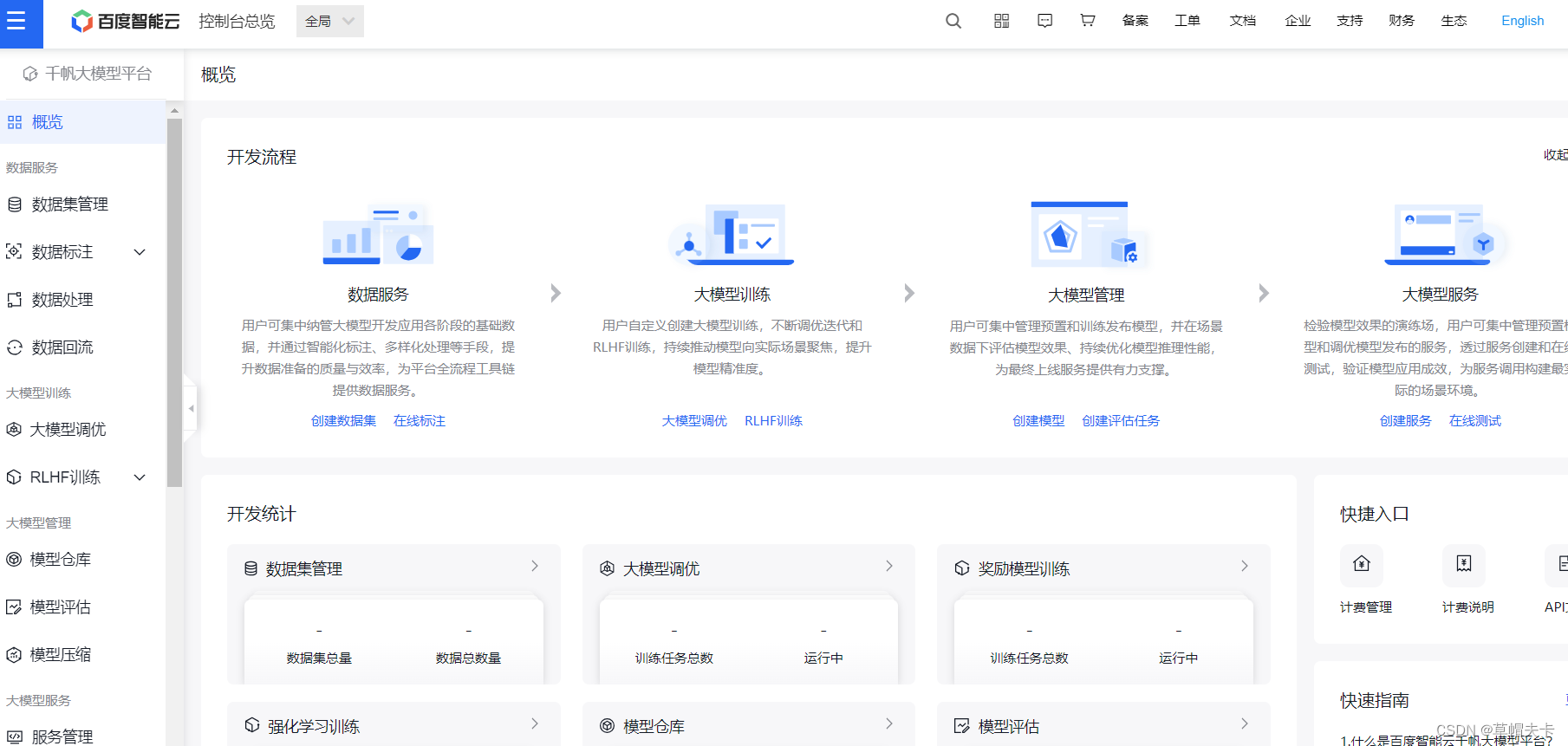

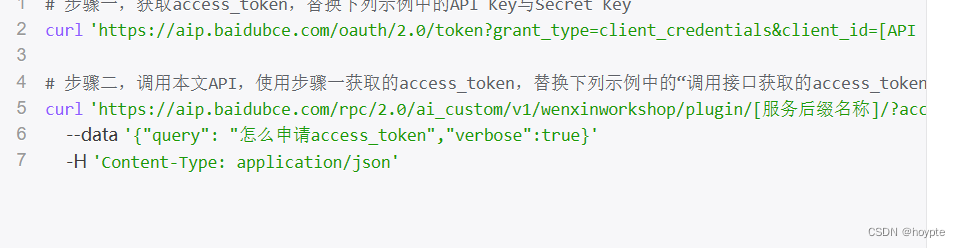

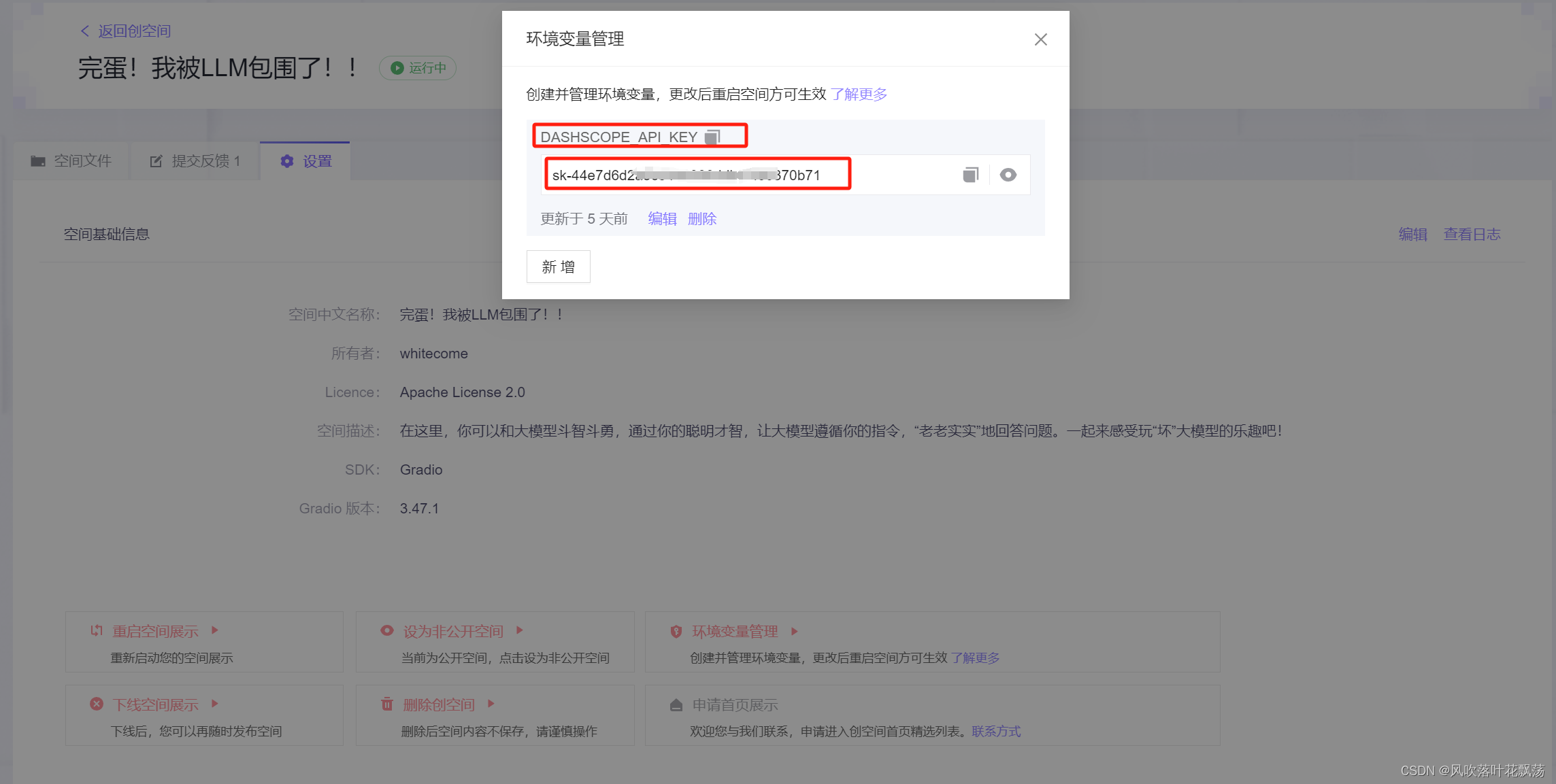

文心一言大模型应用开发入门

本文重点介绍百度智能云平台、文心一言、千帆大模型平台的基本使用与接入流程及其详细步骤。

注册文心一言

请登录文心一言官方网站 https://yiyan.baidu.com/welcome 点击登录;图示如下: 请注册文心一言账号并点击登录,图示如下࿱…

成本管理常用的ChatGPT通用提示词模板

成本分析:如何进行成本分析? 成本核算:如何进行成本核算? 成本控制:如何控制成本? 成本效益分析:如何进行成本效益分析? 成本预测:如何预测成本? 成本决…

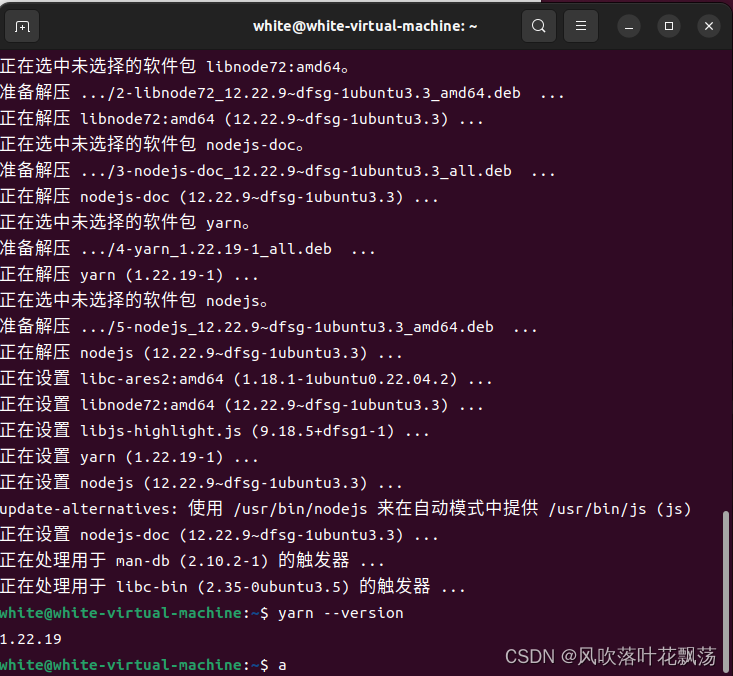

GPT栏目:yarn 安装

GPT栏目:yarn 安装

一、前言

在跟GPT交互的时候,发现最近gpt4给出的答案率有了比较明显的提高,简单记录一下,我用gpt4拿到的答案吧。 本人已按照这个步骤成功

二、具体步骤 要安装 yarn,你可以按照以下步骤进行操作…

UEFI与BIOS、GPT与MBR的区别

版权声明:未经作者允许,严禁用于商业出版,否则追究法律责任。网络转载请注明出处,这是对原创者的起码的尊重!!! 1 磁盘分区格式 一般来说,磁盘分区表有两种格式:MBR和GPT…

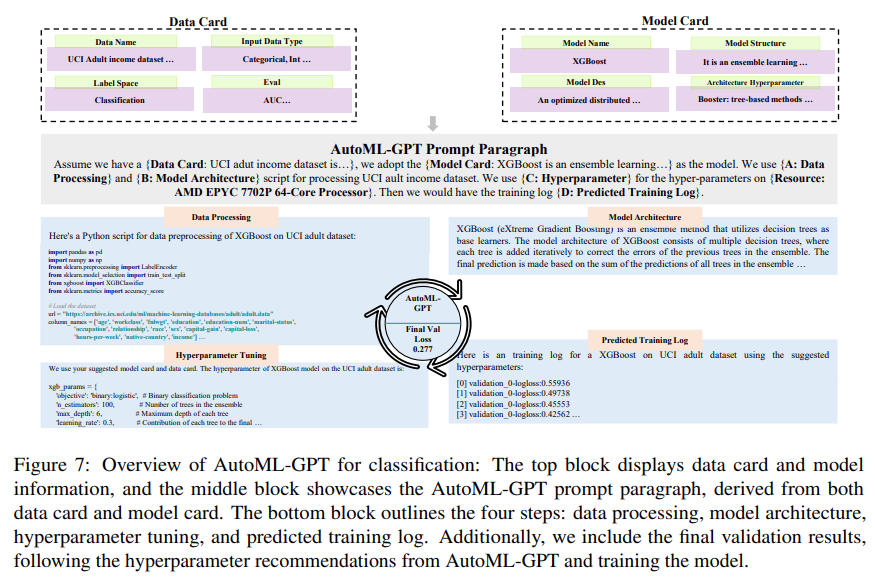

GPT充当大脑,指挥多个模型协作完成各类任务,通用系统AutoML-GPT来了

使用 ChatGPT 实现通用人工智能,思路打开了。 当前,AI 模型虽然已经涉及非常广泛的应用领域,但大部分 AI 模型是为特定任务而设计的,它们往往需要大量的人力来完成正确的模型架构、优化算法和超参数。ChatGPT、GPT-4 爆火之后&…

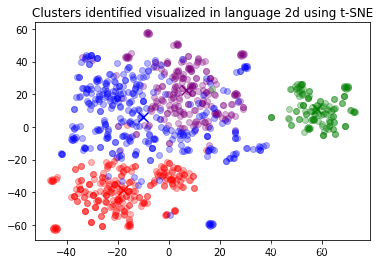

GPT学习笔记-聚类(clustering)

1. 什么是clustering

聚类是一种非常有用的无监督学习技术,它的主要目的是发现数据的内在结构和模式。在许多实际应用中,我们可能没有明确的目标变量或预测目标,但我们仍希望了解数据的组织方式,或者找出数据中的特定模式或组。这…

长假,GPT来敲(Jué)门(Fén)

引 马上十一了,本拐在干了XX和XX事情以后,开始划水,欢天喜地的等放假。 然后,GPT4说更新了,据说加了一个读图的功能,本拐不以为然,不就是什么文生图,图生文么,TOOOLD。 不…

GPT应用程序的行业应用

GPT(Generative Pre-trained Transformer)应用程序在各个行业都有广泛的应用潜力,其自然语言生成的能力使其适用于多种场景。以下是一些行业中常见的GPT应用,希望对大家有所帮助。北京木奇移动技术有限公司,专业的软件…

比尔.盖茨最新思考和宣言, 未来5年AI将彻底改变生活!

人工智能即将彻底改变你使用计算机的方式 并颠覆软件行业。

比尔盖茨

今天我仍然像保罗艾伦和我创办微软时一样热爱软件。但是,尽管从那时起的几十年里它已经有了很大的进步,但在很多方面,软件仍然相当愚蠢。

要在计算机上执行任何任务&am…

用向量数据库Milvus Cloud搭建GPT大模型+私有知识库的定制AI助手——PPT大纲助手

随着人工智能技术的不断发展,AI助手在各行各业中扮演着越来越重要的角色。在商业领域,PPT演示是一种常见的沟通方式,而定制化的PPT大纲助手能够极大地提高PPT制作效率和质量。本文将介绍如何利用向量数据库Milvus Cloud搭建GPT大模型和私有知识库,构建一款高效的PPT大纲助手…

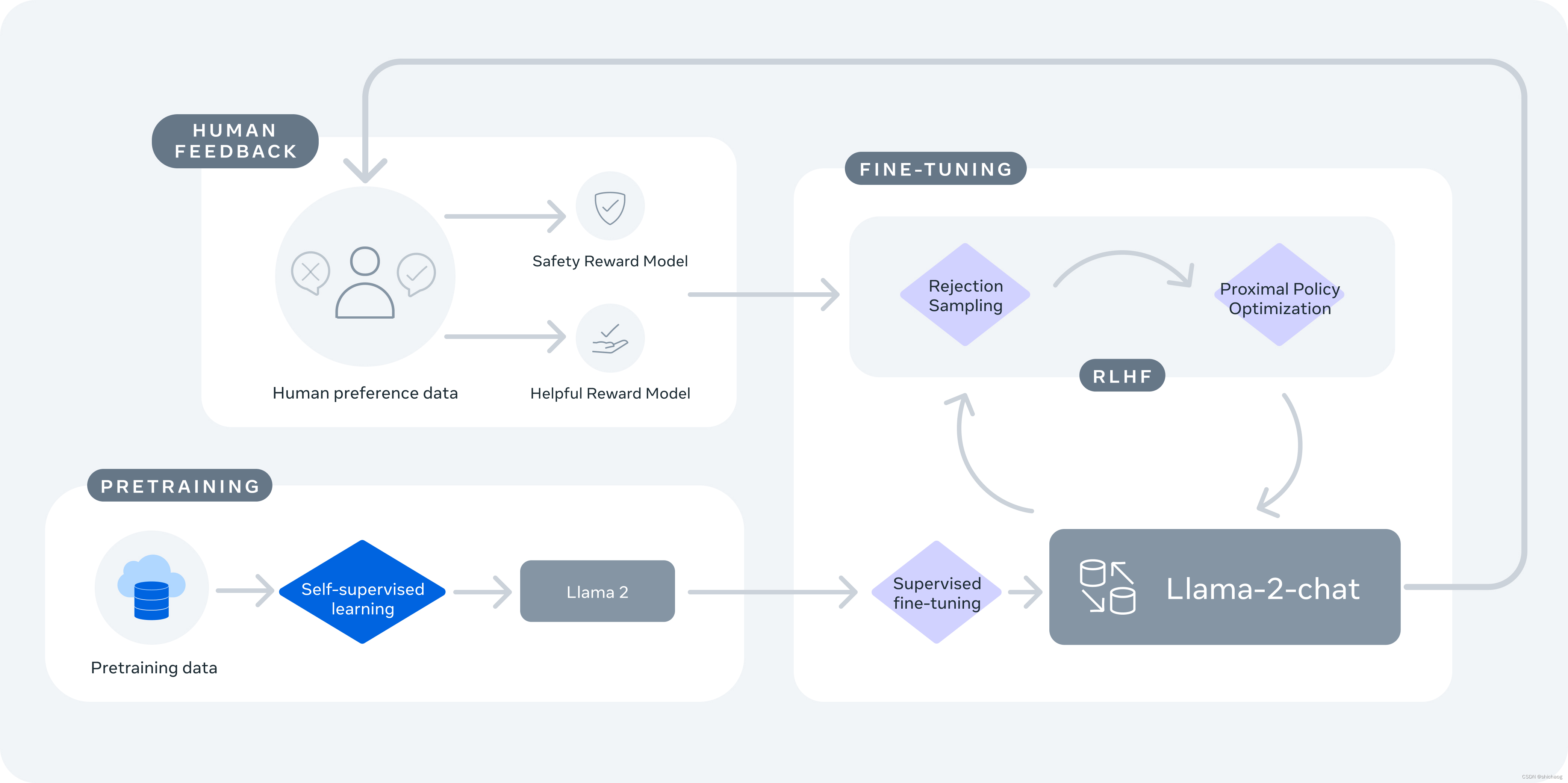

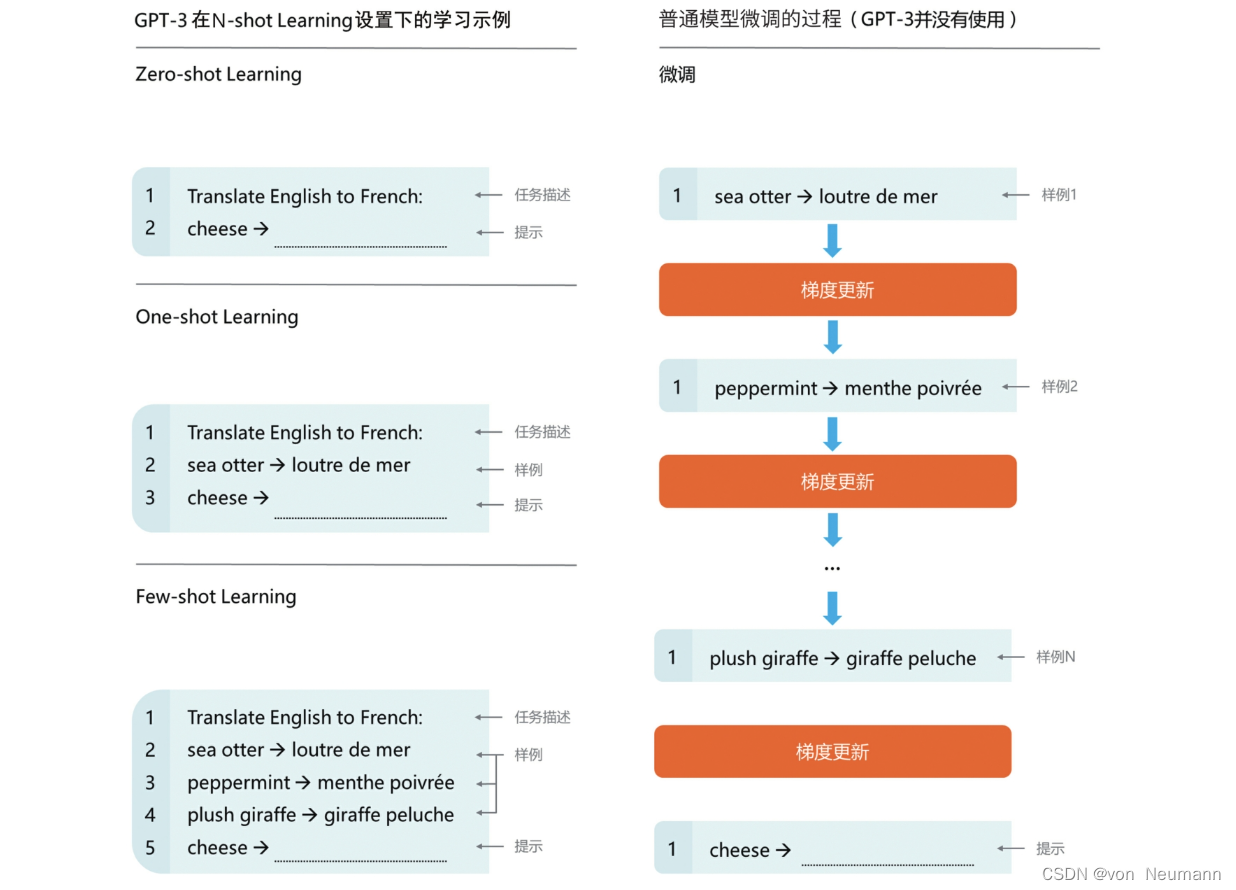

大模型基础02:GPT家族与提示学习

大模型基础:GPT 家族与提示学习

从 GPT-1 到 GPT-3.5

GPT(Generative Pre-trained Transformer)是 Google 于2018年提出的一种基于 Transformer 的预训练语言模型。它标志着自然语言处理领域从 RNN 时代进入 Transformer 时代。GPT 的发展历史和技术特点如下: GPT-12018年6月…

第22期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练 Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

HTTP方式请求并处理GPT聊天补全接口的流式响应输出

python使用HTTP方式,调用OpenAI的聊天补全的流式响应接口,并处理数据 目的是,如果需要对接fastGPT等其他第三方,需要额外增加参数,或者其他开发语言调用时,不能使用官方的类库。需要自行封装请求方法&#…

高级Prompt指南:打造高效聊天体验,让ChatGPT更懂你

前言

随着深度学习技术的不断发展,人工智能在各个领域都表现出越来越强大的能力。其中,自然语言处理(NLP)领域发展迅猛,将人工智能技术应用于对话系统、语音识别和机器翻译等方面。ChatGPT是一个基于GPT-3.5语言模型的…

Unity集成GPT

GPT想必是最近互联网最火的话题了,作为一个Unity开发者,今天来介绍一下如何在Unity中使用GPT。

一、API 密钥

使用GPT的API首先要获得密钥,如下进入OpenAI官网(https://platform.openai.com/account/api-keys)–>选择自己的账号–>查…

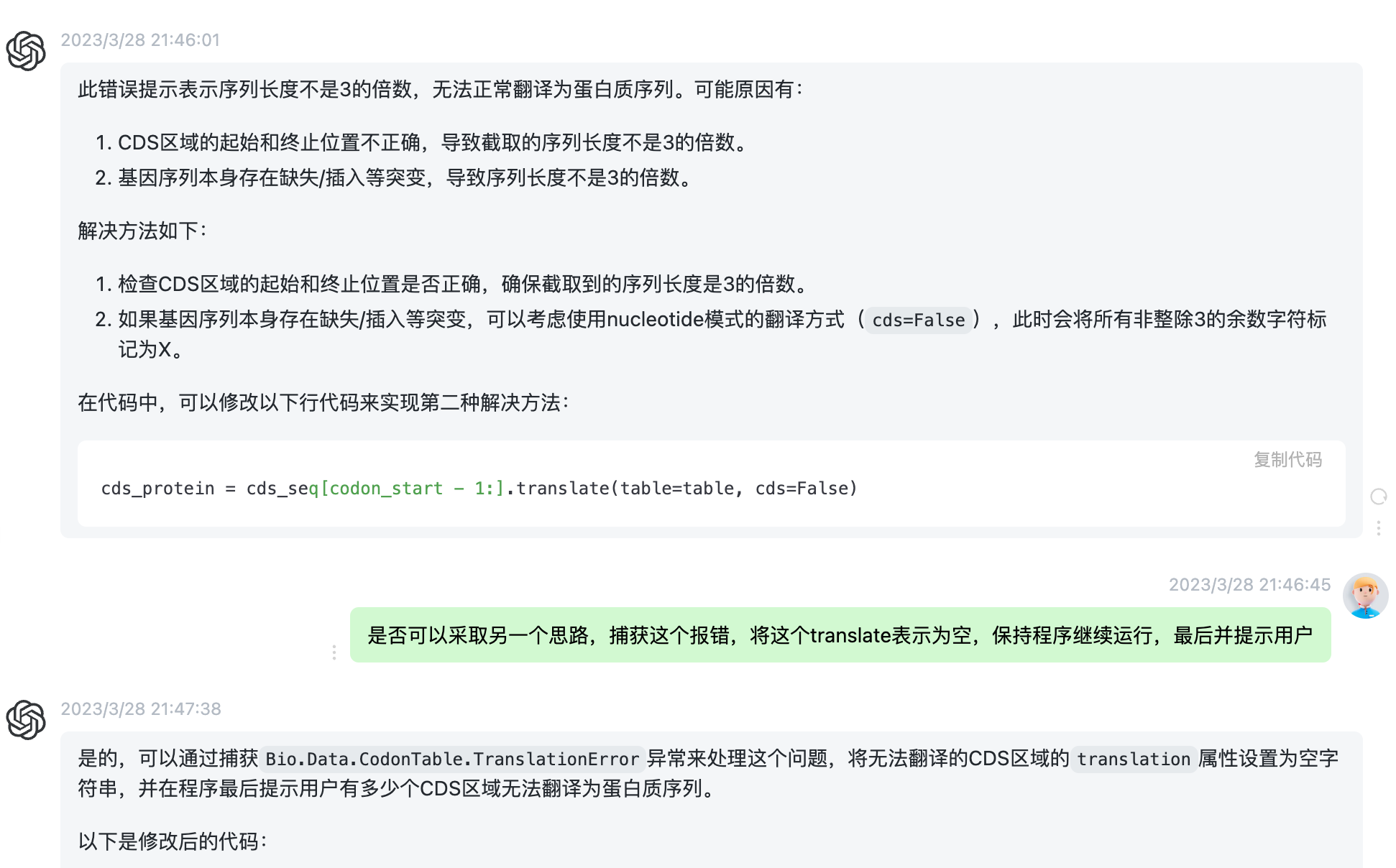

我跟GPT合作写了一个genbank文件处理的脚本

事情起因是这样子,我有个genbank文件,里面记录的是线粒体的注释的坐标信息。由于这个注释是来源同源注释,可能存在错误,因此还需要后续的手动修改。我没去找到专门的工具,只是根据分析结果,手动改了里面一些…

GPT、科技、人类的生产、知识与未来(下)

探讨4 :GPT工具对人类个体的赋能及影响? 有了上篇的铺垫,就可以做更多的分析和判断了。 作者主要结合日常使用ChatGPT、文心一言、BingChat、Stable Diffusion、Midjourney等工具的有限经验,并且假设GPT技术及通用人工智能在可见的…

完全免费的GPT,最新整理,2023年8月24日,已人工验证,不用注册,不用登录,更不用魔法,点开就能用

完全免费的ChatGPT,最新整理,2023年8月24日,已人工验证,

不用注册,不用登录,更不用魔法,点开就能用! 第一个:网址地址统一放在文末啦!文末直达 看上图你就能…

ChatDoctor本地部署应用的实战方案

大家好,我是herosunly。985院校硕士毕业,现担任算法研究员一职,热衷于机器学习算法研究与应用。曾获得阿里云天池比赛第一名,CCF比赛第二名,科大讯飞比赛第三名。拥有多项发明专利。对机器学习和深度学习拥有自己独到的见解。曾经辅导过若干个非计算机专业的学生进入到算法…

GPT、科技、人类的生产、知识与未来(上)

本文将继续结合GPT探讨人工智能技术升级可能对人类社会带来的影响。主要还是侧重历史、社会、文化、经济、政治等角度。 问题的提出:ChatGPT等工具会提高人的工作效率和产出。但它会让人类使用者自身变得更“聪明”,还是“更笨”?更“强”&am…

【GPT】AutoGPT 安装使用完全教程

欢迎关注【youcans的GPT学习笔记】原创作品,火热更新中** 【GPT】AutoGPT 安装使用完全教程 【GPT】AutoGPT 安装使用完全教程1. AutoGPT 介绍1.1 AutoGPT 简介1.2 AutoGPT 的工作流程 2. 下载 AutoGPT 项目源码2.1 GitHub 下载项目源码2.2 网页下载稳定版源码 3. A…

如何用ChatGPT写专业方向的科普内容?

该场景对应的关键词库(13个): 目标用户、科普内容、生活问题、医疗类型、科普文章、病情症状、通俗性、专业名词、背景资质、权威领域、执业范围、证言人、内容形式。

提问模板(3个):

第一步,…

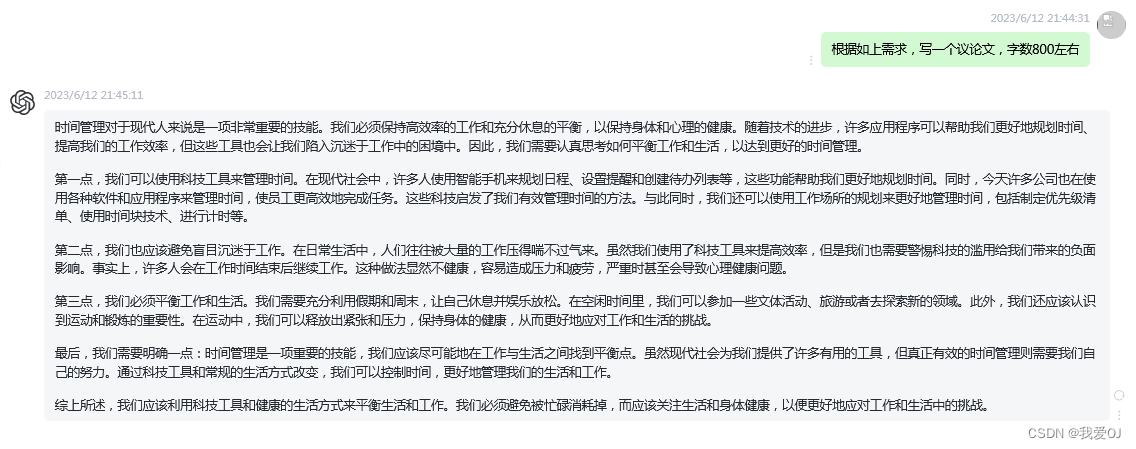

我用GPT-3.5写了一个关于C++排序的博客,大家看看和我手写的哪一个好

手写版:你还不懂排序?那是你没看到这篇文章…_我爱OJ的博客-CSDN博客

以下内容来自GPT-3.5大模型:

目录

一、排序算法的基本概念

二、比较排序算法

1、冒泡排序

C代码实现

2、选择排序

C代码实现

3、插入排序

C代码实现

4、希尔排…

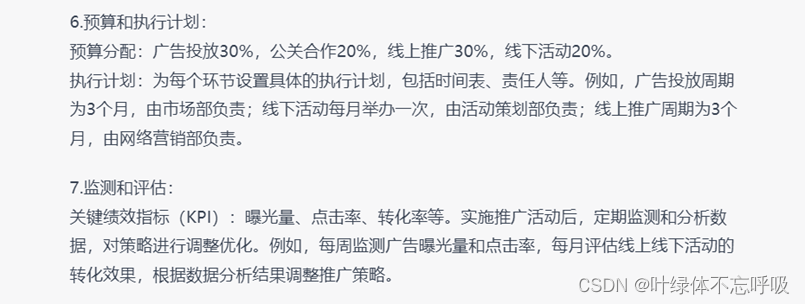

如何用ChatGPT做内容营销方案和选题计划,同时生产和优化内容?

该场景对应的关键词库(31个): 内容营销、目标、主题、类型、选题计划、素材、推广策略、优化方案、渠道、目标受众、竞争对手、行业背景、转化率、品牌知名度、客户参与度、销售、发布频率、选题阶段、生产阶段、推广阶段、预算分配、人群特征…

[ChatGPT] 从 GPT-3.5 到 GPT-5 的进化之路 | ChatGPT和程序员 : 协作 or 取代

⭐作者介绍:大二本科网络工程专业在读,持续学习Java,努力输出优质文章 ⭐作者主页:逐梦苍穹 ⭐如果觉得文章写的不错,欢迎点个关注一键三连😉有写的不好的地方也欢迎指正,一同进步😁…

5月13日,今日信息差

1、国内首条悬挂式空中轨道列车武汉光谷空轨试乘发车空轨列车悬挂在单型轨道下方,将地面交通移至空中,属于立体交通。该列车最高运行时速60公里,最多能容纳220余人

2、菜鸟国际快递、五粮液和上海电气入选“中国品牌全球行”案例,…

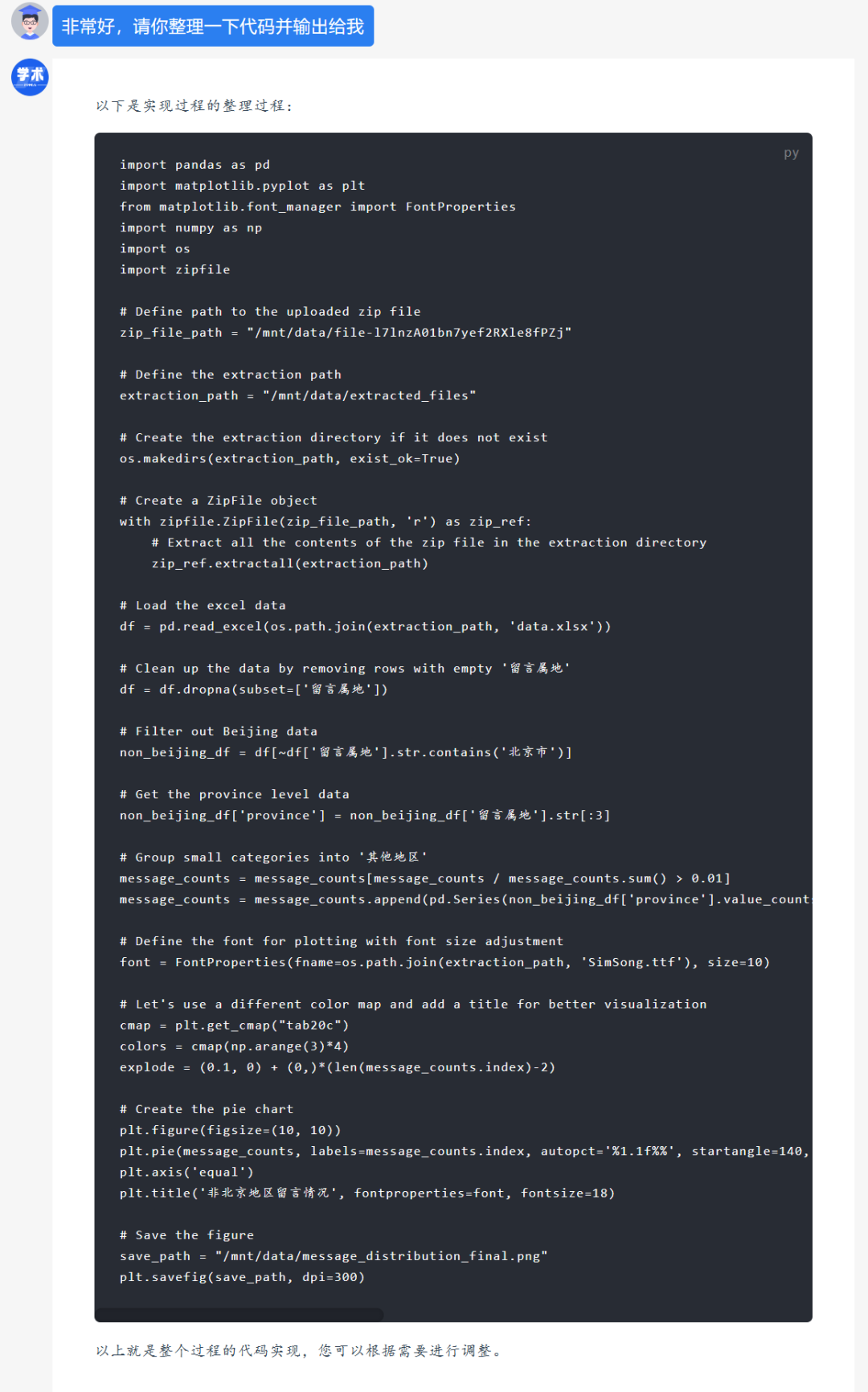

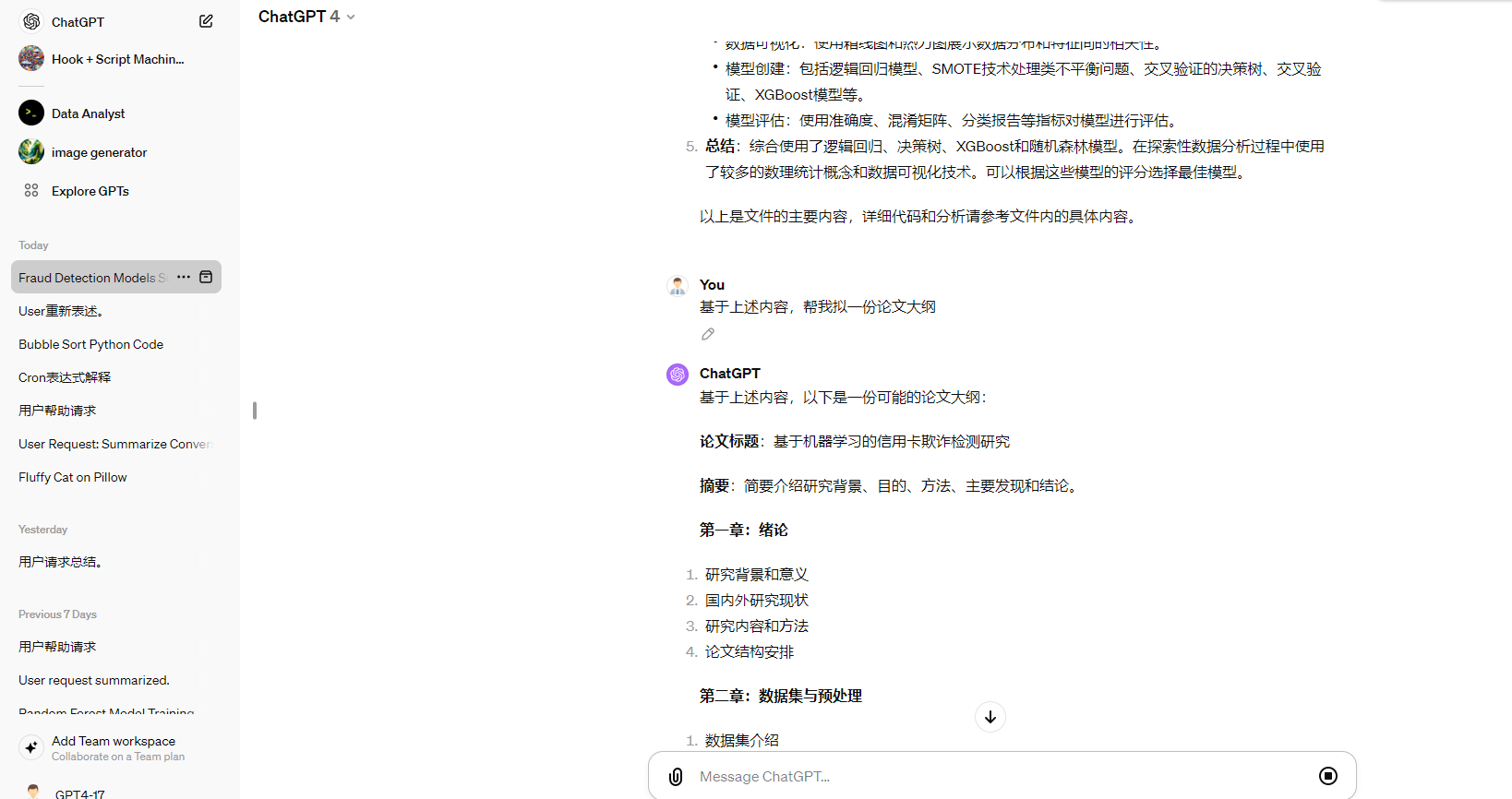

如何用gpt快速做好数据分析?

由于技术限制,目前InfinitePaper AI仅支持上传1份文件,且大小不超过10M。但是,在强大的代码解释器面前,这都是小问题。我们只需要将可能用到的文件打包成压缩文件上传即可,之后要求GPT直接解压就能正常完成后续需求。 …

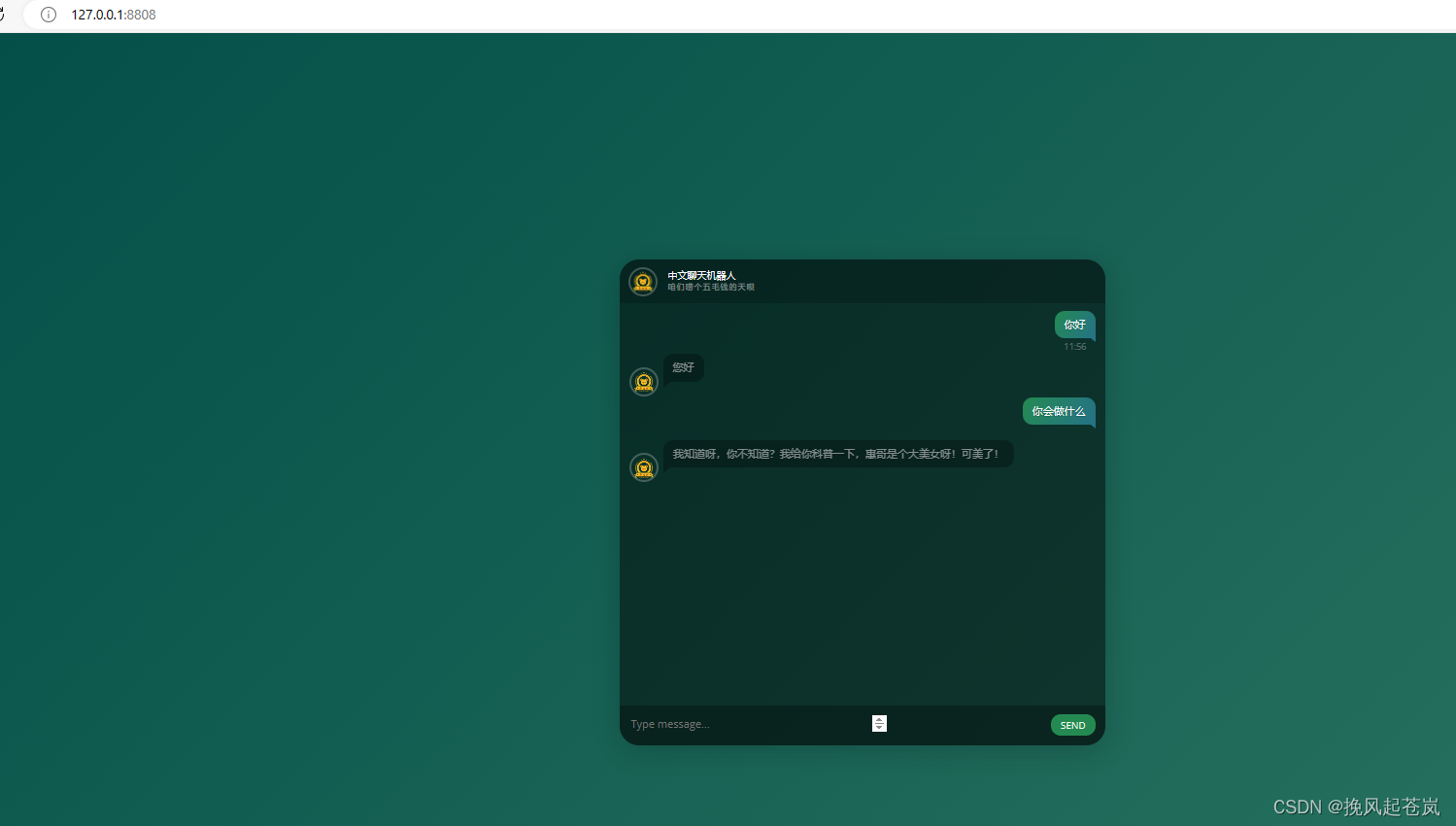

Chat GPT实用案例——VUE+Chat GPT实现聊天功能教程

首先,我们需要确定所需功能和技术栈:

前端框架:Vue.js聊天机器人:Chat GPT APICSS框架:Bootstrap or 自主设计

在开始编写代码之前,请确认 Chat GPT API 服务已经配置好, 并且您已获得了API密钥或者token。

接下来是…

中科院学术专用版GPT Academic项目实现

【写在最前】要完成GPT 学术优化 (GPT Academic)这个项目需要一些值得注意的地方:

chatGPT账户有余额且未过期!!!有代理工具(类似Clash) 1、代码克隆

https://github.com/binary-husky/gpt_academic 根据…

最火爆ChatGPT知识星球分享,开启与GPT的神奇之旅

今天给大家介绍的是一个讲解ChatGPt的知识星球,这个星球是专门为ChatGPT爱好者和AI绘画感兴趣的朋友们打造的。这个知识星球主题是关于ChatGPT的,旨在提供一个交流、学习和探索GPT的平台。

这里有一个强大的阵容,汇集了许多对人工智能和自然…

Transformer通俗笔记:从Word2Vec、Seq2Seq逐步理解到GPT、BERT

前言 我在写上一篇博客《22下半年》时,有读者在文章下面评论道:“july大神,请问BERT的通俗理解还做吗?”,我当时给他发了张俊林老师的BERT文章,所以没太在意。

直到今天早上,刷到CSDN上一篇讲B…

GPT的API KEY答疑

问题答案APIkey的作用用来调用OPENAI的接口,发送对话内容,然后获取结果APIKEY的额度账户注册会有五美元,但是对于开发者来说比较少如何获取高额度APIkey绑定国外信用卡,然后直接提额,先用后付模式120刀账号获取难度高&…

Chat-Gpt Prompt编写技巧

本文翻译自chat-gpt Prompt一书 书中列举了,我们在使用Chat-Gpt时,应该用怎样的技巧和询问方式,才能得到更合理、更准确的结果。

第二章 指令提示技巧

指令提示技巧指的是通过提供特定的介绍给模型,来引导chatgpt的输出的一种方…

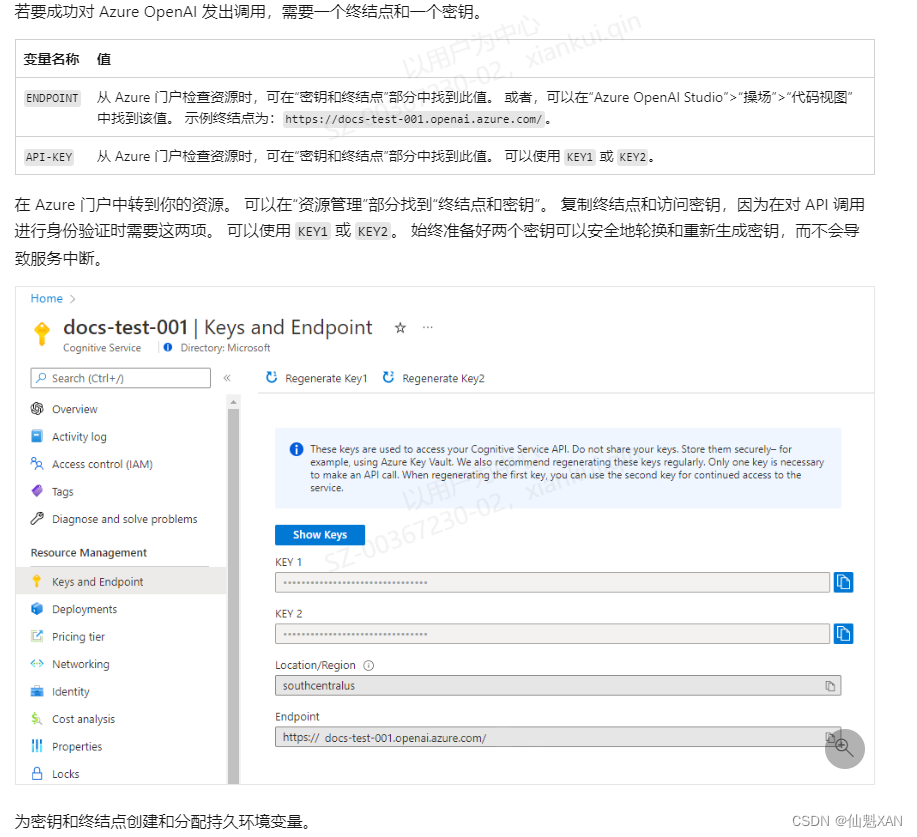

Unity 工具 之 Azure OpenAI 功能接入到Unity 中的简单整理

Unity 工具 之 Azure OpenAI 功能接入到Unity 中的简单整理 目录

Unity 工具 之 Azure OpenAI 功能接入到Unity 中的简单整理

一、简单介绍

二、实现原理

三、注意实现

四、简单实现步骤

五、关键代码

六、附加

创建新的 .NET Core ,获取 Azure.AI.OpenAI d…

GPT-2(Transformer Decoder)的TensorFlow实现(附源码)

文章目录 一、GPT2实现步骤二、源码 一、GPT2实现步骤 机器学习模型的开发实现步骤一般都包含以下几个部分: 1. 遵照模型的网络架构,实现每一层(Layer/Block)的函数; 2. 将第1步中的函数组合在一起,…

ubuntu中安装autogpt,python虚拟环境安装使用

ubuntu中安装autogpt,python虚拟环境安装使用 git安装

https://gitforwindows.org

python3.10安装:

autogpt支持python版本是3.10,ubuntu20.04中默认版本3.8是不支持的。

安装虚拟环境

sudo add-apt-repository ppa:deadsnakes/ppa

sudo…

ChatGPT大战高考作文,一起看看写的如何

文章目录 引言实操作文分析写作指导作文 文末福利:学生管理系统实现亮点 总结 引言

自从上次高考作文题目出来后,很多人在看到高考甲卷时都发出了感慨,的确,这次的题目的确很吸引人 人们因技术发展得以更好地掌控时间,…

GPT-4国内有免费平替吗?

免费/平替永远是最贵的

就如同我们生活中买口红一样,总想找到平替,但永远比不上看中的那只!

但在寻找平替过程中

花出去的时间、金钱成本都是翻倍的。 那么GPT-4呢?

GPT-4优于GPT-3.5闪光点,想必大家都十分清楚

不…

如何撰写高效且实用的Prompt

很多人说GPT并没有什么让人惊艳的地方,但实际上,他们并没有发挥好它的潜能。在很多情况下,他们往往没有使用恰当的prompt。一个恰到好处的prompt就如同魔法师在施展魔法时所需要吟唱的咒语,只有那些正确无误的咒语,才能…

保姆级教程:手把手教你拿下雅思写作7分

在留学路上,雅思考试是绕不开的一道坎。然而,众所周知,雅思学习热度高,学习难度大,而且很多人找不到合适的学习方法。在这里,我们以雅思写作中的大作文为例,从大作文的结构拆解、学习的任务拆分…

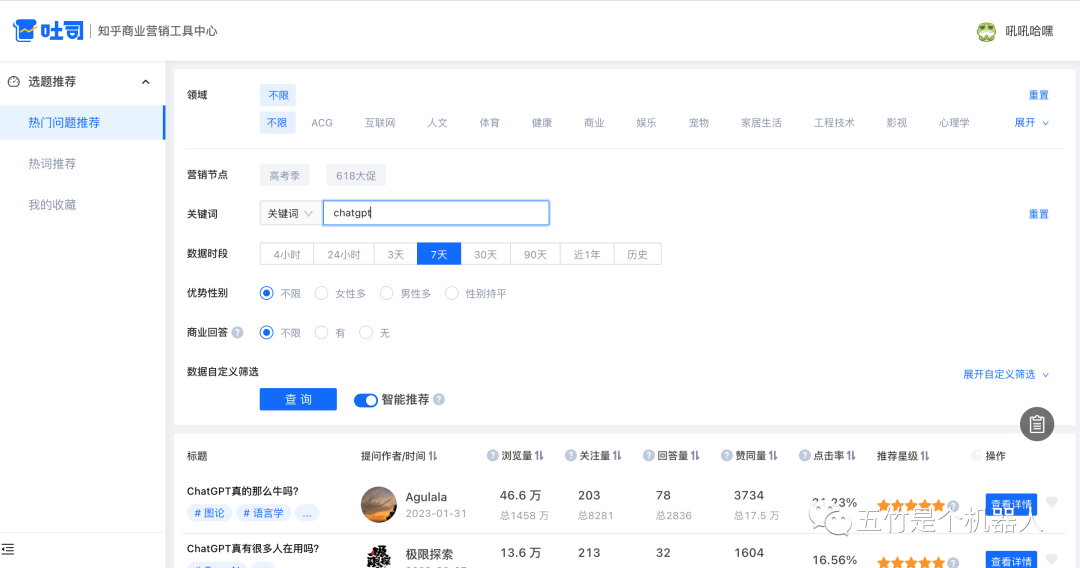

0起步用GPT+知乎赚了点小钱,人人可复制

大家好,我是五竹。

前段时间分享了一篇关于用ChatGPT赚点小钱的实战:TMD,被人偷窥了一个月!结果上周末的时候在知乎追了一个关于Claude的热点,发布了一篇注册Claude的文章,结果小小的“爆了”一下…

一文看懂GPT风口,都有哪些创业机会?

新时代的淘金者,低附加价值的创业要谨慎,高附加价值、低技术门槛创业也要谨慎,主干道边上的创业也要谨慎。不少朋友看完不淡定了,干什么都谨慎,回家躺平好了,我有个朋友,靠ChatGPT,半…

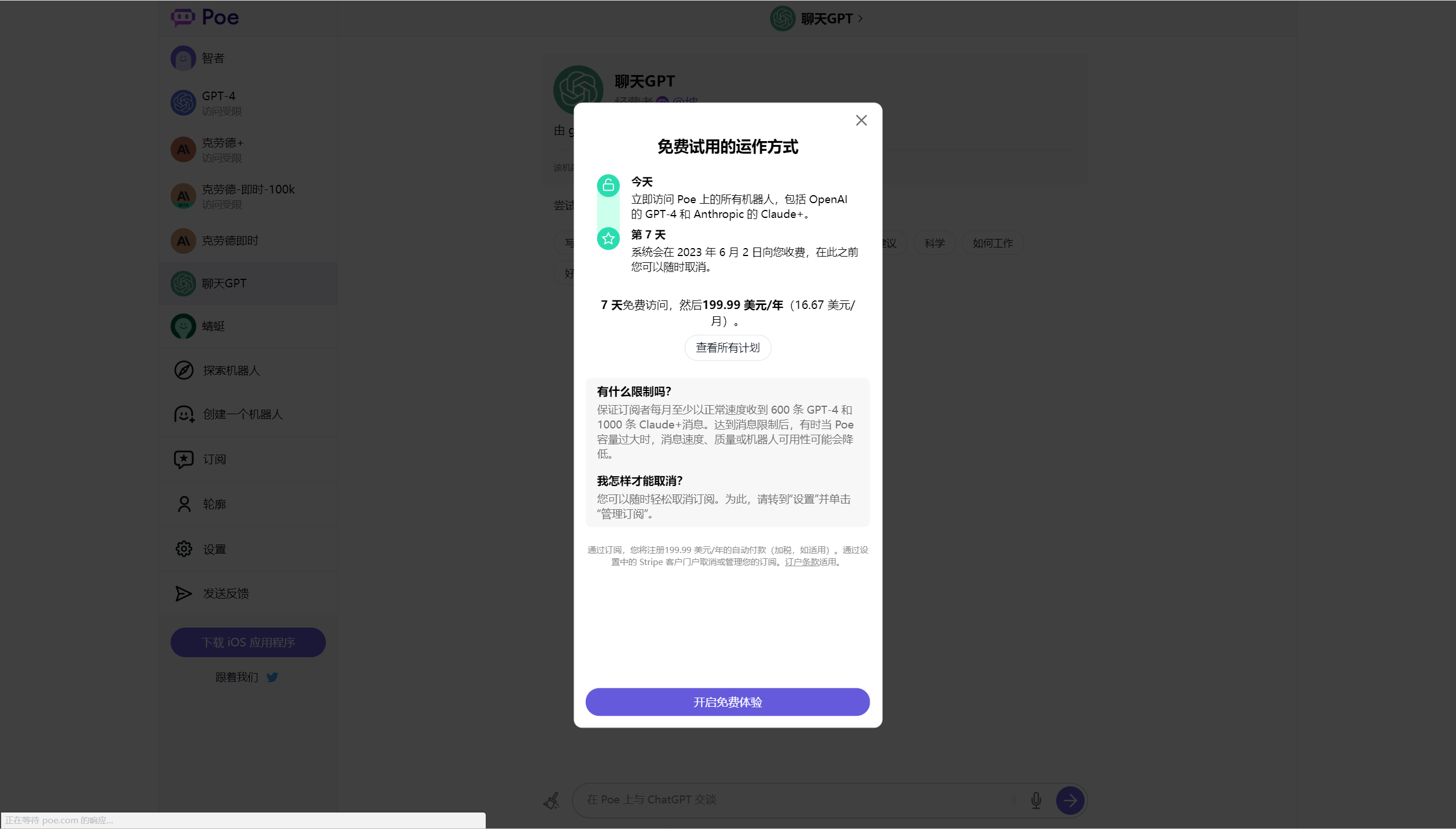

Chat-GPT 聚合平台 Poe:集成多个 AI 聊天机器人

Chat-GPT 聚合平台 Poe:集成多个 AI 聊天机器人

介绍

Poe 是知名问答社区 Quora 推出的 AI 平台——开放探索平台 (Platform for Open Exploration, Poe)。Poe 集成了多个基于大型语言模型的聊天机器人,包括 ChatGPT,以及 Sage、Claude、Dr…

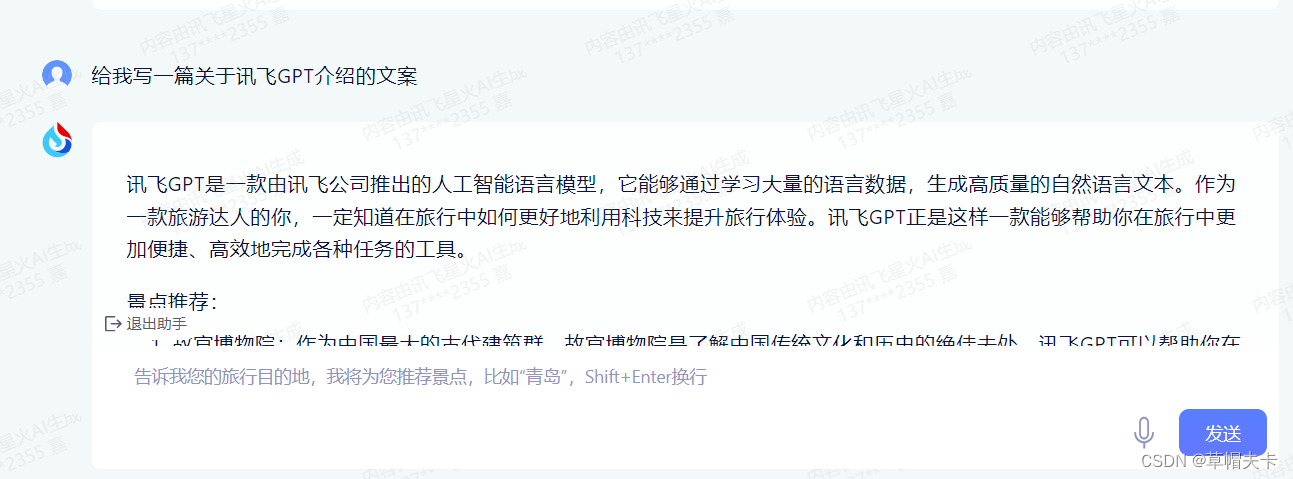

科大讯飞永久免费GPT入口来了!!!

讯飞GPT永久免费使用入口注册链接:讯飞星火认知大模型-AI大语言模型-星火大模型-科大讯飞。 登录讯飞账号后,点击进入体验。 进入体验页面后,选择景点推荐。 笔者让其写一篇关于讯飞GPT介绍的文案。 讯飞GPT是一款由讯飞公司推出的人工智能语…

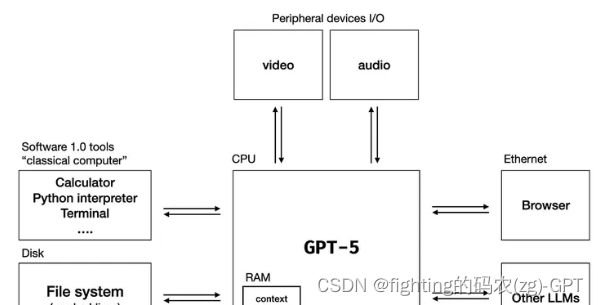

GPT的未来--基于标准接口的由计算机和无数工业软件构成的联合体

GTP未来的两个方向。

一、其自身向逻辑和模型的方向发展。

即加强其自身的能力。

(1)模式

比如,世界上许多看起来不同领域的信息,却有相同的模式。

例如,电流相关的公式,与弹簧的距离与功的公式。

鳄…

GPT 任务指令 = 定义角色 + 背景信息 + 任务目标 + 输出要求

GPT 任务指令 定义角色 背景信息 任务目标 输出要求

环境 GPT-4

0. 你是一名专业的导游,负责为我生成旅游计划,现在我来北京旅游,需要你为我生成一份 3天2晚的北京旅游规划。我的要求是:1.地点包括故宫、军播和环球影城。 2…

GPT学习笔记-使用embedding实现语义文本搜索(Semantic text search)

语义文本搜索(Semantic Text Search)确实是自然语言处理(NLP)的重要功能之一。它代表了NLP的一个关键目标:理解和处理人类语言的语义。

传统方式实现语义文本搜索难点的例子: 理解上下文的重要性ÿ…

GPT带我学-设计模式-迭代器模式

1 什么是迭代器设计模式?

迭代器设计模式是一种行为型设计模式,用于提供一种统一的方式来遍历一个集合对象中的元素,而不需要暴露该对象的内部结构。它将集合对象的遍历操作与集合对象本身分离开来,使得遍历操作可以独立于集合对…

GPT+RPA用于自动流转分配,助力优化信访工作流程

信访工作是基层治理的重要组成部分。面对具体的信访事项,内容繁琐、情况复杂,对基层干部及相关受理部门构成巨大压力,存在以下痛点: 1、匿名举报信访量较大,线索不清、内容模糊、调查难度大,加大基层信访工…

GPT怎样教我用Python进行数据可视化

文章目录 GPT怎样教我用Python进行数据可视化matplotlibpyecharts总结 GPT怎样教我用Python进行数据可视化

🚀🚀首先,我们先看一下这段代码,这是我之前写来读取excel文件中xx大学在各个类别中的获奖情况,并保存在一个…

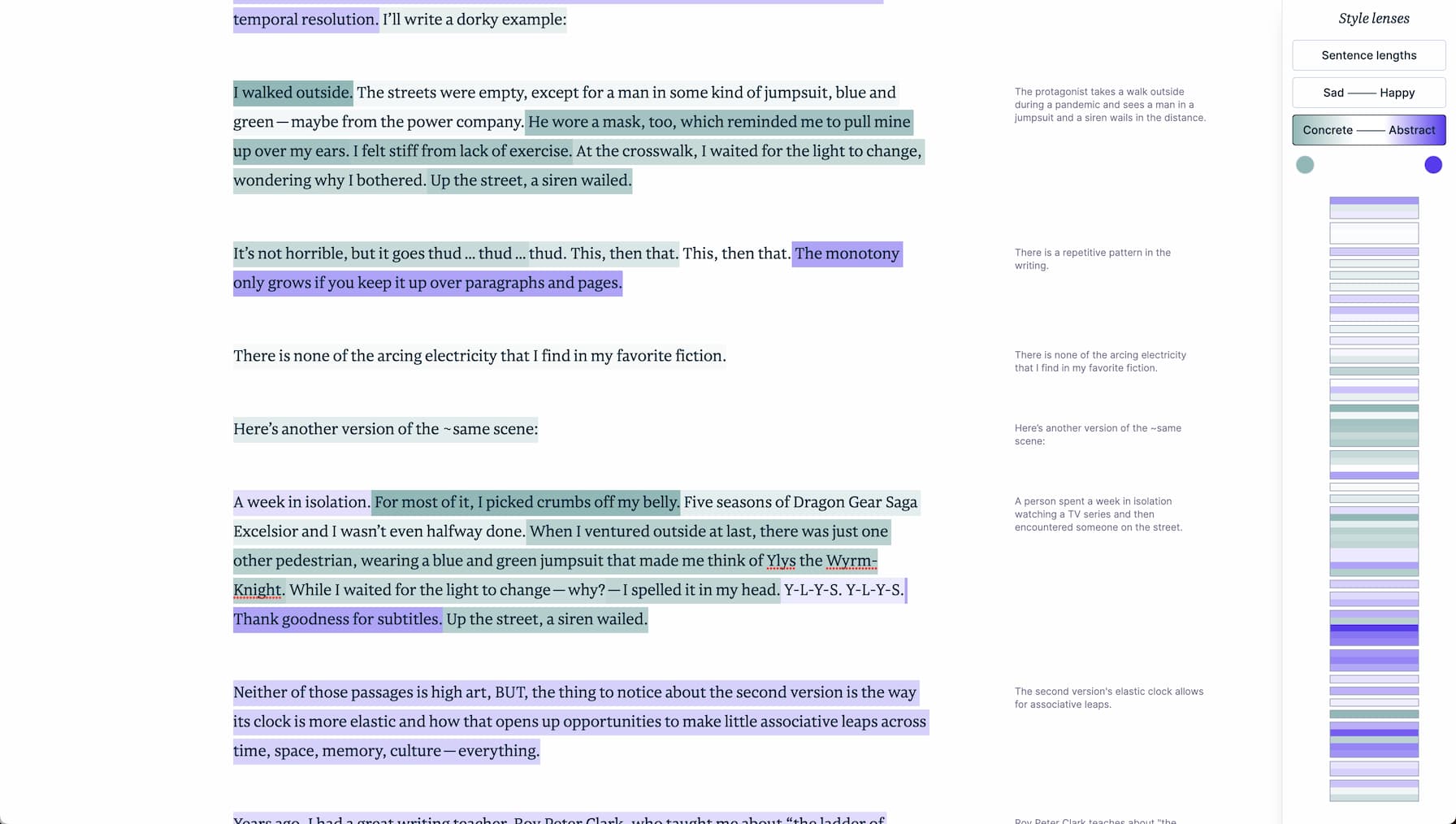

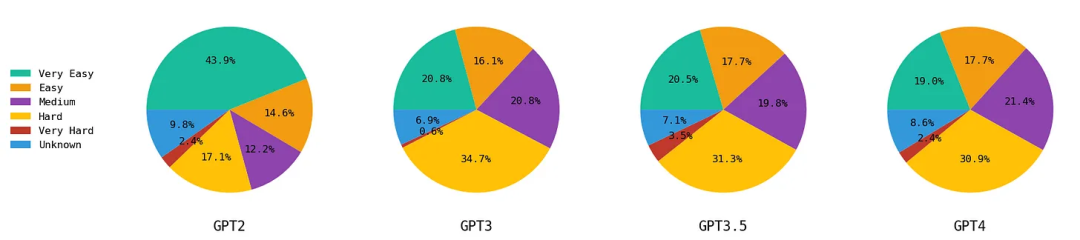

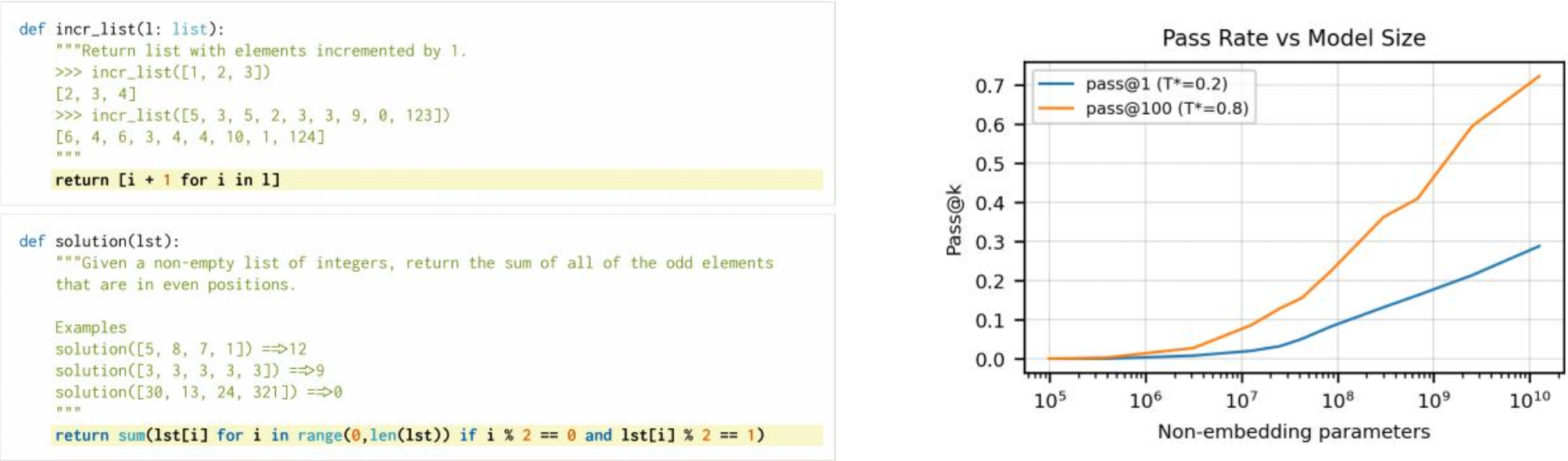

大语言模型的创意能力到底几何?探索从GPT-2到GPT-4的演进

编者按:大语言模型可以提供许多创意性内容,如写诗、写小说等。那么到底应该如何评估大语言模型生成的创意性内容的水平呢? 本文探讨了GPT-2到GPT-4的创造性,并分析了这些模型在不同创造性测试中的表现。作者使用了三种测试来衡量模…

6月11日,今日信息差

1、首都线下演出持续升温 文化消费回暖势头强劲。今年上半年,首都线下文化演出持续升温,文化消费回暖势头强劲,成为提振消费的新引擎。今年上半年,首都线下文化演出活动丰富多彩,文化消费回暖势头强劲。仅最近一个月时…

探索AI插件:statisfinapp、penrose_research_analyst和nextpaper

引言

在当今的数字化世界中,AI插件已经成为了我们日常生活和工作的重要工具。无论是处理财务数据,搜索研究论文,还是获取最新的科研成果,这些插件都能提供强大的帮助。在本文中,我们将详细介绍三个强大的AI插件&#…

DeepMind发布多任务机器人RoboCat;沧海拾珍之LLM、GPT

🦉 AI新闻

🚀 DeepMind发布多任务机器人控制AI模型RoboCat

摘要:谷歌旗下DeepMind发布了名为RoboCat的AI模型,该模型可以控制不同机器人手臂执行多项任务。RoboCat是第一个能够解决和适应多种任务的模型,并且使用真实…

GPT引领前沿与应用突破之GPT-4科研实践技术与AI绘图

查看原文>>>GPT引领前沿与应用突破之GPT4科研实践技术与AI绘图

目录

专题一、AIGC概述

专题二、人工智能算法介绍

专题三、大语言模型Prompt提示词使用技巧

专题四、让GPT成为你的生活助理(动手练习)

专题五、让GPT成为你的工作秘书&…

软件测试/测试开发丨学会与 AI 对话,高效提升学习效率

点此获取更多相关资料

简介

ChatGPT 的主要优点之一是它能够理解和响应自然语言输入。在日常生活中,沟通本来就是很重要的一门课程,沟通的过程中表达越清晰,给到的信息越多,那么沟通就越顺畅。

和 ChatGPT 沟通也是同样的道理&…

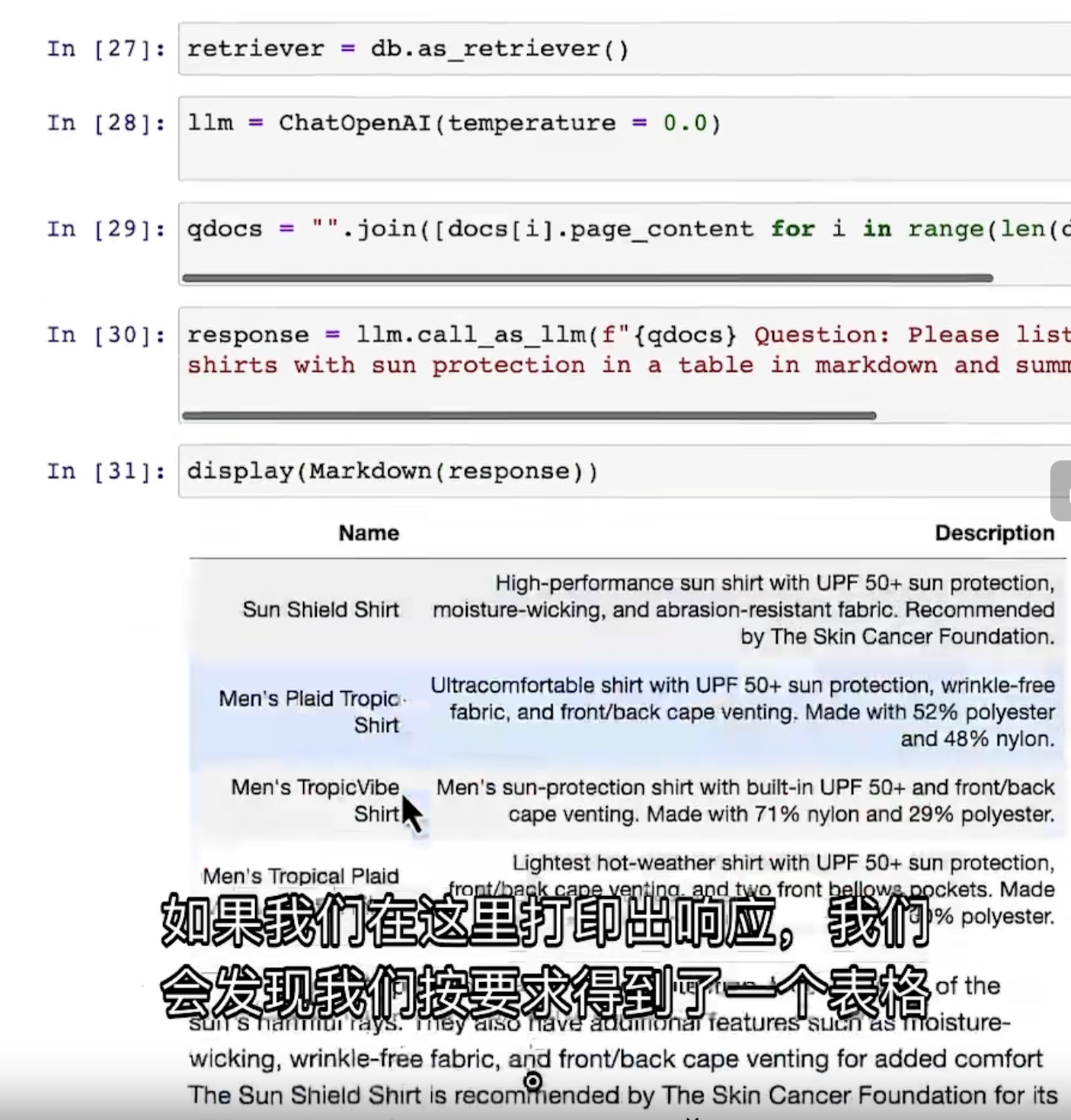

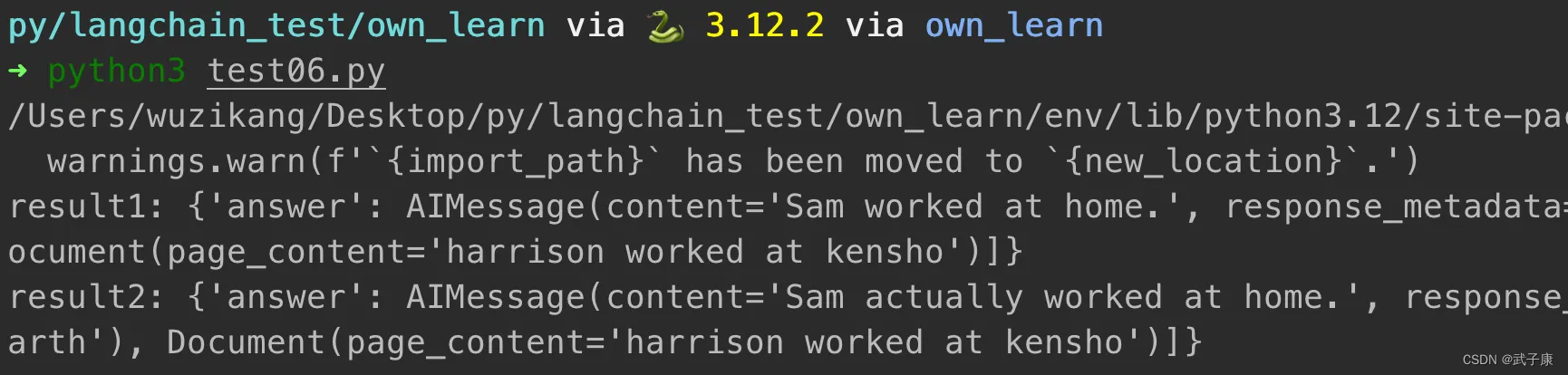

使用Langchain+GPT+向量数据库chromadb 来创建文档对话机器人

使用LangchainGPT向量数据库chromadb 来创建文档对话机器人

一.效果图如下: 二.安装包 pip install langchainpip install chromadbpip install unstructuredpip install jieba三.代码如下

#!/usr/bin/python

# -*- coding: UTF-8 -*-import os # 导入os模块&…

CentOS系统环境搭建(二十)——CentOS7安装chat GPT进阶

centos系统环境搭建专栏🔗点击跳转

CentOS7安装chat GPT进阶

Welcome to the AI era!

基于上一篇文章CentOS系统环境搭建(十九)——CentOS7安装chat GPT,我们用docker20安装了chatGPT。但,总感觉不够好。

使用dock…

电脑维修记录03-GUID GPT转换为MBR

情况是这样的,这是一个HP一体机,型号为HP Pavilion 23-q072cn,预装的Win8需要改成Win7_64bit,简单查看了一下。

启动时按ESC在打开的【启动菜单】界面,选择F9打开【引导设备选项】可以看到U盘所在的启动项。 使用U盘…

7月2日,每日信息差

1、韩旭当选女篮亚洲杯双料MVP。出战34分钟,得到26分10篮板2助攻2盖帽。最终,司职中锋的韩旭当选亚洲杯决赛MVP(最有价值球员)和赛会MVP

2、周鸿祎:不要试图用一个大模型解决所有问题

3、美国《国家地理》࿱…

基于GPT的隐变量表征解码结构

有时候我们想要用GPT(的一部分)作为预训练的隐变量解码器,应该怎么办呢?最近看论文,总结了三种隐变量注入(code injection)的方式。

1. Cheng X , Xu W , Wang T , et al. Variational Semi-Supervised Aspect-Term…

GPT2计算流程详解

GPT-2 就像传统的语言模型一样,一次只输出一个单词(token)。这种模型之所以效果好是因为在每个新单词产生后,该单词就被添加在之前生成的单词序列后面,这个序列会成为模型下一步的新输入。这种机制叫做自回归ÿ…

GPT提示词系统学习-第四课-好玩的角色指令-效果简直是YYDS了

开篇

各位奇思妙想的程序伙伴们,如果你还未加入GPT万能生成器的狂欢队伍,那现在正是时候!让我来带你短暂探访一下GPT惊艳的角色创建功能。嘘~让我们秘密派对开始!

这位万能生成器让人头疼的问题终于迎刃而解——GPT能为你吹气成猴!它帮你创作角色如同魔法一般。

首先,…

每个科研人员不可或缺的辅助工具GPT | 引领前沿与应用突破之GPT4科研实践技术与AI绘图

参加每人均可获得1个独立可永久使用的ChatGPT账号,并提供不用fanqiang使用的方法。

前言 GPT对于每个科研人员已经成为不可或缺的辅助工具,不同的研究领域和项目具有不同的需求。例如在科研编程、绘图领域:

1、编程建议和示例代码: 无论你使…

大语言模型 GPT历史简介

得益于数据、模型结构以及并行算力的发展,大语言模型应用现今呈井喷式发展态势,大语言神经网络模型成为了不可忽视的一项技术。 GPT在自然语言处理NLP任务上取得了突破性的进展,扩散模型已经拥有了成为下一代图像生成模型的代表的潜力&#x…

基于Gradio的GPT聊天程序

网上很多别人写的,要用账号也不放心。就自己写了一个基于gradio的聊天界面,部署后可以本地运行。 特点:

可以用openai的,也可以用api2d,其他api可以自己测试一下。使用了langchain的库

可以更改模型,会的…

使用老北鼻AI免费GPT对话解决gun make安装和解析iso9660的问题

在学习解析ISO9660镜像文件时,使用了GPT来了解相关的库和gun make编译器的相关知识。这个过程可真是一言难尽,每个问题的回答都模棱两可都需要去证实,不能直接复制粘贴,也不能说GPT的回答一点用也没有,至少GPT给出了一…

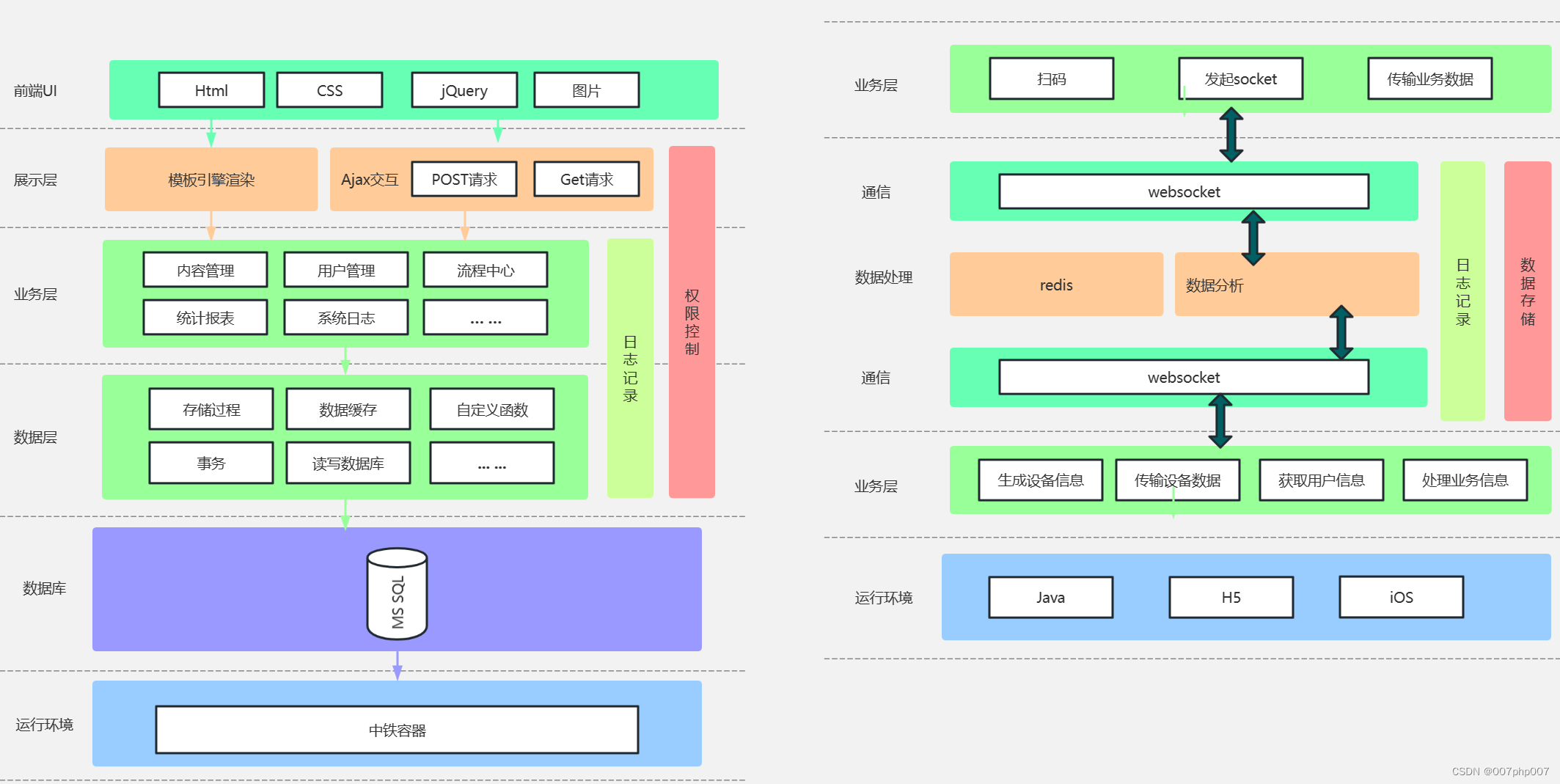

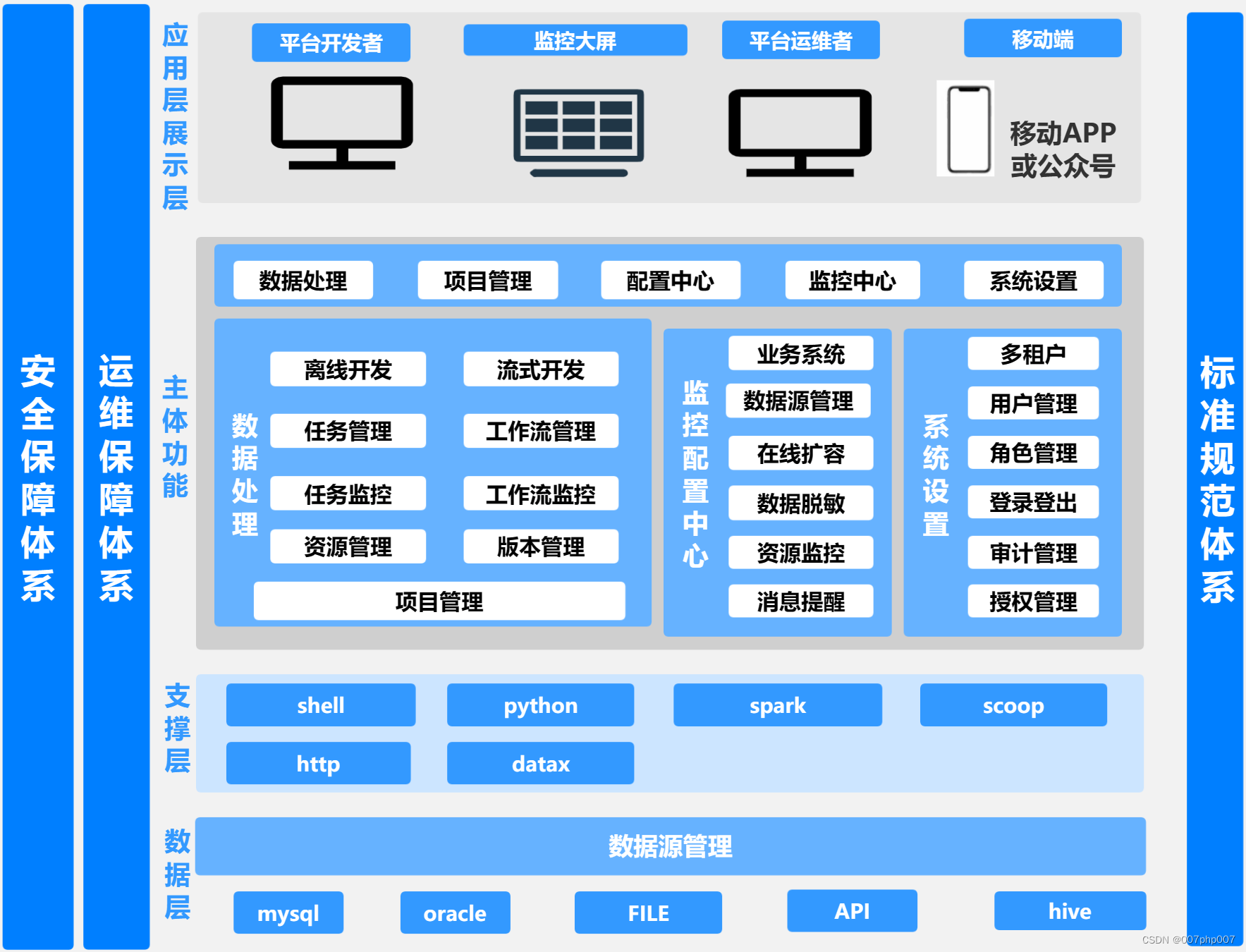

论AI GPT跨境贸易架构及其应用

摘要 2023年初,我司启动了智慧化跨境贸易供应链一体化平台的建设工作。我在该项目中担任系统架构设计师的职务,主要负责设计平台系统架构和安全体系架构。该平台以移动信息化发展为契机,采用”平台+AI”的模式解决现有应用的集中移动化需求。平台整体的逻辑复杂,对系统的高…

Prompt GPT推荐社区

大家好,我是荷逸,这次给大家带来的是我日常学习Prompt社区推荐

Snack Prompt

访问地址:http://snackprompt.com

Snack Prompt是一个采用的Prompts诱导填空式的社区,它提供了一种简单的prompt修改方式,你只需要输入关…

OpenAI 官方: 如何构建 Prompt 最佳策略

OpenAI 官方: 如何构建 Prompt 最佳策略 让 GPT 更好的理解你的需求让 GPT 不再伪造拆解任务让模型思考参考地址OpenAI 官方: 如何构建 Prompt 最佳策略

让 GPT 更好的理解你的需求

对于那些无法确认的东西,GPT 首先会猜测你的意图,为了避免更少的猜测,我们可以 在查询中…

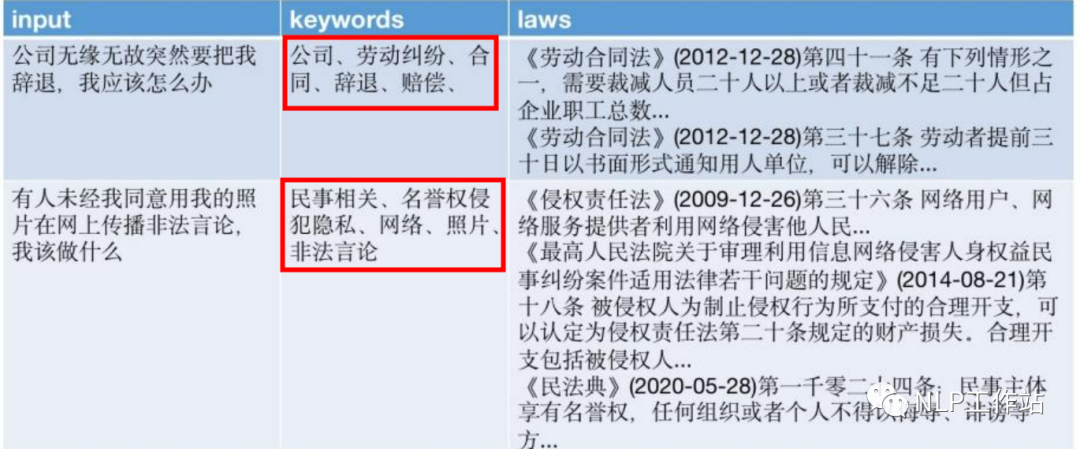

AI 律助 Alpha GPT 线上实操发布会,重磅发布!

数字化时代,随着人工智能的迅猛发展,各行各业都在积极探索通过智能化工具实现工作效率翻升的可能性。“ ChatGPT 类产品”是未来办公应用软件发展的重要趋势之一,但如何将 ChatGPT 真正应用于法律人的工作,赋能效率提升?法律行业同样面临着新的挑战和机遇。 破局的关键是实现技…

GPT引领前沿热点、AI绘图

GPT对于每个科研人员已经成为不可或缺的辅助工具,不同的研究领域和项目具有不同的需求。如在科研编程、绘图领域:

1、编程建议和示例代码: 无论你使用的编程语言是Python、R、MATLAB还是其他语言,都可以为你提供相关的代码示例。

2、数据可…

基于GPT的聊天机器人(未完待续)

入门小菜鸟,希望像做笔记记录自己学的东西,也希望能帮助到同样入门的人,更希望大佬们帮忙纠错啦~侵权立删。

目录

一、简单介绍与参考鸣谢

二、数据集介绍

三、数据预处理

1、重复标点符号表达

2、英文标点符号变为中文标点符号

3、繁…

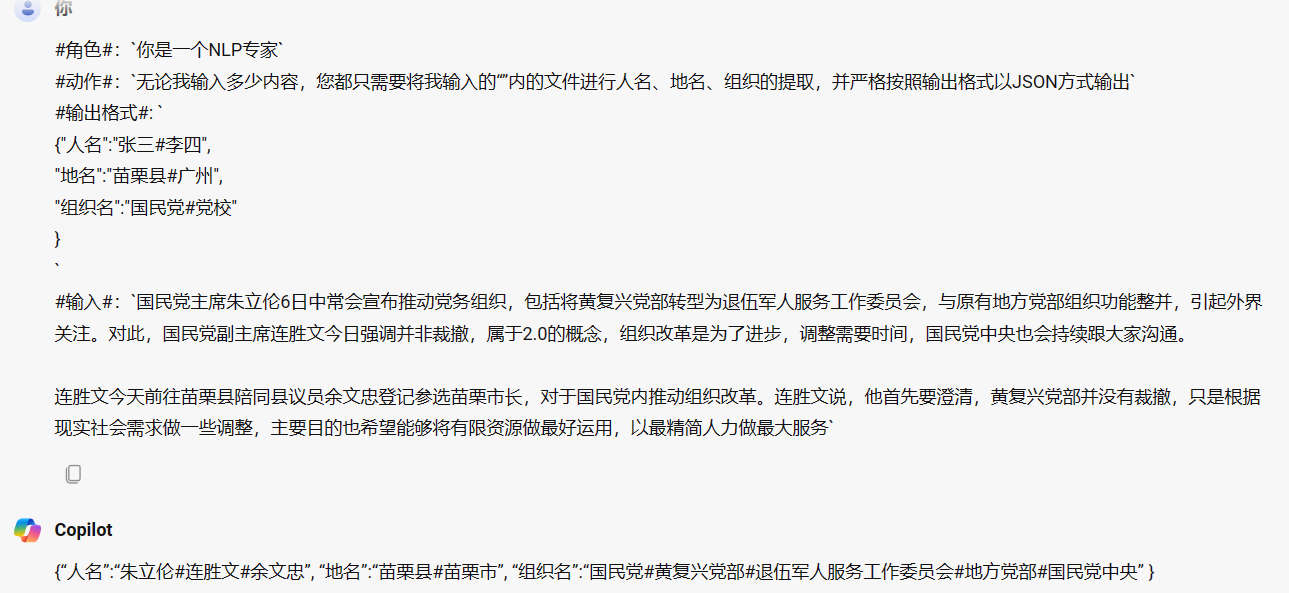

NLP与GPT联合碰撞:大模型与小模型联合发力

目录标题 NLP是什么东西?Al大小模型联合发力 NLP是自然语言处理,而GPT是自然语言生成模型。

它们的联合碰撞结果是大模型与小模型联合发力,是因为大模型可以提供更好的语言理解和生成能力,而小模型则可以更快地进行推理和预测。 …

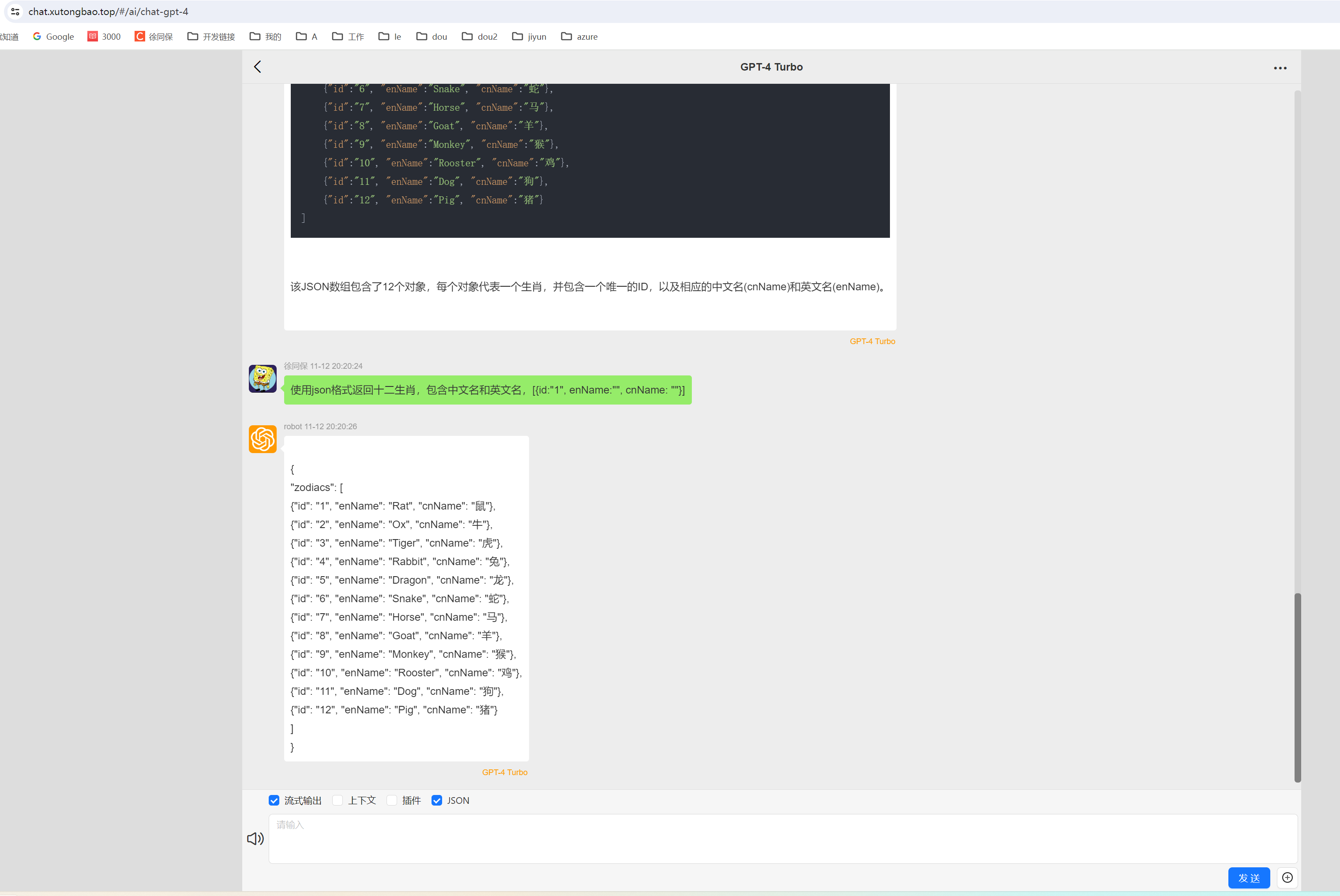

【提示工程】询问GPT返回Json结构数据

theme: orange 众所周知,我们可以通过构建的Prompt获取期望的内容,但是通常都是以自然语言返回的,假如我们想得到结构化的数据,比如Json,XML那么怎么办,这篇文章给你一个思路。 理所当然的想法 要实现询问大…

调用chat-gpt

调用chat-gpt

依赖 <dependency><groupId>org.springframework.boot</groupId><artifactId>spring-boot-starter-web</artifactId></dependency><dependency><groupId>org.springframework.boot</groupId><artifact…

# 磁盘引导方式相关知识之BIOS、msdos、MBR、UEFI、gpt、esp、csm

磁盘引导方式相关知识之BIOS、msdos、MBR、UEFI、gpt、esp、csm

磁盘、分区、引导等知识经常似懂非懂,不能完全说清楚,梳理下:

序号主板芯片引导方式支持的磁盘分区表类型支持的磁盘分区表格式对应引导位置备注1BIOS传统方式(俗…

ChatGPT追祖寻宗:GPT-1论文要点解读

论文地址:《Improving Language Understanding by Generative Pre-Training》 最近一直忙着打比赛,好久没更文了。这两天突然想再回顾一下GPT-1和GPT-2的论文, 于是花时间又整理了一下,也作为一个记录~话不多说,让我们…

用GPT干的18件事,能够真正提高学习生产力,建议收藏

用GPT干的18件事,能够真正提高学习生产力,建议收藏。 语法更正 文本翻译 语言转换 代码解释 修复代码错误 作为百科全书 信息提取 好友聊天 创意生成器 采访问题 论文大纲 故事创作 问题类比 创建 SQL 需求 情感分析 将产品描述转变为广告 关键字提取 闲…

GPT-我的左膀右臂

关于GPT的广泛使用是否会导致人们失业以及对互联网公司构成挑战的问题是一个复杂而有趣的话题。首先,让我们来讨论一下GPT的广泛应用以及我平时使用它的情况。

我平时的使用情况主要包括以下几个方面: 回答问题与解决问题: 我被用于回答用户的技术问题、…

数据不平衡GPT调研

数据不平衡 判别式和生成式的区别是什么判别式模型(Discriminative Models)生成式模型(Generative Models)对比 对于AE或者VAE这种生成式模型,其实更关注数据本身,那这种有什么好处?那对于判别式…

langchain +gpt 报错 SSLError

解决版本2种

一加入下面代码: https://www.zhihu.com/question/588395420

import os

os.environ["http_proxy"] "http://127.0.0.1:7890"

os.environ["https_proxy"] "http://127.0.0.1:7890"二降低urllib3版本

urllib3 1.25.11错…

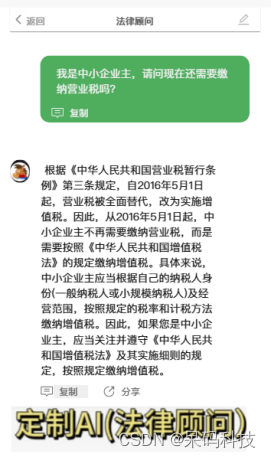

【AI新趋势期刊#1】GPT自动理解视频、法律顾问、大模型安全围栏

每天都要浏览大量AI相关新闻,是不是感到信息量爆炸,有效信息少,无从看起?

这么多新产品和新工具,到底哪些是真正是有价值的,哪些只是浮躁的热点?

想参与AI产品和工具的开发,但苦于…

版本动态 | SolidUI 0.3.0 版本发布

文章目录 背景发版清单功能部署 示例html生成模型选择数据源 详细指引贡献者如何成为贡献者 背景

随着文本生成图像的语言模型兴起,SolidUI想帮人们快速构建可视化工具,可视化内容包括2D,3D,3D场景,从而快速构三维数据演示场景。SolidUI 是一…

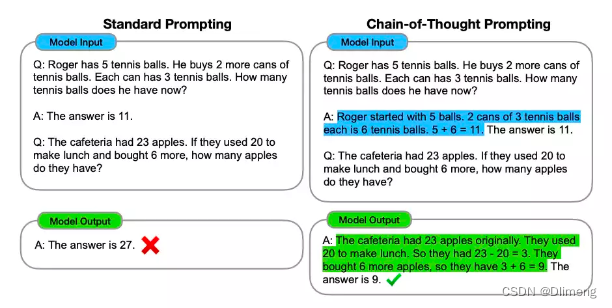

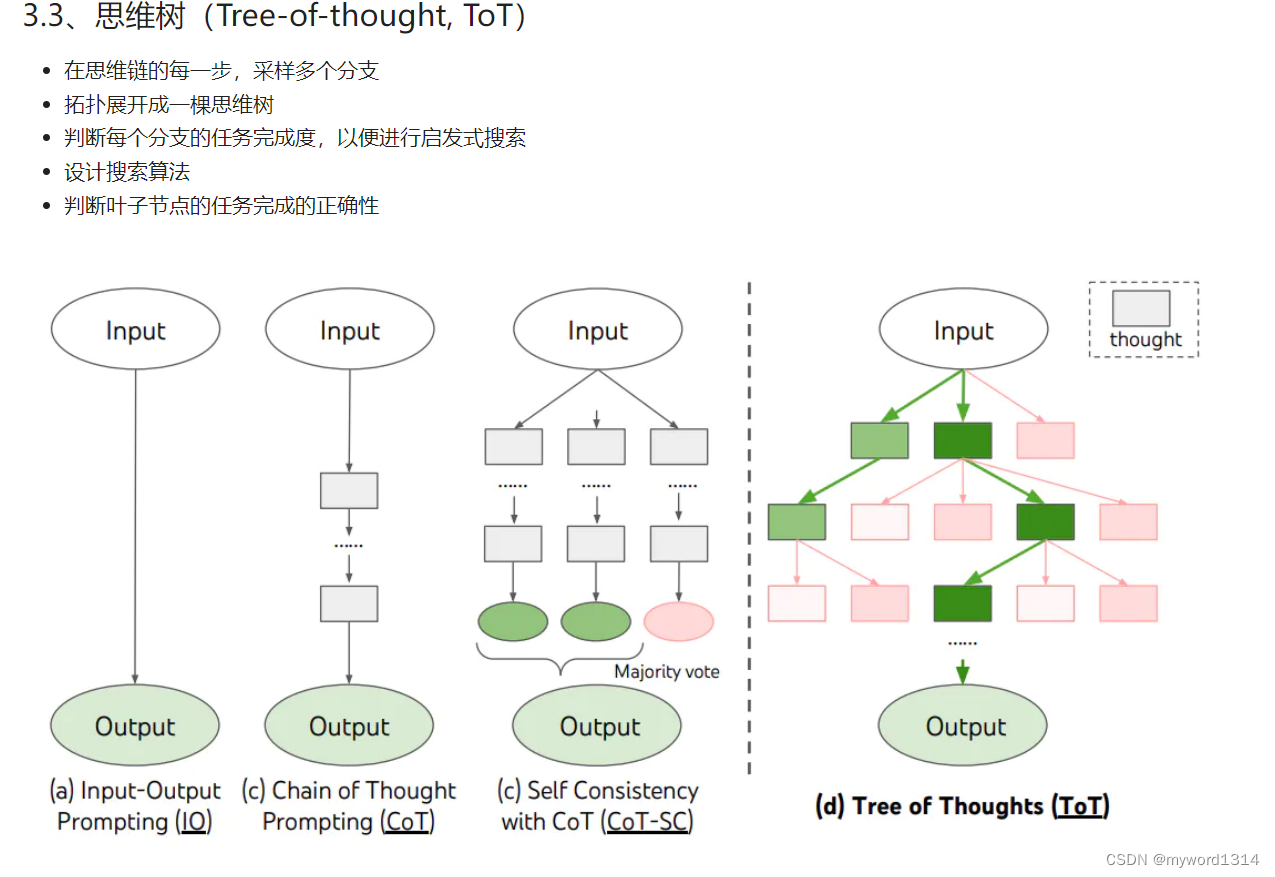

SolidUI社区-提示词链式思考(CoT)

背景

随着文本生成图像的语言模型兴起,SolidUI想帮人们快速构建可视化工具,可视化内容包括2D,3D,3D场景,从而快速构三维数据演示场景。SolidUI 是一个创新的项目,旨在将自然语言处理(NLP)与计算机图形学相…

GPT引发智能AI时代潮流

最近GPT概念爆火,许多行业开始竞相发展AI ,工作就业也将面临跳转,目前测试就业形势就分为了两大类,一类是测试行业如功能、性能、自动化综合性人才就业技能需求,另一类便是AI测试行业的需求普遍增长,原本由…

国内就能使用的chatgpt网页版,包含AIGC应用工具

Chatgpt的出现在多个领域带来了重要的影响。它能够显著提高我们的工作效率,无论是编写文案代码还是回答常见问题,都能在短时间内完成任务。通过Chatgpt,我们能够迅速获取所需答案。随着人工智能技术的不断发展,相信在未来AI能够带…

GPT的优势和GPT缺点

GPT,即Generative Pre-trained Transformer,是一种基于人工智能技术的自然语言处理模型。它采用了深度学习算法,可以通过大量的文本数据来学习自然语言的规律,并能够生成流畅、准确的语句。下面我们将探讨GPT技术的优势。

首先&a…

最新AI智能创作系统源码AI绘画系统/支持GPT联网提问/支持Prompt应用

AI绘图专业设计

不得将程序用作任何违法违纪内容,不要让亲人两行泪

界面部分图解构:

前台show:

前端部署:

安装pm2管理器

点击设置 选择v16.19.1版本-切换版本

再新建一个网站

点击设置 添加反向代理-代理名称随便…

校验 ChatGPT 4.0 真实性的三个经典问题:快速区分 GPT3.5 与 GPT4,并提供免费测试网站

现在已经有很多 ChatGPT 的套壳网站,以下分享验明 GPT-4 真身的三个经典问题,帮助你快速区分套壳网站背后到底用的是 GPT-3.5 还是 GPT-4。 大家可以在这个网站测试:https://ai.hxkj.vip,免登录可以问三条,登录之后无限…

ChatGPT或将引发现代知识体系转变

作为当下大语言模型的典型代表,ChatGPT对人类学习方式和教育发展所产生的变革效应已然引起了广泛关注。技术的快速发展在某种程度上正在“倒逼”教育领域开启更深层次的变革。在此背景下,教育从业者势必要学会准确识变、科学应变、主动求变、以变应变&am…

WorkPlus AI智能助理,基于GPT为企业提供专属的私有化部署解决方案

在当今数字时代,优质的客户服务是企业取得成功的重要因素之一。随着人工智能技术的不断发展,私有化部署AI智能客服成为企业提高客户体验、提升服务效率的新途径。WorkPlus作为领先的品牌,专注于提供可信赖的私有化部署解决方案,助…

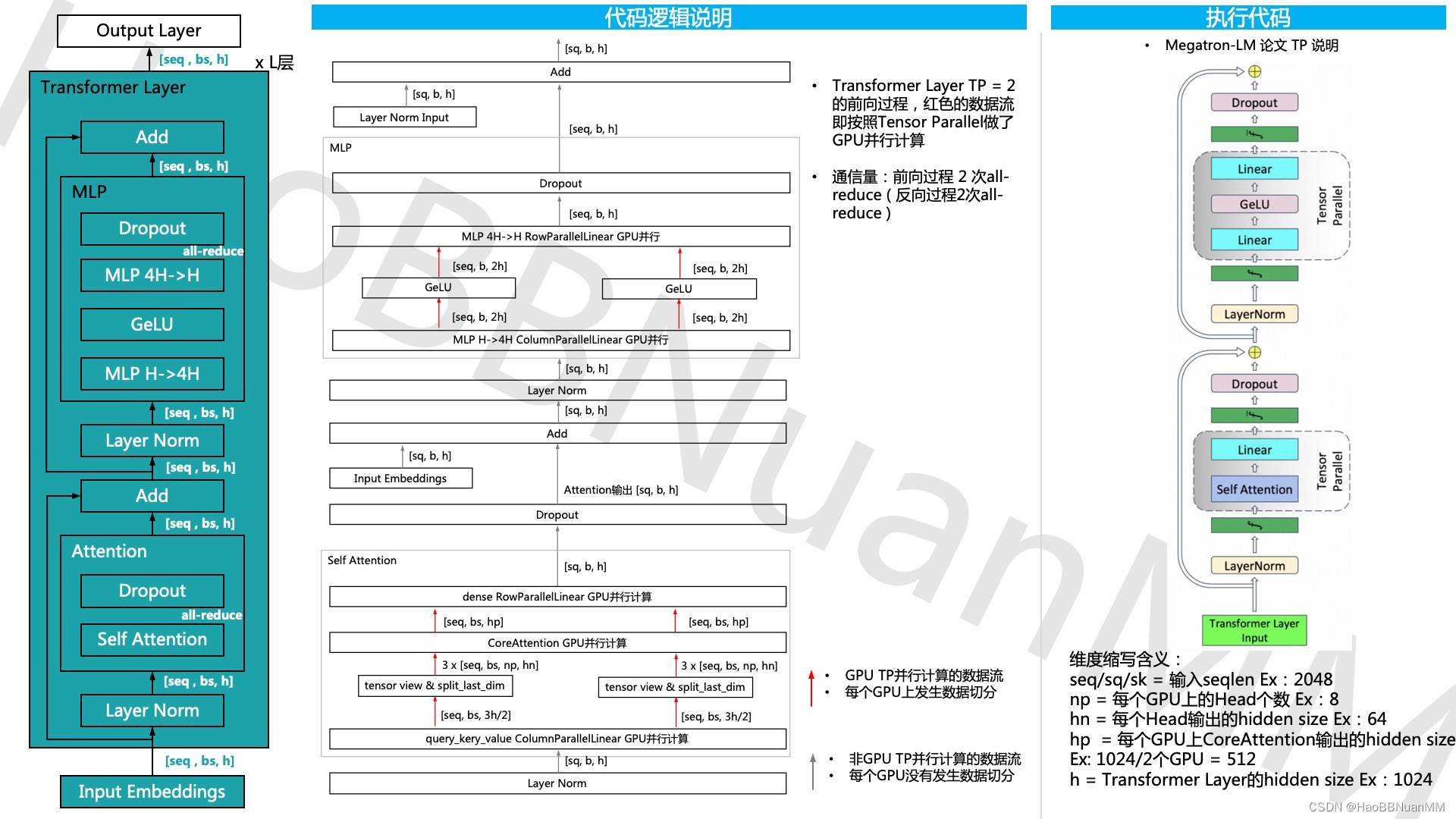

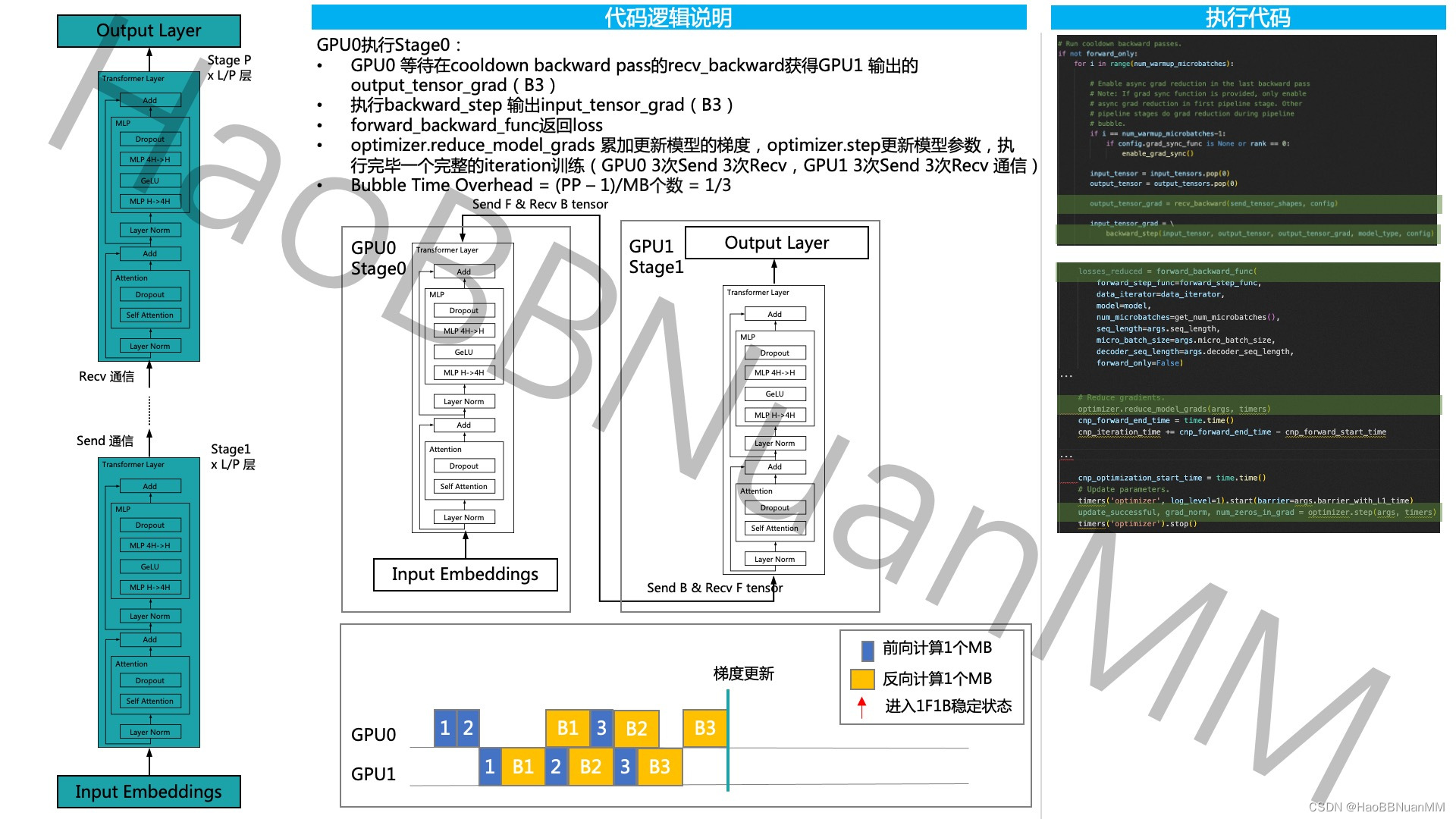

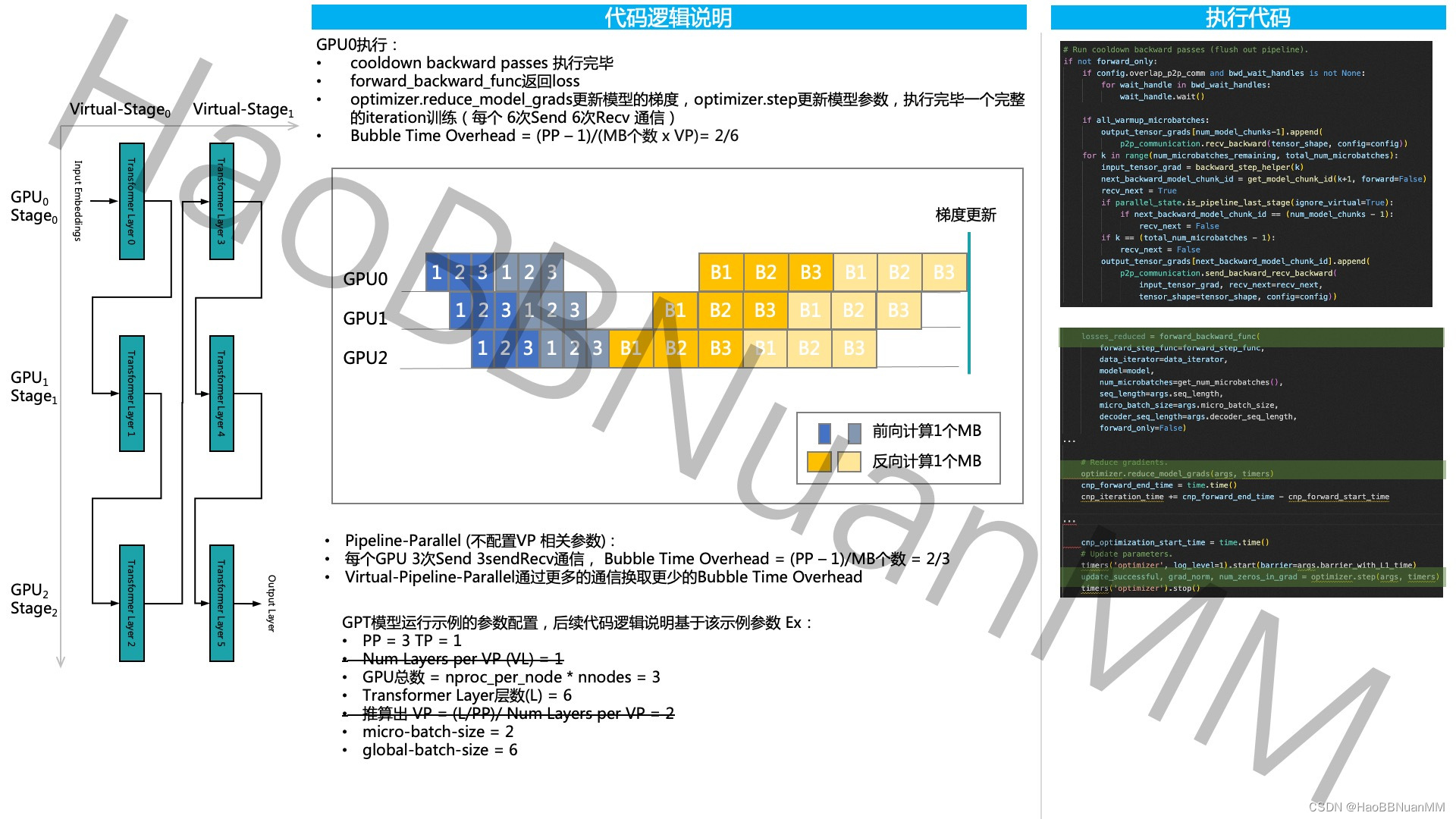

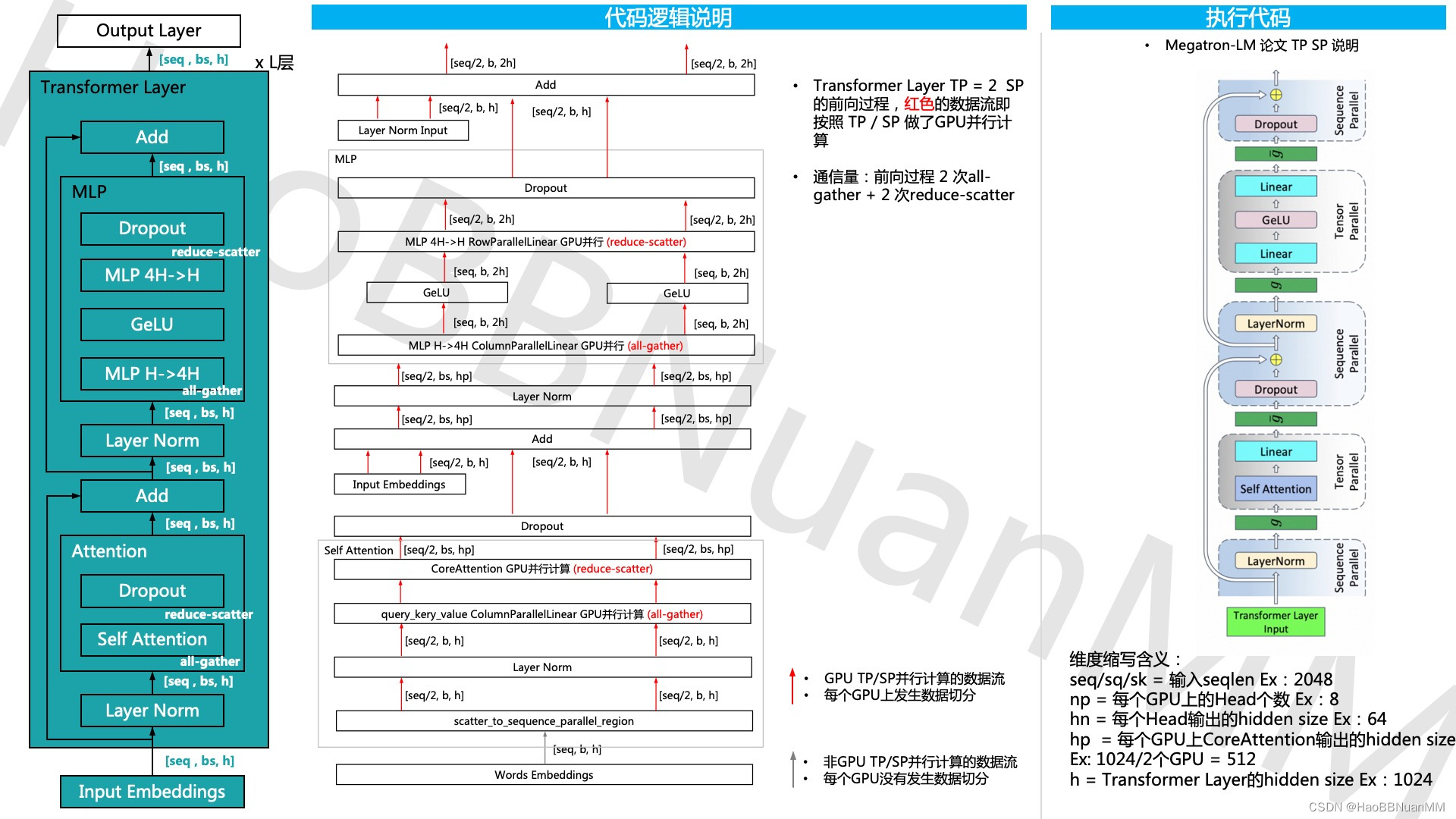

Megatron-LM GPT 源码分析(一) Tensor Parallel分析

引用

本文基于开源代码 https://github.com/NVIDIA/Megatron-LM ,通过GPT的模型运行示例,从三个维度 - 模型结构、代码运行、代码逻辑说明 对其源码做深入的分析。 Tensor Parallel源码分析

AutoGPT:自动化GPT原理及应用实践

一、AutoGPT介绍

想象一下,生活在这样一个世界里,你有一个人工智能助手,它不仅能够理解你的需求,而且还能够与你一起学习与成长。人工智能已无缝融入我们工作、生活,并帮助我们有效完成各种目标。大模型技术的发展与应…

GPT的前世今生:从gpt1到chatgpt的能力提升

从2017年google brain提出transformer模型,到2018年基于transformer模型open ai推出了gpt1模型以及google推出了bert模型,到2019-2021年open ai陆续推出gpt2和gpt3,再到2022-2023年推出chat-gpt和gpt4,大语言模型已经发展成了一个…

讯飞星火大模型V3.0 WebApi使用

讯飞星火大模型V3.0 WebApi使用

文档说明:星火认知大模型Web文档 | 讯飞开放平台文档中心 (xfyun.cn)

实现效果 初始化

首先构建一个基础脚手架项目

npm init vuelatest用到如下依赖

"dependencies": {"crypto-js": "^4.2.0",&q…

一日一技:Python如何同时调用多个GPT的API?

相信很多同学或多或少都在Python中使用过GPT API,通过Python安装openai库,来调用GPT模型。

OpenAI官方文档中给出了一个示例,如下图所示:

OpenAI API 测试 如果你只有一个API账号,那么你可能不觉得这样写有什么问题。…

第13期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练 Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

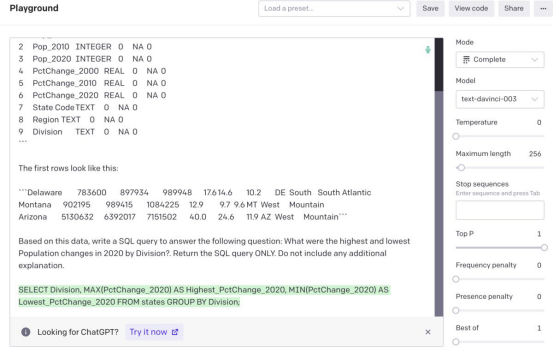

GPT做SQL查询引擎的自然语言

目录

面向企业查询的生成式人工智能

步骤1:将示例数据转换为单字符字符串

步骤2:为大型语言模型(LM)创建提示符

步骤3:将数据发送到OpenAI的API

步骤4:执行GPT返回的SQL代码的结果

步骤5(可选)&#…

Megatron-LM GPT 源码分析(三) Pipeline Parallel分析

引言

本文接着上一篇【Megatron-LM GPT 源码分析(二) Sequence Parallel分析】,基于开源代码 GitHub - NVIDIA/Megatron-LM: Ongoing research training transformer models at scale ,通过GPT的模型运行示例,从三个维…

是否会有 GPT-5 的发布?

本心、输入输出、结果 文章目录 是否会有 GPT-5 的发布?前言围绕 GPT-5 的信息OpenAI 期待增长GPT-5 - 到底是真的在训练,还是一个虚构的故事Sam Altman字里行间包含的信息我们在什么时候可以期待 GPT-5 的发布GPT-5 预计将在哪些方向努力GPT-5 在听觉领域GPT-5 在视频处理领…

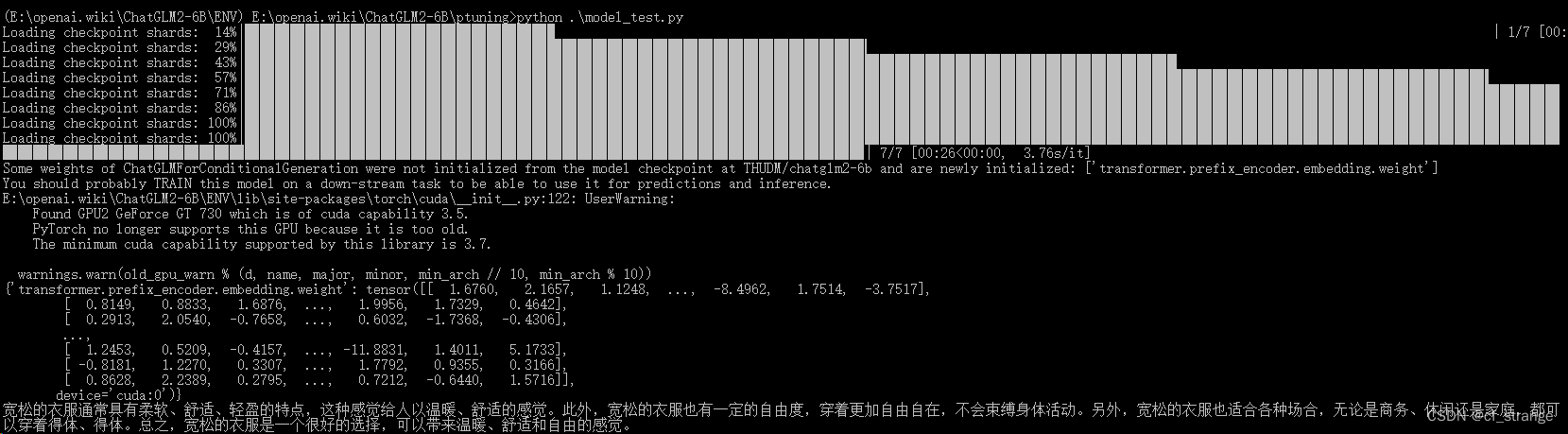

GPT实战系列-如何用自己数据微调ChatGLM2模型训练

GPT实战系列-如何用自己数据微调ChatGLM2模型训练 目录 GPT实战系列-如何用自己数据微调ChatGLM2模型训练1、训练数据广告文案生成模型训练和测试数据组织: 2、训练脚本3、执行训练调整运行 4、问题解决问题一问题二问题三问题四 1、训练数据

广告文案生成模型

输…

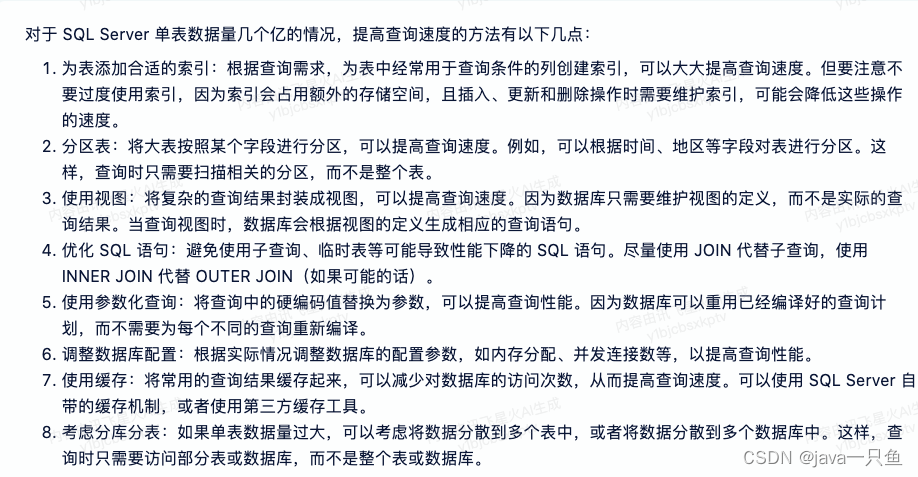

chat gpt 在开发当中的应用

chatgpt 出来已经有一段时间了,本人在开发的过程中也是有去使用。 经常使用的是讯飞大模型和通义千问,在使用的过程中,个人感觉讯飞大模型在写代码方面会比较智能。

比如问一个 sqlser 单表 数据量 几个亿如何处理的问题,讯飞会给…

NExT-GPT复现之——llama踩坑

NExT-GPT复现了快一周,库一多真的各种BUG!各种release和flag不一样也导致配置起来顾此失彼。等配置完了一定搞一个docker发出来!

这里记录一下llama踩坑。

由于llama2发布,llama1的权重很难申请到。学生邮箱两周都没消息。想使用…

如何理解AutoGPT

AutoGPT和GPT-4都是OpenAI公司的产品。AutoGPT是一个实验性开源应用程序,展示了GPT-4语言模型的能力。GPT-4是OpenAI研发的人工智能语言模型。

AutoGPT在GitHub主页上有151k星(151k星代表了151,000个用户点赞了该项目),AutoGPT获…

第17期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练 Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

微软宣布推广数字助理 Copilot;GPT 应用开发和思考

🦉 AI新闻

🚀 微软宣布推广基于生成式人工智能的数字助理 Copilot

摘要:微软宣布将基于生成式人工智能的数字助理 Copilot 推广到更多软件产品中。新的 AI 助理 Microsoft Copilot 将在 Windows 中无缝可用,包括 Windows 11 桌面…

用GPT 搭建一个占星术、解梦、塔罗牌占卜和命理学服务

今天来尝试我们的占星术、解梦、塔罗牌占卜和命理学服务,揭开宇宙的奥秘并获得自我认识

聊天 GPT API 集成的 HTML5 模板。我们的目标是提供易于使用且高度可定制的 API 代码,使您能够训练自己的人工智能解决方案并将其添加到提示中。

我们的产品是可定…

免费分享自建GPT网站,畅享无限创意!

PS:该文章基本为GPT3.5 撰写

这里与大家分享一个令人兴奋的消息:我建立了一个全新的GPT网站,并且我将免费提供给大家使用!这个网站基于最新的GPT-3.5 Turbo模型,能够为您带来无限的创意和惊喜。

在这个免费的GPT网站…

ChatGPT对未来发展的影响?一般什么时候用到GPT

ChatGPT以其强大的自然语言处理能力对未来的发展具有重要影响。以下是ChatGPT的潜在影响和一般使用情况: 改善自然语言理解和生成:ChatGPT和类似的模型可以改善机器对人类语言的理解和生成。这将有助于改进各种应用领域,包括智能助手、聊天机…

使用 PyTorch 构建自定义 GPT

一、介绍 介绍大模型,首先考虑一下使用 ChatGPT、Bing Chat 或 Bard 。您是否想过拥有自己的 ChatGPT 会是什么样子?想象一下创建自己的 GPT 模型的兴奋程度。这确实是一种难以置信的感觉! 为了开始构建自定义 GPT 的旅程,让我们仔…

GPT Store上线 OpenAI 的「iPhone时刻」这回真来了

OpenAI首届全球开发者大会上,Sam Altman再次给AI行业扔了一系列重磅炸弹。GPT-4 Turbo、GPT Store和定制化的GPT在大会上发布,OpenAI的生态体系初具雏形。

GPT模型刚升级了不到24小时,高能网友就开始用它的定制化功能创造了各种有趣的应用。…

80个国内可用的Chatgpt网页版(2023.10.21更新)

ChatGPT:革命性的人工智能语言模型

ChatGPT,一款能够与人类进行自然流畅对话的人工智能语言模型,通过大量训练数据和先进算法,展现出卓越的自然语言处理能力。它能理解并回应人类问题,提供准确、连贯且有意义的答案&a…

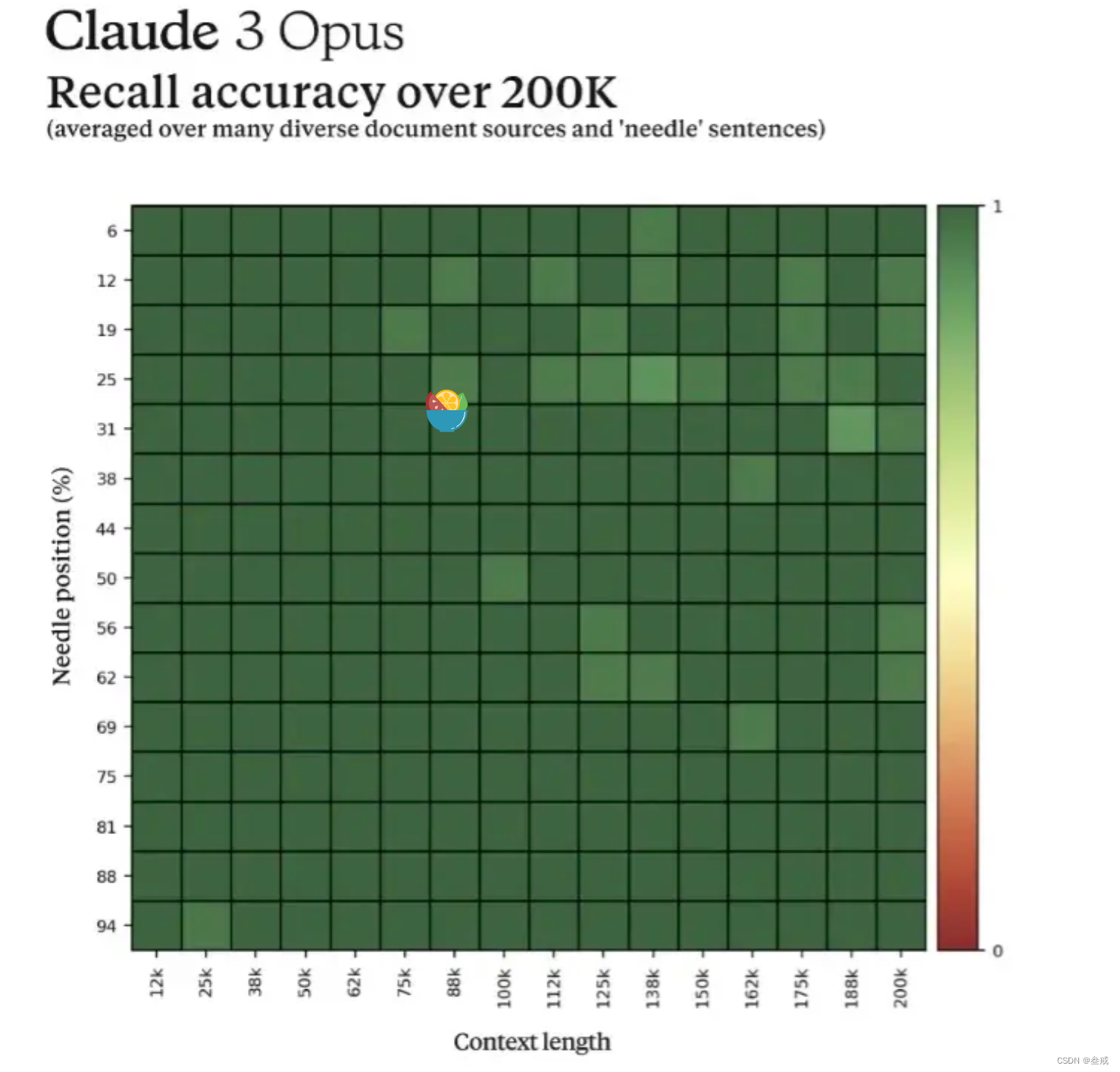

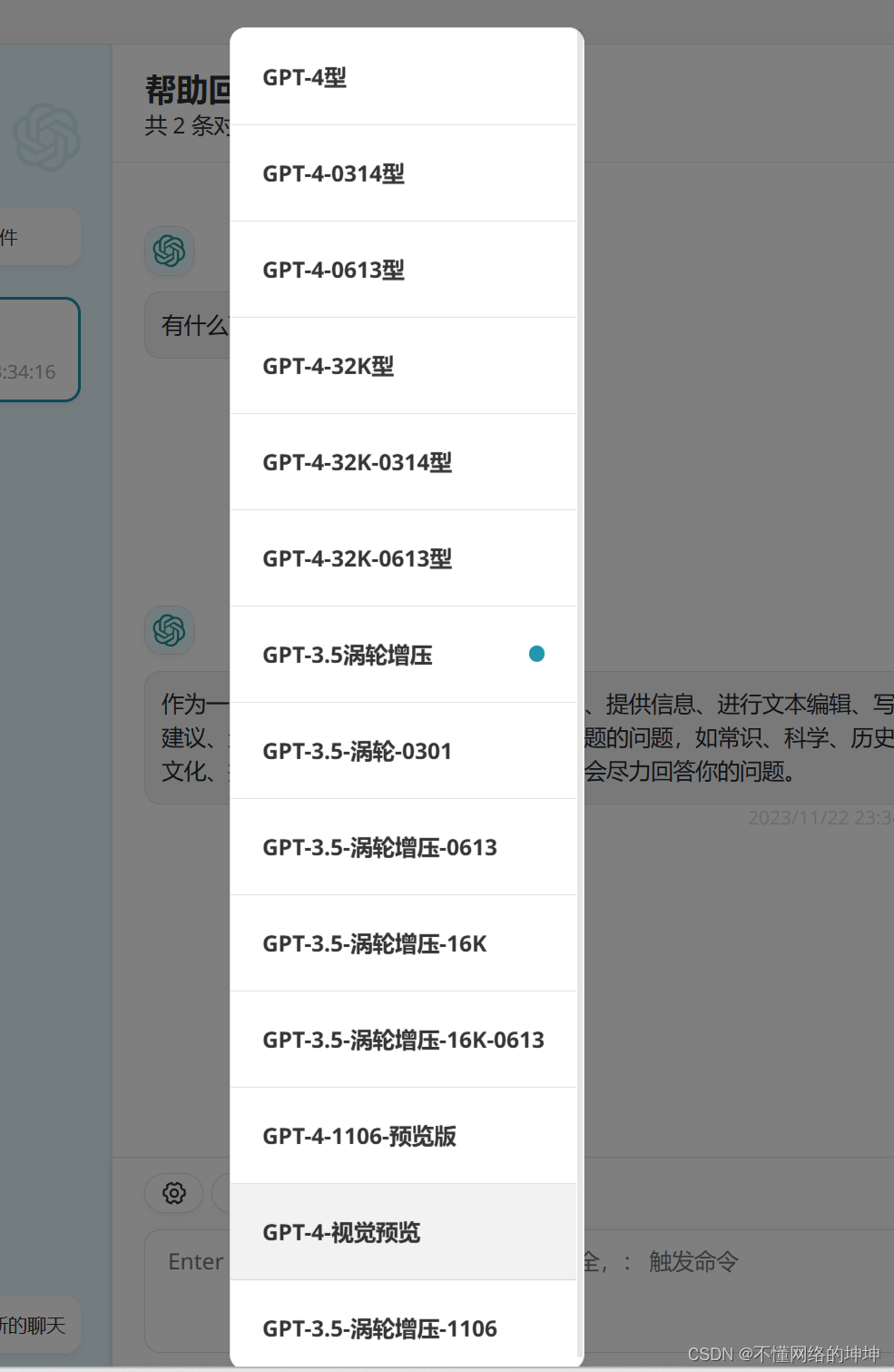

OpenAI发布会,看看GPT又有哪些大动作!2023.11.7【浓缩精华】

ChatGPT GPT-4 Turbo其它applications 北京时间11月7日OpenAI首届开发者大会

GPT-4 Turbo

Context length 支持12.8万个上下文contextMore control JSON模式 可复制输出 未来:在API中查看日志Better knowledge 平台启动检索 拥有截至2023年3月的知识New modaliti…

最新AI智能写作创作系统源码V2.6.4/AI绘画系统/支持GPT联网提问/支持Prompt应用

一、AI创作系统

SparkAi创作系统是基于OpenAI很火的ChatGPT进行开发的Ai智能问答系统AI绘画系统,支持OpenAI GPT全模型国内AI全模型。本期针对源码系统整体测试下来非常完美,可以说SparkAi是目前国内一款的ChatGPT对接OpenAI软件系统。那么如何搭建部署…

ChatGPT-3.5 插件推荐:语音输入,视频总结,联网检索

前言

GPT4 里是有内置的插件市场的,不过博主一直觉得自己对这个工具的使用还不够到位,现在购买升级版性价比不划算所以暂时还没有开。不过今天在学习使用的时候,发现 GPT3.5 也是可以通过网页插件方式进行升级扩展的,而且功能还比…

DevChat:开发者专属的基于IDE插件化编程协助工具

DevChat:开发者专属的基于IDE插件化编程协助工具 一、DevChat 的介绍1.1 DevChat 简介1.2 DevChat 优势 二、DevChat 在 VSCode 上的使用2.1 安装 DevChat2.2 注册 DevChat2.3 使用 DevChat 三、DevChat 的实战四、总结 一、DevChat 的介绍 在AI浪潮的席卷下&#x…

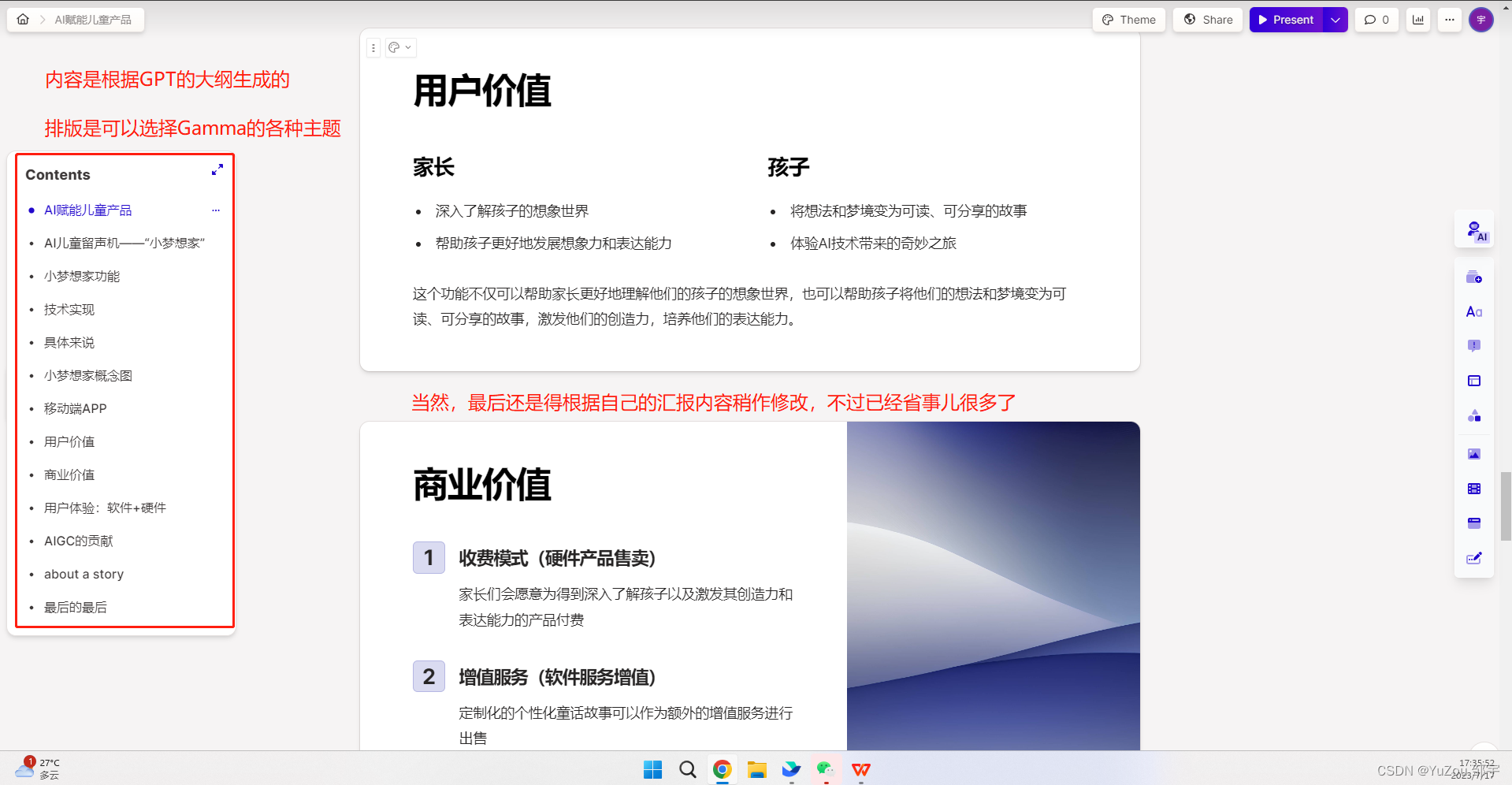

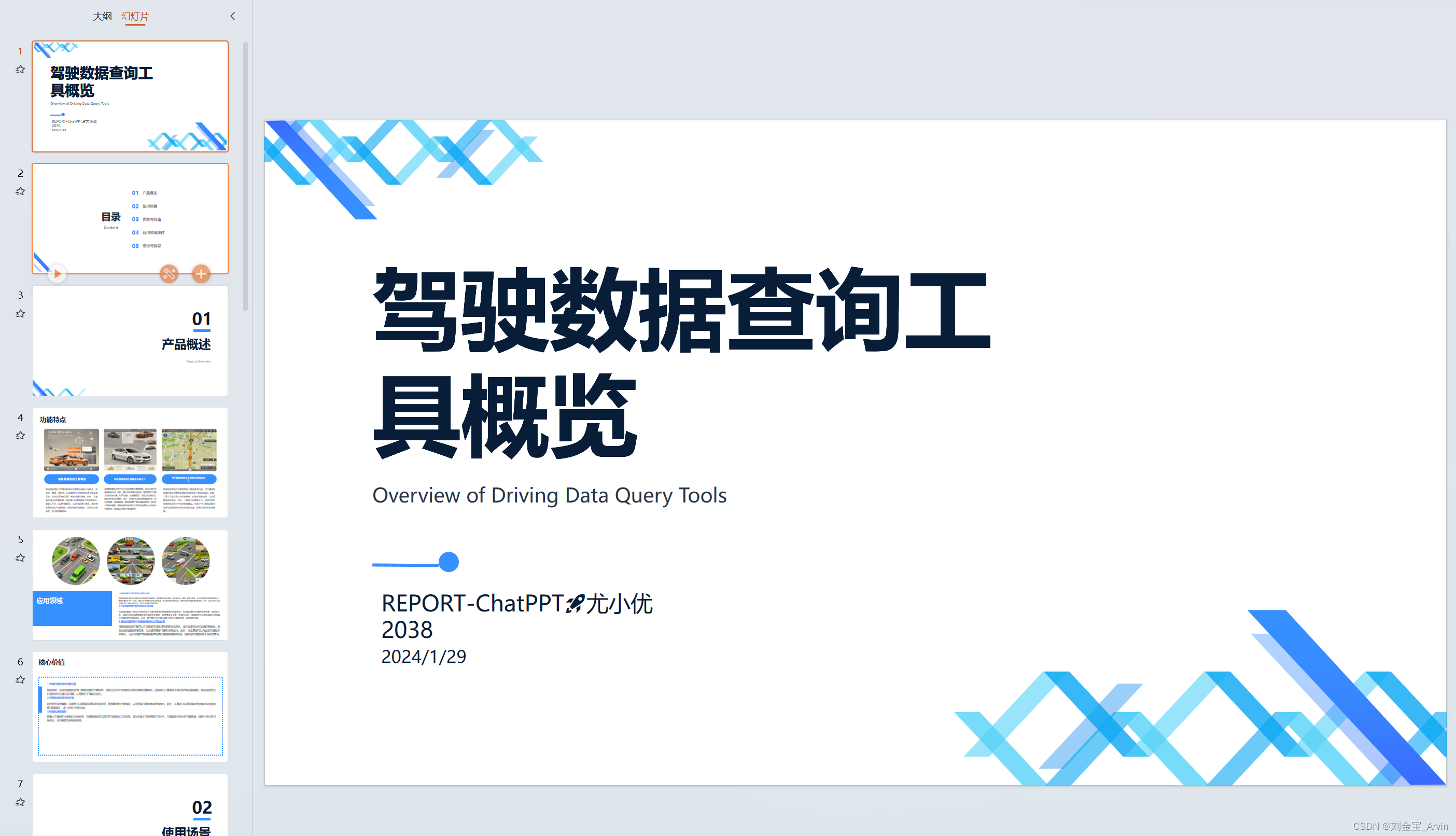

AI生成PPT工具——Gamma,结合GPT生成不错的效果

AI生成PPT工具——Gamma,结合GPT生成不错的效果 先告诉GPT我现在要参加一个比赛,请他帮忙梳理一下内容。当然整个过程需要不断调整,GPT生成的内容也不是一次就是最好的 不断调整之后让其列出提纲即可,如下: 紧接着我们…

GPT 学习法:恐怖算力 + 精确算法,实现复杂文献轻松的完美理解、在庞大的不确性中找到确定性

GPT 学习法:恐怖算力 精确算法,实现复杂文献轻松的完美理解、在庞大的不确性中找到确定性 复杂文献 - 恐怖算力 精确算法,复杂文献轻松的完美理解GPT 理解法 - 举例子、归纳、逻辑链推导本质、图示、概念放大器实战案例:学习高精…

软件测试人员提问常用的ChatGPT通用提示词模板

如何设计有效的软件测试用例? 如何运用自动化测试工具进行软件测试? 如何进行软件的功能测试、性能测试和安全测试? 如何评估软件测试的质量和覆盖范围? 软件测试有哪些常见的缺陷和错误,如何识别和解决࿱…

快速在WIN11中本地部署chatGLM3

具体请看智谱仓库github:GitHub - THUDM/ChatGLM3: ChatGLM3 series: Open Bilingual Chat LLMs | 开源双语对话语言模型

或者Huggingface:https://huggingface.co/THUDM/chatglm3-6b

1. 利用Anaconda建立一个虚拟环境:

conda create -n chatglm3 pyt…

内容运营常用的ChatGPT通用提示词模板

内容定位:请帮助我明确我们的内容定位,包括目标受众、内容类型、主题、风格等方面的内容,以便我能够更好地制定内容策略和规划。 内容策划:请帮助我制定一个详细的内容策划方案,包括内容主题、风格、形式、发布时间等…

用户运营常用的ChatGPT通用提示词模板

如何建立和完善用户运营体系,提高用户满意度和忠诚度? 如何制定有效的用户获取和留存策略,提高用户生命周期价值? 如何运用多种渠道和平台进行用户运营,提高用户参与度和互动性? 如何建立和维护用户社群…

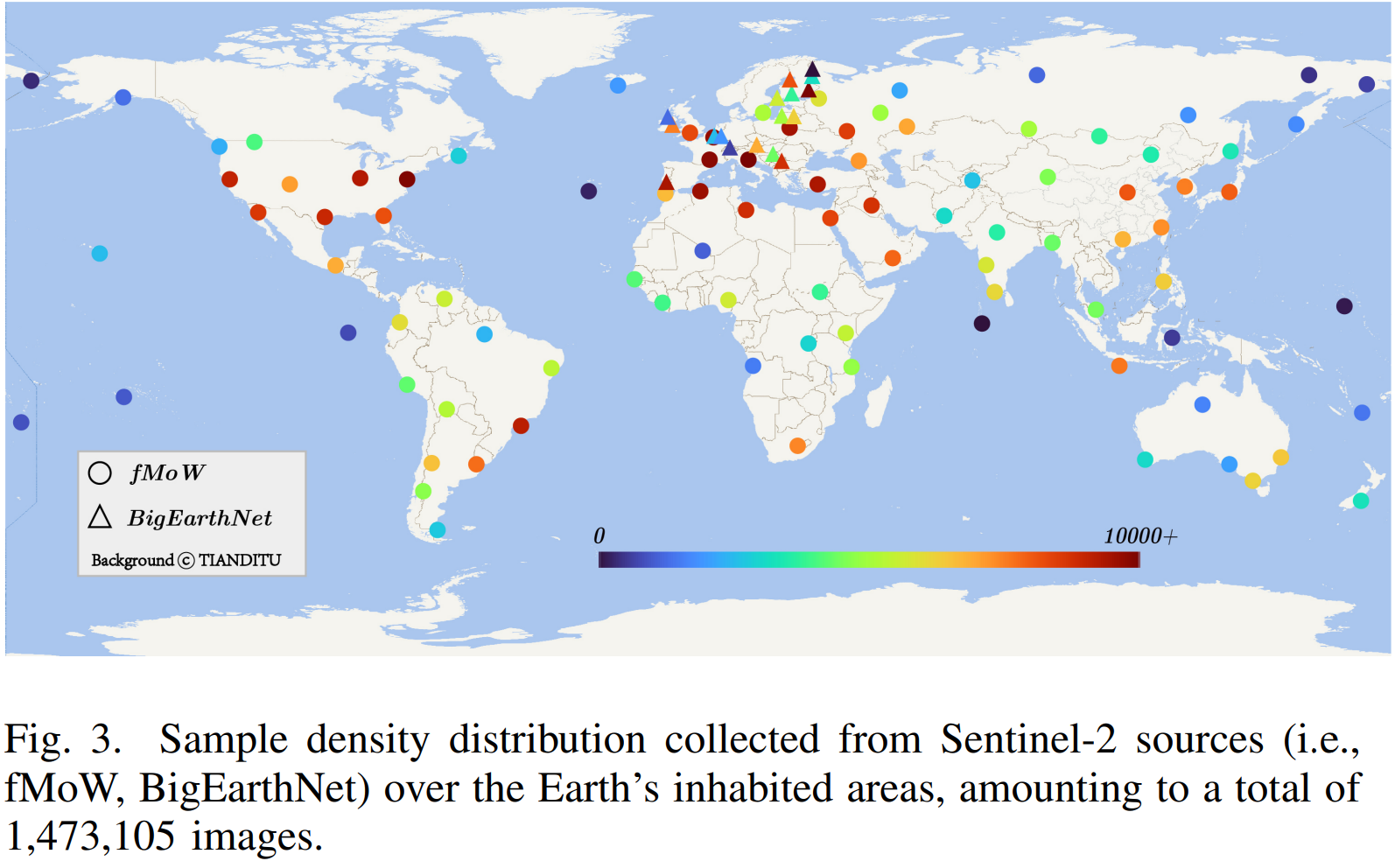

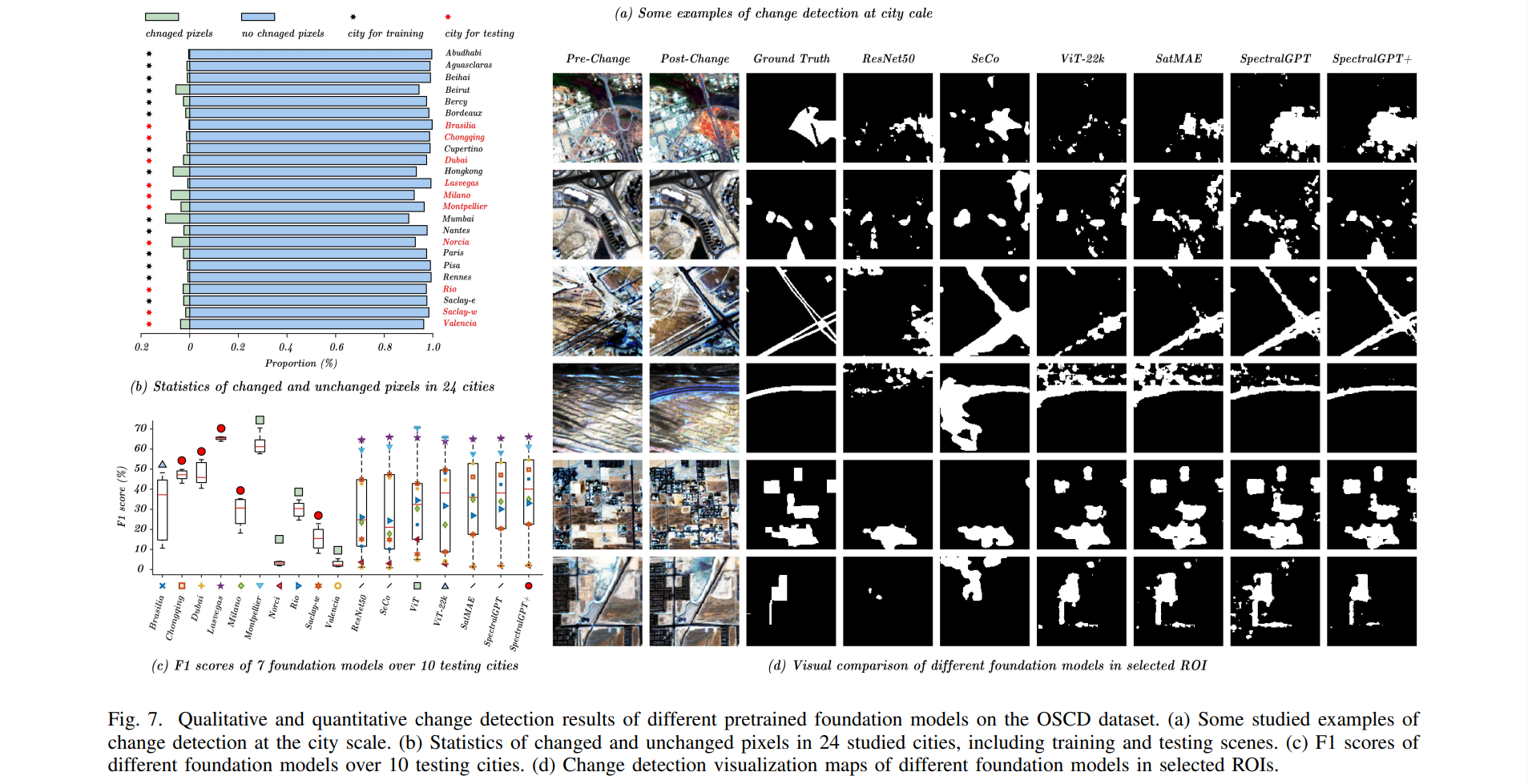

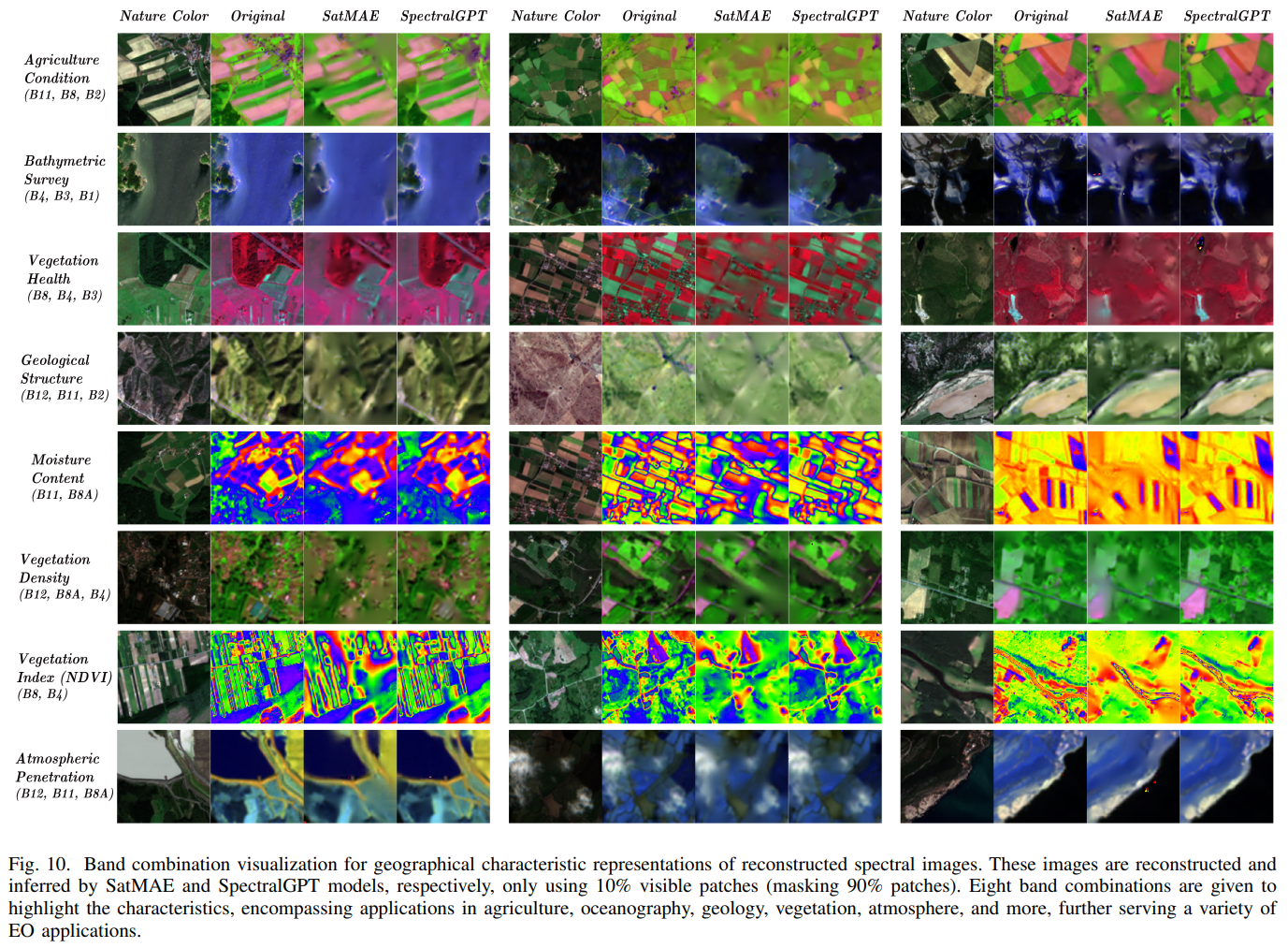

SpectralGPT: Spectral Foundation Model 论文翻译1

遥感领域的通用大模型 2023.11.13在CVPR发表

原文地址:[2311.07113] SpectralGPT: Spectral Foundation Model (arxiv.org)

摘要

基础模型最近引起了人们的极大关注,因为它有可能以一种自我监督的方式彻底改变视觉表征学习领域。虽然大多数基础模型…

SpectralGPT: Spectral Foundation Model 论文翻译2

遥感领域的通用大模型 2023.11.13在CVPR发表

原文地址:[2311.07113] SpectralGPT: Spectral Foundation Model (arxiv.org)

实验

在本节中,我们将严格评估我们的SpectralGPT模型的性能,并对其进行基准测试SOTA基础模型:ResN…

免费获取GPT-4的五种工具

不可否认,由OpenAI带来的GPT-4已是全球最受欢迎的、功能最强大的大语言模型(LLM)之一。大多数人都需要使用ChatGPT Plus的订阅服务去访问GPT-4。为此,他们通常需要每月支付20美元。那么问题来了,如果您不想每月有这笔支…

【云上探索实验室】快速入门AI 编程助手 Amazon CodeWhisperer ——码上学堂领学员招募

目录 一、Amazon CodeWhisperer1.1、大语言模型与AI编程1.2、CodeWhisperer初体验 二、云上探索实验室-码上学堂2.1、码上学堂2.2、学课通道入口 三、领学员招募3.1、报名方式3.2、领学奖励 一、Amazon CodeWhisperer

1.1、大语言模型与AI编程

大语言模型(Large L…

从零构建属于自己的GPT系列1:文本数据预处理、文本数据tokenizer、逐行代码解读

🚩🚩🚩Hugging Face 实战系列 总目录 有任何问题欢迎在下面留言 本篇文章的代码运行界面均在PyCharm中进行 本篇文章配套的代码资源已经上传 从零构建属于自己的GPT系列1:文本数据预处理 从零构建属于自己的GPT系列2:语…

实测_GPT_Assistant

1 资源 openai 客户端源码: https://github.com/openai/openai-python/ openai 各种 API 示例: https://platform.openai.com/examples assistant 示例: https://platform.openai.com/docs/assistants/overview

2 Assistant 功能

代码解…

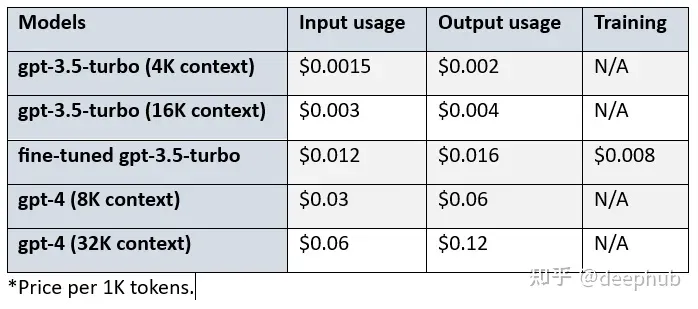

使用GPT-4训练数据微调GPT-3.5 RAG管道

原文:使用GPT-4训练数据微调GPT-3.5 RAG管道 - 知乎

OpenAI在2023年8月22日宣布,现在可以对GPT-3.5 Turbo进行微调了。也就是说,我们可以自定义自己的模型了。然后LlamaIndex就发布了0.8.7版本,集成了微调OpenAI gpt-3.5 turbo的…

GPT技术的崛起:改变生活与挑战未来

GPT的广泛使用引发了许多关于其影响的讨论,包括可能对就业和互联网公司的存活造成挑战。在这篇博客中,我们将探讨这些问题,并分享我们自己在日常生活中如何使用GPT的经验。

1 GPT技术的广泛应用

GPT,或者通用预训练模型&#x…

【工具】OCR方法|不用下载额外的软件,提取扫描中英文PDF的目录文本的最优解!(一)

需求: 1)从PDF里快速提取目录; 2)不想下载任何软件。

我提取出来的目录文本会用于嵌入到PDF中,向PDF批量添加目录的软件以及软件的使用方法可以看我上一篇文章:PDF批量插入目录。

以下是我自己能想到的方…

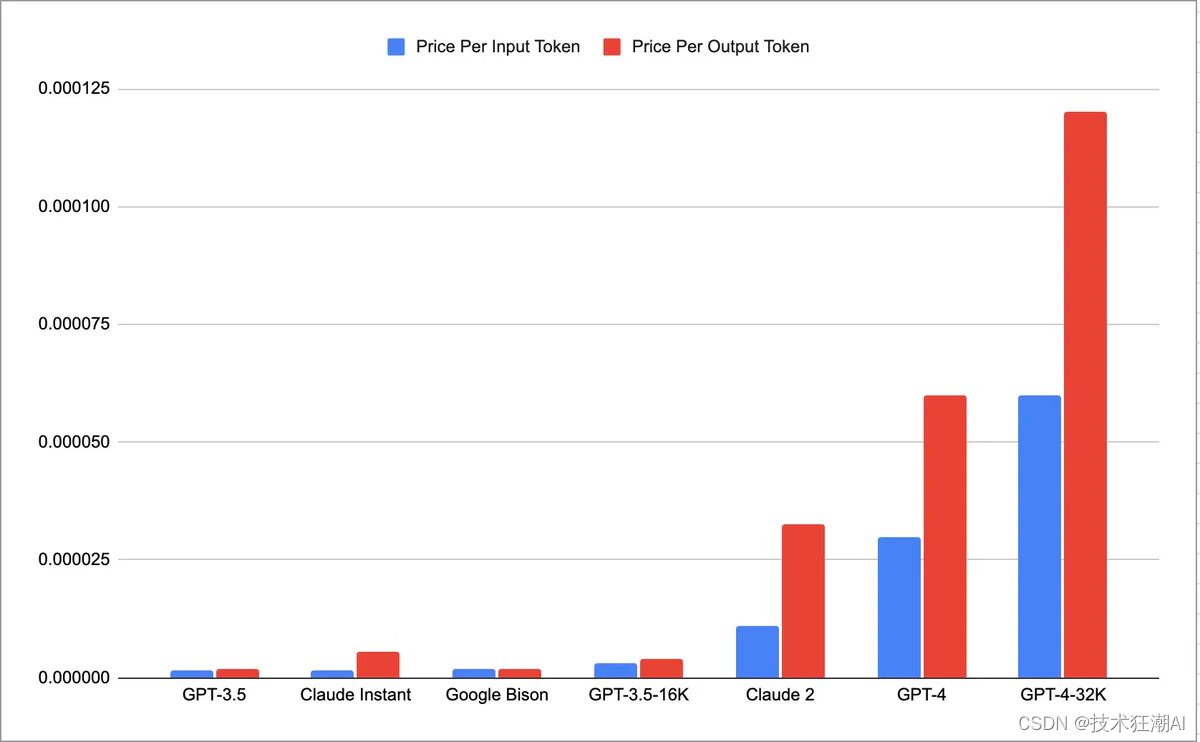

OpenAI开发者大会掀起风暴:GPT模型价格狂降50%,应用商店即将亮相,AI技术将引爆全球!

OpenAI首届开发者大会召开了! 关键信息:

GPT-4升级版GPT-4 Turbo来了,上下文窗口达到128k,为GPT-4的4倍;OpenAI还降低了几乎所有模型的API使用价格,整体便宜了一半多;GPT-4系列的多模态能力向B…

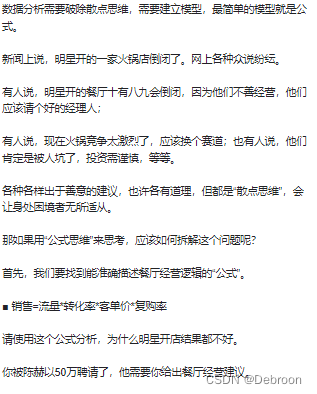

GPT 学习法:复杂文献轻松的完美理解、在庞大的不确性中找到确定性

GPT 学习法:复杂文献轻松的完美理解、在庞大的不确性中找到确定性 复杂文献 - 基础理解GPT 理解法 - 举例子、归纳、逻辑链推导本质、图示、概念放大器GPT 分析法 - 二分、矩阵、公式、要素、过程 做复杂题:在庞大的不确性中找到确定性思维追踪ÿ…

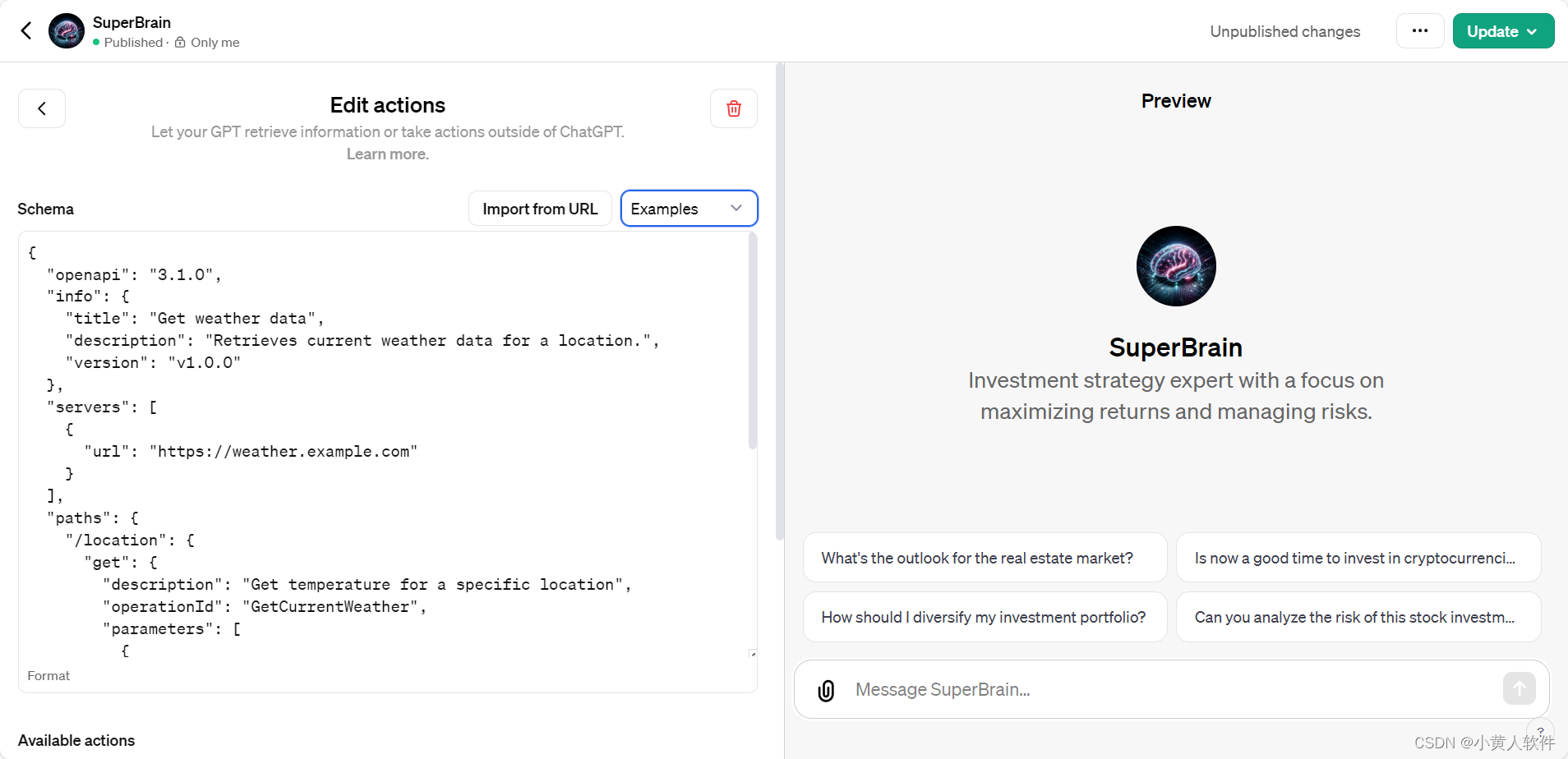

GPTS应用怎么创建?GPTS无法创建应用很卡怎么办

在首届开发者大会上,OpenAI宣布推出了GPTs功能,也就是GPT Store,类似App Store的应用商店,任何用户都可以去参与创建应用。那么GPTS应用该如何创建?碰到应用无法创建很卡怎么办呢?下面就为大家带来GPTS应用创建图文教程…

硝烟弥漫的科技战场——GPT之战

没想到2023年的双11之后,还能看到如此多的科技圈大佬针对GPT提出火药味十足的讨论和极具戏剧性的表演。

历史回顾:

11月6日,OpenAI发布会:GPT-4 Turbo模型、GPT应用商店、开源Whisper-large-v3等;11月17日࿰…

游戏运营常用的ChatGPT通用提示词模板

游戏上线前规划:请帮助我了解游戏上线前的准备工作,包括游戏定位、游戏特色、游戏测试等方面的内容,以便我能够更好地制定游戏上线计划。 游戏上线后运营:请帮助我了解游戏上线后的运营工作,包括玩家反馈、数据分析、…

GPT 中文提示词技巧:参照 OpenAI 官方教程

前言

搜了半天什么 prompt engineering 的课,最后会发现 gpt 官方其实是有 prompt 教程的。因此本文主要是学习这篇教程。

概述 - OpenAI API

部分案例是参考:根据吴恩达老师教程总结出中文版prompt教程_哔哩哔哩_bilibili up主的内容。

一、尽可能清…

互联网产品经理常用的ChatGPT通用提示词模板

产品规划和设计:请帮助我规划和设计一款互联网产品,包括市场调研、用户需求分析、产品功能设计、产品原型设计等方面的内容,以便我能够更好地满足用户需求并开发出优秀的产品。 产品开发和迭代:请帮助我进行互联网产品的开发和迭…

从零构建属于自己的GPT系列2:模型训练1(预训练中文模型加载、中文语言模型训练、逐行代码解读)

🚩🚩🚩Hugging Face 实战系列 总目录 有任何问题欢迎在下面留言 本篇文章的代码运行界面均在PyCharm中进行 本篇文章配套的代码资源已经上传 从零构建属于自己的GPT系列1:数据预处理 从零构建属于自己的GPT系列2:模型训…

手把手用GPT开发小程序全流程!就是这么easy~

大家好,我是五竹。

前段时间用GPT开发了一款小程序:GPT真牛批!三天开发一个小程序,三天积累了2000的用户,上周末抽空又接入了流量主,感兴趣的同学可以围观一下。

今天就来带大家走一遍用GPT开发一款小程序的全过程&a…

ASP.NET版本WOL服务的使用

本文以WOL为例,演示如何通过 GPT-4 让其为 WebAPI 项目设计一个网页。其中介绍了如何让GPT4生成相关功能,添加动画效果,接口鉴权等。 1. 背景

前面我们已经完成了一个WOL服务的开发,并将其迁移改造为了 ASP.NET 服务并完成了部署…

gpt是如何进行训练的?

原理

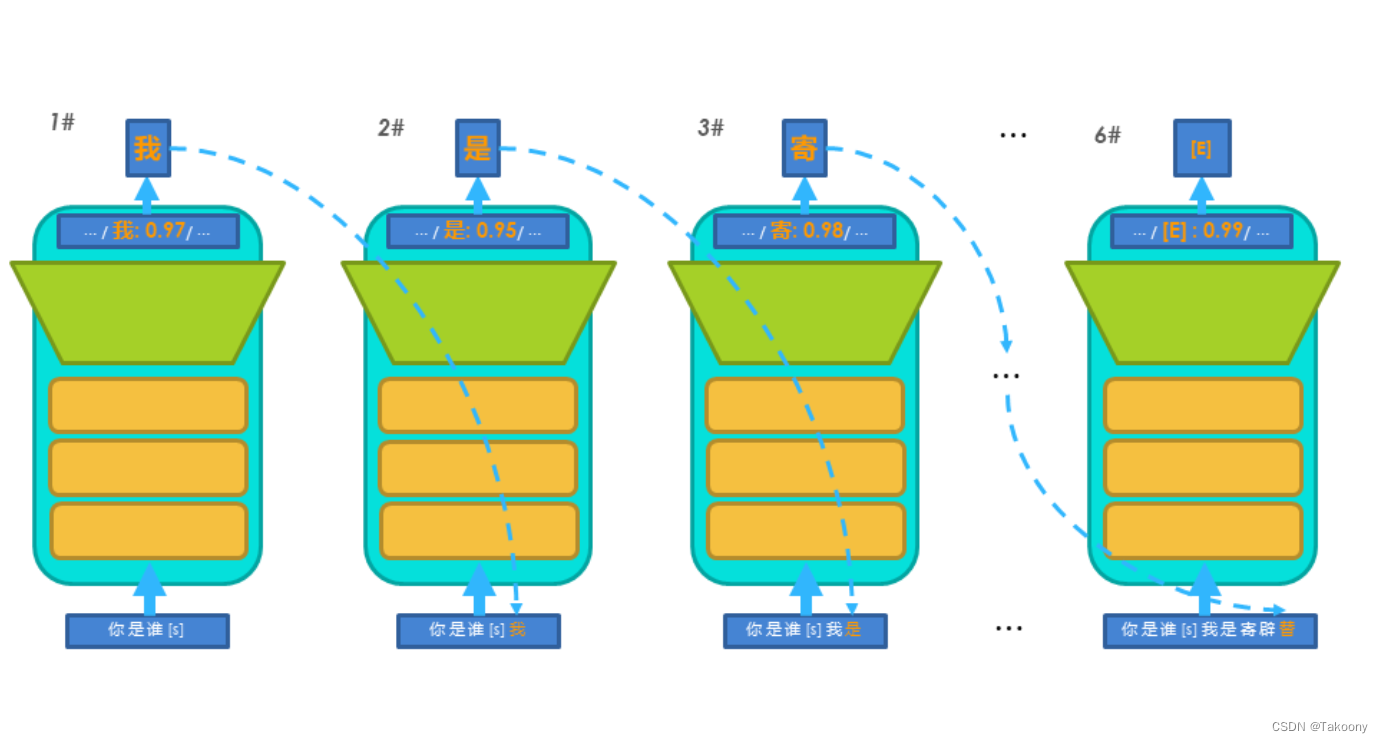

gpt就是一个类似于成语接龙的游戏,根据之前的n个字符,预测下一个字符,那么gpt的输入和输出是如何构造的呢?比如给一个句子如下: sentence:如何理解gpt的原理。 构造gpt输入输入: input&am…

用户增长常用的ChatGPT通用提示词模板

用户画像:请帮助我了解目标用户的特点和需求,包括年龄、性别、职业、兴趣等方面的内容,以便我能够更好地定位和推广。 用户获取渠道:请帮助我了解用户主要从哪些渠道获取我们的产品或服务,以便我能够更好地优化获取渠…

深度学习神经网络加大batchsize训练速度降低的原因(GPT)

在深度学习中,批量大小(batch size)是指在每次参数更新时一次性输入到模型中的样本数量。通常情况下,增大批量大小可以提高训练过程中的计算效率,因为可以利用并行计算的优势。然而,当批量大小过大时&#…

GPT最佳实践:五分钟打造你自己的GPT

前几天OpenAI的My GPTs栏目还是灰色的,就在今天已经开放使用了。有幸第一时间体验了一把生成自己的GPT,效果着实惊艳!!!我打造的GPT模型我会放到文章末尾,大家感兴趣也可以自己体验一下。 打造自己的GPT模型…

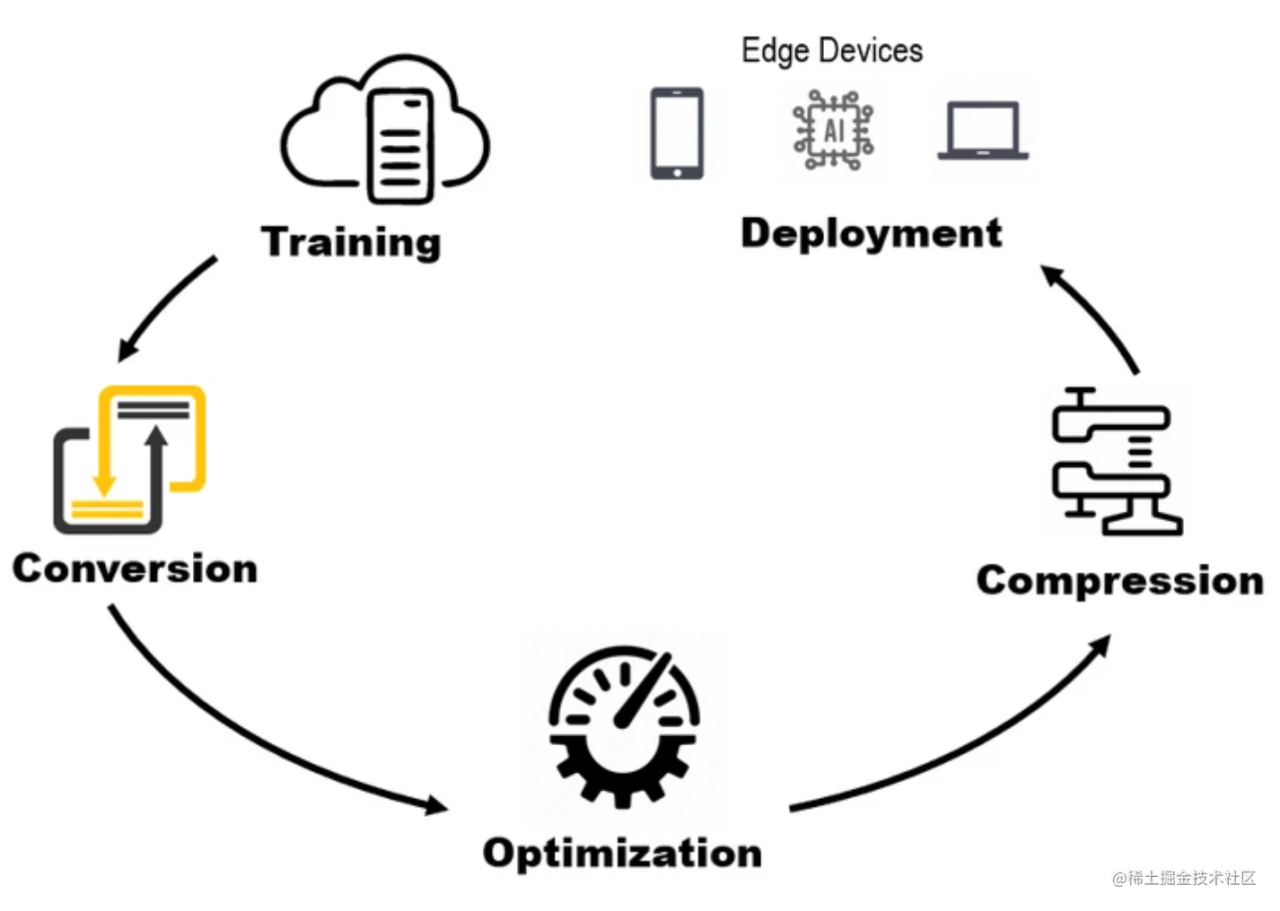

AICore 带来了 Android 专属的 AI 能力,它要解决什么?采用什么架构思路?

前言

Google 最近发布的 Gemini 模型在全球引起了巨大反响,其在多模态领域的 Video demo 无比震撼。对于 Android 开发者而言,其中最振奋人心的消息莫过于 Gemini Nano 模型将内置到 Android 系统当中,并开放给开发者使用。

事实上…

ChatGPT的prompt技巧 心得

ChatGPT的prompt心得 写在最前面chatgpt咒语1(感觉最好用的竟然是这个,简单方便快捷,不需要多轮对话)chatgpt思维链2(复杂任务更适用,简单任务把他弄复杂了)机理chatgpt完整咒语1(感…

Centos 如何判断分区是mbr还是gpt格式

1 介绍

MBR

自20世纪80年代初以来的标准分区表格式每个驱动器最多支持四个主分区最多可以划分2TB的磁盘

GPT

GPT是MBR分区表格式的后续每个驱动器最多支持128个分区可以将一个磁盘分区到最大到18艾字节 对小于2TB的磁盘使用MBR对大于2TB的磁盘使用GTP 2 查询方式

2.1 fdis…

渠道运营常用的ChatGPT通用提示词模板

渠道选择和分析:请帮助我了解不同类型的渠道,包括电商平台、社交媒体、内容平台等,并分析它们的优缺点,以便我能够更好地选择适合我们产品的渠道。 渠道合作和谈判:请帮助我与渠道合作伙伴进行谈判,包括合…

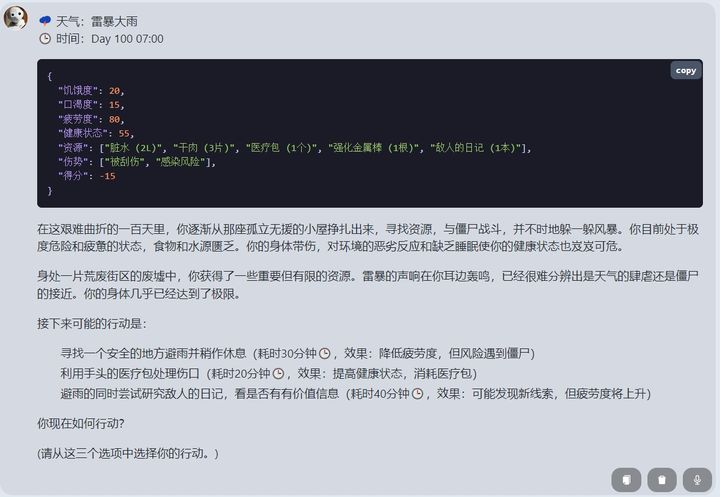

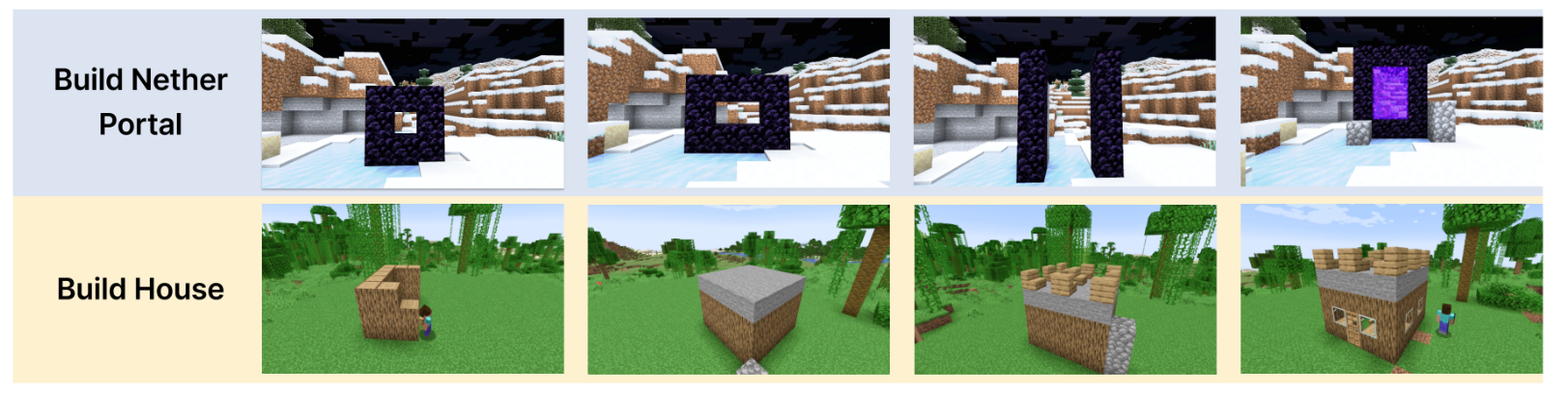

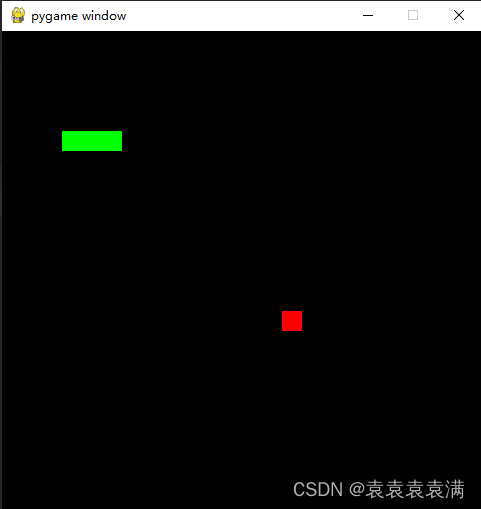

GPT实现开放式世界游戏实践【生化危机】

最近开始研究如何基于GPT构建一个游戏引擎,于是先从简单的文字游戏开始探索。

从最简单的选择机制、故事机制,完善成一个包括天气、事件、技能、属性、伙伴、建造系统的-生化危机版文字游戏-。 我唯一的体验是:AI游戏,大有可为! …

移动产品经理常用的ChatGPT通用提示词模板

产品定位:如何明确移动产品的定位? 需求分析:如何进行移动产品的需求分析? 产品规划:如何制定移动产品的整体规划? UI设计:如何设计移动产品的用户界面? UX设计:如何…

分享几个可以免费使用GPT的网站

ChatGPT这个是国产的,里面可以使用3.5和4.0,免费用户每日都有各自的使用次数,反应迅速。文言一心国内百度的chart8新用户200次,但只能用3.5,响应速度有点慢

各有优缺点,大家看个人情况使用,个人…

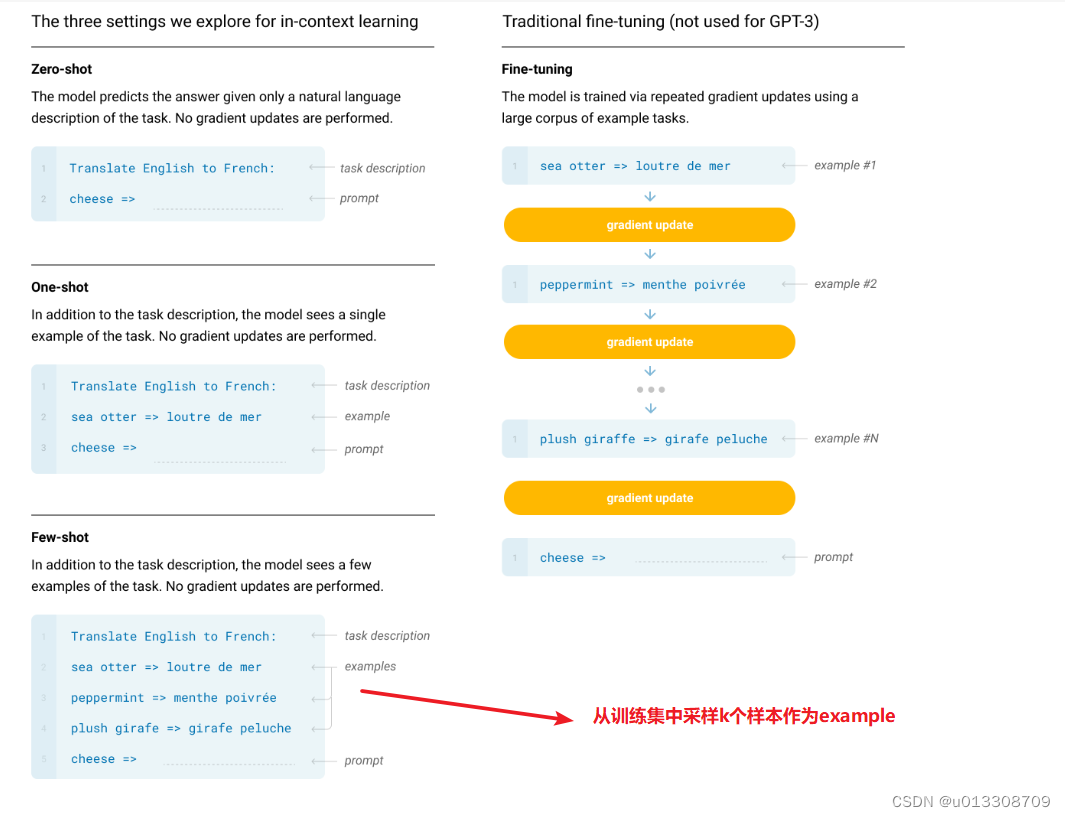

小白理解GPT的“微调“(fine-tuning)

对于GPT-3.5,我们实际上并不能在OpenAI的服务器上直接训练它。OpenAI的模型通常是预训练好的,也就是说,它们已经在大量的语料上进行过训练,学习到了语言的基本规则和模式。

然而,OpenAI提供了一种叫做"微调"…

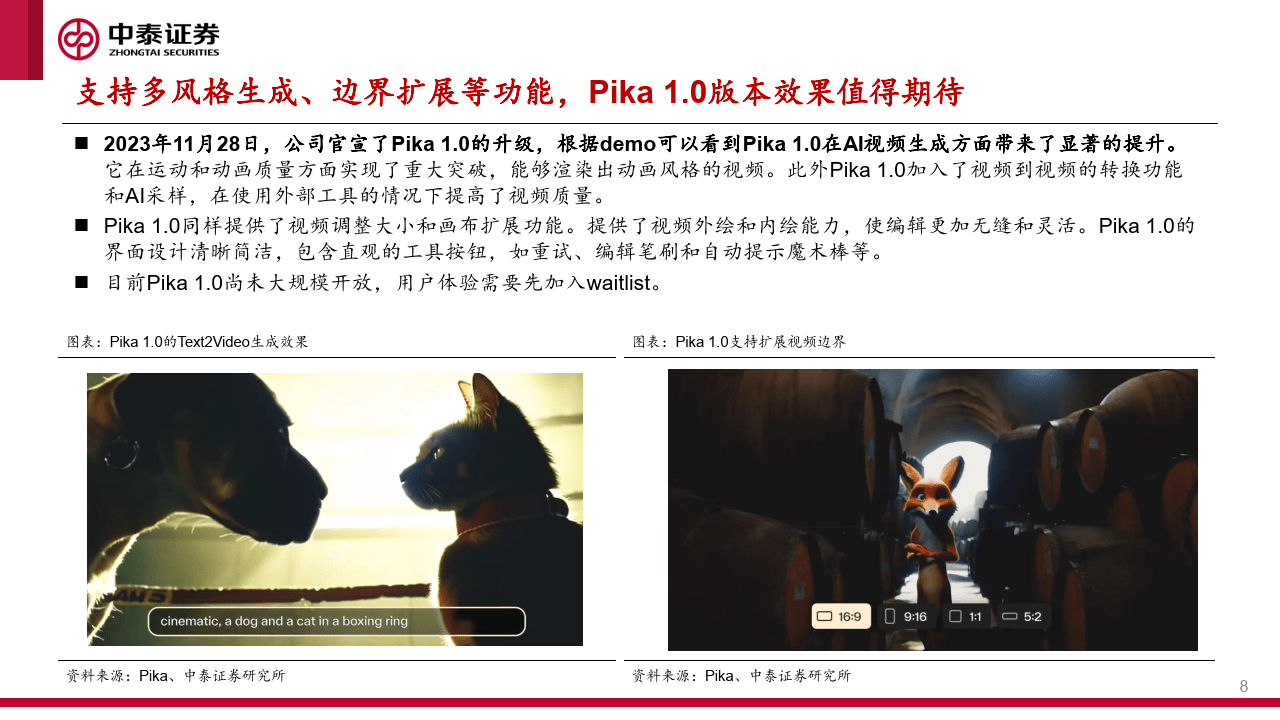

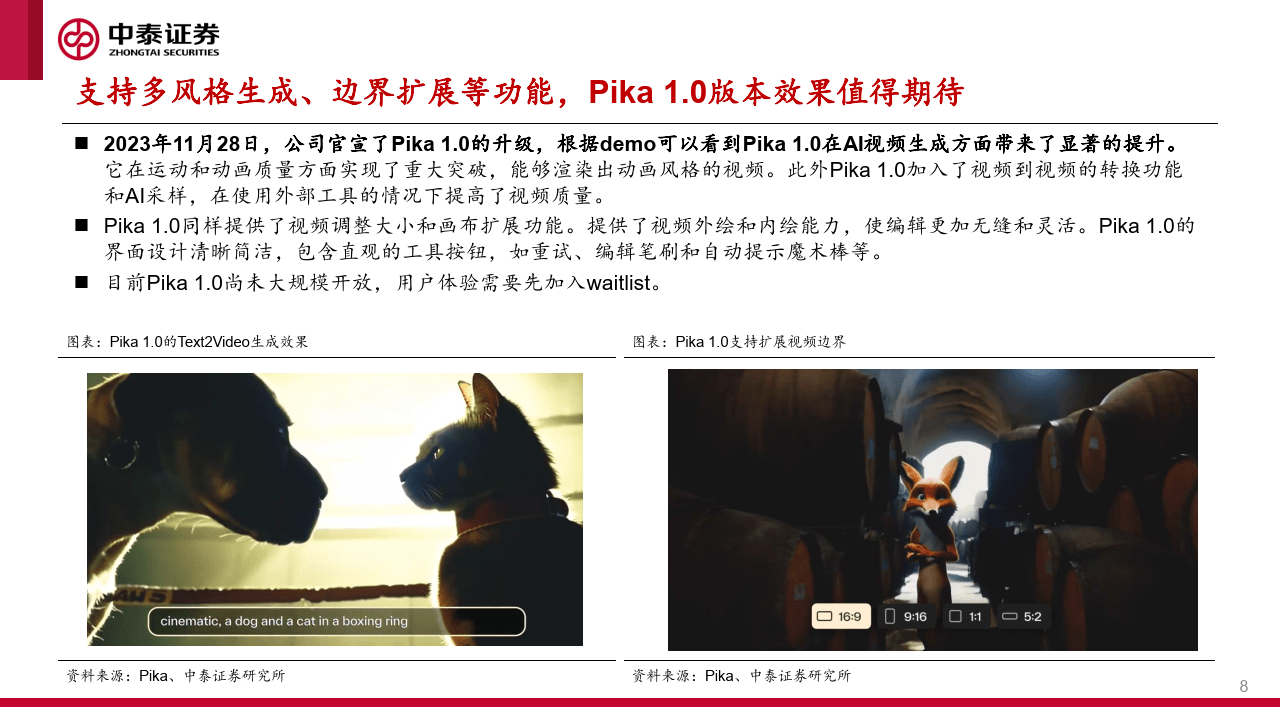

AIGC报告专题:计算机Pika-AIGC新秀-视频生成产业或迎来GPT时刻

今天分享的AIGC系列深度研究报告:《AIGC报告专题:计算机Pika-AIGC新秀-视频生成产业或迎来GPT时刻》。

(报告出品方:中泰证券)

报告共计:11页 Pika:专注Text to Video生成场景,支持…

和gpt聊天,学一手hdfs

我把聊天中间的主题,用标题标出来了,可以跳转直接观看,纯小白的求知道路。

目录 文章目录 目录[toc] 计划学习**主题**: 1.1 HDFS概述**问题**: 他和mysql有什么区别**主题**: 1.1 HDFS概述HDFS 的设计和工作原理选择最佳的 DataNode策略配置…

JavaScript询问gpt:如何合并数组?

如何合并数组? 在 JavaScript 中,你可以使用多种方法来合并数组。以下是一些常见的方法: 1. 使用 concat() 方法: javascript const array1 [1, 2, 3]; const array2 [4, 5, 6]; const mergedArray array1.concat(…

第29期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

数据标注常用的ChatGPT通用提示词模板

数据集理解:如何理解待标注的数据集? 标注规范制定:如何制定数据标注的规范? 标注工具选择:如何选择合适的数据标注工具? 数据预处理:如何对待标注数据进行预处理? 数据标注质量…

是否还在为找不到合适的GPT网站而烦恼?不用担心,这里有一些值得一看的汇总!

1.ChartGPT聊天

⭐功能:包含ChartGPT3.5,ChartGPT4.0功能,以及DALL-E3绘画和AI绘画,PDF文件分析,AI联网,AI识图(上传一张图片,能分析出图片上所有细节,体验过真的很强大)…

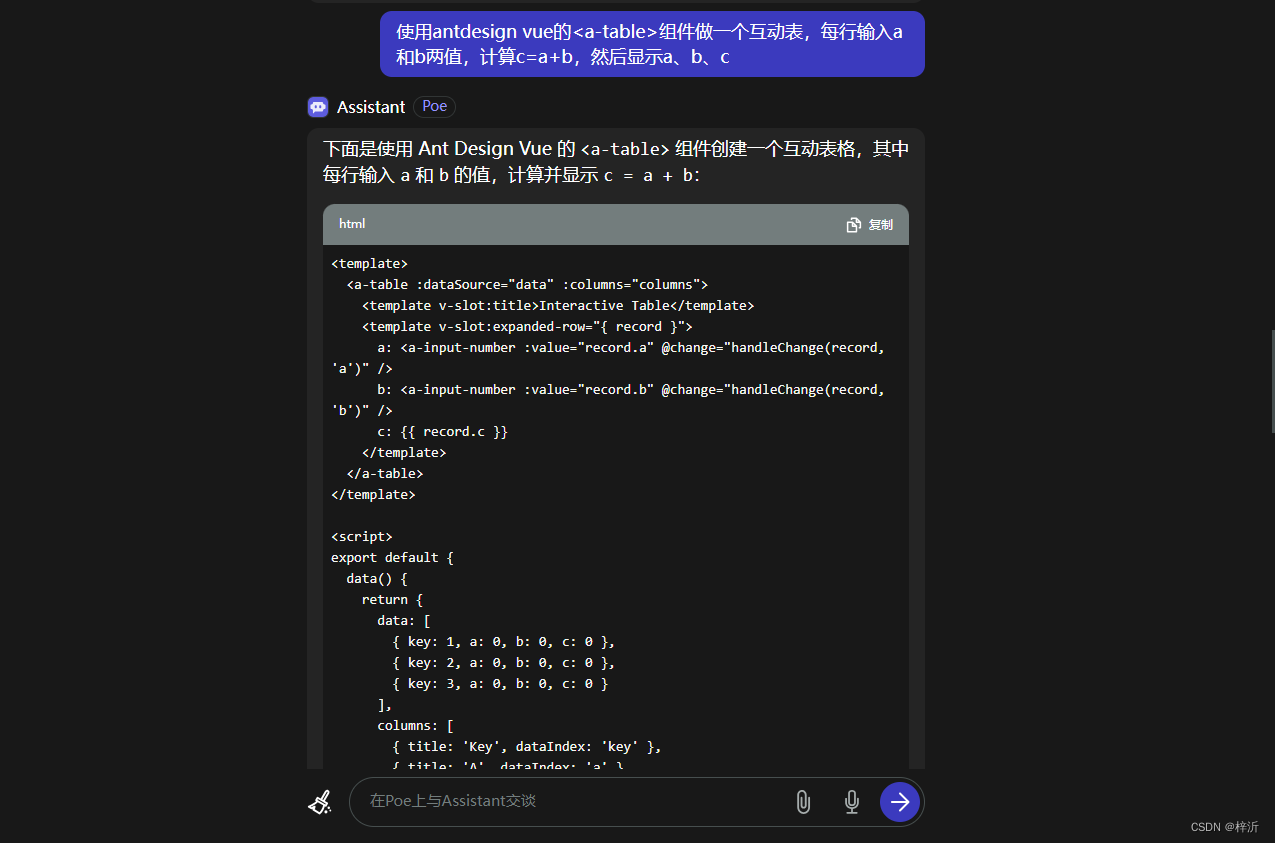

使用GPT开发食堂采购账单

原始系统中,只有采购量和消耗量,需要添加“余”列,并自动计算的余量 具体实现通过查询GPT获得: 提问:

使用antdesign vue的<a-table>组件做一个互动表,每行输入a和b两值,计算cab…

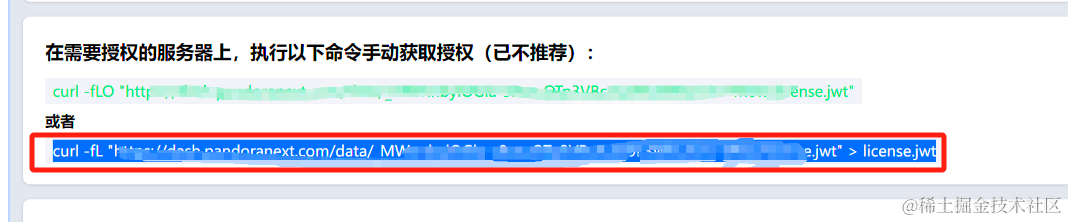

原生GPT本地及云端部署方式保姆级教程

前提条件

部署必须要有一个超过1年的Github账号

本地服务部署

运行效果 部署方法

下载安装包

暂时无法在飞书文档外展示此内容

GitHub授权登录:

https://dash.pandoranext.com/

登录后是这个样子: 复制下面红框里面这个License Id 编辑Config.js…

麒麟v10 数据盘初始化 gpt分区

麒麟v10 数据盘初始化 gpt分区 1、查看磁盘 lsblk2 、分区 parted2.1、 设置磁盘分区形式2.2、 设置磁盘的计量单位为磁柱2.3、 分区2.4、 查看分区 3、分区格式化4、 挂载磁盘4.1、新建挂载目录4.2、挂载磁盘4.3、查看挂载结果 5、设置开机自动挂载磁盘分区5.1、 查询磁盘分区…

Openai通用特定领域的智能语音小助手

无穷尽的Q&A

钉钉...钉钉... 双双同学刚到工位,报销答疑群的消息就万马纷沓而来。她只能咧嘴无奈的摇摇头。水都还没有喝一口就开始“人工智能”的去回复。原本很阳光心情开始蒙上一层薄薄阴影。在这无休无止的Q&A中,就算你对工作有磐石一般强硬࿰…

分享几个可以免费使用GPT工具

1. 国产可以使用GPT3.5和4.0的网站,每日有免费的使用额度,响应速度,注册时不用使用手机号,等个人信息,注重用户隐私,好评!

一个好用的ChatGPT系统 ,可以免费使用3.5 和 4.0https://…

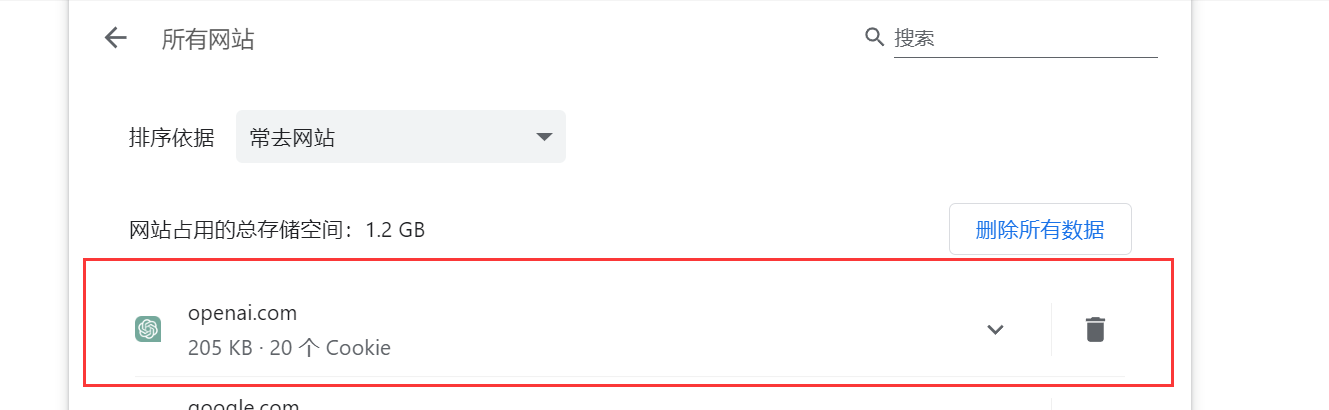

Chrome清除特定网站的Cookie,从而让网址能正常运行(例如GPT)

Chrome在使用某些网址的时候,例如GPT的时候,可能会出现无法访问这个网址的情况,就是点不动啥的 只需要把你需要重置的网址删除就好了

语言模型GPT与HuggingFace应用

受到计算机视觉领域采用ImageNet对模型进行一次预训练,使得模型可以通过海量图像充分学习如何提取特征,然后再根据任务目标进行模型微调的范式影响,自然语言处理领域基于预训练语言模型的方法也逐渐成为主流。以ELMo为代表的动态词向量模型开…

Pika:AIGC新秀,视频生成产业或迎来GPT时刻

今天分享的AIGC系列深度研究报告:《Pika:AIGC新秀,视频生成产业或迎来GPT时刻》。

(报告出品方:中泰证券)

报告共计:11页 Pika:专注Text to Video生成场景,支持3D和动漫…

OpenAI在中国,申请GPT-6、GPT-7商标

根据最新商标信息显示,OpenAI已经在中国提交了GPT-6和GPT-7的商标注册信息,分类是科学仪器和网站服务两大类。申请日期是今年的11月2日,目前处于审核状态。

该申请由知识产权代理公司完成,但申请人的地址正是OpenAI在美国公司的地…

Chat-Gpt 提示攻略

Chat-Gpt 提示攻略

本篇文章的内容皆来自《ChatGPT 提示的艺术: 制作清晰有效的提示的指南》,本文章根据阅读以后总结出来

提示的关键原则

语言表达清晰,切忌模拟两可明确的目的,切忌话题脱轨及话题散漫相关性,切忌不掺杂与目的…

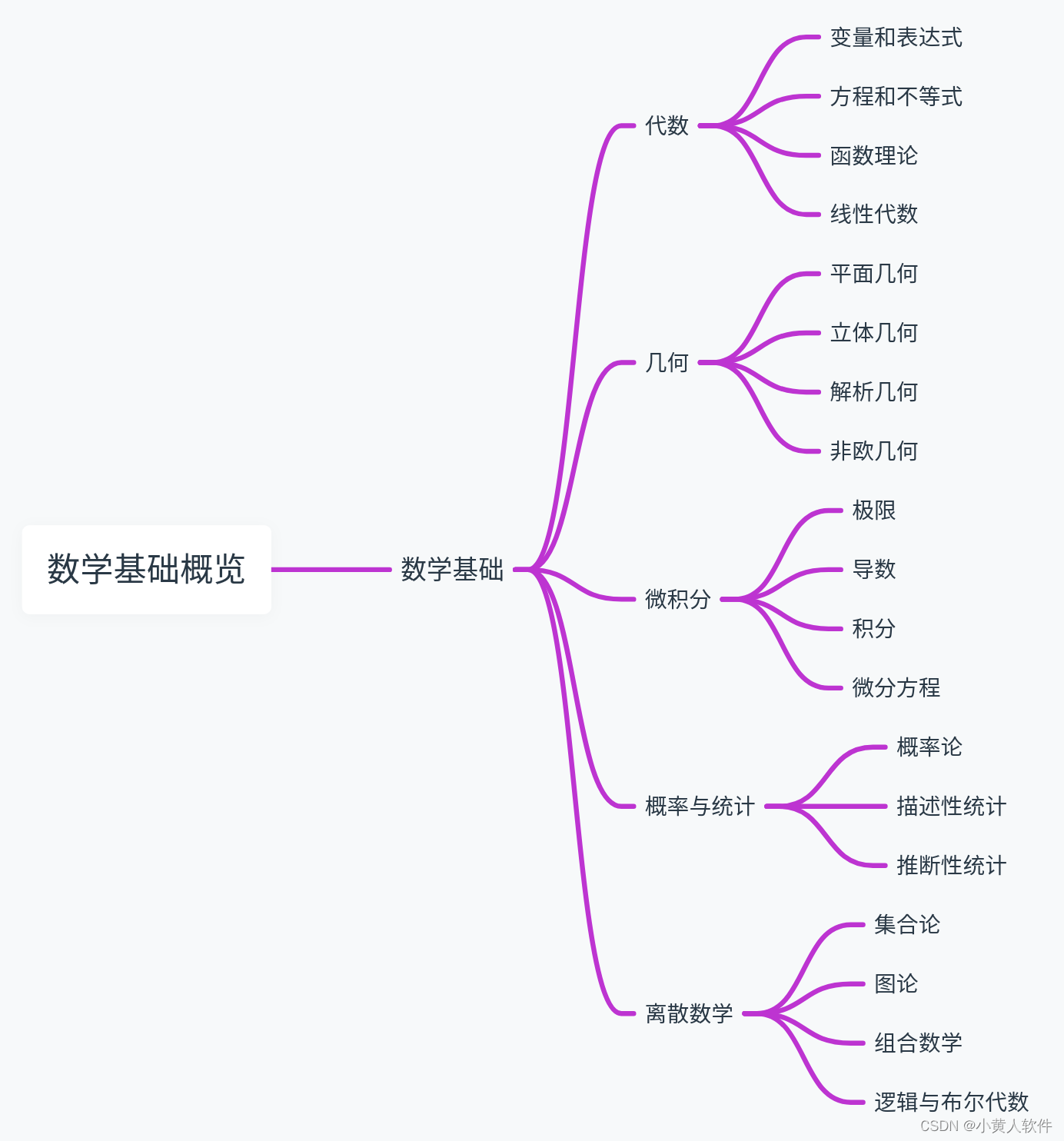

回顾【数学基础】找出断层,继续前进, 使用chatGPT学习并解决实际问题:微积分

已经学过的算术、代数、几何。跳过。

从微积分开始

想象一下,你在画一条曲线,或者在一个大草地上奔跑。微积分就是一种数学工具,帮助我们了解这条曲线的形状,或者你奔跑的方式。 微分(就像研究曲线上的每一小点&…

游戏推广常用的ChatGPT通用提示词模板

目标用户:如何定位游戏的目标用户? 市场分析:如何进行游戏市场的分析? 竞品分析:如何分析竞争对手的游戏? 推广策略:如何制定有效的游戏推广策略? 广告投放:如何进行…

ChatGPT与PowerPoint:AI高效PPT创作、VAB代码

ChatGPT与PowerPoint:一站式解决方案实现高效PPT创作 写在最前面1. 从长文案到PPT提纲:ChatGPT的文案生成展示2. 生成VBA代码3. 执行VBA代码4. 使用PowerPoint Designer优化设计设计灵感与创意实现最大化设计工具的应用 写在最前面 课程报告组会日常展示…

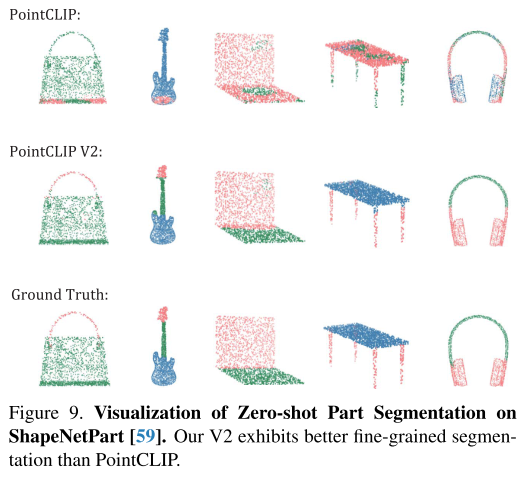

论文阅读:PointCLIP V2: Prompting CLIP and GPT for Powerful3D Open-world Learning

https://arxiv.org/abs/2211.11682

0 Abstract

大规模的预训练模型在视觉和语言任务的开放世界中都表现出了良好的表现。然而,它们在三维点云上的传输能力仍然有限,仅局限于分类任务。在本文中,我们首先协作CLIP和GPT成为一个统一的3D开放世…

从零开始训练一个ChatGPT大模型(低资源,1B3)

macrogpt-prertrain

大模型全量预训练(1b3), 多卡deepspeed/单卡adafactor

源码地址:https://github.com/yongzhuo/MacroGPT-Pretrain.git

踩坑

1. 数据类型fp16不太行, 很容易就Nan了, 最好是fp32, tf32,

2. 单卡如果显存不够, 可以用优化器adafactor,

3. 如果…

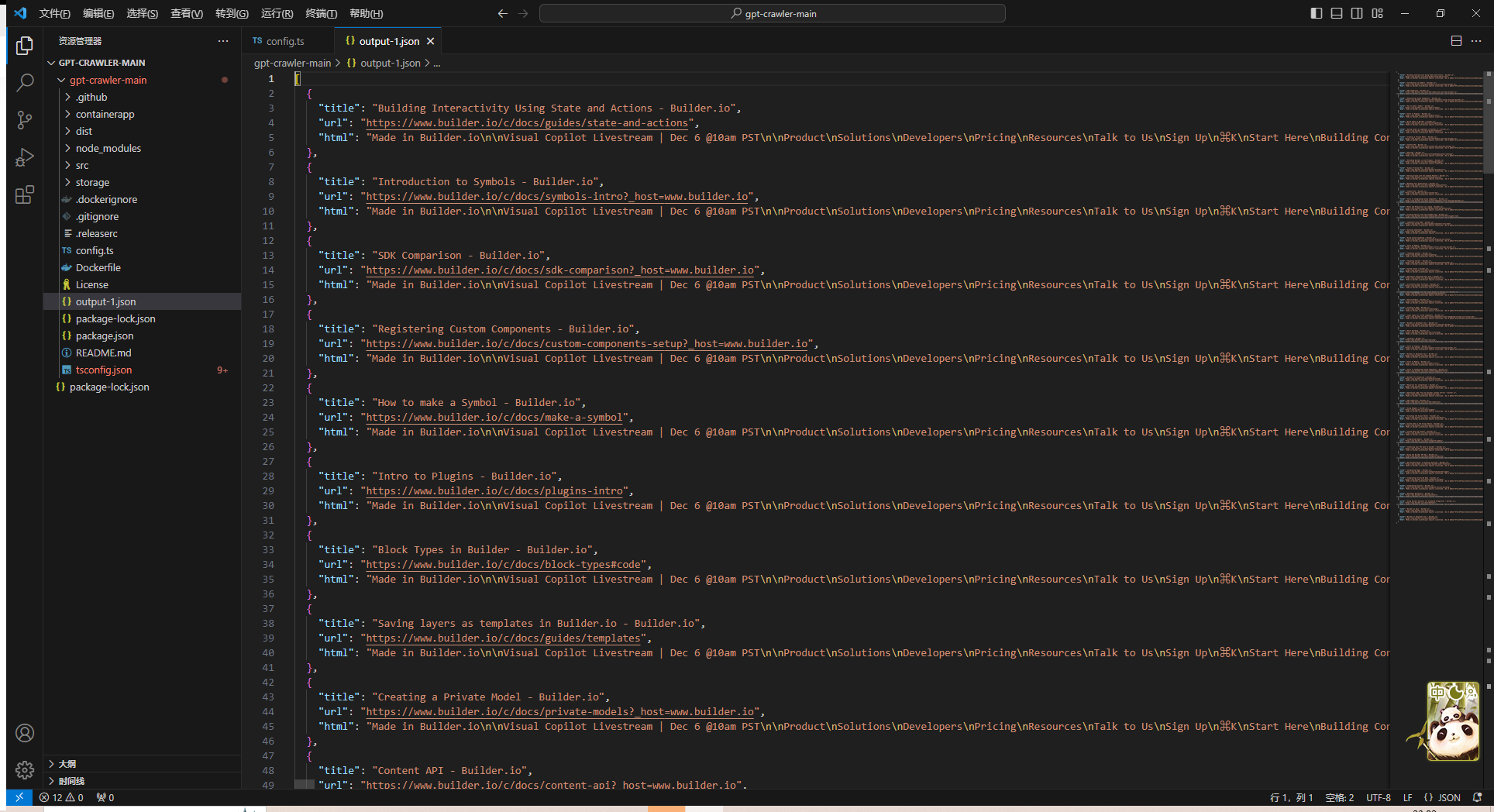

GPT-Crawler一键爬虫构建GPTs知识库

GPT-Crawler一键爬虫构建GPTs知识库 写在最前面安装node.js安装GPT-Crawler启动爬虫结合 OpenAI自定义 assistant自定义 GPTs(笔者用的这个) 总结 写在最前面

GPT-Crawler一键爬虫构建GPTs知识库 能够爬取网站数据,构建GPTs的知识库…

最近爆火的向量数据库是怎么回事儿?

大家好!今天咱们就来聊聊这个颇具魔幻色彩的话题——GPT 模型的困境,以及如何在这场智慧的较量中赢得胜利。看看那些聪明绝顶的开发人员,他们面对万能神剑 GPT 模型的诸多限制,又是怎么想方设法地寻找新的破解之道呢?这…

GPT还远远不是真正的智能

GPT是一个基于深度学习的自然语言处理模型,它可以生成逼真的文本。虽然GPT在生成文本方面取得了显著的进展,但它并不具备真正的智能。GPT是通过训练模型来学习语言模式,它不具备理解、推理、判断和主动学习的能力。它只是根据已有的语料库生成…

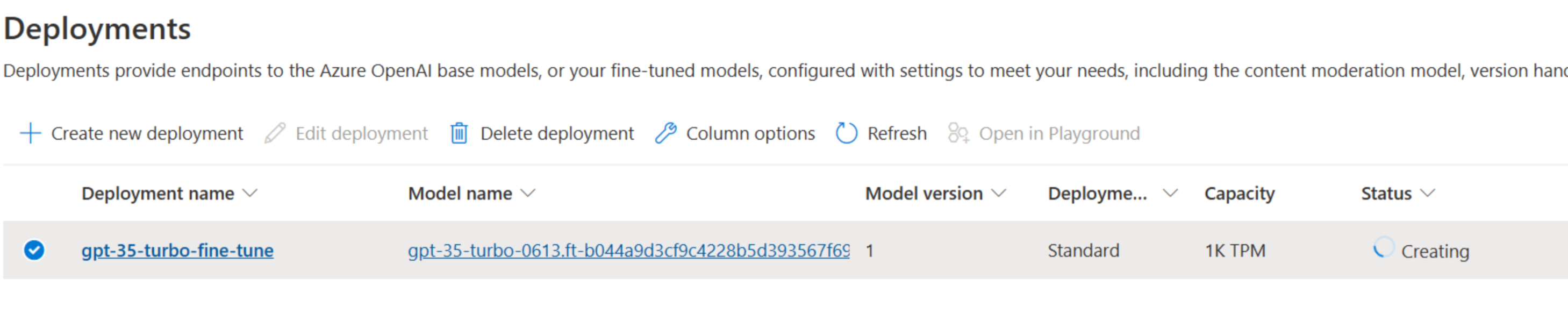

Azure Machine Learning - Azure OpenAI GPT 3.5 Turbo 微调教程

本教程将引导你在Azure平台完成对 gpt-35-turbo-0613 模型的微调。 关注TechLead,分享AI全维度知识。作者拥有10年互联网服务架构、AI产品研发经验、团队管理经验,同济本复旦硕,复旦机器人智能实验室成员,阿里云认证的资深架构师&…

WAVE SUMMIT迎来第十届,文心一言将有最新披露!

10句话2分钟,挑战成功说服宿管阿姨开门,这个人群中的“显眼包”是一个接入文心大模型4.0游戏里的NPC,妥妥 “工具人”实锤~

尝试用AI一键自动识别好坏咖啡豆,看一眼便知好坏,真正“颜值即正义”࿰…

小狐狸GPT付费2.4.9弹窗版学习源码介绍

小狐狸GPT付费2.4.9弹窗版学习源码是一套基于GPT(Generative Pre-trained Transformer)模型的开源代码库,旨在帮助开发者快速构建和训练自己的语言模型。该源码集成了多个先进的自然语言处理技术,包括预训练、微调、对话生成等&am…

【LLM】大语言模型的前世今生

An Overview of LLMs

LLMs’ status quo

NLP Four Paradigm A timeline of existing large language models 看好OpenAI、Meta 和 LLaMA。

Typical Architectures Casual Decoder eg. GPT3、LLaMA… 在前两篇文章大家也了解到GPT的结构了,在训练模型去预测下一个…

跟着GPT学习shell脚本,理论与实践相结合的学习计划。(二)

第9周:项目实战 - 实现一个完整的Shell脚本项目

学习目标

应用所学的Shell脚本知识来实现一个实际项目。从规划到实现,经历完整的项目开发流程。

项目建议:自动化服务器健康检查脚本

项目描述: 开发一个Shell脚本,…

最新国内使用GPT4教程,GPT语音对话使用,Midjourney绘画,ChatFile文档对话总结+DALL-E3文生图

一、前言

ChatGPT3.5、GPT4.0、GPT语音对话、Midjourney绘画,文档对话总结DALL-E3文生图,相信对大家应该不感到陌生吧?简单来说,GPT-4技术比之前的GPT-3.5相对来说更加智能,会根据用户的要求生成多种内容甚至也可以和…

最新AI系统ChatGPT网站H5系统源码,支持AI绘画,GPT语音对话+ChatFile文档对话总结+DALL-E3文生图

一、前言

SparkAi创作系统是基于ChatGPT进行开发的Ai智能问答系统和Midjourney绘画系统,支持OpenAI-GPT全模型国内AI全模型。本期针对源码系统整体测试下来非常完美,可以说SparkAi是目前国内一款的ChatGPT对接OpenAI软件系统。那么如何搭建部署AI创作Ch…

100GPTS计划-AI写作VersatileWriter

地址

https://chat.openai.com/g/g-zHErU9z9m-versatile-writer

https://poe.com/VersatileWriterGPT

测试 翻译:要求将给定的英语语句翻译成中文。 总结:给出一段文本,要求进行概括和总结。 问答:根据给定段落,提出相关问题并给出答案。 推理:给出前提,进行多步推理并得…

fill-in-the-middle(FIM) 实现与简单应用

1 背景

传统训练的 GPT 模型只能根据前文内容预测后文内容,但有些应用比如代码生成器,需要我们给出上文和下文,使模型可以预测中间的内容,传统训练的 GPT 就不能完成这类任务。

传统训练的 GPT 只能根据上文预测下文

使用 FIM…

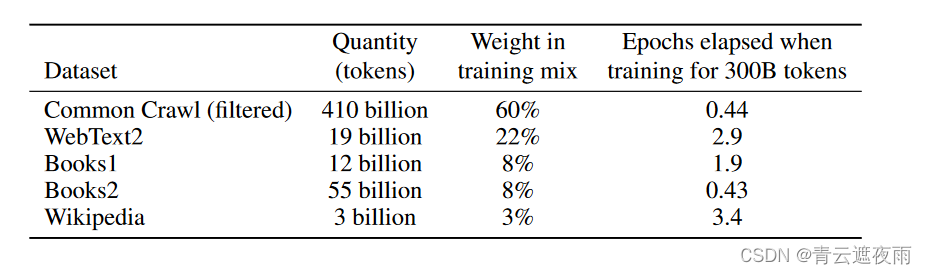

51-8 GPT,GPT2,GPT3 论文精读

2020年的时候有一篇博客冲到了Hack News的第一名。Hack News是在技术圈里面应该是影响力最大的一个新闻汇聚网站,所有人都可以分享自己喜欢的文章,然后观众对这些文章进行点赞或者是评论。Hack News根据你点赞的个数和评论来进行排名,这篇文章…

智能 GPT 图书馆又重生了

智能 GPT 图书馆又重生了 作者:程序员小白条 1)概述

自从大二寒假准备开始筹备这个项目,到现在已经一年了,这个项目能维护一年,不愧是我.jpg。本来这个项目只是想练练手,因为那时候刚学完 Spring Boot2 V…

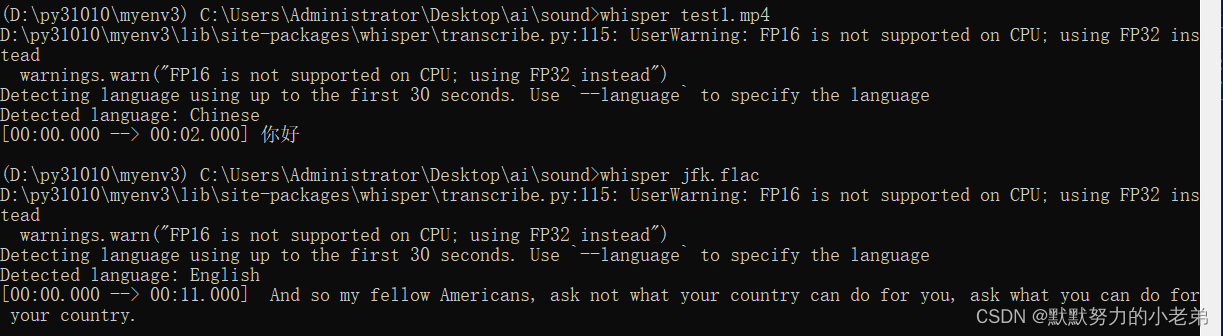

语音识别之百度语音试用和OpenAiGPT开源Whisper使用

0.前言: 本文作者亲自使用了百度云语音识别,腾讯云,java的SpeechRecognition语言识别包 和OpenAI近期免费开源的语言识别Whisper(真香警告)介绍了常见的语言识别实现原理

1.NLP 自然语言处理(人类语言处理) 你好不同人说出来是不同的信号表示 单位k 16k16000个数字表示 1秒160…

100GPTS计划-AI编码CodeWizard

地址

https://chat.openai.com/g/g-vX7yfHNcC-code-wizard https://poe.com/CodeWizardGPT

测试

sql 优化

select a.id,a.name,count(b.id),count(c.id)

from product a

LEFT JOIN

secretkey b

on a.id b.productId

group by a.id

LEFT JOIN secretkey c

on a.id c.pr…

最新国内可用使用GPT4.0,GPT语音对话,Midjourney绘画,DALL-E3文生图

一、前言

ChatGPT3.5、GPT4.0、GPT语音对话、Midjourney绘画,相信对大家应该不感到陌生吧?简单来说,GPT-4技术比之前的GPT-3.5相对来说更加智能,会根据用户的要求生成多种内容甚至也可以和用户进行创作交流。 然而,GP…

openfeign的熔断与降级【gpt】

在使用OpenFeign进行微服务间的调用时,熔断和降级是常用的服务保护机制,用于提高系统的可靠性和稳定性。下面我将分别介绍OpenFeign中的熔断和降级机制:

熔断(Circuit Breaker)

熔断机制在微服务架构中用于防止错误的…

用ChatGPT写公众号10W+爆文的方法(内附提示词)

今天赤辰社群公众号AI爆文写作项目训练营(第一期),正式开营啦! 自从公众号改变了推荐机制后,哪怕没有文案功底,账号没有粉丝基数,只要利用好AI,你也能写出爆款文章的可能。对于新手来…

如何让GPT成为你的科研助手?

详情点击链接:如何让GPT成为你的科研助手?

一OpenAI

1.最新大模型GPT-4 Turbo 2.最新发布的高级数据分析,AI画图,图像识别,文档API

3.GPT Store

4.从0到1创建自己的GPT应用

5. 模型Gemini以及大模型Claude2二定制…

为什么ChatGPT采用SSE协议而不是Websocket?

在探索ChatGPT的使用过程中,我们发现GPT采用了流式数据返回的方式。理论上,这种情况可以通过全双工通信协议实现持久化连接,或者依赖于基于EventStream的事件流。然而,ChatGPT选择了后者,也就是本文即将深入探讨的SSE&…

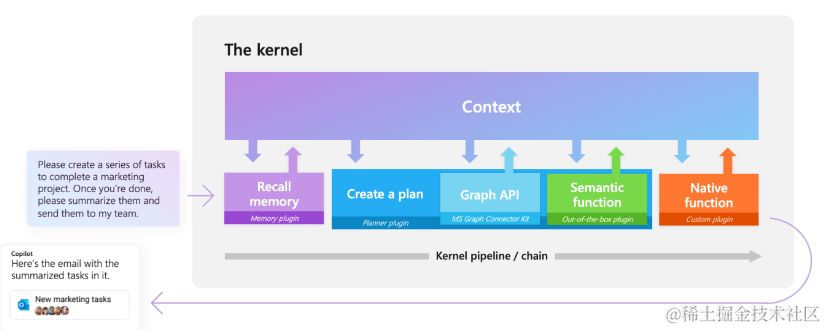

微软官方出品:GPT大模型编排工具,支持C#、Python等多个语言版本

随着ChatGPT的火热,基于大模型开发应用已经成为新的风口。虽然目前的大型模型已经具备相当高的智能水平,但它们仍然无法完全实现业务流程的自动化,从而达到用户的目标。

微软官方开源的Semantic Kernel的AI编排工具,就可以很好的…

【昆明*线上同步】最新ChatGPT/GPT4科研实践应用与AI绘图技术及论文高效写作

详情点击查看福利:【昆明*线上同步】最新ChatGPT/GPT4科研实践应用与AI绘图技术及论文高效写作

目标:

1、熟练掌握ChatGPT提示词技巧及各种应用方法,并成为工作中的助手。 2、通过案例掌握ChatGPT撰写、修改论文及工作报告,提供…

最新国内免费使用GPT4教程,GPT语音对话使用,Midjourney绘画

一、前言

ChatGPT3.5、GPT4.0、GPT语音对话、Midjourney绘画,相信对大家应该不感到陌生吧?简单来说,GPT-4技术比之前的GPT-3.5相对来说更加智能,会根据用户的要求生成多种内容甚至也可以和用户进行创作交流。 然而,GP…

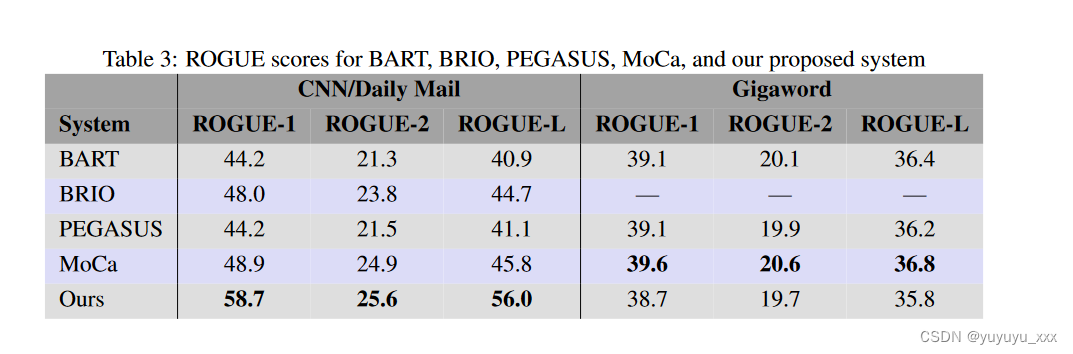

NLP论文阅读记录 - | 使用GPT对大型文档集合进行抽象总结

文章目录 前言0、论文摘要一、Introduction二.相关工作2.1Summarization2.2 神经网络抽象概括2.2.1训练和测试数据集。2.2.2 评估。 2.3 最先进的抽象摘要器 三.本文方法3.1 查询支持3.2 文档聚类3.3主题句提取3.4 语义分块3.5 GPT 零样本总结 四 实验效果4.1数据集4.2 对比模型…

python调用GPT API

每次让gpt给我生成一个调用api的程序时,他经常会调用以前的一些api的方法,导致我的程序运行错误,所以这期记录一下使用新的方法区调用api 参考网址

Migration Guide,这里简要地概括了一下新版本做了哪些更改 OpenAI Python API l…

Ubuntu 22.04 配置LLM大语言模型环境

本文介绍了清洁安装的Ubuntu Server 22.04 LTS安装NVIDIA显卡驱动、CUDA 12.1、cuDNN的方法及ChatGLM3、百川2、FastChat等大语言模型的部署使用方法。

安装NVIDIA驱动

禁用nouveau

sudo vi /etc/modprobe.d/blacklist.conf尾部追加一行

blacklist nouveau执行并重启系统

…

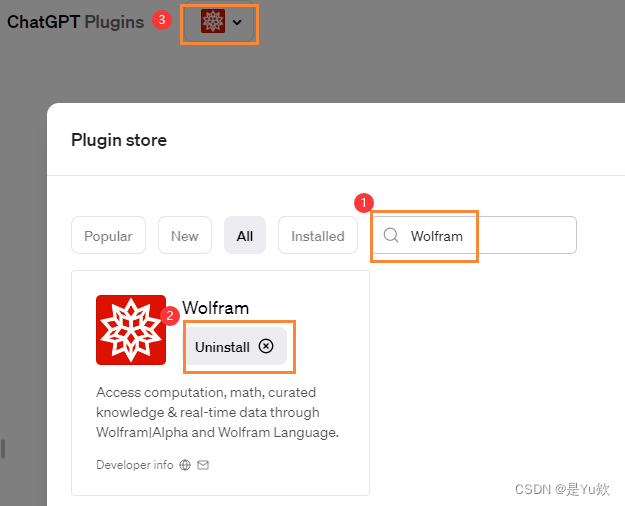

如何在 ChatGPT 上使用 Wolfram 插件回答数学问题

这里写自定义目录标题 写在最前面Wolfram是什么?ChatGPT 如何与 Wolfram 相结合,为什么有效?如何在 ChatGPT 上安装 Wolfram 插件? 写在最前面

参考:https://clickthis.blog/zh-CN/how-to-answer-math-questions-usin…

python调用DALL·E绘画

实现用gpt的api和他对话后,我们试着调用DALLE的api进行绘画 参考文档

OpenAI API

运行代码

from openai import OpenAIclient OpenAI()user_prompt input("请输入您想生成的图片描述: ")response client.images.generate(model"dall-e-3"…

GPT每预测一个token就要调用一次模型

问题:下图调用了多少次模型? 不久以前我以为是调用一次

通过看代码是输出多少个token就调用多少次,如图所示: 我理解为分类模型

预测下一个token可以理解为分类模型,类别是vocab的所有token,每一次调用都…

ChatGPT/GPT4+AI绘图+论文写作+编程结合到底有多强大?带你详细了解

ChatGPT在论文写作与编程方面具备强大的能力。无论是进行代码生成、错误调试还是解决编程难题,ChatGPT都能为您提供实用且高质量的建议和指导,提高编程效率和准确性。此外,ChatGPT是一位出色的合作伙伴,可以为您提供论文写作的支持…

利用Milvus Cloud和LangChain构建机器人:一种引人入胜且通俗易懂的方法

一、引言

机器人已经深入我们的日常生活,从家庭服务到工业生产,再到医疗和运输等领域。然而,这些机器人往往需要复杂的算法和数据处理技术才能有效地执行任务。在这个过程中,人工智能(AI)和机器学习&#…

第33期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

如何用GPT完成论文高效写作?

详情点击链接:如何用GPT完成论文高效写作?

一OpenAI

1.最新大模型GPT-4 Turbo 2.最新发布的高级数据分析,AI画图,图像识别,文档API

3.GPT Store

4.从0到1创建自己的GPT应用

5. 模型Gemini以及大模型Claude2二定制…

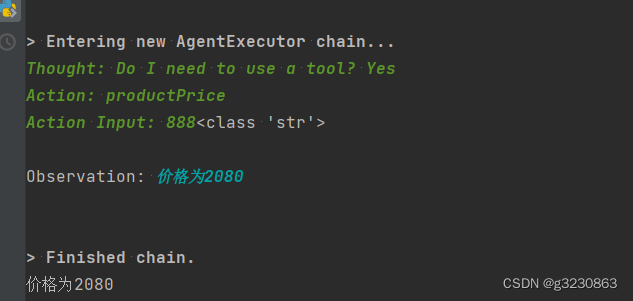

GPT实战系列-ChatGLM3管理外部借力工具

GPT实战系列-ChatGLM3管理外部借力工具

用ChatGLM的工具可以实现很多查询接口和执行命令,外部工具该如何配置使用?如何联合它们实现大模型查询助手功能?例如调用工具实现股票信息查询,网络天气查询等助手功能。 LLM大模型相关文章…

活动运营常用的ChatGPT通用提示词模板

活动目标确定:如何明确活动的目标,确保活动策划与执行的方向性? 活动主题选择:如何选择吸引人的活动主题,提高用户的参与度和兴趣? 活动形式策划:如何根据活动目标和主题,选择适合…

构建自己的私人GPT-支持中文

上一篇已经讲解了如何构建自己的私人GPT,这一篇主要讲如何让GPT支持中文。 privateGPT 本地部署目前只支持基于llama.cpp 的 gguf格式模型,GGUF 是 llama.cpp 团队于 2023 年 8 月 21 日推出的一种新格式。它是 GGML 的替代品,llama.cpp 不再…

【现代密码学】笔记3.4-3.7--构造安全加密方案、CPA安全、CCA安全 《introduction to modern cryphtography》

【现代密码学】笔记3.4-3.7--构造安全加密方案、CPA安全、CCA安全 《introduction to modern cryphtography》 写在最前面私钥加密与伪随机性 第二部分流加密与CPA多重加密 CPA安全加密方案CPA安全实验、预言机访问(oracle access) 操作模式伪随机函数PR…

当我分别问8款GPT一个问题。。。

前两天下班在地铁上无聊寻思问一下不同的GPT一个相同的问题,哪个会给出我比较满意的答案,然后我就提问:我老妹有点憨怎么办?(ps:开玩笑的,嘻嘻。。。) 很明显其他GPT都给出了大差不差…

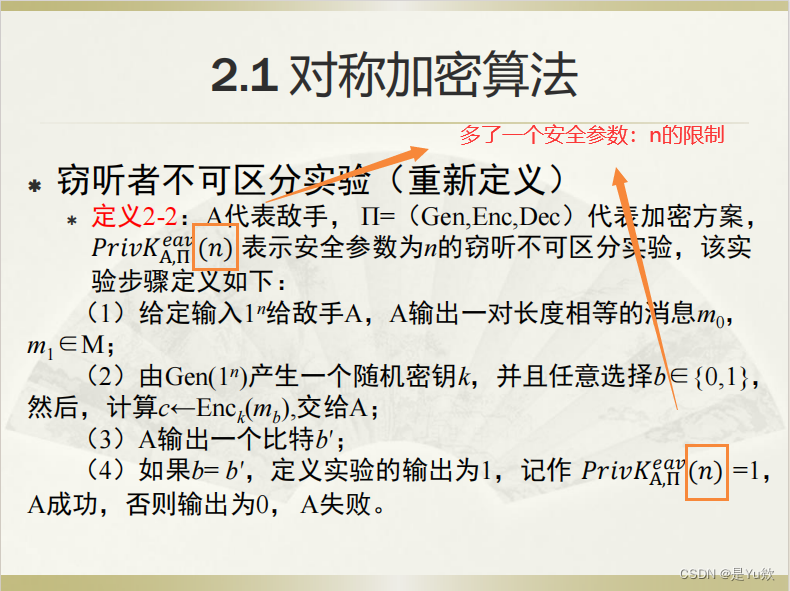

【现代密码学】笔记2 -- 完善保密性《introduction to modern cryphtography》现代密码学原理与协议

【现代密码学】笔记2--完善保密性《introduction to modern cryphtography》 写在最前面2 完善保密性的介绍2.1 定义和基本属性加密方案的组成密钥产生算法 (Gen)加密算法 (Enc)解密算法 (Dec)概率分布独立性 完美保密加密3. 回顾加密词法4. 完美保密(**Perfect Sec…

能赚钱的GPT Store正式上线!如何将自己的 GPT 放到商店中?

等了两个月,OpenAI 的 GPT Store 今日凌晨终于上线!上线 GPT Store 的同时,OpenAI 同步了最新的 GPTs 数据:截止到1月11日,用户已创建300万的GPTs! GPTs 开发者可以通过 GPTs 来获利。OpenAI 将在今年第一季…

校验ChatGPT 4真实性的三个经典问题:提供免费测试网站快速区分 GPT3.5 与 GPT4

现在已经有很多 ChatGPT 的套壳网站,以下分享验明 GPT-4 真身的三个经典问题,帮助你快速区分套壳网站背后到底用的是 GPT-3.5 还是 GPT-4。 大家可以在这个网站测试:https://ai.hxkj.vip,免登录可以问三条,登录之后无限…

【现代密码学】笔记9-10.3-- 公钥(非对称加密)、混合加密理论《introduction to modern cryphtography》

【现代密码学】笔记9-10.3-- 公钥(非对称加密)、混合加密理论《introduction to modern cryphtography》 写在最前面8.1 公钥加密理论随机预言机模型(Random Oracle Model,ROM) 写在最前面

主要在 哈工大密码学课程 张…

GPT编程(1)八分类图像数据集转换为二分类

一个核心问题就是要将这八类数据图片全部重命名,尝试了一步到位 有一个图像数据集,有八个类别amusement,anger,awe,contentment,disgust, excitement, fear,sadness的图片,每张图片被命名为“类别数字”。采用遍历的方式,按顺序阅…

如何获取 ChatGPT 的 OpenAI API 密钥

为什么需要 OpenAI API 密钥? 拥有 OpenAI API 密钥可以解锁多种强大的功能。您可以享受以下一些好处:

访问先进的人工智能模型

OpenAI 开发了 GPT-3 和 Codex 等多种先进的人工智能模型。借助 API 密钥,您可以利用这些模型的功能来执行自然…

【privateGPT】使用privateGPT训练您自己的LLM

了解如何在不向提供商公开您的私人数据的情况下训练您自己的语言模型 使用OpenAI的ChatGPT等公共人工智能服务的主要担忧之一是将您的私人数据暴露给提供商的风险。对于商业用途,这仍然是考虑采用人工智能技术的公司最大的担忧。

很多时候,你想创建自己…

Gpt指引ubuntu安装java8/11

在Ubuntu系统上安装Java环境通常包括以下几个步骤:

更新软件包索引: 在安装新软件之前,最好先更新Ubuntu的软件包索引。这可以确保你安装的是最新版本的软件包。可以使用以下命令来更新:

sudo apt update安装Java: U…

GPT图解大模型是怎样构建的

❤️作者主页:小虚竹 ❤️作者简介:大家好,我是小虚竹。2022年度博客之星评选TOP 10🏆,Java领域优质创作者🏆,CSDN博客专家🏆,华为云享专家🏆,掘金年度人气作…

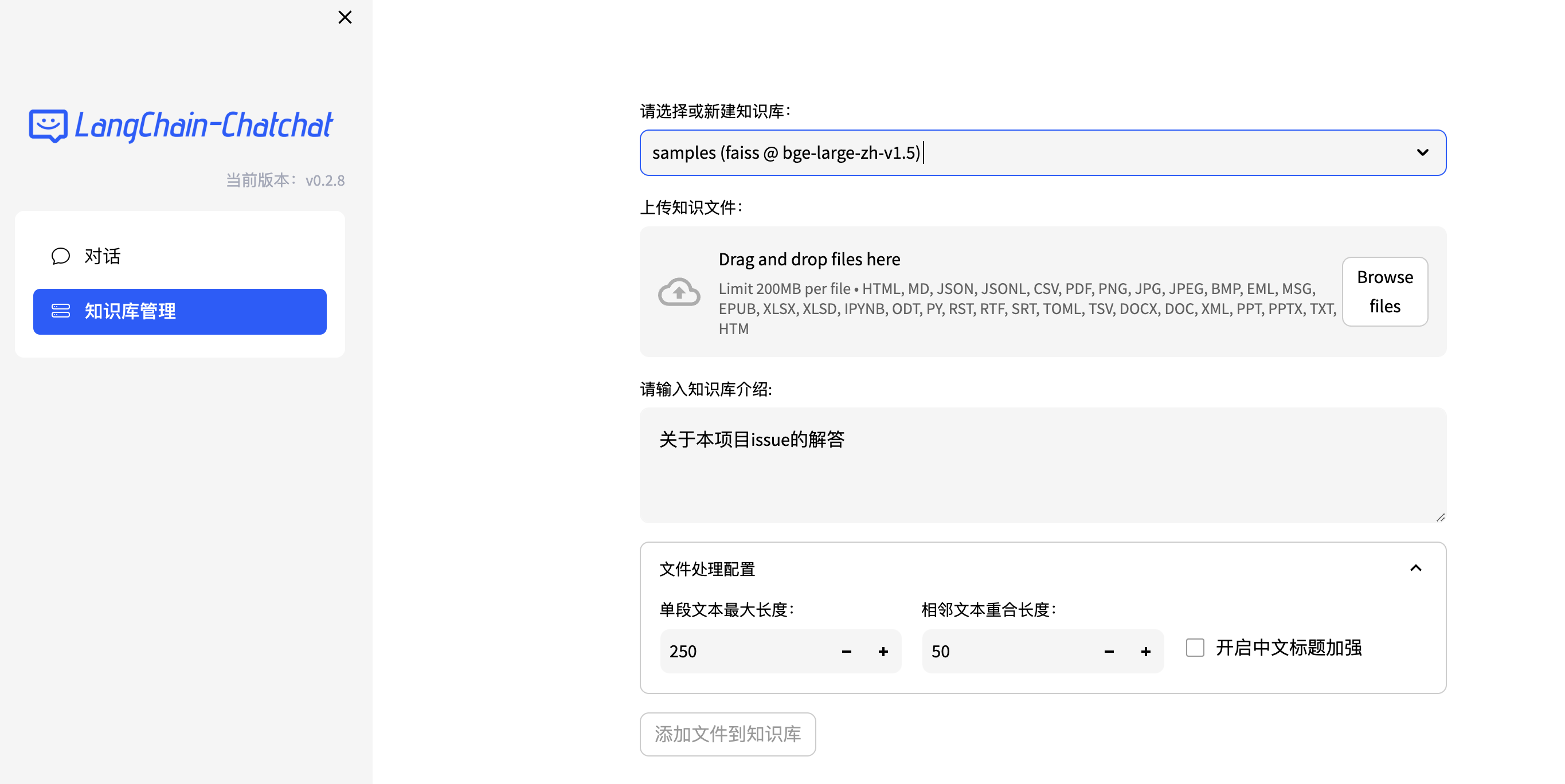

【开源项目推荐】8.9K纯中文本地GPT知识库搭建项目

大家好,我是独孤风。 又到了本周的开源项目推荐。近一年多的时间,人工智能迎来了大爆发。GPT相关的大模型的发展让很多领域都发生了巨大的变化。 但是虽然GPT的自然语言识别功能异常的强大,但回答给我们的知识内容并不尽如人意。那么…

质量管理常用的ChatGPT通用提示词模板

质量方针与目标设定:如何设定并理解公司的质量方针与目标? 质量策划:如何进行质量策划,包括制定质量计划、明确质量标准等? 质量控制:如何通过一系列手段和方法确保产品或服务的质量符合标准?…

LangChain.js 实战系列:入门介绍

📝 LangChain.js 是一个快速开发大模型应用的框架,它提供了一系列强大的功能和工具,使得开发者能够更加高效地构建复杂的应用程序。LangChain.js 实战系列文章将介绍在实际项目中使用 LangChain.js 时的一些方法和技巧。 LangChain.js 是一个…

MetaGPT-打卡-day2,MetaGPT框架组件学习

文章目录 Agent组件实现一个单动作的Agent实现一个多动作的Agent技术文档生成助手其他尝试 今天是第二天的打卡~昨天是关于一些概念的大杂烩,今天的话,就来到了Hello World环节。 从单个Agnet到多个Agent,再到组合更复杂的工作流来解决问题。…

客户关系管理常用的ChatGPT通用提示词模板

客户满意度调查:如何进行客户满意度调查? 客户忠诚度管理:如何管理客户忠诚度? 客户细分与定位:如何对客户进行细分与定位? 客户关系建立与维护:如何建立并维护良好的客户关系? …

ChatGPT Plus续费充值,到账延迟,如何申诉?

ChatGPT Plus充值总是到账延迟比较严重,一般多是通过充值链接代充值遇到,如果是账号登陆充值,是即时到账。但是有的客户不愿意提供账号密码,遇到延迟到账的情况如何解决呢?客户可按下面操作申诉,可快速到账…

GPT-5:未来的大潮,即将到来?

GPT-5:未来的大潮,即将到来?

随着人工智能领域的迅猛发展,OpenAI的GPT(Generative Pre-trained Transformer)系列模型已经成为了业界的焦点。自从GPT-3在2020年震撼发布以来,它凭借强大的自然语…

GPT技术:人工智能的语言革命

在人工智能的领域中,自然语言处理(NLP)一直是一个极具挑战性的研究领域。随着技术的进步,一个名为GPT(Generative Pre-trained Transformer)的模型出现在了公众的视野中,它不仅改变了我们与机器…

降低成本常用的ChatGPT通用提示词模板

成本分析与优化:如何进行成本分析与优化? 成本控制策略:如何制定有效的成本控制策略? 采购成本降低:如何降低采购成本? 生产成本降低:如何降低生产成本? 销售成本降低࿱…

【中断之GPT问答】

中断问题:

中断是什么,中断程序是优先执行的吗,打印输出和按键盘是不同的中断吗,是怎么执行的呢,中断有什么好处呢,具体到案例。

中断(Interrupt)是计算机系统中一种特殊的信号&am…

word2vec,BERT,GPT相关概念

词嵌入(Word Embeddings)

词嵌入通常是针对单个词元(如单词、字符或子词)的。然而,OpenAI 使用的是预训练的 Transformer 模型(如 GPT 和 BERT),这些模型不仅可以为单个词元生成嵌入…

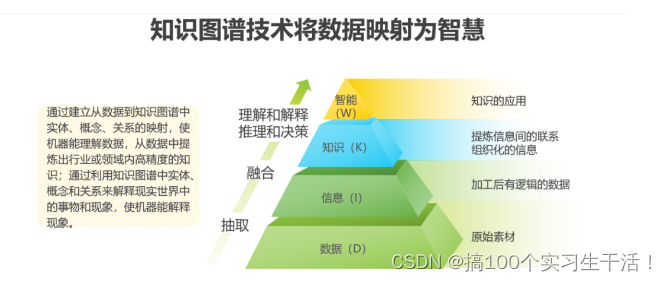

知识图谱 vs GPT

简介: 当我们谈论知识图谱时,我们指的是一种结构化的知识表示形式,是一种描述真实世界中事物及其关系的语义模型,用于描述实体之间的关系。它通过将知识组织成图形结构,提供了一种更全面、准确和智能的信息处理方式。知…

第12期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练 Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

【LLM】Prompt微调

Prompt

在机器学习中,Prompt通常指的是一种生成模型的输入方式。生成模型可以接收一个Prompt作为输入,并生成与该输入相对应的输出。Prompt可以是一段文本、一个问题或者一个片段,用于指导生成模型生成相应的响应、续写文本等。

Prompt优化…

文心一言接入Promptulate,开发复杂LLM应用程序

简介

最近在尝试将文心一言的LLM能力接入Promptulate,故写了一篇博客记录一下,Promptulate 是 Promptulate AI 旗下的大语言模型自动化与应用开发框架,旨在帮助开发者通过更小的成本构建行业级的大模型应用,其包含了LLM领域应用层…

GPT---1234

GPT:《Improving Language Understanding by Generative Pre-Training》 下载地址:https://cdn.openai.com/research-covers/language-unsupervised/language_understanding_paper.pdfhttps://cdn.openai.com/research-covers/language-unsupervised/language_understa…

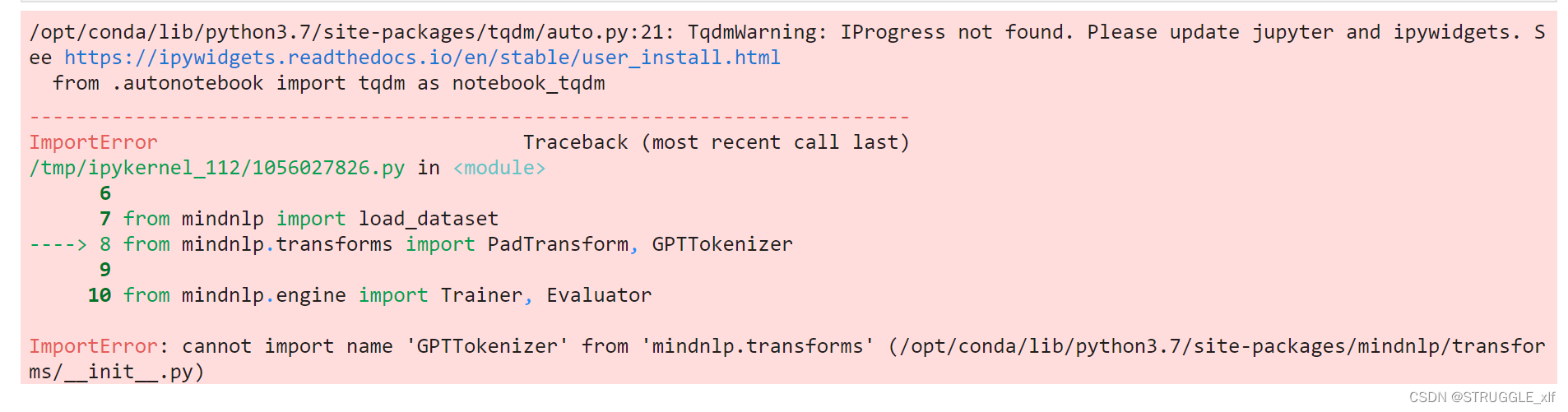

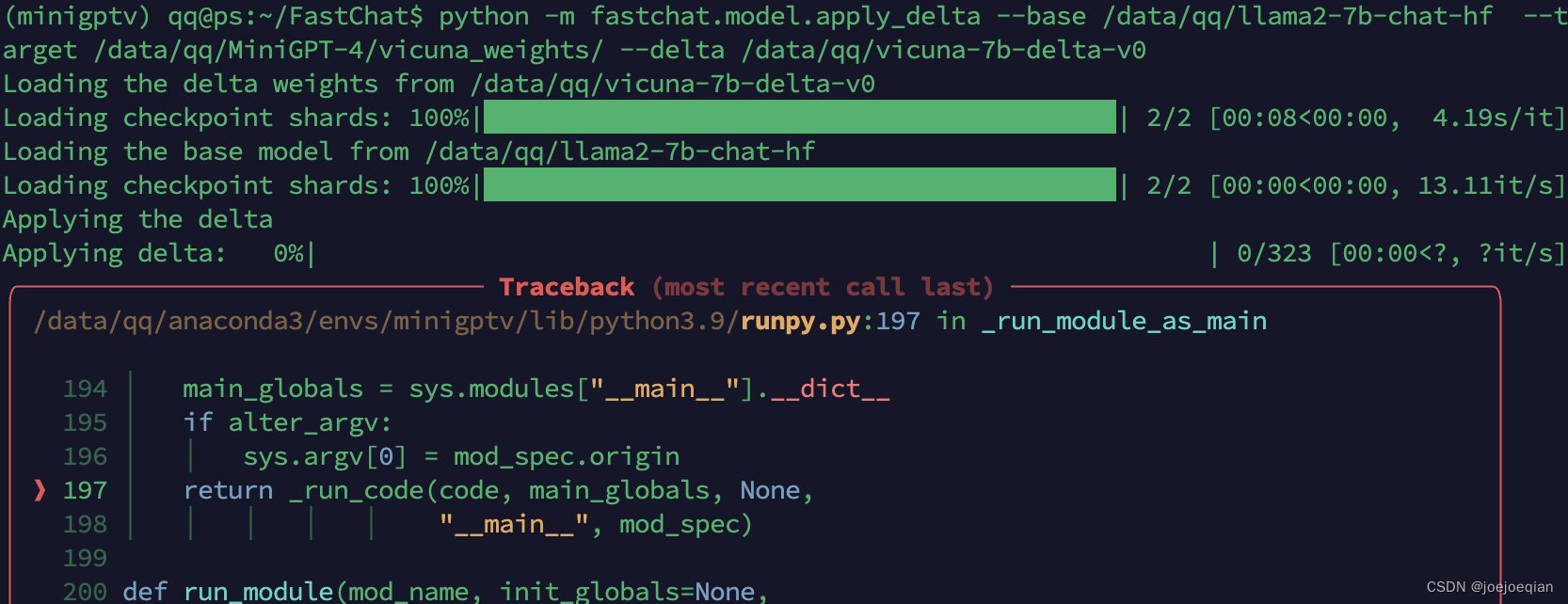

[nlp] 大模型gpu机器推理测速踩坑 (llama/gpt类)

cpu没报错,换gpu就报错。

坑1:要指定gpu,可以在import torch之前指定gpu。

model = LlamaForCausalLM.from_pretrained(model_path, trust_remote_code=True).to(device)

报错: RuntimeError(Expected all tensors to be on the same device, but found at least two dev…

[GPT-1]论文实现:Improving Language Understanding by Generative Pre-Training

Efficient Graph-Based Image Segmentation 一、完整代码二、论文解读2.1 GPT架构2.2 GPT的训练方式Unsupervised pre_trainingSupervised fine_training 三、过程实现3.1 导包3.2 数据处理3.3 模型构建3.4 模型配置 四、整体总结 论文:Improving Language Understa…

【10大专题,2.8w字详解】:从张量开始到GPT的《动手学深度学习》要点笔记

🚀 《动手学深度学习PyTorch版》复习要点全记录 📘 🎯 专注于查漏补缺、巩固基础,这份笔记将带你深入理解深度学习的核心概念。通过一系列精心整理的小专题,逐步构建起你的AI知识框架。 🧠 从最基础的张量操…

国货拟人AI绘图;500+AI岗位合辑;百川x亚马逊AI黑客松;企业级AI行业图谱;100+LLM面试题与答案 | ShowMeAI日报

👀日报&周刊合集 | 🎡生产力工具与行业应用大全 | 🧡 点赞关注评论拜托啦! 🔥 上万人涌入抖音国货直播间,朴实「商战」带火国民品牌 谁能想到,李佳琦「华西子事件」意外带火了一众国货品牌的…

[论文笔记]GPT1

引言

今天带来论文Improving Language Understanding by Generative Pre-Training的笔记,它的中文题目为:通过生成式预训练改进语言理解。其实就是GPT的论文。

自然语言理解可以应用于大量NLP任务上,比如文本蕴含、问答、语义相似和文档分类。虽然无标签文本语料是丰富的,…

我用ChatGPT搞懂GPT技术原理,只问了30个问题,这是极致的学习体验!

自己前段时间写了一篇文章《问了ChatGPT 上百个问题后,我断定ChatGPT可以重塑学习范式!》,讲了使用ChatGPT的感受,最近我开始学习GPT的技术原理,原因有三个: 1、工作中有可能要用到GPT,理解GPT的…

第31期 | GPTSecurity周报

GPTSecurity是一个涵盖了前沿学术研究和实践经验分享的社区,集成了生成预训练Transformer(GPT)、人工智能生成内容(AIGC)以及大型语言模型(LLM)等安全领域应用的知识。在这里,您可以…

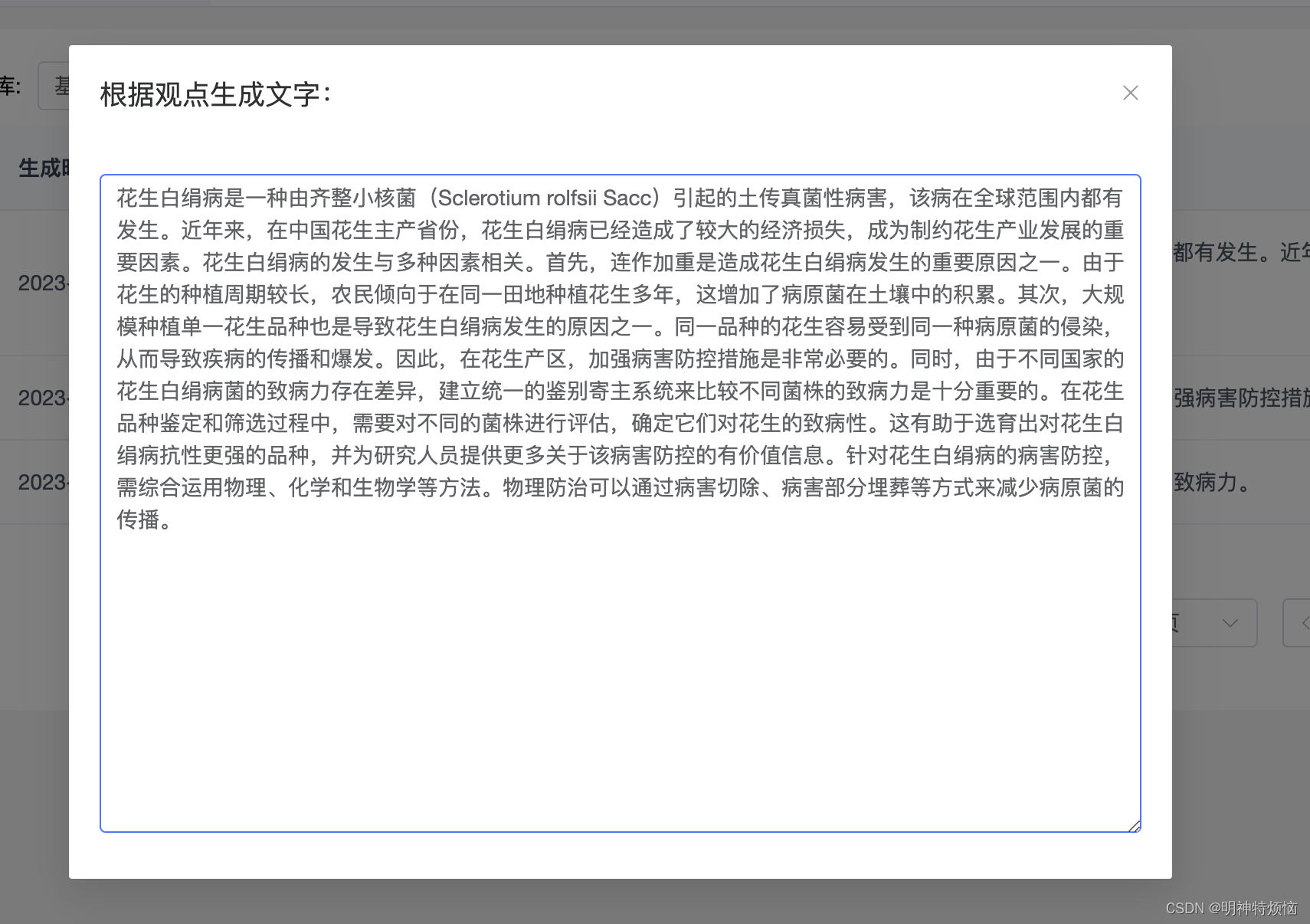

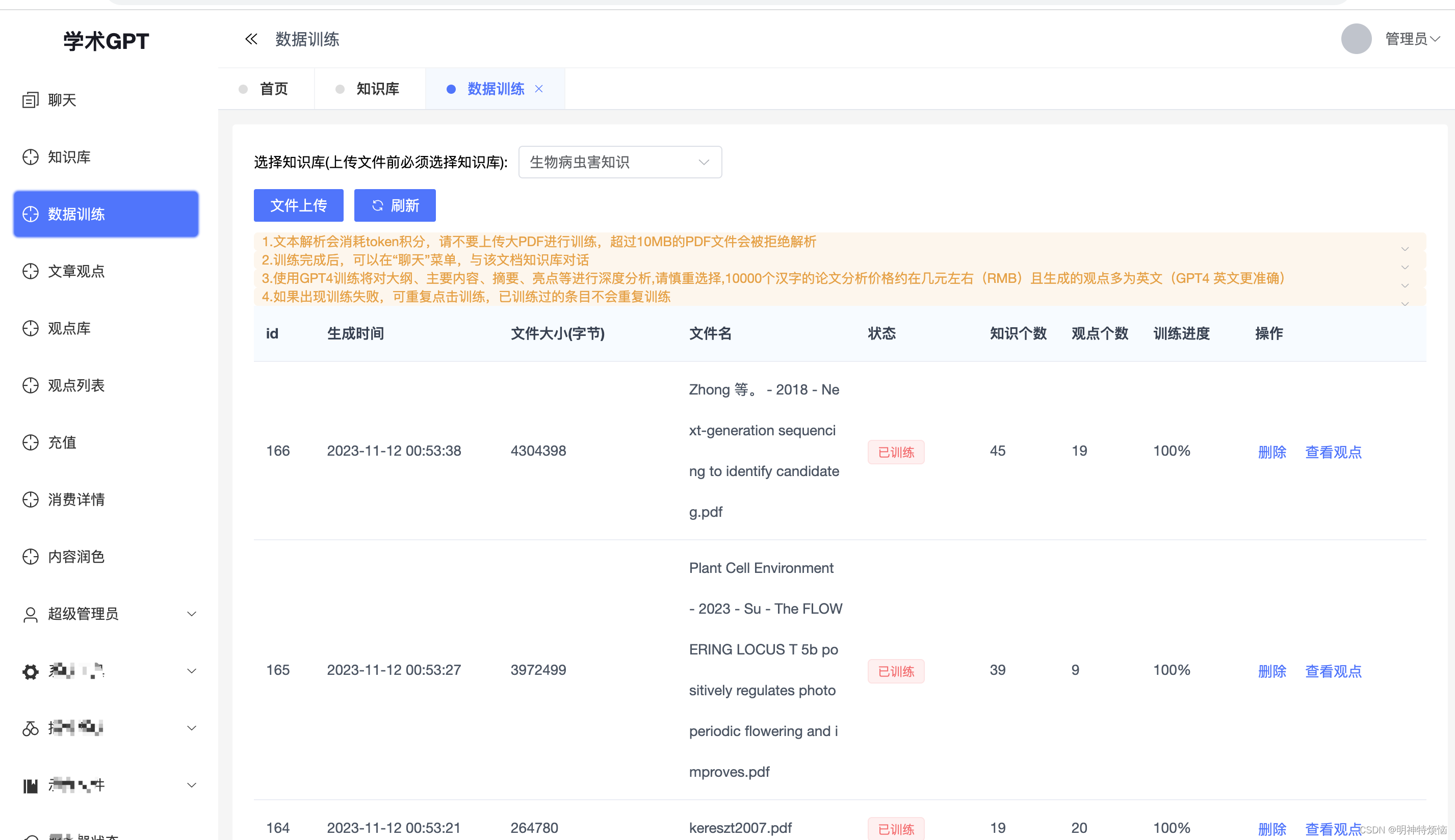

发现一款非常好用的学术GPT,可形成知识库,并分析论文,根据观点生成文字

发现一款非常好用的学术GPT,支持CHATGPT3.5交互、论文分析与生成,目前作者并未全面推广,仅在小圈子里使用,可以保证后端api的使用稳定性,不会出现大量用户共享gpt 服务,导致gpt调用超时的情况。 使用方法&a…

【2023.11.6】OpenAI发布会——近期chatgpt被攻击,不能使用

OpenAI发布会 写在最前面发布会内容GPT-4 Turbo 具有 128K 上下文函数调用更新改进了指令遵循和 JSON 模式可重现的输出和对数概率更新了 GPT-3.5 Turbo 助手 API、检索和代码解释器API 中的新模式GPT-4 Turbo 带视觉DALLE 3文字转语音 (TTS)收听语音样本…

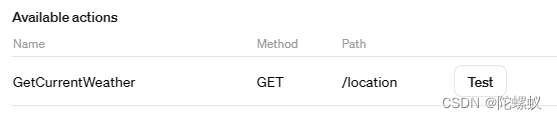

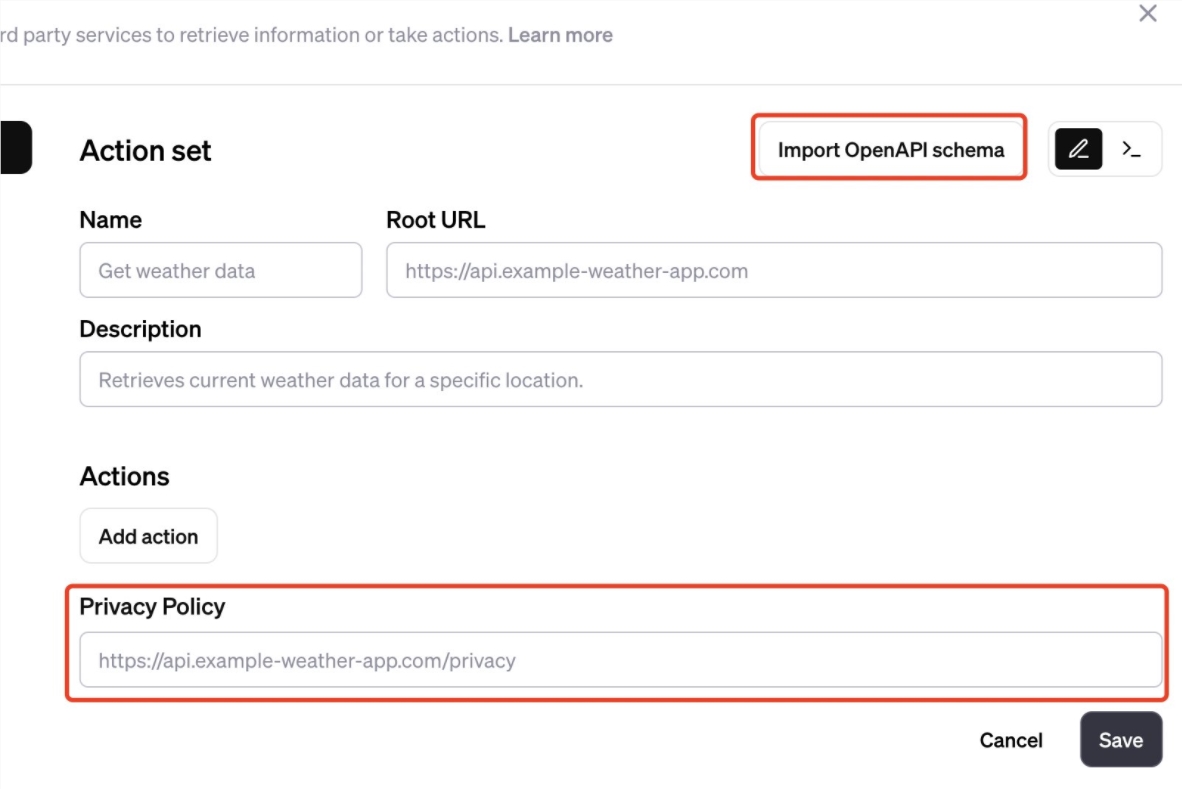

GPT应用开发:GPT插件开发指南

欢迎阅读本系列文章!我将带你一起探索如何利用OpenAI API开发GPT应用。无论你是编程新手还是资深开发者,都能在这里获得灵感和收获。 本文,我们将继续展示聊天API中插件的使用方法,让你能够轻松驾驭这个强大的工具。 插件运行效果…

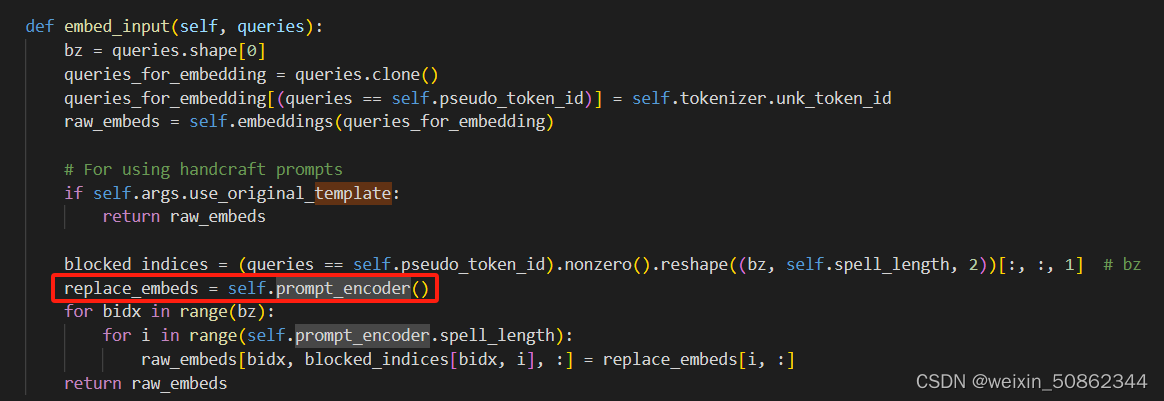

【论文解读】GPT Understands, Too

一.论文

1.1 P-tuning

区别于之前的工作,这篇工作认为promote可以在句子中的任意位置起到作用,可以将它们插入上下文或目标中 上图中,左图是不使用任何操作,右图是选择在居首和目标前插入promote的embedding,插入pro…

电商运营常用的ChatGPT通用提示词模板

商品推荐:请根据我的需求和预算,推荐一款最合适的产品。我需要考虑产品的质量、功能、价格以及售后服务等方面。 价格比较:我正在考虑购买两款价格不同的产品,请帮助我比较它们的价格、性能和品质等方面的差异。 用户评价&#…

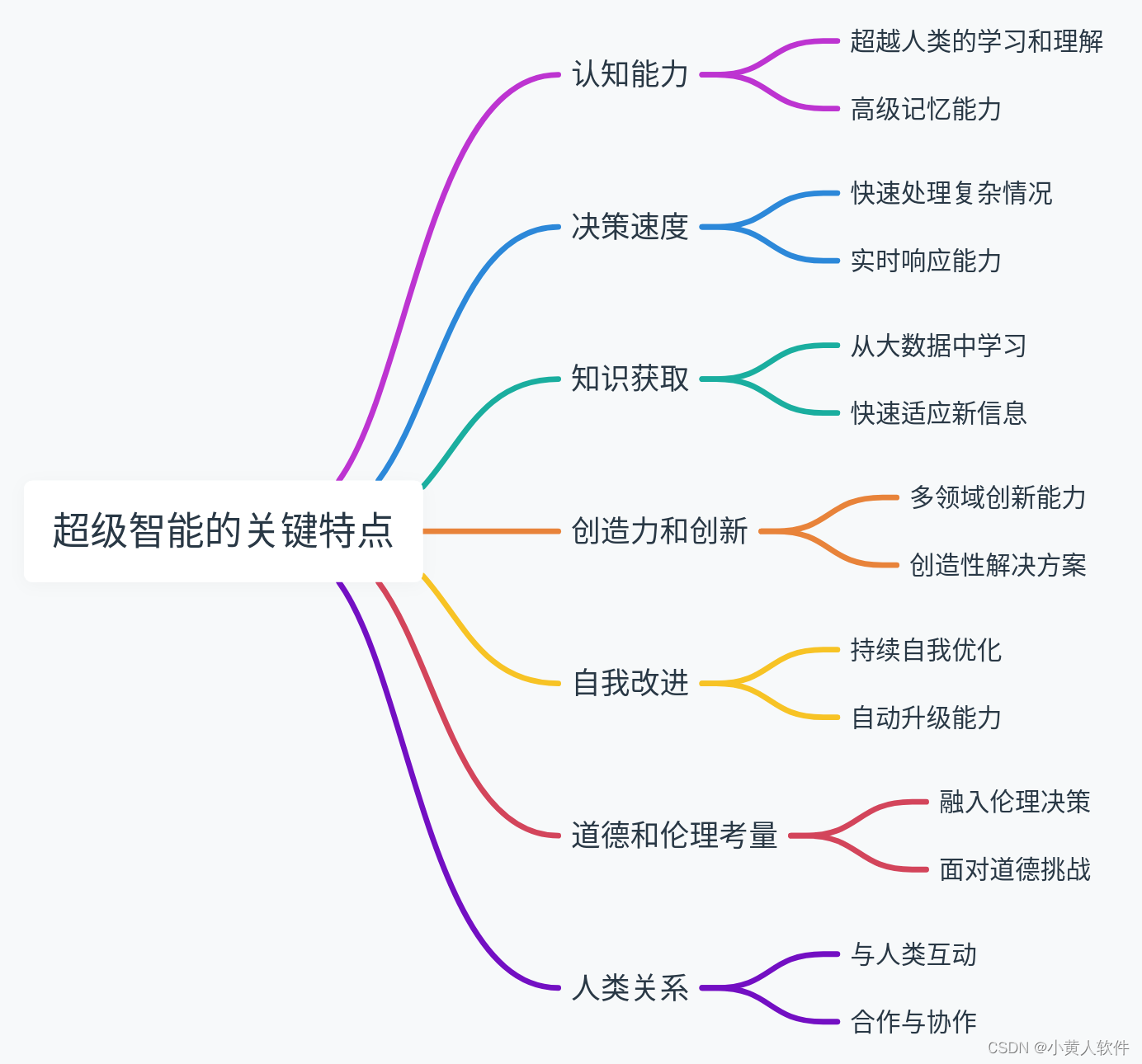

很清楚展示GPT插件的调用过程,人工智能(AI)的潜在危险与好处 超级智能 未来

好处,未来 很清楚展示GPT插件的调用过程:

把请求和要求发chatGPT chatGPT返回markdown格式发给插件 插件返回结果给用户。

你不用别人用。 人工智能(AI)的最危险之处通常与以下几个方面有关: 自主决策能力过强&…

比尔盖茨:GPT-5不会比GPT-4好多少,生成式AI已达到极限

比尔盖茨一句爆料,成为机器学习社区热议焦点:

“GPT-5不会比GPT-4好多少。” 虽然他已不再正式参与微软的日常运营,但仍在担任顾问,并且熟悉OpenAI领导团队的想法。

消息来自德国《商报》(Handelsblatt)对…

3分钟基于Chat GPT完成工作中的小程序

1. 写在前面

GPT自从去年爆发以来,各大公司在大模型方面持续发力,行业大模型也如雨后春笋一般发展迅速,日常工作中比较多的应用场景还是问答模式,作为写程序的辅助也偶尔使用。今天看到一篇翻译的博客“我用 ChatGPT,…

win10戴尔电脑安装操作系统遇到的问题MBR分区表只能安装GPT磁盘

首先按F2启动boot管理界面

调整启动盘的启动顺序,这里启动U盘为第一顺序。

第一步 选择安装程序的磁盘 第二步 转换磁盘为GPT磁盘 一般出现 磁盘0和1,说明存在两个盘 ,这里两个盘不是说的是C盘和D盘的问题,而是在物理上实际存在…

Windows Server 2016使用MBR2GPT.EXE教程!

什么是MBR2GPT.exe?

MBR2GPT.exe是微软提供的专业工具,可在命令提示符下运行。使用该工具可以将引导磁盘从MBR转换为GPT分区样式,而无需修改或删除所选磁盘上的任何内容。

在Windows Server 2019和Windows 10(1703…

PS AI功能真实测评;OpenAI提示词最佳实践官方指南;产品出海的多语言场景设计策略;AI黑客松的复兴与狂欢 | ShowMeAI日报

👀日报&周刊合集 | 🎡生产力工具与行业应用大全 | 🧡 点赞关注评论拜托啦! 🤖 百度商业AI技术创新大赛 (CTI),报名截至7月13日 百度商业AI技术创新大赛,是面向全社会开放的全国性技术创新大…

你一般什么时候会用到GPT?

GPT(Generative Pre-trained Transformer)是一种自然语言处理技术,它在各种领域和场景中都有广泛的应用。下面将详细介绍一些常见的情况,人们在这些情况下通常会使用GPT: 自然语言生成: GPT可以用于生成文本…

使用chat-GPT接口提取合同中关键信息

1 业务需求 目前公司有几千份合同,而且还会不断的增长;现在需要将合同中的关键信息提取出来给业务使用,业务现在需要将这些关键字段信息录入存档到档案系统;人工去阅读整个合同去提取这些信息,是很浪费人力的ÿ…

梁宁:VisionPro、GPT、Web3三件套齐备,元宇宙开启

本文内容整理自图灵社区对谈栏目直播,主题为 ChatGPT 真需求,从产品的第一性原理解析。 上篇内容回顾:梁宁:为什么中国没有像 ChatGPT 和 Vision Pro 这样的创新产品? 梁宁,产品战略专家,曾任湖…

GPT引领学习之旅:为不同层次程序员量身定制的Elasticsearch学习建议

为了帮助不同层次的程序员更有效地利用GPT学习Elasticsearch,我们为初级、中级和高级程序员提供以下建议:

一、初级程序员 学习基础知识:向GPT请教Elasticsearch的基本概念、核心功能和常用操作。 关注官方文档:结合Elasticsear…

003-90-13【SparkSQLDFDS】灵隐寺外桃林深处老王家女儿用GPT 问了8个问题,才把partitionBy和bucketBy给弄懂

用了8个问题,才把partitionBy 和bucketBy 给弄懂。 【SparkSQL&DF&DS】用了8个问题,才把partitionBy 和BucketBy 给弄懂。 用了8个问题,才把partitionBy 和bucketBy 给弄懂。1, 举例说明spark 的partitionBy 和 BucketBy 的区别GPT1,…

新模型GPT-5个性化定制将导致的安全问题

人工智能(AI)的发展速度远远超过了硅谷过去所见的任何其他技术。OpenAI首席执行官山姆奥特曼(Sam Altman)在最近的一次采访中表示,他们的首要任务是推出可能被称为GPT-5的新模型,这一模型将能够比现有模型做…

【AI的未来 - AI Agent系列】【MetaGPT】2. 实现自己的第一个Agent

在MetaGPT中定义的一个agent运行示例如下:

一个agent在启动后他会观察自己能获取到的信息,加入自己的记忆中下一步进行思考,决定下一步的行动,也就是从Action1,Action2,Action3中选择执行的Action决定行动…

利用gpt进行GMV变化数据分析

prompt: 现在已知男性GMV从800降至600,女性GMV从1200至1300,请计算男女GMV变动对整体GMV变动的贡献度 output:

在这个问题中,我们要计算男性和女性的GMV(总销售额)变动对整体GMV变动的贡献度。首先,计算男…

大模型学习与实践笔记(七)

一、环境配置

1.平台:

Ubuntu Anaconda CUDA/CUDNN 8GB nvidia显卡 2.安装

# 构建虚拟环境

conda create --name xtuner0.1.9 python3.10 -y # 拉取 0.1.9 的版本源码

git clone -b v0.1.9 https://github.com/InternLM/xtuner# 从源码安装 XTuner

pip insta…

李宏毅gpt个人记录

参考:

李宏毅机器学习--self-supervised:BERT、GPT、Auto-encoder-CSDN博客 用无标注资料的任务训练完模型以后,它本身没有什么用,GPT 1只能够把一句话补完,可以把 Self-Supervised Learning 的 Model做微微的调整&am…

开源vs闭源大模型如何塑造技术的未来?开源模型的优劣势未来发展方向

开源vs闭源大模型如何塑造技术的未来?开源模型的优劣势&未来发展方向 写在最前面一、开源与闭源:定义与历史背景开源和闭源的定义开源大模型:社区驱动的创新 二、开源和闭源的优劣势比较开源大模型(瓶颈)数据&…

AI生成视频-Pika

背景介绍

Pika 是一个使用 AI 生成和编辑视频的平台。它致力于通过 AI 技术使视频制作变得简单和无障碍。

Pika 1.0 是 Pika 的一个重大产品升级,包含了一个新的 AI 模型,可以在各种风格下生成和编辑视频,如 3D 动画,动漫,卡通和电影风格。…

IOS最新版开通GPT-PLUS方法

前提,美国IP魔法 不多说了

1.拥有一个美区apple id账号

可以买,也可以自己申请

自己申请就打开魔法到apple官网注册,用gmail邮箱,然后地址用美国地址生成器,记得选免税州

2.充值礼品卡

支付宝可以充值礼品卡&…

GPT5将会自己开发新的人工智能?

以下是GPT5 可以预期的7大最具变革性的能力 第一大能力扩展多模式理解 GPT5有望在多模态理解方面表现出色 使其不仅能够处理文本和图像 还能处理音频和视频内容 这种复杂的理解水平 将使GPT5能够跨各种媒体格式 分析和生成上下文 准确的转入翻译和摘要 从而改变我们与内容的交互…

亲测可用国产GPT人工智能

分享一些靠谱、可用、可以白嫖的GPT大模型。配合大模型,工作效率都会极大提升。

清华大学ChatGLM

官网:

智谱清言中国版对话语言模型,与GLM大模型进行对话。https://chatglm.cn/开源的、支持中英双语的1300亿参数的对话语言模型࿰…

如何用ChatGPT做书籍、报告、文件的读取与互动式问答?故事人物活起来

该场景对应的关键词库(15个): 书籍、报告、文件、详细信息、查询、主题、作者、出版日期、出版社、问题、方面、原则、方法、概括、主要观点、解释。

注意: ChatGPT的知识库截止于2021年9月,对于更新的数据或最新出版…

通过fu过 Function Calling 查询数据库

from openai import OpenAI import os import json

from dotenv import load_dotenv, find_dotenv _ load_dotenv(find_dotenv()) # 读取本地 .env 文件,里面定义了 OPENAI_API_KE

client OpenAI( api_keyos.getenv(“OPENAI_API_KEY”), base_urlos.getenv(“O…

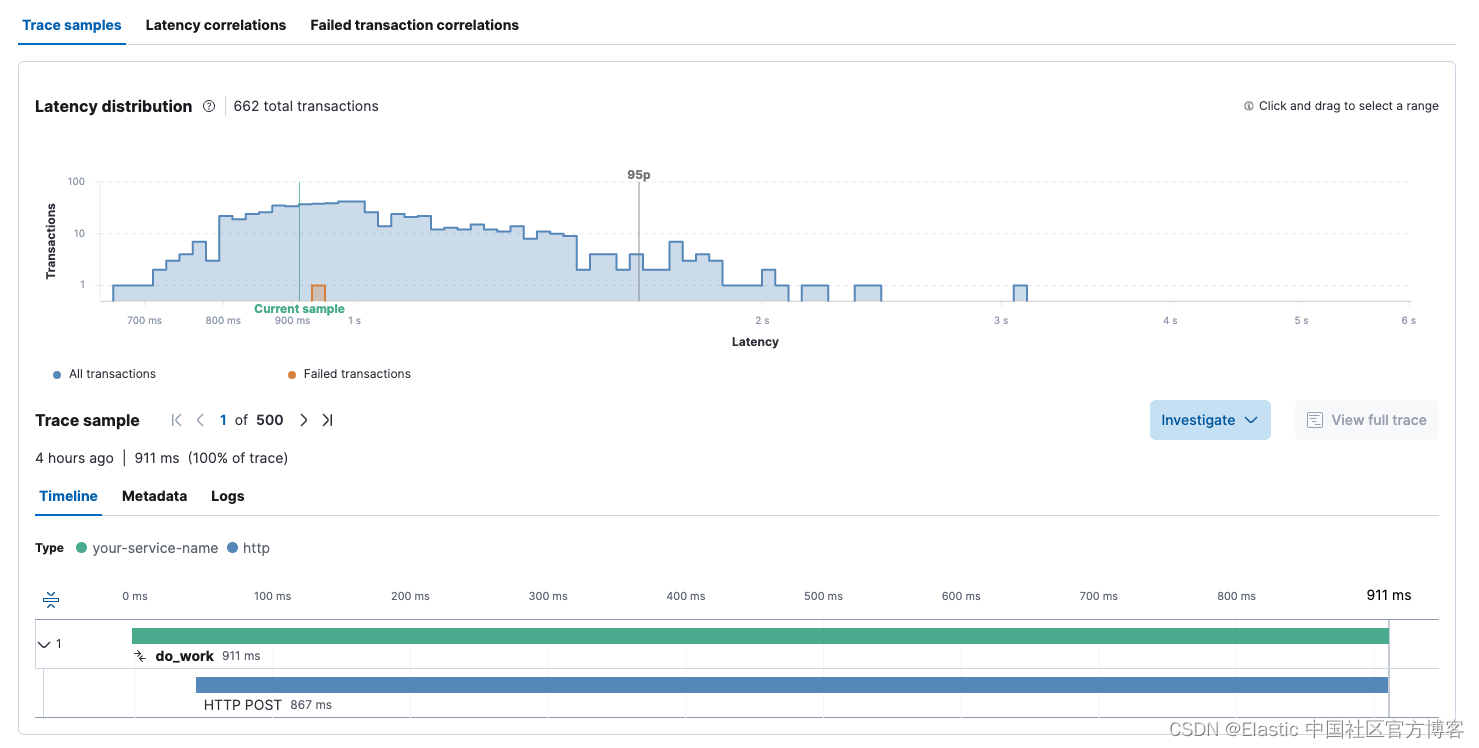

Observability:使用 OpenTelemetry 和 Elastic 监控 OpenAI API 和 GPT 模型

作者:David Hope ChatGPT 现在很火,它打破了互联网。 作为 ChatGPT 的狂热用户和 ChatGPT 应用程序的开发者,我对这项技术的可能性感到无比兴奋。 我看到的情况是,基于 ChatGPT 的解决方案将呈指数级增长,人们将需要监…

GPT系列论文解读:GPT-1

GPT系列

GPT(Generative Pre-trained Transformer)是一系列基于Transformer架构的预训练语言模型,由OpenAI开发。以下是GPT系列的主要模型: GPT:GPT-1是于2018年发布的第一个版本,它使用了12个Transformer…

我会在以下情况用到GPT

ChatGPT可以在各种情况下派上用场,包括但不限于以下情况: 获取信息:你可以使用ChatGPT来获取关于各种主题的信息,例如历史事件、科学知识、文化背景等。ChatGPT可以用作一个知识库,回答你的问题。 学习新知识…

因为AI,我被裁了;MJ设计海报全流程;独立开发者每周收入2.3K美元;MJ常用参数超详细介绍 | ShowMeAI日报

👀日报&周刊合集 | 🎡生产力工具与行业应用大全 | 🧡 点赞关注评论拜托啦! 🤖 受 AI 影响,这 8 家公司开始裁员…… 为了搞清楚 AI 最近在影响哪些行业、哪些职业,作者花了三天事件找到了八…

在国内购买GPT服务前的一定要注意!!!

本人已经入坑GPT多日,从最开始的应用GPT到现在的自己研发GPT,聊聊我对使用ChatGPT的一些思考,有需要使用GPT的朋友或者正在使用GPT的朋友,一定要看完这篇文章,可能会比较露骨,也算是把国内知识库、AI的套路…

【promptulate专栏】使用ChatGPT和XMind快速构建思维导图

本文节选自笔者博客:https://www.blog.zeeland.cn/archives/ao302950h3j 💖 作者简介:大家好,我是Zeeland,全栈领域优质创作者。📝 CSDN主页:Zeeland🔥📣 我的博客&#…

gpt今日最新新闻:gpts的广泛应用

最近,OpenAI给ChatGPT带来了一个备受期待的更新——“GPT提及(mentions)”功能。这项创新不仅增强了ChatGPT的实用性,也为AI在日常业务中的运用开辟了新路径。在本文中,我将分享我对这项新功能的初步体验,并…

龙哥风向标 20230321~20230328 GPT拆解

AI领域多家公司发布创新产品

盈利点:利用AI领域多家公司发布创新产品的商机,可以开发针对这些新产品的培训课程或者定制化解决方案,以满足市场对新技术的需求。

操作步骤:

调研各家公司发布的新产品,了解其特点和应…

【不需要网络不需要显卡】本地部署GPT

【不需要网络/不需要显卡】本地部署GPT

大家好,我是老 J

我们都知道ChatGPT目前只有两种使用方式,一种是直接去官网访问,适合个人用户;另一种是API调用,适合企业或者网站使用。这两种方式的门槛都比较高,…

Python调用GPT3.5接口的最新方法

GPT3.5接口调用方法主要包括openai安装、api_requestor.py替换、接口调用、示例程序说明四个部分。

1 openai安装 Python openai库可直接通过pip install openai安装。如果已经安装openai,但是后续提示找不到ChatCompletion,那么请使用命令“pip instal…

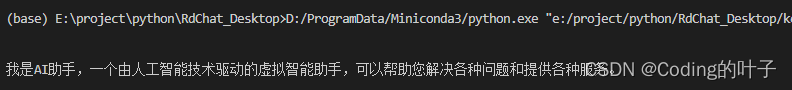

论文笔记--Toolformer: Language Models Can Teach Themselves to Use Tools

论文笔记--Toolformer: Language Models Can Teach Themselves to Use Tools 1. 文章简介2. 文章概括3 文章重点技术3.1 Toolformer3.2 APIs 4. 文章亮点5. 原文传送门 1. 文章简介

标题:Toolformer: Language Models Can Teach Themselves to Use Tools作者&#…

前端工程师常用的ChatGPT通用提示词模板

HTML/CSS基础:如何熟练掌握HTML/CSS基础,包括常用标签、布局方式、样式应用等? JavaScript深入理解:如何深入理解JavaScript语言特性,包括变量类型、函数、闭包、异步编程等? 前端框架学习:如…

AIGPT中文版(人人都能使用的GPT工具)生活工作的好帮手。

AIGPT简介

AIGPT是一款非常强大的人工智能技术的语言处理工具软件,它具有 AI绘画 功能、AI写作、写论文、写代码、哲学探讨、创作等功能,可以说是生活和工作中的好帮手。 我们都知道使用ChatGPT是需要账号以及使用魔法的,其中的每一项对我们…

【GitHub项目推荐--GPT开源项目】【转载】

Auto-GPT

Auto-GPT 是一个实验性的开源项目,基于 GPT-4。你给出 Auto-GPT 一个的任务,它不会立即输出答案,而会先自己通过多轮对话来琢磨、验证、决策,从而自己找出一条达成目标的路,整个过程完全不需要人类插手&…

策略产品经理常用的ChatGPT通用提示词模板

产品策略:请帮助我制定一个策略产品的产品策略。 市场调研:如何进行策略产品的市场调研? 竞争分析:如何进行策略产品的竞争分析? 用户画像:如何构建策略产品的用户画像? 产品定位࿱…

GPT属于AI,是LLM的一种实现

GPT(Generative Pre-trained Transformer)作为一种创新的语言模型,既属于人工智能(AI)的一部分,也是大规模语言模型(LLM)的一种实现。本文将探讨GPT在AI和LLM领域的重要性和影响。

…

如何充值GPT会员账号?

详情点击链接:如何充值GPT会员账号?

一OpenAI

1.最新大模型GPT-4 Turbo 2.最新发布的高级数据分析,AI画图,图像识别,文档API

3.GPT Store

4.从0到1创建自己的GPT应用

5. 模型Gemini以及大模型Claude2二定制自己的…

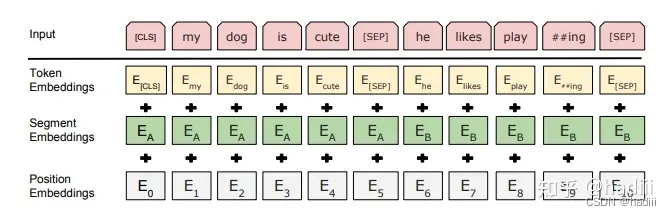

从零开始复现GPT2(二):模型实现和掩码机制

源码地址:https://gitee.com/guojialiang2023/gpt2 GPT2 模型掩码机制PadMasking 类功能构造函数 (__init__)forward 方法 FutureMasking 类功能forward 方法 模型实现 offset的作用:PadMasking中FutureMasking中 模型 掩码机制

定义了两个类࿱…

项目管理常用的ChatGPT通用提示词模板

项目目标设定:如何设定明确、可衡量的项目目标? 项目计划制定:如何制定详细的项目计划,包括时间表、任务分配、资源需求等? 风险管理:如何识别和评估项目风险,并制定相应的应对措施࿱…

ChatGPT实战手册

ChatGPT是 OpenAI 的一个强大的自然语言处理模型,它可以生成人类般的文本。在这篇文章中,我们将通过一个实战示例来展示如何安装、配置和使用 ChatGPT。

安装

首先,你需要安装 OpenAI 的 Python 客户端库。你可以使用 pip 来安装࿱…

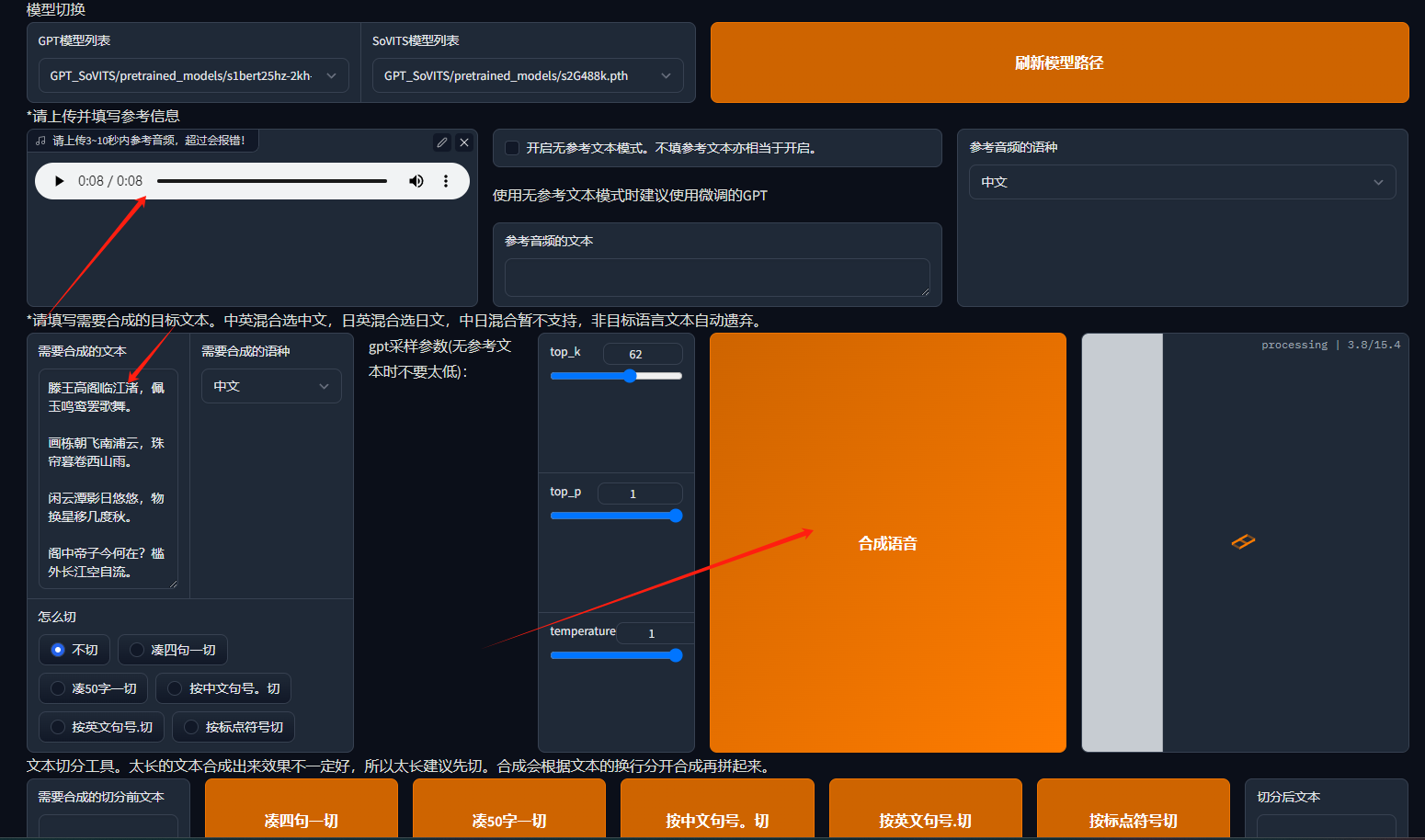

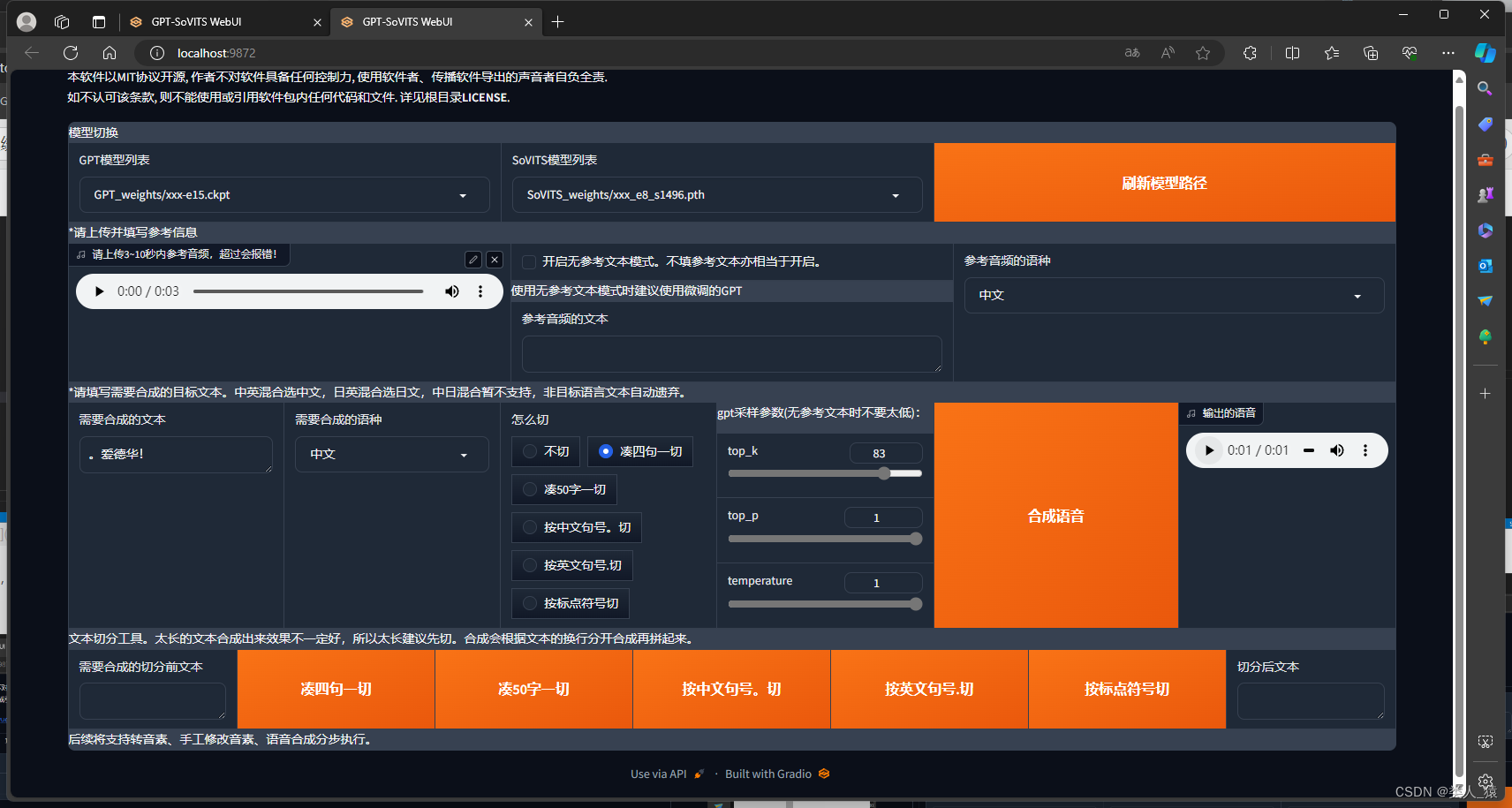

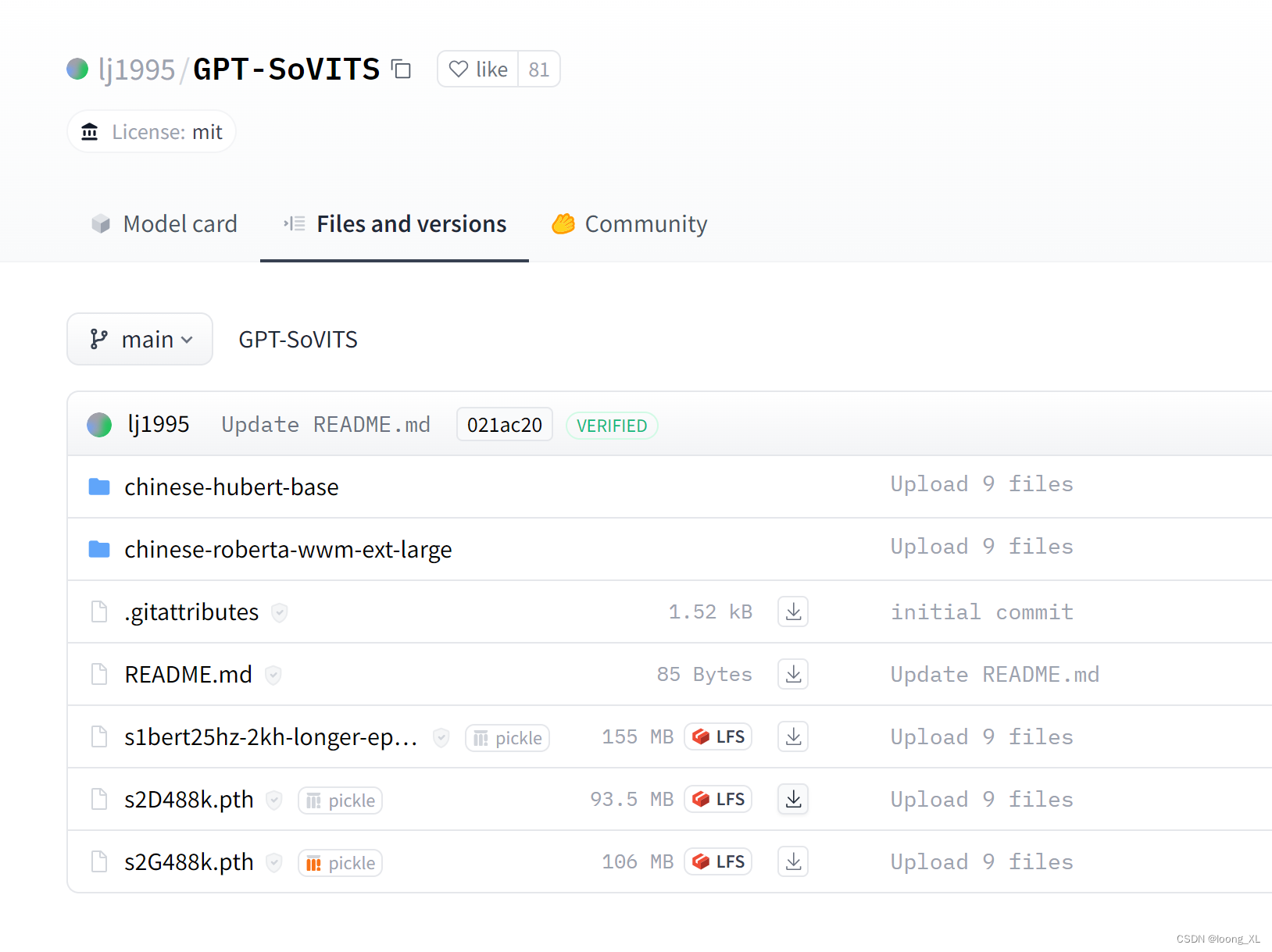

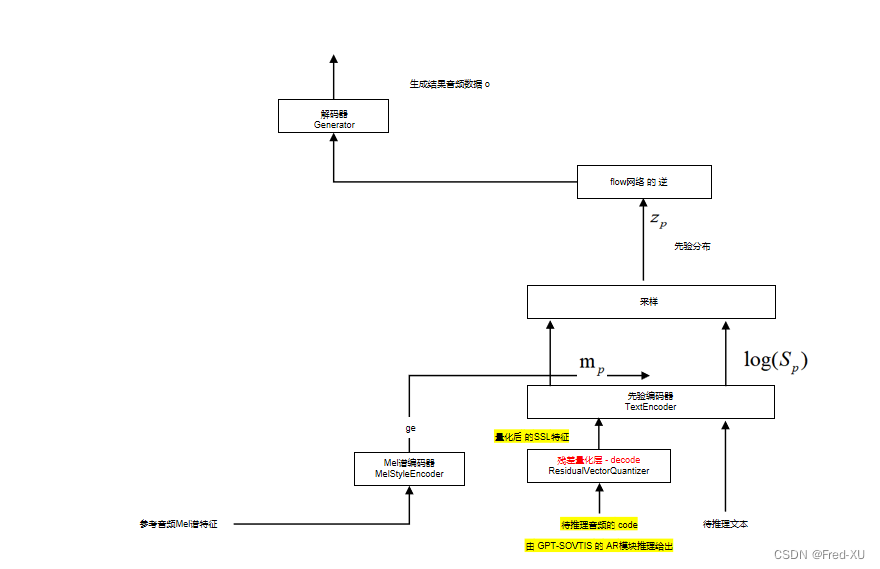

让AI帮你说话--GPT-SoVITS教程

有时候我们在录制视频的时候,由于周边环境嘈杂或者录音设备问题需要后期配音,这样就比较麻烦。一个比较直观的想法就是能不能将写好的视频脚本直接转换成我们的声音,让AI帮我们完成配音呢?在语音合成领域已经有很多这类工作了&…

最新GPT4.0使用教程,AI绘画,ChatFile文档对话总结+GPT语音对话使用,DALL-E3文生图

一、前言

ChatGPT3.5、GPT4.0、GPT语音对话、Midjourney绘画,文档对话总结DALL-E3文生图,相信对大家应该不感到陌生吧?简单来说,GPT-4技术比之前的GPT-3.5相对来说更加智能,会根据用户的要求生成多种内容甚至也可以和…

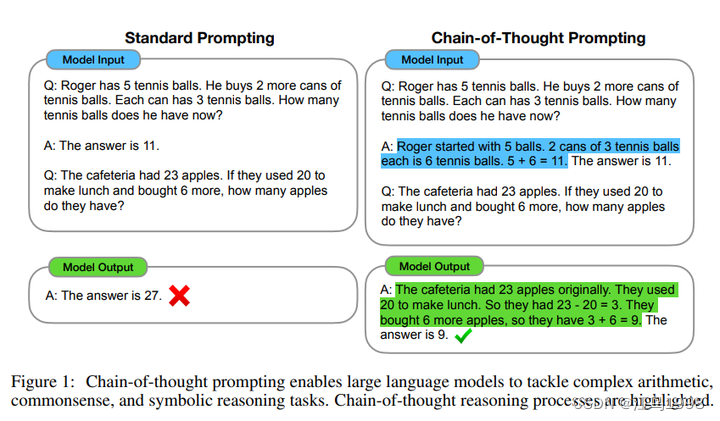

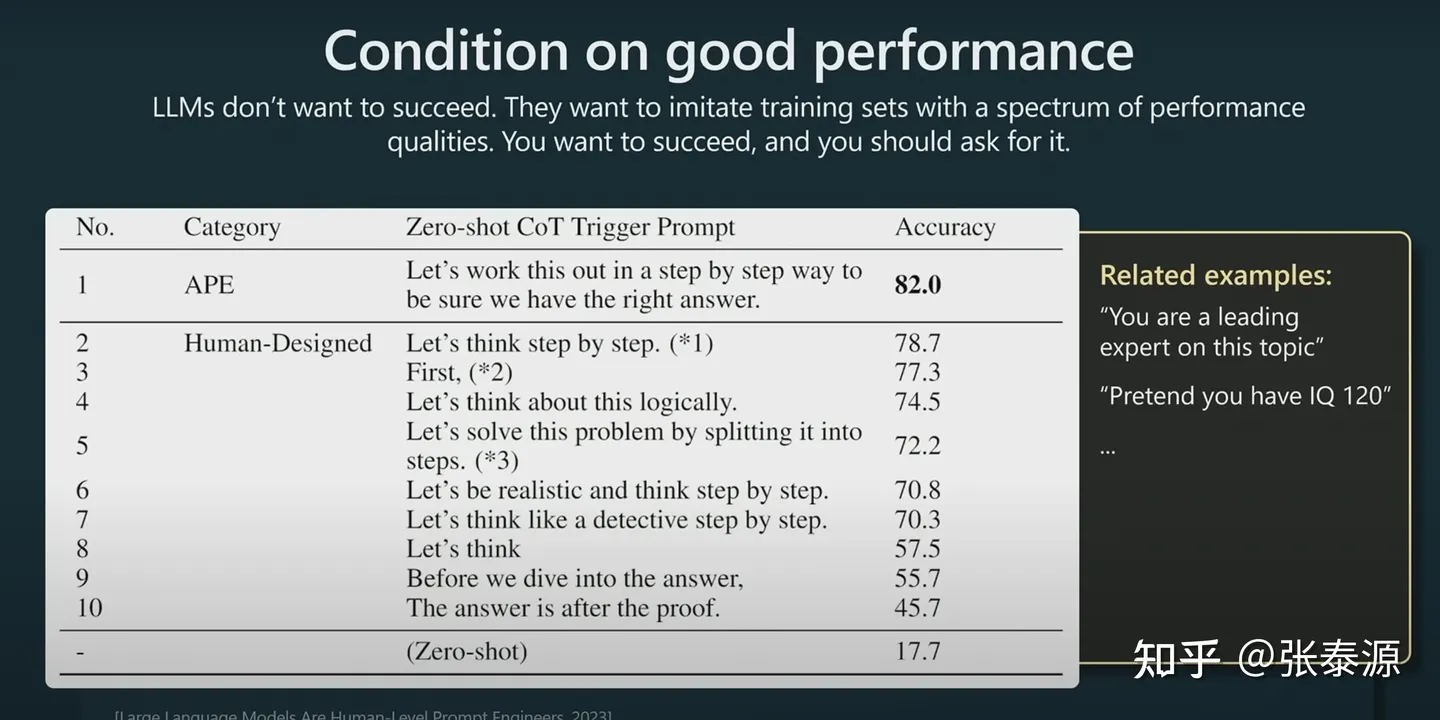

认知篇:什么是CoT(思维链)? 也许GPT需要你引导

本系列文章主要是分享一些关于大模型的一些学术研究或者实验性质的探索,为大家更新一些针对大模型的认知。所有的结论我都会附上对应的参考文献,有理有据,也希望这些内容可以对大家使用大模型的过程有一些启发。 注:本系列研究关注…

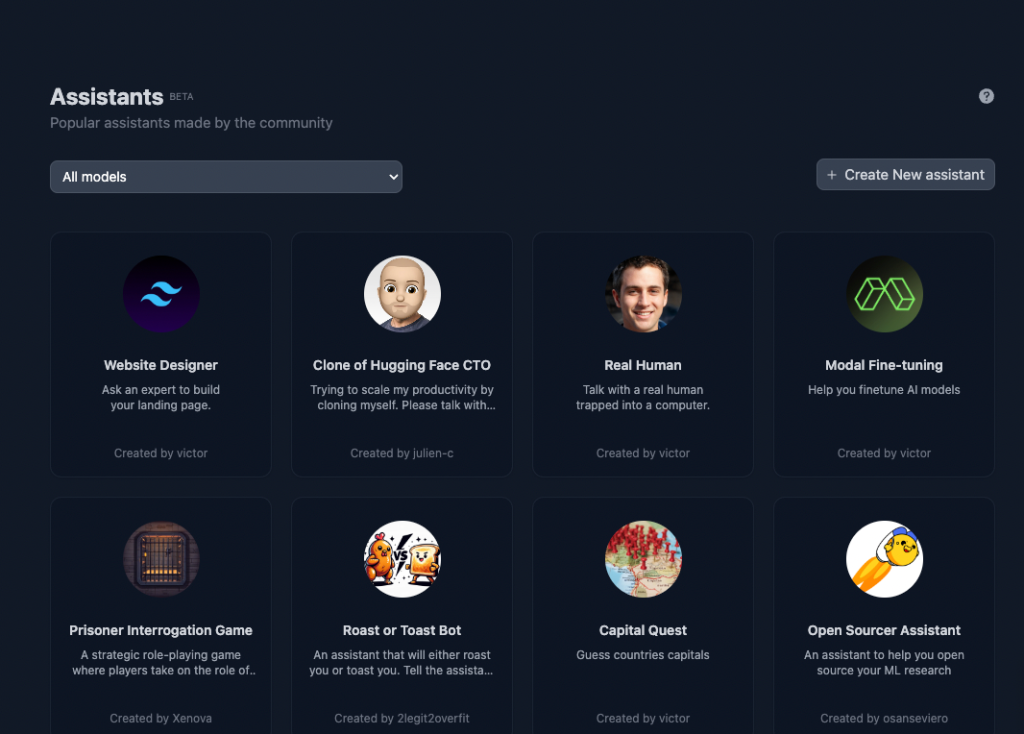

Hugging Face 刚刚推出了一款开源的 AI 助手制造工具,直接向 OpenAI 的定制 GPT 挑战

每周跟踪AI热点新闻动向和震撼发展 想要探索生成式人工智能的前沿进展吗?订阅我们的简报,深入解析最新的技术突破、实际应用案例和未来的趋势。与全球数同行一同,从行业内部的深度分析和实用指南中受益。不要错过这个机会,成为AI领…

【每周AI简讯】GPT-5将有指数级提升,GPT Store正式上线

AI7 - Chat中文版最强人工智能

OpenAI的CEO奥特曼表示GPT-5将有指数级提升

GPT奥特曼参加Y-Combinator W24启动会上表示,我们已经非常接近AGI。GPT-5将具有更好的推理能力、更高的准确性和视频支持。 GPT Store正式上线

OpenAI正式推出GPT store,目前…

最新ChatGPT/GPT4科研应用与AI绘图及论文高效写作

详情点击链接:最新ChatGPT/GPT4科研应用与AI绘图及论文高效写作

一OpenAI

1.最新大模型GPT-4 Turbo 2.最新发布的高级数据分析,AI画图,图像识别,文档API

3.GPT Store

4.从0到1创建自己的GPT应用

5. 模型Gemini以及大模型Clau…

ChatGpt报错:We ran into an issue while authenticating you解决办法

在登录ChatGpt时报错:Oops!,We ran into an issue while authenticating you.(我们在验证您时遇到问题),记录一下解决过程。

完整报错: We ran into an issue while authenticating you. If this issue persists, please contact…

手写GPT实现小说生成(一)

引言

本文开始从零实现GPT1做一个小说续写器,即只需要给出一些文本,让模型帮你续写,主要内容包含:

模型编写训练适配小说的中文分词器将小说按固定大小拆分生成数据集拆分训练/测试集训练体验小说续写效果

同时结合HuggingFace…

AI时代—ChatGPT-4.5的正确打开方式

前言 前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家:https://www.captainbed.cn/z

ChatGPT体验地址 文章目录 前言4.5key价格泄漏ChatGPT4.0使用地址ChatGPT正确打开方式最新功能语音助手存档…

[AI]文心一言爆火的同时,ChatGPT-4.5的正确打开方式